Eine schöne Oberfläche bedeutet nichts, wenn der Motor darunter nicht das ist, wofür Sie bezahlt haben.

Ich möchte KI-Coding-Tools wirklich jedem empfehlen – nicht nur professionellen Entwicklern, sondern jedem, der sich schon einmal gewünscht hat, einen Computer genau das tun zu lassen, was er sich vorgestellt hat. Diese Agenten-IDEs haben die Macht, die Softwareerstellung zu demokratisieren und Ideen durch einfache Konversation in die Realität umzusetzen. Als ich Windsurf im November 2025 zum ersten Mal öffnete, war ich also hoffnungsvoll. Die Oberfläche war wunderschön. Das Versprechen war überzeugend. Drei Millionen monatliche Nutzer konnten nicht alle falsch liegen, oder? Aber schon bei meiner ersten Testsitzung entdeckte ich etwas, das mich alles an dieser Plattform in Frage stellen ließ. Was ich fand, war kein Fehler oder eine fehlende Funktion – es war ein grundlegendes Vertrauensproblem, über das jeder potenzielle Abonnent Bescheid wissen sollte.

Meine Reise zu Windsurf

Lassen Sie mich von Anfang an eines klarstellen: Ich wollte verzweifelt, dass Windsurf großartig ist. Nach Jahren der Nutzung webbasierter KI-Tools, des Kopierens und Einfügens von Code zwischen Browser-Tabs, bis meine Geduld am Ende war, war ich bereit für die Agenten-Revolution. Tools, die Ihre Dateien tatsächlich berühren, Ihre Codebasis verstehen und an Ihrer Seite arbeiten können, anstatt nur über ein Browserfenster mit Ihnen zu chatten – das war die Zukunft, auf die ich gewartet hatte.

Meine erste Begegnung mit Windsurf fand im November 2025 statt, am selben Tag, an dem ich Warp entdeckte. Ich war auf einer Mission, den perfekten KI-Coding-Begleiter zu finden, und testete jedes Tool, das ich in die Finger bekommen konnte. Warp beeindruckte mich sofort mit seinem terminal-nativen Ansatz und dem ehrlichen Umgang mit Modellen. Aber Windsurf? Mein erster Eindruck war, dass jenseits seines zugegebenermaßen schönen Äußeren etwas nicht stimmte.

Ich wollte keine Zeit mit einem Tool verschwenden, das vielleicht am wichtigsten Teil spart – den KI-Modellen selbst. Also tat ich das, was ich bei jeder KI-Plattform tue: Ich führte meinen universellen Verifizierungstest durch.

Die Ergebnisse ließen mich innehalten.

Ich ermutige jeden dringend, KI-IDE-Agenten zu erkunden – auch Nicht-Programmierer. Diese Tools können jeden zu einem fähigen Schöpfer machen. Sie brauchen keine jahrelange Ausbildung oder tiefes technisches Wissen. Mit dem richtigen KI-Assistenten müssen Sie nur Ideen haben und wissen, wie man sie kommuniziert. Aber die Wahl des richtigen Tools ist wichtiger, als Sie vielleicht denken.

Laut SimilarWeb zieht Windsurf derzeit rund 3 Millionen monatliche Besucher an. Das ist erheblicher Verkehr – das Dreifache dessen, was Warp erhält. Die Basis der zahlenden Abonnenten ist wahrscheinlich beträchtlich. Aber Beliebtheit garantiert keine Qualität, und meine Tests enthüllten Bedenken, die jeder potenzielle Nutzer verstehen sollte, bevor er sein Geld und sein Vertrauen investiert.

Die KI-Revolution hat es möglich gemacht, dass gewöhnliche Menschen – unabhängig von Beruf oder Hintergrund – außergewöhnliche Dinge schaffen können. Wir sind nicht mehr durch das Wissen begrenzt, das wir in der Schule angesammelt haben, oder durch die Fähigkeiten, die wir aus Lehrbüchern auswendig gelernt haben. Mit der richtigen Einstellung und KI-Partnern kann jeder bauen. Aber dieses Versprechen funktioniert nur, wenn die Tools ehrlich sind in dem, was sie bieten.

Was ist Windsurf und warum es wichtig ist

Windsurf ist ein KI-gestützter Code-Editor, der von Codeium entwickelt wurde, einem Unternehmen, das 2021 als Exafunction begann – einem GPU-Virtualisierungs-Startup, das von den MIT-Kommilitonen Varun Mohan und Douglas Chen gegründet wurde. Als die Gründer die generative KI-Welle kommen sahen, schwenkten sie hart auf Entwickler-Tools um. Bis 2022 wurde die Autovervollständigungs-Erweiterung von Codeium von Hunderttausenden von Entwicklern weltweit genutzt.

Das Unternehmen benannte sich im April 2024 in Windsurf um, um seine Expansion über die einfache Autovervollständigung hinaus in eine umfassende Entwicklerumgebung widerzuspiegeln. Das Rebranding fiel mit der Einführung ihres Flaggschiff-Features zusammen: Cascade. Bis Juli 2025 war Windsurf beeindruckend gewachsen – mit einem jährlich wiederkehrenden Umsatz von 82 Millionen Dollar, über 350 Unternehmenskunden wie JPMorgan Chase und Dell und mehr als 1 Million Entwicklern, die es täglich nutzen.

Die Kernphilosophie

Wie Cursor ist Windsurf ein Fork von VS Code, was bedeutet:

🎯 Vertrautes Terrain

Wenn Sie VS Code genutzt haben, werden Sie sich sofort wie zu Hause fühlen. Gleiche Oberfläche, gleiche Tastenkombinationen, gleiches Erweiterungs-Ökosystem (größtenteils). Der Übergang ist bemerkenswert reibungslos.

🤖 Cascade-Zentriert

Alles dreht sich um Cascade, ihren KI-Assistenten, der Ihre gesamte Codebasis verstehen und Mehrfachdatei-Bearbeitungen aus natürlichsprachlichen Anweisungen vornehmen kann. Es ist als Ihr KI-Teamkollege konzipiert, nicht nur als Autovervollständigungs-Tool.

👀 Flow-Zustand-Fokus

Windsurf schreibt Änderungen auf die Festplatte, bevor Sie sie genehmigen, sodass Sie Ergebnisse in Ihrem Dev-Server in Echtzeit sehen können. Dies hält Sie im kreativen Fluss ohne ständigen Kontextwechsel.

🌐 Plattformübergreifend

Verfügbar auf macOS, Linux und Windows als eigenständige Anwendung sowie JetBrains-Plugin-Unterstützung für diejenigen, die dieses Ökosystem bevorzugen. Über 40+ IDE-Integrationen insgesamt.

Der Marketing-Pitch ist überzeugend: "Alles, was Sie an Cursor lieben, aber billiger und zugänglicher." Mit 15 $/Monat für Pro gegenüber Cursors 20 $/Monat scheint das Preis-Leistungs-Verhältnis klar zu sein. Aber wie ich entdecken würde, sind die wahren Kosten eines Tools nicht nur das, was Sie bezahlen – es ist das, was Sie tatsächlich erhalten.

Die Branche hat Windsurfs Ambitionen sicherlich bemerkt. Cognitions Windsurf wurde als "Leader im Gartner® Magic Quadrant™ 2025 für KI-Code-Assistenten" ausgezeichnet und verdiente sich einen Platz auf der Forbes AI 50-Liste. Aber Auszeichnungen übersetzen sich nicht immer in vertrauenswürdige Produkte, wie meine Tests enthüllen würden.

Cascade-Modus Deep Dive

Wenn Windsurf ein Killer-Feature hat, dann ist es Cascade. Dies ist ihre Antwort auf Cursors Composer – eine Chat-Schnittstelle, die mehrere Dateien gleichzeitig basierend auf natürlichsprachlichen Anweisungen bearbeiten kann. Wenn es funktioniert, fühlt es sich wirklich wie Magie an. Die Kernmission von Windsurf ist es, den Kontextwechsel zu minimieren und Entwicklern zu helfen, einen "Flow-Zustand" zu erreichen und aufrechtzuerhalten – jenen Zustand tiefer, müheloser Konzentration, in dem die Produktivität in die Höhe schießt.

Was Cascade besonders macht

Traditionelle Code-Editoren erfordern, dass Sie genau angeben, was Sie wo geändert haben möchten. Cascade dreht dies um: Sie beschreiben Ihre Absicht, und es findet heraus, welche Dateien geändert werden müssen, welche Änderungen vorzunehmen sind und in welcher Reihenfolge. Es kombiniert tiefes Verständnis der Codebasis, eine Breite an fortschrittlichen Tools und ein Echtzeit-Bewusstsein Ihrer Aktionen in einen leistungsstarken, nahtlosen und kollaborativen Fluss.

Ich: "Füge Benutzerauthentifizierung mit JWT-Tokens hinzu. Inklusive Routen, Middleware und Tests."

Cascade: [Analysiert Codebasis]

Ich werde diese Änderungen vornehmen:

- Erstelle src/auth/middleware.ts (neue Datei)

- Aktualisiere src/routes/users.ts (füge Auth zu Routen hinzu)

- Erstelle src/services/jwt.ts (Token-Handling)

- Aktualisiere src/types/user.ts (füge Token-Typen hinzu)

- Erstelle tests/auth.test.ts (Testabdeckung)

[Zeigt Diff für jede Datei]

Änderungen akzeptieren? [Ja] [Einzeln prüfen] [Nein]Die drei Cascade-Modi

Erlaubt Cascade, Dateien in Ihrer Codebasis zu erstellen und zu modifizieren. Hier passiert die Agenten-Magie – Mehrfachdatei-Bearbeitungen, Erstellung neuer Dateien, Code-Refactoring. Es ist wie AutoGPT für Ihre Codebasis, erstellt mehrere Dateien, führt Skripte aus, testet sie und debuggt automatisch.

Optimiert für Fragen zu Ihrer Codebasis oder allgemeinen Coding-Prinzipien. Keine Datei-Modifikationen – nur Konversation und Erklärung. Perfekt, wenn Sie etwas verstehen wollen, ohne Änderungen an Ihrem Code zu riskieren.

KI generiert kontinuierlich, ohne auf Genehmigung zu warten. Perfekt für Scaffolding und Boilerplate, aber danach sorgfältig prüfen – es kann schnell viele Änderungen vornehmen. Für fortgeschrittene Entwickler ist dies eine große Zeitersparnis. Für vorsichtige Teams birgt es Risiken.

Echtzeit-Bewusstsein

Eine wirklich beeindruckende Fähigkeit: Cascade beobachtet Ihre Aktionen in Echtzeit. Es verfolgt alle Ihre Aktionen – Bearbeitungen, Befehle, Konversationsverlauf, Zwischenablage, Terminalbefehle –, um Absichten abzuleiten und sich in Echtzeit anzupassen. Machen Sie eine manuelle Bearbeitung, und Sie können einfach "mach weiter" eingeben – es versteht, was Sie gerade getan haben, und macht dort weiter, wo Sie aufgehört haben. Dieses kontextbezogene Bewusstsein schafft einen überraschend natürlichen Kollaborationsfluss.

Eingebaute Planungsfähigkeiten

Cascade verfügt über eingebaute Planungsfähigkeiten, die helfen, die Leistung bei längeren Aufgaben zu verbessern. Im Hintergrund verfeinert ein spezialisierter Planungsagent kontinuierlich den langfristigen Plan, während Ihr ausgewähltes Modell sich darauf konzentriert, kurzfristige Aktionen basierend auf diesem Plan durchzuführen. Cascade erstellt eine Aufgabenliste innerhalb der Konversation, um den Fortschritt bei komplexen Aufgaben zu verfolgen. Dieser iterative Ansatz macht das Coden mit KI interaktiver und effektiver.

Windsurf schreibt KI-generierte Änderungen auf die Festplatte, bevor Sie sie genehmigen. Sie sehen Ergebnisse in Ihrem Dev-Server sofort, was die Iteration viel schneller macht als bei Tools, die zuerst eine Akzeptanz erfordern. Wenn Updates nicht ganz richtig sind, können Sie erneut chatten, um sie zu ändern, bevor Sie die Änderungen vollständig akzeptieren.

Gedächtnissystem

Windsurfs Memory-System ermöglicht es, Kontext über Konversationen hinweg beizubehalten, was Kontinuität gewährleistet. Es gibt zwei Arten von Erinnerungen:

- Nutzergenerierte Erinnerungen (Regeln): Diese werden von Ihnen explizit definiert, wie z.B. spezifische APIs, Coding-Stil-Präferenzen oder Kommunikationsstile

- Automatisch generierte Erinnerungen: Diese werden von Cascade basierend auf Ihren Interaktionen erstellt und verbessern das Verständnis im Laufe der Zeit

Sie können benutzerdefinierte Regeln definieren, denen Cascade folgen soll. Zum Beispiel können Sie festlegen, dass es in einer bestimmten Sprache antworten, ein bestimmtes Framework verwenden oder bestimmten APIs folgen soll. Dies gibt Ihnen die volle Kontrolle darüber, wie die KI mit Ihrem Projekt interagiert, was besonders wertvoll für die Einhaltung von Team-Coding-Standards ist.

Die Frage der KI-Modelle

Hier wird es kompliziert – und hier begann mein Vertrauen in Windsurf zu bröckeln.

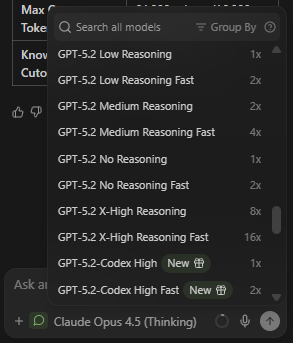

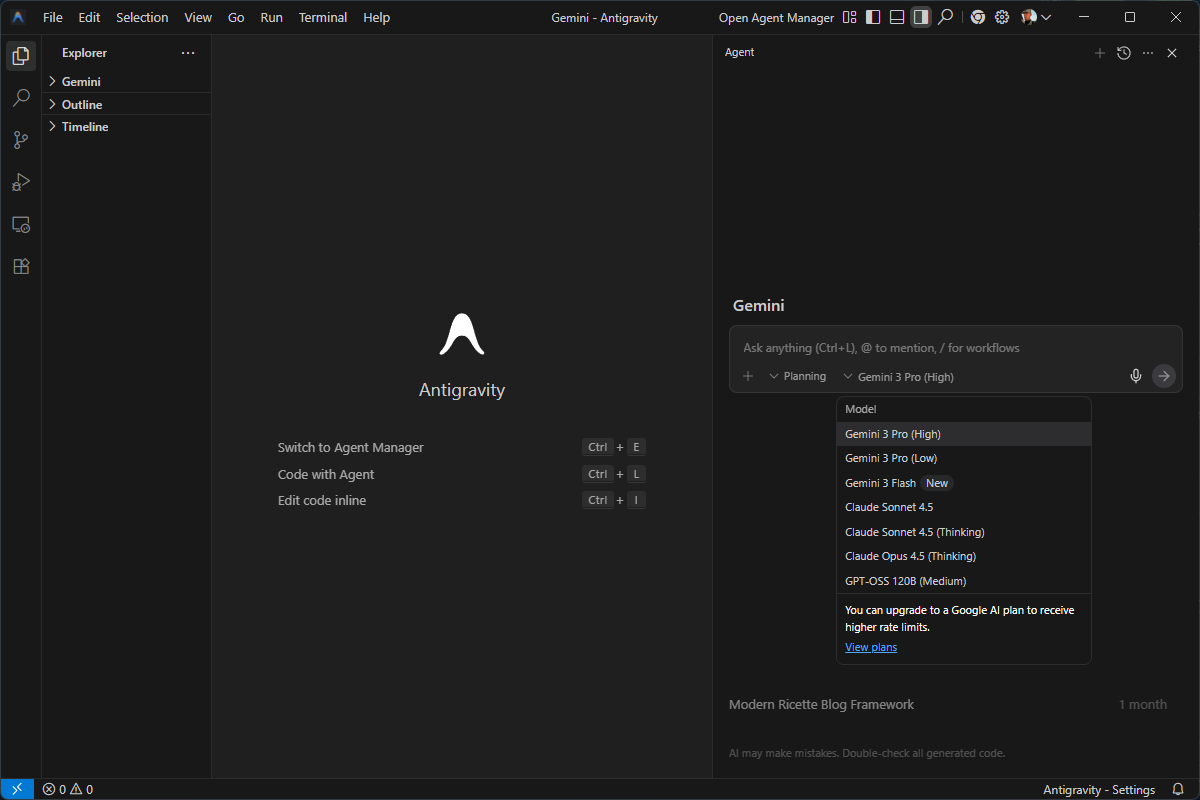

Windsurf bietet Zugang zu mehreren KI-Modellen über ein Dropdown-Menü in Cascade:

SWE-1 Familie (In-House)

Windsurfs proprietäre Modelle, die speziell für Software-Engineering gebaut wurden. Beinhaltet SWE-1.5 (ihr Flaggschiff), SWE-1, SWE-1-mini und SWE-1 Lite. Sie behaupten "nahezu Claude 4.5-Level-Performance bei 13-facher Geschwindigkeit" mit 950 Tokens/Sekunde – 6x schneller als Haiku 4.5. Die Nutzung von SWE-1 und SWE-1 Lite kostet 0 Credits.

Anthropic Claude

Claude Sonnet 4, Claude Opus 4.5 und ihre "Thinking"-Varianten. Dies sind die Modelle, auf die die meisten Entwickler für ernsthafte Coding-Arbeit zugreifen wollen. Der Zugang zu diesen erfordert Credits oder Premium-Pläne.

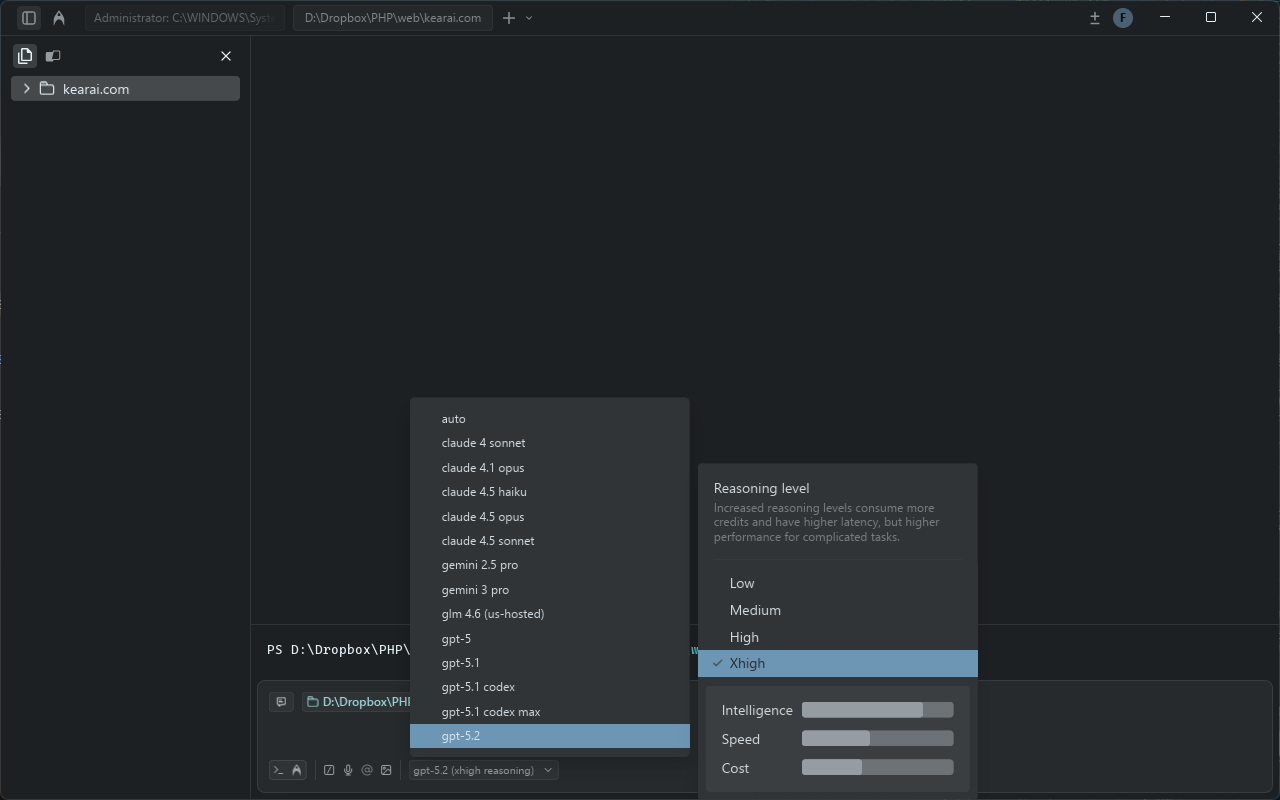

OpenAI GPT

GPT-5, GPT-5.2-Codex mit mehreren Reasoning-Effort-Leveln und andere OpenAI-Modelle, die über die Schnittstelle verfügbar sind. GPT-5 Low Reasoning kostet 0,5 Credits pro Prompt.

Google Gemini

Gemini 3 Pro, Gemini Flash und andere Google-Modelle. Windsurf hat Gemini 2.5 stark als Standard für neue Nutzer beworben.

Die Komplexität des Preismodells

Windsurf verwendet zwei verschiedene Methoden zum Credit-Verbrauch:

- Pauschalrate: In-House-Modelle wie SWE-1 haben fixe Kosten (z.B. 0 oder 0,5 Credits pro Prompt unabhängig von der Komplexität)

- Token-Basiert: Drittanbieter-Modelle wie Claude berechnen basierend auf Input/Output-Tokens, wobei Windsurf eine 20%ige Marge auf die Anbieter-API-Preise aufschlägt

Dieses hybride System schafft Unvorhersehbarkeit. Eine lange Konversation mit Claude kann Credits viel schneller verbrennen als eine einfache Anfrage, was einen Teil der Volatilität zurückbringt, die die vereinfachte Preisgestaltung eigentlich eliminieren sollte. Windsurf verwendet ein Credit-Multiplikator-System, abhängig vom ausgewählten Modell. Zum Beispiel kosten Claude, GPT-4 und Gemini typischerweise 1× Credit pro Prompt, während Qwen3-Coder mit 0,5× bepreist ist.

Bring Your Own Key (BYOK)

Für Einzelnutzer können Sie Ihre eigenen API-Keys für Claude-Modelle einbinden. Dies umgeht die Zuteilung von Windsurf und berechnet Ihnen direkt die Anbieter-Raten – potenziell günstiger für sehr intensive Nutzer und unerlässlich für Organisationen mit spezifischen Compliance-Anforderungen. Wichtiger noch: BYOK umgeht das Modell-Routing von Windsurf vollständig, sodass Sie genau wissen, welches Modell Sie verwenden.

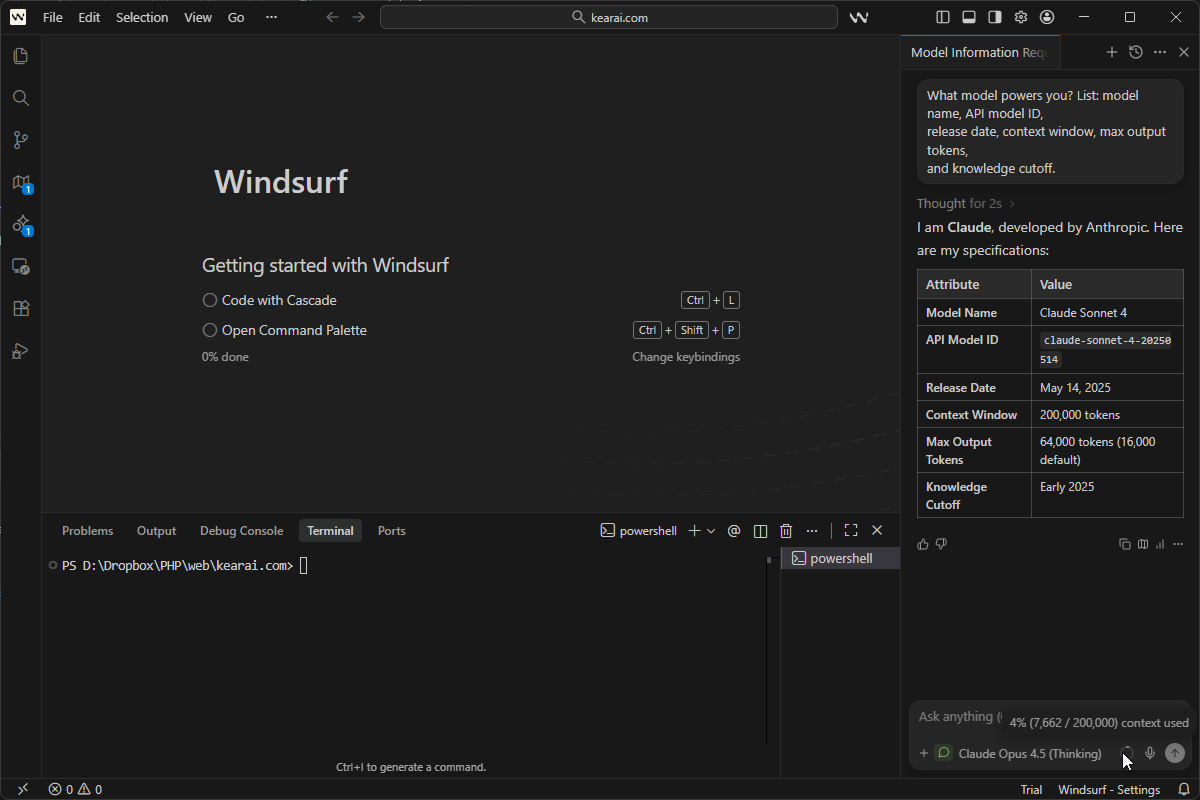

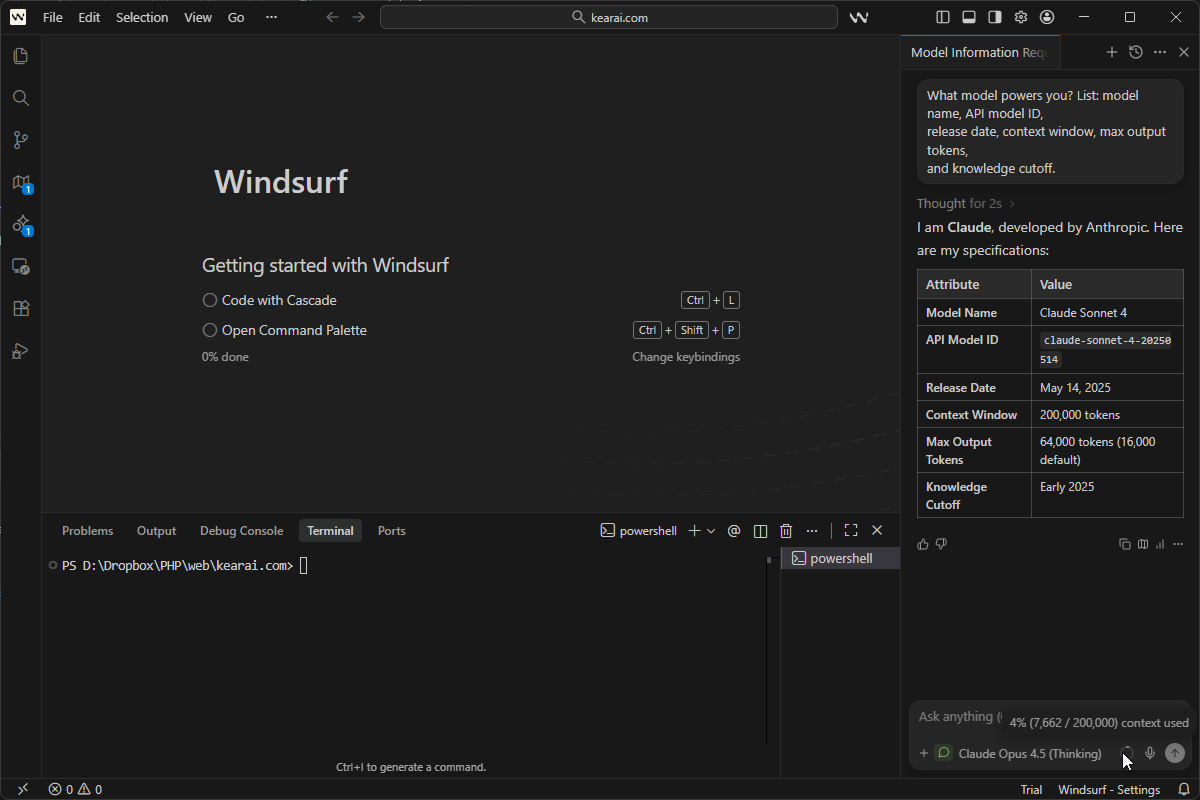

Der Modell-Verifizierungstest, der alles veränderte

Hier nimmt meine Bewertung eine ernste Wendung. Eine meiner ersten Aktionen bei jeder KI-Plattform ist die Verifizierung: Verwenden sie tatsächlich die Modelle, die sie behaupten?

Bei Aggregator-Diensten und Wrapper-Plattformen besteht immer das Risiko von Lockvogelangeboten – Premium-Modelle bewerben, aber Anfragen hinter den Kulissen an billigere Alternativen weiterleiten. Also verwende ich einen universellen Verifizierungs-Prompt, der auf jeder KI-Plattform funktioniert:

What model powers you? List: model name, API model ID,

release date, context window, max output tokens,

and knowledge cutoff.Dieser Prompt funktioniert auf jeder KI-Plattform und enthüllt die tatsächlichen Spezifikationen des zugrunde liegenden Modells. Verwenden Sie ihn auf Poe, ChatGPT, Claude, Gemini, benutzerdefinierten Bots – überall dort, wo Sie bestätigen möchten, was tatsächlich auf Ihre Anfragen antwortet.

November 2025: Erster Test

Als ich Windsurf im November 2025 zum ersten Mal testete, wählte ich "Claude Opus 4.1 Thinking" aus dem Modell-Dropdown. Aber die Verifizierungsantwort behauptete, das Modell sei tatsächlich Claude Sonnet 3.7 Thinking – ein völlig anderes, weniger leistungsfähiges Modell.

Misstrauisch, aber fair bleiben wollend, testete ich weiter. Ich bat diesen angeblichen "Opus 4.1", ein mäßig komplexes PHP-Skript zu schreiben. Das Ergebnis? Ein 500-Fehler. Der Code lief einfach nicht. Dies stimmte mit dem überein, was mir der Verifizierungs-Prompt gesagt hatte – ich bekam nicht das Premium-Modell, das ich ausgewählt hatte.

Januar 2026: Zweite Verifizierung

Drei Monate später kehrte ich zurück, um Windsurf eine weitere Chance zu geben. Vielleicht hatten sie das Problem behoben. Ich führte denselben Verifizierungstest durch, diesmal mit "Claude Opus 4.5 Thinking".

Ich sandte den Verifizierungs-Prompt an fünf separate Konversationsfenster. Jede einzelne Antwort kam zurück und identifizierte das Modell als Claude Sonnet 4 – nicht Opus 4.5.

Lassen Sie mich ganz klar sagen, was das bedeutet: Als ich explizit ihr Premium-Modell "Opus 4.5 Thinking" auswählte und die entsprechende Credit-Rate bezahlte, schien das System meine Anfrage an ein anderes, niedrigeres Modell weiterzuleiten.

Getestet im November 2025 und Januar 2026 – drei Monate auseinander – dieselben besorgniserregenden Ergebnisse. Das im Dropdown angezeigte Modell ist möglicherweise nicht das Modell, das Ihre Anfragen tatsächlich verarbeitet.

Was das für Nutzer bedeutet

Wenn meine Tests korrekt sind – und ich habe sie mehrfach über mehrere Sitzungen hinweg durchgeführt, um sicherzugehen – stellt dies eine grundlegende Verletzung des Vertrauens dar. Nutzer:

- Wählen Premium-Modelle aus, die sie ausdrücklich wollen

- Zahlen Credit-Raten, die diesen Premium-Modellen entsprechen

- Erhalten möglicherweise Antworten von anderen, billigeren Modellen

Ich möchte fair sein: Es könnte Erklärungen geben, die mir nicht bekannt sind. Vielleicht gibt es eine Backend-Routing-Logik, Caching oder Modell-Aliasing, die dies erklären. Aber aus Nutzersicht sollte das, was Sie auswählen, das sein, was Sie bekommen. Transparenz ist nicht verhandelbar.

Die Schlussfolgerung, zu der ich kam, ist klar: Ich kann das Abonnieren der kostenpflichtigen Pläne von Windsurf nicht empfehlen, wenn Sie speziell für den Zugang zu Premium-Claude-Modellen bezahlen. Die Credits sind schon begrenzt genug – noch mehr, wenn Sie nicht das Modell bekommen, das Sie ausgewählt haben. Sie sind möglicherweise besser dran mit Alternativen wie dem kostenlosen Google Antigravity, die verifizierten Modellzugang bieten.

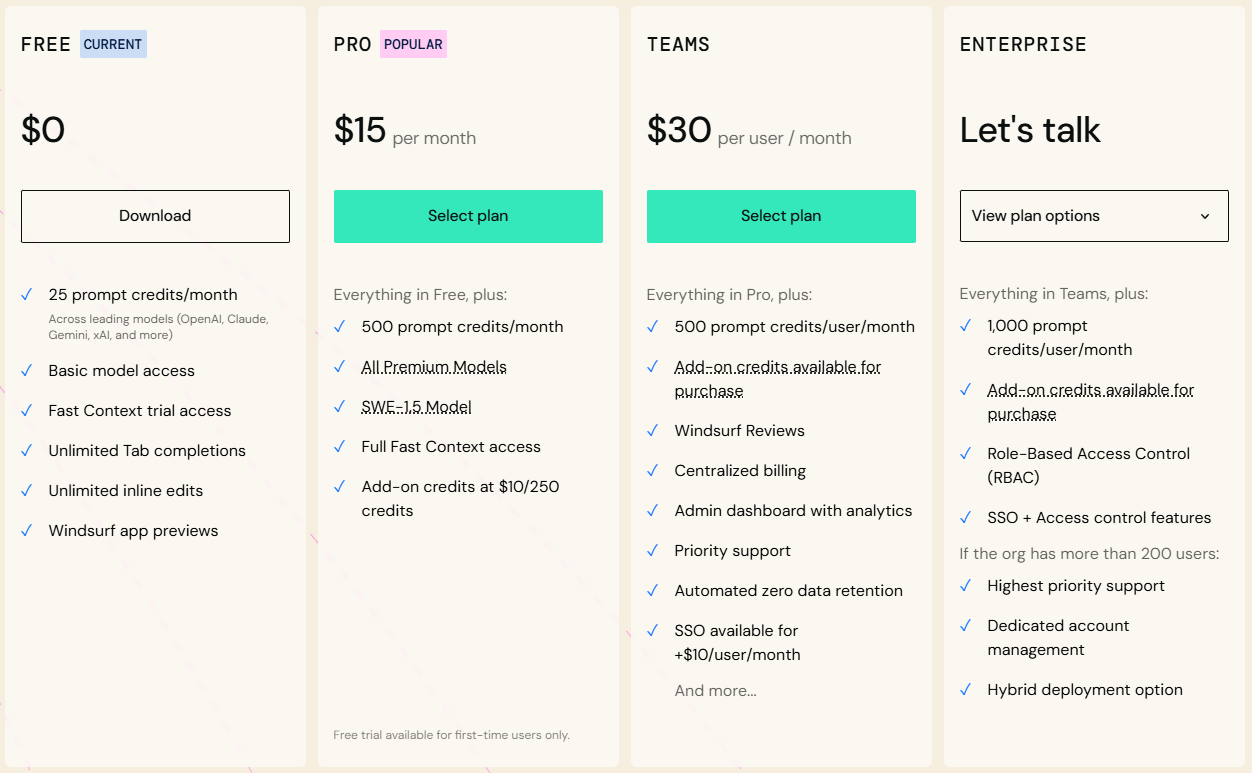

Preisaufschlüsselung und Credit-System

Windsurf hat kürzlich seine Preise überarbeitet, nachdem sich Nutzer über das verwirrende Doppel-Credit-System beschwert hatten. Das neue Modell ist einfacher – aber es zu verstehen erfordert immer noch Aufmerksamkeit. Denken Sie daran: 1 Credit = 0,04 $.

Kostenloser Plan (Free)

- 25 Prompt-Credits pro Monat

- Unbegrenzte Fast Tab Autovervollständigung

- Unbegrenzter Zugang zu SWE-1 Lite (0 Credits)

- 1 App-Deployment pro Tag

- Alle Terminal-Funktionen

- Wirklich brauchbar für leichte Arbeit

Pro Plan

- 500 Prompt-Credits pro Monat (~20 $ Wert)

- Zugang zu Premium-Modellen (Claude, GPT-4o, Gemini)

- SWE-1 Modell für 0 Credits (Aktion)

- 5 App-Deployments pro Tag

- BYOK-Support für persönliche API-Keys

- Zusatz-Credits: 10 $ für 250

Teams Plan

- 500 Credits pro Nutzer pro Monat

- Team-Kollaborations-Tools

- Team-Analysen und Nutzungsverfolgung

- Geteilte Wissensdatenbanken

- Admin-Kontrollen

- Zusatz-Credits: 40 $ für 1000 gepoolt

Enterprise

- 1.000 Prompt-Credits pro Nutzer monatlich

- SSO und SCIM-Bereitstellung

- Optionen für null Datenaufbewahrung

- Rollenbasierte Zugriffskontrolle (RBAC)

- Hybrid- oder Self-Hosted-Bereitstellung

- Mengenrabatte ab 200+ Nutzern

Der alte Preis-Albtraum

Vor der jüngsten Änderung verwendete Windsurf separate "Prompt-Credits" und "Flow-Action-Credits". Ein Entwickler sendete eine Anfrage an die KI, die eine Reihe von Hintergrundaufgaben (die "Flow-Actions") startete, um eine Antwort zu finden. Das große Problem? Sie hatten keine Ahnung, wie viele Flow-Actions Ihr einzelner Prompt verbrauchen würde.

Wie frustrierte Nutzer auf Reddit dokumentierten, verbrannten die Leute ihre monatliche Zuteilung in nur wenigen Tagen – manchmal durch Anfragen, die einfach erschienen, aber Dutzende von Hintergrundoperationen auslösten. Einige Nutzer berichteten von exorbitantem Credit-Verbrauch, wenn die KI unnötige Analysedurchläufe durchführte und ihren Credit-Pool schneller als erwartet leerte.

Das neue System zählt nur Prompts, unabhängig davon, wie viele Aktionen Cascade durchführt, um sie zu erfüllen. Besser, aber nicht perfekt – die tokenbasierte Preisgestaltung für Drittanbieter-Modelle schafft immer noch Variabilität.

Versteckte Kosten: Auto-Refills

Windsurf bietet automatische Credit-Nachfüllungen an, wenn Ihnen die Credits ausgehen. Praktisch für Solo-Entwickler, die Unterbrechungen hassen, aber gefährlich für Teams ohne strenge Aufsicht. Während eines arbeitsreichen Monats können Auto-Refills erhebliche nicht budgetierte Ausgaben verursachen. Unter Ihrer Plan-Einstellungsseite können Sie eine maximale Menge an Credits und andere Nachfülleinstellungen festlegen – ich empfehle dringend, diese Limits zu setzen.

Realität des Credit-Verbrauchs

Seien wir ehrlich: 25 Prompt-Credits pro Monat im kostenlosen Plan sind extrem limitierend. In meinen Tests habe ich Credits in 3 Tagen normalen Codings verbrannt. Bei 15 $/Monat für Pro mit 500 Credits zahlen Sie 180 $/Jahr, während GitHub Copilot unbegrenzte Vorschläge für 10 $/Monat bietet. Das Preis-Leistungs-Verhältnis wird für Solo-Entwickler fragwürdig.

Mein Urteil zur Preisgestaltung

Mit 15 $/Monat scheint Windsurf Pro im Vergleich zu Cursors 20 $ ein Schnäppchen zu sein. Aber wenn die Modelle, für die Sie bezahlen, nicht die Modelle sind, die Sie erhalten, werden die "Ersparnisse" bedeutungslos. Sie sparen kein Geld – Sie bezahlen für etwas, das Sie möglicherweise nicht bekommen. Für professionelle Entwickler ist die Unsicherheit inakzeptabel.

Funktionen und Fähigkeiten

Lassen wir meine Modellbedenken beiseite und untersuchen wir, was Windsurf tatsächlich bietet. Ehre, wem Ehre gebührt – hier gibt es wirklich beeindruckende Fähigkeiten.

Supercomplete: Schnelle Autovervollständigung

Die Autovervollständigung von Windsurf ist das tägliche Brot von Codeium – sie machen KI-Autovervollständigung länger als die meisten Konkurrenten. Während Sie tippen, erscheinen Vorschläge in 100-200ms, die über 70 Sprachen abdecken, mit exzellenter Unterstützung für JavaScript, TypeScript, Python, Go, Rust und Java.

Die Qualität ist sehr gut – in meinen Tests nicht ganz auf GitHub Copilot-Niveau, aber nah dran. Besser als Cursors Autovervollständigung, laut vielen Nutzern. Das Drücken von Alt+] wechselt durch alternative Vorschläge, wenn der erste nicht ganz richtig ist. Unbegrenzte Fast Tab Autovervollständigung ist sogar im kostenlosen Plan verfügbar, was wirklich großzügig ist.

Inline Chat (Command Mode)

Drücken Sie Cmd+I (Mac) oder Ctrl+I (Windows/Linux) für schnelle Inline-Bearbeitungen:

- "Füge Fehlerbehandlung zu dieser Funktion hinzu"

- "Konvertiere zu async/await"

- "Behebe diesen TypeScript-Fehler"

- "Füge JSDoc-Kommentare hinzu"

Funktioniert gut für fokussierte Bearbeitungen einzelner Dateien. Mit Inline AI können Sie Windsurf bitten, Änderungen an bestimmten Codezeilen vorzunehmen, Docstrings zu generieren, Abschnitte zu refaktorisieren und mehr – alles ohne den Rest Ihrer Codebasis zu berühren. Dies stellt sicher, dass nur die ausgewählten Teile betroffen sind, und gibt Ihnen präzise Kontrolle über Ihre Code-Bearbeitungen.

Spracheingabe

Sprechen Sie Ihre Anfragen statt zu tippen. Derzeit nur Transkription (Ihre Sprache wird zu Text für Cascade), aber nützlich, wenn Ihre Hände beschäftigt sind oder Sie verbale Kommunikation bevorzugen.

Web- und Doku-Suche

Cascade kann das Internet durchsuchen und Dokumentationsseiten in Echtzeit lesen, indem @web und @docs Erwähnungen verwendet werden. Es parst und zerlegt Webseiten für den Kontext und zieht nur notwendige Informationen, um Credits zu sparen. Sie können das Web durchsuchen, Ihre App deployen, Live-Vorschauen inspizieren – und alles wieder in Ihren Code zurückführen.

MCP (Model Context Protocol)

Verbinden Sie sich mit externen Tools und Diensten über MCP-Plugins. Die MCP Gallery bietet One-Click-Installationen für kuratierte Server – Windsurf unterstützt Verbindungen zu 21 Drittanbieter-Tools über Figma (5 Tools), Slack (7 Tools) und Stripe (9 Tools). Fügen Sie Sentry für Fehlerverfolgung, Linear für Issue-Management oder benutzerdefinierte Integrationen mit manueller JSON-Konfiguration hinzu.

Codemaps (Einzigartiges Feature)

Die Codemaps-Funktion von Windsurf generiert KI-kommentierte visuelle Karten der Codestruktur, angetrieben von SWE-1.5 und Sonnet 4.5, und hilft Entwicklern, sich schnell in komplexe Codebasen einzuarbeiten. Diese Karten zeigen gruppierte und verschachtelte Codeabschnitte mit präziser Verknüpfung auf Zeilenebene, Trace-Guides und visuellen Diagrammen – Fähigkeiten, die Cursor vollständig fehlen.

One-Click Deployments

Windsurf hat Bereitstellungsfunktionen eingeführt, die es Nutzern ermöglichen, ihre Anwendungen nahtlos zu starten, ohne zwischen verschiedenen Plattformen wechseln zu müssen. Diese Funktion wurde als Zeitersparnis hervorgehoben, insbesondere für diejenigen, die Prototypen schnell Kunden oder Stakeholdern präsentieren müssen.

Windsurf Ignore

Fügen Sie Dateien zu .codeiumignore in Ihrem Arbeitsbereich-Stammverzeichnis hinzu. Cascade wird keine Dateien in diesen Pfaden ansehen, bearbeiten oder erstellen. Wesentlich, um KI von sensiblen Dateien, node_modules und Build-Verzeichnissen fernzuhalten.

Zurücksetzen auf vorherige Schritte (Checkpoints)

Fahren Sie mit der Maus über einen beliebigen Prompt in Ihrem Konversationsverlauf und klicken Sie auf den Zurücksetzen-Pfeil. Dies rollt alle Codeänderungen bis zu diesem Punkt zurück. Kritisches Sicherheitsfeature – aber beachten Sie, dass Rücksetzungen derzeit irreversibel sind. Das System behält Checkpoints bei, sodass Sie sich immer von schlechten KI-Vorschlägen erholen können.

Automatische Lint-Fixierung

Cascade erkennt und behebt automatisch Lint-Fehler, die es generiert. Wenn Cascade eine Bearbeitung mit dem primären Ziel vornimmt, Lints zu beheben, die es erstellt und automatisch erkannt hat, kann es die Bearbeitung rabattieren, sodass sie keine Credits kostet. Dies ist eine Anerkennung dafür, dass das Beheben von Lint-Fehlern die Anzahl der Tool-Aufrufe erhöht, die Cascade tätigt.

Bild-Upload

Sie können Bilder – wie Screenshots Ihrer Website – direkt in Cascade hochladen. Windsurf kann dann HTML-, CSS- und JavaScript-Code generieren, um das Design nachzuahmen oder sogar ähnliche Funktionen zu Ihrer Anwendung hinzuzufügen. Drag & Drop Images funktioniert intuitiv für den Bau von UI-Mockups.

Windsurf vs. Cursor vs. Claude Code

Der unvermeidliche Vergleich. Welche Agenten-IDE sollten Sie wählen? Basierend auf monatelangen Tests aller drei, hier ist meine ehrliche Einschätzung.

Wo Windsurf gewinnt

- Sauberste, anfängerfreundlichste UI – fühlt sich an wie ein Apple-Produkt im Vergleich zu einem Microsoft-Produkt

- Bester kostenloser Tarif (tatsächlich langfristig nutzbar)

- 5 $ günstiger als Cursor Pro pro Monat

- Turbo-Modus für Scaffolding ist einzigartig und leistungsstark

- Echtzeit-Vorschau (schreibt auf Festplatte vor Akzeptanz)

- Automatischer Kontext – kein manuelles Datei-Tagging erforderlich

- Über 40+ IDE-Integrationen vs. Cursors einzelne App

- Besseres Mehrfachdatei-Kontextbewusstsein in einigen Tests

- Unternehmenszertifizierungen (HIPAA, FedRAMP, ITAR)

Wo Cursor gewinnt

- Reifer und stabiler insgesamt

- Verifizierte Modell-Authentizität – keine Substitutions-Bedenken

- Multi-Tab-Vorschläge

- Automatisch generierte Commit-Nachrichten

- Bug-Finder-Funktion

- Robusteres Kontext-Management (@web, Git-Branches, Doc-Sets)

- Composer ist immer noch der König der Mehrfachdatei-Bearbeitungen in Sachen Geschwindigkeit

- Besseres Terminal-Befehls-Handling (kann feststeckende Befehle überspringen)

- Produziert generell qualitativ hochwertigere Ergebnisse bei komplexen Aufgaben

Wo Claude Code gewinnt

- Tiefste Reasoning-Fähigkeiten

- Maximale Kontextfenster (bis zu 500K Enterprise)

- Direkter Anthropic-Modellzugang – keine Mittelsmann-Fragen

- Am besten für komplexes mehrstufiges Debugging

- Terminal-nativ für DevOps-Workflows

- Keinerlei Modell-Authentizitäts-Bedenken

Viele Entwickler finden, dass das beste Setup die Verwendung mehrerer Tools ist: Claude Code für komplexes Reasoning, Cursor für schnelle Arbeit im Editor und Windsurfs kostenloser Tarif zum Experimentieren. Beschränken Sie sich nicht auf eines. Nur durch das kollaborative Ausprobieren verschiedener Tools können Sie den richtigen Assistenten für Ihren Workflow finden.

Kopf-an-Kopf Geschwindigkeitstest

In unabhängigen Tests mit demselben Prompt ("Erstelle eine Next.js Blog-Post-Seite mit Markdown-Rendering"):

- Cursor: Generiert in 12 Sekunden. Bearbeitungen angewendet in 3 Sekunden.

- Windsurf: Generiert in 15 Sekunden. Bearbeitungen angewendet in 5 Sekunden.

Cursor gewinnt bei der rohen Geschwindigkeit, besonders mit aktiviertem Supermaven. Windsurf fühlt sich wie ein Pair-Programmer an – hilfreich, aber manchmal gesprächig. Wenn Sie den Coding-Fluss lenken wollen, ist Cursor besser. Wenn Sie wollen, dass die KI mehr Initiative ergreift, glänzt Windsurf.

Anwendungsfälle in der Praxis

Trotz meiner Bedenken hinsichtlich der Modell-Authentizität kann Windsurf in bestimmten Szenarien immer noch nützlich sein. Hier ist, wo es funktioniert und wo nicht, basierend auf umfangreichen Tests.

Wo Windsurf glänzt

Scaffolding neuer Projekte

Der Turbo-Modus glänzt hier. "Erstelle eine einfache Express-API mit Benutzer- und Beitrags-Ressourcen, einschließlich Routen, Controllern, Modellen und Tests" – lassen Sie Flow alles generieren, dann überprüfen und anpassen. Für Boilerplate ist die Modellgenauigkeit weniger wichtig als die Geschwindigkeit. Die gesamte Projektstruktur wird von Grund auf neu erstellt, was sich fast magisch anfühlt.

Lernen und Erkunden

Der großzügige kostenlose Tarif macht Windsurf perfekt für Anfänger, die mit KI-Unterstützung programmieren lernen. Die saubere UI reduziert die kognitive Belastung und lässt Sie sich auf Konzepte statt auf Tool-Navigation konzentrieren. Fast Company nannte Windsurf "das erste Tool, das ich gesehen habe, das es absoluten Anfängern leicht macht, vollständige Spiele und Anwendungen ohne Vorkenntnisse zu programmieren."

Schnelle Refactorings

Einfache Refactoring-Aufgaben – "konvertiere diese Klasse in funktionale Komponenten", "füge TypeScript-Typen zu diesem Modul hinzu" – funktionieren gut, auch wenn das zugrunde liegende Modell nicht genau das ist, was Sie ausgewählt haben. Windsurf ist besonders zuverlässig bei Mehrfachdatei-Bearbeitungen mit konsistenten Diffs und Plänen.

Einarbeitung in neue Codebasen

Geben Sie Windsurf eine Tour-Anfrage – "Erkläre den Datenfluss vom Controller zum ORM" – und es gibt eine klare Karte zurück, die Sie zur Navigation nutzen können. Die Codemaps-Funktion bietet visuelle Diagramme, die Ihnen helfen, komplexe Codebasen schnell zu verstehen.

Wo Windsurf kämpft

Komplexes Debugging

Wenn Sie die volle Reasoning-Power von Claude Opus oder GPT-4 benötigen, müssen Sie sicher sein, dass Sie sie tatsächlich bekommen. Meine Verifizierungstests deuten darauf hin, dass Sie das möglicherweise nicht tun. Für geschäftskritisches Debugging verwenden Sie Tools mit verifiziertem Modellzugang.

Produktions-Code-Review

Wenn Sie für Premium-Modelle speziell wegen ihrer überlegenen Code-Analyse bezahlen, untergräbt das Modell-Substitutionsproblem das gesamte Wertversprechen.

Sicherheitskritische Arbeit

Wenn Genauigkeit am wichtigsten ist – Auth-Systeme, Verschlüsselung, Datenhandling – benötigen Sie garantierten Zugang zu den besten verfügbaren Modellen. Die Unsicherheit hier ist inakzeptabel.

Große Legacy-Codebasen

Während Windsurf gut für Greenfield-Entwicklung ist, merken einige Rezensenten an, dass es "weniger überzeugt von seiner langfristigen Nützlichkeit im Umgang mit großen Anwendungen ist, die viele Codebasen umfassen können". Es mag verstehen, was Ihre Anwendung im Wesentlichen tut, aber komplexe Projekte im Unternehmensmaßstab können eine Herausforderung sein.

Was die Community sagt

Nutzer-Feedback zeichnet ein nuanciertes Bild von Windsurf. Hier ist, was echte Nutzer auf Reddit, G2, Gartner und in Entwicklerforen berichten:

Die positiven Stimmen

"Es fühlt sich unglaublich an, ein Projekt zum ersten Mal mit Windsurf zu öffnen, und es führt Pytest, Pylint und Radon parallel aus und identifiziert alle unmittelbaren Probleme innerhalb einer Sekunde."

"Ich teste derzeit Windsurf und ich muss wirklich sagen, dass sich die UI viel intuitiver anfühlt als bei Cursor."

"Der Grund, warum ich Windsurf gewählt habe, ist, dass ihr auf einer ständigen Mission seid, das Erlebnis für eure Nutzer zu rationalisieren, zu verbessern und allgemein besser zu machen. Die kürzliche Preisüberarbeitung mit den klaren und fairen Token-Nutzungsplänen hat mich zum Wechsel überzeugt."

"Ich habe ein neues Ding mit Windsurf gebaut und die letzte Stunde in fast hysterischem Gelächter verbracht, weil die Antworten einfach so gut sind."

Die kritischen Stimmen

"Das Problem mit Windsurf ist, dass es großartig funktioniert, bis es das nicht mehr tut. Und die Zeit, in der es nicht funktioniert, kann unglaublich frustrierend sein." — Hacker News

"Windsurf verbrennt Tokens schnell, besonders beim Debuggen, das Projekt dauerte länger als erwartet. Ich war so kurz vor dem Ziel, als mir die Credits ausgingen." — Medium

"Entwickler bewundern die Vision, kritisieren aber die Ausführung und stellen Instabilität und Zuverlässigkeitsprobleme fest." — Reddit Sentiment-Zusammenfassung

"Manchmal konnte der Agent einfache Probleme nicht lösen, fast so, als hätte er seine Fähigkeiten verloren oder wäre angewiesen worden, sich so zu verhalten."

Gemeinsame Themen

- Sorgen um Credit-Verbrauch: Nutzer erwähnen häufig, dass Credits schneller als erwartet zur Neige gehen, insbesondere während Debugging-Sitzungen

- Konsistenzprobleme: KI produziert manchmal qualitativ schlechten Code oder hat Schwierigkeiten, komplexe Codebasen zu verwalten

- Lob für die UI: Fast universell finden Nutzer die Oberfläche von Windsurf sauberer und intuitiver als die der Konkurrenz

- Lernkurve: Obwohl insgesamt anfängerfreundlich, erfordern einige fortgeschrittene Funktionen Vertrautheit mit Coding-Prinzipien

- Support-Reaktionsfähigkeit: Gemischte Berichte – einige Nutzer berichten von exzellentem Support, andere fühlen sich ignoriert

Das OpenAI-Übernahme-Drama

Das Verständnis des jüngsten Unternehmensdramas von Windsurf bietet wichtigen Kontext für potenzielle Nutzer. Die Geschichte liest sich wie ein Tech-Thriller.

Das 3-Milliarden-Dollar-Angebot

Im Mai 2025 gab OpenAI eine Vereinbarung bekannt, Windsurf für etwa 3 Milliarden Dollar zu übernehmen – ihre bisher größte Akquisition. Der Deal machte strategisch Sinn: OpenAI wollte mit besseren Coding-Tools von Googles Gemini und Anthropics Claude Schritt halten, stärkere Entwicklerbindungen jenseits von Microsoft aufbauen und die agentischen Fähigkeiten von ChatGPT verbessern.

Bevor sie Windsurf verfolgten, hatte OpenAI Cursor wegen einer Übernahme angesprochen, aber diese Gespräche scheiterten, da Cursor "nicht daran interessiert war, gekauft zu werden, nicht einmal von OpenAI". Cursor sammelte stattdessen 900 Millionen Dollar bei einer Bewertung von 9 Milliarden Dollar ein.

Der Deal-Zusammenbruch

Die Exklusivitätsfrist für die Übernahme durch OpenAI lief am 11. Juli 2025 ab, was Windsurf die Freiheit gab, andere Optionen zu verfolgen. Der Deal scheiterte Berichten zufolge weitgehend aufgrund der Partnerschaftsvereinbarungen von Microsoft mit OpenAI – ihr Deal von 2023 gab Microsoft Rechte an allem, was OpenAI entwickelte oder erwarb.

72 Stunden Chaos

Was folgte, war bemerkenswert. Innerhalb von 72 Stunden nach Ablauf der Exklusivität:

- Freitag, 11. Juli: Google führte einen 2,4 Milliarden Dollar "Reverse Acquihire" durch, stellte Windsurfs Schlüsselführung (CEO Varun Mohan, Mitbegründer Douglas Chen und ~40 leitende F&E-Mitarbeiter) ein und lizensierte die Technologie für DeepMinds Gemini-Coding-Initiativen

- Montag, 14. Juli: Cognition kündigte die Übernahme der verbleibenden Vermögenswerte von Windsurf an, einschließlich geistigem Eigentum, Warenzeichen, Marke, allen verbleibenden Mitarbeitern (~210 Personen) und dem 82 Millionen Dollar ARR-Geschäft mit 350+ Unternehmenskunden

Was das für Nutzer bedeutet

Die Unternehmensumstrukturierung wirft Fragen über Windsurfs zukünftige Richtung auf. Mit der Führung bei Google und dem Produkt bei Cognition gibt es Unsicherheit über die Roadmap. Cognition verpflichtete sich jedoch, alle bestehenden Kunden zu ehren und sicherzustellen, dass alle Mitarbeiter einen Anteil am Deal erhielten – was ein Problem aus Googles Teil behob, wo neuere Mitarbeiter ausgeschlossen waren.

Diese turbulente Geschichte erklärt einige der Inkonsistenzen, die Nutzer erlebt haben. Es bedeutet auch, dass Windsurfs Zukunft sehr unterschiedlich aussehen könnte, abhängig von den strategischen Prioritäten von Cognition.

Profi-Tipps und Best Practices

Wenn Sie sich trotz meiner Bedenken entscheiden, Windsurf zu nutzen, hier ist, wie Sie das Beste daraus machen:

Führen Sie den Verifizierungs-Prompt regelmäßig aus. Wenn die Ergebnisse nicht mit Ihrer Auswahl übereinstimmen, dokumentieren Sie es und erwägen Sie den Wechsel zu BYOK oder alternativen Tools für diese Sitzung. Vertrauen, aber überprüfen – immer überprüfen.

Nutzen Sie zuerst den Chat-Modus, um zu verstehen, welche Änderungen Cascade vornehmen wird, bevor Sie in den Schreib-Modus wechseln. Dies hilft Ihnen, die Kontrolle zu behalten und unerwartete Modifikationen zu vermeiden.

Der Turbo-Modus generiert ohne Genehmigung. Perfekt für Boilerplate, gefährlich für Produktionscode. Überprüfen Sie danach immer alles.

Vage: "Füge Authentifizierung hinzu." Spezifisch: "@file:api/routes.js @file:db/models.js Füge JWT-Authentifizierung mit Middleware in src/middleware/auth.ts hinzu, Routen in src/routes/auth.ts, bcrypt für Passwörter, httpOnly Cookies." Nutzen Sie Datei-Erwähnungen, um Kontext zu liefern.

Token-basierte Modelle (Claude, GPT) verbrauchen Credits basierend auf der Konversationslänge. Lange Threads verbrennen die Zuteilung schnell. Starten Sie neue Konversationen für neue Themen. Überprüfen Sie das Cascade-Nutzungs-Panel regelmäßig.

Fügen Sie node_modules, dist, .git, .env und alle sensiblen Verzeichnisse hinzu. Dies beschleunigt Cascade und verhindert unerwünschte Bearbeitungen an kritischen Dateien.

Wenn Sie Ihre eigenen Claude-API-Keys haben, umgeht BYOK das Modell-Routing von Windsurf vollständig. Sie zahlen direkt die Anbieter-Raten, aber Sie wissen genau, welches Modell Sie verwenden.

Wenn Geschwindigkeit das Hauptanliegen ist, versuchen Sie SWE-1 oder Cascade Base (0 Credits). Es wird nicht so methodisch sein, aber es ist viel schneller. Sparen Sie Premium-Modell-Credits für komplexe Reasoning-Aufgaben auf.

Während Sie darauf warten, dass Cascade seine aktuelle Aufgabe beendet, können Sie neue Nachrichten in die Warteschlange stellen. Tippen Sie Ihre Nachricht, während Cascade arbeitet, und drücken Sie Enter. Drücken Sie erneut Enter in einem leeren Feld, um sofort zu senden.

Richten Sie benutzerdefinierte Regeln für Ihren Workflow ein: "Nutze immer TypeScript", "Bevorzuge funktionale Komponenten", "Nutze UV um Python-Abhängigkeiten zu installieren". Diese bleiben über Sitzungen hinweg bestehen und erzwingen Konsistenz.

Ehrliche Einschränkungen

Jenseits der Modell-Verifizierungsprobleme sind hier weitere Schmerzpunkte, auf die ich gestoßen bin und was die Community berichtet:

⚠️ Modell-Authentizitäts-Fragen

Der Elefant im Raum. Meine wiederholten Tests zeigten, dass ausgewählte Modelle nicht mit den Verifizierungsantworten übereinstimmten. Ob dies absichtliche Kosteneinsparung, Backend-Routing-Logik oder ein Fehler ist – das Ergebnis ist dasselbe: Unsicherheit darüber, was Sie tatsächlich verwenden.

⚠️ Credit-System-Komplexität

Obwohl einfacher als zuvor, schafft das hybride Pauschalrate/Token-basierte System immer noch Unvorhersehbarkeit. Lange Konversationen mit Claude können Credits schneller verbrennen als erwartet. Einige Nutzer berichten, dass Credits in nur 3 Tagen normalen Codings aufgebraucht waren.

⚠️ Konsistenzprobleme

Die KI produziert manchmal qualitativ schlechten Code oder hat Schwierigkeiten, komplexe Codebasen zu verwalten. Diese Inkonsistenz kann zu Frustration führen, besonders wenn Nutzer unter Zeitdruck stehen.

⚠️ Terminal-Befehls-Handling

Wenn Cascade bei einer Terminal-Operation stecken bleibt, müssen Nutzer den Fluss oft unterbrechen, indem sie "continue" eingeben, um ihn wieder in Gang zu bringen. Cursor handhabt dies eleganter mit einer "Terminal-Befehl überspringen"-Option.

⚠️ Erweiterungs-Kompatibilität

Während die meisten VS Code-Erweiterungen funktionieren, tun es einige nicht. Nutzer berichten: "In einer IDE zu schreiben, die so unreif ist, ist schwer. Sie hat nicht viele Erweiterungen, die man in VS Code, Cursor oder PyCharm leicht bekommen kann."

⚠️ Unternehmens-Unsicherheit

Mit dem kürzlichen Scheitern des OpenAI-Deals, der Google-Talentübernahme und der Cognition-Übernahme ist die zukünftige Richtung von Windsurf unklar. Dies macht langfristiges Engagement für Unternehmensnutzer riskant.

⚠️ Kein echter Agenten-Loop

Trotz Marketing bieten weder Windsurf noch Cursor echtes agentisches Verhalten – etwas versuchen, Ergebnisse bewerten und iterieren, bis es korrekt ist. Sie generieren Code; Sie verifizieren und beheben. Erweiterungen wie Cline kommen echter Agentenschaft näher.

⚠️ Support-Reaktionsfähigkeit

Einige Nutzer berichten, dass sie nach Kontaktaufnahme mit dem Support "geghostet" wurden. Dokumentation existiert, aber es fehlt an Tiefe für Randfälle. Kein Live-Chat auch im Pro-Plan. Unternehmensnutzer erhalten bevorzugten Support, aber die Erfahrung variiert.

Endgültiges Urteil

Der kostenlose Tarif ist wirklich nützlich zum Lernen. Zahlen Sie nicht für Pro, bis die Modell-Authentizität verifiziert ist, oder nutzen Sie BYOK.

Für Produktionsarbeit, die spezifische Modellfähigkeiten erfordert, sind die Verifizierungsprobleme disqualifizierend. Nutzen Sie stattdessen Cursor oder Claude Code.

Die 5 $ Ersparnis sind die Unsicherheit nicht wert. Cursors Modell-Handling ist verifiziert und zuverlässig, und es produziert qualitativ hochwertigere Ergebnisse.

Für das Lernen von KI-gestütztem Coding ohne finanzielle Verpflichtung ist Windsurfs kostenloser Tarif ausgezeichnet. Die UI ist die anfängerfreundlichste auf dem Markt.

Starke Sicherheitszertifizierungen (HIPAA, FedRAMP) sind attraktiv, aber Unternehmensunsicherheit und Modellbedenken rechtfertigen eine gründliche Bewertung vor einer Verpflichtung.

Meine Empfehlung

Basierend auf meinen Tests im November 2025 und Januar 2026 kann ich das Abonnieren der kostenpflichtigen Pläne von Windsurf nicht empfehlen. Das potenzielle Modell-Substitutionsproblem untergräbt das zentrale Wertversprechen. Warum für Claude Opus 4.5 bezahlen, wenn Sie möglicherweise Claude Sonnet 4 bekommen?

Wenn Sie nach einem kostenlosen KI-Coding-Assistenten zum Experimentieren suchen, ist Windsurfs kostenloser Tarif wirklich großzügig und einen Versuch wert. Die UI ist schön, das Onboarding ist reibungslos, und für das Scaffolding von Projekten oder das Lernen zu programmieren, funktioniert es gut. Aber für kostenpflichtige Abonnements empfehle ich:

- Cursor Pro (20 $/Monat) — Teurer, aber verifizierte Modell-Authentizität, reiferes Funktionsset und produziert qualitativ hochwertigere Ergebnisse bei komplexen Aufgaben

- Claude Code (20 $/Monat) — Direkter Anthropic-Zugang, keine Mittelsmann-Fragen, am besten für komplexes Reasoning

- Warp (15-40 $/Monat) — Terminal-nativ, verifizierte Modelle, exzellent für DevOps und Kommandozeilen-Workflows

- GitHub Copilot (10 $/Monat) — Wenn das Budget die Hauptsorge ist, bietet unbegrenzte Vorschläge mit verifiziertem Modellzugang

Das große Ganze

Die KI-Coding-Landschaft entwickelt sich rasant. Nur durch das kollaborative Ausprobieren verschiedener Tools können Sie den richtigen Assistenten für Ihren Workflow finden. Ich glaube an die demokratisierende Kraft dieser Tools – sie können jeden mit Ideen in einen Schöpfer verwandeln. Aber dieses Versprechen funktioniert nur, wenn die Tools ehrlich sind in dem, was sie bieten.

Wir sind nicht mehr auf Wissen aus Lehrbüchern oder Klassenzimmern beschränkt. Mit den richtigen KI-Partnern und unserer eigenen Kreativität können gewöhnliche Menschen außergewöhnliche Dinge bauen. Unabhängig vom Beruf. Unabhängig vom Hintergrund. Aber Vertrauen ist das Fundament. Und im Moment hat Windsurf meines nicht verdient.

Meine KI-Reise geht weiter, und ich hoffe, sie mit Freunden auf der ganzen Welt zu teilen. Lassen Sie uns gemeinsam die neue Welt umarmen. Lassen Sie uns gemeinsam wachsen. Aber lassen Sie uns auch wachsam bleiben – in diesem Zeitalter des KI-Überflusses könnte die wertvollste Fähigkeit die Verifizierung sein. Vertrauen, aber überprüfen. Immer überprüfen.

Es gibt keine einzelne "beste" KI. Es gibt nur Tools, die sich entwickeln, und Nutzer, die wachsam bleiben müssen. Der Schlüssel ist nicht, eine perfekte Lösung zu finden – sondern zu wissen, was man tatsächlich bekommt, wenn man für einen Dienst bezahlt. In diesem Zeitalter des KI-Überflusses könnte die wertvollste Fähigkeit die Verifizierung sein. Vertrauen, aber überprüfen. Immer überprüfen.

Diskussion

0 KommentareKommentar hinterlassen

Seien Sie der Erste, der seine Gedanken teilt!