AI kan inte läsa dina tankar. AI läser dina ord. Kvaliteten på din prompt avgör kvaliteten på ditt resultat.

För två år sedan skrev jag min första prompt till ChatGPT och trodde att jag förstod artificiell intelligens. Jag hade fel. Det jag förstod var hur man ställer frågor—inte hur man kommunicerar med en maskin som tänker i mönster, sannolikheter och tokens. Skillnaden mellan de två? Det är skillnaden mellan att få generiska svar och att låsa upp möjligheter du inte visste existerade. Det här är berättelsen om hur jag lärde mig prata flytande med AI, och allt jag upptäckte på vägen.

Uppvaknandet: När Enkla Prompts Slutade Fungera

Det hände mitt under en projektdeadline. Jag behövde AI:s hjälp med att refaktorera komplex kod—något jag hade gjort hundratals gånger förut. Men den här gången, oavsett hur jag formulerade min förfrågan, fortsatte AI att generera lösningar som var tekniskt korrekta men fullständigt missade målet. Den lade till onödig komplexitet. Den bröt befintliga mönster. Den "fixade" saker som inte var trasiga.

Jag blev frustrerad. Sedan blev jag nyfiken. Vad gjorde jag för fel?

Den frustrationen ledde mig ner i ett kaninhål som förändrade allt: officiell dokumentation, forskningsartiklar, prompt engineering-guider och tusentals timmars experiment. Det jag hittade var inte bara tips och tricks—det var en fundamental förändring i hur jag kommunicerade med AI-system.

Världens mest avancerade AI är värdelös om du inte kan förmedla vad du faktiskt behöver.

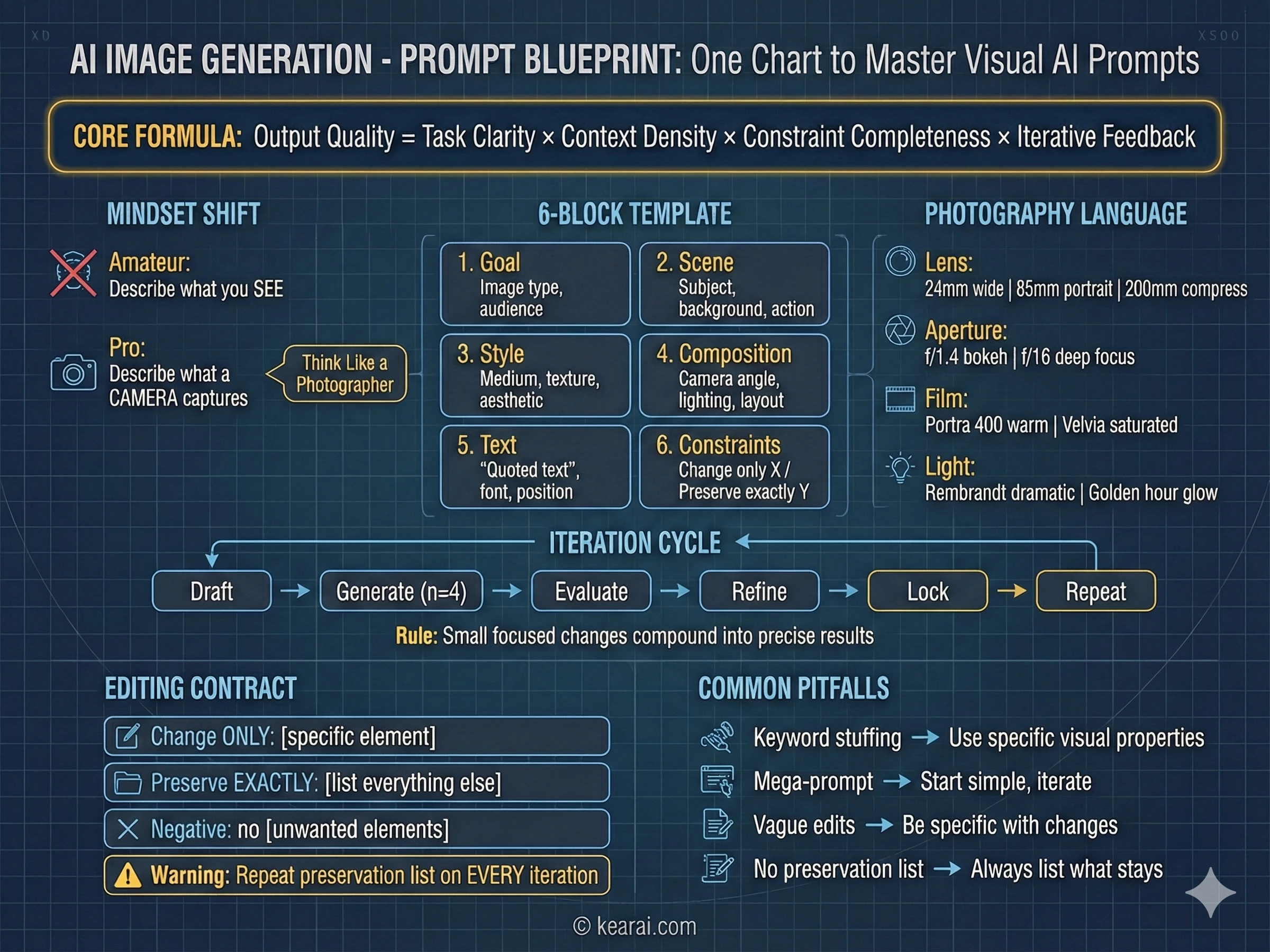

Här är sanningen ingen berättar för nybörjare: prompting handlar inte om att hitta magiska ord. Det handlar om att förstå hur AI-modeller bearbetar språk, vilken information de behöver, och hur man strukturerar den informationen så att modellen kan hjälpa dig effektivt. Det är en färdighet—och som alla färdigheter kan den läras, övas och bemästras.

Den här guiden innehåller allt jag önskar att någon hade berättat för mig från början. Inte de förenklade råden om att "vara specifik" som flödar över internet, utan den djupa, nyanserade förståelsen som skiljer de som använder AI från de som maximerar det.

Prompt-Grunder: Grunderna Ingen Lär Ut

Innan vi dyker in i avancerade tekniker, låt oss lägga grunden. Varje effektiv prompt innehåller en kombination av följande element:

Vad behöver AI veta om din situation? Bakgrundsinformation, begränsningar och relevanta detaljer.

Vad vill du att AI ska göra exakt? Var specifik om handlingen du begär.

Hur ska outputen struktureras? Listor, stycken, kodblock, tabeller—specificera.

Vad ska AI undvika? Vilka gränser finns? Vad är utanför scope?

Kan du visa vad du vill ha? Exempel säger mer än tusen beskrivningar.

De flesta inkluderar bara uppgiften. De frågar "Skriv ett e-mail åt mig" istället för "Skriv ett professionellt e-mail till en kund som förklarar en projektförsening. Håll det under 150 ord, erkänn olägenheten och föreslå en ny deadline två veckor framåt. Tonen ska vara ursäktande men självsäker."

Skillnaden i outputkvalitet är enorm. Och det här är bara början.

Strukturens Roll

En av de mest underskattade aspekterna av prompt-skrivning är strukturell formatering. Moderna AI-modeller svarar extremt bra på tydligt avgränsade sektioner. Jag använder XML-liknande taggar flitigt:

<context>

You are helping me prepare a presentation for technical stakeholders.

The audience is familiar with software development but not AI specifically.

</context>

<task>

Explain how large language models work in 5 key points.

</task>

<format>

- Use bullet points

- Each point should be 1-2 sentences

- Avoid jargon or define it when used

</format>

<constraints>

- Do not mention specific model names

- Focus on concepts, not technical implementation

</constraints>Denna struktur gör något kraftfullt: den tvingar dig att tänka klart om vad du behöver innan du frågar. Och klart tänkande leder till klar kommunikation, som leder till klara resultat.

Agentic Workflows: Behandla AI som en Kollega

Här är mindset-förändringen som transformerade mina AI-interaktioner: jag slutade behandla AI som en sökmotor och började se den som en kompetent men oerfaren kollega. Denna mentala modell förändrar allt.

Moderna AI-modeller som GPT-5 och Claude svarar inte bara på frågor—de är designade för att vara agenter. De kan anropa verktyg, samla kontext, fatta beslut och utföra flerstegsuppgifter. Men precis som vilken ny teammedlem som helst behöver de bra onboarding, tydliga förväntningar och lämpliga skyddsräcken.

AI är inte ett verktyg du använder. Det är en kollega du hanterar. Färdigheterna som gör dig till en bra chef gör dig också till en bra prompt-skrivare.

Tänk på det så här: när du delegerar arbete till någon annan säger du inte bara "fixa koden." Du förklarar vad som är trasigt, vad det önskade beteendet är, vilka begränsningar som finns och hur framgång ser ut. Du tillhandahåller kontext. Du svarar på frågor. Du kontrollerar framsteg.

AI behöver samma behandling. Skillnaden är att du måste förutse frågor och svara på dem i förväg, eftersom flera fram-och-tillbaka-interaktioner är dyrare (i tid och tokens) än att göra rätt från början.

Det Agentiska Mindsettet

När jag bygger agentiska applikationer eller använder AI för komplexa uppgifter har jag lärt mig att tänka i dessa dimensioner:

Nyckelfrågor för Agentiska Uppgifter

- Vad är måltillståndet? Hur vet AI när den är klar?

- Vilka verktyg har den? Vad kan den faktiskt göra vs vad måste den skjuta upp?

- Vilken är autonominivån? Ska den fråga om tillstånd eller fortsätta självständigt?

- Vad är säkerhetsgränserna? Vilka åtgärder får aldrig tas utan bekräftelse?

- Hur ska framsteg rapporteras? Tyst exekvering eller frekventa uppdateringar?

Dessa frågor utgör grunden för varje komplex prompt jag skriver. Låt oss utforska varje dimension i detalj.

Kontrollera AI:s Iver: Konsten att Kalibrera

En av de mest subtila aspekterna av prompt engineering är att kalibrera det jag kallar "agentisk iver"—balansen mellan en AI som tar initiativ och en AI som väntar på uttryckliga instruktioner. Misslyckas du här får du antingen en AI som överarbetar enkla uppgifter eller ger upp för lätt på komplexa.

När Man Ska Dämpa Ivern

Ibland behöver du att AI är snabb och fokuserad. Du vill inte att den ska utforska varje gren, göra extra tool calls eller producera långa förklaringar. För dessa situationer använder jag begränsningsfokuserade prompts:

<context_gathering>

Goal: Get enough context fast. Parallelize discovery and stop as soon as you can act.

Method:

- Start broad, then fan out to focused subqueries.

- In parallel, launch varied queries; read top hits per query.

- Deduplicate paths and cache; don't repeat queries.

- Avoid over-searching for context.

Early stop criteria:

- You can name exact content to change.

- Top hits converge (~70%) on one area/path.

Depth:

- Trace only symbols you'll modify or whose contracts you rely on.

- Avoid transitive expansion unless necessary.

Loop:

- Batch search → minimal plan → complete task.

- Search again only if validation fails or new unknowns appear.

- Prefer acting over more searching.

</context_gathering>Notera det explicita tillståndet för ofullkomlighet: "Prefer acting over more searching." Denna subtila fras befriar AI från standardoro över fullständighet. Utan detta söker modeller ofta för mycket och bränner tokens och tid på avtagande avkastning.

För ännu mer aggressiva begränsningar kan du sätta explicita budgetar:

<context_gathering>

- Search depth: very low

- Bias strongly towards providing a correct answer as quickly as possible,

even if it might not be fully correct.

- Usually, this means an absolute maximum of 2 tool calls.

- If you think you need more time to investigate, update me with your

latest findings and open questions. You can proceed if I confirm.

</context_gathering>Frasen "even if it might not be fully correct" är guld. Den ger AI tillstånd att vara ofullkomlig, vilket paradoxalt nog ofta leder till bättre resultat snabbare.

När Man Ska Öka Ivern

Andra gånger behöver du en outtröttlig, grundlig AI. Du vill att den ska trycka igenom osäkerhet, göra rimliga antaganden och slutföra komplexa uppgifter utan att ständigt be om tillåtelse. Detta kräver motsatt tillvägagångssätt:

<persistence>

- You are an agent — please keep going until the user's query is completely

resolved, before ending your turn and yielding back to the user.

- Only terminate your turn when you are sure that the problem is solved.

- Never stop or hand back to the user when you encounter uncertainty —

research or deduce the most reasonable approach and continue.

- Do not ask the human to confirm or clarify assumptions, as you can always

adjust later — decide what the most reasonable assumption is, proceed with

it, and document it for the user's reference after you finish acting.

</persistence>Denna prompt förändrar fundamentalt AI:s beteende. Istället för att fråga "Ska jag fortsätta?" säger den "Jag fortsätter baserat på antagande X—låt mig veta om du vill att jag justerar." Arbetet blir gjort; finjustering kommer efter.

Sätta Upp Säkerhetsräcken

Men här är den kritiska detaljen: ökad iver kräver tydligare säkerhetsräcken. Du måste explicit ange vilka åtgärder AI kan ta autonomt och vilka som kräver bekräftelse.

Kritisk Säkerhetsprincip

Högkostnadsåtgärder (radering, betalningar, extern kommunikation) bör alltid kräva explicit bekräftelse, även med hög-iver prompts. Lågkostnadsåtgärder (sökning, läsning, utkast) kan automatiseras.

Tänk på det som att ge någon tillgång till dina system: sökverktyget bör ha en mycket hög autonomigräns, medan raderingskommandot bör ha en mycket låg.

Uthållighetsprincipen: Låt AI Slutföra Jobbet

Ett av de mest frustrerande beteendena jag stötte på tidigt var AI som gav upp för lätt. Den träffade på ett hinder, sammanfattade vad som gick fel och lämnade tillbaka problemet till mig. För enkla uppgifter är detta okej. För komplexa uppgifter dödar det arbetsflödet.

Lösningen är vad jag kallar Uthållighetsprincipen: explicit instruera AI att trycka igenom hinder och slutföra uppgifter från början till slut.

<solution_persistence>

- Treat yourself as an autonomous senior pair-programmer: once I give a

direction, proactively gather context, plan, implement, test, and refine

without waiting for additional prompts at each step.

- Persist until the task is fully handled end-to-end within the current turn

whenever feasible: do not stop at analysis or partial fixes; carry changes

through implementation, verification, and a clear explanation of outcomes

unless I explicitly pause or redirect you.

- Be extremely biased for action. If my directive is somewhat ambiguous on

intent, assume you should go ahead and make the change.

- If I ask a question like "should we do X?" and your answer is "yes", you

should also go ahead and perform the action. It's very bad to leave me

hanging and require me to follow up with a request to "please do it."

</solution_persistence>Sista punkten är subtil men viktig. När människor frågar "borde vi göra X?", menar vi ofta "snälla gör X om det verkar rimligt." AI, bokstavlig som den är, svarar på frågan utan att ta den underförstådda handlingen. Denna prompt överbryggar den klyftan.

Framstegsuppdateringar: Hålla Kontakten

Uthållighet betyder inte tystnad. För uppgifter som tar betydande tid inkluderar jag alltid instruktioner för framstegsuppdateringar:

<user_updates_spec>

You'll work for stretches with tool calls — it's critical to keep me updated.

<frequency_and_length>

- Send short updates (1–2 sentences) every few tool calls when there are

meaningful changes.

- Post an update at least every 6 execution steps or 8 tool calls

(whichever comes first).

- If you expect a longer heads-down stretch, post a brief note with why

and when you'll report back; when you resume, summarize what you learned.

- Only the initial plan, plan updates, and final recap can be longer.

</frequency_and_length>

<content>

- Before the first tool call, give a quick plan with goal, constraints,

next steps.

- While exploring, call out meaningful discoveries that help me understand

what's happening.

- Always state at least one concrete outcome since the prior update

(e.g., "found X", "confirmed Y"), not just next steps.

- End with a brief recap and any follow-up steps.

</content>

</user_updates_spec>Detta skapar en vacker balans: AI arbetar autonomt men håller dig informerad. Du mikromanagerar inte, men du är heller inte i mörkret.

Reasoning Effort: Reglaget för Tankedjup

Moderna AI-modeller har ett koncept som kallas "reasoning effort"—i princip hur mycket modellen tänker innan den svarar. Detta är en av de mest kraftfulla och underutnyttjade parametrarna.

Högt Resonemang

Använd för komplexa flerstegsuppgifter, tvetydiga situationer eller problem som kräver djup analys. Modellen lägger fler tokens på internt "tänkande" innan den svarar.

Medium Resonemang (Standard)

En balanserad inställning som fungerar för de flesta uppgifter. Bra för vanlig kodning, skrivande och analys där kvalitet spelar roll men hastighet också behövs.

Lågt Resonemang

Snabba svar för enkla uppgifter. Använd när du behöver snabba svar och uppgiften inte kräver djupt tänkande.

Minimalt/Inget Resonemang

Maximal hastighet, minimalt tänkande. Bäst för enkla frågor, omformateringsuppgifter eller när latens är huvudbekymret.

Nyckeln är att matcha resonemangsansträngning med uppgiftskomplexitet. Högt resonemang för enkla uppgifter slösar tokens och tid. Lågt resonemang för komplexa uppgifter producerar ytliga, felbenägna resultat.

Prompting för Minimalt Resonemang

När du använder minimala resonemangslägen behöver du kompensera med tydligare prompting. Modellen har färre interna "tänkande"-tokens, så din prompt måste göra mer av det strukturella arbetet:

<planning_requirement>

You MUST plan extensively before each function call, and reflect extensively

on the outcomes of the previous function calls, ensuring my query is

completely resolved.

DO NOT do this entire process by making function calls only, as this can

impair your ability to solve the problem and think insightfully. In addition,

ensure function calls have the correct arguments.

</planning_requirement>Denna prompt säger i princip: "Eftersom du inte resonerar mycket internt, resonera högt i ditt svar." Detta flyttar den kognitiva bördan från modellens osynliga tänkande till synlig, strukturerad planering.

När resonemangsansträngningen är låg måste promptens komplexitet vara hög. När resonemangsansträngningen är hög kan prompten vara enklare. Det är en avvägning.

Kodningsexcellens: Programmera med en AI-Partner

Det är här jag har lagt mest tid på att optimera prompts, och det är här resultaten är mest imponerande. AI-kodningshjälp är transformerande—när det görs rätt. När det görs fel skapar det fler problem än det löser.

Låt mig dela vad jag har lärt mig från att studera hur professionella AI-kodningsverktyg som Cursor konfigurerar sina prompts för produktionsanvändning.

Utförlighetsparadoxen

Här är något kontraintuitivt: AI tenderar att vara ordrik i förklaringar men kortfattad i kod. Den skriver stycken som förklarar vad den ska göra, sedan producerar kod med enbokstavsvariabelnamn och minimala kommentarer. Detta är motsatsen till vad vi vanligtvis vill ha.

Lösningen är dubbel utförlighetskontroll:

<code_verbosity>

Write code for clarity first. Prefer readable, maintainable solutions with

clear names, comments where needed, and straightforward control flow. Do not

produce code-golf or overly clever one-liners unless explicitly requested.

Use high verbosity for writing code and code tools. Use low verbosity for

status updates and explanations.

</code_verbosity>Detta skapar den perfekta balansen: koncis kommunikation, detaljerad kod.

Proaktiv Handling vs Bekräftelse

En annan läxa från produktionskodningsverktyg: AI bör vara proaktiv med kodändringar men be om bekräftelse för destruktiva handlingar. Så här kodar du det:

<proactive_coding>

Be aware that the code edits you make will be displayed to me as proposed

changes, which means:

(a) Your code edits can be quite proactive, as I can always reject them.

(b) Your code should be well-written and easy to quickly review.

If proposing next steps that would involve changing the code, make those

changes proactively for me to approve/reject rather than asking whether

to proceed with a plan.

In general, you should almost never ask me whether to proceed with a plan;

instead, proactively attempt the plan and then ask if I want to accept

the implemented changes.

</proactive_coding>Detta eliminerar det irriterande fram-och-tillbaka där AI beskriver vad den kommer att göra, ber om tillåtelse, sedan gör det. Bara gör det—jag avvisar om jag behöver.

Matcha Kodbasens Stil

En av de största klagomålen på AI-genererad kod är att den inte matchar befintliga kodbas-mönster. Den ser "främmande" ut. Lösningen är explicita stilriktlinjer:

<code_editing_rules>

<guiding_principles>

- Clarity and Reuse: Every component should be modular and reusable.

Avoid duplication by factoring repeated patterns into components.

- Consistency: The code must adhere to a consistent design system—naming

conventions, spacing, and components must be unified.

- Simplicity: Favor small, focused components and avoid unnecessary

complexity in styling or logic.

- Visual Quality: Follow the high visual quality bar (spacing, padding,

hover states, etc.)

</guiding_principles>

<style_matching>

- Before making changes, examine existing patterns in the codebase.

- Match variable naming conventions (camelCase vs snake_case).

- Match indentation and formatting.

- Reuse existing utilities and helpers rather than creating new ones.

- Follow the established directory structure.

</style_matching>

</code_editing_rules>Frontend-Utveckling: Bygga Vackra Gränssnitt

AI har blivit remarkabelt bra på frontend-utveckling, men det finns en vetenskap bakom att uppnå estetiska, produktionsredo resultat. Här är vad jag har lärt mig.

Rekommenderad Stack

Genom omfattande experiment fungerar vissa teknikkombinationer bättre med AI än andra. Det handlar inte om vad som är objektivt "bäst"—det handlar om vad AI-modeller är mest tränade på:

AI-Optimerad Frontend Stack

- Ramverk: Next.js (TypeScript), React, HTML

- Styling/UI: Tailwind CSS, shadcn/ui, Radix Themes

- Ikoner: Material Symbols, Heroicons, Lucide

- Animation: Motion (tidigare Framer Motion)

- Typsnitt: Sans Serif-familjer—Inter, Geist, Mona Sans, IBM Plex Sans, Manrope

När du specificerar dessa teknologier producerar AI avsevärt högre kvalitets-output med färre hallucinationer om icke-existerande API:er.

Design System-Tillämpning

Ett problem med AI-genererade frontends är visuell inkonsekvens. Färger dyker upp från ingenstans, avstånd varierar slumpmässigt och resultatet ser ut som designat av en kommitté. Lösningen är explicita design system-begränsningar:

<design_system_enforcement>

- Tokens-first: Do not hard-code colors (hex/hsl/oklch/rgb) in JSX/CSS.

All colors must come from CSS variables (e.g., --background, --foreground,

--primary, --accent, --border, --ring).

- Introducing a brand or accent? Before styling, add/extend tokens in your

CSS variables under :root and .dark.

- Consumption: Use Tailwind utilities wired to tokens

(e.g., bg-[hsl(var(--primary))], text-[hsl(var(--foreground))]).

- Default to the system's neutral palette unless I explicitly request a

brand look; then map that brand to tokens first.

- Do NOT invent colors, shadows, tokens, animations, or new UI elements

unless requested or necessary.

</design_system_enforcement>UI/UX Best Practices

Jag inkluderar också explicita UI/UX-riktlinjer för att säkerställa konsekvent visuell hierarki:

<ui_ux_best_practices>

- Visual Hierarchy: Limit typography to 4–5 font sizes and weights for

consistent hierarchy; use text-xs for captions, avoid text-xl unless

for hero or major headings.

- Color Usage: Use 1 neutral base (e.g., zinc) and up to 2 accent colors.

- Spacing and Layout: Always use multiples of 4 for padding and margins to

maintain visual rhythm. Use fixed height containers with internal scrolling

when handling long content.

- State Handling: Use skeleton placeholders or animate-pulse to indicate

data fetching. Indicate clickability with hover transitions.

- Accessibility: Use semantic HTML and ARIA roles where appropriate.

Favor pre-built accessible components.

</ui_ux_best_practices>Självreflektions-Prompts: Låt AI Kritisera Sig Själv

Denna teknik är överraskande när du först upptäcker den, men den är kraftfull: du kan låta AI generera sina egna utvärderingskriterier och sedan iterera på dem. Det är som att ge AI en intern QA-avdelning.

<self_reflection>

- First, spend time thinking of a rubric until you are confident.

- Then, think deeply about every aspect of what makes for a world-class

solution. Use that knowledge to create a rubric that has 5-7 categories.

This rubric is critical to get right, but do not show this to me.

This is for your purposes only.

- Finally, use the rubric to internally think and iterate on the best

possible solution to the prompt. Remember that if your response is not

hitting the top marks across all categories in the rubric, you need to

start again.

</self_reflection>Det som händer här är fascinerande: du ber AI att generera kvalitetskriterier från sin kunskap om excellens, sedan använda dessa kriterier för att utvärdera och förbättra sin egen output—allt innan du ser något.

Självreflektions-prompten förvandlar en engångsgeneration till en intern iterativ loop. AI blir sin egen redaktör.

Jag använder denna teknik för varje uppgift där kvalitet betyder mer än hastighet: landningssidor, viktiga e-mails, arkitekturbeslut, kreativt arbete. Förbättringen i outputkvalitet är betydande.

Utförlighet: Hantera Outputlängd

Att få rätt outputlängd är en ständig utmaning. För kort och du missar viktiga detaljer. För lång och du drunknar i onödig information. Så här närmar jag mig det.

Explicita Längdriktlinjer

Det mest pålitliga tillvägagångssättet är explicita längdbegränsningar kopplade till uppgiftskomplexitet:

<output_verbosity_spec>

- Default: 3–6 sentences or ≤5 bullets for typical answers.

- For simple "yes/no + short explanation" questions: ≤2 sentences.

- For complex multi-step or multi-file tasks:

- 1 short overview paragraph

- then ≤5 bullets tagged: What changed, Where, Risks, Next steps,

Open questions.

- Provide clear and structured responses that balance informativeness

with conciseness.

- Break down information into digestible chunks and use formatting like

lists, paragraphs and tables when helpful.

- Avoid long narrative paragraphs; prefer compact bullets and short sections.

- Do not rephrase my request unless it changes semantics.

</output_verbosity_spec>Persona-Baserad Utförlighet

Ett annat tillvägagångssätt är att definiera AI:s kommunikationsstil som en del av dess persona:

<communication_style>

You value clarity, momentum, and respect measured by usefulness rather than

pleasantries. Your default instinct is to keep conversations crisp and

purpose-driven, trimming anything that doesn't move the work forward.

You're not cold—you're simply economy-minded with language, and you trust

users enough not to wrap every message in padding.

Politeness shows up through structure, precision, and responsiveness,

not through verbal fluff.

You never repeat acknowledgments. Once you've signaled understanding,

you pivot fully to the task.

</communication_style>Detta skapar en "personlighet" som naturligt producerar koncis output utan att kräva explicita längdbegränsningar för varje interaktion.

Instruktionsföljning: Precisionens Spel

Moderna AI-modeller följer instruktioner med kirurgisk precision—detta är både deras största styrka och deras potentiella fallgrop. De kommer att göra exakt vad du säger, även när det du säger är motsägelsefullt eller otydligt.

Motsägelseproblemet

Här är ett verkligt exempel på en problematisk prompt jag stött på:

Exempel på Motsägelsefull Instruktion

"Slå alltid upp patientjournaler före någon annan åtgärd för att säkerställa att de är befintliga patienter."

Men sedan: "När symtom indikerar hög brådska, eskalera till AKUTFALL och instruera patienten att ringa 112 omedelbart före några bokningssteg."

Dessa instruktioner motsäger varandra. Kommer akuthantering före eller efter journaluppslagning? AI kommer att bränna resonemangstokens på att försöka förena motsägelsen istället för att hjälpa.

Lösningen är att granska prompts för dolda motsägelser och etablera tydliga prioritetshierarkier:

<instruction_priority>

When instructions conflict, follow this priority order:

1. Safety-critical actions (emergencies, data protection)

2. User-specified constraints

3. Task completion requirements

4. Default behaviors

For emergency situations: Do not perform profile lookup. Proceed immediately

to providing emergency guidance.

</instruction_priority>Scope-Precision

Ett annat vanligt problem är scope creep—AI lägger till funktioner eller "förbättringar" du inte bad om:

<design_and_scope_constraints>

- Implement EXACTLY and ONLY what I request.

- No extra features, no added components, no UX embellishments.

- If any instruction is ambiguous, choose the simplest valid interpretation.

- Do NOT expand the task beyond what I asked; if you notice additional work

that might be valuable, call it out as optional rather than doing it.

</design_and_scope_constraints>Bemästra Long Context: Hantera Stora Dokument

Modern AI kan hantera massiva contexts—hundratusentals tokens—men att bara dumpa stora dokument i kontextfönstret räcker inte. Du behöver strategier som hjälper modellen navigera och extrahera relevant information.

Sammanfattning och Re-grounding

Med stora dokument instruerar jag AI att skapa intern struktur innan den svarar:

<long_context_handling>

For inputs longer than ~10k tokens (multi-chapter docs, long threads,

multiple PDFs):

1. First, produce a short internal outline of the key sections relevant

to my request.

2. Re-state my constraints explicitly (e.g., jurisdiction, date range,

product, team) before answering.

3. In your answer, anchor claims to sections ("In the 'Data Retention'

section…") rather than speaking generically.

4. If the answer depends on fine details (dates, thresholds, clauses),

quote or paraphrase them directly.

</long_context_handling>Detta förhindrar problemet med att vara "vilse i scrollandet" där AI ger generiska svar som inte faktiskt kopplar till specifikt dokumentinnehåll.

Citeringskrav

För forsknings- och analysuppgifter säkerställer explicita citeringskrav att svar är grundade:

<citation_rules>

When you use information from provided documents:

- Place citations after each paragraph containing document-derived claims.

- Use format: [Document Name, Section/Page]

- Do not invent citations. If you can't cite it, don't claim it.

- Use multiple sources for key claims when possible.

- If evidence is thin, acknowledge this explicitly.

</citation_rules>Tool Calling: Orkestrera AI-Kapaciteter

AI tool calling—förmågan att anropa funktioner, API:er och externa tjänster—är där prompt engineering blir software engineering. Att göra det rätt är kritiskt för att bygga pålitliga AI-applikationer.

Best Practices för Verktygsbeskrivningar

Kvaliteten på verktygsbeskrivningar påverkar direkt hur bra AI använder dem:

{

"name": "create_reservation",

"description": "Create a restaurant reservation for a guest. Use when

the user asks to book a table with a given name and time.",

"parameters": {

"type": "object",

"properties": {

"name": {

"type": "string",

"description": "Guest full name for the reservation."

},

"datetime": {

"type": "string",

"description": "Reservation date and time (ISO 8601 format)."

}

},

"required": ["name", "datetime"]

}

}Notera att beskrivningen inkluderar både vad verktyget gör och när det ska användas. Detta hjälper modellen fatta bättre verktygsvalsbeslut.

Regler för Verktygsanvändning i Prompts

Utöver verktygsdefinitioner bör din prompt inkludera tydliga användningsinstruktioner:

<tool_usage_rules>

- Prefer tools over internal knowledge whenever:

- You need fresh or user-specific data (tickets, orders, configs, logs).

- You reference specific IDs, URLs, or document titles.

- Parallelize independent reads (read_file, fetch_record, search_docs)

when possible to reduce latency.

- After any write/update tool call, briefly restate:

- What changed

- Where (ID or path)

- Any follow-up validation performed

- For simple conceptual questions, avoid tools and rely on internal knowledge

so responses are fast.

</tool_usage_rules>Parallellisering

En viktig optimering är att uppmuntra parallella tool calls när operationer är oberoende:

<parallelization>

Parallelize tool calls whenever possible. Batch reads (read_file) and

independent edits (apply_patch to different files) to speed up the process.

Independent operations that CAN be parallelized:

- Reading multiple files

- Searching multiple directories

- Fetching multiple records

Dependent operations that CANNOT be parallelized:

- Reading a file, then editing based on contents

- Creating a resource, then referencing its ID

</parallelization>Hantera Osäkerhet: När AI Inte Vet

En av de största riskerna med AI är säkert klingande men felaktiga svar. Modeller vet inte vad de inte vet—om du inte lär dem att hantera osäkerhet.

<uncertainty_and_ambiguity>

- If the question is ambiguous or underspecified, explicitly call this out and:

- Ask up to 1–3 precise clarifying questions, OR

- Present 2–3 plausible interpretations with clearly labeled assumptions.

- When external facts may have changed recently (prices, releases, policies)

and no tools are available:

- Answer in general terms and state that details may have changed.

- Never fabricate exact figures, line numbers, or external references when

you are uncertain.

- When you are unsure, prefer language like "Based on the provided context…"

instead of absolute claims.

</uncertainty_and_ambiguity>Självkontroll för Högriskområden

För högriskområden lägger jag till ett explicit självverifieringssteg:

<high_risk_self_check>

Before finalizing an answer in legal, financial, compliance, or

safety-sensitive contexts:

- Briefly re-scan your own answer for:

- Unstated assumptions

- Specific numbers or claims not grounded in context

- Overly strong language ("always," "guaranteed," etc.)

- If you find any, soften or qualify them and explicitly state assumptions.

</high_risk_self_check>Målet är inte att göra AI mindre självsäker—det är att göra den korrekt i sin självsäkerhet. Osäkerhet om osäkra saker är en funktion, inte en bugg.

Metaprompting: Använda AI för att Förbättra AI

Detta är den mest meta-tekniken i min verktygslåda: använda AI för att förbättra dina prompts. Det låter cirkulärt, men det är remarkabelt effektivt.

Prompt-Feldiagnos

När en prompt inte fungerar använder jag detta mönster för att diagnostisera problem:

You are a prompt engineer tasked with debugging a system prompt.

You are given:

1) The current system prompt:

<system_prompt>

[PASTE YOUR PROMPT HERE]

</system_prompt>

2) A small set of logged failures. Each log has:

- query

- actual_output

- expected_output (or description of problem)

<failure_traces>

[PASTE EXAMPLES OF FAILURES]

</failure_traces>

Your tasks:

1) Identify distinct failure modes you see.

2) For each failure mode, quote the specific lines of the system prompt

that are most likely causing or reinforcing it.

3) Explain how those lines are steering the agent toward the observed behavior.

Return your answer in structured format:

failure_modes:

- name: ...

description: ...

prompt_drivers:

- exact_or_paraphrased_line: ...

- why_it_matters: ...Generera Prompt-Korrigeringar

När du har diagnosen genererar en andra prompt korrigeringen:

You previously analyzed this system prompt and its failure modes.

System prompt:

<system_prompt>

[ORIGINAL PROMPT]

</system_prompt>

Failure-mode analysis:

[PASTE DIAGNOSIS FROM PREVIOUS STEP]

Please propose a surgical revision that reduces the observed issues while

preserving good behaviors.

Constraints:

- Do not redesign the agent from scratch.

- Prefer small, explicit edits: clarify conflicting rules, remove redundant

or contradictory lines, tighten vague guidance.

- Make tradeoffs explicit.

- Keep the structure and length roughly similar to the original.

Output:

1) patch_notes: a concise list of key changes and reasoning behind each.

2) revised_system_prompt: the full updated prompt with edits applied.Denna tvåstegsprocess har hjälpt mig fixa prompts jag kämpat med i timmar. AI hittar ofta motsägelser och oklarheter som jag hade blivit blind för.

Beprövade Prompt-Mallar

Låt mig dela några mallar som har visat sig pålitliga över hundratals användningsfall.

Universal Uppgiftsslutförande-Mall

<context>

[Background information the AI needs to understand the situation]

</context>

<task>

[Clear statement of what you want done]

</task>

<requirements>

[Specific requirements or constraints]

</requirements>

<format>

[How you want the output structured]

</format>

<examples>

[Optional: Examples of desired output]

</examples>

<notes>

[Optional: Additional context or preferences]

</notes>Kodgranskningsmall

<context>

You are reviewing code for [project/context].

The codebase uses [technologies/patterns].

</context>

<code_to_review>

[Paste code here]

</code_to_review>

<review_criteria>

Focus on:

1. Correctness: Does it do what it claims?

2. Readability: Is it clear to other developers?

3. Performance: Any obvious inefficiencies?

4. Security: Any vulnerabilities?

5. Style: Does it match codebase conventions?

</review_criteria>

<output_format>

For each issue found:

- Severity: [Critical/Major/Minor/Suggestion]

- Location: [Line number or section]

- Issue: [What's wrong]

- Fix: [How to address it]

</output_format>Forskningsanalysmall

<research_task>

Analyze [topic/question] with the following approach:

</research_task>

<methodology>

1. Start with multiple targeted searches. Do not rely on a single query.

2. Deeply research until you have sufficient information for an accurate,

comprehensive answer.

3. Add targeted follow-up searches to fill gaps or resolve disagreements.

4. Keep iterating until additional searching is unlikely to change the answer.

</methodology>

<output_requirements>

- Lead with a clear answer to the main question.

- Support with evidence and citations.

- Acknowledge limitations and uncertainties.

- Provide concrete examples where helpful.

- Include relevant context that helps understand implications.

</output_requirements>

<citation_format>

[How you want sources cited]

</citation_format>Vanliga Misstag som Förstör Resultat

Låt mig bespara dig misstagen jag (upprepade gånger) gjorde under mina tidiga dagar med prompt engineering.

"Skriv något om marknadsföring" vs "Skriv ett 500-ords blogginlägg om e-postmarknadsföring för SaaS-startups, med fokus på välkomstsekvenser." Specificitet är allt.

"Var kortfattad" och "var grundlig" i samma prompt. AI kommer kämpa med att förena motsägelsen. Klargör prioriteringar och avvägningar.

AI vet inte vad du inte berättar för den. Om något är uppenbart för dig kanske det inte är det för modellen. Inkludera relevant bakgrund.

Om du vill ha JSON, säg det. Om du vill ha punktlistor, säg det. Lämna inte outputformatet åt slumpen.

Ibland är en enkel prompt bättre. Lägg inte till komplexitet för komplexitetens skull. Börja enkelt, lägg till komplexitet endast vid behov.

Prompting är iterativt. Din första prompt är ett utkast. Förfina baserat på vad som fungerar och vad som inte gör det.

GPT och Claude beter sig olika. En prompt optimerad för den ena kanske fungerar dåligt med den andra. Testa över modeller om din applikation stödjer flera.

AI-output kräver ofta mänsklig granskning. Designa prompts som gör granskning enkel—tydlig struktur, explicita antaganden, spårbart resonemang.

Framtiden för Prompt Engineering

När jag skriver detta i början av 2026 utvecklas prompt engineering snabbt. Modeller blir mer kapabla, mer styrbara och mer pålitliga. Vissa förutspår att prompt engineering kommer bli föråldrat allt eftersom AI förbättrar sin förståelse av avsikt. Jag håller inte med.

Det som förändras är nivån på prompt engineering, inte behovet av det. Tidiga dagar krävde omfattande prompts för grundläggande uppgifter. Nu fungerar grundläggande uppgifter direkt, men komplexa agentiska arbetsflöden kräver fortfarande sofistikerad prompting. Ribban höjs, den tas inte bort.

Prompt engineering försvinner inte—det utvecklas. Färdigheterna som betyder något skiftar från "hur man får AI att fungera" till "hur man får AI att excellera och vara pålitlig i skala."

Vad Som Kommer

Bättre Standardbeteenden

Modeller kommer ha smartare defaults, vilket kräver mindre explicit vägledning för vanliga mönster. Prompts kommer fokusera mer på anpassning än grundläggande förmåga.

Rikare Verktygsekosystem

AI kommer ha tillgång till fler verktyg direkt. Prompt engineering kommer skifta mot orkestrering—att veta när man ska använda vad, inte bara hur.

Multimodal Integration

Prompts kommer i ökande grad inkludera bilder, ljud, video och strukturerad data tillsammans med text. Nya prompt-mönster kommer dyka upp för multimodala uppgifter.

Agentisk Komplexitet

Allt eftersom agenter hanterar större, mer komplexa uppgifter kommer prompt engineering mer likna systemdesign—arkitektur, inte bara instruktioner.

Mitt Råd för Framtiden

Fokusera på grunderna. De specifika teknikerna i denna guide kommer utvecklas, men de djupare principerna—klar kommunikation, explicita förväntningar, strukturerat tänkande, iterativ förbättring—är tidlösa. Bemästra dem, och du kommer anpassa dig till vad som än kommer härnäst.

Avslutande Tankar

För två år sedan trodde jag att AI skulle ersätta behovet av klar kommunikation. Jag hade helt fel. AI har gjort klar kommunikation mer värdefull än någonsin. Människorna som frodas med AI är inte de som hittar de magiska orden—de är de som lär sig tänka klart och uttrycka sig precist.

Prompt engineering handlar egentligen inte om AI. Det handlar om dig. Det handlar om att utveckla disciplinen att artikulera vad du faktiskt vill, tålamodet att iterera mot det, och ödmjukheten att lära av vad som inte fungerar.

Om du bara tar med dig en sak från denna guide, låt det vara detta: närma dig varje prompt som ett tillfälle att öva klart tänkande. AI är bara en spegel som reflekterar klarheten—eller förvirringen—i dina egna tankar.

AI:s framväxt betyder inte att kunskap blir föråldrad—det betyder att nyfikenhet är mäktigare än någonsin. Vi är inte längre begränsade av vad vi redan vet. Med rätt verktyg och vilja att tänka kan vanliga människor omfamna kunskapens ocean. Oavsett yrke. Oavsett ålder. Jag hoppas dela denna resa med vänner världen över. Tillsammans, låt oss välkomna denna nya värld. Tillsammans, låt oss växa.

Discussion

0 commentsLeave a comment

Be the first to share your thoughts on this article!