AI læser ikke tanker. Den læser dine ord. Kvaliteten af din prompt afgør kvaliteten af outputtet.

For to år siden indtastede jeg min første prompt i ChatGPT og troede, at jeg forstod kunstig intelligens. Jeg tog fejl. Jeg forstod at stille spørgsmål – ikke at kommunikere med en maskine, der tænker i mønstre, sandsynligheder og tokens. Forskellen? Det er forskellen mellem at få generiske svar og at låse op for evner, du ikke vidste eksisterede. Dette er historien om, hvordan jeg lærte at tale flydende med AI, og alt hvad jeg opdagede undervejs.

Opvågningen: Da simple prompts fejlede

Det skete lige før en projektdeadline. Jeg havde brug for AI til at hjælpe mig med at refaktorere noget kompleks kode – noget jeg havde gjort hundredvis af gange før. Men denne gang, uanset hvordan jeg formulerede min anmodning, gav AI mig løsninger, der var teknisk korrekte, men fuldstændig missede pointen. Den tilføjede unødvendig kompleksitet, brød eksisterende mønstre og "forbedrede" ting, der ikke behøvede at blive ændret.

Jeg var frustreret. Så blev jeg nysgerrig. Hvad gjorde jeg forkert?

Den frustration førte mig ned i et kaninhul, der ændrede alt: officiel dokumentation, forskningsartikler, prompt engineering-guider og tusindvis af timers eksperimentering. Det jeg opdagede var ikke bare tricks – det var et komplet paradigmeskift i, hvordan man kommunikerer med AI-systemer.

Verdens mest kraftfulde AI er ubrugelig, hvis du ikke kan kommunikere, hvad du faktisk har brug for.

Her er sandheden, som ingen fortæller begyndere: At skrive prompts handler ikke om at finde magiske ord. Det handler om at forstå, hvordan AI-modeller behandler sprog, hvilken information de har brug for, og hvordan man strukturerer den information, så modellen faktisk kan hjælpe dig. Det er en færdighed – og som enhver færdighed kan den læres, øves og mestres.

Denne guide indeholder alt, hvad jeg ville ønske, nogen havde fortalt mig fra starten. Ikke de forenklede "bare vær specifik"-råd, der flyder over internettet, men den dybe, nuancerede forståelse, der adskiller folk, der bruger AI, fra folk, der behersker AI.

Prompt-fundamenter: Det grundlæggende ingen lærer dig

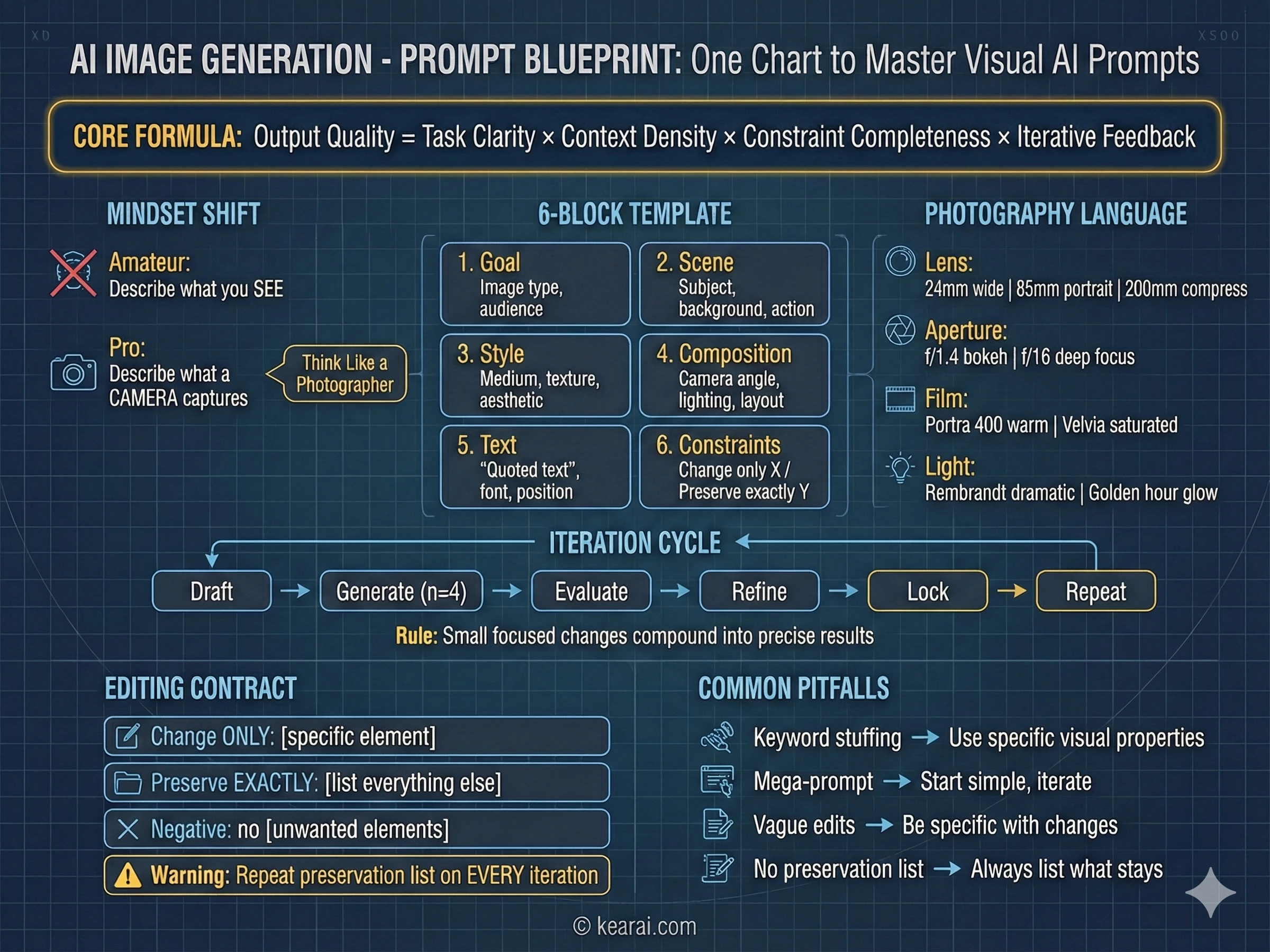

Før vi dykker ned i avancerede teknikker, lad os etablere fundamentet. Hver effektiv prompt indeholder en kombination af følgende elementer:

Hvad skal AI vide om situationen? Baggrundsinformation, begrænsninger og relevante detaljer.

Hvad vil du præcist have AI til at gøre? En klar beskrivelse af den handling, du anmoder om.

Hvordan skal outputtet struktureres? Lister, afsnit, kodeblokke, tabeller – specificer det.

Hvad skal AI undgå? Hvilke grænser findes der? Hvad er uden for scope?

Kan du vise, hvad du vil have? Et eksempel er bedre end tusind ord af beskrivelse.

De fleste inkluderer kun opgaven. De spørger "hjælp mig med at skrive en e-mail", når de burde sige "skriv en professionel e-mail til en kunde, der forklarer en projektforsinkelse. Hold det under 150 ord, anerkend ulejligheden, og foreslå en ny tidsplan med to ugers forsinkelse. Tonen skal være undskyldende men selvsikker."

Forskellen i outputkvalitet er enorm. Og det er bare begyndelsen.

Strukturens rolle

Et af de mest undervurderede aspekter ved promptskrivning er struktureret formatering. Moderne AI-modeller reagerer særligt godt på klart adskilte sektioner. Jeg bruger XML-lignende tags flittigt:

<context>

Du hjælper mig med at forberede en præsentation til tekniske interessenter.

Publikum kender til softwareudvikling, men ikke specifikt AI.

</context>

<task>

Forklar hvordan store sprogmodeller fungerer i 5 punkter.

</task>

<format>

- Brug punktopstilling

- 1-2 sætninger per punkt

- Undgå jargon eller definer det, når det bruges

</format>

<constraints>

- Nævn ikke specifikke modelnavne

- Fokuser på koncepter, ikke teknisk implementering

</constraints>Denne struktur gør noget kraftfuldt: den tvinger dig til at tænke klart over, hvad du har brug for, før du spørger. Og klar tænkning fører til klar kommunikation, der fører til klare resultater.

Agentiske workflows: AI som din kollega

Her er et paradigmeskift, der ændrede måden, jeg interagerer med AI på: Stop med at behandle AI som en søgemaskine, og begynd at behandle den som en kompetent, men uerfaren kollega. Denne mentale model ændrer alt.

Moderne AI-modeller som GPT-5 og Claude svarer ikke bare på spørgsmål – de er designet til at være agenter. De kan kalde værktøjer, indsamle kontekst, træffe beslutninger og udføre flertrinsopgaver. Men ligesom ethvert nyt teammedlem har de brug for ordentlig onboarding, klare forventninger og passende sikkerhedsrammer.

AI er ikke et værktøj, du bruger. Det er en kollega, du leder. De færdigheder, der gør dig til en god leder, gør dig også til en god prompt engineer.

Tænk over det: Når du delegerer en opgave til et menneske, siger du ikke bare "fiks koden". Du forklarer, hvad der er i stykker, hvad den forventede adfærd er, hvilke begrænsninger der findes, og hvordan succes ser ud. Du giver kontekst. Du besvarer spørgsmål. Du følger op på fremskridt.

AI har brug for den samme behandling. Forskellen er, at du skal forudse spørgsmål og besvare dem på forhånd, fordi omkostningen ved frem-og-tilbage (tid og tokens) er højere end at gøre det rigtigt første gang.

Agentisk tænkning

Når jeg bygger agentiske applikationer eller bruger AI til komplekse opgaver, har jeg lært at tænke i disse baner:

Nøglespørgsmål til agentiske opgaver

- Hvad er måltilstanden? Hvordan ved AI, hvornår den er færdig?

- Hvilke værktøjer har den? Hvad kan den faktisk gøre, og hvad skal udskydes?

- Hvad er autonominiveauet? Skal den bede om tilladelse eller handle selvstændigt?

- Hvad er sikkerhedsgrænserne? Hvilke handlinger må aldrig udføres uden bekræftelse?

- Hvordan skal den rapportere fremskridt? Stille eksekvering eller regelmæssige opdateringer?

Disse spørgsmål danner grundlaget for hver kompleks prompt, jeg skriver. Lad os udforske hver dimension i detaljer.

Kontrol af AI's iver: Kunsten at kalibrere

Et af de mest nuancerede aspekter ved prompt engineering er at kalibrere, hvad jeg kalder "agentisk iver" – balancen mellem en AI, der tager initiativ, og en der venter på eksplicit vejledning. Får du det forkert, ender du enten med en AI, der overtænker simple opgaver, eller en der giver for hurtigt op ved komplekse.

Hvornår man skal sænke iveren

Nogle gange har du brug for AI til at være hurtig og fokuseret. Du vil ikke have den til at udforske hver gren, lave ekstra værktøjskald eller producere lange forklaringer. Til disse situationer bruger jeg begrænsningsorienterede prompts:

<context_gathering>

Mål: Hurtig indhentning af tilstrækkelig kontekst. Parallel opdagelse og stop med det samme, du kan handle.

Fremgangsmåde:

- Start bredt, udvid derefter til fokuserede underforespørgsler.

- Start diverse forespørgsler parallelt; læs topresultater fra hver.

- Dedupliker stier og cache; gentag ikke forespørgsler.

- Undgå overdreven kontekstsøgning.

Tidlige stopkriterier:

- Du kan navngive præcis, hvad der skal ændres.

- Topresultater konvergerer ~70% på ét område/sti.

Dybde:

- Spor kun symboler, du vil modificere eller afhænge af kontrakten for.

- Undgå transitiv ekspansion medmindre nødvendigt.

Loop:

- Batch-søgning → minimal plan → fuldfør opgave.

- Søg kun igen ved valideringsfejl eller nye ukendte.

- Foretræk handling frem for mere søgning.

</context_gathering>Bemærk den eksplicitte tilladelse til at være uperfekt: "Foretræk handling frem for mere søgning". Denne subtile sætning frigør AI fra dens standardangst for grundighed. Uden den har modeller tendens til at overresearche og forbruge tokens og tid på faldende afkast.

For mere aggressiv begrænsning kan du sætte eksplicitte budgetter:

<context_gathering>

- Søgedybde: Meget lav

- Stærk præference for at give et korrekt svar så hurtigt som muligt, selv hvis det måske ikke er helt korrekt.

- Generelt betyder dette absolut maksimalt 2 værktøjskald.

- Hvis du mener, du har brug for mere tid til at undersøge, opdater mig med dine seneste fund og åbne spørgsmål.

Hvis jeg bekræfter, kan du fortsætte.

</context_gathering>Sætningen "selv hvis det måske ikke er helt korrekt" er guld værd. Den giver AI tilladelse til at være uperfekt, hvilket paradoksalt ofte fører til bedre resultater hurtigere.

Hvornår man skal øge iveren

Andre gange har du brug for AI til at være utrættelig grundig. Du vil have den til at bryde igennem uklarheder, lave rimelige antagelser og fuldføre komplekse opgaver uden konstant at bede om tilladelse. Dette kræver den modsatte tilgang:

<persistence>

- Du er en agent – fortsæt venligst indtil brugerens forespørgsel er fuldstændig løst,

før du afslutter din tur og giver den til brugeren.

- Afslut kun din tur, når du er sikker på, at problemet er løst.

- Stop aldrig eller giv tilbage til brugeren, når du møder usikkerhed –

undersøg eller udled den mest rimelige tilgang og fortsæt.

- Bed ikke mennesket om bekræftelse eller afklaring af antagelser, da du altid kan justere senere –

beslut hvad den mest rimelige antagelse er, fortsæt med den, og

noter det til brugeren som reference, når du er færdig med handlingen.

</persistence>Denne prompt ændrer fundamentalt AI's adfærd. I stedet for at spørge "Skal jeg fortsætte?" siger den "Jeg fortsatte baseret på antagelse X – fortæl mig, hvis du vil have mig til at justere." Arbejdet bliver gjort; finpudsning kommer bagefter.

Definition af sikkerhedsgrænser

Men her er den afgørende nuance: Øget iver kræver klarere sikkerhedsgrænser. Du skal eksplicit definere, hvilke handlinger AI kan udføre autonomt, og hvilke der kræver bekræftelse.

Nøgle sikkerhedsprincip

Højomkostningsoperationer (sletning, betalinger, ekstern kommunikation) bør altid kræve eksplicit bekræftelse, selv med høj-iver prompts. Lavomkostningsoperationer (søgning, læsning, kladde-oprettelse) kan være autonome.

Tænk på det som at give nogen adgang til dine systemer: Søgeværktøjer bør have ekstremt høj autonomitærskel, mens slettekommandoer bør have ekstremt lav.

Persistensprincippet: At få AI til at følge op

En af de mest frustrerende adfærdsformer, jeg stødte på tidligt, var AI, der gav op for let. Den ville støde på en forhindring, opsummere hvad der gik galt, og så give problemet tilbage til mig. For simple opgaver er det fint. For komplekse opgaver er det en workflow-dræber.

Løsningen er, hvad jeg kalder persistensprincippet: eksplicitte instruktioner til AI om at fortsætte gennem forhindringer og fuldføre opgaver fra start til slut.

<solution_persistence>

- Betragt dig selv som en autonom senior pair programmer: Når jeg giver retning,

skal du proaktivt indsamle kontekst, planlægge, implementere, teste og finpudse

uden at vente på yderligere prompts ved hvert trin.

- Fortsæt indtil opgaven er fuldstændig håndteret ende-til-ende i den aktuelle tur

når det er muligt: stop ikke ved analyse eller delvis fix;

før ændringer helt igennem til implementering, verifikation og klar forklaring af resultater,

medmindre jeg eksplicit pauser eller omdirigerer dig.

- Hav ekstrem præference for handling. Hvis mine instruktioner er noget uklare i intention,

antag at du skal fortsætte med at lave ændringer.

- Hvis jeg stiller et spørgsmål som "Skal vi gøre X?", og dit svar er "ja",

skal du også fortsætte med at udføre handlingen. At lade mig hænge og bede mig

følge op med "gør det venligst" er meget dårligt.

</solution_persistence>Det sidste punkt er subtilt men vigtigt. Når mennesker spørger "Skal vi gøre X?", mener vi typisk "gør venligst X, hvis det er rimeligt". AI, der tager ting bogstaveligt, besvarer spørgsmålet uden at tage den implicitte handling. Denne prompt bygger bro over det gab.

Fremskridtsopdateringer: Hold dig informeret

Persistens betyder ikke tavshed. For langvarige opgaver inkluderer jeg altid instruktioner om fremskridtsopdateringer:

<user_updates_spec>

Du vil arbejde med værktøjskald et stykke tid – det er afgørende at holde mig informeret.

<frequency_and_length>

- Send korte opdateringer (1-2 sætninger) ved meningsfulde ændringer med få værktøjskalds mellemrum.

- Post mindst én opdatering hver 6. eksekveringstrin eller 8 værktøjskald

(hvad der end kommer først).

- Hvis du forventer en længere fokusperiode, post en kort note om hvorfor

og hvornår du vil rapportere; når du genoptager, opsummer hvad du lærte.

- Kun indledende plan, planopdateringer og endelig opsummering må være længere.

</frequency_and_length>

<content>

- Før første værktøjskald, giv en hurtig plan med mål, begrænsninger,

næste trin.

- Under udforskning, fremhæv meningsfulde fund for at hjælpe mig med at forstå,

hvad der sker.

- Angiv altid mindst ét konkret resultat siden sidste opdatering

(f.eks. "fandt X", "bekræftede Y"), ikke kun næste trin.

- Afslut med en kort opsummering og eventuelle næste trin.

</content>

</user_updates_spec>Dette skaber en smuk balance: AI arbejder autonomt, men holder dig informeret. Du mikrostyrer ikke, men du er heller ikke i mørket.

Reasoning-styrke: Justering af tænkeintensitet

Moderne AI-modeller har et koncept kaldet "reasoning effort" – i bund og grund hvor dybt modellen tænker, før den svarer. Det er en af de mest kraftfulde og underudnyttede parametre.

Høj reasoning

Til komplekse flertrinopgaver, tvetydige situationer eller problemer, der kræver dyb analyse. Modellen bruger flere tokens på intern "tænkning" før den svarer.

Medium reasoning (standard)

Balanceret indstilling til de fleste opgaver. God til generel kodning, skrivning og analyse, hvor kvalitet er vigtig, men hastighed også betyder noget.

Lav reasoning

Hurtige svar til ligetil opgaver. Brug når du har brug for hurtige svar, og opgaven ikke kræver dyb overvejelse.

Minimal/ingen reasoning

Maksimal hastighed, minimal tænkning. Bedst til simple forespørgsler, reformateringsopgaver, eller når latens er den primære bekymring.

Nøgleindsigten er at matche reasoning-styrke med opgavekompleksitet. At bruge høj reasoning på simple opgaver spilder tokens og tid. At bruge lav reasoning på komplekse opgaver giver overfladiske, fejlbehæftede resultater.

Tips til minimal reasoning

Når du bruger minimal reasoning-tilstand, skal du kompensere med mere eksplicit prompting. Modellen har færre interne "tænke"-tokens, så din prompt skal gøre mere af struktureringsarbejdet:

<planning_requirement>

Du skal lave omfattende planlægning før hvert funktionskald og

omfattende refleksion over resultater fra tidligere funktionskald for at sikre,

at min forespørgsel er fuldt løst.

Lad være med bare at køre igennem hele processen med funktionskald,

da det kan skade din evne til at løse problemer og tænke dybt. Sørg desuden for,

at funktionskald har de korrekte argumenter.

</planning_requirement>Denne prompt siger i bund og grund: "Da du ikke laver meget intern reasoning, så gør din reasoning højt i dit svar." Den flytter det kognitive arbejde fra usynlig model-tænkning til synlig struktureret planlægning.

Når reasoning-styrken er lav, bør prompt-kompleksiteten være høj. Når reasoning-styrken er høj, kan prompts være simplere. Det er en afvejning.

Kode-ekspertise: Programmering med AI som makker

Det er her, jeg har brugt mest tid på at optimere prompts, og udbyttet har været enormt. AI-kodeassistance er transformerende – hvis det gøres rigtigt. Hvis det gøres forkert, skaber det flere problemer, end det løser.

Lad mig dele, hvad jeg har lært fra at studere, hvordan professionelle AI-kodeværktøjer som Cursor tuner deres prompts til produktionsbrug.

Detaljeringsparadokset

Her er noget kontraintuitivt: AI har tendens til at være omstændelig i forklaringer, men kortfattet i kode. Den vil skrive lange afsnit, der forklarer, hvad den vil gøre, og derefter generere kode med envariabelnavne og minimale kommentarer. Det er helt omvendt for de fleste use cases.

Løsningen er to-tilstands detaljeringskontrol:

<code_verbosity>

Skriv kode for læsbarhed først. Foretræk læsbare, vedligeholdelige løsninger

med klare navne, kommentarer hvor nødvendigt, og ligetil kontrolflow.

Producer ikke kodegolf eller for-smarte one-liners medmindre eksplicit bedt om det.

Brug høj detaljeringsgrad ved skrivning af kode og kodeværktøjer.

Brug lav detaljeringsgrad til statusopdateringer og forklaringer.

</code_verbosity>Dette skaber den perfekte balance: kortfattet kommunikation, detaljeret kode.

Proaktiv vs. bekræftende handling

En anden lektie fra produktions-kodeværktøjer: AI bør være proaktiv med kodeændringer, men bekræfte destruktive operationer. Sådan koder du dette:

<proactive_coding>

Bemærk venligst, at de koderedigeringer, du laver, vil blive præsenteret for mig som foreslåede ændringer, hvilket betyder:

(a) dine koderedigeringer kan være ret proaktive, da jeg altid kan afvise dem.

(b) din kode skal være velskrevet og nem at gennemgå hurtigt.

Hvis det foreslåede næste trin involverer ændring af kode, foretag proaktivt disse ændringer for mig

så jeg kan godkende/afvise, i stedet for at spørge om du skal fortsætte med planen.

Generelt bør du næsten aldrig spørge, om jeg vil have dig til at fortsætte med en plan;

i stedet, prøv proaktivt planen, og spørg så om jeg vil acceptere

de implementerede ændringer.

</proactive_coding>Dette eliminerer det frustrerende frem-og-tilbage, hvor AI beskriver, hvad den vil gøre, beder om tilladelse og så gør det. Bare gør det – jeg afviser, hvis jeg har brug for det.

Match kodebase-stil

En af de største klager over AI-genereret kode er, at den ikke matcher eksisterende kodebase-mønstre. Den føles som "fremmed" kode. Løsningen er eksplicit stilvejledning:

<code_editing_rules>

<guiding_principles>

- Klarhed og genbrug: Hver komponent skal være modulær og genbrugelig.

Undgå gentagelse ved at udtrække gentagende mønstre i komponenter.

- Konsistens: Kode skal følge et konsistent designsystem – navngivnings-

konventioner, spacing og komponenter skal være ensartede.

- Enkelthed: Foretræk små, fokuserede komponenter, undgå unødvendig

stilistisk eller logisk kompleksitet.

- Visuel kvalitet: Følg høje standarder for visuel kvalitet (spacing, padding,

hover states osv.)

</guiding_principles>

<style_matching>

- Før du laver ændringer, undersøg eksisterende mønstre i kodebasen.

- Match variabel-navngivningskonventioner (camelCase vs underscore).

- Match indrykning og formatering.

- Genbrug eksisterende utilities og hjælpefunktioner i stedet for at oprette nye.

- Følg den etablerede mappestruktur.

</style_matching>

</code_editing_rules>Frontend-udvikling: Byg smukke interfaces

AI er blevet forbløffende god til frontend-udvikling, men der er en videnskab bag at få smukke, produktionsklare resultater. Her er, hvad jeg har lært.

Anbefalet tech stack

Gennem omfattende testning fungerer visse teknologikombinationer bedre med AI end andre. Det handler ikke om, hvad der er "bedst" – det handler om, hvad AI-modellerne er trænet mest på:

AI-optimeret frontend tech stack

- Framework: Next.js (TypeScript), React, HTML

- Styling/UI: Tailwind CSS, shadcn/ui, Radix Themes

- Ikoner: Material Symbols, Heroicons, Lucide

- Animation: Motion (tidligere Framer Motion)

- Fonte: Sans-serif familier—Inter, Geist, Mona Sans, IBM Plex Sans, Manrope

Når du specificerer disse teknologier, forbedres kvaliteten af AI-output markant, og hallucinationer om ikke-eksisterende API'er reduceres.

Designsystem-håndhævelse

Et problem med AI-genererede frontends er visuel inkonsistens. Farver opstår ud af ingenting, spacing varierer tilfældigt, og resultatet ser ud som om det er designet af en komité. Løsningen er eksplicitte designsystem-begrænsninger:

<design_system_enforcement>

- Token-først: Hardkod ikke farver (hex/hsl/oklch/rgb) i JSX/CSS.

Alle farver skal komme fra CSS-variabler (f.eks. --background, --foreground,

--primary, --accent, --border, --ring).

- Introducer brand- eller accentfarve? Tilføj/udvid tokens i dine CSS-variabler

under :root og .dark før styling.

- Forbrug: Brug Tailwind utility-klasser koblet til tokens

(f.eks. bg-[hsl(var(--primary))], text-[hsl(var(--foreground))]).

- Medmindre jeg eksplicit beder om brand-look, default til systemets neutrale palette;

map derefter det brand til tokens først.

- Opfind ikke farver, skygger, tokens, animationer eller nye UI-elementer

medmindre anmodet eller nødvendigt.

</design_system_enforcement>UI/UX best practices

Jeg inkluderer også eksplicitte UI/UX-retningslinjer for at sikre konsistent visuelt hierarki:

<ui_ux_best_practices>

- Visuelt hierarki: Begræns typografi til 4-5 fontstørrelser og vægte for at

holde et konsistent hierarki; brug text-xs til overskrifter, undgå text-xl

medmindre det er hovedtitlen.

- Farvebrug: Brug 1 neutral base (f.eks. zinc) og max 2 accentfarver.

- Spacing og layout: Brug altid multipla af 4 til padding og margins for at

holde visuel rytme. Brug containere med fast højde og intern scroll ved

langt indhold.

- State-håndtering: Brug skeleton placeholders eller animate-pulse til at

indikere datahentning. Indiker klikbarhed med hover-transitions.

- Tilgængelighed: Brug semantisk HTML og ARIA-roller korrekt.

Foretræk prækonstruerede tilgængelige komponenter.

</ui_ux_best_practices>Selvreflekterende prompts: Lad AI kritisere sig selv

Denne teknik er tankevækkende, når du først støder på den, men utrolig kraftfuld: Du kan instruere AI i at skabe sine egne evalueringskriterier og iterere baseret på dem. Det er som at give AI sin egen interne QA-afdeling.

<self_reflection>

- Først, brug tid på at tænke over en rubrik, indtil du er sikker.

- Tænk derefter dybt over, hvad hvert aspekt af en verdensklasse-løsning ville være.

Brug denne viden til at skabe en rubrik med 5-7 kategorier.

Denne rubrik er afgørende at få rigtigt, men vis den ikke til mig.

Det er kun til dit formål.

- Til sidst, brug denne rubrik til at tænke internt og iterere til

den bedst mulige løsning på prompten. Husk, at hvis dit svar ikke

scorer maksimalt i alle kategorier på rubrikken, skal du

starte forfra.

</self_reflection>Det der sker her er fascinerende: Du beder AI om at generere kvalitetskriterier ud fra dens viden om ekspertise, og derefter bruge disse kriterier til at evaluere og forbedre sit eget output – alt sammen før du ser noget.

Selvreflekterende prompts forvandler enkelt-generering til en intern iterations-loop. AI bliver sin egen redaktør.

Jeg bruger denne teknik til enhver opgave, hvor kvalitet er vigtigere end hastighed: landingssider, vigtige e-mails, arkitekturbeslutninger, kreativt arbejde. Forbedringen i outputkvalitet er markant.

Detaljekontrol: Mestring af outputlængde

At få den rigtige outputlængde er en vedvarende udfordring. For kort, og du går glip af vigtige detaljer. For langt, og du drukner i unødvendig information. Her er min tilgang.

Eksplicitte længderetningslinjer

Den mest pålidelige tilgang er eksplicitte længdebegrænsninger relateret til opgavekompleksitet:

<output_verbosity_spec>

- Standard: 3-6 sætninger eller ≤5 punkter for typiske svar.

- For simple "ja/nej + kort forklaring" spørgsmål: ≤2 sætninger.

- For komplekse flertrins- eller flerfil-opgaver:

- 1 kort opsummeringsafsnit

- Derefter ≤5 punkter markeret: hvad ændrede sig, hvor, risici, næste trin,

åbne spørgsmål.

- Giv klare og strukturerede svar, der balancerer mellem informativitet og

kortfattethed.

- Opdel information i letfordøjelige bidder, brug formatering som

lister, afsnit og tabeller, når det hjælper.

- Undgå lange narrative afsnit; foretræk kompakte punkter og korte sektioner.

- Gentag ikke min anmodning, medmindre det ændrer semantik.

</output_verbosity_spec>Persona-baseret detaljering

En anden tilgang er at definere AI's kommunikationsstil som en del af dens persona:

<communication_style>

Du værdsætter klarhed, momentum og respekt målt i nytte, ikke høflighedsfraser.

Din standardinstinkt er at holde samtaler kortfattede og måldrevne,

skære alt væk, der ikke skubber arbejdet fremad.

Du er ikke kold – du er bare sparsommelig med ord, og du stoler på

brugeren nok til ikke at pakke hver besked ind i fyld.

Høflighed kommer gennem struktur, præcision og lydhørhed,

ikke gennem sproglig pynt.

Du bekræfter aldrig bekræftelser. Når du har indikeret forståelse,

skifter du fuldt ud til opgaven.

</communication_style>Dette skaber en "personlighed", der naturligt producerer kortfattede output uden at kræve eksplicitte længdebegrænsninger for hver interaktion.

Instruktionsfølge: Præcisionens kunst

Moderne AI-modeller følger instruktioner med kirurgisk præcision – hvilket både er deres største styrke og en potentiel fælde. De vil gøre præcis, hvad du siger, selv hvis det, du siger, er modstridende eller tvetydigt.

Modsætningsproblemet

Her er et virkeligt eksempel på en problematisk prompt, jeg stødte på:

Eksempel på modstridende instruktioner

"Slå altid patientjournalen op for at sikre, at de er eksisterende patienter, før du tager andre handlinger."

Men senere: "Når symptomer indikerer høj hastighed, eskaler som nødsituation og instruer patienten til at ringe 112 med det samme før eventuelle bookingskridt."

Disse instruktioner er i konflikt. Sker nødhåndteringen før eller efter journalopslaget? AI vil forbruge reasoning-tokens på at forsøge at forene modsætningerne i stedet for at hjælpe.

Løsningen er at gennemgå prompts for skjulte konflikter og etablere et klart prioritetshierarki:

<instruction_priority>

Når instruktioner er i konflikt, følg denne prioritetsrækkefølge:

1. Sikkerhedskritiske operationer (nødsituationer, databeskyttelse)

2. Brugerspecificerede begrænsninger

3. Opgavefuldførelseskrav

4. Standardadfærd

For nødsituationer: Udfør ikke journalopslag. Giv øjeblikkelig

nødvejledning.

</instruction_priority>Scope-præcision

Et andet almindeligt problem er scope creep – AI der tilføjer funktioner, du ikke bad om, eller "forbedringer":

<design_and_scope_constraints>

- Implementer præcist og kun det, jeg anmoder om.

- Ingen ekstra funktioner, ingen tilføjede komponenter, ingen UX-pynt.

- Hvis nogen instruktion er tvetydig, vælg den simpleste gyldige fortolkning.

- Udvid ikke opgaver ud over, hvad jeg bad om; hvis du bemærker yderligere

arbejde, der kan være værdifuldt, marker det som valgfrit i stedet for at gøre det.

</design_and_scope_constraints>Lang kontekst-mestring: Håndtering af store dokumenter

Moderne AI kan håndtere enorm kontekst – hundredtusinder af tokens – men at dumpe store dokumenter i kontekstvinduet er ikke nok. Du har brug for strategier til at hjælpe modellen med at navigere og udtrække relevant information.

Tvungen opsummering og genforankring

For lange dokumenter instruerer jeg AI i at skabe intern struktur før den svarer:

<long_context_handling>

For input over ~10k tokens (dokumenter med flere kapitler, lange tråde,

flere PDF'er):

1. Først, generer en kort intern oversigt over nøgleafsnit relevante for min anmodning.

2. Før du svarer, genformulér eksplicit mine begrænsninger (f.eks. jurisdiktion, datointerval,

produkt, team).

3. I dit svar, forankr udsagn til afsnit ("I afsnittet 'Dataopbevaring'

……") i stedet for generelt.

4. Hvis svaret afhænger af specifikke detaljer (datoer, tærskler, vilkår),

citer eller omformuler dem direkte.

</long_context_handling>Dette forhindrer "mistet i scroll"-problemet, hvor AI giver generelle svar, der ikke rigtig engagerer sig med det specifikke dokumentindhold.

Citationskrav

For forsknings- og analyseopgaver sikrer eksplicitte citationskrav forankrede svar:

<citation_rules>

Når du bruger information fra leverede dokumenter:

- Placer citationer efter hvert afsnit, der indeholder dokumentafledte udsagn.

- Brug format: [Dokumentnavn, Afsnit/Side]

- Fabrikér ikke citationer. Hvis du ikke kan citere det, påstå det ikke.

- Brug flere kilder til nøgleudsagn, når det er muligt.

- Hvis evidensen er svag, anerkend det eksplicit.

</citation_rules>Værktøjskald: Orkestrering af AI-evner

AI-værktøjskald – evnen til at kalde eksterne funktioner, API'er og tjenester – er hvor prompt engineering bliver til software engineering. At få dette rigtigt er afgørende for at bygge pålidelige AI-applikationer.

Best practices for værktøjsbeskrivelser

Kvaliteten af dine værktøjsbeskrivelser påvirker direkte, hvor godt AI bruger dem:

{

"name": "create_reservation",

"description": "Opretter en restaurantreservation for en gæst. Brug når brugeren

anmoder om at booke et bord med et givet navn og tidspunkt.",

"parameters": {

"type": "object",

"properties": {

"name": {

"type": "string",

"description": "Gæstens fulde navn til reservationen."

},

"datetime": {

"type": "string",

"description": "Dato og tid for reservationen (ISO 8601-format)."

}

},

"required": ["name", "datetime"]

}

}Bemærk at beskrivelsen inkluderer både hvad værktøjet gør og hvornår det skal bruges. Dette hjælper modellen med at træffe bedre værktøjsvalg.

Værktøjsbrugsregler i prompts

Ud over værktøjsdefinitioner bør din prompt inkludere eksplicit brugsvejledning:

<tool_usage_rules>

- Foretræk værktøjer frem for intern viden når:

- Du har brug for friske eller brugerspecifikke data (tickets, ordrer, konfiguration, logs).

- Du refererer til specifikke ID'er, URL'er eller dokumenttitler.

- Paralleliser uafhængige læsninger (read_file, fetch_record, search_docs)

når det er muligt for at reducere latens.

- Efter ethvert skrive/opdater-værktøjskald, opsummer kort:

- Hvad der ændrede sig

- Hvor (ID eller sti)

- Eventuel efterfølgende validering udført

- For simple konceptuelle spørgsmål, undgå værktøjer og stol på intern viden

for hurtige svar.

</tool_usage_rules>Parallelisering

En nøgleoptimering er at opmuntre til parallelle værktøjskald, når operationer er uafhængige:

<parallelization>

Paralleliser værktøjskald når det er muligt. Batch læsninger (read_file) og

uafhængige redigeringer (apply_patch til forskellige filer) for at fremskynde processen.

Uafhængige operationer, der kan paralleliseres:

- Læsning af flere filer

- Søgning i flere mapper

- Hentning af flere poster

Afhængige operationer, der ikke kan paralleliseres:

- Læs fil, derefter rediger baseret på indhold

- Opret ressource, derefter referer til dens ID

</parallelization>Håndtering af usikkerhed: Når AI ikke ved

En af de største risici ved AI er selvsikkert-lydende forkerte svar. Modeller ved ikke, hvad de ikke ved – medmindre du lærer dem at håndtere usikkerhed.

<uncertainty_and_ambiguity>

- Hvis spørgsmålet er tvetydigt eller underspecificeret, angiv det eksplicit og:

- Stil max 1-3 præcise afklarende spørgsmål, eller

- Præsenter 2-3 mulige fortolkninger med klart markerede antagelser.

- Når eksterne fakta kan have ændret sig for nylig (priser, udgivelser, politikker)

og intet værktøj er tilgængeligt:

- Svar i generelle vendinger og angiv, at specifikke detaljer kan være ændret.

- Fabrikér aldrig præcise tal, linjenumre eller eksterne referencer, når du er usikker.

- Når du er usikker, foretræk sprog som "Baseret på den givne kontekst……"

frem for absolutte udsagn.

</uncertainty_and_ambiguity>Højrisiko selvtjek

For højrisikoområder tilføjer jeg et eksplicit selv-valideringstrin:

<high_risk_self_check>

Før du færdiggør et svar i juridisk, finansiel, compliance- eller

sikkerhedsfølsom kontekst:

- Genscan kort dit eget svar for:

- Udeklarerede antagelser

- Specifikke tal eller udsagn, der ikke er forankret i konteksten

- Overdrevent stærkt sprog ("altid", "garanteret" osv.)

- Hvis du finder nogen, blødgør eller kvalificer dem og angiv eksplicit antagelser.

</high_risk_self_check>Målet er ikke at gøre AI mindre selvsikker – det er at gøre den præcist selvsikker. At være usikker om usikre ting er en feature, ikke en bug.

Meta-prompting: Brug AI til at forbedre AI

Dette er den mest meta-teknik i min værktøjskasse: Brug AI til at forbedre dine prompts. Det lyder cirkulært, men det er ekstremt effektivt.

Diagnose af prompt-fejl

Når en prompt ikke virker, bruger jeg dette mønster til at diagnosticere problemet:

Du er en prompt engineer med ansvar for at debugge en systemprompt.

Du får:

1) Den nuværende systemprompt:

<system_prompt>

[Indsæt din prompt her]

</system_prompt>

2) Et lille sæt af loggede fejl. Hver log har:

- Query

- Faktisk output

- Forventet output (eller problembeskrivelse)

<failure_traces>

[Indsæt fejleksempler]

</failure_traces>

Din opgave:

1) Identificer de forskellige fejlmønstre, du ser.

2) For hvert fejlmønster, citer de specifikke linjer i systemprompten, der mest

sandsynligt forårsager eller forstærker det.

3) Forklar, hvordan disse linjer leder agenten mod den observerede adfærd.

Returner dit svar i struktureret format:

failure_modes:

- name: ...

description: ...

prompt_drivers:

- exact_or_paraphrased_line: ...

- why_it_matters: ...Generering af prompt-forbedringer

Når du har diagnosen, genererer en anden prompt forbedringer:

Du har tidligere analyseret denne systemprompt og dens fejlmønstre.

Systemprompt:

<system_prompt>

[Original prompt]

</system_prompt>

Fejlmønsteranalyse:

[Indsæt diagnose fra forrige trin]

Foreslå venligst en kirurgisk revision, der reducerer de observerede problemer

mens den bevarer god adfærd.

Begrænsninger:

- Redesign ikke agenten fra bunden.

- Foretræk små, målrettede redigeringer: afklar modstridende regler, fjern

redundante eller modstridende linjer, stram vag vejledning.

- Gør afvejninger eksplicitte.

- Hold struktur og længde nogenlunde som originalen.

Output:

1) patch_notes: Kortfattet liste over nøgleændringer og ræsonnementet bag hver.

2) revised_system_prompt: Den fulde opdaterede prompt med redigeringer anvendt.Denne to-trins proces har hjulpet mig med at fixe prompts, jeg havde kæmpet med i dagevis. AI finder ofte modsætninger og tvetydigheder, som jeg var blevet blind for.

Gennemprøvede prompt-skabeloner

Lad mig dele nogle skabeloner, der har vist sig pålidelige på tværs af hundredvis af use cases.

Generel opgavefuldførelses-skabelon

<context>

[Baggrundsinformation AI har brug for at forstå situationen]

</context>

<task>

[Klar beskrivelse af, hvad du vil opnå]

</task>

<requirements>

[Specifikke krav eller begrænsninger]

</requirements>

<format>

[Hvordan du vil have outputtet struktureret]

</format>

<examples>

[Valgfrit: Eksempler på forventet output]

</examples>

<notes>

[Valgfrit: Yderligere kontekst eller præferencer]

</notes>Code review-skabelon

<context>

Du reviewer kode til [projekt/kontekst].

Kodebasen bruger [teknologier/mønstre].

</context>

<code_to_review>

[Indsæt kode her]

</code_to_review>

<review_criteria>

Fokuser på:

1. Korrekthed: Gør den, hvad den påstår?

2. Læsbarhed: Er den klar for andre udviklere?

3. Performance: Er der åbenlyse ineffektiviteter?

4. Sikkerhed: Er der sårbarheder?

5. Stil: Matcher den kodebase-konventioner?

</review_criteria>

<output_format>

For hvert problem fundet:

- Alvorlighed: [Kritisk/Major/Minor/Forslag]

- Placering: [Linjenummer eller sektion]

- Problem: [Hvad er galt]

- Fix: [Hvordan det løses]

</output_format>Forskningsanalyse-skabelon

<research_task>

Analyser [emne/spørgsmål] med følgende tilgang:

</research_task>

<methodology>

1. Start med flere målrettede søgninger. Stol ikke på en enkelt forespørgsel.

2. Grav dybt, indtil du har nok information til at give et præcist,

omfattende svar.

3. Tilføj målrettede opfølgende søgninger for at udfylde huller eller løse uoverensstemmelser.

4. Fortsæt med at iterere, indtil yderligere søgninger sandsynligvis ikke vil ændre svaret.

</methodology>

<output_requirements>

- Start med et klart svar på hovedspørgsmålet.

- Understøt med evidens og citationer.

- Anerkend begrænsninger og usikkerheder.

- Giv konkrete eksempler, hvor det hjælper.

- Inkluder relevant kontekst, der hjælper med at forstå implikationer.

</output_requirements>

<citation_format>

[Hvordan du vil have kilder citeret]

</citation_format>Almindelige fejl der ødelægger resultater

Lad mig hjælpe dig med at undgå de fejl, jeg begik (gentagne gange) i mine tidlige dage med prompt engineering.

"Hjælp mig med at skrive noget om markedsføring" vs "Skriv et 500-ords blogindlæg om e-mail-markedsføring til SaaS-startups, med fokus på velkomstsekvenser." Specificitet er alt.

At sige "vær kortfattet" og "vær udtømmende" i samme prompt. AI vil kæmpe med at forene modsætninger. Vær eksplicit om prioriteter og afvejninger.

AI ved ikke, hvad du ikke har fortalt den. Hvis noget er indlysende for dig, er det måske ikke for modellen. Inkluder relevant baggrund.

Hvis du har brug for JSON, så sig det. Hvis du har brug for punktopstilling, så sig det. Overlad ikke outputformatet til tilfældigheder.

Nogle gange er en simpel prompt den bedste. Tilføj ikke kompleksitet for kompleksitetens skyld. Start simpelt og tilføj kun kompleksitet, når det er nødvendigt.

At skrive prompts er iterativt. Din første prompt er et udkast. Finpuds baseret på, hvad der virker, og hvad der ikke virker.

GPT og Claude opfører sig forskelligt. Prompts optimeret til én performer måske dårligere på en anden. Test på flere modeller, hvis din applikation understøtter det.

AI-output kræver ofte menneskelig gennemgang. Byg prompts, der gør gennemgang let – klar struktur, eksplicitte antagelser, sporbar ræsonnement.

Fremtiden for prompt engineering

Når jeg skriver dette i begyndelsen af 2026, udvikler prompt engineering sig hurtigt. Modeller bliver mere kapable, mere kontrollerbare, mere pålidelige. Nogle forudsiger, at prompt engineering vil blive forældet, efterhånden som AI bliver bedre til at forstå intentioner. Jeg er uenig.

Det der ændrer sig er niveauet af prompt engineering, ikke dets nødvendighed. Tidligt krævede selv basale opgaver omhyggeligt udformede prompts. Nu virker basale opgaver out-of-the-box, men komplekse agentiske workflows kræver stadig sofistikerede prompts. Baren hæves, ikke fjernes.

Prompt engineering forsvinder ikke – det udvikler sig. De relevante færdigheder skifter fra "hvordan man får AI til at virke" til "hvordan man får AI til at virke fremragende og pålideligt i skala".

Ændringer på vej

Bedre standardadfærd

Modeller vil have smartere standarder, der kræver færre eksplicitte instruktioner for almindelige mønstre. Prompting vil fokusere mere på tilpasning end grundlæggende evner.

Rigere værktøjsøkosystemer

AI vil have adgang til flere værktøjer out-of-the-box. Prompt engineering vil skifte mod orkestrering – at vide hvornår man bruger hvad, ikke bare hvordan.

Multimodal integration

Prompts vil i stigende grad involvere billeder, lyd, video og struktureret data sammen med tekst. Nye prompting-mønstre vil opstå for multimodale opgaver.

Agentisk kompleksitet

Efterhånden som agenter håndterer længere, mere komplekse opgaver, vil prompt engineering mere ligne systemdesign – arkitektur, ikke bare instruktioner.

Mit råd til fremtiden

Fokuser på fundamenterne. De specifikke teknikker i denne guide vil udvikle sig, men de underliggende principper – klar kommunikation, eksplicitte forventninger, struktureret tænkning, iterativ finpudsning – er tidløse. Mestr disse, og du vil tilpasse dig uanset, hvad der kommer næste gang.

Afsluttende tanker

For to år siden troede jeg, at AI ville erstatte behovet for klar kommunikation. Jeg tog fuldstændig fejl. AI gør klar kommunikation mere værdifuld end nogensinde. De mennesker, der trives med at arbejde sammen med AI, er ikke dem, der fandt de magiske ord – det er dem, der lærte at tænke og udtrykke sig præcist.

Prompt engineering handler faktisk ikke om AI. Det handler om dig. Det handler om at dyrke disciplinen til klart at formulere, hvad du virkelig vil have, tålmodigheden til at iterere mod det, og ydmygheden til at lære af det, der ikke virker.

Hvis du kun tager én ting med fra denne guide, lad det være dette: Behandl hver prompt som en mulighed for at øve klar tænkning. AI er bare et spejl, der reflekterer klarheden – eller forvirringen – i din egen tænkning tilbage til dig.

AI's fremkomst har ikke gjort viden forældet – den har gjort nysgerrighed mere kraftfuld end nogensinde. Vi er ikke længere begrænset af, hvad vi allerede ved. Med de rigtige værktøjer og viljen til at tænke kan almindelige mennesker omfavne et hav af viden. Uanset profession. Uanset alder. Jeg håber at dele denne rejse med venner over hele verden. Lad os sammen tage imod denne nye verden. Lad os vokse sammen.

Discussion

0 commentsLeave a comment

Be the first to share your thoughts on this article!