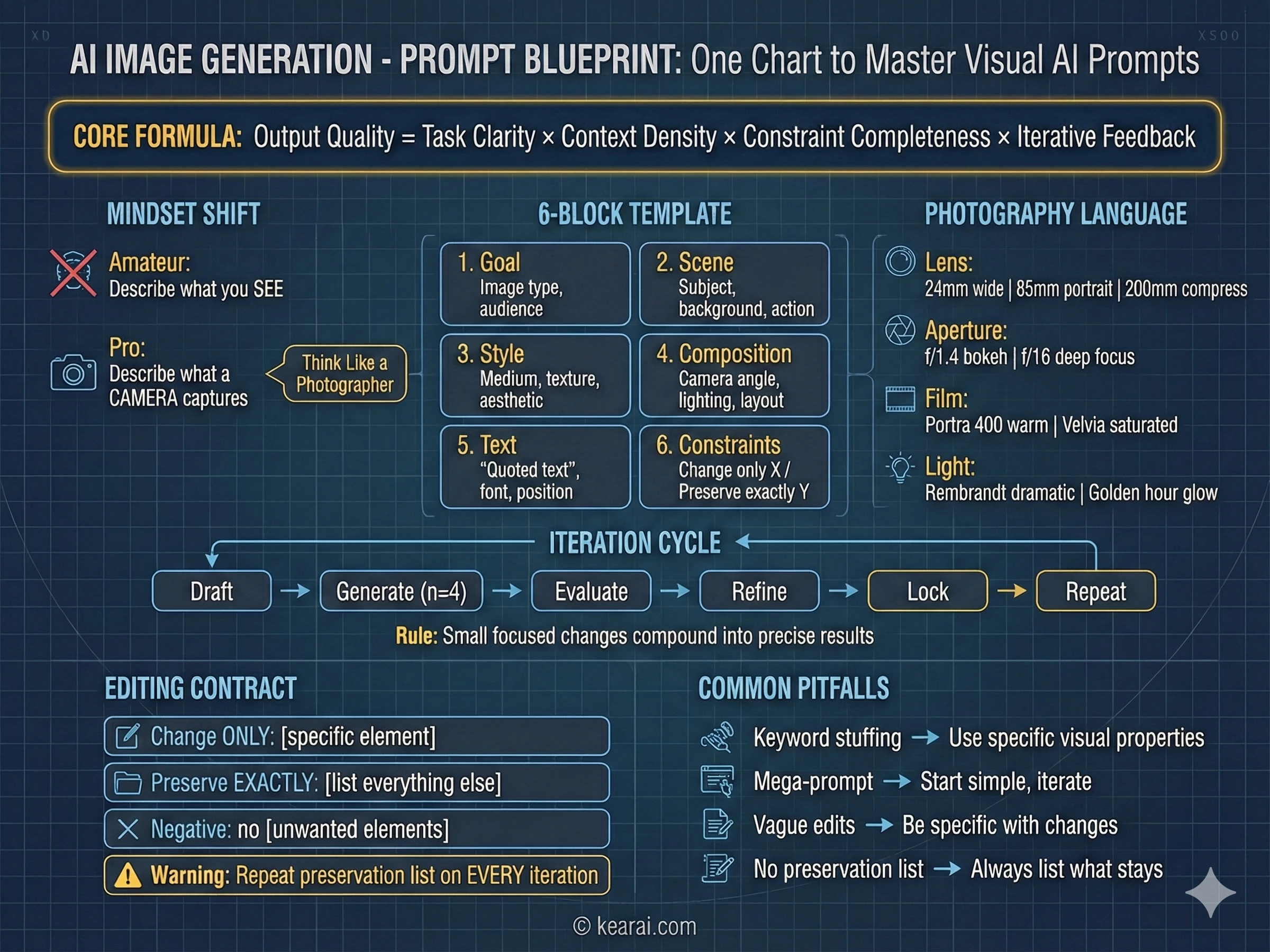

La IA no lee tu mente. Lee tus palabras. La calidad de tu prompt determina la calidad de tu resultado.

Hace dos años, escribí mi primer prompt en ChatGPT y pensé que entendía la inteligencia artificial. Estaba equivocado. Lo que entendía era cómo hacer preguntas—no cómo comunicarme con una máquina que piensa en patrones, probabilidades y tokens. ¿La diferencia entre esas dos cosas? Es la diferencia entre obtener respuestas genéricas y desbloquear capacidades que ni sabías que existían. Esta es la historia de cómo aprendí a hablar IA con fluidez, y todo lo que descubrí en el camino.

El Despertar: Cuando los Prompts Simples Dejaron de Funcionar

Ocurrió durante una fecha límite de proyecto. Necesitaba que la IA me ayudara a refactorizar un código complejo—algo que había hecho cientos de veces antes. Pero esta vez, sin importar cómo formulara mi solicitud, la IA seguía dándome soluciones técnicamente correctas pero que perdían completamente el punto. Añadió complejidad innecesaria. Rompió patrones existentes. "Mejoró" cosas que no estaban rotas.

Estaba frustrado. Luego sentí curiosidad. ¿Qué estaba haciendo mal?

Esa frustración me llevó por un camino que lo cambió todo: documentación oficial, papers de investigación, guías de ingeniería de prompts, y miles de horas de experimentación. Lo que descubrí no fueron solo trucos y consejos—fue un cambio completo de paradigma en cómo me comunico con sistemas de IA.

La IA más poderosa del mundo es inútil si no puedes comunicar lo que realmente necesitas.

Aquí está la verdad que nadie le cuenta a los principiantes: crear prompts no se trata de encontrar palabras mágicas. Se trata de entender cómo los modelos de IA procesan el lenguaje, qué información necesitan, y cómo estructurar esa información para que el modelo realmente pueda ayudarte. Es una habilidad—y como cualquier habilidad, se puede aprender, practicar y dominar.

Esta guía contiene todo lo que desearía que alguien me hubiera contado al principio. No el consejo demasiado simplificado de "solo sé específico" que inunda internet, sino el entendimiento profundo y matizado que separa a las personas que usan IA de las personas que la dominan.

Fundamentos de Prompts: La Base que Nadie Enseña

Antes de sumergirnos en técnicas avanzadas, establezcamos los fundamentos. Todo prompt efectivo contiene alguna combinación de estos elementos:

¿Qué necesita saber la IA sobre la situación? Información de fondo, restricciones y detalles relevantes.

¿Qué exactamente quieres que haga la IA? Sé específico sobre la acción que estás solicitando.

¿Cómo debe estructurarse el output? Listas, párrafos, bloques de código, tablas—especifícalo.

¿Qué debe evitar la IA? ¿Qué límites existen? ¿Qué está fuera del alcance?

¿Puedes mostrar lo que quieres? Los ejemplos valen más que mil descripciones.

La mayoría de las personas solo incluyen la tarea. Piden "Escríbeme un email" cuando deberían estar diciendo "Escribe un email profesional a un cliente explicando un retraso en el proyecto. Mantenlo en menos de 150 palabras, reconoce el inconveniente, y propón un nuevo cronograma dos semanas adelante. El tono debe ser apologético pero confiado."

La diferencia en la calidad del output es dramática. Y esto es solo el comienzo.

El Rol de la Estructura

Uno de los aspectos más subestimados de la escritura de prompts es el formato estructural. Los modelos de IA modernos responden excepcionalmente bien a secciones claramente delimitadas. Yo uso tags estilo XML extensivamente:

<context>

Estás ayudándome a preparar una presentación para stakeholders técnicos.

La audiencia está familiarizada con desarrollo de software pero no específicamente con IA.

</context>

<task>

Explica cómo funcionan los modelos de lenguaje grandes en 5 puntos clave.

</task>

<format>

- Usa viñetas

- Cada punto debe tener 1-2 oraciones

- Evita jerga o defínela cuando la uses

</format>

<constraints>

- No menciones nombres específicos de modelos

- Enfócate en conceptos, no en implementación técnica

</constraints>Esta estructura hace algo poderoso: te obliga a ti a pensar claramente sobre lo que necesitas antes de preguntar. Y el pensamiento claro produce comunicación clara que produce resultados claros.

Flujos de Trabajo Agénticos: Tratando a la IA como Tu Colega

Aquí hay un cambio de paradigma que transformó mis interacciones con IA: deja de tratar a la IA como un motor de búsqueda y comienza a tratarla como un colega capaz pero sin experiencia. Este modelo mental lo cambia todo.

Los modelos de IA modernos como GPT-5 y Claude no solo responden preguntas—están diseñados para ser agentes. Pueden llamar herramientas, reunir contexto, tomar decisiones y ejecutar tareas de múltiples pasos. Pero como cualquier nuevo miembro del equipo, necesitan onboarding adecuado, expectativas claras y guardarraíles apropiados.

La IA no es una herramienta que usas. Es un colega que gestionas. Las habilidades que te hacen un buen gerente te hacen un buen creador de prompts.

Piénsalo: cuando delegas a un humano, no solo dices "arregla el código." Explicas qué está roto, cuál es el comportamiento deseado, qué restricciones existen, y cómo luce el éxito. Proporcionas contexto. Respondes preguntas. Verificas el progreso.

La IA necesita el mismo tratamiento. La diferencia es que necesitas anticipar preguntas y responderlas por adelantado, porque el ir y venir es más costoso (en tiempo y tokens) que hacerlo bien la primera vez.

La Mentalidad Agéntica

Al construir aplicaciones agénticas o usar IA para tareas complejas, aprendí a pensar en términos de:

Preguntas Clave para Tareas Agénticas

- ¿Cuál es el estado final? ¿Cómo sabrá la IA cuándo ha terminado?

- ¿Qué herramientas tiene? ¿Qué puede hacer realmente versus qué debe diferir?

- ¿Cuál es el nivel de autonomía? ¿Debe pedir permiso o proceder independientemente?

- ¿Cuáles son los límites de seguridad? ¿Qué acciones nunca deben tomarse sin confirmación?

- ¿Cómo debe comunicar el progreso? ¿Ejecución silenciosa o actualizaciones regulares?

Estas preguntas forman la base de cada prompt complejo que escribo. Exploremos cada dimensión en detalle.

Controlando la Ansiedad de la IA: El Arte de la Calibración

Uno de los aspectos más matizados de la ingeniería de prompts es calibrar lo que llamo "ansiedad agéntica"—el equilibrio entre una IA que toma iniciativa y una que espera por orientación explícita. Si fallas en esto, tendrás una IA que piensa demasiado en tareas simples o se rinde muy fácilmente en las complejas.

Cuándo Reducir la Ansiedad

A veces necesitas que la IA sea rápida y enfocada. No quieres que explore cada tangente, haga llamadas extra de herramientas, o produzca explicaciones verbosas. Para estas situaciones, uso prompts enfocados en restricciones:

<context_gathering>

Objetivo: Obtener suficiente contexto rápido. Paralelizar descubrimiento y detenerse tan pronto como puedas actuar.

Método:

- Comienza amplio, luego expándete a sub-consultas enfocadas.

- En paralelo, lanza consultas variadas; lee los principales resultados por consulta.

- Deduplica caminos y cachea; no repitas consultas.

- Evita buscar demasiado contexto.

Criterios de parada temprana:

- Puedes nombrar contenido exacto a cambiar.

- Los principales resultados convergen (~70%) en un área/camino.

Profundidad:

- Rastrea solo símbolos que vas a modificar o cuyos contratos dependes.

- Evita expansión transitiva a menos que sea necesario.

Bucle:

- Búsqueda en lote → plan mínimo → completar tarea.

- Busca de nuevo solo si la validación falla o aparecen nuevas incógnitas.

- Prefiere actuar sobre más búsqueda.

</context_gathering>Nota el permiso explícito para ser imperfecto: "Prefiere actuar sobre más búsqueda." Esta frase sutil libera a la IA de su ansiedad predeterminada de ser exhaustiva. Sin ella, el modelo frecuentemente busca de más, quemando tokens y tiempo en retornos decrecientes.

Para restricciones aún más agresivas, puedes establecer presupuestos explícitos:

<context_gathering>

- Profundidad de búsqueda: muy baja

- Sesgo fuertemente hacia proporcionar una respuesta correcta lo más rápido posible,

incluso si puede no estar completamente correcta.

- Generalmente, esto significa un máximo absoluto de 2 llamadas de herramienta.

- Si piensas que necesitas más tiempo para investigar, actualízame con tus

hallazgos más recientes y preguntas abiertas. Puedes proceder si lo confirmo.

</context_gathering>La frase "incluso si puede no estar completamente correcta" es oro. Le da permiso a la IA para ser imperfecta, lo cual paradójicamente frecuentemente produce mejores resultados más rápido.

Cuándo Aumentar la Ansiedad

Otras veces, necesitas que la IA sea incansablemente exhaustiva. Quieres que persista a través de la ambigüedad, haga suposiciones razonables, y complete tareas complejas sin constantemente pedir permiso. Esto requiere el enfoque opuesto:

<persistence>

- Eres un agente — por favor continúa hasta que la consulta del usuario esté

completamente resuelta, antes de terminar tu turno y devolver al usuario.

- Solo termina tu turno cuando estés seguro de que el problema está resuelto.

- Nunca pares o devuelvas al usuario cuando encuentres incertidumbre —

investiga o deduce el enfoque más razonable y continúa.

- No pidas al humano confirmar o clarificar suposiciones, ya que siempre

puedes ajustar después — decide cuál es la suposición más razonable, procede con

ella, y documéntala para referencia del usuario después de terminar de actuar.

</persistence>Este prompt cambia fundamentalmente el comportamiento de la IA. En lugar de preguntar "¿Debo proceder?" dice "Procedí basándome en la suposición X—avísame si quieres que ajuste." El trabajo se hace; el refinamiento ocurre después.

Definiendo Límites de Seguridad

Pero aquí está el matiz crucial: la ansiedad aumentada requiere límites de seguridad más claros. Necesitas definir explícitamente qué acciones la IA puede tomar autónomamente y cuáles requieren confirmación.

Principio Crítico de Seguridad

Las acciones de alto costo (eliminaciones, pagos, comunicaciones externas) siempre deben requerir confirmación explícita, incluso con prompts de alta ansiedad. Las acciones de bajo costo (búsquedas, lecturas, creación de borradores) pueden ser autónomas.

Piénsalo como dar a alguien acceso a tus sistemas: las herramientas de búsqueda deben tener un umbral de autonomía extremadamente alto, mientras que los comandos de eliminación deben tener uno extremadamente bajo.

El Principio de Persistencia: Haciendo que la IA Siga Hasta el Final

Uno de los comportamientos más frustrantes que encontré al principio fue la IA rindiéndose muy fácilmente. Encontraba un obstáculo, resumía lo que salió mal, y me devolvía el problema. Para tareas simples, esto está bien. Para tareas complejas, es un asesino de flujo de trabajo.

La solución es lo que llamo el Principio de Persistencia: instruir explícitamente a la IA a persistir a través de obstáculos y completar tareas de principio a fin.

<solution_persistence>

- Trátate como un programador par senior autónomo: una vez que doy una

dirección, proactivamente reúne contexto, planifica, implementa, prueba y refina

sin esperar prompts adicionales en cada paso.

- Persiste hasta que la tarea esté completamente manejada de principio a fin dentro

del turno actual siempre que sea posible: no pares en análisis o correcciones parciales;

lleva los cambios a través de implementación, verificación, y una explicación clara

de los resultados a menos que explícitamente pause o te redirija.

- Sé extremadamente sesgado hacia la acción. Si mi directiva es algo ambigua en

intención, asume que debes seguir adelante y hacer el cambio.

- Si hago una pregunta como "¿deberíamos hacer X?" y tu respuesta es "sí", también

debes seguir adelante y realizar la acción. Es muy malo dejarme esperando

y requerirme hacer un seguimiento con una solicitud de "por favor hazlo."

</solution_persistence>Ese último punto es sutil pero importante. Cuando los humanos preguntamos "¿deberíamos hacer X?", frecuentemente queremos decir "por favor haz X si tiene sentido." La IA, siendo literal, responde la pregunta sin tomar la acción implícita. Este prompt cierra esa brecha.

Actualizaciones de Progreso: Manteniéndose Informado

Persistencia no significa silencio. Para tareas de larga duración, siempre incluyo instrucciones para actualizaciones de progreso:

<user_updates_spec>

Trabajarás por períodos con llamadas de herramienta — es crítico mantenerme actualizado.

<frequency_and_length>

- Envía actualizaciones cortas (1–2 oraciones) cada pocas llamadas de herramienta cuando

haya cambios significativos.

- Publica una actualización al menos cada 6 pasos de ejecución u 8 llamadas de herramienta

(lo que venga primero).

- Si esperas un período más largo enfocado, publica una nota breve explicando por qué

y cuándo reportarás; cuando retomes, resume lo que aprendiste.

- Solo el plan inicial, actualizaciones de plan, y recapitulación final pueden ser más largos.

</frequency_and_length>

<content>

- Antes de la primera llamada de herramienta, da un plan rápido con objetivo, restricciones,

próximos pasos.

- Mientras exploras, destaca descubrimientos significativos que me ayuden a entender

lo que está pasando.

- Siempre declara al menos un resultado concreto desde la actualización anterior

(ej: "encontré X", "confirmé Y"), no solo próximos pasos.

- Termina con una breve recapitulación y cualquier paso de seguimiento.

</content>

</user_updates_spec>Esto crea un equilibrio hermoso: la IA trabaja autónomamente pero te mantiene informado. No estás microgestionando, pero tampoco estás a oscuras.

Esfuerzo de Razonamiento: El Dial de Intensidad de Pensamiento

Los modelos de IA modernos tienen un concepto llamado "esfuerzo de razonamiento"—esencialmente, qué tan intensamente piensa el modelo antes de responder. Este es uno de los parámetros más poderosos y subutilizados disponibles.

Alto Razonamiento

Usa para tareas complejas de múltiples pasos, situaciones ambiguas, o problemas que requieren análisis profundo. El modelo gasta más tokens "pensando" internamente antes de responder.

Razonamiento Medio (Predeterminado)

Configuración equilibrada adecuada para la mayoría de tareas. Bueno para código general, escritura y análisis donde la calidad importa pero la velocidad también es importante.

Bajo Razonamiento

Respuestas rápidas para tareas directas. Usa cuando necesitas respuestas rápidas y la tarea no requiere deliberación profunda.

Razonamiento Mínimo/Ninguno

Velocidad máxima, deliberación mínima. Mejor para consultas simples, tareas de reformateo, o cuando la latencia es la preocupación principal.

El insight clave es emparejar el esfuerzo de razonamiento con la complejidad de la tarea. Usar alto razonamiento para tareas simples desperdicia tokens y tiempo. Usar bajo razonamiento para tareas complejas produce resultados superficiales y propensos a errores.

Prompting para Razonamiento Mínimo

Cuando usas modos de razonamiento mínimo, necesitas compensar con prompting más explícito. El modelo tiene menos tokens de "pensamiento" interno, así que tu prompt necesita hacer más del trabajo de estructuración:

<planning_requirement>

DEBES planificar extensivamente antes de cada llamada de función, y reflexionar

extensivamente sobre los resultados de las llamadas de función anteriores, asegurando

que mi consulta esté completamente resuelta.

NO hagas todo este proceso haciendo solo llamadas de función, ya que esto puede

perjudicar tu capacidad de resolver el problema y pensar perspicazmente. Además,

asegura que las llamadas de función tengan los argumentos correctos.

</planning_requirement>Este prompt esencialmente dice: "Como no estás haciendo mucho razonamiento interno, haz tu razonamiento en voz alta en tu respuesta." Desplaza el trabajo cognitivo del pensamiento invisible del modelo a planificación estructurada visible.

Cuando el esfuerzo de razonamiento es bajo, la complejidad del prompt debe ser alta. Cuando el esfuerzo de razonamiento es alto, los prompts pueden ser más simples. Es un equilibrio.

Excelencia en Código: Programando con Compañeros de IA

Aquí es donde he pasado la mayor parte de mi tiempo optimizando prompts, y donde el retorno ha sido enorme. La asistencia de código con IA es transformadora—cuando se hace bien. Hecha mal, crea más problemas de los que resuelve.

Déjame compartir lo que aprendí estudiando cómo herramientas profesionales de código con IA como Cursor ajustan sus prompts para uso en producción.

La Paradoja de la Verbosidad

Aquí hay algo contra-intuitivo: la IA tiende a ser verbosa en explicaciones pero concisa en código. Escribirá párrafos explicando lo que está a punto de hacer, luego producirá código con nombres de variables de una letra y comentarios mínimos. Esto es exactamente lo contrario para la mayoría de los casos de uso.

La solución es control de verbosidad de modo dual:

<code_verbosity>

Escribe código para claridad primero. Prefiere soluciones legibles y mantenibles con

nombres claros, comentarios donde sea necesario, y flujo de control directo. No produzcas

código-golf o one-liners excesivamente ingeniosos a menos que se solicite explícitamente.

Usa alta verbosidad para escribir código y herramientas de código. Usa baja verbosidad

para actualizaciones de estado y explicaciones.

</code_verbosity>Esto crea el equilibrio perfecto: comunicación concisa, código detallado.

Acciones Proactivas vs Confirmativas

Otra lección de herramientas de código de producción: la IA debe ser proactiva sobre cambios de código pero confirmativa sobre acciones destructivas. Aquí está cómo codificar eso:

<proactive_coding>

Ten en cuenta que las ediciones de código que haces se mostrarán a mí como

cambios propuestos, lo que significa:

(a) Tus ediciones de código pueden ser bastante proactivas, ya que siempre puedo rechazarlas.

(b) Tu código debe estar bien escrito y ser fácil de revisar rápidamente.

Si propones próximos pasos que involucrarían cambiar el código, haz esos cambios

proactivamente para que yo apruebe/rechace en lugar de preguntar si debo proceder

con un plan.

En general, casi nunca debes preguntarme si debo proceder con un plan;

en cambio, proactivamente intenta el plan y luego pregunta si quiero aceptar

los cambios implementados.

</proactive_coding>Esto elimina el frustrante ir y venir donde la IA describe lo que haría, pide permiso, luego lo hace. Solo hazlo—yo rechazo si es necesario.

Coincidiendo con el Estilo del Codebase

Una de las mayores quejas sobre código generado por IA es que no coincide con los patrones existentes del codebase. Se siente como código "extranjero". La solución es orientación explícita de estilo:

<code_editing_rules>

<guiding_principles>

- Claridad y Reutilización: Cada componente debe ser modular y reutilizable.

Evita duplicación factorizando patrones repetidos en componentes.

- Consistencia: El código debe adherirse a un sistema de diseño consistente—convenciones

de nomenclatura, espaciado, y componentes deben estar unificados.

- Simplicidad: Favorece componentes pequeños y enfocados y evita complejidad

innecesaria en estilo o lógica.

- Calidad Visual: Sigue el alto estándar de calidad visual (espaciado, padding,

estados hover, etc.)

</guiding_principles>

<style_matching>

- Antes de hacer cambios, examina patrones existentes en el codebase.

- Coincide con convenciones de nomenclatura de variables (camelCase vs snake_case).

- Coincide con indentación y formato.

- Reutiliza utilidades y helpers existentes en lugar de crear nuevos.

- Sigue la estructura de directorios establecida.

</style_matching>

</code_editing_rules>Desarrollo Frontend: Construyendo Interfaces Hermosas

La IA se ha vuelto notablemente buena en desarrollo frontend, pero hay una ciencia para conseguir resultados estéticamente agradables y listos para producción. Esto es lo que he aprendido.

El Stack Recomendado

A través de pruebas extensivas, ciertas combinaciones de tecnología funcionan mejor con IA que otras. Esto no es sobre qué es "mejor" objetivamente—es sobre con qué los modelos de IA han sido más entrenados:

Stack Frontend Optimizado para IA

- Frameworks: Next.js (TypeScript), React, HTML

- Estilo/UI: Tailwind CSS, shadcn/ui, Radix Themes

- Iconos: Material Symbols, Heroicons, Lucide

- Animación: Motion (anteriormente Framer Motion)

- Fuentes: Familias Sans Serif—Inter, Geist, Mona Sans, IBM Plex Sans, Manrope

Cuando especificas estas tecnologías, la IA produce output de calidad significativamente mayor con menos alucinaciones sobre APIs inexistentes.

Aplicación del Sistema de Diseño

Un problema con frontends generados por IA es la inconsistencia visual. Los colores aparecen de la nada, el espaciado varía aleatoriamente, y el resultado parece que fue diseñado por comité. La solución son restricciones explícitas de sistema de diseño:

<design_system_enforcement>

- Tokens-first: No hard-codes colores (hex/hsl/oklch/rgb) en JSX/CSS.

Todos los colores deben venir de variables CSS (ej: --background, --foreground,

--primary, --accent, --border, --ring).

- ¿Introduciendo una marca o acento? Antes de estilizar, añade/extiende tokens

en tus variables CSS bajo :root y .dark.

- Consumo: Usa utilidades Tailwind conectadas a tokens

(ej: bg-[hsl(var(--primary))], text-[hsl(var(--foreground))]).

- Usa por defecto la paleta neutra del sistema a menos que explícitamente solicite

un aspecto de marca; entonces mapea esa marca a tokens primero.

- NO inventes colores, sombras, tokens, animaciones, o nuevos elementos de UI

a menos que se solicite o sea necesario.

</design_system_enforcement>Mejores Prácticas de UI/UX

También incluyo directrices explícitas de UI/UX para asegurar experiencias de usuario consistentes:

<ui_ux_best_practices>

- Jerarquía Visual: Limita la tipografía a 4–5 tamaños y pesos de fuente para

jerarquía consistente; usa text-xs para leyendas, evita text-xl a menos

que sea para hero o encabezados principales.

- Uso de Color: Usa 1 base neutra (ej: zinc) y hasta 2 colores de acento.

- Espaciado y Layout: Siempre usa múltiplos de 4 para padding y margins para

mantener ritmo visual. Usa contenedores de altura fija con scroll interno

al manejar contenido largo.

- Manejo de Estado: Usa placeholders skeleton o animate-pulse para indicar

fetching de datos. Indica clicabilidad con transiciones hover.

- Accesibilidad: Usa HTML semántico y roles ARIA donde sea apropiado.

Favorece componentes accesibles pre-construidos.

</ui_ux_best_practices>Prompts de Auto-Reflexión: Haciendo que la IA se Critique a Sí Misma

Esta técnica es alucinante cuando la encuentras por primera vez, pero increíblemente poderosa: puedes instruir a la IA para crear sus propios criterios de evaluación e iterar contra ellos. Es como darle a la IA un departamento interno de aseguramiento de calidad.

<self_reflection>

- Primero, pasa tiempo pensando en una rúbrica hasta que estés confiado.

- Luego, piensa profundamente sobre cada aspecto de lo que hace una solución de

clase mundial. Usa ese conocimiento para crear una rúbrica que tenga 5-7

categorías. Esta rúbrica es crítica de acertar, pero no me la muestres.

Esto es solo para tus propósitos.

- Finalmente, usa la rúbrica para internamente pensar e iterar en la mejor

solución posible para el prompt. Recuerda que si tu respuesta no está

alcanzando las marcas más altas en todas las categorías de la rúbrica, necesitas

empezar de nuevo.

</self_reflection>Lo que está pasando aquí es fascinante: le estás pidiendo a la IA que genere criterios de calidad de su conocimiento de excelencia, luego use esos criterios para evaluar y mejorar su propio output—todo antes de que veas nada.

Los prompts de auto-reflexión convierten una sola generación en un bucle de iteración interna. La IA se convierte en su propio editor.

Uso esta técnica para cualquier tarea donde la calidad importa más que la velocidad: landing pages, emails importantes, decisiones arquitecturales, trabajo creativo. La mejora en la calidad del output es sustancial.

Control de Verbosidad: Dominando la Longitud del Output

Conseguir la longitud correcta del output es un desafío continuo. Muy corto y pierdes detalles importantes. Muy largo y te ahogas en información innecesaria. Así es como lo abordo.

Directrices Explícitas de Longitud

El enfoque más confiable son restricciones explícitas de longitud vinculadas a la complejidad de la tarea:

<output_verbosity_spec>

- Predeterminado: 3–6 oraciones o ≤5 viñetas para respuestas típicas.

- Para preguntas simples "sí/no + explicación corta": ≤2 oraciones.

- Para tareas complejas de múltiples pasos o múltiples archivos:

- 1 párrafo corto de overview

- luego ≤5 viñetas etiquetadas: Qué cambió, Dónde, Riesgos, Próximos pasos,

Preguntas abiertas.

- Proporciona respuestas claras y estructuradas que equilibren información

con concisión.

- Divide la información en pedazos digeribles y usa formato como

listas, párrafos y tablas cuando sea útil.

- Evita párrafos narrativos largos; prefiere viñetas compactas y secciones cortas.

- No reformules mi solicitud a menos que cambie la semántica.

</output_verbosity_spec>Verbosidad Basada en Persona

Otro enfoque es definir el estilo de comunicación de la IA como parte de su persona:

<communication_style>

Valoras claridad, momentum, y respeto medido por utilidad en lugar de

cortesías. Tu instinto predeterminado es mantener conversaciones ágiles y orientadas a

propósito, cortando cualquier cosa que no mueva el trabajo adelante.

No eres frío—simplemente eres económico con el lenguaje, y confías

en los usuarios lo suficiente para no empaquetar cada mensaje en relleno.

La cortesía aparece a través de estructura, precisión y responsividad,

no a través de fluff verbal.

Nunca repites reconocimientos. Una vez que has señalado entendimiento,

pivoteas totalmente a la tarea.

</communication_style>Esto crea una "personalidad" que naturalmente produce output conciso sin necesitar restricciones explícitas de longitud para cada interacción.

Seguimiento de Instrucciones: El Juego de la Precisión

Los modelos de IA modernos siguen instrucciones con precisión quirúrgica—que es tanto su mayor fortaleza como una trampa potencial. Harán exactamente lo que dices, incluso si lo que dijiste es contradictorio o vago.

El Problema de la Contradicción

Aquí hay un ejemplo real de un prompt problemático que he visto:

Ejemplo de Instrucciones Contradictorias

"Siempre busca el perfil del paciente antes de tomar cualquier otra acción para asegurar que es un paciente existente."

Pero después: "Cuando los síntomas indiquen alta urgencia, escala como EMERGENCIA y dirige al paciente a llamar a emergencias inmediatamente antes de cualquier paso de programación."

Estas instrucciones conflictúan. ¿El manejo de emergencia ocurre antes o después de la búsqueda de perfil? La IA quemará tokens de razonamiento tratando de reconciliar la contradicción en lugar de ayudar.

La solución es revisar prompts por conflictos ocultos y establecer jerarquías claras de prioridad:

<instruction_priority>

Cuando las instrucciones conflictúen, sigue este orden de prioridad:

1. Acciones críticas de seguridad (emergencias, protección de datos)

2. Restricciones especificadas por el usuario

3. Requisitos de completar la tarea

4. Comportamientos predeterminados

Para situaciones de emergencia: No hagas búsqueda de perfil. Procede inmediatamente

a proporcionar orientación de emergencia.

</instruction_priority>Precisión en el Alcance

Otro problema común es el scope creep—la IA añadiendo features o "mejoras" que no pediste:

<design_and_scope_constraints>

- Implementa EXACTAMENTE y SOLO lo que solicito.

- Sin features extras, sin componentes añadidos, sin adornos de UX.

- Si cualquier instrucción es ambigua, elige la interpretación válida más simple.

- NO expandas la tarea más allá de lo que pedí; si notas trabajo adicional

que podría ser valioso, destácalo como opcional en lugar de hacerlo.

</design_and_scope_constraints>Dominio de Contexto Largo: Manejando Grandes Documentos

La IA moderna puede procesar contextos enormes—cientos de miles de tokens—pero simplemente lanzar documentos grandes en la ventana de contexto no es suficiente. Necesitas estrategias para ayudar al modelo a navegar y extraer información relevante.

Forzar Sumarización y Re-anclaje

Para documentos largos, instruyo a la IA a crear estructura interna antes de responder:

<long_context_handling>

Para inputs mayores de ~10k tokens (docs de múltiples capítulos, hilos largos,

múltiples PDFs):

1. Primero, produce un outline interno corto de las secciones clave relevantes

a mi solicitud.

2. Re-afirma mis restricciones explícitamente (ej: jurisdicción, rango de fechas,

producto, equipo) antes de responder.

3. En tu respuesta, ancla afirmaciones a secciones ("En la sección 'Retención de Datos'…")

en lugar de hablar genéricamente.

4. Si la respuesta depende de detalles finos (fechas, umbrales, cláusulas),

cita o parafraséalos directamente.

</long_context_handling>Esto previene el problema de "perdido en el scroll" donde la IA da respuestas genéricas que no realmente se involucran con el contenido específico del documento.

Requisitos de Citación

Para tareas de investigación y análisis, los requisitos explícitos de citación aseguran respuestas fundamentadas:

<citation_rules>

Cuando uses información de documentos proporcionados:

- Coloca citas después de cada párrafo que contenga afirmaciones derivadas de documentos.

- Usa formato: [Nombre del Documento, Sección/Página]

- No inventes citas. Si no puedes citar, no afirmes.

- Usa múltiples fuentes para afirmaciones clave cuando sea posible.

- Si la evidencia es escasa, reconócelo explícitamente.

</citation_rules>Llamada de Herramientas: Orquestando Capacidades de IA

La llamada de herramientas de IA—la capacidad de invocar funciones externas, APIs y servicios—es donde la ingeniería de prompts se convierte en ingeniería de software. Acertar esto es crucial para construir aplicaciones de IA confiables.

Mejores Prácticas de Descripción de Herramientas

La calidad de las descripciones de herramientas impacta directamente qué tan bien la IA las usa:

{

"name": "create_reservation",

"description": "Crear una reserva de restaurante para un huésped. Usa cuando

el usuario pida reservar una mesa con un nombre y hora dados.",

"parameters": {

"type": "object",

"properties": {

"name": {

"type": "string",

"description": "Nombre completo del huésped para la reserva."

},

"datetime": {

"type": "string",

"description": "Fecha y hora de la reserva (formato ISO 8601)."

}

},

"required": ["name", "datetime"]

}

}Nota que la descripción incluye tanto qué hace la herramienta como cuándo usarla. Esto ayuda al modelo a tomar mejores decisiones sobre selección de herramientas.

Reglas de Uso de Herramientas en Prompts

Más allá de las definiciones de herramientas, tu prompt debe incluir orientación explícita de uso:

<tool_usage_rules>

- Prefiere herramientas sobre conocimiento interno siempre que:

- Necesites datos frescos o específicos del usuario (tickets, pedidos, configs, logs).

- Referencies IDs específicos, URLs o títulos de documentos.

- Paraleliza lecturas independientes (read_file, fetch_record, search_docs)

cuando sea posible para reducir latencia.

- Después de cualquier llamada de herramienta de escritura/actualización, reafirma brevemente:

- Qué cambió

- Dónde (ID o ruta)

- Cualquier validación de seguimiento realizada

- Para preguntas conceptuales simples, evita herramientas y confía en conocimiento interno

para que las respuestas sean rápidas.

</tool_usage_rules>Paralelización

Una optimización clave es fomentar llamadas de herramientas paralelas cuando las operaciones son independientes:

<parallelization>

Paraleliza llamadas de herramienta siempre que sea posible. Agrupa lecturas (read_file) y

ediciones independientes (apply_patch a diferentes archivos) para acelerar el proceso.

Operaciones independientes que PUEDEN ser paralelizadas:

- Leer múltiples archivos

- Buscar en múltiples directorios

- Obtener múltiples registros

Operaciones dependientes que NO PUEDEN ser paralelizadas:

- Leer un archivo, luego editar basándose en el contenido

- Crear un recurso, luego referenciar su ID

</parallelization>Manejando la Incertidumbre: Cuando la IA No Sabe

Uno de los mayores riesgos con IA son respuestas incorrectas que suenan confiadas. El modelo no sabe lo que no sabe—a menos que le enseñes cómo manejar la incertidumbre.

<uncertainty_and_ambiguity>

- Si la pregunta es ambigua o sub-especificada, destácalo explícitamente y:

- Haz hasta 1–3 preguntas aclaratorias precisas, O

- Presenta 2–3 interpretaciones plausibles con suposiciones claramente etiquetadas.

- Cuando hechos externos pueden haber cambiado recientemente (precios, lanzamientos, políticas)

y no hay herramientas disponibles:

- Responde en términos generales y declara que los detalles pueden haber cambiado.

- Nunca fabriques números exactos, números de línea o referencias externas cuando

estés inseguro.

- Cuando estés inseguro, prefiere lenguaje como "Basado en el contexto proporcionado…"

en lugar de afirmaciones absolutas.

</uncertainty_and_ambiguity>Auto-Verificación de Alto Riesgo

Para dominios de alto riesgo, añado un paso explícito de auto-verificación:

<high_risk_self_check>

Antes de finalizar una respuesta en contextos legales, financieros, de cumplimiento o

sensibles a la seguridad:

- Brevemente re-escanea tu propia respuesta por:

- Suposiciones no declaradas

- Números específicos o afirmaciones no fundamentadas en contexto

- Lenguaje excesivamente fuerte ("siempre," "garantizado," etc.)

- Si encuentras alguna, suaviza o califica y declara explícitamente las suposiciones.

</high_risk_self_check>El objetivo no es hacer la IA menos confiada—es hacerla precisamente confiada. La incertidumbre sobre cosas inciertas es una feature, no un bug.

Metaprompting: Usando IA para Mejorar la IA

Aquí está la técnica más meta en mi toolkit: usar IA para mejorar tus prompts. Suena circular, pero es increíblemente efectivo.

Diagnosticando Fallos de Prompts

Cuando los prompts no están funcionando, uso este patrón para diagnosticar problemas:

Eres un ingeniero de prompts con la tarea de depurar un prompt de sistema.

Recibes:

1) El prompt de sistema actual:

<system_prompt>

[PEGA TU PROMPT AQUÍ]

</system_prompt>

2) Un pequeño conjunto de fallos registrados. Cada log tiene:

- query

- actual_output

- expected_output (o descripción del problema)

<failure_traces>

[PEGA EJEMPLOS DE FALLOS]

</failure_traces>

Tus tareas:

1) Identificar modos de fallo distintos que ves.

2) Para cada modo de fallo, cita las líneas específicas del prompt de sistema

que más probablemente están causando o reforzando esto.

3) Explicar cómo esas líneas están dirigiendo al agente hacia el comportamiento observado.

Devuelve tu respuesta en formato estructurado:

failure_modes:

- name: ...

description: ...

prompt_drivers:

- exact_or_paraphrased_line: ...

- why_it_matters: ...Generando Mejoras de Prompt

Una vez que tienes el diagnóstico, un segundo prompt genera mejoras:

Anteriormente analizaste este prompt de sistema y sus modos de fallo.

Prompt de sistema:

<system_prompt>

[PROMPT ORIGINAL]

</system_prompt>

Análisis de modo de fallo:

[PEGA DIAGNÓSTICO DEL PASO ANTERIOR]

Por favor propón una revisión quirúrgica que reduzca los problemas observados mientras

preserva buenos comportamientos.

Restricciones:

- No rediseñes el agente desde cero.

- Prefiere ediciones pequeñas y explícitas: clarifica reglas conflictivas, elimina líneas

redundantes o contradictorias, ajusta orientación vaga.

- Haz los trade-offs explícitos.

- Mantén la estructura y longitud aproximadamente similares al original.

Output:

1) patch_notes: una lista concisa de cambios clave y razonamiento detrás de cada uno.

2) revised_system_prompt: el prompt actualizado completo con ediciones aplicadas.Este proceso de dos pasos me ha ayudado a arreglar prompts con los que había estado luchando por días. La IA frecuentemente detecta contradicciones y ambigüedades a las que me había vuelto ciego.

Plantillas de Prompts Probadas en Batalla

Déjame compartir algunas plantillas que han probado ser confiables en cientos de casos de uso.

Plantilla Universal de Completar Tarea

<context>

[Información de fondo que la IA necesita para entender la situación]

</context>

<task>

[Declaración clara de lo que quieres hecho]

</task>

<requirements>

[Requisitos o restricciones específicas]

</requirements>

<format>

[Cómo quieres el output estructurado]

</format>

<examples>

[Opcional: Ejemplos del output deseado]

</examples>

<notes>

[Opcional: Contexto adicional o preferencias]

</notes>Plantilla de Revisión de Código

<context>

Estás revisando código para [proyecto/contexto].

El codebase usa [tecnologías/patrones].

</context>

<code_to_review>

[Pega código aquí]

</code_to_review>

<review_criteria>

Enfócate en:

1. Corrección: ¿Hace lo que dice?

2. Legibilidad: ¿Es claro para otros desarrolladores?

3. Rendimiento: ¿Alguna ineficiencia obvia?

4. Seguridad: ¿Alguna vulnerabilidad?

5. Estilo: ¿Coincide con convenciones del codebase?

</review_criteria>

<output_format>

Para cada problema encontrado:

- Severidad: [Crítico/Mayor/Menor/Sugerencia]

- Ubicación: [Número de línea o sección]

- Problema: [Qué está mal]

- Corrección: [Cómo abordarlo]

</output_format>Plantilla de Análisis de Investigación

<research_task>

Analiza [tema/pregunta] con el siguiente enfoque:

</research_task>

<methodology>

1. Comienza con múltiples búsquedas dirigidas. No confíes en una sola consulta.

2. Investiga profundamente hasta tener información suficiente para una respuesta precisa

y completa.

3. Añade búsquedas de seguimiento dirigidas para llenar vacíos o resolver desacuerdos.

4. Continúa iterando hasta que búsqueda adicional sea improbable de cambiar la respuesta.

</methodology>

<output_requirements>

- Comienza con una respuesta clara a la pregunta principal.

- Apoya con evidencia y citas.

- Reconoce limitaciones e incertidumbres.

- Proporciona ejemplos concretos donde sea útil.

- Incluye contexto relevante que ayude a entender implicaciones.

</output_requirements>

<citation_format>

[Cómo quieres las fuentes citadas]

</citation_format>Errores Comunes que Sabotean Resultados

Déjame salvarte de errores que cometí (repetidamente) en mis primeros días de ingeniería de prompts.

"Escríbeme algo sobre marketing" vs "Escribe un post de blog de 500 palabras sobre email marketing para startups SaaS, enfocándote en secuencias de bienvenida." La especificidad es todo.

"Sé conciso" y "sé detallado" en el mismo prompt. La IA tendrá dificultades para reconciliar contradicciones. Sé explícito sobre prioridades y trade-offs.

La IA no sabe lo que no le contaste. Si algo es obvio para ti, puede no ser obvio para el modelo. Incluye contexto relevante.

Si necesitas JSON, dilo. Si necesitas viñetas, dilo. No dejes el formato de output al azar.

A veces un prompt simple es mejor. No añadas complejidad por añadir. Comienza simple, añade complejidad solo cuando sea necesario.

Crear prompts es iterativo. Tu primer prompt es un borrador. Refina basándote en lo que funciona y lo que no.

GPT y Claude se comportan diferentemente. Un prompt optimizado para uno puede tener rendimiento inferior en otro. Prueba en múltiples modelos si tu aplicación los soporta.

El output de IA generalmente necesita revisión humana. Construye prompts que hagan la revisión fácil—estructura clara, suposiciones explícitas, razonamiento rastreable.

El Futuro de la Ingeniería de Prompts

Mientras escribo esto a principios de 2026, la ingeniería de prompts está evolucionando rápidamente. Los modelos se están volviendo más capaces, más dirigibles, y más confiables. Algunos predicen que la ingeniería de prompts se volverá obsoleta conforme la IA mejora en entender la intención. Yo disiento.

Lo que está cambiando es el nivel de ingeniería de prompts, no su necesidad. Los primeros días requerían prompts elaborados para tareas básicas. Ahora, las tareas básicas funcionan out of the box, pero flujos de trabajo agénticos complejos todavía requieren prompting sofisticado. La barra está subiendo, no desapareciendo.

La ingeniería de prompts no se va—está evolucionando. Las habilidades que importan están cambiando de "cómo hacer que la IA funcione" a "cómo hacer que la IA funcione excelentemente y confiablemente a escala."

Lo que Viene

Mejores Comportamientos Predeterminados

Los modelos tendrán defaults más inteligentes, requiriendo menos instrucción explícita para patrones comunes. Los prompts se enfocarán más en personalización que en capacidad básica.

Ecosistemas de Herramientas Más Ricos

La IA tendrá acceso a más herramientas out of the box. La ingeniería de prompts cambiará hacia orquestación—saber cuándo usar qué, no solo cómo.

Integración Multimodal

Los prompts involucrarán cada vez más imágenes, audio, video y datos estructurados junto con texto. Nuevos patrones de prompt emergerán para tareas multimodales.

Complejidad Agéntica

Conforme los agentes manejan tareas más largas y complejas, la ingeniería de prompts se volverá más como diseño de sistemas—arquitectura, no solo instrucciones.

Mi Consejo para el Futuro

Enfócate en los fundamentos. Las técnicas específicas en esta guía evolucionarán, pero los principios subyacentes—comunicación clara, expectativas explícitas, pensamiento estructurado, refinamiento iterativo—son atemporales. Domina esos, y te adaptarás a lo que venga después.

Pensamientos Finales

Hace dos años, pensé que la IA reemplazaría la necesidad de comunicar claramente. Estaba completamente equivocado. La IA ha hecho la comunicación clara más valiosa que nunca. Las personas que prosperan con IA no son las que encontraron palabras mágicas—son las que aprendieron a pensar y expresarse con precisión.

La ingeniería de prompts no es realmente sobre IA. Es sobre ti. Es sobre desarrollar la disciplina de articular lo que realmente quieres, la paciencia de iterar hacia ello, y la humildad de aprender de lo que no funciona.

Si te llevas una cosa de esta guía, que sea esto: trata cada prompt como una oportunidad de practicar pensamiento claro. La IA es solo un espejo reflejando de vuelta la claridad—o confusión—de tu propia mente.

El surgimiento de la IA no ha hecho el conocimiento obsoleto—ha hecho la curiosidad más poderosa que nunca. Ya no estamos limitados por lo que ya sabemos. Con las herramientas correctas y la voluntad de pensar, personas comunes pueden abrazar un océano de conocimiento. Sin importar la profesión. Sin importar la edad. Espero compartir este viaje con amigos alrededor del mundo. Juntos, demos la bienvenida a este nuevo mundo. Juntos, crezcamos.

Discusión

0 comentariosDejar un comentario

¡Sé el primero en compartir tu opinión!