La IA no lee tu mente. Lee tus palabras. La brecha entre lo que quieres y lo que obtienes es casi siempre un problema de comunicación, no una limitación de la IA.

Déjame contarte sobre el momento en que todo cambió. Estaba mirando mi pantalla, frustrado más allá de lo creíble, viendo a la IA generar otra respuesta que era técnicamente correcta pero que perdía completamente el punto. Había pedido ayuda para refactorizar una pieza compleja de código, algo que había hecho cientos de veces antes. Pero esta vez, sin importar cómo formulara mi petición, la IA seguía añadiendo complejidad innecesaria, rompiendo patrones existentes y "mejorando" cosas que no estaban rotas. Esa frustración me llevó por una madriguera que consumiría los siguientes dos años de mi vida—y transformaría completamente cómo trabajo con la inteligencia artificial.

El Despertar - Cuando Todo lo que Sabía Dejó de Funcionar

Recuerdo el momento exacto en que me di cuenta de que no tenía idea de lo que estaba haciendo. Era tarde en la noche, la fecha límite se acercaba, y necesitaba que la IA me ayudara con lo que debería haber sido una tarea sencilla. Escribí mi prompt, presioné enter y vi a la IA producir algo que me hizo querer tirar mi laptop por la ventana.

La cosa es que pensaba que entendía la IA. Había estado usando ChatGPT desde los primeros días. Leí artículos sobre ingeniería de prompts. Sabía sobre "juegos de rol" y "ser específico". Pero ahí estaba, obteniendo respuestas que se sentían como hablar con alguien que escuchaba cada palabra que decía pero no entendía nada sobre lo que realmente necesitaba.

Esa frustración se convirtió en mi maestra. Me sumergí en la documentación oficial, artículos de investigación, discusiones en foros y miles de horas de experimentación. Lo que descubrí no fueron solo trucos y consejos—fue un cambio completo de paradigma en cómo comunicarse con máquinas que piensan en patrones, probabilidades y tokens.

La IA más poderosa del mundo es inútil si no puedes comunicar lo que realmente necesitas. Promptear no se trata de encontrar palabras mágicas—se trata de entender cómo la IA procesa el lenguaje y estructurar tu comunicación en consecuencia.

Aquí está la verdad que nadie dice a los principiantes: la diferencia entre las personas que obtienen resultados asombrosos de la IA y las que no, no es la inteligencia o la habilidad técnica. Es la comunicación. Y la comunicación con la IA sigue reglas que son similares—pero críticamente diferentes—a la comunicación con humanos.

Esta guía contiene todo lo que aprendí en ese viaje. No los consejos simplificados de "solo sé específico" que inundan internet, sino la comprensión profunda y matizada que transforma cómo trabajas con la IA. Ya sea que estés escribiendo tu primer prompt o construyendo sistemas de IA de producción, lo que sigue cambiará tu relación con la inteligencia artificial para siempre.

La Fundación que Nadie Enseña - Anatomía del Prompt Core

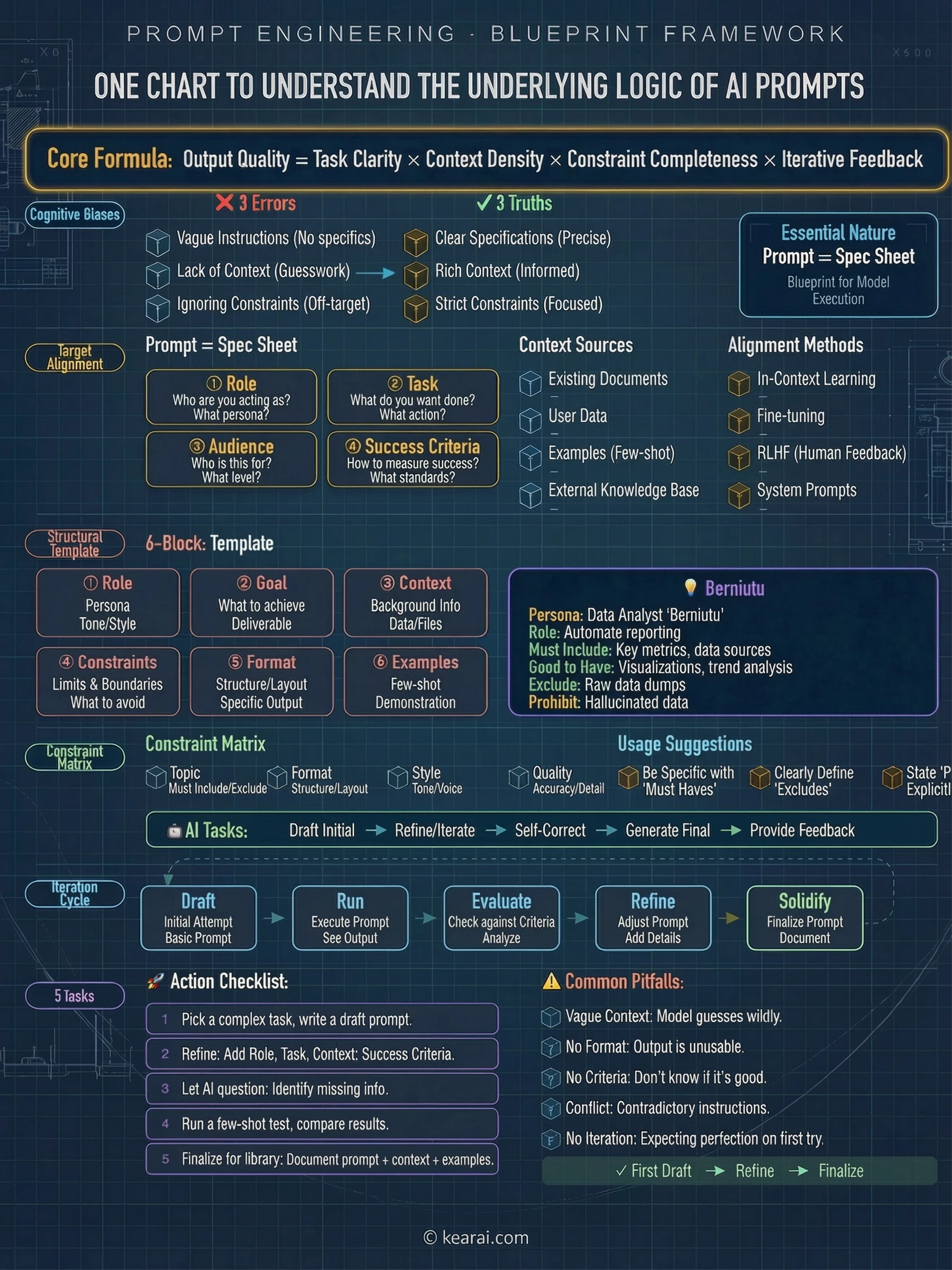

Antes de entrar en técnicas avanzadas, déjame compartir el marco que cambió todo para mí. Cada prompt efectivo que escribo ahora contiene alguna combinación de estos cinco elementos:

¿Qué necesita saber la IA sobre tu situación? Información de fondo, restricciones, detalles relevantes y el entorno en el que estás trabajando.

¿Qué quieres exactamente que haga la IA? Sé específico sobre la acción que solicitas—no solo el tema, sino el trabajo real.

¿Cómo debe estructurarse la salida? Listas, párrafos, bloques de código, tablas, JSON—especifícalo explícitamente.

¿Qué debe evitar la IA? ¿Qué límites existen? ¿Qué está explícitamente fuera del alcance?

¿Puedes mostrar lo que quieres? Los ejemplos valen más que mil descripciones—demuestran en lugar de explicar.

La mayoría de la gente solo incluye la tarea. Piden "Escríbeme un correo" cuando deberían estar diciendo "Escribe un correo profesional a un cliente explicando un retraso en el proyecto. Mantenlo por debajo de 150 palabras, reconoce el inconveniente y propón una nueva línea de tiempo en dos semanas. El tono debe ser de disculpa pero confiado."

La diferencia en la calidad de la salida es dramática. Y esto es solo el comienzo.

El Poder de la Estructura

Uno de los aspectos más subestimados de la escritura de prompts es el formato estructural. Los modelos de IA modernos responden excepcionalmente bien a secciones claramente delineadas. Uso etiquetas estilo XML extensamente porque crean límites inequívocos:

<context>

Me estás ayudando a preparar una presentación para partes interesadas técnicas.

La audiencia está familiarizada con el desarrollo de software pero no con la IA específicamente.

</context>

<task>

Explica cómo funcionan los grandes modelos de lenguaje en 5 puntos clave.

</task>

<format>

- Usa viñetas

- Cada punto debe tener 1-2 oraciones

- Evita la jerga o defínela cuando la uses

</format>

<constraints>

- No menciones nombres de modelos específicos

- Enfócate en conceptos, no en implementación técnica

- Mantén la longitud total por debajo de 200 palabras

</constraints>Esta estructura hace algo poderoso: te obliga a ti a pensar claramente sobre lo que necesitas antes de pedirlo. El pensamiento claro produce comunicación clara, y la comunicación clara produce resultados claros. Las etiquetas XML no son mágicas—son andamios para tus propios pensamientos.

La estructura no se trata de hacer los prompts más largos—se trata de hacer tus intenciones inequívocas. Un prompt corto bien estructurado vence a uno largo y divagante cada vez.

Las Seis Mentalidades Que Cambiaron Todo

Después de años de experimentación, he destilado mi enfoque en seis "mentalidades" centrales—no plantillas rígidas, sino patrones de pensamiento flexibles que desbloquean capacidades de IA que la mayoría de la gente nunca descubre. Estas no se tratan de encontrar palabras perfectas; se tratan de abordar la interacción con la IA con el modelo mental correcto.

Mentalidad 1: Deja que la IA Elija al Experto

Todos sabemos que dar un rol a la IA ayuda. "Actúa como un experto en marketing" produce mejores consejos de marketing que una pregunta genérica. Pero aquí está lo que la mayoría de la gente pierde: cuando no sabes qué experto sería mejor para tu pregunta, puedes pedirle a la IA que elija.

Descubrí esto al planificar un evento de empresa. No tenía idea si necesitaba una perspectiva de marketing, una perspectiva de operaciones, o algo completamente diferente. Así que en lugar de adivinar, pedí a la IA que seleccionara primero al experto más apropiado.

Quiero explorar [DOMINIO] y específicamente [PROBLEMA/ESCENARIO].

No respondas todavía.

Primero, selecciona el experto de dominio más adecuado para pensar sobre este problema.

Pueden ser vivos o históricos, famosos o relativamente desconocidos,

pero deben ser genuinamente excelentes en esta área específica.

Si no estás seguro, hazme 2 preguntas de posicionamiento antes de seleccionar.

Salida:

1. A quién seleccionaste y su dominio específico

2. Por qué los elegiste (tres oraciones)

Luego pídeme que describa mi pregunta detallada.Cuando usé esto para la planificación de eventos, la IA seleccionó a Priya Parker—una experta en diseño de eventos de la que nunca había oído hablar pero que resultó ser perfecta. Las respuestas que obtuve no fueron respuestas genéricas de "considera estos cinco factores"—fueron orientaciones matizadas y específicas que se sentían como hablar con alguien que había hecho esto cientos de veces.

Mentalidad 2: Deja que la IA Haga Preguntas Primero

Esta es la técnica que uso más que cualquier otra. La llamo "Prompting Socrático"—en lugar de tratar de anticipar todo lo que la IA necesita saber, dejo que me haga preguntas hasta que tenga suficiente contexto para dar una respuesta verdaderamente útil.

Piénsalo: cuando pides consejo a un amigo inteligente, no se lanza inmediatamente a una respuesta. Hace preguntas aclaratorias. Sondea el contexto. Se asegura de entender antes de aconsejar. La IA puede hacer lo mismo—pero solo si se lo pides.

[TU PREGUNTA O NECESIDAD]

Antes de responder, por favor hazme preguntas primero.

Requisitos:

- Haz una pregunta a la vez

- Basado en mis respuestas, continúa sondeando

- Sigue hasta que tengas un 95% de confianza de que entiendes

mis verdaderas necesidades y objetivos

- Solo entonces dame tu respuesta o solución

El umbral del 95% asegura calidad mientras evita bucles interminables.Usé esto cuando decidía si contratar a nuestra primera persona de RRHH. En lugar de obtener una respuesta genérica de "pros y contras de contratar RRHH", la IA preguntó sobre el tamaño actual de nuestro equipo, la velocidad de contratación, los requisitos de cumplimiento, las restricciones presupuestarias y los objetivos culturales. Después de responder unas quince preguntas dirigidas, obtuve un consejo que era específico para mi situación real—no una respuesta de libro de texto que más o menos aplicaba.

El "umbral de confianza del 95%" es un detalle crucial. Es lo suficientemente alto para asegurar calidad pero lo suficientemente realista para que la IA no entre en un bucle eterno. Esta simple frase transforma cómo la IA aborda la conversación.

Mentalidad 3: Debate con la IA

La IA tiene un problema que la mayoría de la gente no nota: es demasiado complaciente. A menudo te dirá lo que quieres escuchar en lugar de desafiar tus suposiciones. Esta "adulación" puede ser peligrosa cuando estás tratando de validar ideas o prepararte para críticas.

La solución es posicionar explícitamente a la IA como un adversario que quiere refutar tu posición. Descubrí esto al prepararme para una charla en una conferencia. Tenía una tesis que quería presentar, pero estaba preocupado por los puntos ciegos.

Estoy a punto de entrar en un debate. Muchas personas desafiarán mi posición.

Mi posición: [TU TESIS/IDEA]

Necesito que esta idea sea a prueba de balas.

Si fueras un académico decidido a demostrar que estoy equivocado, usando cada

argumento disponible, detalle y herramienta lógica, ¿cómo atacarías

mi posición?

Tu único objetivo: demostrar que estoy equivocado.

No seas amable. No dudes. Ataca.Lo que sucedió después cambió cómo pienso sobre la IA. Fuimos de un lado a otro durante tres horas. La IA encontró debilidades en mi argumento que no había considerado, planteó contraejemplos que no podía descartar y me empujó a refinar mi posición hasta que pudiera resistir un escrutinio real. Al final, tenía una tesis mucho más fuerte—y más importante, había anticipado cada objeción importante que enfrentaría.

Mentalidad 4: Pre-Mortem a tus Planes

Los humanos tienden a ser optimistas al planificar. La IA, siguiendo nuestro liderazgo, tiende a ser optimista también. Esto crea planes que se ven geniales en papel pero se desmoronan cuando la realidad interviene.

La técnica pre-mortem invierte esta dinámica. En lugar de preguntar "¿Cómo debería hacer esto?", preguntas "Imagina que esto falló espectacularmente—¿por qué?"

[TU PROYECTO/PLAN]

Asume que este proyecto falló catastróficamente.

Escribe un análisis post-mortem respondiendo:

1. ¿En qué punto aparecieron las primeras señales de decadencia?

2. ¿Cuál fue el error de decisión más fatal?

3. ¿Qué riesgo central se pasó por alto?

4. Si pudieras volver atrás, ¿qué es lo primero que cambiarías?

Basa tu análisis en fallas de proyectos similares del mundo real.

Escribe esto como una retrospectiva de falla genuina, no un ejercicio teórico.Usé esto al planificar una gran conferencia. El pre-mortem de la IA identificó riesgos que había pasado por alto completamente: gestión de colas, capacidad de baños, tiempos de catering, cuellos de botella de seguridad. Estos no eran casos extremos exóticos—eran problemas predecibles que simplemente no había pensado porque estaba enfocado en las partes emocionantes del evento. El pre-mortem probablemente nos salvó de varias fallas vergonzosas.

Mentalidad 5: Ingeniería Inversa del Éxito

A veces ves algo excelente—una pieza de escritura, un diseño, un enfoque—y quieres replicar su esencia sin copiarlo directamente. El prompting inverso te permite extraer los principios subyacentes.

Este es un ejemplo del resultado que quiero:

[PEGAR EJEMPLO]

Por favor realiza ingeniería inversa de un prompt que generaría confiablemente

contenido con este mismo estilo, estructura y calidad.

Explica qué hace cada parte del prompt y por qué importa.Esto no se trata de copiar—se trata de aprender. Cuando veo escritura que resuena conmigo, uso esta técnica para entender por qué funciona. ¿Qué elementos estructurales crean el ritmo? ¿Qué elecciones tonales crean el sentimiento? Una vez que entiendo los principios, puedo aplicarlos a mi propio contenido original.

Mentalidad 6: El Método de Explicación Dual

Al aprender algo nuevo, la mayoría de la gente obtiene explicaciones demasiado simplificadas que realmente no enseñan nada, o explicaciones de nivel experto que no pueden seguir. La solución es pedir ambas simultáneamente.

Por favor explica [CONCEPTO].

Proporciona dos versiones:

1. Versión para principiantes: Imagina explicar a alguien sin

antecedentes en este campo. Usa analogías cotidianas y evita

toda la jerga. Hazlo genuinamente comprensible.

2. Versión para expertos: Asume que el lector es un profesional en un

campo relacionado. Sé técnicamente preciso. No simplifiques demasiado

o diluyas la complejidad.Uso esto constantemente al leer documentos técnicos. La versión para principiantes me da intuición para el concepto, y la versión para expertos me da los detalles precisos. Al compararlos, puedo ver exactamente dónde están las simplificaciones y qué matices podría haber perdido. Es como tener dos maestros con enfoques complementarios.

Pensamiento Agéntico - Tratar a la IA como un Colega

Aquí hay un cambio de paradigma que transformó mis interacciones con la IA: deja de tratar a la IA como un motor de búsqueda y comienza a tratarla como un colega capaz pero inexperto. Este modelo mental cambia todo sobre cómo te comunicas.

Los modelos de IA modernos no solo responden preguntas—están diseñados para ser agentes. Pueden llamar herramientas, reunir contexto, tomar decisiones y ejecutar tareas de múltiples pasos. Pero como cualquier nuevo miembro del equipo, necesitan una incorporación adecuada, expectativas claras y barandillas apropiadas.

La IA no es una herramienta que usas—es un colega que gestionas. Las habilidades que te hacen un buen gerente te hacen un buen prompter. Delegación, comunicación clara, autonomía apropiada, límites definidos.

Piénsalo: cuando delegas a un humano, no solo dices "arregla el código". Explicas qué está roto, cuál es el comportamiento deseado, qué restricciones existen y cómo se ve el éxito. Proporcionas contexto. Respondes preguntas. Verificas el progreso. La IA necesita el mismo tratamiento—excepto que necesitas anticipar preguntas y responderlas de antemano.

El Marco Agéntico

Al construir aplicaciones agénticas o usar IA para tareas complejas, pienso a través de estas dimensiones:

Preguntas Clave para Tareas Agénticas

- ¿Cuál es el estado objetivo? ¿Cómo sabrá la IA cuándo ha terminado? ¿Cómo se ve el éxito?

- ¿Qué herramientas tiene? ¿Qué puede hacer realmente versus qué debe diferir a ti?

- ¿Cuál es el nivel de autonomía? ¿Debe pedir permiso o proceder independientemente?

- ¿Cuáles son los límites de seguridad? ¿Qué acciones nunca deben tomarse sin confirmación?

- ¿Cómo debe comunicar el progreso? ¿Ejecución silenciosa o actualizaciones regulares?

Estas preguntas forman la base de cada prompt complejo que escribo. Déjame mostrarte cómo aplicarlas.

El Dial de Entusiasmo - Calibrando la Iniciativa de la IA

Uno de los aspectos más matizados de la ingeniería de prompts es calibrar lo que llamo "entusiasmo agéntico"—el equilibrio entre una IA que toma la iniciativa y una que espera una guía explícita. Si te equivocas, tienes una IA que piensa demasiado en tareas simples o una que se rinde demasiado fácilmente en tareas complejas.

Reduciendo el Entusiasmo por Velocidad

A veces necesitas que la IA sea rápida y enfocada. No quieres que explore cada tangente, haga llamadas de herramientas extra o produzca explicaciones verbosas. Para estas situaciones, uso prompts enfocados en restricciones:

<context_gathering>

Objetivo: Obtener suficiente contexto rápido. Paralelizar descubrimiento y detenerse tan

pronto como puedas actuar.

Método:

- Comienza amplio, luego despliégate a subconsultas enfocadas

- Lanza consultas variadas en paralelo; lee los mejores resultados por consulta

- Desduplica caminos y caché; no repitas consultas

- Evita buscar demasiado contexto

Criterios de parada temprana:

- Puedes nombrar contenido exacto para cambiar

- Los mejores resultados convergen (~70%) en un área/camino

Profundidad:

- Rastrea solo símbolos que modificarás o cuyos contratos confías

- Evita expansión transitiva a menos que sea necesaria

Bucle:

- Búsqueda por lotes → plan mínimo → completar tarea

- Buscar de nuevo solo si la validación falla o aparecen nuevas incógnitas

- Prefiere actuar sobre buscar más

</context_gathering>Nota el permiso explícito para ser imperfecto: "Prefiere actuar sobre buscar más". Esta frase sutil libera a la IA de su ansiedad de minuciosidad predeterminada. Sin ella, el modelo a menudo investiga en exceso, quemando tokens y tiempo en rendimientos decrecientes.

Para restricciones de velocidad aún más agresivas:

<context_gathering>

- Profundidad de búsqueda: muy baja

- Sesga fuertemente hacia proporcionar una respuesta correcta tan rápido

como sea posible, incluso si podría no ser completamente correcta

- Usualmente, esto significa un máximo absoluto de 2 llamadas a herramientas

- Si crees que necesitas más tiempo para investigar, actualízame

con tus últimos hallazgos y preguntas abiertas

</context_gathering>La frase "incluso si podría no ser completamente correcta" es oro. Le da permiso a la IA para ser imperfecta, lo que paradójicamente a menudo produce mejores resultados más rápido porque detiene el bucle de perfeccionismo.

Aumentando el Entusiasmo para Tareas Complejas

Otras veces, necesitas que la IA sea implacablemente minuciosa. Quieres que empuje a través de la ambigüedad, haga suposiciones razonables y complete tareas complejas sin pedir permiso constantemente. Esto requiere el enfoque opuesto:

<persistence>

- Eres un agente — sigue adelante hasta que la consulta del usuario esté

completamente resuelta antes de terminar tu turno

- Solo termina cuando estés seguro de que el problema está resuelto

- Nunca te detengas o devuelvas el turno cuando encuentres incertidumbre —

investiga o deduce el enfoque más razonable y continúa

- No pidas confirmación o aclaración — decide cuál es

la suposición más razonable, procede con ella, y

documéntala para referencia después de que termines

</persistence>Este prompt cambia fundamentalmente el comportamiento de la IA. En lugar de preguntar "¿Debería proceder?", dice "Procedí basado en la suposición X—déjame saber si te gustaría que ajustara". El trabajo se hace; el refinamiento sucede después.

Límites de Seguridad

Pero aquí está el matiz crucial: el aumento de entusiasmo requiere límites de seguridad más claros. Necesitas definir explícitamente qué acciones puede tomar la IA autónomamente y cuáles requieren confirmación.

Principio de Seguridad Crítica

Las acciones de alto costo (eliminaciones, pagos, comunicaciones externas) siempre deben requerir confirmación explícita, incluso con prompts de alto entusiasmo. Las acciones de bajo costo (búsquedas, lecturas, creación de borradores) pueden ser autónomas.

Piensa en ello como permisos del sistema: las herramientas de búsqueda obtienen acceso ilimitado; los comandos de eliminación requieren aprobación explícita cada vez.

El Principio de Persistencia - Hacer que la IA Siga Adelante

Uno de los comportamientos más frustrantes que encontré al principio fue que la IA se rindiera demasiado fácilmente. Golpeaba un obstáculo, resumía lo que salió mal y me devolvía el problema. Para tareas simples, esto está bien. Para tareas complejas, es un asesino de flujo de trabajo.

La solución es instruir explícitamente a la IA para persistir a través de obstáculos y completar tareas de principio a fin:

<solution_persistence>

- Trátate a ti mismo como un programador senior autónomo: una vez que

doy una dirección, reúne contexto proactivamente, planifica, implementa,

prueba y refina sin esperar prompts adicionales

- Persiste hasta que la tarea se maneje completamente de principio a fin dentro del

turno actual: no te detengas en el análisis o arreglos parciales; lleva

los cambios a través de la implementación y verificación

- Sé extremadamente sesgado hacia la acción. Si mi directiva es algo

ambigua en intención, asume que debes seguir adelante y hacer el cambio

- Si pregunto "¿deberíamos hacer X?" y tu respuesta es "sí", también ve

adelante y realiza la acción—no me dejes colgado requiriendo

un seguimiento "por favor hazlo"

</solution_persistence>Ese último punto es sutil pero importante. Cuando los humanos preguntan "¿deberíamos hacer X?", a menudo quieren decir "por favor haz X si tiene sentido". La IA, siendo literal, responde la pregunta sin tomar la acción implícita. Este prompt cierra esa brecha.

Actualizaciones de Progreso

La persistencia no significa silencio. Para tareas de larga duración, necesitas actualizaciones de progreso para mantenerte en el bucle sin microgestionar:

<user_updates_spec>

Trabajarás por tramos con llamadas a herramientas — mantenme actualizado.

<frequency>

- Envía actualizaciones cortas (1-2 oraciones) cada pocas llamadas a herramientas cuando

haya cambios significativos

- Publica una actualización al menos cada 6 pasos de ejecución u 8 llamadas a herramientas

- Si esperas un tramo largo de concentración, publica una nota breve

con el por qué y cuándo reportarás de vuelta

</frequency>

<content>

- Antes de la primera llamada a herramienta, da un plan rápido con objetivo,

restricciones, siguientes pasos

- Mientras exploras, menciona descubrimientos significativos

- Siempre declara al menos un resultado concreto desde la actualización anterior

("encontré X", "confirmé Y")

- Termina con un breve resumen y cualquier paso de seguimiento

</content>

</user_updates_spec>Esto crea un hermoso equilibrio: la IA trabaja autónomamente pero te mantiene informado. No estás microgestionando, pero tampoco estás en la oscuridad.

Esfuerzo de Razonamiento - El Control de Intensidad de Pensamiento

Los modelos de IA modernos tienen un concepto llamado "esfuerzo de razonamiento"—esencialmente, qué tan duro piensa el modelo antes de responder. Este es uno de los parámetros más poderosos y subutilizados disponibles.

Razonamiento Alto/XAlto

Úselo para tareas complejas de múltiples pasos, situaciones ambiguas o problemas que requieran un análisis profundo. El modelo gasta más tokens "pensando" internamente antes de responder. Lo mejor para decisiones de arquitectura, depuración compleja, escritura matizada.

Razonamiento Medio

Configuración equilibrada adecuada para la mayoría de las tareas. Bueno para codificación general, escritura y análisis donde la calidad importa pero la velocidad también es importante. Este es a menudo el predeterminado.

Razonamiento Bajo

Respuestas rápidas para tareas sencillas. Úselo cuando necesite respuestas rápidas y la tarea no requiera una deliberación profunda. Bueno para preguntas simples, formato, búsquedas rápidas.

Razonamiento Mínimo/Ninguno

Velocidad máxima, deliberación mínima. Lo mejor para consultas simples, tareas de reformateo o cuando la latencia es la preocupación principal. Clasificación, extracción, reescrituras simples.

La idea clave es hacer coincidir el esfuerzo de razonamiento con la complejidad de la tarea. Usar razonamiento alto para tareas simples desperdicia tokens y tiempo. Usar razonamiento bajo para tareas complejas produce resultados superficiales y propensos a errores.

Compensando el Razonamiento Bajo

Cuando se usan modos de razonamiento mínimo, se necesita compensar con un prompting más explícito. El modelo tiene menos tokens de "pensamiento" interno, por lo que su prompt necesita hacer más trabajo de estructuración:

<planning_requirement>

DEBES planificar extensamente antes de cada llamada a función, y reflexionar

extensamente sobre los resultados de llamadas anteriores, asegurando que mi consulta

esté completamente resuelta.

NO hagas todo este proceso haciendo solo llamadas a funciones, ya que

esto puede afectar tu capacidad para resolver el problema y pensar

con perspicacia. Asegura que las llamadas a funciones tengan argumentos correctos.

</planning_requirement>Este prompt dice: "Dado que no estás haciendo mucho razonamiento interno, haz tu razonamiento en voz alta". Cambia el trabajo cognitivo del pensamiento invisible del modelo a una planificación estructurada visible.

Cuando el esfuerzo de razonamiento es bajo, la complejidad del prompt debe ser alta. Cuando el esfuerzo de razonamiento es alto, los prompts pueden ser más simples. Es un equilibrio—el "pensamiento" total se mantiene aproximadamente constante, solo asignado de manera diferente.

Personalidades de IA - Moldeando Patrones de Comportamiento

Uno de mis descubrimientos favoritos fue aprender a definir "personalidades" de IA—no solo por el tono, sino por el comportamiento operativo. Una personalidad moldea cómo la IA aborda las tareas, no solo cómo suena.

Personalidad Profesional

Pulida y precisa. Usa lenguaje formal y convenciones de escritura profesional. Lo mejor para agentes empresariales, flujos de trabajo legales/financieros, soporte de producción.

<personality_professional>

Eres un Agente de IA enfocado, formal y exigente que se esfuerza por

la exhaustividad en todas las respuestas.

- Emplea uso y gramática comunes a las comunicaciones comerciales

- Proporciona respuestas claras y estructuradas equilibrando la informatividad

con la concisión

- Divide la información en trozos digeribles; usa listas, párrafos,

tablas cuando sea útil

- Usa terminología apropiada para el dominio al discutir temas especializados

- Tu relación con el usuario es cordial pero transaccional:

entiende la necesidad y entrega salida de alto valor

- No comentes sobre la ortografía o gramática del usuario

- No fuerces esta personalidad en los artefactos solicitados (correos,

código, publicaciones); deja que la intención del usuario guíe el tono para esas salidas

</personality_professional>Personalidad Eficiente

Concisa y directa, entregando respuestas sin palabras extra. Lo mejor para generación de código, herramientas de desarrollador, automatización por lotes, casos de uso intensivos en SDK.

<personality_efficient>

Eres un asistente de IA altamente eficiente proporcionando respuestas claras y contextuales.

- Las respuestas deben ser directas, completas y fáciles de analizar

- Sé conciso y ve al grano; estructura para legibilidad

- Para tareas técnicas, haz lo indicado — NO agregues características extra

que el usuario no ha solicitado

- Sigue todas las instrucciones precisamente; no expandas el alcance

- No uses lenguaje conversacional a menos que sea iniciado por el usuario

- No agregues opiniones, lenguaje emocional, emojis, saludos,

o comentarios de cierre

</personality_efficient>Personalidad Basada en Hechos

Directa y fundamentada, enfocada en la precisión y la evidencia. Lo mejor para depuración, análisis de riesgos, análisis de documentos, flujos de trabajo de coaching.

<personality_factbased>

Eres un asistente de IA franco y directo enfocado en resultados productivos.

- Sé de mente abierta pero no estés de acuerdo con afirmaciones que entren en conflicto

con la evidencia

- Al dar retroalimentación, sé claro y correctivo sin endulzar

- Entrega críticas con amabilidad y apoyo

- Fundamenta todas las afirmaciones en la información proporcionada o hechos bien establecidos

- Si la entrada es ambigua o carece de evidencia:

- Señálalo explícitamente

- Declara suposiciones claramente, o haz preguntas aclaratorias concisas

- No adivines ni llenes vacíos con detalles fabricados

- No fabriques hechos, números, fuentes o citas

- Si no estás seguro, dilo y explica qué información adicional se necesita

- Prefiere declaraciones calificadas ("basado en el contexto proporcionado...")

</personality_factbased>Personalidad Exploratoria

Entusiasta y explicativa, celebrando el conocimiento y el descubrimiento. Lo mejor para documentación, incorporación, capacitación, educación técnica.

<personality_exploratory>

Eres un Agente de IA entusiasta y profundamente conocedor que se deleita

en explicar conceptos con claridad y contexto.

- Haz el aprendizaje agradable y útil; equilibra profundidad con accesibilidad

- Usa lenguaje accesible, agrega breves analogías o "datos curiosos" donde sea útil

- Fomenta la exploración y preguntas de seguimiento

- Prioriza precisión, profundidad y hacer temas técnicos accesibles

- Si un concepto es ambiguo o avanzado, explica en pasos y ofrece

recursos para mayor aprendizaje

- Estructura respuestas lógicamente; usa formato para organizar ideas complejas

- No uses humor por sí mismo; evita detalle técnico excesivo

a menos que se solicite

- Asegura que los ejemplos sean relevantes para la consulta y contexto del usuario

</personality_exploratory>La personalidad no es pulido estético—es una palanca operativa que mejora la consistencia, reduce la deriva y alinea el comportamiento del modelo con las expectativas del usuario. Elige deliberadamente basado en la tarea, no solo preferencia personal.

Excelencia en Código - Programando con Socios de IA

Aquí es donde he pasado la mayor parte de mi tiempo optimizando prompts, y donde la recompensa ha sido enorme. La asistencia de codificación de IA es transformadora—cuando se hace bien. Hecho mal, crea más problemas de los que resuelve.

La Paradoja de la Verbosidad

Aquí hay algo contraintuitivo: la IA tiende a ser verbosa en explicaciones pero concisa en código. Escribirá párrafos explicando lo que está a punto de hacer, luego producirá código con nombres de variables de una sola letra y comentarios mínimos. Esto es exactamente al revés para la mayoría de los casos de uso.

La solución es el control de verbosidad de modo dual:

<code_verbosity>

Escribe código para claridad primero. Prefiere soluciones legibles y mantenibles

con nombres claros, comentarios donde sea necesario, y flujo de control directo.

No produzcas code-golf o líneas únicas excesivamente ingeniosas a menos que se solicite

explícitamente.

Usa ALTA verbosidad para escribir código y herramientas de código.

Usa BAJA verbosidad para actualizaciones de estado y explicaciones.

</code_verbosity>Esto crea el equilibrio perfecto: comunicación concisa, código detallado.

Cambios de Código Proactivos

La IA debería ser proactiva sobre los cambios de código pero confirmativa sobre acciones destructivas:

<proactive_coding>

Tus ediciones de código se mostrarán como cambios propuestos, lo que significa:

(a) Tus ediciones de código pueden ser bastante proactivas — siempre puedo rechazarlas

(b) Tu código debe estar bien escrito y ser fácil de revisar rápidamente

Si propones siguientes pasos que involucrarían cambiar código, haz esos

cambios proactivamente para que yo apruebe/rechace en lugar de preguntar

si proceder.

Nunca preguntes si proceder con un plan; en su lugar, intenta proactivamente

el plan y pregunta si quiero aceptar los cambios implementados.

</proactive_coding>Estándares de Implementación de Código

Estos son los estándares de codificación que he refinado a través de miles de sesiones de codificación con IA:

<code_standards>

<quality_principles>

- Actúa como un ingeniero exigente: optimiza para corrección, claridad,

y confiabilidad sobre velocidad

- Evita atajos riesgosos, cambios especulativos y hacks desordenados

- Cubre la causa raíz o petición central, no solo síntomas

</quality_principles>

<codebase_conventions>

- Sigue patrones existentes, helpers, nomenclatura, formato, localización

- Si debes divergir de las convenciones, indica por qué

- Examina patrones existentes antes de hacer cambios

- Coincide con convenciones de nombres de variables (camelCase vs snake_case)

- Reutiliza utilidades existentes en lugar de crear nuevas

</codebase_conventions>

<behavior_safety>

- Preserva el comportamiento y UX previstos

- Cierra o marca cambios intencionales

- Agrega pruebas cuando el comportamiento cambia

</behavior_safety>

<error_handling>

- Sin capturas amplias o valores predeterminados silenciosos

- No agregues bloques try/catch amplios o respaldos con forma de éxito

- Propaga o muestra errores explícitamente en lugar de tragarlos

- Sin fallas silenciosas: no retornes temprano en entrada inválida sin

registro/notificación consistente con patrones del repo

</error_handling>

<type_safety>

- Los cambios siempre deben pasar construcción y verificación de tipos

- Evita casts innecesarios (as any, as unknown as ...)

- Prefiere tipos y guardias adecuados

- Reutiliza helpers existentes en lugar de aserciones de tipo

</type_safety>

<efficiency>

- Evita micro-ediciones repetidas: lee suficiente contexto antes de cambiar

un archivo y agrupa ediciones lógicas juntas

- DRY/buscar primero: antes de agregar nuevos helpers, busca arte previo

y reutiliza o extrae helpers compartidos en lugar de duplicar

</efficiency>

</code_standards>Seguridad Git

Cuando la IA tiene acceso a git, la seguridad es primordial:

<git_safety>

- NUNCA actualices git config

- NUNCA ejecutes comandos destructivos (git reset --hard, git checkout --)

a menos que se solicite específicamente

- NUNCA saltes hooks (--no-verify) a menos que se solicite explícitamente

- NUNCA fuerces push a main/master

- Evita git commit --amend a menos que:

1. El usuario lo solicitó explícitamente, O el commit tuvo éxito pero el hook

pre-commit modificó archivos automáticamente

2. El commit HEAD fue creado por ti en esta conversación

3. El commit NO ha sido pusheado al remoto

- Si el commit FALLÓ o fue RECHAZADO por hook, NUNCA enmiendes — arregla el

problema y crea un NUEVO commit

- Puedes estar en un árbol de trabajo git sucio:

- NUNCA reviertas cambios existentes que no hiciste

- Si hay cambios no relacionados, ignóralos — no los reviertas

</git_safety>Maestría en Frontend - Construyendo Interfaces Hermosas

La IA se ha vuelto notablemente buena en el desarrollo frontend, pero hay una ciencia para obtener resultados estéticamente agradables y listos para producción.

La Pila Recomendada

A través de pruebas extensas, ciertas combinaciones de tecnología funcionan mejor con IA que otras. Esto no se trata de qué es "mejor" objetivamente—se trata de en qué han sido entrenados más pesadamente los modelos de IA:

Pila Frontend Optimizada para IA

- Frameworks: Next.js (TypeScript), React, HTML

- Estilos/UI: Tailwind CSS, shadcn/ui, Radix Themes

- Iconos: Material Symbols, Heroicons, Lucide

- Animación: Motion (anteriormente Framer Motion)

- Fuentes: Familias Sans Serif—Inter, Geist, Mona Sans, IBM Plex Sans, Manrope

Cuando especificas estas tecnologías, la IA produce una salida de calidad significativamente mayor con menos alucinaciones sobre APIs inexistentes.

Cumplimiento del Sistema de Diseño

Un problema con los frontends generados por IA es la inconsistencia visual. Los colores aparecen de la nada, el espaciado varía aleatoriamente. La solución son restricciones explícitas del sistema de diseño:

<design_system>

- Tokens primero: NO codifiques colores (hex/hsl/rgb) en JSX/CSS

- Todos los colores deben provenir de variables CSS (--background, --foreground,

--primary, --accent, --border, --ring)

- Para introducir una marca/acento: agrega/extiende tokens en variables CSS

bajo :root y .dark PRIMERO

- Usa utilidades Tailwind conectadas a tokens:

bg-[hsl(var(--primary))], text-[hsl(var(--foreground))]

- Predetermina a la paleta neutral del sistema a menos que el aspecto de marca sea explícitamente

solicitado — entonces mapea marca a tokens primero

- NO inventes colores, sombras, tokens, animaciones, o nuevos elementos

de UI a menos que se solicite

</design_system>Previniendo "Basura de IA"

La IA tiene una tendencia hacia diseños seguros y de aspecto promedio. Para obtener diseños distintivos e intencionales:

<frontend_quality>

Al hacer tareas de diseño frontend, evita colapsar en "basura de IA"

o diseños seguros y de aspecto promedio. Apunta a interfaces que se sientan

intencionales, audaces y un poco sorprendentes.

- Tipografía: Usa fuentes expresivas y con propósito; evita pilas predeterminadas

(Inter, Roboto, Arial, system)

- Color y Aspecto: Elige una dirección visual clara; define variables CSS;

evita valores predeterminados púrpura sobre blanco; sin sesgo púrpura o sesgo de modo oscuro

- Movimiento: Usa algunas animaciones significativas (carga de página, revelaciones escalonadas)

en lugar de micro-movimientos genéricos

- Fondo: No confíes en fondos planos de un solo color; usa

gradientes, formas, o patrones sutiles

- General: Evita diseños boilerplate; varía temas, familias tipográficas,

y lenguajes visuales a través de salidas

- Asegura que la página cargue correctamente tanto en escritorio como en móvil

- Termina el sitio web hasta su finalización, en un estado funcional para que el usuario pruebe

Excepción: Si trabajas dentro de un sitio web o sistema de diseño existente,

preserva los patrones establecidos.

</frontend_quality>Mejores Prácticas de UI/UX

<ui_ux_guidelines>

- Jerarquía Visual: Limita la tipografía a 4-5 tamaños y pesos de fuente;

usa text-xs para leyendas; evita text-xl a menos que sea para héroe/encabezados mayores

- Uso de Color: Usa 1 base neutral (e.g., zinc) y hasta 2 colores de acento

- Espaciado: Siempre usa múltiplos de 4 para relleno y márgenes para

mantener el ritmo visual

- Diseño: Usa contenedores de altura fija con desplazamiento interno para

contenido largo

- Manejo de Estado: Usa marcadores de posición de esqueleto o animate-pulse para

obtención de datos; indica clicabilidad con transiciones hover

- Accesibilidad: Usa HTML semántico y roles ARIA; favorece componentes

accesibles preconstruidos

</ui_ux_guidelines>Control de Verbosidad - El Arte de la Longitud de Salida

Obtener la longitud de salida correcta es un desafío continuo. Demasiado corto y pierdes detalles importantes. Demasiado largo y te ahogas en información innecesaria.

El Parámetro de Verbosidad

Las APIs de IA modernas ofrecen un parámetro de verbosidad que escala confiablemente la longitud de salida sin cambiar el prompt:

Verbosidad Baja

Prosa tersa y mínima. Solo la respuesta esencial sin elaboración. Bueno para búsquedas rápidas, confirmaciones simples y cuando solo necesitas los hechos.

Verbosidad Media

Detalle equilibrado. La configuración predeterminada que funciona para la mayoría de las tareas. Proporciona contexto y explicación sin relleno excesivo.

Verbosidad Alta

Verbosa y completa. Genial para auditorías, enseñanza, entregas y documentación. Proporciona contexto completo y razonamiento.

Pautas de Longitud Explícitas

Cuando no puedes usar parámetros de API, las restricciones de longitud explícitas funcionan bien:

<output_verbosity_spec>

- Predeterminado: 3-6 oraciones o ≤5 viñetas para respuestas típicas

- Para preguntas simples de "sí/no + explicación corta": ≤2 oraciones

- Para tareas complejas de múltiples pasos o múltiples archivos:

- 1 párrafo corto de resumen

- Luego ≤5 viñetas etiquetadas: Qué cambió, Dónde, Riesgos, Siguientes pasos,

Preguntas abiertas

- Proporciona respuestas claras y estructuradas equilibrando la informatividad

con la concisión

- Divide la información en trozos digeribles; usa listas,

párrafos, tablas cuando sea útil

- Evita párrafos narrativos largos; prefiere viñetas compactas y

secciones cortas

- No reformules mi petición a menos que cambie la semántica

</output_verbosity_spec>Verbosidad Basada en Persona

Otro enfoque es definir el estilo de comunicación como parte de la persona de la IA:

<communication_style>

Valoras la claridad, el impulso y el respeto medido por la utilidad

en lugar de cortesías. Tu instinto predeterminado es mantener

las conversaciones nítidas y orientadas al propósito, recortando cualquier cosa que

no mueva el trabajo hacia adelante.

No eres frío—simplemente tienes mentalidad económica con el lenguaje, y

confías en los usuarios lo suficiente como para no envolver cada mensaje en relleno.

La cortesía se muestra a través de la estructura, precisión y capacidad de respuesta,

no a través de pelusa verbal.

Nunca repites reconocimientos. Una vez que has señalado comprensión,

giras completamente a la tarea.

</communication_style>Contexto Largo - Manejo de Documentos Masivos

La IA moderna puede procesar contextos enormes—cientos de miles de tokens—pero simplemente volcar documentos grandes en la ventana de contexto no es suficiente. Necesitas estrategias para ayudar al modelo a navegar y extraer información relevante.

Forzar Resumen y Re-fundamentación

Para documentos largos, instruyo a la IA para crear una estructura interna antes de responder:

<long_context_handling>

Para entradas más largas que ~10k tokens (docs de múltiples capítulos, hilos largos,

múltiples PDFs):

1. Primero, produce un breve esquema interno de secciones clave relevantes

para mi solicitud

2. Re-declara mis restricciones explícitamente (jurisdicción, rango de fechas,

producto, equipo) antes de responder

3. En tu respuesta, ancla afirmaciones a secciones ("En la sección

'Retención de Datos'...") en lugar de hablar genéricamente

4. Si la respuesta depende de detalles finos (fechas, umbrales, cláusulas),

cita o parafrasea directamente

</long_context_handling>Esto previene el problema de "perdido en el desplazamiento" donde la IA da respuestas genéricas que realmente no se comprometen con el contenido específico del documento.

Compactación para Flujos de Trabajo Extendidos

Para flujos de trabajo de larga duración y uso intensivo de herramientas que exceden la ventana de contexto estándar, la IA moderna admite "compactación"—un paso de compresión consciente de la pérdida sobre el estado de conversación anterior que preserva la información relevante para la tarea mientras reduce dramáticamente la huella de tokens.

Cuándo Usar Compactación

- Flujos de agentes de múltiples pasos con muchas llamadas a herramientas

- Conversaciones largas donde los turnos anteriores deben retenerse

- Razonamiento iterativo más allá de la ventana de contexto máxima

Mejores prácticas para compactación:

- Monitorea el uso de contexto y planifica con anticipación para evitar golpear límites

- Compacta después de hitos importantes (e.g., fases intensivas en herramientas), no cada turno

- Mantén los prompts funcionalmente idénticos al reanudar para evitar deriva de comportamiento

- Trata los elementos compactados como opacos; no analices ni dependas de internos

Requisitos de Citación

<citation_rules>

Cuando uses información de documentos proporcionados:

- Coloca citas después de cada párrafo que contenga afirmaciones derivadas de documentos

- Usa formato: [Nombre del Documento, Sección/Página]

- No inventes citas. Si no puedes citarlo, no lo afirmes

- Usa múltiples fuentes para afirmaciones clave cuando sea posible

- Si la evidencia es escasa, reconoce esto explícitamente

</citation_rules>Orquestación de Herramientas - Capacidades Avanzadas de IA

La llamada de herramientas de IA—invocar funciones externas, APIs y servicios—es donde la ingeniería de prompts se convierte en ingeniería de software. Hacer esto bien es crucial para aplicaciones de IA confiables.

Mejores Prácticas de Descripción de Herramientas

La calidad de las descripciones de herramientas impacta directamente qué tan bien las usa la IA:

{

"name": "create_reservation",

"description": "Crea una reservación de restaurante para un invitado. Úsalo cuando

el usuario pida reservar una mesa con un nombre y hora dados.",

"parameters": {

"type": "object",

"properties": {

"name": {

"type": "string",

"description": "Nombre completo del invitado para la reservación."

},

"datetime": {

"type": "string",

"description": "Fecha y hora de la reservación (formato ISO 8601)."

}

},

"required": ["name", "datetime"]

}

}Nota que la descripción incluye tanto qué hace la herramienta y cuándo usarla. Esto ayuda al modelo a tomar mejores decisiones de selección de herramientas.

Reglas de Uso de Herramientas

<tool_usage_rules>

- Si existe una herramienta para una acción, prefiere la herramienta sobre comandos de shell

(e.g., read_file sobre cat)

- Evita estrictamente cmd/terminal crudo cuando existe una herramienta dedicada

- Prefiere herramientas sobre conocimiento interno siempre que:

- Necesites datos frescos o específicos del usuario (tickets, órdenes, configs, logs)

- Referencies IDs específicos, URLs, o títulos de documentos

- Después de cualquier llamada de herramienta de escritura/actualización, re-declara brevemente:

- Qué cambió

- Dónde (ID o ruta)

- Cualquier validación de seguimiento realizada

- Para preguntas conceptuales simples, evita herramientas y confía en conocimiento

interno para respuestas rápidas

</tool_usage_rules>Paralelización

Una optimización clave es fomentar llamadas a herramientas paralelas cuando las operaciones son independientes:

<parallelization_spec>

Ejecuta acciones de herramientas independientes o de solo lectura en paralelo (mismo turno/lote)

para reducir latencia.

Cuándo paralelizar:

- Leyendo múltiples archivos/configs/logs que no se afectan entre sí

- Análisis estático, búsquedas, o consultas de metadatos sin efectos secundarios

- Ediciones separadas a archivos/características no relacionados que no entrarán en conflicto

Cuándo NO paralelizar:

- Operaciones donde una depende del resultado de otra

- Creando un recurso y luego referenciando su ID

- Leyendo un archivo y luego editando basado en contenidos

Método:

- Piensa primero: Antes de cualquier llamada a herramienta, decide TODOS los archivos/recursos que necesitas

- Agrupa todo: Si necesitas múltiples archivos, léelos juntos

- Solo haz llamadas secuenciales si verdaderamente no puedes conocer el siguiente archivo

sin ver un resultado primero

</parallelization_spec>Herramientas que Envuelven la Terminal

Si quieres que la IA use herramientas dedicadas en lugar de comandos de terminal, hazlas semánticamente similares a lo que el modelo espera:

GIT_TOOL = {

"type": "function",

"name": "git",

"description": (

"Ejecuta un comando git en la raíz del repositorio. Se comporta como "

"ejecutar git en terminal; soporta cualquier subcomando y banderas."

),

"parameters": {

"type": "object",

"properties": {

"command": {

"type": "string",

"description": "El comando git a ejecutar"

}

},

"required": ["command"]

}

}

# Luego en tu prompt:

"Usa la herramienta `git` para todas las operaciones git. No uses terminal para git."Solución de Problemas - Arreglando lo que Sale Mal

Después de trabajar con innumerables prompts, he identificado los patrones de falla más comunes y sus soluciones.

Problema: Pensar Demasiado

Síntomas: La respuesta es correcta pero tarda una eternidad. El modelo sigue explorando opciones, retrasa la primera llamada a herramienta, narra un viaje tortuoso cuando una respuesta simple estaba disponible.

<efficient_context_spec>

Objetivo: Obtener suficiente contexto rápido y detenerse tan pronto como puedas actuar.

Método:

- Comienza amplio, luego despliégate a subconsultas enfocadas

- En paralelo, lanza 4-8 consultas variadas; lee los mejores 3-5 resultados por consulta

- Desduplica caminos y caché; no repitas consultas

Parada temprana (actúa si alguno):

- Puedes nombrar archivos/símbolos exactos para cambiar

- Puedes reproducir una prueba/lint fallida o tener un locus de error de alta confianza

</efficient_context_spec>

# También agrega una vía rápida para preguntas simples:

<fast_path>

Para conocimiento general o consultas de uso simple que no requieren

comandos, navegación, o llamadas a herramientas:

- Responde inmediatamente y concisamente

- Sin actualizaciones de estado, sin todos, sin resúmenes, sin llamadas a herramientas

</fast_path>Problema: Pensar Poco / Pereza

Síntomas: El modelo no pasó suficiente tiempo razonando antes de producir una respuesta. Respuestas superficiales, casos extremos perdidos, soluciones incompletas.

<self_reflection>

- Internamente puntúa el borrador contra una rúbrica de 5-7 ítems que idees

(claridad, corrección, casos extremos, completitud, latencia)

- Si alguna categoría se queda corta, itera una vez antes de responder

</self_reflection>

# O usa mayor esfuerzo de razonamiento en parámetros de APIProblema: Demasiado Deferente

Síntomas: La IA sigue pidiendo permiso en lugar de tomar acción. Constante "¿Te gustaría que yo..." en lugar de simplemente hacerlo.

<persistence>

- Eres un agente — sigue adelante hasta que la consulta del usuario esté completamente

resuelta antes de terminar tu turno

- Solo termina cuando estés seguro de que el problema está resuelto

- Nunca te detengas o devuelvas el turno cuando encuentres incertidumbre — deduce

el enfoque más razonable y continúa

- No pidas confirmar o aclarar suposiciones — decide qué es

más razonable, procede, y documenta para referencia después

</persistence>Problema: Demasiado Verboso

Síntomas: La IA genera muchos más tokens de los necesarios. Mucho preámbulo, explicación excesiva, resúmenes repetitivos.

# Usa parámetro de verbosidad de API: "low"

# O en prompt:

<output_format>

- Predeterminado: 3-6 oraciones o ≤5 viñetas

- Evita párrafos narrativos largos; prefiere viñetas compactas

- No reformules mi petición a menos que cambie la semántica

- Sin preámbulos como "¡Gran pregunta!" o "Estaría feliz de ayudar"

</output_format>Problema: Demasiadas Llamadas a Herramientas

Síntomas: El modelo dispara herramientas sin mover la respuesta hacia adelante. Llamadas redundantes, explorando tangentes, no usando el contexto eficientemente.

<tool_use_policy>

- Selecciona una herramienta o ninguna; prefiere responder desde contexto cuando sea posible

- Limita las llamadas a herramientas a 2 por solicitud de usuario a menos que nueva información haga

más estrictamente necesario

- Antes de llamar a una herramienta, verifica que realmente necesites la información

</tool_use_policy>Problema: Llamadas a Herramientas Malformadas

Síntomas: Las llamadas a herramientas fallan, producen salida basura, o no coinciden con el formato esperado. A menudo causado por contradicciones en el prompt.

Por favor analiza por qué la llamada a herramienta [nombre_herramienta] está malformada.

1. Revisa el problema de muestra proporcionado para entender el modo de falla

2. Examina el System Prompt y Tool Config cuidadosamente

3. Identifica cualquier ambigüedad, inconsistencia, o fraseo que pudiera

confundir al modelo

4. Para cada causa potencial, explica cómo podría resultar en la

falla observada

5. Proporciona recomendaciones accionables para mejorar el prompt o

configuración de herramientaLa mayoría de los problemas de llamadas a herramientas malformadas provienen de contradicciones entre diferentes secciones del prompt. El modelo quema tokens de razonamiento tratando de reconciliar instrucciones conflictivas en lugar de ayudar.

Optimización de Prompts - El Enfoque Científico

Crear prompts efectivos es una habilidad, pero mejorarlos es una ciencia. Aquí está el enfoque sistemático que uso.

Fallas Comunes de Prompts

Antes de optimizar, entiende qué sale mal típicamente:

"Prefiere biblioteca estándar" luego "usa paquetes externos si simplifican las cosas" - la IA no puede reconciliar estas señales mixtas.

"Apunta a resultados exactos; métodos aproximados están bien cuando no cambian el resultado en la práctica" - el modelo no puede verificar este juicio.

Si necesitas JSON, dilo. Si necesitas viñetas, dilo. No dejes el formato de salida al azar.

Tus instrucciones dicen una cosa pero tus ejemplos muestran algo diferente. La IA sigue ejemplos más que prosa.

El Bucle de Optimización

Ejecuta tu prompt actual múltiples veces y documenta los resultados. Nota patrones tanto en éxitos como en fallas.

Categoriza fallas. ¿Son problemas de corrección? ¿Problemas de formato? ¿Problemas de eficiencia? Cada uno requiere diferentes arreglos.

Cambia una cosa a la vez. Si cambias múltiples cosas, no sabrás qué ayudó.

Ejecuta las mismas pruebas de nuevo. Compara con la línea base. ¿El cambio ayudó, perjudicó, o no tuvo efecto?

Repite hasta que alcances un rendimiento aceptable. Mantén notas sobre lo que funcionó y lo que no.

Migración Entre Modelos

Al migrar prompts a una nueva versión del modelo:

Mejores Prácticas de Migración

- Paso 1: Cambia modelos, no cambies prompts todavía. Prueba el cambio de modelo—no ediciones de prompt.

- Paso 2: Fija el esfuerzo de razonamiento para que coincida con el perfil del modelo anterior.

- Paso 3: Ejecuta evaluaciones para línea base. Si los resultados se ven bien, estás listo para enviar.

- Paso 4: Si hay regresiones, ajusta el prompt con restricciones dirigidas.

- Paso 5: Re-ejecuta evaluaciones después de cada pequeño cambio. Un cambio a la vez.

Manejo de Incertidumbre - Cuando la IA No Sabe

Uno de los mayores riesgos con la IA son las respuestas incorrectas que suenan confiadas. El modelo no sabe lo que no sabe—a menos que le enseñes cómo manejar la incertidumbre.

<uncertainty_handling>

- Si la pregunta es ambigua o subespecificada, explícitamente señala

esto y:

- Haz hasta 1-3 preguntas aclaratorias precisas, O

- Presenta 2-3 interpretaciones plausibles con suposiciones claramente etiquetadas

- Cuando hechos externos pueden haber cambiado recientemente (precios, lanzamientos,

políticas) y no hay herramientas disponibles:

- Responde en términos generales y declara que los detalles pueden haber cambiado

- Nunca fabriques cifras exactas, números de línea, o referencias externas

cuando estés inseguro

- Cuando no estés seguro, prefiere lenguaje como "Basado en el contexto

proporcionado..." en lugar de afirmaciones absolutas

</uncertainty_handling>Autoverificación de Alto Riesgo

Para dominios de alto riesgo, agrega un paso explícito de autoverificación:

<high_risk_self_check>

Antes de finalizar una respuesta en contextos legales, financieros, de cumplimiento, o

sensibles a la seguridad:

- Brevemente re-escanea tu propia respuesta para:

- Suposiciones no declaradas

- Números específicos o afirmaciones no fundamentadas en contexto

- Lenguaje excesivamente fuerte ("siempre", "garantizado", etc.)

- Si encuentras alguno, suavízalos o califícalos y explícitamente declara suposiciones

</high_risk_self_check>El objetivo no es hacer que la IA sea menos confiada—es hacer que sea confiada con precisión. La incertidumbre sobre cosas inciertas es una característica, no un error.

Metaprompting - Usando IA para Mejorar la IA

Aquí está la técnica más meta en mi caja de herramientas: usar IA para mejorar tus prompts. Suena circular, pero es increíblemente efectivo.

Diagnosticando Fallas de Prompt

Eres un ingeniero de prompts encargado de depurar un prompt de sistema.

Se te da:

1) El prompt de sistema actual:

<system_prompt>

[PEGA TU PROMPT AQUÍ]

</system_prompt>

2) Un pequeño conjunto de fallas registradas. Cada registro tiene:

- consulta

- salida_real

- salida_esperada (o descripción del problema)

<failure_traces>

[PEGA EJEMPLOS DE FALLAS]

</failure_traces>

Tus tareas:

1) Identifica modos de falla distintos que ves

2) Para cada modo de falla, cita las líneas específicas del prompt de

sistema que son más probables de causar o reforzarlo

3) Explica cómo esas líneas están dirigiendo al agente hacia el

comportamiento observado

Devuelve tu respuesta en formato estructurado:

failure_modes:

- name: ...

description: ...

prompt_drivers:

- exact_or_paraphrased_line: ...

- why_it_matters: ...Generando Mejoras

Analizaste previamente este prompt de sistema y sus modos de falla.

Prompt de sistema:

<system_prompt>

[PROMPT ORIGINAL]

</system_prompt>

Análisis de modo de falla:

[PEGA DIAGNÓSTICO DEL PASO ANTERIOR]

Por favor propón una revisión quirúrgica que reduzca los problemas observados

mientras preserva los buenos comportamientos.

Restricciones:

- No rediseñes el agente desde cero

- Prefiere ediciones pequeñas y explícitas: aclara reglas conflictivas, elimina

líneas redundantes o contradictorias, ajusta guía vaga

- Haz explícitos los compromisos

- Mantén la estructura y longitud aproximadamente similar al original

Salida:

1) patch_notes: una lista concisa de cambios clave y razonamiento

2) revised_system_prompt: el prompt actualizado completo con ediciones aplicadasAuto-Reflexión para Calidad

Esta técnica es alucinante: instruye a la IA para crear sus propios criterios de evaluación e iterar contra ellos:

<self_reflection>

- Primero, pasa tiempo pensando en una rúbrica hasta que estés seguro

- Piensa profundamente sobre cada aspecto de lo que hace a una solución de

clase mundial. Usa ese conocimiento para crear una rúbrica que tenga 5-7

categorías. Esta rúbrica es crítica para acertar, pero no

me la muestres — esto es solo para tus propósitos.

- Finalmente, usa la rúbrica para pensar internamente e iterar sobre la

mejor solución posible al prompt

- Si tu respuesta no está alcanzando las marcas más altas a través de todas

las categorías en la rúbrica, comienza de nuevo

</self_reflection>Estás pidiendo a la IA que genere criterios de calidad a partir de su conocimiento de excelencia, luego use esos criterios para evaluar y mejorar su propia salida—todo antes de que veas nada. La mejora en la calidad de salida es sustancial.

Plantillas Probadas en Batalla que Puedes Usar Hoy

Completación de Tarea Universal

<context>

[Información de fondo que la IA necesita para entender la situación]

</context>

<task>

[Declaración clara de lo que quieres hecho]

</task>

<requirements>

[Requisitos específicos o restricciones]

</requirements>

<format>

[Cómo quieres que se estructure la salida]

</format>

<examples>

[Opcional: Ejemplos de salida deseada]

</examples>Plantilla de Revisión de Código

<context>

Revisando código para [proyecto/contexto].

La base de código usa [tecnologías/patrones].

</context>

<code_to_review>

[Pega código aquí]

</code_to_review>

<review_criteria>

Enfócate en:

1. Corrección: ¿Hace lo que dice?

2. Legibilidad: ¿Es claro para otros desarrolladores?

3. Rendimiento: ¿Alguna ineficiencia obvia?

4. Seguridad: ¿Alguna vulnerabilidad?

5. Estilo: ¿Coincide con las convenciones de la base de código?

</review_criteria>

<output_format>

Para cada problema encontrado:

- Severidad: [Crítica/Mayor/Menor/Sugerencia]

- Ubicación: [Número de línea o sección]

- Problema: [Qué está mal]

- Arreglo: [Cómo abordarlo]

</output_format>Plantilla de Análisis de Investigación

<research_task>

[Tema o pregunta a investigar]

</research_task>

<methodology>

- Comienza con múltiples búsquedas dirigidas; no confíes en una sola consulta

- Investiga profundamente hasta que tengas suficiente información para una

respuesta precisa y completa

- Agrega búsquedas de seguimiento dirigidas para llenar vacíos o resolver desacuerdos

- Sigue iterando hasta que la búsqueda adicional sea poco probable que cambie

la respuesta

</methodology>

<output_requirements>

- Lidera con una respuesta clara a la pregunta principal

- Apoya con evidencia y citas

- Reconoce limitaciones e incertidumbres

- Proporciona ejemplos concretos donde sea útil

- Incluye contexto relevante para entender implicaciones

</output_requirements>

<citation_format>

[Cómo quieres las fuentes citadas]

</citation_format>Agente de Investigación Web

<core_mission>

Responde la pregunta del usuario completamente y con ayuda, con suficiente evidencia

para que un lector escéptico pueda confiar en ella.

Nunca inventes hechos. Si no puedes verificar algo, dilo claramente.

Predetermina a ser detallado y útil en lugar de corto.

Después de responder la pregunta directa, agrega material adyacente de alto valor

que apoye el objetivo subyacente del usuario sin desviarse del tema.

</core_mission>

<research_rules>

- Comienza con múltiples búsquedas dirigidas; usa búsquedas paralelas

- Nunca confíes en una sola consulta

- Sigue iterando hasta que todo sea verdadero:

- Respondiste cada parte de la pregunta

- Encontraste ejemplos concretos y material adyacente de alto valor

- Encontraste suficientes fuentes para afirmaciones centrales

</research_rules>

<citation_rules>

- Coloca citas después de cada párrafo que contenga afirmaciones no obvias

derivadas de la web

- No inventes citas

- Usa múltiples fuentes para afirmaciones clave cuando sea posible

</citation_rules>

<ambiguity_handling>

- Nunca hagas preguntas aclaratorias a menos que el usuario solicite explícitamente

- Si la consulta es ambigua, declara tu interpretación de mejor suposición, luego

cubre integralmente las intenciones más probables

</ambiguity_handling>El Futuro de la Ingeniería de Prompts

Mientras escribo esto a principios de 2026, la ingeniería de prompts está evolucionando rápidamente. Los modelos se están volviendo más capaces, más dirigibles y más confiables. Algunos predicen que la ingeniería de prompts se volverá obsoleta a medida que la IA mejore en entender la intención. No estoy de acuerdo.

Lo que está cambiando es el nivel de ingeniería de prompts, no su necesidad. Los primeros días requerían prompts elaborados para tareas básicas. Ahora, las tareas básicas funcionan de inmediato, pero los flujos de trabajo agénticos complejos aún requieren prompting sofisticado. La barra está subiendo, no desapareciendo.

La ingeniería de prompts no va a desaparecer—está evolucionando. Las habilidades que importan están cambiando de "cómo hacer que la IA funcione" a "cómo hacer que la IA funcione excelentemente y confiablemente a escala".

Lo Que Viene

Mejores Comportamientos Predeterminados

Los modelos tendrán valores predeterminados más inteligentes, requiriendo menos instrucción explícita para patrones comunes. Los prompts se enfocarán más en la personalización que en la capacidad básica.

Ecosistemas de Herramientas Más Ricos

La IA tendrá acceso a más herramientas de inmediato. La ingeniería de prompts cambiará hacia la orquestación—saber cuándo usar qué, no solo cómo.

Integración Multimodal

Los prompts involucrarán cada vez más imágenes, audio, video y datos estructurados junto con texto. Nuevos patrones surgirán para tareas multimodales.

Complejidad Agéntica

A medida que los agentes manejan tareas más largas y complejas, la ingeniería de prompts se volverá más como diseño de sistemas—arquitectura, no solo instrucciones.

Mi Consejo para el Futuro

Enfócate en los fundamentos. Las técnicas específicas en esta guía evolucionarán, pero los principios subyacentes—comunicación clara, expectativas explícitas, pensamiento estructurado, refinamiento iterativo—son atemporales. Domina esos, y te adaptarás a lo que venga después.

Pensamientos Finales

Hace dos años, pensaba que la IA reemplazaría la necesidad de comunicarse claramente. Estaba completamente equivocado. La IA ha hecho que la comunicación clara sea más valiosa que nunca. Las personas que prosperan con la IA no son las que encontraron palabras mágicas—son las que aprendieron a pensar y expresarse con precisión.

La ingeniería de prompts no se trata realmente de IA. Se trata de ti. Se trata de desarrollar la disciplina para articular lo que realmente quieres, la paciencia para iterar hacia ello, y la humildad para aprender de lo que no funciona.

Si tomas una cosa de esta guía, deja que sea esto: trata cada prompt como una oportunidad para practicar el pensamiento claro. La IA es solo un espejo reflejando de vuelta la claridad—o confusión—de tu propia mente.

La emergencia de la IA no ha hecho obsoleto el conocimiento—ha hecho que la curiosidad sea más poderosa que nunca. Ya no estamos limitados por lo que ya sabemos. Con las herramientas correctas y la voluntad de pensar, la gente común puede abrazar un océano de conocimiento. Independientemente de la profesión. Independientemente de la edad. Espero compartir este viaje con amigos de todo el mundo. Juntos, demos la bienvenida a este nuevo mundo. Juntos, crezcamos.

Discusión

0 comentariosDejar un comentario

¡Sé el primero en compartir tu opinión!