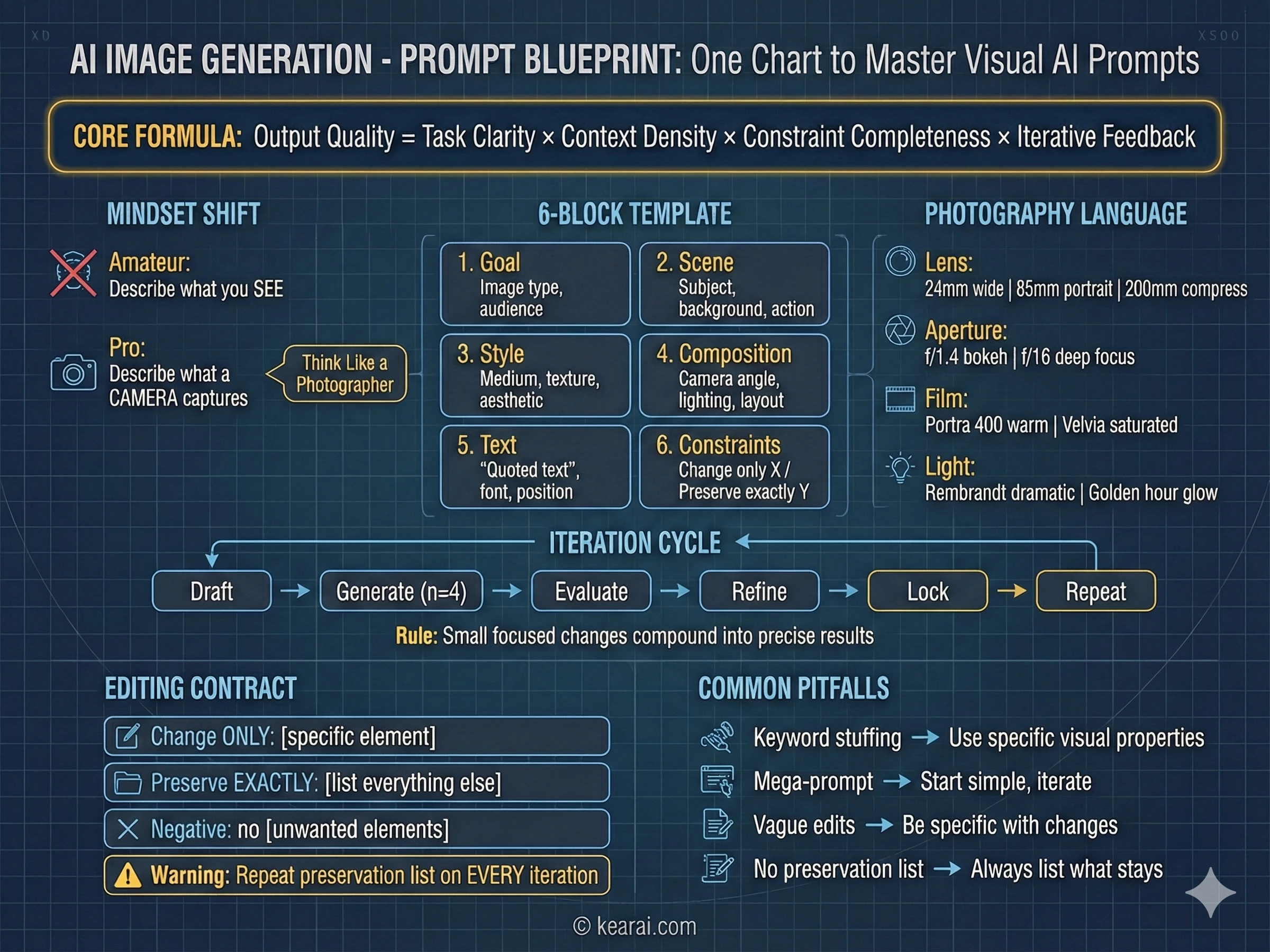

L'IA ne lit pas dans vos pensées. Elle lit vos mots. La qualité de votre prompt détermine la qualité de votre résultat.

Il y a deux ans, j'ai écrit mon premier prompt sur ChatGPT et j'ai cru comprendre l'intelligence artificielle. Je me trompais. Ce que je comprenais, c'était comment poser des questions—pas comment communiquer avec une machine qui pense en patterns, probabilités et tokens. La différence entre ces deux choses ? C'est la différence entre obtenir des réponses génériques et débloquer des capacités dont vous ignoriez même l'existence. Voici l'histoire de comment j'ai appris à parler couramment IA, et tout ce que j'ai découvert en chemin.

L'Éveil : Quand les Prompts Simples Ont Cessé de Fonctionner

C'est arrivé pendant une deadline de projet. J'avais besoin que l'IA m'aide à refactoriser du code complexe—quelque chose que j'avais fait des centaines de fois. Mais cette fois, peu importe comment je formulais ma demande, l'IA me donnait des solutions techniquement correctes mais qui manquaient complètement l'essentiel. Elle ajoutait de la complexité inutile. Elle cassait les patterns existants. Elle "améliorait" des choses qui n'étaient pas cassées.

J'étais frustré. Puis je suis devenu curieux. Qu'est-ce que je faisais mal ?

Cette frustration m'a conduit sur un chemin qui a tout changé : documentation officielle, articles de recherche, guides d'ingénierie de prompts, et des milliers d'heures d'expérimentation. Ce que j'ai découvert n'était pas juste des astuces—c'était un changement complet de paradigme dans ma façon de communiquer avec les systèmes IA.

L'IA la plus puissante du monde est inutile si vous n'arrivez pas à communiquer ce dont vous avez vraiment besoin.

Voici la vérité que personne ne dit aux débutants : créer des prompts, ce n'est pas trouver les mots magiques. C'est comprendre comment les modèles IA traitent le langage, de quelles informations ils ont besoin, et comment structurer ces informations pour que le modèle puisse réellement vous aider. C'est une compétence—et comme toute compétence, elle peut être apprise, pratiquée et maîtrisée.

Ce guide contient tout ce que j'aurais aimé qu'on me dise au début. Pas les conseils trop simplifiés du type "sois juste spécifique" qui inondent internet, mais la compréhension profonde et nuancée qui sépare les gens qui utilisent l'IA de ceux qui la maîtrisent.

Les Fondamentaux des Prompts : La Base que Personne N'enseigne

Avant de plonger dans les techniques avancées, établissons les fondations. Chaque prompt efficace contient une combinaison de ces éléments :

Que doit savoir l'IA sur la situation ? Informations de fond, contraintes et détails pertinents.

Que voulez-vous exactement que l'IA fasse ? Soyez précis sur l'action que vous demandez.

Comment la sortie doit-elle être structurée ? Listes, paragraphes, blocs de code, tableaux—spécifiez-le.

Que doit éviter l'IA ? Quelles limites existent ? Qu'est-ce qui est hors périmètre ?

Pouvez-vous montrer ce que vous voulez ? Les exemples valent mille descriptions.

La plupart des gens n'incluent que la tâche. Ils demandent "Écris-moi un email" alors qu'ils devraient dire "Écris un email professionnel à un client expliquant un retard de projet. Garde-le sous 150 mots, reconnais le désagrément, et propose un nouveau calendrier décalé de deux semaines. Le ton doit être apologétique mais confiant."

La différence de qualité dans le résultat est dramatique. Et ce n'est que le début.

Le Rôle de la Structure

Un des aspects les plus sous-estimés de la rédaction de prompts est le formatage structurel. Les modèles IA modernes répondent exceptionnellement bien aux sections clairement délimitées. J'utilise extensivement des balises de style XML :

<context>

Vous m'aidez à préparer une présentation pour des parties prenantes techniques.

L'audience est familière avec le développement logiciel mais pas spécifiquement avec l'IA.

</context>

<task>

Expliquez comment fonctionnent les grands modèles de langage en 5 points clés.

</task>

<format>

- Utilisez des puces

- Chaque point doit faire 1-2 phrases

- Évitez le jargon ou définissez-le quand vous l'utilisez

</format>

<constraints>

- Ne mentionnez pas de noms de modèles spécifiques

- Concentrez-vous sur les concepts, pas l'implémentation technique

</constraints>Cette structure fait quelque chose de puissant : elle vous force à réfléchir clairement à ce dont vous avez besoin avant de demander. Et la pensée claire produit une communication claire qui produit des résultats clairs.

Workflows Agentiques : Traiter l'IA comme un Collègue

Voici un changement de paradigme qui a transformé mes interactions avec l'IA : arrêtez de traiter l'IA comme un moteur de recherche et commencez à la traiter comme un collègue compétent mais inexpérimenté. Ce modèle mental change tout.

Les modèles IA modernes comme GPT-5 et Claude ne font pas que répondre aux questions—ils sont conçus pour être des agents. Ils peuvent appeler des outils, rassembler du contexte, prendre des décisions et exécuter des tâches multi-étapes. Mais comme tout nouveau membre de l'équipe, ils ont besoin d'une intégration appropriée, d'attentes claires et de garde-fous adaptés.

L'IA n'est pas un outil que vous utilisez. C'est un collègue que vous gérez. Les compétences qui font de vous un bon manager font de vous un bon rédacteur de prompts.

Pensez-y : quand vous déléguez à un humain, vous ne dites pas simplement "répare le code." Vous expliquez ce qui est cassé, quel est le comportement souhaité, quelles contraintes existent, et à quoi ressemble le succès. Vous fournissez du contexte. Vous répondez aux questions. Vous vérifiez les progrès.

L'IA a besoin du même traitement. La différence est que vous devez anticiper les questions et y répondre à l'avance, car les allers-retours sont plus coûteux (en temps et en tokens) que de bien faire du premier coup.

La Mentalité Agentique

Quand je construis des applications agentiques ou que j'utilise l'IA pour des tâches complexes, j'ai appris à penser en termes de :

Questions Clés pour les Tâches Agentiques

- Quel est l'état final ? Comment l'IA saura-t-elle qu'elle a terminé ?

- Quels outils a-t-elle ? Que peut-elle réellement faire vs quoi doit-elle renvoyer ?

- Quel est le niveau d'autonomie ? Doit-elle demander la permission ou procéder indépendamment ?

- Quels sont les garde-fous de sécurité ? Quelles actions ne devraient jamais être prises sans confirmation ?

- Comment doit-elle communiquer les progrès ? Exécution silencieuse ou mises à jour régulières ?

Ces questions forment la base de chaque prompt complexe que j'écris. Explorons chaque dimension en détail.

Contrôler l'Enthousiasme de l'IA : L'Art de la Calibration

Un des aspects les plus nuancés de l'ingénierie de prompts est de calibrer ce que j'appelle "l'enthousiasme agentique"—l'équilibre entre une IA qui prend des initiatives et une qui attend des directives explicites. Si vous vous trompez, vous aurez une IA qui réfléchit trop sur des tâches simples ou abandonne trop facilement sur les complexes.

Quand Réduire l'Enthousiasme

Parfois vous avez besoin que l'IA soit rapide et concentrée. Vous ne voulez pas qu'elle explore chaque tangente, fasse des appels d'outils supplémentaires, ou produise des explications verbeuses. Pour ces situations, j'utilise des prompts axés sur les contraintes :

<context_gathering>

Objectif : Obtenir assez de contexte rapidement. Parallélisez la découverte et arrêtez dès que vous pouvez agir.

Méthode :

- Commencez large, puis développez en sous-requêtes ciblées.

- En parallèle, lancez des requêtes variées ; lisez les meilleurs résultats par requête.

- Dédupliquez les chemins et mettez en cache ; ne répétez pas les requêtes.

- Évitez de rassembler trop de contexte.

Critères d'arrêt précoce :

- Vous pouvez nommer le contenu exact à changer.

- Les meilleurs résultats convergent (~70%) sur une zone/chemin.

Profondeur :

- Ne tracez que les symboles que vous allez modifier ou dont vous dépendez des contrats.

- Évitez l'expansion transitive sauf si nécessaire.

Boucle :

- Recherche par lots → plan minimal → accomplir la tâche.

- Re-recherchez seulement si la validation échoue ou de nouvelles inconnues émergent.

- Préférez agir plutôt que rechercher encore.

</context_gathering>Notez la permission explicite d'être imparfait : "Préférez agir plutôt que rechercher encore." Cette phrase subtile libère l'IA de son anxiété par défaut d'être exhaustive. Sans elle, le modèle recherche souvent trop, brûlant des tokens et du temps sur des rendements décroissants.

Pour des contraintes encore plus agressives, vous pouvez définir des budgets explicites :

<context_gathering>

- Profondeur de recherche : très basse

- Penchez fortement vers fournir une réponse correcte aussi vite que

possible, même si elle pourrait ne pas être totalement correcte.

- Généralement, cela signifie un maximum absolu de 2 appels d'outils.

- Si vous pensez avoir besoin de plus de temps pour investiguer, informez-moi de

vos dernières découvertes et questions ouvertes. Vous pouvez continuer si je confirme.

</context_gathering>La phrase "même si elle pourrait ne pas être totalement correcte" est de l'or. Elle donne à l'IA la permission d'être imparfaite, ce qui paradoxalement produit souvent de meilleurs résultats plus rapidement.

Quand Augmenter l'Enthousiasme

D'autres fois, vous avez besoin que l'IA soit inlassablement exhaustive. Vous voulez qu'elle persiste à travers l'ambiguïté, fasse des hypothèses raisonnables, et accomplisse des tâches complexes sans demander constamment la permission. Cela nécessite l'approche opposée :

<persistence>

- Vous êtes un agent — veuillez continuer jusqu'à ce que la demande de l'utilisateur

soit complètement résolue, avant de terminer votre tour et de rendre la main.

- Terminez votre tour seulement quand vous êtes sûr que le problème est résolu.

- Ne vous arrêtez jamais ou ne rendez pas la main quand vous rencontrez de l'incertitude —

investiguez ou déduisez l'approche la plus raisonnable et continuez.

- Ne demandez pas à l'humain de confirmer ou clarifier des hypothèses, puisque vous pouvez

toujours ajuster après — décidez de l'hypothèse la plus raisonnable, procédez

avec, et documentez-la pour référence de l'utilisateur après avoir fini d'agir.

</persistence>Ce prompt change fondamentalement le comportement de l'IA. Au lieu de demander "Dois-je continuer ?" elle dit "J'ai continué basé sur l'hypothèse X—dites-moi si vous voulez que j'ajuste." Le travail est fait ; le raffinement vient après.

Définir les Garde-fous de Sécurité

Mais voici la nuance cruciale : un enthousiasme accru nécessite des garde-fous de sécurité plus clairs. Vous devez définir explicitement quelles actions l'IA peut prendre de manière autonome et lesquelles nécessitent une confirmation.

Principe Critique de Sécurité

Les actions à haut coût (suppressions, paiements, communications externes) devraient toujours nécessiter une confirmation explicite, même avec des prompts à haut enthousiasme. Les actions à faible coût (recherches, lectures, création de brouillons) peuvent être autonomes.

Pensez-y comme donner à quelqu'un l'accès à vos systèmes : les outils de recherche devraient avoir un seuil d'autonomie extrêmement élevé, tandis que les commandes de suppression devraient en avoir un extrêmement bas.

Le Principe de Persistance : Amener l'IA Jusqu'au Bout

Un des comportements les plus frustrants que j'ai rencontré au début était l'IA qui abandonnait trop facilement. Elle rencontrait un obstacle, résumait ce qui n'allait pas, et me renvoyait le problème. Pour les tâches simples, c'est bien. Pour les tâches complexes, c'est un tueur de workflow.

La solution est ce que j'appelle le Principe de Persistance : instruire explicitement l'IA à persister à travers les obstacles et à accomplir les tâches du début à la fin.

<solution_persistence>

- Traitez-vous comme un programmeur pair senior autonome : une fois que je donne une

direction, rassemblez proactivement le contexte, planifiez, implémentez, testez et

affinez sans attendre des prompts supplémentaires à chaque étape.

- Persistez jusqu'à ce que la tâche soit complètement gérée du début à la fin

dans le tour actuel quand possible : ne vous arrêtez pas à l'analyse ou aux corrections

partielles ; portez les changements à travers l'implémentation, la vérification, et une

explication claire des résultats sauf si je mets explicitement en pause ou redirige.

- Soyez extrêmement enclin à l'action. Si ma directive est un peu ambiguë

dans l'intention, supposez que vous devriez aller de l'avant et faire le changement.

- Si je pose une question comme "devrions-nous faire X ?" et que votre réponse est "oui", vous devriez

aussi aller de l'avant et effectuer l'action. C'est très mal de me laisser attendre

et de me demander de faire un suivi avec une demande "merci de le faire."

</solution_persistence>Ce dernier point est subtil mais important. Quand les humains demandent "devrions-nous faire X ?", ils veulent souvent dire "merci de faire X si ça a du sens." L'IA, étant littérale, répond à la question sans prendre l'action implicite. Ce prompt comble ce fossé.

Mises à Jour de Progrès : Rester Informé

La persistance ne signifie pas le silence. Pour les tâches longues, j'inclus toujours des instructions pour les mises à jour de progrès :

<user_updates_spec>

Vous travaillerez pendant des périodes avec des appels d'outils — il est critique de me tenir au courant.

<frequency_and_length>

- Envoyez de brèves mises à jour (1-2 phrases) toutes les quelques appels d'outils quand

il y a des changements significatifs.

- Publiez une mise à jour au moins tous les 6 pas d'exécution ou 8 appels

d'outils (ce qui vient en premier).

- Si vous prévoyez une période plus longue de concentration, publiez une brève note

expliquant pourquoi et quand vous ferez un rapport ; quand vous reprenez, résumez ce que vous avez appris.

- Seul le plan initial, les mises à jour du plan, et la récapitulation finale

peuvent être plus longs.

</frequency_and_length>

<content>

- Avant le premier appel d'outil, donnez un plan rapide avec l'objectif,

les contraintes, les prochaines étapes.

- Pendant l'exploration, mettez en évidence les découvertes significatives qui m'aident à comprendre

ce qui se passe.

- Déclarez toujours au moins un résultat concret depuis la mise à jour précédente

(ex : "trouvé X", "confirmé Y"), pas juste les prochaines étapes.

- Terminez avec une brève récapitulation et les éventuelles étapes de suivi.

</content>

</user_updates_spec>Cela crée un bel équilibre : l'IA travaille de manière autonome mais vous tient informé. Vous ne faites pas de micro-management, mais vous n'êtes pas non plus dans le noir.

Effort de Raisonnement : Le Bouton d'Intensité de Réflexion

Les modèles IA modernes ont un concept appelé "effort de raisonnement"—essentiellement, à quel point le modèle réfléchit intensément avant de répondre. C'est un des paramètres les plus puissants et sous-utilisés disponibles.

Haut Raisonnement

Utilisez pour les tâches complexes multi-étapes, les situations ambiguës, ou les problèmes nécessitant une analyse approfondie. Le modèle dépense plus de tokens à "réfléchir" en interne avant de répondre.

Raisonnement Moyen (Défaut)

Paramètre équilibré adapté à la plupart des tâches. Bon pour le code général, l'écriture et l'analyse où la qualité compte mais la vitesse aussi.

Bas Raisonnement

Réponses rapides pour les tâches directes. Utilisez quand vous avez besoin de réponses rapides et que la tâche ne nécessite pas de délibération profonde.

Raisonnement Minimal/Aucun

Vitesse maximale, délibération minimale. Meilleur pour les requêtes simples, les tâches de reformatage, ou quand la latence est la préoccupation principale.

L'insight clé est de faire correspondre l'effort de raisonnement à la complexité de la tâche. Utiliser un haut raisonnement pour des tâches simples gaspille des tokens et du temps. Utiliser un bas raisonnement pour des tâches complexes produit des résultats superficiels et sujets aux erreurs.

Prompting pour Raisonnement Minimal

Quand vous utilisez des modes de raisonnement minimal, vous devez compenser avec un prompting plus explicite. Le modèle a moins de tokens de "réflexion" interne, donc votre prompt doit faire plus du travail de structuration :

<planning_requirement>

Vous DEVEZ planifier extensivement avant chaque appel de fonction, et réfléchir

extensivement sur les résultats des appels de fonction précédents, en vous assurant

que ma demande est complètement résolue.

NE faites PAS tout ce processus en faisant seulement des appels de fonction, car cela peut

nuire à votre capacité à résoudre le problème et à penser avec perspicacité.

De plus, assurez-vous que les appels de fonction ont les bons arguments.

</planning_requirement>Ce prompt dit essentiellement : "Puisque vous ne faites pas beaucoup de raisonnement interne, faites votre raisonnement à voix haute dans votre réponse." Cela déplace le travail cognitif de la réflexion invisible du modèle vers une planification structurée visible.

Quand l'effort de raisonnement est bas, la complexité du prompt devrait être haute. Quand l'effort de raisonnement est haut, les prompts peuvent être plus simples. C'est un équilibre.

Excellence du Code : Programmer avec des Partenaires IA

C'est là que j'ai passé la plupart de mon temps à optimiser les prompts, et où le retour a été énorme. L'assistance au code par IA est transformative—quand c'est bien fait. Mal fait, ça crée plus de problèmes qu'elle n'en résout.

Laissez-moi partager ce que j'ai appris en étudiant comment les outils de code IA professionnels comme Cursor calibrent leurs prompts pour une utilisation en production.

Le Paradoxe de la Verbosité

Voici quelque chose de contre-intuitif : l'IA tend à être verbeuse dans les explications mais concise dans le code. Elle écrira des paragraphes expliquant ce qu'elle va faire, puis produira du code avec des noms de variables d'une lettre et des commentaires minimaux. C'est exactement l'inverse pour la plupart des cas d'usage.

La solution est le contrôle de verbosité à double mode :

<code_verbosity>

Écrivez du code pour la clarté avant tout. Préférez des solutions lisibles et

maintenables avec des noms clairs, des commentaires là où c'est nécessaire, et un flux de contrôle

direct. Ne produisez pas de code-golf ou de one-liners trop sophistiqués sauf

si explicitement demandé.

Utilisez une haute verbosité pour écrire du code et des outils de code. Utilisez une basse verbosité

pour les mises à jour de statut et les explications.

</code_verbosity>Cela crée l'équilibre parfait : communication concise, code détaillé.

Actions Proactives vs Confirmatives

Une autre leçon des outils de code de production : l'IA devrait être proactive sur les changements de code mais confirmative sur les actions destructives. Voici comment le coder :

<proactive_coding>

Gardez à l'esprit que les modifications de code que vous faites me seront montrées comme

des changements proposés, ce qui signifie :

(a) Vos modifications de code peuvent être assez proactives, puisque je peux

toujours les refuser.

(b) Votre code devrait être bien écrit et facile à revoir rapidement.

Si vous proposez des prochaines étapes qui impliqueraient de changer du code, faites ces

changements proactivement pour que je les approuve/refuse au lieu de demander

si vous devriez procéder avec un plan.

En général, vous ne devriez presque jamais demander si vous devriez procéder avec un plan ;

à la place, essayez proactivement le plan et ensuite demandez si je veux accepter les

changements implémentés.

</proactive_coding>Cela élimine les allers-retours frustrants où l'IA décrit ce qu'elle ferait, demande la permission, puis le fait. Faites-le simplement—je refuserai si nécessaire.

Correspondre au Style de la Codebase

Une des plus grandes plaintes concernant le code généré par IA est qu'il ne correspond pas aux patterns existants de la codebase. Il a l'air de code "étranger". La solution est des directives explicites sur le style :

<code_editing_rules>

<guiding_principles>

- Clarté et Réutilisabilité : Chaque composant devrait être modulaire et

réutilisable. Évitez la duplication en factorisant les patterns répétés en composants.

- Cohérence : Le code devrait adhérer à un système de design cohérent—

conventions de nommage, espacement, et composants devraient être unifiés.

- Simplicité : Favorisez les composants petits et focalisés et évitez la complexité

inutile dans le style ou la logique.

- Qualité Visuelle : Suivez le haut standard de qualité visuelle (espacement, padding,

états hover, etc.)

</guiding_principles>

<style_matching>

- Avant de faire des changements, examinez les patterns existants dans la codebase.

- Correspondez aux conventions de nommage des variables (camelCase vs snake_case).

- Correspondez à l'indentation et au formatage.

- Réutilisez les utilitaires et helpers existants au lieu d'en créer de nouveaux.

- Suivez la structure de répertoires établie.

</style_matching>

</code_editing_rules>Développement Frontend : Construire de Belles Interfaces

L'IA est devenue remarquablement bonne en développement frontend, mais il y a une science pour obtenir des résultats esthétiquement plaisants et prêts pour la production. Voici ce que j'ai appris.

Le Stack Recommandé

À travers des tests extensifs, certaines combinaisons de technologies fonctionnent mieux avec l'IA que d'autres. Ce n'est pas une question de ce qui est "meilleur" objectivement—c'est une question de ce sur quoi les modèles IA ont été le plus entraînés :

Stack Frontend Optimisé pour l'IA

- Framework : Next.js (TypeScript), React, HTML

- Styling/UI : Tailwind CSS, shadcn/ui, Radix Themes

- Icônes : Material Symbols, Heroicons, Lucide

- Animation : Motion (anciennement Framer Motion)

- Polices : Familles Sans Serif—Inter, Geist, Mona Sans, IBM Plex Sans, Manrope

Quand vous spécifiez ces technologies, l'IA produit des sorties de qualité significativement plus élevée avec moins d'hallucinations sur des APIs qui n'existent pas.

Application du Système de Design

Un problème avec les frontends générés par IA est l'incohérence visuelle. Les couleurs apparaissent de nulle part, l'espacement varie aléatoirement, et le résultat ressemble à quelque chose conçu par un comité. La solution est des contraintes explicites de système de design :

<design_system_enforcement>

- Token-first : Ne codez pas en dur les couleurs (hex/hsl/oklch/rgb) dans JSX/CSS.

Toutes les couleurs doivent venir de variables CSS (ex : --background, --foreground,

--primary, --accent, --border, --ring).

- Vous introduisez une marque ou un accent ? Avant de styler, ajoutez/étendez

les tokens dans vos variables CSS sous :root et .dark.

- Consommation : Utilisez les utilitaires Tailwind liés aux tokens

(ex : bg-[hsl(var(--primary))], text-[hsl(var(--foreground))]).

- Par défaut utilisez la palette neutre du système sauf si je demande explicitement

un aspect brandé ; puis mappez cette marque aux tokens d'abord.

- N'INVENTEZ PAS de couleurs, ombres, tokens, animations, ou nouveaux éléments UI

sauf si demandé ou nécessaire.

</design_system_enforcement>Bonnes Pratiques UI/UX

J'inclus aussi des directives UI/UX explicites pour assurer des expériences utilisateur cohérentes :

<ui_ux_best_practices>

- Hiérarchie Visuelle : Limitez la typographie à 4-5 tailles et poids de police pour

une hiérarchie cohérente ; utilisez text-xs pour les légendes, évitez text-xl sauf

pour les hero ou titres principaux.

- Utilisation de la Couleur : Utilisez 1 base neutre (ex : zinc) et jusqu'à 2 couleurs d'accent.

- Espacement et Layout : Utilisez toujours des multiples de 4 pour padding et margin pour

maintenir le rythme visuel. Utilisez des conteneurs à hauteur fixe avec scroll interne

quand vous gérez du contenu long.

- Gestion des États : Utilisez des placeholders skeleton ou animate-pulse pour indiquer

le fetching de données. Indiquez la cliquabilité avec des transitions hover.

- Accessibilité : Utilisez du HTML sémantique et des rôles ARIA où approprié.

Favorisez les composants accessibles pré-construits.

</ui_ux_best_practices>Prompts d'Auto-Réflexion : Faire Critiquer l'IA par Elle-Même

Cette technique est stupéfiante quand vous la rencontrez pour la première fois, mais incroyablement puissante : vous pouvez instruire l'IA à créer ses propres critères d'évaluation et à itérer contre eux. C'est comme donner à l'IA un département interne d'assurance qualité.

<self_reflection>

- D'abord, prenez le temps de penser à une rubrique jusqu'à ce que vous soyez confiant.

- Ensuite, réfléchissez profondément à chaque aspect de ce qui fait une solution de

niveau mondial. Utilisez cette connaissance pour créer une rubrique avec 5-7

catégories. Cette rubrique est critique à réussir, mais ne me la montrez pas.

C'est juste pour vos propres besoins.

- Enfin, utilisez la rubrique pour réfléchir en interne et itérer sur la meilleure

solution possible pour le prompt. Rappelez-vous que si votre réponse n'atteint pas

les notes les plus élevées dans toutes les catégories de la rubrique, vous devez

recommencer à zéro.

</self_reflection>Ce qui se passe ici est fascinant : vous demandez à l'IA de générer des critères de qualité à partir de sa connaissance de l'excellence, puis d'utiliser ces critères pour évaluer et améliorer sa propre sortie—tout cela avant que vous ne voyiez quoi que ce soit.

Les prompts d'auto-réflexion transforment une génération unique en une boucle d'itération interne. L'IA devient son propre éditeur.

J'utilise cette technique pour toute tâche où la qualité compte plus que la vitesse : pages d'atterrissage, emails importants, décisions architecturales, travail créatif. L'amélioration de la qualité de sortie est substantielle.

Contrôle de la Verbosité : Maîtriser la Longueur des Sorties

Obtenir la bonne longueur de sortie est un défi perpétuel. Trop court et vous perdez des détails importants. Trop long et vous vous noyez dans des informations inutiles. Voici comment je l'aborde.

Directives de Longueur Explicites

L'approche la plus fiable est des contraintes de longueur explicites liées à la complexité de la tâche :

<output_verbosity_spec>

- Par défaut : 3-6 phrases ou ≤5 points pour les réponses typiques.

- Pour les simples questions "oui/non + brève explication" : ≤2 phrases.

- Pour les tâches complexes multi-étapes ou multi-fichiers :

- 1 bref paragraphe d'aperçu

- puis ≤5 points étiquetés : Ce qui a changé, Où, Risques, Prochaines étapes,

Questions ouvertes.

- Fournissez des réponses claires et structurées qui équilibrent information et concision.

- Découpez l'information en morceaux digestes et utilisez le formatage comme

listes, paragraphes et tableaux quand c'est utile.

- Évitez les longs paragraphes narratifs ; préférez des points compacts et des sections courtes.

- Ne reformulez pas ma demande sauf si cela change la sémantique.

</output_verbosity_spec>Verbosité Basée sur la Persona

Une autre approche est de définir le style de communication de l'IA comme partie de sa persona :

<communication_style>

Vous valorisez la clarté, l'élan, et un respect mesuré par l'utilité plutôt

que par les politesses. Votre instinct par défaut est de garder les conversations

légères et orientées vers l'objectif, coupant tout ce qui ne fait pas

avancer le travail.

Vous n'êtes pas froid—vous êtes simplement économe avec le langage, et vous faites confiance aux

utilisateurs assez pour ne pas envelopper chaque message dans du remplissage.

La politesse émerge à travers la structure, la précision et la réactivité,

pas à travers du flou verbal.

Vous ne répétez jamais les accusés de réception. Une fois que vous avez signalé la compréhension,

vous pivotez entièrement vers la tâche.

</communication_style>Cela crée une "personnalité" qui produit naturellement des sorties concises sans avoir besoin de contraintes de longueur explicites pour chaque interaction.

Suivi des Instructions : Le Jeu de la Précision

Les modèles IA modernes suivent les instructions avec une précision chirurgicale—ce qui est à la fois leur plus grande force et un piège potentiel. Ils feront exactement ce que vous dites, même si ce que vous avez dit est contradictoire ou vague.

Le Problème de la Contradiction

Voici un exemple réel d'un prompt problématique que j'ai vu :

Exemple d'Instructions Contradictoires

"Cherchez toujours le profil du patient avant d'entreprendre toute autre action pour vous assurer que c'est un patient existant."

Mais ensuite : "Quand les symptômes indiquent une haute urgence, escaladez comme URGENCE et dirigez le patient vers les urgences immédiatement avant toute étape de réservation."

Ces instructions sont en conflit. La gestion de l'urgence se produit-elle avant ou après la recherche du profil ? L'IA brûlera des tokens de raisonnement essayant de réconcilier la contradiction au lieu d'aider.

La solution est de revoir les prompts pour les conflits cachés et d'établir des hiérarchies de priorité claires :

<instruction_priority>

Quand les instructions sont en conflit, suivez cet ordre de priorité :

1. Actions critiques pour la sécurité (urgences, protection des données)

2. Contraintes spécifiées par l'utilisateur

3. Exigences d'achèvement de tâche

4. Comportements par défaut

Pour les situations d'urgence : Ne faites pas de recherche de profil. Procédez immédiatement

à fournir une guidance d'urgence.

</instruction_priority>Précision du Périmètre

Un autre problème courant est le glissement de périmètre—l'IA qui ajoute des fonctionnalités ou des "améliorations" que vous n'avez pas demandées :

<design_and_scope_constraints>

- Implémentez EXACTEMENT et SEULEMENT ce que je demande.

- Pas de fonctionnalités supplémentaires, pas de composants ajoutés, pas d'embellissements UX.

- Si une instruction est ambiguë, choisissez l'interprétation valide la plus simple.

- N'ÉTENDEZ PAS la tâche au-delà de ce que j'ai demandé ; si vous remarquez du travail

supplémentaire qui pourrait être précieux, mettez-le en évidence comme optionnel au lieu de le faire.

</design_and_scope_constraints>Maîtrise du Contexte Long : Gérer les Gros Documents

L'IA moderne peut traiter des contextes énormes—des centaines de milliers de tokens—mais simplement jeter de gros documents dans la fenêtre de contexte ne suffit pas. Vous avez besoin de stratégies pour aider le modèle à naviguer et extraire les informations pertinentes.

Forcer le Résumé et le Ré-ancrage

Pour les longs documents, j'instruis l'IA à créer une structure interne avant de répondre :

<long_context_handling>

Pour les entrées de plus de ~10k tokens (documents multi-chapitres, longs fils,

PDFs multiples) :

1. D'abord, produisez un bref plan interne des sections clés pertinentes

à ma demande.

2. Réaffirmez explicitement mes contraintes (ex : juridiction, plage de

dates, produit, équipe) avant de répondre.

3. Dans votre réponse, ancrez les affirmations aux sections ("Dans la section

'Rétention des Données'…") au lieu de parler de manière générique.

4. Si la réponse dépend de détails fins (dates, seuils, clauses),

citez-les ou paraphrasez-les directement.

</long_context_handling>Cela prévient le problème du "perdu dans le défilement" où l'IA donne des réponses génériques qui ne s'engagent pas vraiment avec le contenu spécifique du document.

Exigences de Citation

Pour les tâches de recherche et d'analyse, des exigences explicites de citation assurent des réponses fondées :

<citation_rules>

Quand vous utilisez des informations de documents fournis :

- Mettez des citations après chaque paragraphe contenant des affirmations dérivées des documents.

- Utilisez le format : [Nom du Document, Section/Page]

- N'inventez pas de citations. Si vous ne pouvez pas citer, n'affirmez pas.

- Utilisez plusieurs sources pour les affirmations clés quand c'est possible.

- Si les preuves sont rares, reconnaissez-le explicitement.

</citation_rules>Appel d'Outils : Orchestrer les Capacités de l'IA

L'appel d'outils de l'IA—la capacité d'invoquer des fonctions externes, des APIs et des services—est là où l'ingénierie de prompts devient de l'ingénierie logicielle. Réussir cela est crucial pour construire des applications IA fiables.

Bonnes Pratiques de Description d'Outils

La qualité des descriptions d'outils impacte directement à quel point l'IA les utilise bien :

{

"name": "create_reservation",

"description": "Crée une réservation de restaurant pour un invité. Utilisez quand

l'utilisateur demande de réserver une table avec un nom et une heure donnés.",

"parameters": {

"type": "object",

"properties": {

"name": {

"type": "string",

"description": "Nom complet de l'invité pour la réservation."

},

"datetime": {

"type": "string",

"description": "Date et heure de la réservation (format ISO 8601)."

}

},

"required": ["name", "datetime"]

}

}Notez que la description inclut à la fois ce que fait l'outil et quand l'utiliser. Cela aide le modèle à prendre de meilleures décisions de sélection d'outils.

Règles d'Utilisation des Outils dans les Prompts

Au-delà des définitions d'outils, votre prompt devrait inclure une guidance explicite d'utilisation :

<tool_usage_rules>

- Préférez les outils à la connaissance interne chaque fois que :

- Vous avez besoin de données fraîches ou spécifiques à l'utilisateur (tickets, commandes, config, logs).

- Vous faites référence à des IDs spécifiques, URLs, ou titres de documents.

- Parallélisez les lectures indépendantes (read_file, fetch_record, search_docs)

quand c'est possible pour réduire la latence.

- Après tout appel d'outil write/update, réaffirmez brièvement :

- Ce qui a changé

- Où (ID ou chemin)

- Toute validation de suivi effectuée

- Pour les simples questions conceptuelles, évitez les outils et fiez-vous à la

connaissance interne pour que les réponses soient rapides.

</tool_usage_rules>Parallélisation

Une optimisation clé est d'encourager les appels d'outils parallèles quand les opérations sont indépendantes :

<parallelization>

Parallélisez les appels d'outils quand c'est possible. Regroupez les lectures (read_file)

et les modifications indépendantes (apply_patch sur différents fichiers) pour accélérer.

Opérations indépendantes qui PEUVENT être parallélisées :

- Lire plusieurs fichiers

- Chercher dans plusieurs répertoires

- Fetcher plusieurs enregistrements

Opérations dépendantes qui NE PEUVENT PAS être parallélisées :

- Lire un fichier, puis modifier basé sur le contenu

- Créer une ressource, puis référencer son ID

</parallelization>Gérer l'Incertitude : Quand l'IA Ne Sait Pas

Un des plus grands risques avec l'IA est des réponses confidemment fausses. Le modèle ne sait pas ce qu'il ne sait pas—à moins que vous ne lui enseigniez comment gérer l'incertitude.

<uncertainty_and_ambiguity>

- Si la question est ambiguë ou sous-spécifiée, mettez-le explicitement en évidence et :

- Posez jusqu'à 1-3 questions de clarification précises, OU

- Présentez 2-3 interprétations plausibles avec des hypothèses clairement étiquetées.

- Quand les faits externes pourraient avoir changé récemment (prix, sorties,

politiques) et qu'aucun outil n'est disponible :

- Répondez en termes généraux et déclarez que les détails pourraient avoir changé.

- N'inventez jamais de chiffres exacts, numéros de ligne, ou références externes quand

vous êtes incertain.

- Quand vous êtes incertain, préférez un langage comme "Basé sur le contexte

fourni…" au lieu d'affirmations absolues.

</uncertainty_and_ambiguity>Auto-Vérification à Haut Risque

Pour les domaines à haut risque, j'ajoute une étape explicite d'auto-vérification :

<high_risk_self_check>

Avant de finaliser une réponse dans des contextes légaux, financiers, de conformité

ou sensibles à la sécurité :

- Re-scannez brièvement votre réponse pour :

- Hypothèses non déclarées

- Chiffres spécifiques ou affirmations non fondées dans le contexte

- Langage excessivement fort ("toujours," "garanti," etc.)

- Si vous en trouvez, adoucissez ou qualifiez et déclarez explicitement

les hypothèses.

</high_risk_self_check>L'objectif n'est pas de rendre l'IA moins confiante—c'est de la rendre précisément confiante. L'incertitude sur les choses incertaines est une fonctionnalité, pas un bug.

Métaprompting : Utiliser l'IA pour Améliorer l'IA

Voici la technique la plus méta de ma boîte à outils : utiliser l'IA pour améliorer vos prompts. Ça semble circulaire, mais c'est incroyablement efficace.

Diagnostiquer les Échecs de Prompts

Quand les prompts ne fonctionnent pas, j'utilise ce pattern pour diagnostiquer les problèmes :

Vous êtes un ingénieur de prompts chargé de débugger un prompt système.

On vous donne :

1) Le prompt système actuel :

<system_prompt>

[COLLEZ VOTRE PROMPT ICI]

</system_prompt>

2) Un petit ensemble d'échecs loggés. Chaque log a :

- query

- actual_output

- expected_output (ou description du problème)

<failure_traces>

[COLLEZ LES EXEMPLES D'ÉCHECS]

</failure_traces>

Vos tâches :

1) Identifier les modes d'échec distincts que vous voyez.

2) Pour chaque mode d'échec, citez les lignes spécifiques dans le prompt

système qui causent ou renforcent probablement cela.

3) Expliquez comment ces lignes guident l'agent vers le comportement observé.

Retournez votre réponse en format structuré :

failure_modes:

- name: ...

description: ...

prompt_drivers:

- exact_or_paraphrased_line: ...

- why_it_matters: ...Générer des Améliorations de Prompts

Une fois que vous avez le diagnostic, un second prompt génère des améliorations :

Vous avez précédemment analysé ce prompt système et ses modes d'échec.

Prompt système :

<system_prompt>

[PROMPT ORIGINAL]

</system_prompt>

Analyse des modes d'échec :

[COLLEZ LE DIAGNOSTIC DE L'ÉTAPE PRÉCÉDENTE]

Veuillez proposer une révision chirurgicale qui réduit les problèmes observés

tout en préservant les bons comportements.

Contraintes :

- Ne redesignez pas l'agent à partir de zéro.

- Préférez des modifications petites et explicites : clarifiez les règles en conflit,

supprimez les lignes redondantes ou contradictoires, ajustez la guidance vague.

- Rendez les compromis explicites.

- Gardez la structure et la longueur approximativement similaires à l'original.

Sortie :

1) patch_notes : une liste concise des changements clés et du raisonnement derrière chacun.

2) revised_system_prompt : le prompt mis à jour complet avec les modifications appliquées.Ce processus en deux étapes m'a aidé à corriger des prompts avec lesquels je luttais depuis des jours. L'IA attrape souvent des contradictions et ambiguïtés auxquelles j'étais devenu aveugle.

Modèles de Prompts Testés sur le Terrain

Laissez-moi partager quelques modèles qui se sont avérés fiables sur des centaines de cas d'usage.

Modèle Universel d'Accomplissement de Tâche

<context>

[Informations de fond que l'IA doit connaître pour comprendre la situation]

</context>

<task>

[Déclaration claire de ce que vous voulez fait]

</task>

<requirements>

[Exigences ou contraintes spécifiques]

</requirements>

<format>

[Comment vous voulez que la sortie soit structurée]

</format>

<examples>

[Optionnel : Exemples de la sortie désirée]

</examples>

<notes>

[Optionnel : Contexte additionnel ou préférences]

</notes>Modèle de Revue de Code

<context>

Vous examinez du code pour [projet/contexte].

La codebase utilise [technologies/patterns].

</context>

<code_to_review>

[Collez le code ici]

</code_to_review>

<review_criteria>

Concentrez-vous sur :

1. Exactitude : Fait-il ce qu'il dit ?

2. Lisibilité : Est-ce clair pour d'autres développeurs ?

3. Performance : Y a-t-il des inefficacités évidentes ?

4. Sécurité : Y a-t-il des vulnérabilités ?

5. Style : Correspond-il aux conventions de la codebase ?

</review_criteria>

<output_format>

Pour chaque problème trouvé :

- Sévérité : [Critique/Majeur/Mineur/Suggestion]

- Emplacement : [Numéro de ligne ou section]

- Problème : [Ce qui ne va pas]

- Correction : [Comment l'adresser]

</output_format>Modèle d'Analyse de Recherche

<research_task>

Analysez [sujet/question] avec l'approche suivante :

</research_task>

<methodology>

1. Commencez par plusieurs recherches ciblées. Ne vous fiez pas à une seule requête.

2. Creusez en profondeur jusqu'à avoir assez d'informations pour une

réponse précise et complète.

3. Ajoutez des recherches de suivi ciblées pour combler les lacunes ou résoudre les désaccords.

4. Continuez à itérer jusqu'à ce que d'autres recherches soient peu susceptibles de changer la réponse.

</methodology>

<output_requirements>

- Commencez par une réponse claire à la question principale.

- Supportez avec des preuves et citations.

- Reconnaissez les limitations et incertitudes.

- Fournissez des exemples concrets quand c'est utile.

- Incluez le contexte pertinent qui aide à comprendre les implications.

</output_requirements>

<citation_format>

[Comment vous voulez que les sources soient citées]

</citation_format>Erreurs Courantes qui Sabotent les Résultats

Laissez-moi vous épargner les erreurs que j'ai faites (à répétition) dans mes premiers jours d'ingénierie de prompts.

"Écris-moi quelque chose sur le marketing" vs "Écris un article de blog de 500 mots sur l'email marketing pour les startups SaaS, en te concentrant sur les séquences de bienvenue." La spécificité est tout.

"Sois concis" et "sois détaillé" dans le même prompt. L'IA luttera pour réconcilier les contradictions. Soyez explicite sur les priorités et compromis.

L'IA ne sait pas ce que vous ne lui avez pas dit. Si quelque chose est évident pour vous, ça pourrait ne pas l'être pour le modèle. Incluez le contexte pertinent.

Si vous avez besoin de JSON, dites-le. Si vous avez besoin de puces, dites-le. Ne laissez pas le format de sortie au hasard.

Parfois un prompt simple est meilleur. N'ajoutez pas de complexité pour le plaisir. Commencez simple, ajoutez de la complexité seulement quand c'est nécessaire.

Créer des prompts est itératif. Votre premier prompt est un brouillon. Affinez basé sur ce qui fonctionne et ce qui ne fonctionne pas.

GPT et Claude se comportent différemment. Un prompt optimisé pour l'un pourrait sous-performer sur l'autre. Testez sur plusieurs modèles si votre application les supporte.

La sortie de l'IA nécessite généralement une revue humaine. Construisez des prompts qui rendent la revue facile—structure claire, hypothèses explicites, raisonnement traçable.

L'Avenir de l'Ingénierie de Prompts

Alors que j'écris ceci au début de 2026, l'ingénierie de prompts évolue rapidement. Les modèles deviennent plus capables, plus guidables et plus fiables. Certains prédisent que l'ingénierie de prompts deviendra obsolète à mesure que l'IA s'améliore dans la compréhension de l'intention. Je ne suis pas d'accord.

Ce qui change, c'est le niveau de l'ingénierie de prompts, pas sa nécessité. Les premiers jours nécessitaient des prompts élaborés pour des tâches basiques. Maintenant, les tâches basiques fonctionnent dès la sortie de la boîte, mais les workflows agentiques complexes nécessitent encore un prompting sophistiqué. La barre se lève, elle ne disparaît pas.

L'ingénierie de prompts ne s'en va pas—elle évolue. Les compétences qui comptent passent de "comment faire fonctionner l'IA" à "comment faire fonctionner l'IA excellemment et de manière fiable à l'échelle."

Ce Qui Arrive

Meilleurs Comportements par Défaut

Les modèles auront des défauts plus intelligents, nécessitant moins d'instructions explicites pour les patterns courants. Les prompts se concentreront plus sur la personnalisation que sur la capacité de base.

Écosystèmes d'Outils Plus Riches

L'IA aura accès à plus d'outils dès la sortie de la boîte. L'ingénierie de prompts passera à l'orchestration—savoir quand utiliser quoi, pas juste comment.

Intégration Multimodale

Les prompts impliqueront de plus en plus des images, audio, vidéo et données structurées en plus du texte. De nouveaux patterns de prompts émergeront pour les tâches multimodales.

Complexité Agentique

À mesure que les agents s'attaquent à des tâches plus longues et plus complexes, l'ingénierie de prompts deviendra plus comme du design système—de l'architecture, pas juste des instructions.

Mon Conseil pour l'Avenir

Concentrez-vous sur les fondamentaux. Les techniques spécifiques de ce guide évolueront, mais les principes sous-jacents—communication claire, attentes explicites, pensée structurée, raffinement itératif—sont intemporels. Maîtrisez ceux-là, et vous vous adapterez à tout ce qui viendra ensuite.

Réflexions Finales

Il y a deux ans, je pensais que l'IA remplacerait le besoin de communiquer clairement. Je me trompais complètement. L'IA a rendu la communication claire plus précieuse que jamais. Les gens qui prospèrent avec l'IA ne sont pas ceux qui ont trouvé des mots magiques—ce sont ceux qui ont appris à penser et à s'exprimer avec précision.

L'ingénierie de prompts n'est pas vraiment à propos de l'IA. C'est à propos de vous. C'est développer la discipline d'articuler ce que vous voulez vraiment, la patience d'itérer vers ça, et l'humilité d'apprendre de ce qui ne fonctionne pas.

Si vous retenez une chose de ce guide, que ce soit ceci : traitez chaque prompt comme une opportunité de pratiquer la pensée claire. L'IA n'est qu'un miroir qui reflète la clarté—ou la confusion—de votre propre esprit.

L'essor de l'IA n'a pas rendu la connaissance obsolète—il a rendu la curiosité plus puissante que jamais. Nous ne sommes plus limités par ce que nous savons déjà. Avec les bons outils et la volonté de penser, les gens ordinaires peuvent embrasser un océan de connaissances. Peu importe la profession. Peu importe l'âge. J'espère partager ce voyage avec des amis du monde entier. Ensemble, accueillons ce nouveau monde. Ensemble, grandissons.

Discussion

0 commentairesLaisser un commentaire

Soyez le premier à partager vos pensées !