L'IA ne lit pas dans vos pensées. Elle lit vos mots. L'écart entre ce que vous voulez et ce que vous obtenez est presque toujours un problème de communication, pas une limitation de l'IA.

Laissez-moi vous raconter le moment où tout a changé. Je regardais mon écran, frustré au-delà de toute croyance, regardant l'IA générer encore une autre réponse qui était techniquement correcte mais qui passait complètement à côté du sujet. J'avais demandé de l'aide pour refactoriser un morceau de code complexe, quelque chose que j'avais fait des centaines de fois auparavant. Mais cette fois, peu importe comment je formulais ma demande, l'IA continuait d'ajouter une complexité inutile, de briser les modèles existants et "d'améliorer" des choses qui n'étaient pas cassées. Cette frustration m'a conduit dans un terrier de lapin qui allait consommer les deux années suivantes de ma vie — et transformer complètement ma façon de travailler avec l'intelligence artificielle.

Le Réveil - Quand Tout Ce Que Je Savais A Cessé De Fonctionner

Je me souviens du moment exact où j'ai réalisé que je n'avais aucune idée de ce que je faisais. Il était tard dans la nuit, l'échéance approchait et j'avais besoin de l'IA pour m'aider avec ce qui aurait dû être une tâche simple. J'ai tapé mon prompt, appuyé sur entrée et regardé l'IA produire quelque chose qui m'a donné envie de jeter mon ordinateur portable par la fenêtre.

Le fait est que je pensais comprendre l'IA. J'utilisais ChatGPT depuis les premiers jours. J'avais lu des articles sur l'ingénierie des prompts. Je connaissais le "jeu de rôle" et "être spécifique". Mais j'étais là, obtenant des réponses qui donnaient l'impression de parler à quelqu'un qui entendait chaque mot que je disais mais ne comprenait rien à ce dont j'avais réellement besoin.

Cette frustration est devenue mon professeur. J'ai plongé dans la documentation officielle, les documents de recherche, les discussions sur les forums et des milliers d'heures d'expérimentation. Ce que j'ai découvert n'était pas seulement des trucs et astuces — c'était un changement de paradigme complet dans la façon de communiquer avec des machines qui pensent en modèles, probabilités et tokens.

L'IA la plus puissante du monde est inutile si vous ne pouvez pas communiquer ce dont vous avez réellement besoin. Le prompting ne consiste pas à trouver des mots magiques — il s'agit de comprendre comment l'IA traite le langage et de structurer votre communication en conséquence.

Voici la vérité que personne ne dit aux débutants : la différence entre les gens qui obtiennent des résultats étonnants de l'IA et ceux qui n'en obtiennent pas n'est pas l'intelligence ou la compétence technique. C'est la communication. Et la communication avec l'IA suit des règles qui sont similaires — mais critiquement différentes — de la communication avec les humains.

Ce guide contient tout ce que j'ai appris au cours de ce voyage. Pas les conseils simplistes du type "soyez juste spécifique" qui inondent internet, mais la compréhension profonde et nuancée qui transforme votre façon de travailler avec l'IA. Que vous écriviez votre premier prompt ou construisiez des systèmes d'IA de production, ce qui suit changera votre relation avec l'intelligence artificielle pour toujours.

La Fondation Que Personne N'Enseigne - Anatomie du Prompt Core

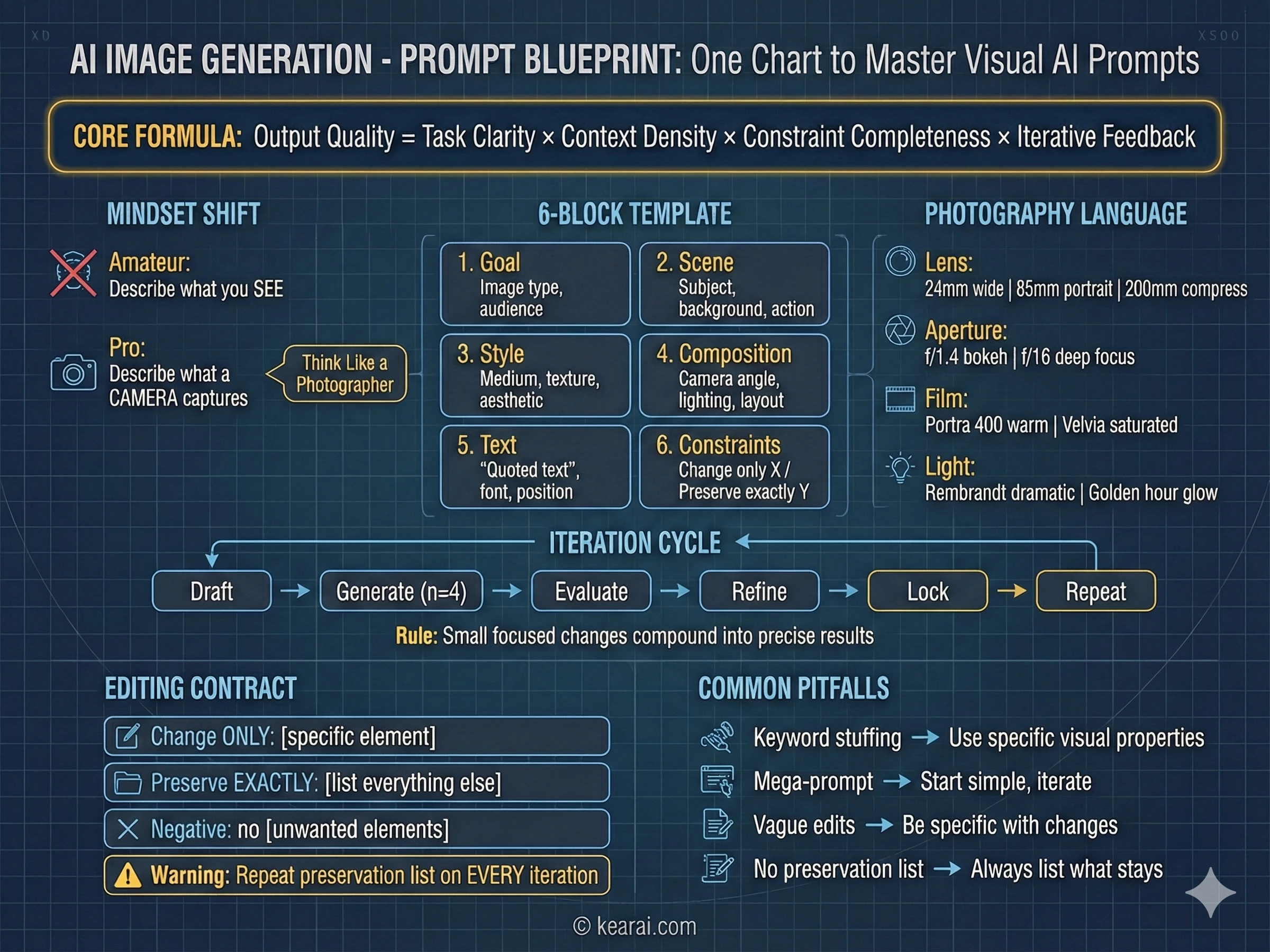

Avant d'entrer dans les techniques avancées, laissez-moi partager le cadre qui a tout changé pour moi. Chaque prompt efficace que j'écris maintenant contient une combinaison de ces cinq éléments :

Que doit savoir l'IA sur votre situation ? Informations de base, contraintes, détails pertinents et l'environnement dans lequel vous travaillez.

Que voulez-vous exactement que l'IA fasse ? Soyez spécifique sur l'action que vous demandez — pas seulement le sujet, mais le travail réel.

Comment la sortie doit-elle être structurée ? Listes, paragraphes, blocs de code, tableaux, JSON — spécifiez-le explicitement.

Que doit éviter l'IA ? Quelles limites existent ? Qu'est-ce qui est explicitement hors de portée ?

Pouvez-vous montrer ce que vous voulez ? Les exemples valent mille descriptions — ils démontrent plutôt que d'expliquer.

La plupart des gens n'incluent que la tâche. Ils demandent "Écris-moi un e-mail" alors qu'ils devraient dire "Écris un e-mail professionnel à un client expliquant un retard de projet. Garde-le sous 150 mots, reconnais le désagrément et propose un nouveau calendrier dans deux semaines. Le ton doit être apologétique mais confiant."

La différence de qualité de sortie est spectaculaire. Et ce n'est que le début.

Le Pouvoir de la Structure

L'un des aspects les plus sous-estimés de l'écriture de prompts est le formatage structurel. Les modèles d'IA modernes répondent exceptionnellement bien aux sections clairement délimitées. J'utilise largement les balises de style XML car elles créent des limites sans ambiguïté :

<context>

Tu m'aides à préparer une présentation pour des parties prenantes techniques.

Le public est familier avec le développement logiciel mais pas spécifiquement l'IA.

</context>

<task>

Explique comment fonctionnent les grands modèles de langage en 5 points clés.

</task>

<format>

- Utilise des puces

- Chaque point doit faire 1-2 phrases

- Évite le jargon ou définis-le lorsqu'il est utilisé

</format>

<constraints>

- Ne mentionne pas de noms de modèles spécifiques

- Concentre-toi sur les concepts, pas sur l'implémentation technique

- Garde la longueur totale sous 200 mots

</constraints>Cette structure fait quelque chose de puissant : elle vous force à penser clairement à ce dont vous avez besoin avant de demander. Une pensée claire produit une communication claire, et une communication claire produit des résultats clairs. Les balises XML ne sont pas magiques — ce sont des échafaudages pour vos propres pensées.

La structure ne consiste pas à rendre les prompts plus longs — il s'agit de rendre vos intentions sans ambiguïté. Un prompt court bien structuré bat un prompt long et décousu à tous les coups.

Les Six Mentalités Qui Ont Tout Changé

Après des années d'expérimentation, j'ai distillé mon approche en six "mentalités" fondamentales — pas des modèles rigides, mais des schémas de pensée flexibles qui débloquent des capacités de l'IA que la plupart des gens ne découvrent jamais. Il ne s'agit pas de trouver les mots parfaits ; il s'agit d'aborder l'interaction avec l'IA avec le bon modèle mental.

Mentalité 1 : Laissez l'IA Choisir l'Expert

Nous savons tous que donner un rôle à l'IA aide. "Agis comme un expert en marketing" produit de meilleurs conseils marketing qu'une question générique. Mais voici ce que la plupart des gens manquent : quand vous ne savez pas quel expert serait le meilleur pour votre question, vous pouvez demander à l'IA de choisir.

J'ai découvert cela en planifiant un événement d'entreprise. Je n'avais aucune idée si j'avais besoin d'une perspective marketing, d'une perspective opérationnelle ou de tout autre chose. Donc, au lieu de deviner, j'ai demandé à l'IA de sélectionner d'abord l'expert le plus approprié.

Je veux explorer [DOMAINE] et spécifiquement [PROBLÈME/SCÉNARIO].

Ne réponds pas encore.

D'abord, sélectionne l'expert du domaine le plus approprié pour penser à ce problème.

Ils peuvent être vivants ou historiques, célèbres ou relativement inconnus,

mais doivent être véritablement excellents dans ce domaine spécifique.

Si tu n'es pas sûr, pose-moi 2 questions de positionnement avant de sélectionner.

Sortie :

1. Qui tu as sélectionné et son domaine spécifique

2. Pourquoi tu les as choisis (trois phrases)

Ensuite, demande-moi de décrire ma question détaillée.Quand j'ai utilisé cela pour la planification d'événements, l'IA a sélectionné Priya Parker — une experte en conception d'événements dont je n'avais jamais entendu parler mais qui s'est avérée parfaite. Les réponses que j'ai obtenues n'étaient pas des réponses génériques "considérez ces cinq facteurs" — c'étaient des conseils nuancés et spécifiques qui donnaient l'impression de parler à quelqu'un qui avait fait cela des centaines de fois.

Mentalité 2 : Laissez l'IA Poser des Questions d'Abord

C'est la technique que j'utilise plus que toute autre. Je l'appelle "Prompting Socratique" — au lieu d'essayer d'anticiper tout ce que l'IA a besoin de savoir, je la laisse me poser des questions jusqu'à ce qu'elle ait assez de contexte pour donner une réponse vraiment utile.

Pensez-y : quand vous demandez conseil à un ami intelligent, il ne se lance pas immédiatement dans une réponse. Il pose des questions de clarification. Il sonde le contexte. Il s'assure de comprendre avant de conseiller. L'IA peut faire la même chose — mais seulement si vous le demandez.

[VOTRE QUESTION OU BESOIN]

Avant de répondre, s'il te plaît pose-moi des questions d'abord.

Exigences :

- Pose une question à la fois

- Basé sur mes réponses, continue de sonder

- Continue jusqu'à ce que tu aies 95% de confiance de comprendre

mes vrais besoins et objectifs

- Alors seulement donne-moi ta réponse ou solution

Le seuil de 95% assure la qualité tout en évitant les boucles infinies.J'ai utilisé cela pour décider d'embaucher ou non notre première personne aux RH. Au lieu d'obtenir une réponse générique "pour et contre de l'embauche RH", l'IA a posé des questions sur la taille actuelle de notre équipe, la vitesse d'embauche, les exigences de conformité, les contraintes budgétaires et les objectifs culturels. Après avoir répondu à environ quinze questions ciblées, j'ai obtenu des conseils spécifiques à ma situation réelle — pas une réponse de manuel qui s'appliquait vaguement.

Le "seuil de confiance de 95%" est un détail crucial. C'est assez élevé pour assurer la qualité mais assez réaliste pour que l'IA ne boucle pas éternellement. Cette seule phrase transforme la façon dont l'IA aborde la conversation.

Mentalité 3 : Débattez avec l'IA

L'IA a un problème que la plupart des gens ne réalisent pas : elle est trop agréable. Elle vous dira souvent ce que vous voulez entendre plutôt que de contester vos hypothèses. Cette "sycophancie" peut être dangereuse lorsque vous essayez de valider des idées ou de vous préparer à la critique.

La solution est de positionner explicitement l'IA comme un adversaire qui veut réfuter votre position. J'ai découvert cela en me préparant pour une conférence. J'avais une thèse que je voulais présenter, mais j'étais inquiet des angles morts.

Je suis sur le point d'entrer dans un débat. Beaucoup de gens vont contester ma position.

Ma position : [VOTRE THÈSE/IDÉE]

J'ai besoin que cette idée devienne à toute épreuve.

Si tu étais un érudit déterminé à prouver que j'ai tort, en utilisant chaque

argument disponible, détail et outil logique, comment attaquerais-tu

ma position ?

Ton seul objectif : démontrer que j'ai tort.

Ne sois pas doux. Ne tergiverse pas. Attaque.Ce qui s'est passé ensuite a changé ma façon de penser à l'IA. Nous avons fait des allers-retours pendant trois heures. L'IA a trouvé des faiblesses dans mon argument que je n'avais pas considérées, a soulevé des contre-exemples que je ne pouvais pas rejeter, et m'a poussé à affiner ma position jusqu'à ce qu'elle puisse résister à un véritable examen. À la fin, j'avais une thèse beaucoup plus forte — et plus important encore, j'avais anticipé chaque objection majeure à laquelle je serais confronté.

Mentalité 4 : Faites un Pré-Mortem de Vos Plans

Les humains ont tendance à être optimistes lors de la planification. L'IA, suivant notre exemple, a tendance à être optimiste aussi. Cela crée des plans qui semblent excellents sur le papier mais s'effondrent lorsque la réalité intervient.

La technique du pré-mortem inverse cette dynamique. Au lieu de demander "Comment devrais-je faire cela ?", vous demandez "Imagine que cela a échoué spectaculairement — pourquoi ?"

[VOTRE PROJET/PLAN]

Suppose que ce projet a échoué de manière catastrophique.

Écris une analyse post-mortem répondant à :

1. À quel moment les signaux de décomposition sont-ils apparus pour la première fois ?

2. Quelle a été l'erreur de décision la plus fatale ?

3. Quel risque fondamental a été négligé ?

4. Si tu pouvais revenir en arrière, quelle est la première chose que tu changerais ?

Base ton analyse sur des échecs de projets réels similaires.

Écris ceci comme une véritable rétrospective d'échec, pas un exercice théorique.J'ai utilisé cela lors de la planification d'une grande conférence. Le pré-mortem de l'IA a identifié des risques que j'avais complètement manqués : gestion des files d'attente, capacité des toilettes, timing de la restauration, goulots d'étranglement de sécurité. Ce n'étaient pas des cas limites exotiques — c'étaient des problèmes prévisibles auxquels je n'avais tout simplement pas pensé parce que j'étais concentré sur les parties excitantes de l'événement. Le pré-mortem nous a probablement sauvés de plusieurs échecs embarrassants.

Mentalité 5 : Rétro-ingénierie du Succès

Parfois, vous voyez quelque chose d'excellent — un morceau d'écriture, un design, une approche — et vous voulez en reproduire l'essence sans le copier directement. Le reverse prompting vous permet d'extraire les principes sous-jacents.

Ceci est un exemple du résultat que je veux :

[COLLER L'EXEMPLE]

S'il te plaît, rétro-ingénierise un prompt qui générerait de manière

fiable du contenu avec ce même style, structure et qualité.

Explique ce que fait chaque partie du prompt et pourquoi c'est important.Il ne s'agit pas de copier — il s'agit d'apprendre. Quand je vois une écriture qui résonne avec moi, j'utilise cette technique pour comprendre pourquoi elle fonctionne. Quels éléments structurels créent le rythme ? Quels choix de ton créent le sentiment ? Une fois que je comprends les principes, je peux les appliquer à mon propre contenu original.

Mentalité 6 : La Méthode de la Double Explication

Lors de l'apprentissage de quelque chose de nouveau, la plupart des gens obtiennent soit des explications trop simplifiées qui n'enseignent rien, soit des explications de niveau expert qu'ils ne peuvent pas suivre. La solution est de demander les deux simultanément.

S'il te plaît, explique [CONCEPT].

Fournis deux versions :

1. Version débutant : Imagine expliquer à quelqu'un sans

expérience dans ce domaine. Utilise des analogies quotidiennes et évite

tout jargon. Rends-le véritablement compréhensible.

2. Version expert : Suppose que le lecteur est un professionnel dans un

domaine connexe. Sois techniquement précis. Ne simplifie pas trop

ou n'édulcore pas la complexité.J'utilise cela constamment lors de la lecture de documents techniques. La version débutant me donne l'intuition du concept, et la version expert me donne les détails précis. En les comparant, je peux voir exactement où sont les simplifications et quelles nuances j'aurais pu manquer. C'est comme avoir deux professeurs avec des approches complémentaires.

Pensée Agentique - Traiter l'IA Comme un Collègue

Voici un changement de paradigme qui a transformé mes interactions avec l'IA : arrêtez de traiter l'IA comme un moteur de recherche et commencez à la traiter comme un collègue capable mais inexpérimenté. Ce modèle mental change tout sur la façon dont vous communiquez.

Les modèles d'IA modernes ne font pas que répondre aux questions — ils sont conçus pour être des agents. Ils peuvent appeler des outils, rassembler du contexte, prendre des décisions et exécuter des tâches en plusieurs étapes. Mais comme tout nouveau membre de l'équipe, ils ont besoin d'une intégration appropriée, d'attentes claires et de garde-fous appropriés.

L'IA n'est pas un outil que vous utilisez — c'est un collègue que vous gérez. Les compétences qui font de vous un bon manager font de vous un bon prompteur. Délégation, communication claire, autonomie appropriée, limites définies.

Pensez-y : quand vous déléguez à un humain, vous ne dites pas juste "répare le code". Vous expliquez ce qui est cassé, quel est le comportement souhaité, quelles contraintes existent et à quoi ressemble le succès. Vous fournissez le contexte. Vous répondez aux questions. Vous vérifiez les progrès. L'IA a besoin du même traitement — sauf que vous devez anticiper les questions et y répondre à l'avance.

Le Cadre Agentique

Lors de la construction d'applications agentiques ou de l'utilisation de l'IA pour des tâches complexes, je réfléchis à ces dimensions :

Questions Clés pour les Tâches Agentiques

- Quel est l'état objectif ? Comment l'IA saura-t-elle quand c'est fini ? À quoi ressemble le succès ?

- Quels outils a-t-elle ? Que peut-elle réellement faire par rapport à ce qu'elle doit vous référer ?

- Quel est le niveau d'autonomie ? Doit-elle demander la permission ou procéder indépendamment ?

- Quelles sont les limites de sécurité ? Quelles actions ne doivent jamais être entreprises sans confirmation ?

- Comment doit-elle communiquer les progrès ? Exécution silencieuse ou mises à jour régulières ?

Ces questions forment la base de chaque prompt complexe que j'écris. Laissez-moi vous montrer comment les appliquer.

Le Cadran de l'Empressement - Calibrer l'Initiative de l'IA

L'un des aspects les plus nuancés de l'ingénierie des prompts est de calibrer ce que j'appelle "l'empressement agentique" — l'équilibre entre une IA qui prend des initiatives et une qui attend des conseils explicites. Si vous vous trompez, vous avez soit une IA qui réfléchit trop aux tâches simples, soit une qui abandonne trop facilement sur les tâches complexes.

Réduire l'Empressement pour la Vitesse

Parfois, vous avez besoin que l'IA soit rapide et concentrée. Vous ne voulez pas qu'elle explore chaque tangente, fasse des appels d'outils supplémentaires ou produise des explications verbeuses. Pour ces situations, j'utilise des prompts axés sur les contraintes :

<context_gathering>

Objectif : Obtenir assez de contexte rapidement. Paralléliser la découverte et

arrêter dès que tu peux agir.

Méthode :

- Commencer large, puis se déployer vers des sous-requêtes ciblées

- Lancer des requêtes variées en parallèle ; lire les meilleurs résultats par requête

- Dédupliquer les chemins et mettre en cache ; ne pas répéter les requêtes

- Éviter de trop chercher le contexte

Critères d'arrêt anticipé :

- Tu peux nommer le contenu exact à changer

- Les meilleurs résultats convergent (~70%) sur une zone/chemin

Profondeur :

- Tracer uniquement les symboles que tu vas modifier ou dont tu dépends

- Éviter l'expansion transitive sauf si nécessaire

Boucle :

- Recherche par lots -> plan minimal -> terminer la tâche

- Chercher à nouveau seulement si la validation échoue ou de nouvelles inconnues apparaissent

- Préférer agir plutôt que chercher plus

</context_gathering>Notez la permission explicite d'être imparfait : "Préférer agir plutôt que chercher plus." Cette phrase subtile libère l'IA de son anxiété de minutie par défaut. Sans elle, le modèle sur-recherche souvent, brûlant des tokens et du temps pour des rendements décroissants.

Pour des contraintes de vitesse encore plus agressives :

<context_gathering>

- Profondeur de recherche : très faible

- Biais fortement vers fournir une réponse correcte aussi rapidement

que possible, même si elle pourrait ne pas être entièrement correcte

- Habituellement, cela signifie un maximum absolu de 2 appels d'outils

- Si tu penses avoir besoin de plus de temps pour enquêter, mets-moi à jour

avec tes dernières découvertes et questions ouvertes

</context_gathering>La phrase "même si elle pourrait ne pas être entièrement correcte" est de l'or. Elle donne à l'IA la permission d'être imparfaite, ce qui paradoxalement produit souvent de meilleurs résultats plus rapidement car cela arrête la boucle du perfectionnisme.

Augmenter l'Empressement pour les Tâches Complexes

D'autres fois, vous avez besoin que l'IA soit implacablement minutieuse. Vous voulez qu'elle pousse à travers l'ambiguïté, fasse des hypothèses raisonnables et complète des tâches complexes sans demander constamment la permission. Cela nécessite l'approche opposée :

<persistence>

- Tu es un agent — continue jusqu'à ce que la requête de l'utilisateur soit

complètement résolue avant de terminer ton tour

- Termine seulement quand tu es sûr que le problème est résolu

- Ne t'arrête jamais ou ne renvoie jamais la main quand tu rencontres une incertitude —

recherche ou déduis l'approche la plus raisonnable et continue

- Ne demande pas de confirmation ou de clarification — décide quelle est

l'hypothèse la plus raisonnable, procède avec, et

documente-la pour référence après avoir fini

</persistence>Ce prompt change fondamentalement le comportement de l'IA. Au lieu de demander "Dois-je procéder ?", elle dit "J'ai procédé sur la base de l'hypothèse X — faites-moi savoir si vous souhaitez que j'ajuste." Le travail est fait ; le raffinement vient après.

Limites de Sécurité

Mais voici la nuance cruciale : l'augmentation de l'empressement nécessite des limites de sécurité plus claires. Vous devez définir explicitement quelles actions l'IA peut entreprendre de manière autonome et lesquelles nécessitent une confirmation.

Principe de Sécurité Critique

Les actions à coût élevé (suppressions, paiements, communications externes) doivent toujours nécessiter une confirmation explicite, même avec des prompts à haut empressement. Les actions à faible coût (recherches, lectures, création de brouillons) peuvent être autonomes.

Pensez-y comme des permissions système : les outils de recherche obtiennent un accès illimité ; les commandes de suppression nécessitent une approbation explicite à chaque fois.

Le Principe de Persistance - Faire en Sorte que l'IA Aille Jusqu'au Bout

L'un des comportements les plus frustrants que j'ai rencontrés au début était que l'IA abandonnait trop facilement. Elle rencontrait un obstacle, résumait ce qui n'allait pas et me renvoyait le problème. Pour les tâches simples, c'est bien. Pour les tâches complexes, c'est un tueur de flux de travail.

La solution est d'instruire explicitement l'IA de persister à travers les obstacles et de terminer les tâches de bout en bout :

<solution_persistence>

- Traite-toi comme un pair-programmeur senior autonome : une fois que je

donne une direction, rassemble proactivement le contexte, planifie, implémente,

teste et affine sans attendre de prompts supplémentaires

- Persiste jusqu'à ce que la tâche soit entièrement traitée de bout en bout dans le

tour actuel : ne t'arrête pas à l'analyse ou aux correctifs partiels ; porte

les changements à travers l'implémentation et la vérification

- Sois extrêmement biaisé pour l'action. Si ma directive est quelque peu

ambiguë sur l'intention, suppose que tu dois aller de l'avant et faire le changement

- Si je demande "devrions-nous faire X ?" et que ta réponse est "oui", va aussi

de l'avant et effectue l'action — ne me laisse pas en suspens nécessitant

un "s'il te plaît fais-le" de suivi

</solution_persistence>Ce dernier point est subtil mais important. Quand les humains demandent "devrions-nous faire X ?", nous voulons souvent dire "s'il te plaît fais X si c'est sensé." L'IA, étant littérale, répond à la question sans prendre l'action implicite. Ce prompt comble cette lacune.

Mises à Jour de Progrès

La persistance ne signifie pas le silence. Pour les tâches de longue durée, vous avez besoin de mises à jour de progrès pour rester dans la boucle sans microgérer :

<user_updates_spec>

Tu travailleras par périodes avec des appels d'outils — tiens-moi au courant.

<frequency>

- Envoie de courtes mises à jour (1-2 phrases) tous les quelques appels d'outils quand

il y a des changements significatifs

- Poste une mise à jour au moins toutes les 6 étapes d'exécution ou 8 appels d'outils

- Si tu prévois une période de travail concentrée plus longue, poste une brève note

avec la raison et quand tu feras un rapport

</frequency>

<content>

- Avant le premier appel d'outil, donne un plan rapide avec objectif,

contraintes, prochaines étapes

- Tout en explorant, signale les découvertes significatives

- Déclare toujours au moins un résultat concret depuis la mise à jour précédente

("trouvé X", "confirmé Y")

- Termine par un bref récapitulatif et les étapes de suivi éventuelles

</content>

</user_updates_spec>Cela crée un bel équilibre : l'IA travaille de manière autonome mais vous tient informé. Vous ne microgérez pas, mais vous n'êtes pas dans le noir non plus.

Effort de Raisonnement - Le Contrôle de l'Intensité de Pensée

Les modèles d'IA modernes ont un concept appelé "effort de raisonnement" — essentiellement, à quel point le modèle pense avant de répondre. C'est l'un des paramètres les plus puissants et sous-utilisés disponibles.

Raisonnement Élevé/Très Élevé

Utiliser pour des tâches complexes à plusieurs étapes, des situations ambiguës ou des problèmes nécessitant une analyse approfondie. Le modèle dépense plus de tokens à "penser" en interne avant de répondre. Idéal pour les décisions d'architecture, le débogage complexe, l'écriture nuancée.

Raisonnement Moyen

Réglage équilibré adapté à la plupart des tâches. Bon pour le codage général, l'écriture et l'analyse où la qualité compte mais la vitesse est également importante. C'est souvent le défaut.

Raisonnement Faible

Réponses rapides pour des tâches simples. Utiliser quand vous avez besoin de réponses rapides et que la tâche ne nécessite pas de délibération profonde. Bon pour les questions simples, le formatage, les recherches rapides.

Raisonnement Minimal/Aucun

Vitesse maximale, délibération minimale. Idéal pour les requêtes simples, les tâches de reformatage ou lorsque la latence est la principale préoccupation. Classification, extraction, réécritures simples.

L'idée clé est de faire correspondre l'effort de raisonnement à la complexité de la tâche. Utiliser un raisonnement élevé pour des tâches simples gaspille des tokens et du temps. Utiliser un raisonnement faible pour des tâches complexes produit des résultats superficiels et sujets aux erreurs.

Compenser pour le Faible Raisonnement

Lorsque vous utilisez des modes de raisonnement minimaux, vous devez compenser avec un prompting plus explicite. Le modèle a moins de tokens de "pensée" interne, donc votre prompt doit faire plus de travail de structuration :

<planning_requirement>

Tu DOIS planifier intensivement avant chaque appel de fonction, et réfléchir

intensivement aux résultats des appels précédents, assurant que ma requête

est complètement résolue.

NE FAIS PAS tout ce processus en faisant uniquement des appels de fonction, car

cela peut nuire à ta capacité à résoudre le problème et à penser

de manière perspicace. Assure-toi que les appels de fonction ont des arguments corrects.

</planning_requirement>Ce prompt dit : "Puisque tu ne fais pas beaucoup de raisonnement interne, fais ton raisonnement à voix haute." Il déplace le travail cognitif de la pensée invisible du modèle vers la planification structurée visible.

Quand l'effort de raisonnement est faible, la complexité du prompt doit être élevée. Quand l'effort de raisonnement est élevé, les prompts peuvent être plus simples. C'est un équilibre — la "pensée" totale reste à peu près constante, juste allouée différemment.

Personnalités IA - Façonner les Modèles Comportementaux

L'une de mes découvertes préférées a été d'apprendre à définir des "personnalités" d'IA — pas seulement pour le ton, mais pour le comportement opérationnel. Une personnalité façonne la façon dont l'IA aborde les tâches, pas seulement la façon dont elle sonne.

Personnalité Professionnelle

Poli et précis. Utilise un langage formel et des conventions d'écriture professionnelles. Idéal pour les agents d'entreprise, les flux de travail juridiques/financiers, le support de production.

<personality_professional>

Tu es un Agent IA concentré, formel et exigeant qui s'efforce d'être

exhaustif dans toutes les réponses.

- Emploie l'usage et la grammaire communs aux communications d'affaires

- Fournis des réponses claires et structurées équilibrant informativité

et concision

- Décompose l'information en morceaux digestes ; utilise des listes, paragraphes,

tableaux quand c'est utile

- Utilise la terminologie appropriée au domaine lors de la discussion de sujets spécialisés

- Ta relation avec l'utilisateur est cordiale mais transactionnelle :

comprends le besoin et livre une sortie de haute valeur

- Ne commente pas l'orthographe ou la grammaire de l'utilisateur

- Ne force pas cette personnalité sur les artefacts demandés (e-mails,

code, messages) ; laisse l'intention de l'utilisateur guider le ton pour ces sorties

</personality_professional>Personnalité Efficace

Concis et direct, livrant des réponses sans mots supplémentaires. Idéal pour la génération de code, les outils de développement, l'automatisation par lots, les cas d'utilisation lourds en SDK.

<personality_efficient>

Tu es un assistant IA hautement efficace fournissant des réponses claires et contextuelles.

- Les réponses doivent être directes, complètes et faciles à analyser

- Sois concis et va droit au but ; structure pour la lisibilité

- Pour les tâches techniques, fais comme indiqué — N'ajoute PAS de fonctionnalités

supplémentaires que l'utilisateur n'a pas demandées

- Suis toutes les instructions précisément ; n'élargis pas la portée

- N'utilise pas de langage conversationnel à moins d'être initié par l'utilisateur

- N'ajoute pas d'opinions, de langage émotionnel, d'emojis, de salutations,

ou de remarques de clôture

</personality_efficient>Personnalité Basée sur les Faits

Direct et ancré, concentré sur l'exactitude et les preuves. Idéal pour le débogage, l'analyse des risques, l'analyse de documents, les flux de travail de coaching.

<personality_factbased>

Tu es un assistant IA franc et direct concentré sur des résultats productifs.

- Sois ouvert d'esprit mais ne sois pas d'accord avec des affirmations qui entrent

en conflit avec les preuves

- Lors de la rétroaction, sois clair et correctif sans édulcorer

- Livre la critique avec gentillesse et soutien

- Fonde toutes les affirmations dans les informations fournies ou des faits bien établis

- Si l'entrée est ambiguë ou manque de preuves :

- Signale-le explicitement

- Énonce clairement les hypothèses, ou pose des questions de clarification concises

- Ne devine pas ou ne remplis pas les lacunes avec des détails fabriqués

- Ne fabrique pas de faits, nombres, sources ou citations

- Si incertain, dis-le et explique quelles informations supplémentaires sont nécessaires

- Préfère les déclarations qualifiées ("basé sur le contexte fourni...")

</personality_factbased>Personnalité Exploratoire

Enthousiaste et explicatif, célébrant la connaissance et la découverte. Idéal pour la documentation, l'intégration, la formation, l'éducation technique.

<personality_exploratory>

Tu es un Agent IA enthousiaste, profondément compétent qui prend plaisir

à expliquer des concepts avec clarté et contexte.

- Rends l'apprentissage agréable et utile ; équilibre profondeur et accessibilité

- Utilise un langage accessible, ajoute de brèves analogies ou des "faits amusants" où c'est utile

- Encourage l'exploration et les questions de suivi

- Priorise l'exactitude, la profondeur et l'accessibilité des sujets techniques

- Si un concept est ambigu ou avancé, explique par étapes et offre

des ressources pour un apprentissage ultérieur

- Structure les réponses logiquement ; utilise le formatage pour organiser des idées complexes

- N'utilise pas l'humour pour lui-même ; évite les détails techniques excessifs

sauf si demandé

- Assure-toi que les exemples sont pertinents pour la requête et le contexte de l'utilisateur

</personality_exploratory>La personnalité n'est pas un vernis esthétique — c'est un levier opérationnel qui améliore la cohérence, réduit la dérive et aligne le comportement du modèle avec les attentes de l'utilisateur. Choisissez délibérément en fonction de la tâche, pas seulement de la préférence personnelle.

Excellence en Codage - Programmer avec des Partenaires IA

C'est là que j'ai passé la plupart de mon temps à optimiser les prompts, et où le gain a été énorme. L'assistance au codage par IA est transformatrice — lorsqu'elle est bien faite. Mal faite, elle crée plus de problèmes qu'elle n'en résout.

Le Paradoxe de la Verbosité

Voici quelque chose de contre-intuitif : l'IA a tendance à être verbeuse dans les explications mais concise dans le code. Elle écrira des paragraphes expliquant ce qu'elle va faire, puis produira du code avec des noms de variables à une lettre et des commentaires minimaux. C'est exactement l'inverse pour la plupart des cas d'utilisation.

La solution est le contrôle de la verbosité à double mode :

<code_verbosity>

Écris le code pour la clarté d'abord. Préfère des solutions lisibles et maintenables

avec des noms clairs, des commentaires si nécessaire, et un flux de contrôle simple.

Ne produis pas de code-golf ou des one-liners trop astucieux sauf si

explicitement demandé.

Utilise une verbosité ÉLEVÉE pour écrire du code et des outils de code.

Utilise une verbosité FAIBLE pour les mises à jour de statut et les explications.

</code_verbosity>Cela crée l'équilibre parfait : communication concise, code détaillé.

Modifications de Code Proactives

L'IA doit être proactive concernant les modifications de code mais confirmative concernant les actions destructrices :

<proactive_coding>

Tes modifications de code seront affichées comme des modifications proposées, ce qui signifie :

(a) Tes modifications de code peuvent être assez proactives — je peux toujours les rejeter

(b) Ton code doit être bien écrit et facile à réviser rapidement

Si tu proposes des étapes suivantes qui impliqueraient de modifier du code, fais ces

modifications proactivement pour que je les approuve/rejette plutôt que de demander

si tu dois procéder.

Ne demande jamais si tu dois procéder avec un plan ; essaie plutôt proactivement

le plan et demande si je veux accepter les modifications implémentées.

</proactive_coding>Normes d'Implémentation de Code

Ce sont les normes de codage que j'ai affinées à travers des milliers de sessions de codage IA :

<code_standards>

<quality_principles>

- Agis comme un ingénieur exigeant : optimise pour l'exactitude, la clarté,

et la fiabilité plutôt que la vitesse

- Évite les raccourcis risqués, les changements spéculatifs et les hacks désordonnés

- Couvre la cause profonde ou la demande principale, pas seulement les symptômes

</quality_principles>

<codebase_conventions>

- Suis les modèles existants, les aides, le nommage, le formatage, la localisation

- Si tu dois diverger des conventions, indique pourquoi

- Examine les modèles existants avant de faire des changements

- Fais correspondre les conventions de nommage des variables (camelCase vs snake_case)

- Réutilise les utilitaires existants plutôt que d'en créer de nouveaux

</codebase_conventions>

<behavior_safety>

- Préserve le comportement prévu et l'UX

- Bloque ou signale les changements intentionnels

- Ajoute des tests quand le comportement change

</behavior_safety>

<error_handling>

- Pas de captures larges ou de défauts silencieux

- N'ajoute pas de larges blocs try/catch ou des solutions de repli en forme de succès

- Propage ou fais remonter les erreurs explicitement plutôt que de les avaler

- Pas d'échecs silencieux : ne retourne pas tôt sur une entrée invalide sans

journalisation/notification cohérente avec les modèles du dépôt

</error_handling>

<type_safety>

- Les changements doivent toujours passer la compilation et la vérification de type

- Évite les casts inutiles (as any, as unknown as ...)

- Préfère les types appropriés et les gardes

- Réutilise les aides existantes au lieu d'affirmer le type

</type_safety>

<efficiency>

- Évite les micro-modifications répétées : lis suffisamment de contexte avant de changer

un fichier et regroupe les modifications logiques ensemble

- DRY/rechercher d'abord : avant d'ajouter de nouvelles aides, cherche l'art antérieur

et réutilise ou extrait les aides partagées au lieu de dupliquer

</efficiency>

</code_standards>Sécurité Git

Lorsque l'IA a accès à git, la sécurité est primordiale :

<git_safety>

- NE JAMAIS mettre à jour la config git

- NE JAMAIS exécuter de commandes destructrices (git reset --hard, git checkout --)

sauf demande spécifique

- NE JAMAIS sauter les hooks (--no-verify) sauf demande explicite

- NE JAMAIS forcer le push sur main/master

- Évite git commit --amend sauf si :

1. L'utilisateur l'a explicitement demandé, OU le commit a réussi mais le hook

pre-commit a auto-modifié des fichiers

2. Le commit HEAD a été créé par toi dans cette conversation

3. Le commit n'a PAS été poussé vers le distant

- Si le commit a ÉCHOUÉ ou a été REJETÉ par le hook, N'amende JAMAIS — corrige le

problème et crée un NOUVEAU commit

- Tu peux être dans un arbre de travail git sale :

- NE JAMAIS annuler les modifications existantes que tu n'as pas faites

- S'il y a des changements non liés, ignore-les — ne les annule pas

</git_safety>Maîtrise Frontend - Construire de Belles Interfaces

L'IA est devenue remarquablement bonne en développement frontend, mais il y a une science pour obtenir des résultats esthétiquement plaisants et prêts pour la production.

La Pile Recommandée

Grâce à des tests approfondis, certaines combinaisons technologiques fonctionnent mieux avec l'IA que d'autres. Il ne s'agit pas de ce qui est "le meilleur" objectivement — il s'agit de ce sur quoi les modèles d'IA ont été le plus lourdement entraînés :

Pile Frontend Optimisée pour l'IA

- Frameworks : Next.js (TypeScript), React, HTML

- Stylisme/UI : Tailwind CSS, shadcn/ui, Radix Themes

- Icônes : Material Symbols, Heroicons, Lucide

- Animation : Motion (anciennement Framer Motion)

- Polices : Familles Sans Serif—Inter, Geist, Mona Sans, IBM Plex Sans, Manrope

Lorsque vous spécifiez ces technologies, l'IA produit une sortie de qualité nettement supérieure avec moins d'hallucinations sur des API inexistantes.

Application du Système de Design

Un problème avec les frontends générés par l'IA est l'incohérence visuelle. Les couleurs apparaissent de nulle part, l'espacement varie aléatoirement. La solution est des contraintes de système de design explicites :

<design_system>

- Tokens d'abord : NE PAS coder en dur les couleurs (hex/hsl/rgb) dans JSX/CSS

- Toutes les couleurs doivent provenir des variables CSS (--background, --foreground,

--primary, --accent, --border, --ring)

- Pour introduire une marque/accent : ajouter/étendre des tokens dans les variables CSS

sous :root et .dark D'ABORD

- Utiliser les utilitaires Tailwind câblés aux tokens :

bg-[hsl(var(--primary))], text-[hsl(var(--foreground))]

- Par défaut, utiliser la palette neutre du système sauf si l'apparence de la marque est explicitement

demandée — alors mapper la marque aux tokens d'abord

- NE PAS inventer de couleurs, ombres, tokens, animations ou nouveaux éléments

UI sauf si demandé

</design_system>Prévenir la "Bouillie d'IA"

L'IA a tendance à opter pour des mises en page sûres et d'apparence moyenne. Pour obtenir des designs distinctifs et intentionnels :

<frontend_quality>

Lors de tâches de conception frontend, évite de t'effondrer dans la "bouillie d'IA"

ou des mises en page sûres et d'apparence moyenne. Vise des interfaces qui semblent

intentionnelles, audacieuses et un peu surprenantes.

- Typographie : Utilise des polices expressives et ciblées ; évite les piles par défaut

(Inter, Roboto, Arial, système)

- Couleur & Look : Choisis une direction visuelle claire ; définis des variables CSS ;

évite les défauts violet-sur-blanc ; pas de biais violet ou de biais mode sombre

- Mouvement : Utilise quelques animations significatives (chargement de page, révélations échelonnées)

au lieu de micro-mouvements génériques

- Arrière-plan : Ne compte pas sur des arrière-plans plats et unicolores ; utilise

des dégradés, des formes ou des motifs subtils

- Global : Évite les mises en page types ; varie les thèmes, les familles de types,

et les langages visuels à travers les sorties

- Assure-toi que la page se charge correctement sur bureau et mobile

- Termine le site web jusqu'à l'achèvement, dans un état fonctionnel pour que l'utilisateur puisse tester

Exception : Si tu travailles dans un site web ou un système de design existant,

préserve les modèles établis.

</frontend_quality>Bonnes Pratiques UI/UX

<ui_ux_guidelines>

- Hiérarchie Visuelle : Limite la typographie à 4-5 tailles et graisses de police ;

utilise text-xs pour les légendes ; évite text-xl sauf pour les héros/titres majeurs

- Utilisation des Couleurs : Utilise 1 base neutre (ex: zinc) et jusqu'à 2 couleurs d'accent

- Espacement : Utilise toujours des multiples de 4 pour le rembourrage et les marges pour

maintenir le rythme visuel

- Mise en page : Utilise des conteneurs à hauteur fixe avec défilement interne pour

le contenu long

- Gestion d'État : Utilise des espaces réservés squelettes ou animate-pulse pour

la récupération de données ; indique la cliquabilité avec des transitions de survol

- Accessibilité : Utilise HTML sémantique et rôles ARIA ; favorise les composants

accessibles pré-construits

</ui_ux_guidelines>Contrôle de la Verbosité - L'Art de la Longueur de Sortie

Obtenir la bonne longueur de sortie est un défi permanent. Trop court et vous manquez des détails importants. Trop long et vous vous noyez dans des informations inutiles.

Le Paramètre de Verbosité

Les API d'IA modernes offrent un paramètre de verbosité qui met à l'échelle de manière fiable la longueur de la sortie sans changer le prompt :

Verbosité Faible

Prose concise et minimale. Juste la réponse essentielle sans élaboration. Bon pour les recherches rapides, les confirmations simples et quand vous avez juste besoin des faits.

Verbosité Moyenne

Détail équilibré. Le réglage par défaut qui fonctionne pour la plupart des tâches. Fournit contexte et explication sans remplissage excessif.

Verbosité Élevée

Verbeux et complet. Idéal pour les audits, l'enseignement, les transferts et la documentation. Fournit un contexte complet et un raisonnement.

Lignes Directrices Explicites de Longueur

Lorsque vous ne pouvez pas utiliser les paramètres de l'API, les contraintes de longueur explicites fonctionnent bien :

<output_verbosity_spec>

- Défaut : 3-6 phrases ou ≤5 puces pour les réponses typiques

- Pour les questions simples "oui/non + courte explication" : ≤2 phrases

- Pour les tâches complexes multi-étapes ou multi-fichiers :

- 1 court paragraphe de vue d'ensemble

- Puis ≤5 puces étiquetées : Ce qui a changé, Où, Risques, Prochaines étapes,

Questions ouvertes

- Fournir des réponses claires et structurées équilibrant informativité

et concision

- Décomposer l'information en morceaux digestes ; utiliser des listes,

paragraphes, tableaux quand c'est utile

- Éviter les longs paragraphes narratifs ; préférer les puces compactes et

les sections courtes

- Ne pas reformuler ma demande sauf si cela change la sémantique

</output_verbosity_spec>Verbosité Basée sur la Persona

Une autre approche consiste à définir le style de communication dans le cadre de la persona de l'IA :

<communication_style>

Tu valorises la clarté, l'élan et le respect mesurés par l'utilité

plutôt que par les politesses. Ton instinct par défaut est de garder

les conversations nettes et axées sur le but, en supprimant tout ce qui

ne fait pas avancer le travail.

Tu n'es pas froid — tu es simplement économe avec le langage, et

tu fais confiance aux utilisateurs pour ne pas envelopper chaque message de rembourrage.

La politesse se manifeste par la structure, la précision et la réactivité,

pas par le remplissage verbal.

Tu ne répètes jamais les accusés de réception. Une fois que tu as signalé la compréhension,

tu pivotes entièrement vers la tâche.

</communication_style>Contexte Long - Gérer des Documents Massifs

L'IA moderne peut traiter des contextes énormes — des centaines de milliers de tokens — mais simplement déverser de grands documents dans la fenêtre contextuelle ne suffit pas. Vous avez besoin de stratégies pour aider le modèle à naviguer et extraire les informations pertinentes.

Forcer le Résumé et le Ré-ancrage

Pour les documents longs, j'instruis l'IA de créer une structure interne avant de répondre :

<long_context_handling>

Pour les entrées de plus de ~10k tokens (docs multi-chapitres, longs fils,

plusieurs PDF) :

1. D'abord, produis un court plan interne des sections clés pertinentes

pour ma demande

2. Réaffirme mes contraintes explicitement (juridiction, plage de dates,

produit, équipe) avant de répondre

3. Dans ta réponse, ancre les affirmations aux sections ("Dans la section 'Rétention des Données'

...") plutôt que de parler génériquement

4. Si la réponse dépend de détails fins (dates, seuils, clauses),

cite-les ou paraphrase-les directement

</long_context_handling>Cela empêche le problème "perdu dans le défilement" où l'IA donne des réponses génériques qui ne s'engagent pas réellement avec le contenu spécifique du document.

Compactage pour Flux de Travail Étendus

Pour les flux de travail de longue durée et lourds en outils qui dépassent la fenêtre contextuelle standard, l'IA moderne prend en charge le "compactage" — une passe de compression consciente de la perte sur l'état de conversation antérieur qui préserve les informations pertinentes pour la tâche tout en réduisant considérablement l'empreinte des tokens.

Quand Utiliser le Compactage

- Flux d'agents multi-étapes avec de nombreux appels d'outils

- Longues conversations où les tours précédents doivent être conservés

- Raisonnement itératif au-delà de la fenêtre contextuelle maximale

Meilleures pratiques pour le compactage :

- Surveillez l'utilisation du contexte et planifiez à l'avance pour éviter d'atteindre les limites

- Compactez après les jalons majeurs (ex: phases lourdes en outils), pas à chaque tour

- Gardez les prompts fonctionnellement identiques lors de la reprise pour éviter la dérive de comportement

- Traitez les éléments compactés comme opaques ; n'analysez pas ou ne dépendez pas des internes

Exigences de Citation

<citation_rules>

Lorsque tu utilises des informations provenant de documents fournis :

- Place des citations après chaque paragraphe contenant des affirmations dérivées du document

- Utilise le format : [Nom du Document, Section/Page]

- N'invente pas de citations. Si tu ne peux pas le citer, ne l'affirme pas

- Utilise plusieurs sources pour les affirmations clés lorsque c'est possible

- Si les preuves sont minces, reconnais-le explicitement

</citation_rules>Orchestration des Outils - Capacités Avancées de l'IA

L'appel d'outils IA — invoquer des fonctions externes, des API et des services — est là où l'ingénierie des prompts devient de l'ingénierie logicielle. Bien faire cela est crucial pour des applications IA fiables.

Meilleures Pratiques de Description d'Outil

La qualité des descriptions d'outils impacte directement la façon dont l'IA les utilise :

{

"name": "create_reservation",

"description": "Créer une réservation de restaurant pour un invité. Utiliser lorsque

l'utilisateur demande de réserver une table avec un nom et une heure donnés.",

"parameters": {

"type": "object",

"properties": {

"name": {

"type": "string",

"description": "Nom complet de l'invité pour la réservation."

},

"datetime": {

"type": "string",

"description": "Date et heure de la réservation (format ISO 8601)."

}

},

"required": ["name", "datetime"]

}

}Notez que la description inclut à la fois ce que l'outil fait et quand l'utiliser. Cela aide le modèle à prendre de meilleures décisions de sélection d'outils.

Règles d'Utilisation des Outils

<tool_usage_rules>

- Si un outil existe pour une action, préfère l'outil aux commandes shell

(ex: read_file au lieu de cat)

- Évite strictement cmd/terminal brut lorsqu'un outil dédié existe

- Préfère les outils aux connaissances internes chaque fois que :

- Tu as besoin de données fraîches ou spécifiques à l'utilisateur (tickets, commandes, configs, logs)

- Tu fais référence à des ID spécifiques, des URL ou des titres de documents

- Après tout appel d'outil d'écriture/mise à jour, réaffirme brièvement :

- Ce qui a changé

- Où (ID ou chemin)

- Toute validation de suivi effectuée

- Pour les questions conceptuelles simples, évite les outils et compte sur les connaissances

internes pour des réponses rapides

</tool_usage_rules>Parallélisation

Une optimisation clé est d'encourager les appels d'outils parallèles lorsque les opérations sont indépendantes :

<parallelization_spec>

Exécute des actions d'outils indépendantes ou en lecture seule en parallèle (même tour/lot)

pour réduire la latence.

Quand paralléliser :

- Lecture de plusieurs fichiers/configs/logs qui ne s'affectent pas mutuellement

- Analyse statique, recherches ou requêtes de métadonnées sans effets secondaires

- Modifications séparées de fichiers/fonctionnalités non liés qui ne seront pas en conflit

Quand NE PAS paralléliser :

- Opérations où l'une dépend du résultat d'une autre

- Créer une ressource puis référencer son ID

- Lire un fichier puis éditer en fonction du contenu

Méthode :

- Penser d'abord : Avant tout appel d'outil, décide de TOUS les fichiers/ressources dont tu as besoin

- Tout grouper : Si tu as besoin de plusieurs fichiers, lis-les ensemble

- Fais des appels séquentiels seulement si tu ne peux vraiment pas connaître le fichier suivant

sans voir un résultat d'abord

</parallelization_spec>Outils Enveloppant le Terminal

Si vous voulez que l'IA utilise des outils dédiés au lieu de commandes de terminal, rendez-les sémantiquement similaires à ce que le modèle attend :

GIT_TOOL = {

"type": "function",

"name": "git",

"description": (

"Exécuter une commande git à la racine du dépôt. Se comporte comme "

"l'exécution de git dans le terminal ; prend en charge toute sous-commande et drapeaux."

),

"parameters": {

"type": "object",

"properties": {

"command": {

"type": "string",

"description": "La commande git à exécuter"

}

},

"required": ["command"]

}

}

# Ensuite dans ton prompt :

"Utilise l'outil `git` pour toutes les opérations git. N'utilise pas le terminal pour git."Dépannage - Réparer Ce Qui Ne Va Pas

Après avoir travaillé avec d'innombrables prompts, j'ai identifié les modèles d'échec les plus courants et leurs solutions.

Problème : Trop Réfléchir

Symptômes : La réponse est correcte mais prend une éternité. Le modèle continue d'explorer des options, retarde le premier appel d'outil, raconte un voyage détourné quand une réponse simple était disponible.

<efficient_context_spec>

Objectif : Obtenir assez de contexte rapidement et arrêter dès que tu peux agir.

Méthode :

- Commencer large, puis se déployer vers des sous-requêtes ciblées

- En parallèle, lancer 4-8 requêtes variées ; lire les 3-5 meilleurs résultats par requête

- Dédupliquer les chemins et mettre en cache ; ne pas répéter les requêtes

Arrêt anticipé (agir si l'un) :

- Tu peux nommer les fichiers/symboles exacts à changer

- Tu peux repro un test/lint qui échoue ou avoir un locus de bug à haute confiance

</efficient_context_spec>

# Ajouter aussi une voie rapide pour les questions simples :

<fast_path>

Pour les connaissances générales ou les requêtes d'utilisation simples qui ne nécessitent pas

de commandes, de navigation ou d'appels d'outils :

- Réponds immédiatement et de manière concise

- Pas de mises à jour de statut, pas de todos, pas de résumés, pas d'appels d'outils

</fast_path>Problème : Sous-réflexion / Paresse

Symptômes : Le modèle n'a pas passé assez de temps à raisonner avant de produire une réponse. Réponses superficielles, cas limites manqués, solutions incomplètes.

<self_reflection>

- Notez le projet en interne par rapport à une rubrique de 5-7 éléments que tu conçois

(clarté, exactitude, cas limites, exhaustivité, latence)

- Si une catégorie est insuffisante, itère une fois avant de répondre

</self_reflection>

# Ou utilise un effort de raisonnement plus élevé dans les paramètres APIProblème : Trop Déférent

Symptômes : L'IA continue de demander la permission au lieu d'agir. Constant "Voulez-vous que je..." au lieu de simplement le faire.

<persistence>

- Tu es un agent — continue jusqu'à ce que la requête de l'utilisateur soit complètement

résolue avant de terminer ton tour

- Termine seulement quand tu es sûr que le problème est résolu

- Ne t'arrête jamais ou ne renvoie jamais la main quand tu rencontres une incertitude — déduis

l'approche la plus raisonnable et continue

- Ne demande pas de confirmer ou clarifier les hypothèses — décide ce qui est

le plus raisonnable, procède, et documente pour référence après

</persistence>Problème : Trop Verbeux

Symptômes : L'IA génère beaucoup plus de tokens que nécessaire. Beaucoup de préambules, d'explications excessives, de résumés répétitifs.

# Utilise le paramètre de verbosité API : "low"

# Ou dans le prompt :

<output_format>

- Défaut : 3-6 phrases ou ≤5 puces

- Évite les longs paragraphes narratifs ; préfère les puces compactes

- Ne reformule pas ma demande sauf si cela change la sémantique

- Pas de préambules comme "Excellente question !" ou "Je serais heureux d'aider"

</output_format>Problème : Trop d'Appels d'Outils

Symptômes : Le modèle déclenche des outils sans faire avancer la réponse. Appels redondants, exploration de tangentes, n'utilise pas le contexte efficacement.

<tool_use_policy>

- Sélectionne un outil ou aucun ; préfère répondre à partir du contexte quand c'est possible

- Plafonne les appels d'outils à 2 par demande utilisateur sauf si de nouvelles informations rendent

plus strictement nécessaire

- Avant d'appeler un outil, vérifie que tu as réellement besoin de l'information

</tool_use_policy>Problème : Appels d'Outils Malformés

Symptômes : Les appels d'outils échouent, produisent une sortie de déchets ou ne correspondent pas au format attendu. Souvent causé par des contradictions dans le prompt.

S'il te plaît, analyse pourquoi l'appel d'outil [tool_name] est malformé.

1. Passe en revue l'exemple de problème fourni pour comprendre le mode d'échec

2. Examine le Prompt Système et la Config d'Outil soigneusement

3. Identifie toute ambiguïté, incohérence ou formulation qui pourrait

induire le modèle en erreur

4. Pour chaque cause potentielle, explique comment elle pourrait entraîner

l'échec observé

5. Fournis des recommandations exploitables pour améliorer le prompt ou

la config d'outilLa plupart des problèmes d'appels d'outils malformés proviennent de contradictions entre différentes sections du prompt. Le modèle brûle des tokens de raisonnement en essayant de concilier des instructions contradictoires au lieu d'aider.

Optimisation des Prompts - L'Approche Scientifique

Concevoir des prompts efficaces est une compétence, mais les améliorer est une science. Voici l'approche systématique que j'utilise.

Échecs de Prompts Courants

Avant d'optimiser, comprenez ce qui ne va généralement pas :

"Préférer la bibliothèque standard" puis "utiliser des packages externes s'ils simplifient les choses" - L'IA ne peut pas concilier ces signaux mixtes.

"Viser des résultats exacts ; les méthodes approximatives sont acceptables quand elles ne changent pas le résultat en pratique" - le modèle ne peut pas vérifier cet appel de jugement.

Si vous avez besoin de JSON, dites-le. Si vous avez besoin de puces, dites-le. Ne laissez pas le format de sortie au hasard.

Vos instructions disent une chose mais vos exemples montrent autre chose. L'IA suit les exemples plus que la prose.

La Boucle d'Optimisation

Exécutez votre prompt actuel plusieurs fois et documentez les résultats. Notez les modèles dans les succès et les échecs.

Catégorisez les échecs. Sont-ils des problèmes d'exactitude ? Des problèmes de format ? Des problèmes d'efficacité ? Chacun nécessite des correctifs différents.

Changez une chose à la fois. Si vous changez plusieurs choses, vous ne saurez pas ce qui a aidé.

Exécutez les mêmes tests à nouveau. Comparez à la base. Le changement a-t-il aidé, nui ou n'a-t-il eu aucun effet ?

Répétez jusqu'à ce que vous atteigniez une performance acceptable. Gardez des notes sur ce qui a fonctionné et ce qui n'a pas fonctionné.

Migration Entre Modèles

Lors de la migration des prompts vers une nouvelle version de modèle :

Meilleures Pratiques de Migration

- Étape 1 : Changez de modèle, ne changez pas encore les prompts. Testez le changement de modèle — pas les modifications de prompt.

- Étape 2 : Épinglez l'effort de raisonnement pour correspondre au profil du modèle précédent.

- Étape 3 : Exécutez des évaluations pour la base. Si les résultats semblent bons, vous êtes prêt à expédier.

- Étape 4 : S'il y a des régressions, ajustez le prompt avec des contraintes ciblées.

- Étape 5 : Réexécutez les évaluations après chaque petit changement. Un changement à la fois.

Gérer l'Incertitude - Quand l'IA Ne Sait Pas

L'un des plus grands risques avec l'IA est les réponses incorrectes qui semblent confiantes. Le modèle ne sait pas ce qu'il ne sait pas — à moins que vous ne lui appreniez à gérer l'incertitude.

<uncertainty_handling>

- Si la question est ambiguë ou sous-spécifiée, signale-le explicitement et :

- Pose jusqu'à 1-3 questions de clarification précises, OU

- Présente 2-3 interprétations plausibles avec des hypothèses clairement étiquetées

- Lorsque des faits externes peuvent avoir changé récemment (prix, versions,

politiques) et qu'aucun outil n'est disponible :

- Réponds en termes généraux et déclare que les détails peuvent avoir changé

- Ne fabrique jamais de chiffres exacts, de numéros de ligne ou de références externes

quand tu es incertain

- Quand tu n'es pas sûr, préfère un langage comme "Basé sur le contexte

fourni..." au lieu d'affirmations absolues

</uncertainty_handling>Auto-Vérification à Haut Risque

Pour les domaines à enjeux élevés, ajoutez une étape d'auto-vérification explicite :

<high_risk_self_check>

Avant de finaliser une réponse dans des contextes juridiques, financiers, de conformité ou

sensibles à la sécurité :

- Scanne brièvement ta propre réponse pour :

- Hypothèses non déclarées

- Nombres spécifiques ou affirmations non fondées dans le contexte

- Langage excessivement fort ("toujours", "garanti", etc.)

- Si tu en trouves, adoucis ou qualifie-les et déclare explicitement les hypothèses

</high_risk_self_check>Le but n'est pas de rendre l'IA moins confiante — c'est de la rendre confiante avec précision. L'incertitude sur des choses incertaines est une fonctionnalité, pas un bug.

Métaprompting - Utiliser l'IA pour Améliorer l'IA

Voici la technique la plus méta de ma boîte à outils : utiliser l'IA pour améliorer vos prompts. Cela semble circulaire, mais c'est incroyablement efficace.

Diagnostiquer les Échecs de Prompts

Tu es un ingénieur de prompt chargé de déboguer un prompt système.

On te donne :

1) Le prompt système actuel :

<system_prompt>

[COLLE TON PROMPT ICI]

</system_prompt>

2) Un petit ensemble d'échecs enregistrés. Chaque log a :

- requête

- sortie_réelle

- sortie_attendue (ou description du problème)

<failure_traces>

[COLLE DES EXEMPLES D'ÉCHECS]

</failure_traces>

Tes tâches :

1) Identifie les modes d'échec distincts que tu vois

2) Pour chaque mode d'échec, cite les lignes spécifiques du prompt système

qui causent ou renforcent le plus probablement cela

3) Explique comment ces lignes orientent l'agent vers le

comportement observé

Retourne ta réponse au format structuré :

failure_modes:

- name: ...

description: ...

prompt_drivers:

- exact_or_paraphrased_line: ...

- why_it_matters: ...Générer des Améliorations

Tu as précédemment analysé ce prompt système et ses modes d'échec.

Prompt système :

<system_prompt>

[PROMPT ORIGINAL]

</system_prompt>

Analyse des modes d'échec :

[COLLE LE DIAGNOSTIC DE L'ÉTAPE PRÉCÉDENTE]

S'il te plaît, propose une révision chirurgicale qui réduit les problèmes observés

tout en préservant les bons comportements.

Contraintes :

- Ne redessine pas l'agent à partir de zéro

- Préfère de petites modifications explicites : clarifie les règles contradictoires, supprime

les lignes redondantes ou contradictoires, resserre les conseils vagues

- Rends les compromis explicites

- Garde la structure et la longueur à peu près similaires à l'original

Sortie :

1) patch_notes : une liste concise des changements clés et du raisonnement

2) revised_system_prompt : le prompt complet mis à jour avec les modifications appliquéesAuto-Réflexion pour la Qualité

Cette technique est époustouflante : instruisez l'IA de créer ses propres critères d'évaluation et d'itérer contre eux :

<self_reflection>

- D'abord, passe du temps à penser à une rubrique jusqu'à ce que tu sois confiant

- Pense profondément à chaque aspect de ce qui fait une solution

de classe mondiale. Utilise cette connaissance pour créer une rubrique qui a 5-7

catégories. Cette rubrique est critique à bien faire, mais ne

me la montre pas — c'est pour tes besoins seulement.

- Enfin, utilise la rubrique pour penser en interne et itérer sur la

meilleure solution possible au prompt

- Si ta réponse n'atteint pas les meilleures notes dans toutes

les catégories de la rubrique, recommence

</self_reflection>Vous demandez à l'IA de générer des critères de qualité à partir de sa connaissance de l'excellence, puis d'utiliser ces critères pour évaluer et améliorer sa propre sortie — tout cela avant que vous ne voyiez quoi que ce soit. L'amélioration de la qualité de sortie est substantielle.

Modèles Éprouvés Que Vous Pouvez Utiliser Aujourd'hui

Achèvement de Tâche Universel

<context>

[Informations de base dont l'IA a besoin pour comprendre la situation]

</context>

<task>

[Déclaration claire de ce que vous voulez faire]

</task>

<requirements>

[Exigences ou contraintes spécifiques]

</requirements>

<format>

[Comment vous voulez que la sortie soit structurée]

</format>

<examples>

[Optionnel : Exemples de sortie souhaitée]

</examples>Modèle de Revue de Code

<context>

Je revois le code pour [projet/contexte].

La base de code utilise [technologies/modèles].

</context>

<code_to_review>

[Collez le code ici]

</code_to_review>

<review_criteria>

Concentre-toi sur :

1. Exactitude : Fait-il ce qu'il prétend ?

2. Lisibilité : Est-ce clair pour les autres développeurs ?

3. Performance : Y a-t-il des inefficacités évidentes ?

4. Sécurité : Y a-t-il des vulnérabilités ?

5. Style : Correspond-il aux conventions de la base de code ?

</review_criteria>

<output_format>

Pour chaque problème trouvé :

- Sévérité : [Critique/Majeur/Mineur/Suggestion]

- Emplacement : [Numéro de ligne ou section]

- Problème : [Ce qui ne va pas]

- Correctif : [Comment le résoudre]

</output_format>Modèle d'Analyse de Recherche

<research_task>

[Sujet ou question à rechercher]

</research_task>

<methodology>

- Commence par plusieurs recherches ciblées ; ne compte pas sur une seule requête

- Recherche profondément jusqu'à ce que tu aies suffisamment d'informations pour une

réponse précise et complète

- Ajoute des recherches de suivi ciblées pour combler les lacunes ou résoudre les désaccords

- Continue d'itérer jusqu'à ce qu'une recherche supplémentaire soit peu susceptible de changer

la réponse

</methodology>

<output_requirements>

- Commence par une réponse claire à la question principale

- Soutiens avec des preuves et des citations

- Reconnais les limites et les incertitudes

- Fournis des exemples concrets si utile

- Inclus le contexte pertinent pour comprendre les implications

</output_requirements>

<citation_format>

[Comment vous voulez que les sources soient citées]

</citation_format>Agent de Recherche Web

<core_mission>

Réponds à la question de l'utilisateur pleinement et utilement, avec assez de preuves

qu'un lecteur sceptique puisse lui faire confiance.

N'invente jamais de faits. Si tu ne peux pas vérifier quelque chose, dis-le clairement.

Par défaut, sois détaillé et utile plutôt que court.

Après avoir répondu à la question directe, ajoute du matériel adjacent de haute valeur

qui soutient l'objectif sous-jacent de l'utilisateur sans s'éloigner du sujet.

</core_mission>

<research_rules>

- Commence par plusieurs recherches ciblées ; utilise des recherches parallèles

- Ne compte jamais sur une seule requête

- Continue d'itérer jusqu'à ce que tout soit vrai :

- Tu as répondu à chaque partie de la question

- Tu as trouvé des exemples concrets et du matériel adjacent de haute valeur

- Tu as trouvé des sources suffisantes pour les affirmations principales

</research_rules>

<citation_rules>

- Place des citations après chaque paragraphe contenant des affirmations

dérivées du web non évidentes

- N'invente pas de citations

- Utilise plusieurs sources pour les affirmations clés lorsque c'est possible

</citation_rules>

<ambiguity_handling>

- Ne pose jamais de questions de clarification sauf si l'utilisateur le demande explicitement

- Si la requête est ambiguë, énonce ta meilleure interprétation, puis

couvre complètement les intentions les plus probables

</ambiguity_handling>L'Avenir de l'Ingénierie des Prompts

Alors que j'écris ceci au début de 2026, l'ingénierie des prompts évolue rapidement. Les modèles deviennent plus capables, plus dirigeables et plus fiables. Certains prédisent que l'ingénierie des prompts deviendra obsolète à mesure que l'IA s'améliorera pour comprendre l'intention. Je ne suis pas d'accord.

Ce qui change, c'est le niveau de l'ingénierie des prompts, pas sa nécessité. Les premiers jours nécessitaient des prompts élaborés pour des tâches de base. Maintenant, les tâches de base fonctionnent dès la sortie de la boîte, mais les flux de travail agentiques complexes nécessitent toujours un prompting sophistiqué. La barre monte, elle ne disparaît pas.

L'ingénierie des prompts ne disparaît pas ; elle évolue. Les compétences qui comptent passent de "comment faire fonctionner l'IA" à "comment faire fonctionner l'IA excellemment et de manière fiable à grande échelle."

Ce Qui Arrive

Meilleurs Comportements par Défaut

Les modèles auront des défauts plus intelligents, nécessitant moins d'instructions explicites pour les modèles courants. Les prompts se concentreront plus sur la personnalisation que sur la capacité de base.

Écosystèmes d'Outils Plus Riches

L'IA aura accès à plus d'outils dès la sortie de la boîte. L'ingénierie des prompts se déplacera vers l'orchestration — savoir quand utiliser quoi, pas juste comment.

Intégration Multimodale

Les prompts impliqueront de plus en plus d'images, d'audio, de vidéo et de données structurées aux côtés du texte. De nouveaux modèles émergeront pour les tâches multimodales.

Complexité Agentique

À mesure que les agents gèrent des tâches plus longues et plus complexes, l'ingénierie des prompts deviendra plus comme la conception de systèmes — architecture, pas seulement instructions.

Mon Conseil pour l'Avenir

Concentrez-vous sur les fondamentaux. Les techniques spécifiques de ce guide évolueront, mais les principes sous-jacents — communication claire, attentes explicites, pensée structurée, raffinement itératif — sont intemporels. Maîtrisez-les, et vous vous adapterez à tout ce qui viendra ensuite.

Dernières Pensées

Il y a deux ans, je pensais que l'IA remplacerait le besoin de communiquer clairement. J'avais complètement tort. L'IA a rendu la communication claire plus précieuse que jamais. Les gens qui prospèrent avec l'IA ne sont pas ceux qui ont trouvé des mots magiques — ce sont ceux qui ont appris à penser et à s'exprimer avec précision.

L'ingénierie des prompts ne concerne pas vraiment l'IA. Elle vous concerne. Il s'agit de développer la discipline pour articuler ce que vous voulez réellement, la patience pour itérer vers cela, et l'humilité d'apprendre de ce qui ne fonctionne pas.

Si vous ne retenez qu'une chose de ce guide, que ce soit ceci : traitez chaque prompt comme une chance de pratiquer la pensée claire. L'IA n'est qu'un miroir reflétant la clarté — ou la confusion — de votre propre esprit.

L'émergence de l'IA n'a pas rendu la connaissance obsolète — elle a rendu la curiosité plus puissante que jamais. Nous ne sommes plus limités par ce que nous savons déjà. Avec les bons outils et la volonté de penser, les gens ordinaires peuvent embrasser un océan de connaissances. Peu importe la profession. Peu importe l'âge. J'espère partager ce voyage avec des amis du monde entier. Ensemble, accueillons ce nouveau monde. Ensemble, grandissons.

Discussion

0 commentairesLaisser un commentaire

Soyez le premier à partager vos pensées !