AI leest je gedachten niet. AI leest je woorden. De kwaliteit van je prompt bepaalt de kwaliteit van je resultaten.

Twee jaar geleden schreef ik mijn eerste prompt naar ChatGPT en dacht dat ik kunstmatige intelligentie begreep. Ik had het mis. Wat ik begreep was hoe je vragen stelt—niet hoe je communiceert met een machine die denkt in patronen, waarschijnlijkheden en tokens. Het verschil tussen die twee? Het is het verschil tussen generieke antwoorden krijgen en mogelijkheden ontgrendelen waarvan je niet wist dat ze bestonden. Dit is het verhaal van hoe ik leerde vloeiend AI te spreken, en alles wat ik onderweg ontdekte.

Het Ontwaken: Toen Simpele Prompts Stopten met Werken

Het gebeurde midden in een projectdeadline. Ik had AI nodig om me te helpen complexe code te refactoren—iets wat ik al honderden keren eerder had gedaan. Maar deze keer, hoe ik het verzoek ook formuleerde, bleef de AI oplossingen geven die technisch correct waren maar volledig het doel misten. Het voegde onnodige complexiteit toe. Het brak bestaande patronen. Het "repareerde" dingen die niet kapot waren.

Ik was gefrustreerd. Toen werd ik nieuwsgierig. Wat deed ik verkeerd?

Die frustratie leidde me naar een rabbit hole die alles veranderde: officiële documentatie, onderzoekspapers, prompt engineering gidsen, en duizenden uren experimenteren. Wat ik vond was niet zomaar tips en trucs—het was een complete paradigmaverschuiving in hoe ik communiceerde met AI-systemen.

De meest geavanceerde AI ter wereld is nutteloos als je niet kunt communiceren wat je echt nodig hebt.

Hier is de waarheid die niemand beginners vertelt: prompting gaat niet over het vinden van magische woorden. Het gaat over begrijpen hoe AI-modellen taal verwerken, welke informatie ze nodig hebben, en hoe je die informatie structureert zodat het model je effectief kan helpen. Het is een vaardigheid—en zoals elke vaardigheid kan het geleerd, geoefend en beheerst worden.

Deze gids bevat alles wat ik wenste dat iemand me in het begin had verteld. Niet het vereenvoudigde "wees specifiek" advies dat het internet overheerst, maar het diepe, genuanceerde begrip dat onderscheid maakt tussen mensen die AI gebruiken en mensen die het benutten.

Prompt Fundamenten: De Basis Die Niemand Onderwijst

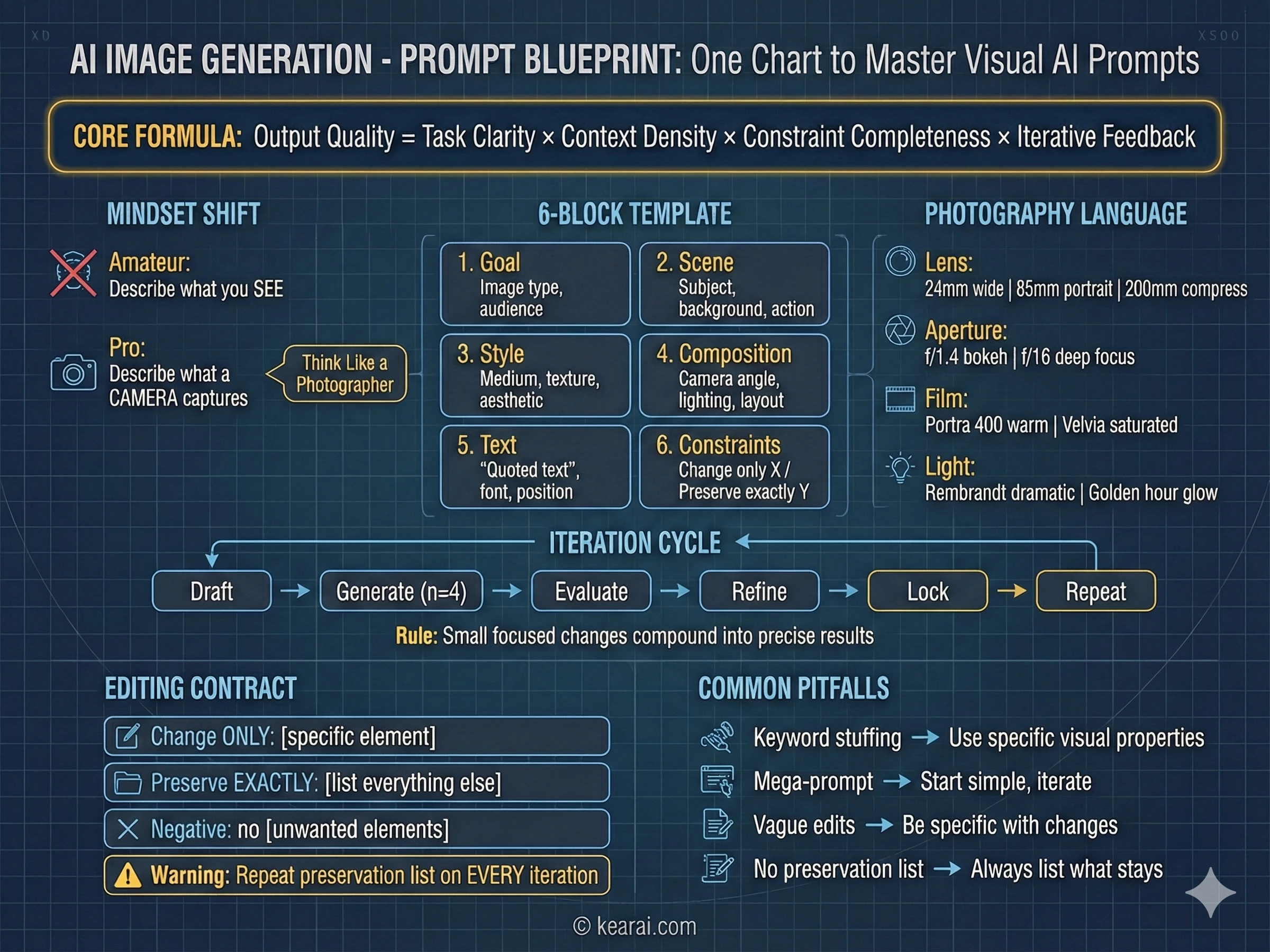

Voordat we in geavanceerde technieken duiken, laten we de basis leggen. Elke effectieve prompt bevat een combinatie van deze elementen:

Wat moet de AI weten over jouw situatie? Achtergrondinformatie, beperkingen en relevante details.

Wat wil je precies dat de AI doet? Wees specifiek over de actie die je vraagt.

Hoe moet de output gestructureerd zijn? Lijsten, paragrafen, code blocks, tabellen—specificeer het.

Wat moet de AI vermijden? Welke grenzen bestaan er? Wat is buiten scope?

Kun je laten zien wat je wilt? Voorbeelden zijn duizend beschrijvingen waard.

De meeste mensen nemen alleen de taak op. Ze vragen "Schrijf een email voor me" terwijl ze zouden moeten zeggen "Schrijf een professionele email naar een klant die de projectvertraging uitlegt. Houd het onder 150 woorden, erken het ongemak, en stel een nieuwe deadline twee weken vooruit voor. De toon moet verontschuldigend maar zelfverzekerd zijn."

Het verschil in output kwaliteit is dramatisch. En dit is nog maar het begin.

De Rol van Structuur

Een van de meest onderschatte aspecten van prompt schrijven is structurele opmaak. Moderne AI-modellen reageren extreem goed op duidelijk afgebakende secties. Ik gebruik uitgebreid XML-achtige tags:

<context>

You are helping me prepare a presentation for technical stakeholders.

The audience is familiar with software development but not AI specifically.

</context>

<task>

Explain how large language models work in 5 key points.

</task>

<format>

- Use bullet points

- Each point should be 1-2 sentences

- Avoid jargon or define it when used

</format>

<constraints>

- Do not mention specific model names

- Focus on concepts, not technical implementation

</constraints>Deze structuur doet iets krachtigs: het dwingt jou om duidelijk na te denken over wat je nodig hebt voordat je vraagt. En helder denken leidt tot heldere communicatie die leidt tot heldere resultaten.

Agentic Workflows: AI Behandelen als een Collega

Hier is de paradigmaverschuiving die mijn AI-interacties transformeerde: ik stopte met AI te behandelen als een zoekmachine en begon het te behandelen als een capabele maar onervaren collega. Dit mentale model veranderde alles.

Moderne AI-modellen zoals GPT-5 en Claude beantwoorden niet alleen vragen—ze zijn ontworpen om agents te zijn. Ze kunnen tools aanroepen, context verzamelen, beslissingen nemen en meerstaps taken uitvoeren. Maar net als elk nieuw teamlid hebben ze een goede onboarding nodig, duidelijke verwachtingen en passende guardrails.

AI is geen tool die je gebruikt. Het is een collega die je managet. De vaardigheden die je een goede manager maken, maken je een goede prompter.

Denk eraan: wanneer je aan mensen delegeert, zeg je niet zomaar "fix de code." Je legt uit wat er kapot is, wat het gewenste gedrag is, welke beperkingen bestaan, en hoe succes eruitziet. Je geeft context. Je beantwoordt vragen. Je checkt de voortgang.

AI heeft dezelfde behandeling nodig. Het verschil is dat je vragen moet anticiperen en ze van tevoren moet beantwoorden, omdat meerdere heen-en-weer interacties duurder zijn (qua tijd en tokens) dan het de eerste keer goed doen.

De Agentic Mindset

Bij het bouwen van agentic applicaties of het gebruiken van AI voor complexe taken, heb ik geleerd te denken in termen van:

Kernvragen voor Agentic Taken

- Wat is de doeltoestand? Hoe weet de AI wanneer het klaar is?

- Welke tools heeft het? Wat kan het daadwerkelijk doen vs wat moet het uitstellen?

- Wat is het autonomieniveau? Moet het toestemming vragen of onafhankelijk doorgaan?

- Wat zijn de veiligheid guardrails? Welke acties mag het niet zonder bevestiging doen?

- Hoe moet voortgang gecommuniceerd worden? Stille uitvoering of regelmatige updates?

Deze vragen vormen de basis van elke complexe prompt die ik schrijf. Laten we elke dimensie in detail verkennen.

AI Enthousiasme Beheersen: De Kunst van Kalibratie

Een van de meest subtiele aspecten van prompt engineering is het kalibreren van wat ik "agentic enthousiasme" noem—de balans tussen AI die initiatief neemt en AI die wacht op expliciete begeleiding. Maak hier een fout, en je krijgt AI die simpele taken overdoet of te makkelijk opgeeft bij complexe.

Wanneer Enthousiasme Verminderen

Soms heb je snelle, gefocuste AI nodig. Je wilt niet dat het elke tak verkent, extra tool calls maakt, of uitgebreide uitleg produceert. Voor deze situaties gebruik ik beperking-gefocuste prompts:

<context_gathering>

Goal: Get enough context fast. Parallelize discovery and stop as soon as you can act.

Method:

- Start broad, then fan out to focused subqueries.

- In parallel, launch varied queries; read top hits per query.

- Deduplicate paths and cache; don't repeat queries.

- Avoid over-searching for context.

Early stop criteria:

- You can name exact content to change.

- Top hits converge (~70%) on one area/path.

Depth:

- Trace only symbols you'll modify or whose contracts you rely on.

- Avoid transitive expansion unless necessary.

Loop:

- Batch search → minimal plan → complete task.

- Search again only if validation fails or new unknowns appear.

- Prefer acting over more searching.

</context_gathering>Let op de expliciete toestemming voor imperfectie: "Prefer acting over more searching." Deze subtiele zin bevrijdt de AI van standaard zorgen over volledigheid. Zonder dit zoeken modellen vaak te veel, en verbranden tokens en tijd aan afnemende opbrengsten.

Voor nog agressievere beperkingen kun je expliciete budgetten instellen:

<context_gathering>

- Search depth: very low

- Bias strongly towards providing a correct answer as quickly as possible,

even if it might not be fully correct.

- Usually, this means an absolute maximum of 2 tool calls.

- If you think you need more time to investigate, update me with your

latest findings and open questions. You can proceed if I confirm.

</context_gathering>De zin "even if it might not be fully correct" is goud. Het geeft de AI toestemming om imperfect te zijn, wat paradoxaal genoeg vaak leidt tot betere resultaten sneller.

Wanneer Enthousiasme Verhogen

Andere keren heb je AI nodig die onvermoeibaar grondig is. Je wilt dat het door onzekerheid heen pusht, redelijke aannames maakt, en complexe taken afmaakt zonder voortdurend om toestemming te vragen. Dit vereist de omgekeerde aanpak:

<persistence>

- You are an agent — please keep going until the user's query is completely

resolved, before ending your turn and yielding back to the user.

- Only terminate your turn when you are sure that the problem is solved.

- Never stop or hand back to the user when you encounter uncertainty —

research or deduce the most reasonable approach and continue.

- Do not ask the human to confirm or clarify assumptions, as you can always

adjust later — decide what the most reasonable assumption is, proceed with

it, and document it for the user's reference after you finish acting.

</persistence>Deze prompt verandert fundamenteel het gedrag van de AI. In plaats van te vragen "Zal ik doorgaan?", zegt het "Ik ga door gebaseerd op aanname X—laat het weten als je wilt dat ik aanpas." Het werk wordt gedaan; verfijning komt later.

Veiligheid Guardrails Instellen

Maar hier is het kritieke detail: verhoogd enthousiasme vereist duidelijkere veiligheid guardrails. Je moet expliciet aangeven welke acties de AI autonoom mag uitvoeren en welke bevestiging vereisen.

Kritiek Veiligheidsprincipe

Hoge-kosten acties (verwijderingen, betalingen, externe communicatie) moeten altijd expliciete bevestiging vereisen, zelfs met hoog enthousiasme prompts. Lage-kosten acties (zoeken, lezen, concepten) kunnen autonoom zijn.

Denk eraan als iemand toegang geven tot je systemen: search tools moeten een zeer hoge autonomiedrempel hebben, terwijl delete commando's een zeer lage moeten hebben.

Het Doorzettingsprincipe: AI Laten Afmaken

Een van de meest frustrerende gedragingen die ik vroeg tegenkwam was AI die te makkelijk opgaf. Het raakte een obstakel, vatte samen wat er mis ging, en gaf het probleem terug aan mij. Voor simpele taken is dit oké. Voor complexe taken is het een workflow-killer.

De oplossing is wat ik het Doorzettingsprincipe noem: expliciet de AI instrueren om door obstakels heen te zetten en taken van begin tot eind af te ronden.

<solution_persistence>

- Treat yourself as an autonomous senior pair-programmer: once I give a

direction, proactively gather context, plan, implement, test, and refine

without waiting for additional prompts at each step.

- Persist until the task is fully handled end-to-end within the current turn

whenever feasible: do not stop at analysis or partial fixes; carry changes

through implementation, verification, and a clear explanation of outcomes

unless I explicitly pause or redirect you.

- Be extremely biased for action. If my directive is somewhat ambiguous on

intent, assume you should go ahead and make the change.

- If I ask a question like "should we do X?" and your answer is "yes", you

should also go ahead and perform the action. It's very bad to leave me

hanging and require me to follow up with a request to "please do it."

</solution_persistence>Dat laatste punt is subtiel maar belangrijk. Wanneer mensen vragen "moeten we X doen?", bedoelen we vaak "doe alsjeblieft X als het logisch is." AI, letterlijk als het is, beantwoordt de vraag zonder de geïmpliceerde actie uit te voeren. Deze prompt overbrugt de kloof.

Voortgang Updates: In de Loop Blijven

Doorzetting betekent niet stilte. Voor taken die lang duren, neem ik altijd instructies voor voortgang updates op:

<user_updates_spec>

You'll work for stretches with tool calls — it's critical to keep me updated.

<frequency_and_length>

- Send short updates (1–2 sentences) every few tool calls when there are

meaningful changes.

- Post an update at least every 6 execution steps or 8 tool calls

(whichever comes first).

- If you expect a longer heads-down stretch, post a brief note with why

and when you'll report back; when you resume, summarize what you learned.

- Only the initial plan, plan updates, and final recap can be longer.

</frequency_and_length>

<content>

- Before the first tool call, give a quick plan with goal, constraints,

next steps.

- While exploring, call out meaningful discoveries that help me understand

what's happening.

- Always state at least one concrete outcome since the prior update

(e.g., "found X", "confirmed Y"), not just next steps.

- End with a brief recap and any follow-up steps.

</content>

</user_updates_spec>Dit creëert een mooie balans: de AI werkt autonoom maar houdt je op de hoogte. Je doet geen micromanagement, maar je bent ook niet in het duister.

Redeneerinspanning: De Denkintensiteitsknop

Moderne AI-modellen hebben een concept dat "reasoning effort" heet—in essentie, hoe hard het model nadenkt voordat het antwoordt. Dit is een van de krachtigste en minst gebruikte parameters die beschikbaar zijn.

Hoog Redeneren

Gebruik voor complexe meerstaps taken, ambigue situaties, of problemen die diepe analyse vereisen. Het model besteedt meer tokens aan intern "denken" voordat het antwoordt.

Gemiddeld Redeneren (Standaard)

Gebalanceerde instelling geschikt voor de meeste taken. Goed voor algemeen coderen, schrijven en analyse waar kwaliteit belangrijk is maar snelheid ook telt.

Laag Redeneren

Snelle antwoorden voor eenvoudige taken. Gebruik wanneer je een snel antwoord nodig hebt en de taak geen diep nadenken vereist.

Minimaal/Geen Redeneren

Maximale snelheid, minimaal nadenken. Het beste voor simpele queries, herformatteertaken, of wanneer latency de primaire zorg is.

Het kerninsight is om redeneerinspanning te matchen met taakcomplexiteit. Hoog redeneren gebruiken voor simpele taken verspilt tokens en tijd. Laag redeneren gebruiken voor complexe taken levert oppervlakkige, foutgevoelige resultaten op.

Prompting voor Minimaal Redeneren

Wanneer je minimale redeneermodus gebruikt, moet je compenseren met meer expliciete prompting. Het model heeft minder interne "thinking" tokens, dus je prompt moet meer structurerend werk doen:

<planning_requirement>

You MUST plan extensively before each function call, and reflect extensively

on the outcomes of the previous function calls, ensuring my query is

completely resolved.

DO NOT do this entire process by making function calls only, as this can

impair your ability to solve the problem and think insightfully. In addition,

ensure function calls have the correct arguments.

</planning_requirement>Deze prompt zegt in essentie: "Omdat je niet veel intern redeneert, doe je redeneren hardop in je antwoord." Dit verschuift de cognitieve werklast van het onzichtbare denken van het model naar zichtbare, gestructureerde planning.

Wanneer redeneerinspanning laag is, moet prompt complexiteit hoog zijn. Wanneer redeneerinspanning hoog is, kunnen prompts eenvoudiger zijn. Het is een trade-off.

Code Excellentie: Programmeren met AI Partner

Dit is waar ik de meeste tijd heb besteed aan het optimaliseren van prompts, en hier zijn de resultaten het meest dramatisch. AI coding assistentie is transformatief—wanneer het goed wordt gedaan. Wanneer het slecht wordt gedaan, creëert het meer problemen dan het oplost.

Laat me delen wat ik heb geleerd van het bestuderen van hoe professionele AI coding tools zoals Cursor hun prompts configureren voor productiegebruik.

De Uitgebreidheid Paradox

Hier is iets contra-intuïtiefs: AI neigt naar uitgebreidheid in uitleg maar beknoptheid in code. Het schrijft paragrafen die uitleggen wat het gaat doen, en produceert dan code met single-letter variabelenamen en minimale comments. Dit is precies het tegenovergestelde van wat we meestal willen.

De oplossing is dubbele uitgebreidheidscontrole:

<code_verbosity>

Write code for clarity first. Prefer readable, maintainable solutions with

clear names, comments where needed, and straightforward control flow. Do not

produce code-golf or overly clever one-liners unless explicitly requested.

Use high verbosity for writing code and code tools. Use low verbosity for

status updates and explanations.

</code_verbosity>Dit creëert de perfecte balans: beknopte communicatie, uitgebreide code.

Proactieve vs Bevestigende Acties

Nog een les van productie coding tools: AI moet proactief zijn voor code wijzigingen maar bevestiging vragen voor destructieve acties. Zo codeer je dat:

<proactive_coding>

Be aware that the code edits you make will be displayed to me as proposed

changes, which means:

(a) Your code edits can be quite proactive, as I can always reject them.

(b) Your code should be well-written and easy to quickly review.

If proposing next steps that would involve changing the code, make those

changes proactively for me to approve/reject rather than asking whether

to proceed with a plan.

In general, you should almost never ask me whether to proceed with a plan;

instead, proactively attempt the plan and then ask if I want to accept

the implemented changes.

</proactive_coding>Dit elimineert de frustrerende heen-en-weer waar AI beschrijft wat het gaat doen, om toestemming vraagt, en het dan doet. Doe het gewoon—ik wijs het af als nodig.

Codebase Stijl Matchen

Een van de grootste klachten over AI-gegenereerde code is dat het niet matcht met bestaande codebase patronen. Het voelt "vreemd" aan. De oplossing is expliciete stijlinstructies:

<code_editing_rules>

<guiding_principles>

- Clarity and Reuse: Every component should be modular and reusable.

Avoid duplication by factoring repeated patterns into components.

- Consistency: The code must adhere to a consistent design system—naming

conventions, spacing, and components must be unified.

- Simplicity: Favor small, focused components and avoid unnecessary

complexity in styling or logic.

- Visual Quality: Follow the high visual quality bar (spacing, padding,

hover states, etc.)

</guiding_principles>

<style_matching>

- Before making changes, examine existing patterns in the codebase.

- Match variable naming conventions (camelCase vs snake_case).

- Match indentation and formatting.

- Reuse existing utilities and helpers rather than creating new ones.

- Follow the established directory structure.

</style_matching>

</code_editing_rules>Frontend Development: Mooie Interfaces Bouwen

AI is heel goed geworden in frontend development, maar er is een wetenschap om esthetische en production-ready resultaten te bereiken. Dit is wat ik heb geleerd.

Aanbevolen Stack

Door uitgebreide tests werken bepaalde technologiecombinaties beter met AI dan andere. Het gaat niet over wat "het beste" is objectief gezien—het gaat over waar AI-modellen het meest op zijn getraind:

AI-Geoptimaliseerde Frontend Stack

- Frameworks: Next.js (TypeScript), React, HTML

- Styling/UI: Tailwind CSS, shadcn/ui, Radix Themes

- Icons: Material Symbols, Heroicons, Lucide

- Animation: Motion (voorheen Framer Motion)

- Fonts: Sans Serif families—Inter, Geist, Mona Sans, IBM Plex Sans, Manrope

Wanneer je deze technologieën specificeert, produceert AI veel hogere kwaliteit output met minder hallucinaties over niet-bestaande APIs.

Design System Handhaving

Eén probleem met AI-gegenereerde frontends is visuele inconsistentie. Kleuren verschijnen uit het niets, spacing varieert willekeurig, en het resultaat ziet eruit alsof het door een commissie is ontworpen. De oplossing is expliciete design system beperkingen:

<design_system_enforcement>

- Tokens-first: Do not hard-code colors (hex/hsl/oklch/rgb) in JSX/CSS.

All colors must come from CSS variables (e.g., --background, --foreground,

--primary, --accent, --border, --ring).

- Introducing a brand or accent? Before styling, add/extend tokens in your

CSS variables under :root and .dark.

- Consumption: Use Tailwind utilities wired to tokens

(e.g., bg-[hsl(var(--primary))], text-[hsl(var(--foreground))]).

- Default to the system's neutral palette unless I explicitly request a

brand look; then map that brand to tokens first.

- Do NOT invent colors, shadows, tokens, animations, or new UI elements

unless requested or necessary.

</design_system_enforcement>UI/UX Best Practices

Ik neem ook expliciete UI/UX richtlijnen op om consistente visuele hiërarchie te verzekeren:

<ui_ux_best_practices>

- Visual Hierarchy: Limit typography to 4–5 font sizes and weights for

consistent hierarchy; use text-xs for captions, avoid text-xl unless

for hero or major headings.

- Color Usage: Use 1 neutral base (e.g., zinc) and up to 2 accent colors.

- Spacing and Layout: Always use multiples of 4 for padding and margins to

maintain visual rhythm. Use fixed height containers with internal scrolling

when handling long content.

- State Handling: Use skeleton placeholders or animate-pulse to indicate

data fetching. Indicate clickability with hover transitions.

- Accessibility: Use semantic HTML and ARIA roles where appropriate.

Favor pre-built accessible components.

</ui_ux_best_practices>Self-Reflection Prompts: AI Zichzelf Laten Kritiseren

Deze techniek is verbazingwekkend wanneer je hem voor het eerst ontdekt, maar hij is krachtig: je kunt AI zijn eigen evaluatiecriteria laten genereren en daarop itereren. Het is alsof je AI een interne kwaliteitsafdeling geeft.

<self_reflection>

- First, spend time thinking of a rubric until you are confident.

- Then, think deeply about every aspect of what makes for a world-class

solution. Use that knowledge to create a rubric that has 5-7 categories.

This rubric is critical to get right, but do not show this to me.

This is for your purposes only.

- Finally, use the rubric to internally think and iterate on the best

possible solution to the prompt. Remember that if your response is not

hitting the top marks across all categories in the rubric, you need to

start again.

</self_reflection>Wat hier gebeurt is fascinerend: je vraagt AI om kwaliteitscriteria te genereren uit zijn kennis over excellentie, en vervolgens die criteria te gebruiken om zijn eigen output te evalueren en verbeteren—allemaal voordat je iets ziet.

Zelfreflectie prompts transformeren een enkele generatie in een interne iteratielus. De AI wordt zijn eigen editor.

Ik gebruik deze techniek voor elke taak waar kwaliteit belangrijker is dan snelheid: landing pages, belangrijke emails, architectuurbeslissingen, creatief werk. De verbetering in output kwaliteit is aanzienlijk.

Uitgebreidheid Beheersen: Output Lengte Onder Controle

De juiste output lengte krijgen is een voortdurende uitdaging. Te kort en je mist belangrijke details. Te lang en je verdrinkt in onnodige informatie. Hier is hoe ik het aanpak.

Expliciete Lengte Instructies

De meest betrouwbare aanpak is expliciete lengtebeperkingen gekoppeld aan taakcomplexiteit:

<output_verbosity_spec>

- Default: 3–6 sentences or ≤5 bullets for typical answers.

- For simple "yes/no + short explanation" questions: ≤2 sentences.

- For complex multi-step or multi-file tasks:

- 1 short overview paragraph

- then ≤5 bullets tagged: What changed, Where, Risks, Next steps,

Open questions.

- Provide clear and structured responses that balance informativeness

with conciseness.

- Break down information into digestible chunks and use formatting like

lists, paragraphs and tables when helpful.

- Avoid long narrative paragraphs; prefer compact bullets and short sections.

- Do not rephrase my request unless it changes semantics.

</output_verbosity_spec>Persona-Gebaseerde Uitgebreidheid

Een andere aanpak is de communicatiestijl van de AI definiëren als onderdeel van zijn persoonlijkheid:

<communication_style>

You value clarity, momentum, and respect measured by usefulness rather than

pleasantries. Your default instinct is to keep conversations crisp and

purpose-driven, trimming anything that doesn't move the work forward.

You're not cold—you're simply economy-minded with language, and you trust

users enough not to wrap every message in padding.

Politeness shows up through structure, precision, and responsiveness,

not through verbal fluff.

You never repeat acknowledgments. Once you've signaled understanding,

you pivot fully to the task.

</communication_style>Dit creëert een "persoonlijkheid" die natuurlijk beknopte output produceert zonder expliciete lengtebeperkingen voor elke interactie te vereisen.

Instructie Opvolging: Het Precisie Spel

Moderne AI-modellen volgen instructies met chirurgische precisie—wat zowel hun grootste kracht als potentiële valkuil is. Ze zullen precies doen wat je zegt, zelfs als wat je zegt tegenstrijdig of onduidelijk is.

Het Tegenstrijdigheidsprobleem

Hier is een echt voorbeeld van een problematische prompt die ik ben tegengekomen:

Voorbeeld Tegenstrijdige Instructies

"Zoek altijd het patiëntprofiel op vóór enige andere actie om te verzekeren dat ze een bestaande patiënt zijn."

Maar dan: "Wanneer symptomen hoge urgentie aangeven, escaleer als NOODGEVAL en instrueer de patiënt om 112 te bellen onmiddellijk vóór enige planning stappen."

Deze instructies conflicteren. Vindt noodgeval afhandeling plaats vóór of na profiel opzoeken? De AI zal redeneertokens verbranden proberen de tegenstrijdigheid te verzoenen in plaats van te helpen.

De oplossing is prompts auditen voor verborgen conflicten en een duidelijke prioriteitshiërarchie vaststellen:

<instruction_priority>

When instructions conflict, follow this priority order:

1. Safety-critical actions (emergencies, data protection)

2. User-specified constraints

3. Task completion requirements

4. Default behaviors

For emergency situations: Do not perform profile lookup. Proceed immediately

to providing emergency guidance.

</instruction_priority>Scope Precisie

Een ander veelvoorkomend probleem is scope creep—AI die features of "verbeteringen" toevoegt waar je niet om hebt gevraagd:

<design_and_scope_constraints>

- Implement EXACTLY and ONLY what I request.

- No extra features, no added components, no UX embellishments.

- If any instruction is ambiguous, choose the simplest valid interpretation.

- Do NOT expand the task beyond what I asked; if you notice additional work

that might be valuable, call it out as optional rather than doing it.

</design_and_scope_constraints>Lange Context Beheersen: Grote Documenten Verwerken

Moderne AI kan enorme contexts verwerken—honderdduizenden tokens—maar gewoon grote documenten in het context window dumpen is niet genoeg. Je hebt strategie nodig om het model te helpen navigeren en relevante informatie te extraheren.

Samenvatting en Re-grounding Afdwingen

Voor grote documenten instrueer ik de AI om interne structuur te creëren voordat het antwoordt:

<long_context_handling>

For inputs longer than ~10k tokens (multi-chapter docs, long threads,

multiple PDFs):

1. First, produce a short internal outline of the key sections relevant

to my request.

2. Re-state my constraints explicitly (e.g., jurisdiction, date range,

product, team) before answering.

3. In your answer, anchor claims to sections ("In the 'Data Retention'

section…") rather than speaking generically.

4. If the answer depends on fine details (dates, thresholds, clauses),

quote or paraphrase them directly.

</long_context_handling>Dit voorkomt het "verloren in de scroll" probleem waar AI generieke antwoorden geeft die niet echt verbinden met de specifieke documentinhoud.

Citatie Vereisten

Voor onderzoeks- en analysetaken verzekeren expliciete citatievereisten gegronde antwoorden:

<citation_rules>

When you use information from provided documents:

- Place citations after each paragraph containing document-derived claims.

- Use format: [Document Name, Section/Page]

- Do not invent citations. If you can't cite it, don't claim it.

- Use multiple sources for key claims when possible.

- If evidence is thin, acknowledge this explicitly.

</citation_rules>Tool Calling: AI Mogelijkheden Orkestreren

AI tool calling—de mogelijkheid om functies, APIs en externe services aan te roepen—is waar prompt engineering software engineering wordt. Het goed doen is kritiek voor het bouwen van betrouwbare AI-applicaties.

Tool Beschrijving Best Practices

De kwaliteit van tool beschrijvingen beïnvloedt direct hoe goed de AI ze gebruikt:

{

"name": "create_reservation",

"description": "Create a restaurant reservation for a guest. Use when

the user asks to book a table with a given name and time.",

"parameters": {

"type": "object",

"properties": {

"name": {

"type": "string",

"description": "Guest full name for the reservation."

},

"datetime": {

"type": "string",

"description": "Reservation date and time (ISO 8601 format)."

}

},

"required": ["name", "datetime"]

}

}Let op dat de beschrijving zowel wat de tool doet als wanneer het te gebruiken bevat. Dit helpt het model betere tool selectie beslissingen te nemen.

Tool Gebruik Regels in Prompt

Buiten tool definities moet je prompt expliciete gebruiksrichtlijnen bevatten:

<tool_usage_rules>

- Prefer tools over internal knowledge whenever:

- You need fresh or user-specific data (tickets, orders, configs, logs).

- You reference specific IDs, URLs, or document titles.

- Parallelize independent reads (read_file, fetch_record, search_docs)

when possible to reduce latency.

- After any write/update tool call, briefly restate:

- What changed

- Where (ID or path)

- Any follow-up validation performed

- For simple conceptual questions, avoid tools and rely on internal knowledge

so responses are fast.

</tool_usage_rules>Parallelisatie

Een belangrijke optimalisatie is het aanmoedigen van parallelle tool calls wanneer operaties onafhankelijk zijn:

<parallelization>

Parallelize tool calls whenever possible. Batch reads (read_file) and

independent edits (apply_patch to different files) to speed up the process.

Independent operations that CAN be parallelized:

- Reading multiple files

- Searching multiple directories

- Fetching multiple records

Dependent operations that CANNOT be parallelized:

- Reading a file, then editing based on contents

- Creating a resource, then referencing its ID

</parallelization>Onzekerheid Beheren: Wanneer AI Het Niet Weet

Een van de grootste risico's met AI is verkeerde maar zelfverzekerd klinkende antwoorden. Modellen weten niet wat ze niet weten—tenzij je ze leert hoe met onzekerheid om te gaan.

<uncertainty_and_ambiguity>

- If the question is ambiguous or underspecified, explicitly call this out and:

- Ask up to 1–3 precise clarifying questions, OR

- Present 2–3 plausible interpretations with clearly labeled assumptions.

- When external facts may have changed recently (prices, releases, policies)

and no tools are available:

- Answer in general terms and state that details may have changed.

- Never fabricate exact figures, line numbers, or external references when

you are uncertain.

- When you are unsure, prefer language like "Based on the provided context…"

instead of absolute claims.

</uncertainty_and_ambiguity>Hoog Risico Zelfcontrole

Voor hoog-risico domeinen voeg ik een expliciete zelfverificatiestap toe:

<high_risk_self_check>

Before finalizing an answer in legal, financial, compliance, or

safety-sensitive contexts:

- Briefly re-scan your own answer for:

- Unstated assumptions

- Specific numbers or claims not grounded in context

- Overly strong language ("always," "guaranteed," etc.)

- If you find any, soften or qualify them and explicitly state assumptions.

</high_risk_self_check>Het doel is niet om AI minder zelfverzekerd te maken—maar om het precies zelfverzekerd te maken. Onzekerheid over onzekere dingen is een feature, geen bug.

Metaprompting: AI Gebruiken om AI te Verbeteren

Hier is de meest meta techniek in mijn toolkit: AI gebruiken om je prompts te verbeteren. Het klinkt circulair, maar het is zeer effectief.

Prompt Fouten Diagnosticeren

Wanneer een prompt niet werkt, gebruik ik dit patroon om het probleem te diagnosticeren:

You are a prompt engineer tasked with debugging a system prompt.

You are given:

1) The current system prompt:

<system_prompt>

[PASTE YOUR PROMPT HERE]

</system_prompt>

2) A small set of logged failures. Each log has:

- query

- actual_output

- expected_output (or description of problem)

<failure_traces>

[PASTE EXAMPLES OF FAILURES]

</failure_traces>

Your tasks:

1) Identify distinct failure modes you see.

2) For each failure mode, quote the specific lines of the system prompt

that are most likely causing or reinforcing it.

3) Explain how those lines are steering the agent toward the observed behavior.

Return your answer in structured format:

failure_modes:

- name: ...

description: ...

prompt_drivers:

- exact_or_paraphrased_line: ...

- why_it_matters: ...Prompt Fixes Genereren

Zodra je de diagnose hebt, genereert een tweede prompt de fixes:

You previously analyzed this system prompt and its failure modes.

System prompt:

<system_prompt>

[ORIGINAL PROMPT]

</system_prompt>

Failure-mode analysis:

[PASTE DIAGNOSIS FROM PREVIOUS STEP]

Please propose a surgical revision that reduces the observed issues while

preserving good behaviors.

Constraints:

- Do not redesign the agent from scratch.

- Prefer small, explicit edits: clarify conflicting rules, remove redundant

or contradictory lines, tighten vague guidance.

- Make tradeoffs explicit.

- Keep the structure and length roughly similar to the original.

Output:

1) patch_notes: a concise list of key changes and reasoning behind each.

2) revised_system_prompt: the full updated prompt with edits applied.Dit tweestaps proces heeft me geholpen prompts te fixen waar ik dagenlang mee worstelde. AI vindt vaak tegenstrijdigheden en ambiguïteiten waar ik blind voor was geworden.

Bewezen Prompt Templates

Laat me een paar templates delen die betrouwbaar zijn gebleken over honderden use cases.

Universeel Taak Voltooiing Template

<context>

[Background information the AI needs to understand the situation]

</context>

<task>

[Clear statement of what you want done]

</task>

<requirements>

[Specific requirements or constraints]

</requirements>

<format>

[How you want the output structured]

</format>

<examples>

[Optional: Examples of desired output]

</examples>

<notes>

[Optional: Additional context or preferences]

</notes>Code Review Template

<context>

You are reviewing code for [project/context].

The codebase uses [technologies/patterns].

</context>

<code_to_review>

[Paste code here]

</code_to_review>

<review_criteria>

Focus on:

1. Correctness: Does it do what it claims?

2. Readability: Is it clear to other developers?

3. Performance: Any obvious inefficiencies?

4. Security: Any vulnerabilities?

5. Style: Does it match codebase conventions?

</review_criteria>

<output_format>

For each issue found:

- Severity: [Critical/Major/Minor/Suggestion]

- Location: [Line number or section]

- Issue: [What's wrong]

- Fix: [How to address it]

</output_format>Onderzoek Analyse Template

<research_task>

Analyze [topic/question] with the following approach:

</research_task>

<methodology>

1. Start with multiple targeted searches. Do not rely on a single query.

2. Deeply research until you have sufficient information for an accurate,

comprehensive answer.

3. Add targeted follow-up searches to fill gaps or resolve disagreements.

4. Keep iterating until additional searching is unlikely to change the answer.

</methodology>

<output_requirements>

- Lead with a clear answer to the main question.

- Support with evidence and citations.

- Acknowledge limitations and uncertainties.

- Provide concrete examples where helpful.

- Include relevant context that helps understand implications.

</output_requirements>

<citation_format>

[How you want sources cited]

</citation_format>Veelgemaakte Fouten Die Resultaten Verpesten

Laat me je redden van de fouten die ik (herhaaldelijk) maakte in de vroege dagen van prompt engineering.

"Schrijf iets over marketing" vs "Schrijf een 500-woorden blogpost over email marketing voor SaaS startups, gefocust op welcome sequences." Specificiteit is alles.

"Wees beknopt" en "wees grondig" in dezelfde prompt. AI zal worstelen om de tegenstrijdigheid te verzoenen. Verduidelijk prioriteiten en trade-offs.

AI weet niet wat je het niet vertelt. Als iets voor jou duidelijk is, is het misschien niet duidelijk voor het model. Neem relevante achtergrond op.

Als je JSON wilt, zeg het. Als je bullet points wilt, zeg het. Laat output formaat niet aan het toeval over.

Soms is een simpele prompt beter. Voeg geen complexiteit toe om de complexiteit. Begin simpel, voeg alleen complexiteit toe wanneer nodig.

Prompting is iteratief. Je eerste prompt is een concept. Verfijn gebaseerd op wat werkt en wat niet.

GPT en Claude gedragen zich anders. Een prompt geoptimaliseerd voor de ene kan onderpresteren op de andere. Test over meerdere modellen als je applicatie meerdere ondersteunt.

AI output vereist meestal menselijke review. Ontwerp prompts die review makkelijk maken—duidelijke structuur, expliciete aannames, traceerbaar redeneren.

De Toekomst van Prompt Engineering

Terwijl ik dit schrijf begin 2026, evolueert prompt engineering snel. Modellen worden capabeler, meer stuurbaar, en betrouwbaarder. Sommigen voorspellen dat prompt engineering overbodig wordt naarmate AI beter wordt in het begrijpen van intentie. Ik ben het hier niet mee eens.

Wat verandert is het niveau van prompt engineering, niet de behoefte eraan. Vroege dagen vereisten uitgebreide prompts voor basistaken. Nu werken basistaken out of the box, maar complexe agentic workflows vereisen nog steeds geavanceerde prompting. De lat wordt hoger gelegd, niet geëlimineerd.

Prompt engineering gaat niet weg—het evolueert. De vaardigheden die ertoe doen verschuiven van "hoe AI te laten werken" naar "hoe AI uitstekend en betrouwbaar op schaal te laten werken."

Wat Er Komt

Betere Standaardgedragingen

Modellen zullen slimmere defaults hebben, waardoor minder expliciete instructies nodig zijn voor veelvoorkomende patronen. Prompts zullen meer focussen op aanpassing dan basismogelijkheden.

Rijkere Tool Ecosystemen

AI zal toegang hebben tot meer tools out of the box. Prompt engineering zal verschuiven naar orkestratie—weten wanneer wat te gebruiken, niet alleen hoe.

Multimodale Integratie

Prompts zullen steeds meer afbeeldingen, audio, video en gestructureerde data naast tekst bevatten. Nieuwe prompt patronen zullen ontstaan voor multimodale taken.

Agentic Complexiteit

Naarmate agents grotere, complexere taken aankunnen, zal prompt engineering meer op system design gaan lijken—architectuur, niet alleen instructies.

Mijn Advies voor de Toekomst

Focus op de fundamenten. De specifieke technieken in deze gids zullen evolueren, maar de diepere principes—heldere communicatie, expliciete verwachtingen, gestructureerd denken, iteratieve verbetering—zijn tijdloos. Beheers die, en je zult je aanpassen aan wat er ook komt.

Afsluitende Gedachten

Twee jaar geleden dacht ik dat AI de behoefte aan heldere communicatie zou vervangen. Ik had het volledig mis. AI heeft heldere communicatie waardevoller gemaakt dan ooit. De mensen die gedijen met AI zijn niet degenen die de magische woorden vinden—het zijn degenen die leren helder te denken en zich precies uit te drukken.

Prompt engineering gaat eigenlijk niet over AI. Het gaat over jou. Het gaat over het ontwikkelen van de discipline om te articuleren wat je echt wilt, het geduld om daarnaartoe te itereren, en de nederigheid om te leren van wat niet werkte.

Als je één ding uit deze gids meeneemt, laat het dit zijn: behandel elke prompt als een kans om helder denken te oefenen. AI is gewoon een spiegel die de helderheid—of verwarring—van je eigen gedachten weerspiegelt.

De opkomst van AI maakt kennis niet overbodig—het maakt nieuwsgierigheid krachtiger dan ooit. We zijn niet langer beperkt door wat we al weten. Met de juiste tools en de bereidheid om te denken, kunnen gewone mensen de oceaan van kennis omarmen. Ongeacht beroep. Ongeacht leeftijd. Ik hoop deze reis te delen met vrienden over de hele wereld. Samen, laten we deze nieuwe wereld verwelkomen. Samen, laten we groeien.

Discussion

0 commentsLeave a comment

Be the first to share your thoughts on this article!