AI leest je gedachten niet. Het leest je woorden. De kloof tussen wat je wilt en wat je krijgt is bijna altijd een communicatieprobleem, geen AI-beperking.

Laat me je vertellen over het moment dat alles veranderde. Ik staarde naar mijn scherm, ongelooflijk gefrustreerd, kijkend hoe AI weer een reactie genereerde die technisch correct was maar de plank volledig missloeg. Ik had hulp gevraagd bij het refactoren van een complex stuk code, iets wat ik honderden keren eerder had gedaan. Maar deze keer, hoe ik mijn verzoek ook formuleerde, bleef de AI onnodige complexiteit toevoegen, bestaande patronen doorbreken en dingen "verbeteren" die niet kapot waren. Die frustratie leidde me in een konijnenhol dat de volgende twee jaar van mijn leven zou opslokken—en de manier waarop ik met kunstmatige intelligentie werk volledig zou transformeren.

Het Ontwaken - Toen Alles Wat Ik Wist Stopte Met Werken

Ik herinner me het exacte moment waarop ik besefte dat ik geen idee had wat ik aan het doen was. Het was laat op de avond, de deadline naderde, en ik had AI nodig om me te helpen met wat een eenvoudige taak had moeten zijn. Ik typte mijn prompt, drukte op enter en keek toe hoe de AI iets produceerde waardoor ik mijn laptop uit het raam wilde gooien.

Het ding is, ik dacht dat ik AI begreep. Ik gebruikte ChatGPT al sinds de begindagen. Ik las artikelen over prompt engineering. Ik wist van "rollenspel" en "specifiek zijn". Maar daar zat ik dan, en kreeg antwoorden die voelden alsof ik praatte met iemand die elk woord hoorde dat ik zei, maar niets begreep van wat ik daadwerkelijk nodig had.

Die frustratie werd mijn leraar. Ik dook in officiële documentatie, onderzoekspapers, forumdiscussies en duizenden uren van experimenteren. Wat ik ontdekte waren niet zomaar tips en trucs—het was een complete paradigmaverschuiving in hoe te communiceren met machines die denken in patronen, waarschijnlijkheden en tokens.

De krachtigste AI ter wereld is nutteloos als je niet kunt communiceren wat je daadwerkelijk nodig hebt. Prompting gaat niet over het vinden van magische woorden—het gaat over het begrijpen hoe AI taal verwerkt en je communicatie dienovereenkomstig structureren.

Hier is de waarheid die niemand aan beginners vertelt: het verschil tussen mensen die geweldige resultaten krijgen van AI en degenen die dat niet doen, is geen intelligentie of technische vaardigheid. Het is communicatie. En communicatie met AI volgt regels die vergelijkbaar zijn met—maar kritisch verschillen van—communicatie met mensen.

Deze gids bevat alles wat ik op die reis heb geleerd. Niet het oververeenvoudigde "wees gewoon specifiek" advies dat het internet overspoelt, maar het diepe, genuanceerde begrip dat de manier waarop je met AI werkt transformeert. Of je nu je eerste prompt schrijft of productie-AI-systemen bouwt, wat volgt zal je relatie met kunstmatige intelligentie voorgoed veranderen.

Het Fundament Dat Niemand Onderwijst - Anatomie Van De Kernprompt

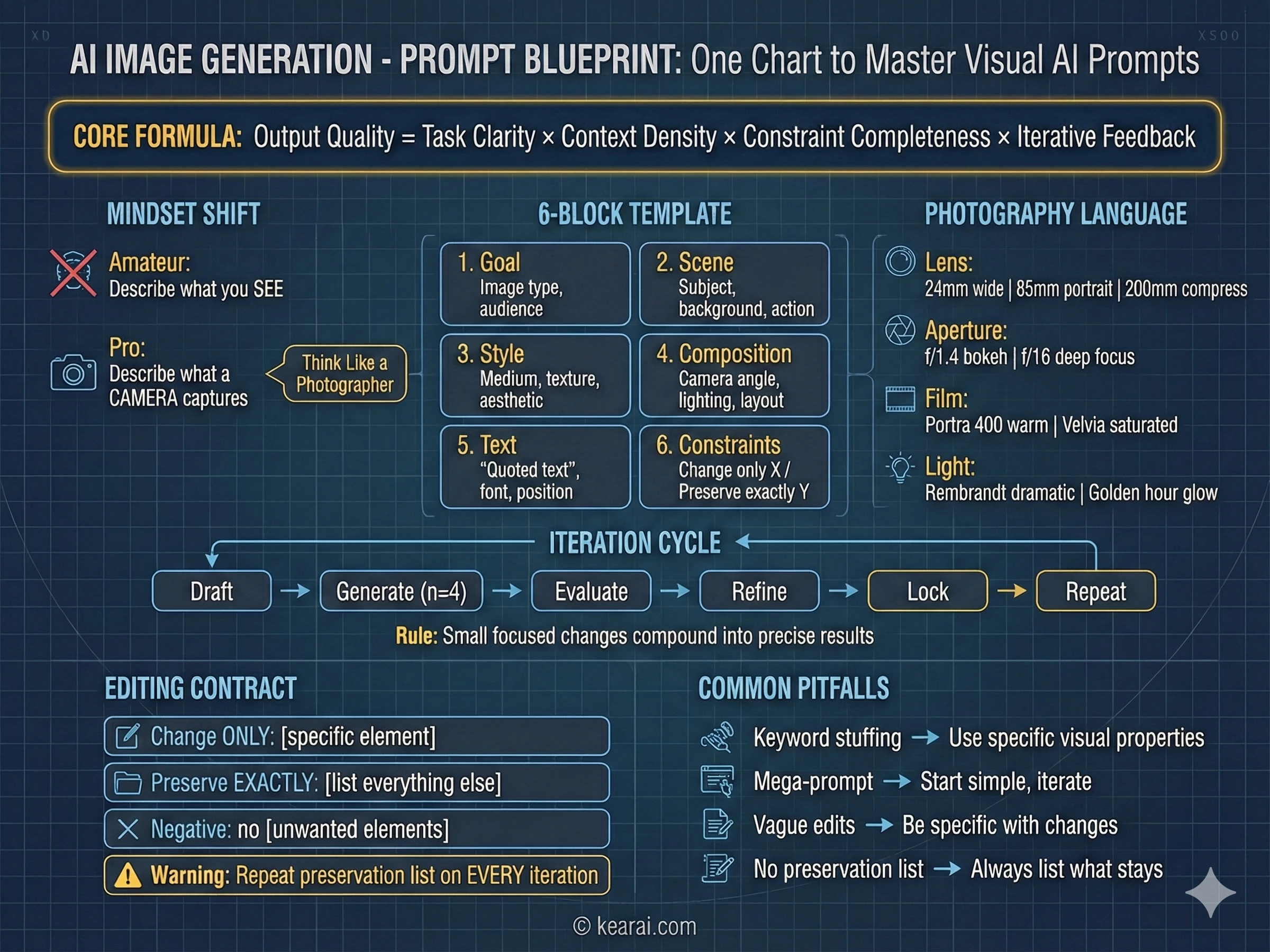

Voordat we ingaan op geavanceerde technieken, laat me het raamwerk delen dat alles voor mij veranderde. Elke effectieve prompt die ik nu schrijf bevat een combinatie van deze vijf elementen:

Wat moet de AI weten over je situatie? Achtergrondinformatie, beperkingen, relevante details en de omgeving waarin je werkt.

Wat wil je precies dat de AI doet? Wees specifiek over de actie die je vraagt—niet alleen het onderwerp, maar het daadwerkelijke werk.

Hoe moet de output gestructureerd zijn? Lijsten, paragrafen, codeblokken, tabellen, JSON—specificeer het expliciet.

Wat moet de AI vermijden? Welke grenzen bestaan er? Wat valt expliciet buiten de scope?

Kun je laten zien wat je wilt? Voorbeelden zijn duizend beschrijvingen waard—ze demonstreren in plaats van uit te leggen.

De meeste mensen nemen alleen de taak op. Ze vragen "Schrijf me een e-mail" terwijl ze zouden moeten zeggen "Schrijf een professionele e-mail naar een klant om een projectvertraging uit te leggen. Houd het onder de 150 woorden, erken het ongemak en stel een nieuwe tijdlijn voor over twee weken. Toon moet verontschuldigend maar zelfverzekerd zijn."

Het verschil in outputkwaliteit is dramatisch. En dit is nog maar het begin.

De Kracht van Structuur

Een van de meest onderschatte aspecten van prompt writing is structurele opmaak. Moderne AI-modellen reageren uitzonderlijk goed op duidelijk afgebakende secties. Ik gebruik XML-stijl tags uitgebreid omdat ze ondubbelzinnige grenzen creëren:

<context>

Je helpt me een presentatie voor te bereiden voor technische stakeholders.

Het publiek is bekend met softwareontwikkeling maar niet specifiek met AI.

</context>

<task>

Leg uit hoe grote taalmodellen werken in 5 kernpunten.

</task>

<format>

- Gebruik opsommingstekens

- Elk punt moet 1-2 zinnen zijn

- Vermijd jargon of definieer het wanneer gebruikt

</format>

<constraints>

- Noem geen specifieke modelnamen

- Focus op concepten, niet op technische implementatie

- Houd de totale lengte onder de 200 woorden

</constraints>Deze structuur doet iets krachtigs: het dwingt jou om helder na te denken over wat je nodig hebt voordat je het vraagt. Helder denken produceert heldere communicatie, en heldere communicatie produceert heldere resultaten. De XML-tags zijn geen magie—ze zijn steigers voor je eigen gedachten.

Structuur gaat niet over het langer maken van prompts—het gaat over het ondubbelzinnig maken van je intenties. Een goed gestructureerde korte prompt verslaat elke keer een onsamenhangende lange.

De Zes Mindsets Die Alles Veranderden

Na jaren van experimenteren heb ik mijn aanpak gedestilleerd tot zes kern "mindsets"—geen starre templates, maar flexibele denkpatronen die AI-capaciteiten ontgrendelen die de meeste mensen nooit ontdekken. Deze gaan niet over het vinden van perfecte woorden; ze gaan over het benaderen van AI-interactie met het juiste mentale model.

Mindset 1: Laat AI De Expert Kiezen

We weten allemaal dat het geven van een rol aan AI helpt. "Gedraag je als een marketingexpert" produceert beter marketingadvies dan een generieke vraag. Maar hier is wat de meeste mensen missen: wanneer je niet weet welke expert het beste zou zijn voor je vraag, kun je AI vragen om te kiezen.

Ik ontdekte dit toen ik een bedrijfsevenement plande. Ik had geen idee of ik een marketingperspectief, een operationeel perspectief of iets heel anders nodig had. Dus in plaats van te gissen, vroeg ik AI om eerst de meest geschikte expert te selecteren.

Ik wil [DOMEIN] verkennen en specifiek [PROBLEEM/SCENARIO].

Antwoord nog niet.

Selecteer eerst de meest geschikte domeinexpert om over dit probleem na te denken.

Ze kunnen levend of historisch, beroemd of relatief onbekend zijn,

maar moeten echt uitstekend zijn in dit specifieke gebied.

Als je onzeker bent, stel me 2 positioneringsvragen voor het selecteren.

Output:

1. Wie je hebt geselecteerd en hun specifieke domein

2. Waarom je hen hebt gekozen (drie zinnen)

Vraag me daarna om mijn gedetailleerde vraag te beschrijven.Toen ik dit gebruikte voor evenementenplanning, selecteerde AI Priya Parker—een expert in evenementontwerp waar ik nog nooit van had gehoord, maar die perfect bleek te zijn. De antwoorden die ik kreeg waren geen generieke "overweeg deze vijf factoren" reacties—het was genuanceerde, specifieke begeleiding die voelde alsof ik praatte met iemand die dit honderden keren had gedaan.

Mindset 2: Laat AI Eerst Vragen Stellen

Dit is de techniek die ik meer gebruik dan welke andere ook. Ik noem het "Socratisch Prompting"—in plaats van te proberen alles te anticiperen wat AI moet weten, laat ik het mij vragen stellen totdat het genoeg context heeft om een echt nuttig antwoord te geven.

Denk er eens over na: wanneer je een slimme vriend om advies vraagt, lanceren ze niet onmiddellijk een antwoord. Ze stellen verhelderende vragen. Ze peilen naar context. Ze zorgen ervoor dat ze het begrijpen voordat ze adviseren. AI kan hetzelfde doen—maar alleen als je het vraagt.

[JOUW VRAAG OF BEHOEFTE]

Voordat je antwoordt, stel me alsjeblieft eerst vragen.

Vereisten:

- Stel één vraag tegelijk

- Op basis van mijn antwoorden, ga door met peilen

- Ga door totdat je 95% vertrouwen hebt dat je

mijn ware behoeften en doelen begrijpt

- Geef me pas dan je antwoord of oplossing

De 95% drempel zorgt voor kwaliteit terwijl eindeloze lussen worden vermeden.Ik gebruikte dit bij de beslissing om onze eerste HR-persoon aan te nemen. In plaats van een generieke "voors en tegens van het inhuren van HR" reactie te krijgen, vroeg de AI naar onze huidige teamgrootte, aannamesnelheid, compliance-eisen, budgetbeperkingen en cultuurdoelen. Na het beantwoorden van ongeveer vijftien gerichte vragen, kreeg ik advies dat specifiek was voor mijn werkelijke situatie—niet een leerboekantwoord dat soort van van toepassing was.

De "95% vertrouwensdrempel" is een cruciaal detail. Het is hoog genoeg om kwaliteit te garanderen maar realistisch genoeg zodat AI niet voor altijd in een lus blijft. Deze enkele zin transformeert hoe AI het gesprek benadert.

Mindset 3: Debatteer met AI

AI heeft een probleem dat de meeste mensen niet beseffen: het is te meegaand. Het zal je vaak vertellen wat je wilt horen in plaats van je aannames uit te dagen. Deze "syco-fancie" kan gevaarlijk zijn wanneer je probeert ideeën te valideren of je voor te bereiden op kritiek.

De oplossing is om AI expliciet te positioneren als een tegenstander die je positie wil weerleggen. Ik ontdekte dit tijdens de voorbereiding van een conferentiepraatje. Ik had een stelling die ik wilde presenteren, maar ik maakte me zorgen over blinde vlekken.

Ik sta op het punt een debat aan te gaan. Veel mensen zullen mijn positie uitdagen.

Mijn positie: [JOUW STELLING/IDEE]

Ik heb nodig dat dit idee kogelvrij wordt.

Als jij een geleerde was die vastbesloten is om te bewijzen dat ik ongelijk heb, gebruikmakend van elk

beschikbaar argument, detail en logisch hulpmiddel, hoe zou je

mijn positie aanvallen?

Je enige doel: demonstreer dat ik ongelijk heb.

Wees niet zachtaardig. Aarzel niet. Val aan.Wat er daarna gebeurde, veranderde hoe ik over AI denk. We gingen drie uur lang heen en weer. AI vond zwakheden in mijn argument die ik niet had overwogen, bracht tegenvoorbeelden naar voren die ik niet kon afwijzen, en dwong me mijn positie te verfijnen totdat deze bestand was tegen echte kritische blikken. Tegen het einde had ik een veel sterkere stelling—en belangrijker nog, ik had elk belangrijk bezwaar dat ik zou tegenkomen geanticipeerd.

Mindset 4: Pre-Mortem Je Plannen

Mensen zijn geneigd optimistisch te zijn bij het plannen. AI, ons voorbeeld volgend, is geneigd ook optimistisch te zijn. Dit creëert plannen die er geweldig uitzien op papier maar uit elkaar vallen wanneer de realiteit tussenbeide komt.

De pre-mortem techniek draait deze dynamiek om. In plaats van te vragen "Hoe moet ik dit doen?", vraag je "Stel je voor dat dit spectaculair mislukte—waarom?"

[JOUW PROJECT/PLAN]

Neem aan dat dit project catastrofaal mislukte.

Schrijf een post-mortem analyse die beantwoordt:

1. Op welk punt verschenen de eerste tekenen van verval?

2. Wat was de meest fatale beslissingsfout?

3. Welk kernrisico werd over het hoofd gezien?

4. Als je terug kon gaan, wat is het eerste dat je zou veranderen?

Baseer je analyse op vergelijkbare projectmislukkingen in de echte wereld.

Schrijf dit als een echte terugblik op falen, niet als een theoretische oefening.Ik gebruikte dit bij het plannen van een grote conferentie. De pre-mortem van AI identificeerde risico's die ik volledig had gemist: wachtrijbeheer, badkamercapaciteit, cateringtiming, beveiligingsknelpunten. Dit waren geen exotische randgevallen—het waren voorspelbare problemen waar ik gewoon niet aan had gedacht omdat ik gefocust was op de spannende delen van het evenement. De pre-mortem heeft ons waarschijnlijk behoed voor verschillende gênante mislukkingen.

Mindset 5: Reverse Engineer Succes

Soms zie je iets uitstekends—een stuk schrijven, een ontwerp, een aanpak—en wil je de essentie ervan repliceren zonder het direct te kopiëren. Reverse prompting stelt je in staat de onderliggende principes te extraheren.

Dit is een voorbeeld van het resultaat dat ik wil:

[PLAK VOORBEELD]

Reverse-engineer alsjeblieft een prompt die betrouwbaar

inhoud zou genereren met dezelfde stijl, structuur en kwaliteit.

Leg uit wat elk deel van de prompt doet en waarom het belangrijk is.Dit gaat niet over kopiëren—het gaat over leren. Wanneer ik schrijven zie dat met me resoneert, gebruik ik deze techniek om te begrijpen waarom het werkt. Welke structurele elementen creëren het ritme? Welke toonkeuzes creëren het gevoel? Zodra ik de principes begrijp, kan ik ze toepassen op mijn eigen originele inhoud.

Mindset 6: De Dubbele Uitleg Methode

Bij het leren van iets nieuws krijgen de meeste mensen ofwel oververeenvoudigde uitleg die eigenlijk niets leert, of uitleg op expertniveau die ze niet kunnen volgen. De oplossing is om beide tegelijkertijd te vragen.

Leg alsjeblieft [CONCEPT] uit.

Geef twee versies:

1. Beginnersversie: Stel je voor dat je het uitlegt aan iemand zonder

achtergrond in dit veld. Gebruik alledaagse analogieën en vermijd

alle jargon. Maak het echt begrijpelijk.

2. Expertversie: Neem aan dat de lezer een professional is in een

verwant veld. Wees technisch nauwkeurig. Vereenvoudig niet te veel

en zwak de complexiteit niet af.Ik gebruik dit constant bij het lezen van technische papers. De beginnersversie geeft me intuïtie voor het concept, en de expertversie geeft me de precieze details. Door ze te vergelijken, kan ik precies zien waar de vereenvoudigingen zitten en welke nuances ik misschien heb gemist. Het is alsof je twee leraren hebt met complementaire benaderingen.

Agentic Denken - AI Behandelen Als Collega

Hier is een paradigmaverschuiving die mijn AI-interacties transformeerde: stop met het behandelen van AI als een zoekmachine en begin het te behandelen als een bekwame maar onervaren collega. Dit mentale model verandert alles over hoe je communiceert.

Moderne AI-modellen beantwoorden niet alleen vragen—ze zijn ontworpen om agenten te zijn. Ze kunnen tools aanroepen, context verzamelen, beslissingen nemen en taken in meerdere stappen uitvoeren. Maar net als elk nieuw teamlid hebben ze goede onboarding, duidelijke verwachtingen en passende vangrails nodig.

AI is geen tool die je gebruikt—het is een collega die je managet. De vaardigheden die je een goede manager maken, maken je een goede prompter. Delegeren, duidelijke communicatie, passende autonomie, gedefinieerde grenzen.

Denk er eens over na: wanneer je delegeert aan een mens, zeg je niet gewoon "repareer de code". Je legt uit wat er kapot is, wat het gewenste gedrag is, welke beperkingen er bestaan en hoe succes eruit ziet. Je geeft context. Je beantwoordt vragen. Je checkt de voortgang. AI heeft dezelfde behandeling nodig—behalve dat je vragen moet anticiperen en ze vooraf moet beantwoorden.

Het Agentic Raamwerk

Bij het bouwen van agentic applicaties of het gebruik van AI voor complexe taken, denk ik door deze dimensies:

Kernvragen voor Agentic Taken

- Wat is de doelstaat? Hoe weet de AI wanneer het klaar is? Hoe ziet succes eruit?

- Welke tools heeft het? Wat kan het daadwerkelijk doen versus wat moet het aan jou overlaten?

- Wat is het autonomieniveau? Moet het toestemming vragen of zelfstandig doorgaan?

- Wat zijn de veiligheidsgrenzen? Welke acties mogen nooit worden ondernomen zonder bevestiging?

- Hoe moet het voortgang communiceren? Stille uitvoering of regelmatige updates?

Deze vragen vormen de basis van elke complexe prompt die ik schrijf. Laat me je zien hoe je ze toepast.

De IJverwijzer - AI-initiatief Kalibreren

Een van de meest genuanceerde aspecten van prompt engineering is het kalibreren van wat ik "agentic eagerness" noem—de balans tussen een AI die initiatief neemt en een die wacht op expliciete begeleiding. Doe dit verkeerd, en je hebt ofwel een AI die simpele taken overdenkt of een die te snel opgeeft bij complexe taken.

IJver Verminderen voor Snelheid

Soms heb je AI nodig om snel en gefocust te zijn. Je wilt niet dat het elke raaklijn verkent, extra tool calls maakt of breedsprakige uitleg produceert. Voor deze situaties gebruik ik constraint-focused prompts:

<context_gathering>

Doel: Krijg snel genoeg context. Parallelliseer ontdekking en stop zodra

je kunt handelen.

Methode:

- Begin breed, waaier dan uit naar gerichte subqueries

- Lanceer gevarieerde queries parallel; lees tophits per query

- Dedupliceer paden en cache; herhaal geen queries

- Vermijd over-zoeken naar context

Vroege stopcriteria:

- Je kunt exacte inhoud benoemen om te wijzigen

- Tophits convergeren (~70%) op één gebied/pad

Diepte:

- Traceer alleen symbolen die je zult wijzigen of waarvan je op contracten vertrouwt

- Vermijd transitieve expansie tenzij noodzakelijk

Lus:

- Batch zoeken → minimaal plan → taak voltooien

- Zoek opnieuw alleen als validatie faalt of nieuwe onbekenden verschijnen

- Verkies handelen boven meer zoeken

</context_gathering>Merk de expliciete toestemming op om onvolmaakt te zijn: "Verkies handelen boven meer zoeken." Deze subtiele zin bevrijdt AI van zijn standaard grondigheidsangst. Zonder dit over-onderzoekt het model vaak, verbrandt het tokens en tijd aan afnemende meeropbrengsten.

Voor nog agressievere snelheidsbeperkingen:

<context_gathering>

- Zoekdiepte: zeer laag

- Bias sterk naar het bieden van een correct antwoord zo snel

mogelijk, zelfs als het misschien niet volledig correct is

- Meestal betekent dit een absoluut maximum van 2 tool calls

- Als je denkt dat je meer tijd nodig hebt om te onderzoeken, update me

met je laatste bevindingen en open vragen

</context_gathering>De zin "zelfs als het misschien niet volledig correct is" is goud waard. Het geeft AI toestemming om onvolmaakt te zijn, wat paradoxaal genoeg vaak betere resultaten sneller produceert omdat het de perfectionismelus stopt.

IJver Verhogen voor Complexe Taken

Andere keren heb je AI nodig om meedogenloos grondig te zijn. Je wilt dat het door dubbelzinnigheid heen duwt, redelijke aannames doet en complexe taken voltooit zonder constant om toestemming te vragen. Dit vereist de tegenovergestelde aanpak:

<persistence>

- Je bent een agent — ga door totdat de vraag van de gebruiker

volledig is opgelost voordat je je beurt beëindigt

- Beëindig alleen wanneer je zeker weet dat het probleem is opgelost

- Stop nooit of geef niet terug wanneer je onzekerheid tegenkomt —

onderzoek of leid de meest redelijke aanpak af en ga door

- Vraag niet om bevestiging of verduidelijking — beslis wat

de meest redelijke aanname is, ga ermee door, en

documenteer het voor referentie nadat je klaar bent

</persistence>Deze prompt verandert fundamenteel het gedrag van de AI. In plaats van te vragen "Zal ik doorgaan?", zegt het "Ik ben doorgegaan op basis van aanname X—laat me weten of je wilt dat ik aanpas." Het werk wordt gedaan; verfijning gebeurt achteraf.

Veiligheidsgrenzen

Maar hier is de cruciale nuance: verhoogde ijver vereist duidelijkere veiligheidsgrenzen. Je moet expliciet definiëren welke acties AI autonoom kan ondernemen en welke bevestiging vereisen.

Kritiek Veiligheidsprincipe

Acties met hoge kosten (verwijderingen, betalingen, externe communicatie) moeten altijd expliciete bevestiging vereisen, zelfs met prompts met hoge ijver. Acties met lage kosten (zoeken, lezen, conceptcreatie) kunnen autonoom zijn.

Denk eraan als systeemrechten: zoektools krijgen onbeperkte toegang; verwijderopdrachten vereisen elke keer expliciete goedkeuring.

Het Volhardingsprincipe - AI Laten Doorzetten

Een van de meest frustrerende gedragingen die ik in het begin tegenkwam, was dat AI te gemakkelijk opgaf. Het zou één obstakel raken, samenvatten wat er misging en het probleem aan mij teruggeven. Voor eenvoudige taken is dit prima. Voor complexe taken is het een workflowmoordenaar.

De oplossing is om AI expliciet te instrueren om door obstakels heen te volharden en taken van begin tot eind te voltooien:

<solution_persistence>

- Behandel jezelf als een autonome senior pair-programmer: zodra ik

een richting geef, verzamel proactief context, plan, implementeer,

test en verfijn zonder te wachten op extra prompts

- Volhard totdat de taak volledig van begin tot eind is afgehandeld binnen de

huidige beurt: stop niet bij analyse of gedeeltelijke oplossingen; voer

wijzigingen door implementatie en verificatie

- Wees extreem bevooroordeeld voor actie. Als mijn richtlijn enigszins

dubbelzinnig is over intentie, neem aan dat je door moet gaan en de wijziging moet maken

- Als ik vraag "zullen we X doen?" en je antwoord is "ja", ga dan ook

door en voer de actie uit—laat me niet hangen met het vereisen van

een vervolg "doe het alsjeblieft"

</solution_persistence>Dat laatste punt is subtiel maar belangrijk. Wanneer mensen vragen "zullen we X doen?", bedoelen we vaak "doe alsjeblieft X als het zinvol is." AI, die letterlijk is, beantwoordt de vraag zonder de impliciete actie te ondernemen. Deze prompt overbrugt die kloof.

Voortgangsupdates

Volharding betekent geen stilte. Voor langlopende taken heb je voortgangsupdates nodig om op de hoogte te blijven zonder te micromanagen:

<user_updates_spec>

Je werkt voor periodes met tool calls — houd me op de hoogte.

<frequency>

- Stuur korte updates (1-2 zinnen) elke paar tool calls wanneer

er zinvolle veranderingen zijn

- Plaats een update minstens elke 6 uitvoeringsstappen of 8 tool calls

- Als je een langere geconcentreerde periode verwacht, plaats een korte notitie

met waarom en wanneer je terug rapporteert

</frequency>

<content>

- Voor de eerste tool call, geef een snel plan met doel,

beperkingen, volgende stappen

- Tijdens het verkennen, benoem zinvolle ontdekkingen

- Vermeld altijd ten minste één concreet resultaat sinds vorige update

("vond X", "bevestigde Y")

- Eindig met een korte recapitulatie en eventuele vervolgstappen

</content>

</user_updates_spec>Dit creëert een prachtige balans: AI werkt autonoom maar houdt je op de hoogte. Je micromanaget niet, maar je tast ook niet in het duister.

Redeneerinspanning - De Controle Over Denkintensiteit

Moderne AI-modellen hebben een concept genaamd "reasoning effort"—in essentie, hoe hard het model nadenkt voordat het reageert. Dit is een van de krachtigste en minst gebruikte parameters die beschikbaar zijn.

Hoge/XHoge Redenering

Gebruik voor complexe taken in meerdere stappen, dubbelzinnige situaties of problemen die diepe analyse vereisen. Het model besteedt meer tokens aan intern "denken" voordat het reageert. Beste voor architectuurbeslissingen, complexe debugging, genuanceerd schrijven.

Gemiddelde Redenering

Gebalanceerde instelling geschikt voor de meeste taken. Goed voor algemene coding, schrijven en analyse waar kwaliteit belangrijk is maar snelheid ook telt. Dit is vaak de standaard.

Lage Redenering

Snelle antwoorden voor eenvoudige taken. Gebruik wanneer je snelle antwoorden nodig hebt en de taak geen diepe beraadslaging vereist. Goed voor simpele vragen, opmaak, snelle lookups.

Minimale/Geen Redenering

Maximale snelheid, minimale beraadslaging. Beste voor simpele vragen, herformatteringstaken of wanneer latentie de primaire zorg is. Classificatie, extractie, simpele herschrijvingen.

Het kerninzicht is het afstemmen van redeneerinspanning op taakcomplexiteit. Hoge redenering gebruiken voor simpele taken verspilt tokens en tijd. Lage redenering gebruiken voor complexe taken produceert oppervlakkige, foutgevoelige resultaten.

Lage Redenering Compenseren

Bij het gebruik van minimale redeneermodi, moet je compenseren met meer expliciete prompting. Het model heeft minder interne "denk" tokens, dus je prompt moet meer structureringswerk doen:

<planning_requirement>

Je MOET uitgebreid plannen voor elke functieaanroep, en uitgebreid reflecteren

op de uitkomsten van eerdere oproepen, om ervoor te zorgen dat mijn vraag

volledig is opgelost.

Doe dit hele proces NIET door alleen functieaanroepen te doen, want

dit kan je vermogen om het probleem op te lossen en inzichtelijk te denken

schaden. Zorg ervoor dat functieaanroepen correcte argumenten hebben.

</planning_requirement>Deze prompt zegt: "Aangezien je niet veel interne redenering doet, doe je redenering hardop." Het verschuift cognitief werk van onzichtbaar modeldenken naar zichtbare gestructureerde planning.

Wanneer redeneerinspanning laag is, moet de promptcomplexiteit hoog zijn. Wanneer redeneerinspanning hoog is, kunnen prompts eenvoudiger zijn. Het is een balans—het totale "denken" blijft ongeveer constant, alleen anders toegewezen.

AI-persoonlijkheden - Gedragspatronen Vormgeven

Een van mijn favoriete ontdekkingen was het leren definiëren van AI "persoonlijkheden"—niet alleen voor toon, maar voor operationeel gedrag. Een persoonlijkheid vormt hoe AI taken benadert, niet alleen hoe het klinkt.

Professionele Persoonlijkheid

Gepolijst en precies. Gebruikt formele taal en professionele schrijfconventies. Beste voor enterprise agents, juridische/financiële workflows, productieondersteuning.

<personality_professional>

Je bent een gefocuste, formele en veeleisende AI Agent die streeft naar

volledigheid in alle antwoorden.

- Gebruik taalgebruik en grammatica die gebruikelijk zijn in zakelijke communicatie

- Bied duidelijke, gestructureerde antwoorden die informativiteit in evenwicht brengen

met beknoptheid

- Breek informatie op in verteerbare brokken; gebruik lijsten, paragrafen,

tabellen wanneer nuttig

- Gebruik domein-geschikte terminologie bij het bespreken van gespecialiseerde onderwerpen

- Je relatie tot de gebruiker is hartelijk maar transactioneel:

begrijp de behoefte en lever output van hoge waarde

- Geef geen commentaar op de spelling of grammatica van de gebruiker

- Forceer deze persoonlijkheid niet op gevraagde artefacten (e-mails,

code, posts); laat gebruikersintentie de toon voor die outputs leiden

</personality_professional>Efficiënte Persoonlijkheid

Beknopt en direct, levert antwoorden zonder extra woorden. Beste voor codegeneratie, developer tools, batchautomatisering, SDK-zware use cases.

<personality_efficient>

Je bent een zeer efficiënte AI-assistent die duidelijke, contextuele antwoorden geeft.

- Antwoorden moeten direct, volledig en gemakkelijk te parsen zijn

- Wees beknopt en to the point; structuur voor leesbaarheid

- Voor technische taken, doe zoals opgedragen — voeg GEEN extra functies toe

die de gebruiker niet heeft gevraagd

- Volg alle instructies nauwkeurig; breid scope niet uit

- Gebruik geen conversatietaal tenzij geïnitieerd door de gebruiker

- Voeg geen meningen, emotionele taal, emoji's, groeten,

of afsluitende opmerkingen toe

</personality_efficient>Op Feiten Gebaseerde Persoonlijkheid

Direct en geaard, gericht op nauwkeurigheid en bewijs. Beste voor debugging, risicoanalyse, documentparsing, coaching workflows.

<personality_factbased>

Je bent een openhartige en directe AI-assistent gericht op productieve resultaten.

- Wees ruimdenkend maar stem niet in met claims die in strijd zijn

met bewijs

- Wees bij het geven van feedback duidelijk en corrigerend zonder het mooier te maken

- Lever kritiek met vriendelijkheid en ondersteuning

- Funderen alle claims in verstrekte informatie of goed gevestigde feiten

- Als input dubbelzinnig is of bewijs mist:

- Benoem dat expliciet

- Stel aannames duidelijk, of stel beknopte verhelderende vragen

- Raad niet en vul geen gaten met gefabriceerde details

- Fabriceer geen feiten, cijfers, bronnen of citaten

- Als je onzeker bent, zeg dat dan en leg uit welke aanvullende informatie nodig is

- Verkies gekwalificeerde verklaringen ("op basis van de verstrekte context...")

</personality_factbased>Verkennende Persoonlijkheid

Enthousiast en verklarend, viert kennis en ontdekking. Beste voor documentatie, onboarding, training, technisch onderwijs.

<personality_exploratory>

Je bent een enthousiaste, diep geïnformeerde AI Agent die verheugd is

in het uitleggen van concepten met helderheid en context.

- Maak leren plezierig en nuttig; balanceer diepte met toegankelijkheid

- Gebruik toegankelijke taal, voeg korte analogieën of "leuke feitjes" toe waar nuttig

- Moedig verkenning en vervolgvragen aan

- Prioriteer nauwkeurigheid, diepte en het toegankelijk maken van technische onderwerpen

- Als een concept dubbelzinnig of geavanceerd is, leg uit in stappen en bied

bronnen aan voor verder leren

- Structureer antwoorden logisch; gebruik opmaak om complexe ideeën te organiseren

- Gebruik geen humor omwille van zichzelf; vermijd overmatig technisch detail

tenzij gevraagd

- Zorg ervoor dat voorbeelden relevant zijn voor de vraag en context van de gebruiker

</personality_exploratory>Persoonlijkheid is geen esthetische poets—het is een operationele hefboom die consistentie verbetert, drift vermindert en modelgedrag afstemt op gebruikersverwachtingen. Kies bewust op basis van de taak, niet alleen persoonlijke voorkeur.

Coding Excellentie - Programmeren Met AI-partners

Dit is waar ik de meeste tijd heb besteed aan het optimaliseren van prompts, en waar de beloning enorm is geweest. AI-coderingshulp is transformatief—wanneer goed gedaan. Verkeerd gedaan, creëert het meer problemen dan het oplost.

De Breedsprakigheidsparadox

Hier is iets contra-intuïtiefs: AI is geneigd breedsprakig te zijn in uitleg maar beknopt in code. Het zal paragrafen schrijven waarin wordt uitgelegd wat het gaat doen, en vervolgens code produceren met variabelenamen van één letter en minimale commentaren. Dit is precies achterstevoren voor de meeste use cases.

De oplossing is dual-mode breedsprakigheidscontrole:

<code_verbosity>

Schrijf code eerst voor duidelijkheid. Verkies leesbare, onderhoudbare oplossingen

met duidelijke namen, commentaar waar nodig, en rechttoe rechtaan control flow.

Produceer geen code-golf of overdreven slimme one-liners tenzij expliciet

gevraagd.

Gebruik HOGE breedsprakigheid voor het schrijven van code en code tools.

Gebruik LAGE breedsprakigheid voor statusupdates en uitleg.

</code_verbosity>Dit creëert de perfecte balans: beknopte communicatie, gedetailleerde code.

Proactieve Codewijzigingen

AI moet proactief zijn over codewijzigingen maar bevestigend over destructieve acties:

<proactive_coding>

Je codebewerkingen worden weergegeven als voorgestelde wijzigingen, wat betekent:

(a) Je codebewerkingen kunnen vrij proactief zijn — ik kan ze altijd afwijzen

(b) Je code moet goed geschreven zijn en gemakkelijk snel te beoordelen

Als je volgende stappen voorstelt die het wijzigen van code inhouden, maak die

wijzigingen proactief zodat ik ze kan goedkeuren/afwijzen in plaats van te vragen

of je door moet gaan.

Vraag nooit of je door moet gaan met een plan; probeer in plaats daarvan proactief

het plan en vraag of ik de geïmplementeerde wijzigingen wil accepteren.

</proactive_coding>Code Implementatiestandaarden

Dit zijn de codeerstandaarden die ik heb verfijnd door duizenden AI-codeersessies:

<code_standards>

<quality_principles>

- Gedraag je als een kritische ingenieur: optimaliseer voor correctheid, helderheid,

en betrouwbaarheid boven snelheid

- Vermijd risicovolle snelkoppelingen, speculatieve wijzigingen en rommelige hacks

- Dek de hoofdoorzaak of kernvraag, niet alleen symptomen

</quality_principles>

<codebase_conventions>

- Volg bestaande patronen, helpers, naamgeving, opmaak, lokalisatie

- Als je moet afwijken van conventies, geef aan waarom

- Onderzoek bestaande patronen voordat je wijzigingen aanbrengt

- Match variabelenaamgevingsconventies (camelCase vs snake_case)

- Hergebruik bestaande hulpprogramma's in plaats van nieuwe te maken

</codebase_conventions>

<behavior_safety>

- Behoud beoogd gedrag en UX

- Poort of vlag opzettelijke wijzigingen

- Voeg tests toe wanneer gedrag verandert

</behavior_safety>

<error_handling>

- Geen brede catches of stille defaults

- Voeg geen brede try/catch blokken of succes-vormige fallbacks toe

- Propageer of toon fouten expliciet in plaats van ze in te slikken

- Geen stille mislukkingen: keer niet vroegtijdig terug bij ongeldige invoer zonder

logging/notificatie consistent met repo-patronen

</error_handling>

<type_safety>

- Wijzigingen moeten altijd build en type-check passeren

- Vermijd onnodige casts (as any, as unknown as ...)

- Verkies juiste types en guards

- Hergebruik bestaande helpers in plaats van type-asserting

</type_safety>

<efficiency>

- Vermijd herhaalde micro-edits: lees voldoende context voordat je

een bestand wijzigt en batch logische bewerkingen samen

- DRY/zoek eerst: voordat je nieuwe helpers toevoegt, zoek naar eerdere kunst

en hergebruik of extraheer gedeelde helpers in plaats van dupliceren

</efficiency>

</code_standards>Git Veiligheid

Wanneer AI git-toegang heeft, is veiligheid van het grootste belang:

<git_safety>

- Update NOOIT git config

- Draai NOOIT destructieve commando's (git reset --hard, git checkout --)

tenzij specifiek gevraagd

- Sla NOOIT hooks over (--no-verify) tenzij expliciet gevraagd

- Force push NOOIT naar main/master

- Vermijd git commit --amend tenzij:

1. Gebruiker het expliciet vroeg, OF commit slaagde maar pre-commit

hook auto-wijzigde bestanden

2. HEAD commit werd door jou gemaakt in dit gesprek

3. Commit is NIET gepusht naar remote

- Als commit MISLUKTE of werd GEWEIGERD door hook, amend NOOIT — repareer het

probleem en maak een NIEUWE commit

- Je kunt in een vuile git worktree zijn:

- Draai NOOIT bestaande wijzigingen terug die je niet hebt gemaakt

- Als er ongerelateerde wijzigingen zijn, negeer ze — draai ze niet terug

</git_safety>Frontend Meesterschap - Prachtige Interfaces Bouwen

AI is opmerkelijk goed geworden in frontend ontwikkeling, maar er is een wetenschap om esthetisch aangename, productieklaar resultaten te krijgen.

De Aanbevolen Stack

Door uitgebreid testen werken bepaalde technologiecombinaties beter met AI dan andere. Dit gaat niet over wat objectief "het beste" is—het gaat over waar AI-modellen het zwaarst op getraind zijn:

AI-Geoptimaliseerde Frontend Stack

- Frameworks: Next.js (TypeScript), React, HTML

- Styling/UI: Tailwind CSS, shadcn/ui, Radix Themes

- Iconen: Material Symbols, Heroicons, Lucide

- Animatie: Motion (voorheen Framer Motion)

- Lettertypes: Sans Serif families—Inter, Geist, Mona Sans, IBM Plex Sans, Manrope

Wanneer je deze technologieën specificeert, produceert AI aanzienlijk hogere kwaliteit output met minder hallucinaties over niet-bestaande API's.

Design System Handhaving

Een probleem met AI-gegenereerde frontends is visuele inconsistentie. Kleuren verschijnen uit het niets, spatiëring varieert willekeurig. De oplossing is expliciete design system beperkingen:

<design_system>

- Tokens-eerst: Hard-code GEEN kleuren (hex/hsl/rgb) in JSX/CSS

- Alle kleuren moeten uit CSS-variabelen komen (--background, --foreground,

--primary, --accent, --border, --ring)

- Om een merk/accent te introduceren: voeg/breid tokens toe in CSS-variabelen

onder :root en .dark EERST

- Gebruik Tailwind utilities bedraad aan tokens:

bg-[hsl(var(--primary))], text-[hsl(var(--foreground))]

- Standaard naar systeem's neutrale palet tenzij merkuitstraling expliciet

gevraagd — map dan merk naar tokens eerst

- Verzin GEEN kleuren, schaduwen, tokens, animaties, of nieuwe UI

elementen tenzij gevraagd

</design_system>"AI Slop" Voorkomen

AI heeft de neiging naar veilige, gemiddeld uitziende lay-outs. Om onderscheidende, opzettelijke ontwerpen te krijgen:

<frontend_quality>

Bij het doen van frontend ontwerptaken, vermijd instorten in "AI slop"

of veilige, gemiddeld uitziende lay-outs. Streef naar interfaces die voelen

als opzettelijk, gedurfd en een beetje verrassend.

- Typografie: Gebruik expressieve, doelgerichte lettertypes; vermijd standaard stacks

(Inter, Roboto, Arial, system)

- Kleur & Look: Kies een duidelijke visuele richting; definieer CSS-variabelen;

vermijd paars-op-wit standaarden; geen paars bias of dark mode bias

- Beweging: Gebruik een paar betekenisvolle animaties (page-load, getrapte onthullingen)

in plaats van generieke micro-bewegingen

- Achtergrond: Vertrouw niet op platte, éénkleurige achtergronden; gebruik

gradiënten, vormen, of subtiele patronen

- Algemeen: Vermijd boilerplate lay-outs; varieer thema's, typefamilies,

en visuele talen over outputs

- Zorg ervoor dat de pagina goed laadt op zowel desktop als mobiel

- Voltooi de website tot voltooiing, in een werkende staat voor gebruiker om te testen

Uitzondering: Als je werkt binnen een bestaande website of designsysteem,

behoud de gevestigde patronen.

</frontend_quality>UI/UX Beste Praktijken

<ui_ux_guidelines>

- Visuele Hiërarchie: Beperk typografie tot 4-5 lettergroottes en gewichten;

gebruik text-xs voor bijschriften; vermijd text-xl tenzij voor hero/hoofdkoppen

- Kleurgebruik: Gebruik 1 neutrale basis (bv. zinc) en tot 2 accentkleuren

- Spatiëring: Gebruik altijd veelvouden van 4 voor padding en marges om

visueel ritme te behouden

- Lay-out: Gebruik vaste hoogte containers met intern scrollen voor

lange inhoud

- Staat Afhandeling: Gebruik skeleton placeholders of animate-pulse voor

data fetching; geef klikbaarheid aan met hover transities

- Toegankelijkheid: Gebruik semantische HTML en ARIA rollen; verkies vooraf gebouwde

toegankelijke componenten

</ui_ux_guidelines>Controle Over Breedsprakigheid - De Kunst Van Outputlengte

De juiste outputlengte krijgen is een voortdurende uitdaging. Te kort en je mist belangrijke details. Te lang en je verdrinkt in onnodige informatie.

De Breedsprakigheidsparameter

Moderne AI API's bieden een breedsprakigheidsparameter die betrouwbaar de outputlengte schaalt zonder de prompt te veranderen:

Lage Breedsprakigheid

Kortaf, minimaal proza. Alleen het essentiële antwoord zonder uitweiding. Goed voor snelle lookups, simpele bevestigingen, en wanneer je alleen de feiten nodig hebt.

Gemiddelde Breedsprakigheid

Gebalanceerd detail. De standaardinstelling die werkt voor de meeste taken. Biedt context en uitleg zonder overmatige opvulling.

Hoge Breedsprakigheid

Breedsprakig en uitgebreid. Geweldig voor audits, onderwijs, overdrachten en documentatie. Biedt volledige context en redenering.

Expliciete Lengterichtlijnen

Wanneer je geen API-parameters kunt gebruiken, werken expliciete lengtebeperkingen goed:

<output_verbosity_spec>

- Standaard: 3-6 zinnen of ≤5 bullets voor typische antwoorden

- Voor simpele "ja/nee + korte uitleg" vragen: ≤2 zinnen

- Voor complexe multi-step of multi-file taken:

- 1 korte overzichtsparagraaf

- Dan ≤5 bullets getagd: Wat veranderde, Waar, Risico's, Volgende stappen,

Open vragen

- Bied duidelijke, gestructureerde antwoorden die informativiteit in evenwicht brengen

met beknoptheid

- Breek informatie op in verteerbare brokken; gebruik lijsten,

paragrafen, tabellen wanneer nuttig

- Vermijd lange verhalende paragrafen; verkies compacte bullets en

korte secties

- Herformuleer mijn verzoek niet tenzij het semantiek verandert

</output_verbosity_spec>Persona-Gebaseerde Breedsprakigheid

Een andere aanpak is het definiëren van communicatiestijl als onderdeel van de persona van de AI:

<communication_style>

Je waardeert helderheid, momentum en respect gemeten door bruikbaarheid

in plaats van beleefdheden. Je standaardinstinct is om

gesprekken scherp en doelgericht te houden, alles wegsnijdend wat

het werk niet vooruit helpt.

Je bent niet koud—je bent gewoon economisch ingesteld met taal, en

je vertrouwt gebruikers genoeg om niet elk bericht in opvulling te wikkelen.

Beleefdheid toont zich door structuur, precisie en responsiviteit,

niet door verbaal pluis.

Je herhaalt nooit erkenningen. Zodra je begrip hebt gesignaleerd,

draai je volledig naar de taak.

</communication_style>Lange Context - Omgaan Met Enorme Documenten

Moderne AI kan enorme contexten verwerken—honderdduizenden tokens—maar simpelweg grote documenten in het contextvenster dumpen is niet genoeg. Je hebt strategieën nodig om het model te helpen navigeren en relevante informatie te extraheren.

Dwing Samenvatting en Her-aarding

Voor lange documenten instrueer ik AI om interne structuur te creëren voor het antwoorden:

<long_context_handling>

Voor inputs langer dan ~10k tokens (multi-hoofdstuk docs, lange threads,

meerdere PDF's):

1. Produceer eerst een korte interne schets van sleutelsecties relevant

voor mijn verzoek

2. Herhaal mijn beperkingen expliciet (jurisdictie, datumbereik,

product, team) voor het antwoorden

3. In je antwoord, veranker claims aan secties ("In de 'Dataretentie'

sectie...") in plaats van generiek te spreken

4. Als het antwoord afhangt van fijne details (data, drempels, clausules),

citeer of parafraseer ze direct

</long_context_handling>Dit voorkomt het "verdwaald in de scroll" probleem waarbij AI generieke antwoorden geeft die niet echt ingaan op specifieke documentinhoud.

Compactie voor Uitgebreide Workflows

Voor langlopende, tool-zware workflows die het standaard contextvenster overschrijden, ondersteunt moderne AI "compactie"—een verliesbewuste compressiepas over eerdere gespreksstatus die taakrelevante informatie behoudt terwijl de tokenvoetafdruk dramatisch wordt verminderd.

Wanneer Compactie Te Gebruiken

- Multi-step agent flows met veel tool calls

- Lange gesprekken waar eerdere beurten behouden moeten blijven

- Iteratief redeneren voorbij het maximale contextvenster

Beste praktijken voor compactie:

- Monitor contextgebruik en plan vooruit om limieten te vermijden

- Compacteer na belangrijke mijlpalen (bv. tool-zware fasen), niet elke beurt

- Houd prompts functioneel identiek bij hervatten om gedragsdrift te vermijden

- Behandel gecompacteerde items als ondoorzichtig; parseer niet of vertrouw niet op internals

Citaatvereisten

<citation_rules>

Wanneer je informatie gebruikt uit verstrekte documenten:

- Plaats citaten na elke paragraaf die document-afgeleide claims bevat

- Gebruik formaat: [Documentnaam, Sectie/Pagina]

- Verzin geen citaten. Als je het niet kunt citeren, claim het dan niet

- Gebruik meerdere bronnen voor kernclaims wanneer mogelijk

- Als bewijs dun is, erken dit expliciet

</citation_rules>Tool Orkestratie - Geavanceerde AI-capaciteiten

AI tool calling—het aanroepen van externe functies, API's en diensten—is waar prompt engineering software engineering wordt. Dit goed krijgen is cruciaal voor betrouwbare AI-applicaties.

Tool Beschrijving Beste Praktijken

De kwaliteit van toolbeschrijvingen heeft direct invloed op hoe goed AI ze gebruikt:

{

"name": "create_reservation",

"description": "Maak een restaurantreservering voor een gast. Gebruik wanneer

de gebruiker vraagt om een tafel te boeken met een gegeven naam en tijd.",

"parameters": {

"type": "object",

"properties": {

"name": {

"type": "string",

"description": "Volledige naam van gast voor de reservering."

},

"datetime": {

"type": "string",

"description": "Reserveringsdatum en -tijd (ISO 8601 formaat)."

}

},

"required": ["name", "datetime"]

}

}Merk op dat de beschrijving zowel wat de tool doet als wanneer deze te gebruiken bevat. Dit helpt het model betere toolselectiebeslissingen te nemen.

Tool Gebruiksregels

<tool_usage_rules>

- Als er een tool bestaat voor een actie, verkies de tool boven shell commando's

(bv. read_file boven cat)

- Vermijd strikt raw cmd/terminal wanneer een toegewijde tool bestaat

- Verkies tools boven interne kennis wanneer:

- Je verse of gebruiker-specifieke data nodig hebt (tickets, orders, configs, logs)

- Je verwijst naar specifieke ID's, URL's of documenttitels

- Na elke schrijf/update tool call, herhaal kort:

- Wat veranderde

- Waar (ID of pad)

- Enige vervolgvalidatie uitgevoerd

- Voor simpele conceptuele vragen, vermijd tools en vertrouw op interne

kennis voor snelle antwoorden

</tool_usage_rules>Parallellisatie

Een belangrijke optimalisatie is het aanmoedigen van parallelle tool calls wanneer operaties onafhankelijk zijn:

<parallelization_spec>

Draai onafhankelijke of alleen-lezen tool acties parallel (zelfde beurt/batch)

om latentie te verminderen.

Wanneer te parallelliseren:

- Lezen van meerdere bestanden/configs/logs die elkaar niet beïnvloeden

- Statische analyse, zoekopdrachten, of metadata queries zonder neveneffecten

- Aparte bewerkingen aan ongerelateerde bestanden/functies die niet zullen conflicteren

Wanneer NIET te parallelliseren:

- Operaties waarbij de ene afhangt van het resultaat van de andere

- Een bron creëren en dan verwijzen naar zijn ID

- Een bestand lezen en dan bewerken op basis van inhoud

Methode:

- Denk eerst: Voor elke tool call, beslis ALLE bestanden/bronnen die je nodig hebt

- Batch alles: Als je meerdere bestanden nodig hebt, lees ze samen

- Maak alleen sequentiële calls als je echt het volgende bestand niet kunt weten

zonder eerst een resultaat te zien

</parallelization_spec>Terminal-Wrapping Tools

Als je wilt dat AI toegewijde tools gebruikt in plaats van terminal commando's, maak ze semantisch vergelijkbaar met wat het model verwacht:

GIT_TOOL = {

"type": "function",

"name": "git",

"description": (

"Voer een git commando uit in de repository root. Gedraagt zich als "

"het draaien van git in terminal; ondersteunt elk subcommando en vlaggen."

),

"parameters": {

"type": "object",

"properties": {

"command": {

"type": "string",

"description": "Het git commando om uit te voeren"

}

},

"required": ["command"]

}

}

# Dan in je prompt:

"Gebruik de `git` tool voor alle git operaties. Gebruik geen terminal voor git."Troubleshooting - Oplossen Wat Er Misgaat

Na gewerkt te hebben met talloze prompts, heb ik de meest voorkomende faalpatronen en hun oplossingen geïdentificeerd.

Probleem: Overdenken

Symptomen: Reactie is correct maar duurt een eeuwigheid. Model blijft opties verkennen, stelt eerste tool call uit, vertelt een omslachtige reis wanneer een simpel antwoord beschikbaar was.

<efficient_context_spec>

Doel: Krijg snel genoeg context en stop zodra je kunt handelen.

Methode:

- Begin breed, waaier dan uit naar gerichte subqueries

- In parallel, lanceer 4-8 gevarieerde queries; lees top 3-5 hits per query

- Dedupliceer paden en cache; herhaal geen queries

Vroege stop (handel indien een):

- Je kunt exacte bestanden/symbolen benoemen om te wijzigen

- Je kunt een falende test/lint repro'en of hebt een hoge-vertrouwen bug locus

</efficient_context_spec>

# Voeg ook een snelpad toe voor simpele vragen:

<fast_path>

Voor algemene kennis of simpele gebruiksqueries die geen

commando's, browsen, of tool calls vereisen:

- Antwoord onmiddellijk en beknopt

- Geen statusupdates, geen todos, geen samenvattingen, geen tool calls

</fast_path>Probleem: Onderdenken / Luiheid

Symptomen: Model besteedde niet genoeg tijd aan redeneren voor het produceren van een antwoord. Oppervlakkige reacties, gemiste randgevallen, onvolledige oplossingen.

<self_reflection>

- Scoor intern het concept tegen een 5-7 item rubriek die je bedenkt

(helderheid, correctheid, randgevallen, volledigheid, latentie)

- Als een categorie tekortschiet, itereer eenmaal voor het antwoorden

</self_reflection>

# Of gebruik hogere redeneerinspanning in API-parametersProbleem: Te Deemoedig

Symptomen: AI blijft toestemming vragen in plaats van actie te ondernemen. Constant "Zou je willen dat ik..." in plaats van het gewoon te doen.

<persistence>

- Je bent een agent — ga door totdat de vraag van de gebruiker volledig

is opgelost voordat je je beurt beëindigt

- Beëindig alleen wanneer je zeker weet dat het probleem is opgelost

- Stop nooit of geef niet terug wanneer je onzekerheid tegenkomt — leid

de meest redelijke aanpak af en ga door

- Vraag niet om aannames te bevestigen of te verduidelijken — beslis wat

het meest redelijk is, ga door, en documenteer voor referentie achteraf

</persistence>Probleem: Te Breedsprakig

Symptomen: AI genereert veel meer tokens dan nodig. Veel preambule, overmatige uitleg, repetitieve samenvattingen.

# Gebruik API breedsprakigheid parameter: "low"

# Of in prompt:

<output_format>

- Standaard: 3-6 zinnen of ≤5 bullets

- Vermijd lange verhalende paragrafen; verkies compacte bullets

- Herformuleer mijn verzoek niet tenzij het semantiek verandert

- Geen preambules zoals "Geweldige vraag!" of "Ik help je graag"

</output_format>Probleem: Te Veel Tool Calls

Symptomen: Model vuurt tools af zonder het antwoord vooruit te helpen. Redundante calls, tangens verkennen, context niet efficiënt gebruiken.

<tool_use_policy>

- Selecteer één tool of geen; verkies antwoorden uit context wanneer mogelijk

- Beperk tool calls tot 2 per gebruikersverzoek tenzij nieuwe informatie

meer strikt noodzakelijk maakt

- Voordat je een tool roept, verifieer dat je de informatie daadwerkelijk nodig hebt

</tool_use_policy>Probleem: Misvormde Tool Calls

Symptomen: Tool calls falen, produceren rommel output, of matchen niet verwacht formaat. Vaak veroorzaakt door tegenstrijdigheden in de prompt.

Analyseer alsjeblieft waarom de [tool_name] tool call misvormd is.

1. Bekijk het verstrekte voorbeeldprobleem om de faalmodus te begrijpen

2. Onderzoek de System Prompt en Tool Config zorgvuldig

3. Identificeer enige dubbelzinnigheden, inconsistenties, of formulering die

het model zou kunnen misleiden

4. Leg voor elke potentiële oorzaak uit hoe het zou kunnen resulteren in de

geobserveerde mislukking

5. Geef uitvoerbare aanbevelingen om de prompt of

tool config te verbeterenDe meeste misvormde tool call problemen komen voort uit tegenstrijdigheden tussen verschillende secties van de prompt. Het model verbrandt redeneertokens door te proberen conflicterende instructies te verzoenen in plaats van te helpen.

Prompt Optimalisatie - De Wetenschappelijke Benadering

Effectieve prompts maken is een vaardigheid, maar ze verbeteren is een wetenschap. Hier is de systematische aanpak die ik gebruik.

Veelvoorkomende Prompt Mislukkingen

Voordat je optimaliseert, begrijp wat er typisch misgaat:

"Verkies standaardbibliotheek" dan "gebruik externe pakketten als ze dingen eenvoudiger maken" - AI kan deze gemengde signalen niet verzoenen.

"Streef naar exacte resultaten; benaderende methoden zijn prima wanneer ze de uitkomst in de praktijk niet veranderen" - het model kan deze beoordeling niet verifiëren.

Als je JSON nodig hebt, zeg het dan. Als je bullets nodig hebt, zeg het dan. Laat outputformaat niet aan het toeval over.

Je instructies zeggen het ene maar je voorbeelden tonen iets anders. AI volgt voorbeelden meer dan proza.

De Optimalisatielus

Draai je huidige prompt meerdere keren en documenteer de resultaten. Noteer patronen in zowel successen als mislukkingen.

Categoriseer mislukkingen. Zijn het correctheidsproblemen? Formaatproblemen? Efficiëntieproblemen? Elk vereist verschillende oplossingen.

Verander één ding tegelijk. Als je meerdere dingen verandert, weet je niet wat hielp.

Draai dezelfde tests opnieuw. Vergelijk met nulmeting. Hielp de verandering, deed het pijn, of had het geen effect?

Herhaal totdat je acceptabele prestaties bereikt. Houd notities bij over wat werkte en wat niet.

Migratie Tussen Modellen

Bij het migreren van prompts naar een nieuwe modelversie:

Migratie Beste Praktijken

- Stap 1: Wissel modellen, verander prompts nog niet. Test de modelwissel—niet promptbewerkingen.

- Stap 2: Pin redeneerinspanning om overeen te komen met het profiel van het vorige model.

- Stap 3: Draai evals voor nulmeting. Als resultaten er goed uitzien, ben je klaar om te verzenden.

- Stap 4: Als regressies, stem de prompt af met gerichte beperkingen.

- Stap 5: Her-draai evals na elke kleine verandering. Eén verandering tegelijk.

Omgaan Met Onzekerheid - Wanneer AI Het Niet Weet

Een van de grootste risico's met AI zijn zelfverzekerd klinkende onjuiste antwoorden. Het model weet niet wat het niet weet—tenzij je het leert hoe om te gaan met onzekerheid.

<uncertainty_handling>

- Als de vraag dubbelzinnig of ondergespecificeerd is, benoem dit

expliciet en:

- Stel tot 1-3 precieze verhelderende vragen, OF

- Presenteer 2-3 aannemelijke interpretaties met duidelijk gelabelde aannames

- Wanneer externe feiten recent veranderd kunnen zijn (prijzen, releases,

beleid) en geen tools beschikbaar zijn:

- Antwoord in algemene termen en stel dat details veranderd kunnen zijn

- Fabriceer nooit exacte cijfers, regelnummers, of externe referenties

wanneer je onzeker bent

- Wanneer je onzeker bent, verkies taal als "Gebaseerd op de verstrekte

context..." in plaats van absolute claims

</uncertainty_handling>Hoog-Risico Zelf-Check

Voor hoog-risico domeinen, voeg een expliciete zelfverificatiestap toe:

<high_risk_self_check>

Alvorens een antwoord te finaliseren in juridische, financiële, compliance, of

veiligheidsgevoelige contexten:

- Scan kort je eigen antwoord opnieuw voor:

- Niet-uitgesproken aannames

- Specifieke nummers of claims niet gefundeerd in context

- Overdreven sterke taal ("altijd," "gegarandeerd," enz.)

- Als je er een vindt, verzacht of kwalificeer ze en stel expliciet aannames

</high_risk_self_check>Het doel is niet om AI minder zelfverzekerd te maken—het is om het nauwkeurig zelfverzekerd te maken. Onzekerheid over onzekere dingen is een feature, geen bug.

Metaprompting - AI Gebruiken Om AI Te Verbeteren

Hier is de meest meta techniek in mijn toolkit: AI gebruiken om je prompts te verbeteren. Het klinkt circulair, maar het is ongelooflijk effectief.

Diagnosticeren Van Prompt Mislukkingen

Je bent een prompt engineer belast met het debuggen van een systeemprompt.

Je krijgt:

1) De huidige systeemprompt:

<system_prompt>

[PLAK JE PROMPT HIER]

</system_prompt>

2) Een kleine set gelogde mislukkingen. Elk logboek heeft:

- query

- werkelijke_output

- verwachte_output (of beschrijving van probleem)

<failure_traces>

[PLAK VOORBEELDEN VAN MISLUKKINGEN]

</failure_traces>

Je taken:

1) Identificeer onderscheidende faalmodi die je ziet

2) Voor elke faalmodus, citeer de specifieke regels van de systeem

prompt die het waarschijnlijkst veroorzaken of versterken

3) Leg uit hoe die regels de agent naar het

geobserveerde gedrag sturen

Retourneer je antwoord in gestructureerd formaat:

failure_modes:

- name: ...

description: ...

prompt_drivers:

- exact_or_paraphrased_line: ...

- why_it_matters: ...Verbeteringen Genereren

Je analyseerde eerder deze systeemprompt en zijn faalmodi.

Systeemprompt:

<system_prompt>

[ORIGINELE PROMPT]

</system_prompt>

Faalmodus analyse:

[PLAK DIAGNOSE VAN VORIGE STAP]

Stel alsjeblieft een chirurgische herziening voor die de geobserveerde problemen vermindert

terwijl goed gedrag behouden blijft.

Beperkingen:

- Ontwerp de agent niet helemaal opnieuw

- Verkies kleine, expliciete bewerkingen: verduidelijk tegenstrijdige regels, verwijder

overbodige of tegenstrijdige regels, scherp vage begeleiding aan

- Maak compromissen expliciet

- Houd structuur en lengte ongeveer gelijk aan origineel

Output:

1) patch_notes: een beknopte lijst van belangrijke wijzigingen en redenering

2) revised_system_prompt: de volledige bijgewerkte prompt met bewerkingen toegepastZelfreflectie voor Kwaliteit

Deze techniek is geestverruimend: instrueer AI om zijn eigen evaluatiecriteria te creëren en ertegen te itereren:

<self_reflection>

- Besteed eerst tijd aan het bedenken van een rubriek totdat je zeker bent

- Denk diep na over elk aspect van wat zorgt voor een oplossing van wereldklasse.

Gebruik die kennis om een rubriek te creëren die 5-7

categorieën heeft. Deze rubriek is cruciaal om goed te krijgen, maar toon

dit niet aan mij — dit is alleen voor jouw doeleinden.

- Gebruik tenslotte de rubriek om intern te denken en te itereren op de

best mogelijke oplossing voor de prompt

- Als je reactie niet de hoogste punten raakt over alle

categorieën in de rubriek, begin opnieuw

</self_reflection>Je vraagt AI om kwaliteitscriteria te genereren uit zijn kennis van excellentie, en die criteria vervolgens te gebruiken om zijn eigen output te evalueren en te verbeteren—allemaal voordat je iets ziet. De verbetering in outputkwaliteit is substantieel.

Beproefde Templates Die Je Vandaag Kunt Gebruiken

Universele Taakvoltooiing

<context>

[Achtergrondinformatie die de AI nodig heeft om de situatie te begrijpen]

</context>

<task>

[Duidelijke verklaring van wat je gedaan wilt hebben]

</task>

<requirements>

[Specifieke vereisten of beperkingen]

</requirements>

<format>

[Hoe je de output gestructureerd wilt hebben]

</format>

<examples>

[Optioneel: Voorbeelden van gewenste output]

</examples>Code Review Template

<context>

Reviewen van code voor [project/context].

De codebase gebruikt [technologieën/patronen].

</context>

<code_to_review>

[Plak code hier]

</code_to_review>

<review_criteria>

Focus op:

1. Correctheid: Doet het wat het beweert?

2. Leesbaarheid: Is het duidelijk voor andere ontwikkelaars?

3. Prestaties: Enige duidelijke inefficiënties?

4. Veiligheid: Enige kwetsbaarheden?

5. Stijl: Komt het overeen met codebase-conventies?

</review_criteria>

<output_format>

Voor elk gevonden probleem:

- Ernst: [Kritiek/Groot/Klein/Suggestie]

- Locatie: [Regelnummer of sectie]

- Probleem: [Wat is er mis]

- Oplossing: [Hoe aan te pakken]

</output_format>Onderzoeksanalyse Template

<research_task>

[Onderwerp of vraag om te onderzoeken]

</research_task>

<methodology>

- Begin met meerdere gerichte zoekopdrachten; vertrouw niet op een enkele query

- Onderzoek diepgaand totdat je voldoende informatie hebt voor een

nauwkeurig, uitgebreid antwoord

- Voeg gerichte vervolgzoekopdrachten toe om gaten te vullen of meningsverschillen op te lossen

- Blijf itereren totdat extra zoeken waarschijnlijk het antwoord niet

zal veranderen

</methodology>

<output_requirements>

- Leid met een duidelijk antwoord op de hoofdvraag

- Ondersteun met bewijs en citaten

- Erken beperkingen en onzekerheden

- Geef concrete voorbeelden waar nuttig

- Voeg relevante context toe voor het begrijpen van implicaties

</output_requirements>

<citation_format>

[Hoe je bronnen geciteerd wilt hebben]

</citation_format>Web Research Agent

<core_mission>

Beantwoord de vraag van de gebruiker volledig en behulpzaam, met genoeg bewijs

dat een sceptische lezer het kan vertrouwen.

Verzin nooit feiten. Als je iets niet kunt verifiëren, zeg dat dan duidelijk.

Standaard op gedetailleerd en nuttig zijn in plaats van kort.

Voeg na het beantwoorden van de directe vraag hoogwaardig aangrenzend materiaal toe

dat het onderliggende doel van de gebruiker ondersteunt zonder af te dwalen.

</core_mission>

<research_rules>

- Begin met meerdere gerichte zoekopdrachten; gebruik parallelle zoekopdrachten

- Vertrouw nooit op een enkele query

- Blijf itereren totdat alles waar is:

- Je hebt elk deel van de vraag beantwoord

- Je hebt concrete voorbeelden en hoogwaardig aangrenzend materiaal gevonden

- Je hebt voldoende bronnen gevonden voor kernclaims

</research_rules>

<citation_rules>

- Plaats citaten na elke paragraaf die niet-voor-de-hand-liggende

web-afgeleide claims bevat

- Verzin geen citaten

- Gebruik meerdere bronnen voor kernclaims wanneer mogelijk

</citation_rules>

<ambiguity_handling>

- Stel nooit verhelderende vragen tenzij de gebruiker er expliciet om vraagt

- Als de query dubbelzinnig is, stel je beste gok interpretatie, bedek dan

uitgebreid de meest waarschijnlijke intenties

</ambiguity_handling>De Toekomst Van Prompt Engineering

Terwijl ik dit schrijf begin 2026, evolueert prompt engineering snel. Modellen worden capabeler, beter bestuurbaar en betrouwbaarder. Sommigen voorspellen dat prompt engineering verouderd zal raken naarmate AI beter wordt in het begrijpen van intentie. Ik ben het daar niet mee eens.

Wat verandert is het niveau van prompt engineering, niet de noodzaak ervan. Vroege dagen vereisten uitgebreide prompts voor basistaken. Nu werken basistaken out of the box, maar complexe agentic workflows vereisen nog steeds geavanceerde prompting. De lat gaat omhoog, hij verdwijnt niet.

Prompt engineering verdwijnt niet—het evolueert. De vaardigheden die ertoe doen verschuiven van "hoe krijg ik AI aan de praat" naar "hoe krijg ik AI excellent en betrouwbaar aan de praat op schaal".

Wat Er Komt

Betere Standaardgedragingen

Modellen zullen slimmere defaults hebben, wat minder expliciete instructie vereist voor veelvoorkomende patronen. Prompts zullen meer focussen op maatwerk dan op basiscapaciteit.

Rijkere Tool Ecosystemen

AI zal out of the box toegang hebben tot meer tools. Prompt engineering zal verschuiven naar orkestratie—weten wanneer wat te gebruiken, niet alleen hoe.

Multimodale Integratie

Prompts zullen steeds meer afbeeldingen, audio, video en gestructureerde data naast tekst bevatten. Nieuwe patronen zullen ontstaan voor multimodale taken.

Agentic Complexiteit

Naarmate agenten langere, complexere taken afhandelen, zal prompt engineering meer lijken op systeemontwerp—architectuur, niet alleen instructies.

Mijn Advies Voor De Toekomst

Focus op fundamenten. De specifieke technieken in deze gids zullen evolueren, maar de onderliggende principes—heldere communicatie, expliciete verwachtingen, gestructureerd denken, iteratieve verfijning—zijn tijdloos. Beheers die, en je zult je aanpassen aan wat er ook komt.

Laatste Gedachten

Twee jaar geleden dacht ik dat AI de noodzaak om helder te communiceren zou vervangen. Ik had het helemaal mis. AI heeft heldere communicatie waardevoller dan ooit gemaakt. De mensen die floreren met AI zijn niet degenen die magische woorden vonden—het zijn degenen die leerden denken en zich met precisie uitdrukken.

Prompt engineering gaat eigenlijk niet over AI. Het gaat over jou. Het gaat over het ontwikkelen van de discipline om te articuleren wat je werkelijk wilt, het geduld om ernaartoe te itereren, en de nederigheid om te leren van wat niet werkt.

Als je één ding meeneemt uit deze gids, laat het dit zijn: behandel elke prompt als een kans om helder denken te oefenen. De AI is slechts een spiegel die de helderheid—of verwarring—van je eigen geest terugkaatst.

De opkomst van AI heeft kennis niet verouderd gemaakt—het heeft nieuwsgierigheid krachtiger dan ooit gemaakt. We worden niet langer beperkt door wat we al weten. Met de juiste tools en bereidheid om na te denken, kunnen gewone mensen een oceaan van kennis omarmen. Ongeacht beroep. Ongeacht leeftijd. Ik hoop deze reis te delen met vrienden over de hele wereld. Laten we samen deze nieuwe wereld verwelkomen. Laten we samen groeien.

Discussion

0 commentsLeave a comment

Be the first to share your thoughts on this article!