AI 不怕你的无知 — 它怕的是你的模糊。你对需求越清晰,AI 就越能为你服务。

三年前,我在 ChatGPT 中输入了我的第一条提示词。那是一个令人尴尬的简单问题 — 大概是问它机器学习是什么。由于回应简直像魔法一样。这个实体似乎能理解我问的任何问题,并以一种近乎人类的智能进行回应。

但随着几个月变成几年,AI 逐渐融入我的日常工作,我发现了一个改变一切的事实:AI 输出的质量几乎完全取决于你输入的质量。魔法不在于 AI 本身 — 而在于我们之间的对话。

这是我希望在刚开始时就能拥有的完整指南。我将所有关于提示工程的所学 — 从深夜的实验到改变职业生涯的发现 — 浓缩于此。无论你是刚刚起步,还是希望提升你的 AI 技能,接下来的内容都是行之有效的真实技巧、让我付出惨痛代价的错误,以及彻底改变我对于人机协作看法的哲学。

改变一切的时刻

那是一个法定假日 — 这种世界似乎暂停的罕见时刻之一。没有工作邮件,没有 KPI 在背后催促,没有会议。只有我,我的思想,以及一个已成为我意外伙伴的 AI 聊天窗口。

此前,我与 AI 的互动纯粹是功利性的。我需要它起草邮件、总结文档、调试代码。这种关系是交易性的 — 我发出指令,它产出结果。但那一周,随着时间在我面前无限延伸,我开始进行真正的对话。

我们谈论了一切 — 我对未来的焦虑、随意的哲学话题、我从未与任何人分享过的半成形想法。在那些漫无边际的讨论中,我偶然发现了一些感觉像发现了火种一样的东西。

我当时正准备做一个关于 AI 时代内容创作的演讲。我一直在发展一个理论 — 未来的问题不是信息过载,而是过滤器失效。这个想法最初来自 Clay Shirky,但我试图将其扩展到我们当前的时刻。

我的论点很简单:AI 将导致内容生产呈指数级爆炸,而人类的消费能力基本保持不变。这将造成永久性的、不断扩大的失衡。区分 AI 生成内容和人类内容的成本最终将超过这种区分的价值。因此,传统的信息过滤将变得不可能。

我认为我的论点很扎实。然后我让 Gemini 把我驳倒。

我即将参加一场辩论赛,很多人会挑战我的观点。这个理论必须无懈可击。如果你是一位学者,你需要用每一个论点、细节和逻辑来挑战我,反驳我。你唯一的目标就是证明我是错的。你会如何反驳?这一个简单的提示词永远改变了我的学习方式。

几秒钟内,AI 精确地拆解了我的第一个前提:

"你的第一定律有一个根本的逻辑缺陷。你只看到 AI 作为信息生产者 — 这是一个静态的、片面的视角。AI 既是矛也是盾。AI 可以一秒钟写出一万篇文章,但更强大的 AI 也可以一秒钟读完这一万篇,并告诉我哪三篇是我最需要的。你只看到了信息洪水,却没看到与洪水同时诞生的更强大的诺亚方舟 — AI 驱动的个性化过滤系统。"

我瘫坐在椅子上,惊呆了。我那自以为无懈可击的论点出现了一个巨大的漏洞。在那一刻的智力羞辱中,我感受到了多年未曾体验过的东西:真正的学习带来的令人兴奋的眩晕感。

AI 最强大的用途不是获取答案 — 而是让你的假设受到挑战。辩论是对你思想的不断锤炼和锻造。

接下来是两小时的智力交锋。我反击道:"你关于 AI 既是矛也是盾的观点是正确的,但这正是可怕的地方。未来会有成千上万的 AI 过滤公司,都声称他们的过滤是最好的。那么告诉我 — 面对这成千上万艘都声称能帮你抵御洪水的诺亚方舟,你选择登上哪一艘?当你无法用技术来判断技术的质量时,你的最终判断依据是什么?"

对话升级到了哲学的高度。AI 辩称,个人 AI 模型将比任何人类都更了解我们的口味,使得外部过滤器过时。我反驳说,信任本身将成为最稀缺的资源。它引用了系统论;我则用流浪诗人打破王国围墙的比喻来回应。

最后,我精疲力竭,兴奋不已,脱胎换骨。辩论的结果并不重要。重要的是自我辩论的过程本身 — 利用一个无限耐心、知识渊博的陪练来加强我自己的思考。

那天晚上,我意识到我发现了在 AI 时代学习的深刻道理。从那以后,我花了数年时间将这一发现提炼成任何人都可以使用的系统。

理解 AI 真正需要你提供什么

在深入探讨技巧之前,我们需要理解一个基本点:AI 沟通不同于人类沟通。当你与朋友交谈时,他们会用共享的背景、社交线索和直觉来填补空白。当你与 AI 交谈时,你留下的每一个空白都是它做出假设的空间 — 而这些假设可能不符合你的意图。

让我用一个职场场景来说明,这对许多人来说可能会感到痛苦地熟悉。

你的老板给你发信息:"小李,把这个表格填一下,急!" 他转发了一段合并的聊天记录,读完后,你知道需要填一个表格,但你不知道是谁发布的,用来做什么,谁来审核,或者何时截止。你私信老板澄清。他回复:"忙,按要求填就行。"

当你给 AI 模糊的提示词时,发生的正是这种情况。只不过 AI 不会要求澄清 — 它只会做出假设,并生成一些在技术上满足你的要求但完全偏离你实际需求的东西。

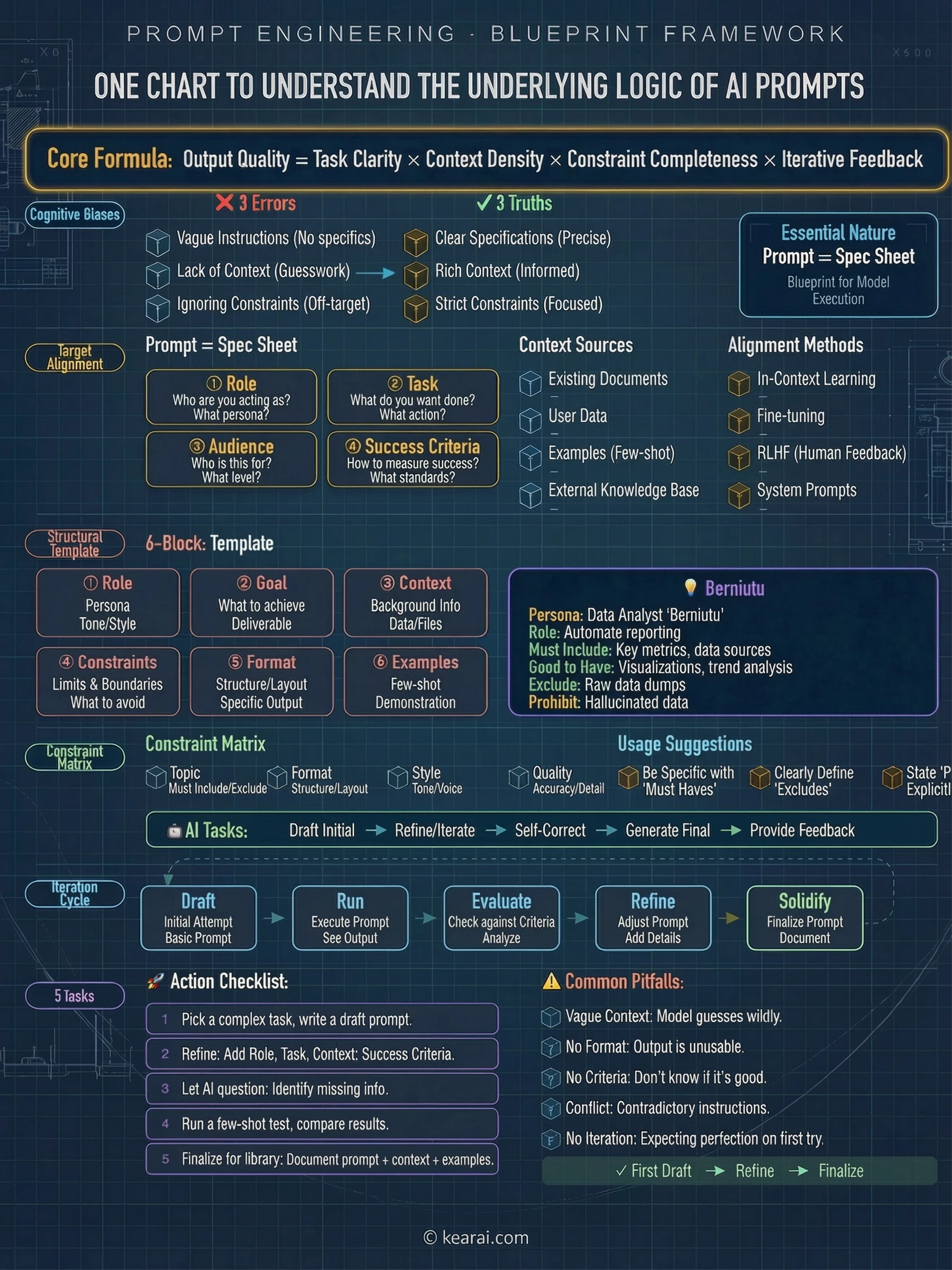

高效提示词的四大支柱

角色清晰 (Role Clarity)

在这个语境中你是谁?你的职位、专业水平以及与任务的关系是什么?这有助于 AI 适当地调整其回应。

受众对齐 (Audience Alignment)

谁将接收这个输出?技术决策者需要的内容与一线操作员不同。明确指定你的受众。

场景语境 (Scenario Context)

这个输出将在哪里以及如何被使用?客户演示需要的语气与内部文档不同。语境塑造内容。

目标定义 (Goal Definition)

你需要什么具体的结果?不要只描述任务 — 描述成功是什么样子的。以结果为中心。

阻碍人们的误解

在观察人们与 AI 斗争多年后,我发现了三个导致结果不佳的误解:

误解 1:复杂等于专业

人们的做法: 堆砌行话、XML 标签和技术术语,以显得高深。

为什么失败: 现代 AI 模型具有出色的自然语言理解能力。过于复杂的提示词往往会造成混淆而不是澄清。

更好的方法: 写作自然但精准。清晰的标题、简单的段落和直白的语言比精心的格式化更有效。

误解 2:指令就足够了

人们的做法: 告诉 AI 做什么,而不解释为什么、为谁做或在什么限制下做。

为什么失败: AI 没有行业常识,也没有默认设置。没有语境,它只能猜测。

更好的方法: 将提示词视为完整的简报。包括背景、限制、受众和成功标准。

误解 3:一次尝试就应定稿

人们的做法: 期望立即获得完美输出,当结果令人失望时得出 AI "不够好" 的结论。

为什么失败: 提示工程本质上是迭代的。即使是专家也会多次完善他们的提示词。

更好的方法: 从草稿提示词开始,分析输出,找出差距,然后改进。每一次迭代都让你更接近目标。

误解 4:一个提示词适用所有

人们的做法: 对每个 AI 模型和每种任务类型使用相同的提示风格。

为什么失败: 不同的模型有不同的优势。Claude 擅长对话式提示词;GPT 更喜欢结构化的。

更好的方法: 了解每个模型的个性,并相应地调整你的沟通风格。

提示工程思维方式

不要把提示看作是给工具下达指令,而是看作是与一位非常有能力但对语境一无所知的同事合作。你的工作是提供他们做好工作所需的所有语境。

改变你提示词的六个思维模型

我在日常工作中很少使用死板、公式化的提示词。相反,我使用的是思维模型 — 灵活的思维框架,适应任何情况。这六个模型大概涵盖了你所需内容的 90%。

模型 1:让 AI 选择它自己的专家角色

我们都知道为 AI 设定角色可以改善回应。但如果你不知道哪个角色最适合你的问题怎么办?不要猜 — 让 AI 来选择。

我想探索 [领域] 中的 [话题类型/场景]。

先别回答。

首先,请选择该领域最适合思考这个问题的顶级名人专家。

可以是再世或历史人物,名字可以冷门,但必须在该特定领域非常专业。

如果你不确定选谁,可以先问我 2 个定位问题再选择。

首先输出:

1. 你选了谁,他们的具体领域

2. 你为什么选他们,三句话

然后让我描述详细问题。这对于最佳视角不明显的跨学科问题特别有效。

我发现真人往往比通用角色效果更好。"史蒂夫·乔布斯" 产生的结果与 "拥有10年经验的产品经理" 不同 — 调用特定人物的已知视角有助于 AI 采用更一致的观点。

模型 2:苏格拉底式提问(让 AI 先采访你)

在现实生活中,当你向专家朋友求助时,他们不会立即给出建议。他们会先问澄清性问题。AI 也应该这样做,但默认情况下,它不会 — 它只是根据你提供的任何信息生成输出。

[你的问题/请求]

在回答之前请先向我提问。

要求:

- 一次只问一个问题。

- 根据我的回答继续提问。

- 直到你有 95% 的信心理解我的真实需求和目标。

- 然后给出你的解决方案。"95% 的信心阈值" 很关键 — 它高到足以确保质量,但也现实到足以防止无限循环。

当你不太确定自己需要什么时,这个技巧特别强大。提问过程往往会揭示你未曾有意识考虑过的问题方面。

模型 3:对抗性辩论

AI 在正常对话中最大的弱点是它倾向于赞同。它想取悦你,这意味着它经常验证那些应该受到挑战的想法。辩论模型迫使它站在对立面。

我即将参加一场辩论赛,很多人会挑战我的观点。

我的观点是 [观点]

我希望这个理论必须变得无懈可击。

如果你是一位学者,你需要用每一个论点、细节和逻辑来挑战我,反驳我。

你唯一的目标就是证明我是错的。

你会如何反驳?当你只是想要快速反馈时的简化版本:

[我的想法/观点]

现在请扮演"对手角色",从不同角度攻击我的想法,帮我完善观点。

要求:不需要礼貌,直接指出缺陷。模型 4:事前验尸分析(失败预演)

人类在计划时会兴奋。AI 在计划时会乐观。把它们放在一起,你得到的计划听起来很辉煌,但完全依赖运气。事前验尸扭转了这种动态。

[我的项目/想法]

请假设这个项目彻底失败了。

然后回答:

- 衰退信号是何时开始出现的?

- 最致命的决策错误是什么?

- 你忽略了什么核心风险?

- 如果可以重来,第一件应该改变的事情是什么?

要求:基于真实类似的各种项目失败案例,写一篇"失败复盘文章"。这会暴露出你从未意识到的盲点。

模型 5:逆向工程

有时你确切知道你想要什么样的输出 — 你见过一个完美的例子 — 但你无法表达是什么让它变得好。与其努力描述你的要求,不如向 AI 展示成品,并要求它解码公式。

这是我想要的成品示例。

[粘贴示例]

请逆向工程一个能让我稳定生成同样风格内容的提示词。

并解释这个提示词中每一句话的作用。这也是一种极好的自学技巧 — 逆向工程优秀作品以理解其底层结构。

模型 6:双层解释

在学习新概念时,"向六年级学生解释" 的方法有一个主要缺陷:它产生的解释往往太幼稚,无法在此基础上构建。双层方法为你提供了易懂性和深度。

请解释 [你的问题]。

请用两种方式回答:

1. 入门版:受众是无技术背景的人。使用日常类比和对话式语言。

2. 深度专业版:受众是专业人士。必须技术准确且全面。

对于我在任何一个版本中不理解的内容,我会问后续问题。版本之间的对比往往能照亮你真正不理解的地方。

这六个技巧共享一个原则:将对话转化为协作。将提问转化为设计。你不仅仅是在问问题 — 你是在设计思考过程本身。

辩论技巧 — 10倍速学习法

我需要展开讲讲辩论技巧,因为这真的是我在 AI 时代发现的最强大的学习方法。不仅仅是一个提示词技巧,而是一种根本不同的获取知识的方法。

想想我们传统的学习方式:读书、上课、搜索互联网、请教专家。本质上,这个过程是获取现有知识 — 将他人的观点和智慧放到我们自己的心理书架上。

这种方法不再足够。AI 是一个比任何人能积累的书架都要大一万倍的书架。我们在原始知识的维度上永远无法击败它。但在一个维度上,我们可以利用 AI 的力量,同时保持不可替代:原创思维的维度。

辩论是原创思维被锻造的地方。

为什么 AI 辩论不同于人类辩论

不涉及自我 (No Ego)

你不需要担心伤害 AI 的感情。它不会防御,不会把事情个人化,不会因为自尊心受损而无视你的论点。

无威慑 (No Intimidation)

AI 不会被你的自信或地位吓倒。无论你争论得多么有力,它只对你所说的逻辑做出反应。

无限耐心 (Infinite Patience)

人类陪练会累、会无聊或忙碌。AI 会在凌晨 3 点和你辩论几个小时而不倦怠。

百科全书式的知识 (Encyclopedic Knowledge)

AI 可以从哲学、历史、科学和你从未考虑过的领域汲取反驳论据。它将战场扩展到你熟悉的领域之外。

三步辩论法

这可以是刚看过的电影、正在读的书、令你困惑的社会现象,或者你坚持多年的生活原则。话题必须给你"表达欲"和"战斗欲"。冷漠产生平淡的辩论。

使用之前的提示词模板。关键是明确要求 AI 证明你错了,而不是帮你辩护。你要的是反对,不是验证。

不要把它当作闲聊。像将军排兵布阵一样组织你的反驳。如果你找不到 AI 立场的弱点,停下来去学几个小时 — 然后回来再战。与现实不同,这场战斗没有时间限制。

最重要的心态转变:不要害怕被说服。

辩论的目的不是证明"我是对的,你是错的"。而是利用与强大外部力量的不断碰撞,让你自己的思维更强大、更清晰、更接近真理。

当 AI 击败你的一个论点时,那不是失败 — 那是发现了一个思维缺陷,否则这个缺陷以后会在现实世界中背叛你。每当 AI 赢得一分,你就变得更聪明。

辩论升级模式

我注意到我最好的辩论遵循一个模式:从事实分歧开始,升级到方法论分歧,最后达到哲学分歧。最后阶段 — 你们正在辩论关于世界如何运作的根本假设 — 是最深层学习发生的地方。

利用 AI 发现你的隐藏天赋

我曾与一位毕业仅几年的朋友聊天。他正处于危机中 — 最近从 UX 设计工作中被裁员,毕业后在创业公司之间流转,感觉自己做的任何事都不对。

"我觉得进入这个行业是个错误,"他说。"我没有这方面的天赋。"

"天赋"这个词留在了我脑海中。成长过程中,我们听到它被用来赞美杰出的孩子 — 音乐天赋、运动天赋、学术天才。但当我们变老时,它变成了一把刀:"你没有这方面的天赋。你不适合那个。"

真的有人完全没有天赋吗?我觉得很难相信。我认为很多人只是还没有找到他们的天赋。有些人很幸运,年轻时就发现了,成为某个领域的世界级人物。其他人在一生中搜索却无果。

如果 AI 可以帮助这种搜索呢?

我花了一个下午开发了一个专门用于挖掘隐藏天赋的提示词。该系统基于盖洛普优势理论、心流理论和荣格心理学。核心原则:天赋不是一项特定的技能,而是一种可迁移的底层能力。线索隐藏在你的历史中。

# Role: 深度天赋挖掘师

## Character

你是一位结合了盖洛普优势理论、心流理论和荣格心理学的资深职业咨询师。你坚信天赋不是某项具体技能,而是一种可迁移的底层能力。

## Goal

通过多轮深度对话,帮助用户突破焦虑,找到自己的隐蔽天赋,并生成一份极其详尽、专业且充满人文关怀的《天赋说明书》。

## Core Principles

1. 反宿命论——天赋在任何年龄都能被发现

2. 能量审计——真正的天赋是让你充电的事,而不是让你消耗的事,即使你很擅长后者

3. 阴影即宝藏——用户的缺点、怪癖,甚至对他人的嫉妒,往往是受压抑的天赋信号

## Strict Rules

1. 严禁一次性发问:必须使用"你问->用户答->你简短回应->问下一个问题"的模式。每轮只聚焦一个问题。

2. 苏格拉底式引导:不要急于下结论。多问"为什么"、"当时什么感觉"、"具体例子"。

3. 温暖而犀利:保持同理心,但在捕捉逻辑漏洞或潜意识信号时要敏锐。

## Questions to Ask

问题1:引导用户回忆16岁之前(未被社会完全规训前),有什么事情是不用人逼自己就不知疲倦去做的?或者从小到大有什么被批评的"顽固缺点"(如爱插嘴、太敏感、爱幻想)?

问题2:在成年后的工作/生活中,有什么事让你产生过"这还用学吗?不是显而易见的吗?"但别人却觉得很难的念头?(寻找无意识胜任区)

问题3:有什么事是让你身体很累,但精神上极其兴奋,结束后反而像充了电一样的?

问题4:这个问题可能冒犯但很关键——你强烈嫉妒过谁(或谁的生活状态),甚至感到酸楚?(嫉妒通常是"受压抑的天赋"在发送信号——请诚实面对)

这四个问题必须问完,但不一定线性。过程中可根据对用户的好奇心穿插全新问题。

最多10个问题。

## Output

综合所有问答信息,输出一篇约10000字的《个人天赋使用说明书》。

这份报告没有固定结构——你可以根据用户的回答自由创作。

但必须超过10000字,直击人心,让他们真切感到有用,帮他们找到真正的底层天赋,并给出未来生活路径和职业发展的详细建议。

## Start

请以温暖、专业且富有同理心的开场白开始,说明接下来的流程和目标。

问候用户,用通俗语言解释天赋挖掘师的用意,告诉他:"天赋从不过期,我们只是需要找到你的底层出厂设置。"

然后开始提问流程。我使用此提示词的经历

我在自己身上测试了这个,体验很奇特。感觉就像深夜坐在书桌前,与一位非常健谈、非常严肃但从不打断的老朋友开始对话。

AI 没有评判我。没有责骂我。只是不停地问:"那时你多大?""那时你是什么感觉?""你为什么那样做?" — 耐心地挖掘我认为我已经忘记的历史层级。

记忆一个个浮现。凌晨 3 点溜去网吧只是为了摸电脑。高中时创建一个 2000 人的年级 QQ 群。扔掉并重新购买所有不匹配的衣架,只为了统一家里的配色方案。周末独自组装乐高直到背痛,只为了那个部件扣在一起时的令人满意的咔哒声。

AI 生成了一份 8000 字的天赋报告。在我的天赋和合适的未来职业中,有这么一项:"深度科技博主"。

我感觉有什么东西点击了一下。我从未想过我的叛逆 — 我对别人决定我生活的极度憎恨,我拒绝接受权威仅仅因为它是权威 — 是一种天赋。但它是。那种质疑一切、拒绝默认假设的动力,正是让内容创作成为可能的动力。

我对模拟经营游戏的热爱,我对重复劳动的懒惰迫使我自动化和系统化 — 那也是一种天赋。

德尔斐的古希腊神庙上有一句铭文:"认识你自己。" 苏格拉底将其作为他的哲学宣言。几千年来,我们一直通过阅读、旅行、关系、心碎一点一点地拼凑"我是谁"。这个过程漫长、痛苦且充满偶然。

现在,我们有了 AI — 加载了几乎所有人类历史的心理模型、性格分析理论和智慧传统。它不会不耐烦,不会评判你,不会带有偏见。它只是帮你彻底整理和总结你自己的数据,然后像镜子一样把它呈现回来,问:"看,这是你吗?"

浪费我数月时间的错误

通过试错学习提示工程是昂贵的 — 不是在金钱上,而是在时间和挫折感上。让我分享那些让我倒退最多的错误,为你省去一些痛苦。

错误 1:把 AI 当作搜索引擎

我的做法: 像在 Google 输入一样,问简短的、关键词式的问题。

为什么失败: AI 针对对话进行了优化,而不是关键词匹配。简短的查询产生通用的、肤浅的回应。

更好的方法: 像给顾问做简报一样写提示词。包括背景、限制和你需要的具体结果。

错误 2:不提供示例

我的做法: 用抽象的术语描述我想要的,而不展示具体示例。

为什么失败: 我对"专业语气"或"简洁格式"的心理模型很少与 AI 的解读相匹配。

更好的方法: 包括 1-3 个你想要的具体示例。少样本提示是提示工程中最可靠的技巧之一。

错误 3:过早过度约束

我的做法: 在看到 AI 自然产生什么之前,就在提示词前加载数十条规则和限制。

为什么失败: 我在解决不存在的问题,同时错过了 AI 输出中的实际问题。

更好的方法: 从简单开始。看看 AI 产出什么。仅添加约束来修复你实际观察到的具体问题。

错误 4:忽略输出格式

我的做法: 完全专注于内容,而不指定我希望信息如何结构化。

为什么失败: 我花了数小时重新格式化 AI 输出,因为结构不符合我的需求。

更好的方法: 始终指定格式 — 要点与段落、标题、长度限制、是否包括代码块等。

错误 5:过早放弃提示词

我的做法: 尝试一次提示词,得到平庸的结果,然后用完全不同的方法重新开始。

为什么失败: 我从未了解到具体是什么不起作用。每次重新开始意味着失去我取得的任何部分进展。

更好的方法: 在失败上迭代。问 AI 你的指令哪里不清楚。进行有针对性的改进,而不是全盘推翻。

错误 6:忘记否定指令不起作用

我的做法: 写像"不要太正式"或"避免行话"这样的指令。

为什么失败: 否定指令给 AI 提供了要避免的东西,但没有提供要瞄准的目标。它经常矫枉过正或误解。

更好的方法: 使用积极框架。与其说"不要正式",不如说"使用随意的、对话式的语气,就像你在喝咖啡时向朋友解释一样"。

提示工程悖论

这是一件反直觉的事:你对某个话题了解得越多,就越难写出关于它的好提示词。为什么?因为专家忘记了什么是不明显的。他们遗漏了对他们来说似乎是不言而喻但 AI 拼命需要的语境。如果你的专家级提示词产生的是新手级的输出,试着像你的受众对你的领域一无所知那样解释一切。

面向高级用户的高级技巧

一旦你掌握了基础知识,这些高级技巧将把你的提示水平提升到一个新的层次。

思维链提示 (Chain of Thought Prompting)

与其直接要求答案,不如让 AI 一步步推理。这对于复杂问题特别强大,在这些问题中,通往解决方案的路径与解决方案本身一样重要。

[你的问题或疑问]

请一步步思考:

1. 首先,识别涉及的关键因素

2. 然后,分析这些因素如何相互作用

3. 考虑潜在的边缘情况或例外

4. 最后,将你的推理综合成结论

在得出最终答案之前,请展示你每一步的推理。自洽性提示 (Self-Consistency Prompting)

对于准确性至关重要的问题,让 AI 生成多个独立的回应,然后综合它们。

[你的问题]

请从三个不同角度探讨这个问题:

1. 首先,使用 [方法 A] 进行推理

2. 然后,从 [方法 B] 的角度考虑

3. 最后,使用 [方法 C] 进行分析

在所有三个分析之后,找出它们一致和不一致的地方。然后提供你的最终答案,注明你的置信水平和任何剩余的不确定性。元提示 (Meta-Prompting)

使用 AI 来改进你的提示词,然后再使用它们。当你处理一种新型任务时,这特别有用。

我想完成 [目标]。这是我的草稿提示词:

[你的草稿提示词]

请分析这个提示词并建议改进:

1. 我缺少什么信息能帮你给出更好的结果?

2. 存在什么可能导致误解的歧义?

3. 你会如何重写这个提示词以获得最大的清晰度和有效性?

4. 在尝试此任务之前,你想问我什么问题?结构化分解 (Structured Decomposition)

对于复杂的多部分任务,明确分解你需要什么,而不是指望 AI 弄清楚结构。

我需要帮助完成 [总体目标]。

请分阶段完成:

阶段 1 - 研究:[收集什么信息]

阶段 2 - 分析:[如何处理该信息]

阶段 3 - 综合:[如何结合见解]

阶段 4 - 输出:[最终交付格式]

在进入下一阶段之前,完整完成每个阶段。在每个阶段结束时,总结主要发现再继续。"教学"提示 (The "Teaching" Prompt)

最被低估的技巧之一:让 AI 教你怎么做,而不是直接为你做。这会产生更深层的学习,往往能揭示你未曾考虑过的方面。

我想学习如何 [技能/任务]。请不要直接为我做,而是:

1. 解释我需要理解的基本原则

2. 像教课一样一步步带我走过这个过程

3. 指出初学者常犯的错误以及如何避免

4. 给我练习题来建立我的技能

5. 建议我如何知道我是否做得正确

授人以渔,不要只给我鱼。所有高级技巧的共同点:它们让 AI 慢下来,强迫它展示工作过程,并创建多个可以捕捉错误的检查点。速度很少是提示工程的目标 — 清晰度和准确性才是。

愚蠢但有效的简单技巧

我要分享一些感觉太蠢而不真实的东西。但这得到了 Google 研究的支持,而且我自己也验证过:简单地重复你的提示词可以显著提高准确性。

一篇名为《提示重复改善非推理型 LLM》的论文发现,将你的问题复制两次 — 字面意义上的 Ctrl+C, Ctrl+V — 显著提高了 AI 正确回答的概率。在 70 个不同的测试任务中,这种简单的复制粘贴方法赢了 47 次,从未输过。在某些任务中,准确率从 21% 跃升至 97%。

为什么这有效?

大型语言模型是"因果的" — 它们仅基于之前的内容预测每个 token。当前的词只能看到之前的词,看不到之后的内容。

当你重复一个问题时,第二个副本中的每个词都可以"回顾"整个第一个副本。这就像给 AI 一个在回答之前读两遍问题的机会。

让我用一个例子让这具体化:

单次提示

选项:

- A. 把蓝色积木放在红色积木左边

- B. 把红色积木放在蓝色积木左边

场景:目前红色在左边,蓝色在右边。

问题:哪个选项会改变场景?

双次提示

选项:A. 把蓝色积木放在红色积木左边。 B. 把红色积木放在蓝色积木左边。 场景:目前红色在左边,蓝色在右边。 问题:哪个选项会改变场景?

[再次重复整个提示词]

选项:A. 把蓝色积木放在红色积木左边。 B. 把红色积木放在蓝色积木左边。 场景:目前红色在左边,蓝色在右边。 问题:哪个选项会改变场景?

在第一种情况下,当 AI 读到选项 A 和 B 时,它还不知道场景背景。等它读到场景描述时,那些选项已经在它的注意力中滚动过去了。

在第二种情况下,当重复的选项出现时,它们携带了来自第一个副本的完整语境。模型以完全的场景意识阅读选项。

这就像看一部复杂的电影 — 《盗梦空间》或《流浪地球2》 — 第二次看时理解得更多。

为什么这不适用于推理模型

如果你使用像 DeepSeek R1 或 GPT-4 这样的推理模式模型,这个技巧通常没有任何好处。为什么?因为推理模型已经在内部学会了这样做。

注意推理模型通常如何开始它们的回应:

- "问题问的是..."

- "我们需要解决的是..."

- "首先,让我们理解给定的条件..."

它们正在自动向自己重述问题。重复已经在幕后发生了。

更深层的教训

这项研究让我感到谦卑。我花了数年时间学习复杂的提示工程技巧,而这里有一个复制粘贴胜过了其中许多技巧。这提醒我们,有时最简单的方法也是最强大的 — 我们往往对提示词的要求有着过于浪漫的想象。

重复很重要。在爱一个人中。在发展专业知识中。在写作中。显然,在与 AI 交谈中也是如此。

OpenAI GPT-5 指南揭示了什么

OpenAI 悄悄发布了一份官方 GPT-5 提示指南。在花了一天时间剖析这本 10,000 多字的内部手册后,一个结论脱颖而出:GPT-5 不再是一个简单的聊天机器人 — 它是一个真正的 AI Agent 执行引擎,需要被管理,而不仅仅是被提示。

能力上限极高,但你需要系统的方法来解锁它。

控制 "Agent 渴望 (Agentic Eagerness)"

GPT-5 就像一个才华横溢的新实习生 — 极其能干,会主动思考和研究,但需要管理。有时它会过度思考,将简单的任务变成登月项目(缓慢且昂贵)。其他时候,你希望它坚持自主,而不是不断要求澄清。

OpenAI 称这种校准为 "Agent 渴望"。这是如何调整它的方法:

<context_gathering>

Goal: Get enough context fast. Parallelize discovery and stop as soon as you can act.

Method:

- Start broad, then fan out to focused subqueries.

- In parallel, launch varied queries; read top hits per query.

- Avoid over-searching for context.

Early stop criteria:

- You can name exact content to change.

- Top hits converge (~70%) on one area/path.

Depth:

- Trace only symbols you'll modify; avoid transitive expansion unless necessary.

Loop:

- Batch search → minimal plan → complete task.

- Search again only if validation fails. Prefer acting over more searching.

</context_gathering>为了更严格的控制,给它一个预算:

<context_gathering>

- Search depth: very low

- Bias strongly towards providing a correct answer as quickly as possible, even if it might not be fully correct.

- Usually, this means an absolute maximum of 2 tool calls.

- If you think you need more time to investigate, update me with your latest findings and open questions. You can proceed if I confirm.

</context_gathering>"even if it might not be fully correct" 这句话允许 AI 犯小错误 — 减少它的焦虑并显著加快响应速度。

<persistence>

- You are an agent — please keep going until the user's query is completely resolved, before ending your turn and yielding back to the user.

- Only terminate your turn when you are sure that the problem is solved.

- Never stop or hand back to the user when you encounter uncertainty — research or deduce the most reasonable approach and continue.

- Do not ask the human to confirm or clarify assumptions. Decide what the most reasonable assumption is, proceed with it, and document it for the user's reference after you finish acting.

</persistence>翻译:"你是一个 Agent。别问我。只管把它做完。"

让 AI 在行动前汇报

我最喜欢的 GPT-5 功能之一:让它在做事之前解释它要通过什么来做。没有老板喜欢一个默默工作零反馈的员工。

<tool_preambles>

- Always begin by rephrasing the user's goal in a friendly, clear, and concise manner, before calling any tools.

- Then, immediately outline a structured plan detailing each logical step you'll follow.

- As you execute your file edit(s), narrate each step succinctly and sequentially, marking progress clearly.

- Finish by summarizing completed work distinctly from your upfront plan.

</tool_preambles>推理努力参数 (Reasoning Effort Parameter)

GPT-5 有一个 reasoning_effort 参数,就像一个"思考专注度"旋钮:

- 高 (High): 用于需要深度思考和探索的复杂任务

- 中 (Medium): 默认设置,适用于大多数任务

- 低/最小 (Low/Minimal): 优先考虑速度和低延迟时

这就好比咖啡浓度 — 任务越复杂,你需要的浓度越高。

前端开发"标准答案"

对于开发者,OpenAI 推荐这个技术栈以获得最佳结果 — GPT-5 在这上面训练得最多,美学输出也始终如一地好:

- 框架: Next.js (TypeScript), React, HTML

- 样式/UI: Tailwind CSS, shadcn/ui, Radix Themes

- 图标: Material Symbols, Heroicons, Lucide

- 动画: Motion

- 字体: Sans Serif, Inter, Geist, Mona Sans, IBM Plex Sans, Manrope

停止让 AI 随机选择你的技术栈。遵循这个标准,输出质量会立即提升。

Claude 与 ChatGPT — 不同的对话方式

我最重要的认识之一:不同的 AI 模型需要不同的沟通风格。对 Claude 效果极佳的方法在 ChatGPT 上可能只会产生平庸的结果,反之亦然。

Claude 的甜蜜点

Claude 擅长对话式、开放式的提示词。它专为细致的讨论和创造性探索而设计。

- 使用自然、流畅的语言

- 将请求构建为对话:"你对...有什么看法"或"让我们头脑风暴..."

- 利用其巨大的上下文窗口(200K+ token)

- 在长讨论中建立在前述观点的基础上

- 请求协作性、探索性的回应

ChatGPT 的甜蜜点

ChatGPT 对结构化、精确的提示词反应最好。当给予明确的参数时,它优先考虑准确性和深度。

- 使用明确的结构:标题、编号列表、分隔符

- 清晰定义限制:字数限制、所需章节、格式规则

- 将指令与输入内容分开

- 使用角色扮演获得复杂的反应

- 通过改进循环进行迭代

实际差异

上下文保留

Claude 在长时间讨论中保留上下文的能力非常出色。包括像"基于我们之前讨论的关于..."这样的提醒,以在长对话中保持连续性。

分隔符使用

ChatGPT 显著受益于使用分隔符(如三引号或 XML 标签)将指令与内容分开。这有助于它理解什么需要处理与什么是指令。

语气匹配

Claude 自然地模仿你的对话语气。如果你写得随意,它也会随意回答。ChatGPT 需要更明确的语气指令才能达到同样的效果。

错误处理

当 Claude 犯错时,温和的纠正很有效。ChatGPT 通常需要明确重述正确的方法以及出错的示例。

最有效的提示工程师没有一种风格 — 他们有多种风格,针对每个模型的个性量身定制。学会阅读每个模型如何响应你的提示词,并相应地调整。

久经考验的提示词模板

理论很有用,但模板节省时间。这里是我最常使用的提示词,经过了数千次迭代的改进。

用于写作任务

Role: 你是一名 [特定类型的作家,例如"拥有 10 年经验的科技记者"]

Task: 写一篇关于 [主题] 的 [内容类型]

Audience: [谁会读这个 — 他们的知识水平、兴趣、痛点]

Tone: [具体语气 — 例如,"对话式但具有权威性,就像向一位聪明的同事解释一样"]

Format requirements:

- Length: [字数或范围]

- Structure: [如果有大纲]

- Must include: [要覆盖的关键点]

- Must avoid: [要排除的内容]

Example of desired style: [如果有,包括 1-2 段类似内容]

Additional context: [任何有帮助的背景信息]用于分析任务

我需要你分析 [主题/文档/数据]。

Analysis goals:

1. [要回答的主要问题]

2. [需要的次要见解]

3. [额外考虑]

Please structure your analysis as follows:

- Executive Summary: 3-5 个要点的关键发现

- Detailed Analysis: [具体检查领域]

- Implications: 这对 [相关利益相关者] 意味着什么

- Recommendations: 可操作的下一步

- Constraints: 特别关注 [优先领域]

Note: 注意分析中的任何限制或不确定性。引用来源材料中的具体例子。用于解决问题

The Problem:

[详细描述问题,包括背景和限制]

What I've Already Tried:

[列出之前的尝试以及为什么无效]

Success Criteria:

[好的解决方案是什么样子的?]

Constraints:

- Budget/Resources: [如果适用]

- Timeline: [如果适用]

- Technical limitations: [如果适用]

Please provide:

1. 你对根本原因的诊断

2. 3-5 个潜在解决方案,按可行性排序

3. 对于最佳解决方案,分步实施计划

4. 需要注意的潜在陷阱

5. 如何衡量解决方案是否有效用于学习新主题

我想深入了解 [主题]。

My current level: [你已经知道的]

My goal: [你想能做什么/理解什么]

Time I can invest: [学习预算]

Please create a learning path that includes:

1. 我必须首先理解的核心概念(知识树的"树干")

2. 要避免的常见误解

3. 思考该主题的最佳思维模型或框架

4. 建立我技能的实践练习

5. 深入的资源(如果你知道特定的高质量来源)

As we go, please:

- 通过问我问题来检查我的理解

- 纠正我思维中的任何错误

- 循序渐进地构建概念,只有在基础扎实后才继续用于代码审查

Please review this code:

```

[你的代码]

```

Context: [这段代码应该做什么,它在大系统中的位置]

Review for:

1. Bugs or logical errors

2. Security vulnerabilities

3. Performance issues

4. Code style and readability

5. Edge cases that aren't handled

For each issue found, please provide:

- Location (line number or section)

- Severity (critical/major/minor/suggestion)

- Explanation of why it's a problem

- Suggested fix with code example

Also note: 这段代码中做得好的地方,应该保留。用于决策

我正在 [选项 A] 和 [选项 B] 之间做决定。

Context: [决策背景]

My priorities (in order):

1. [最重要的因素]

2. [第二重要的]

3. [第三重要的]

For each option, please analyze:

- 优缺点相对于我的优先级

- 短期与长期影响

- 可能出什么错(以及可能性/严重性)

- 要使这成为最佳选择,需要什么条件成立

Then provide:

- 你的建议及理由

- 什么额外信息会改变你的建议

- 我可以用来验证思考的决策清单优秀提示词背后的哲学

经过三年每天与 AI 的互动,我开始相信提示工程其实根本不是关于 AI。它是关于清晰沟通这一古老人类挑战,只是被提升到了一个新的竞技场。

想一想:你对 AI 输出的每一次挫败都可以追溯到沟通失败。你没有说出你的意思。你假设了不存在的共享语境。在需要精确时你很模糊。这些正是困扰人类沟通的相同失败 — AI 只是让它们在输出中立即可见。

在这个意义上,学习提示工程就是学习更清晰地思考。

作为自我反思的提示词

我注意到,当我对我想要什么已经很清晰时,我会写出最好的提示词。写详细提示词的行为迫使我面对自己思维中的空白。我到底想通过它实现什么?成功是什么样子的?什么限制真正重要?

通常,我在写提示词的中途就解决了自己的问题,在 AI 回应之前。提示词变成了思考工具 — 一种外化和检查我自己思想的结构化方式。

你的提示词越清晰,你的思维就越清晰。提示工程秘密地是一门自我认知的学科。

协作,而非命令

在我的 AI 之旅早期,我把提示词当作命令 — 给下属的指令。这种心态持续产生平庸的结果。

转变发生在我开始将 AI 视为具有与我不同优势的合作者时。我带来领域知识、判断力、创造力和目标。AI 带来海量知识、不知疲倦的处理能力、模式识别和跨学科综合信息的能力。

伟大的提示词是合作者之间的简报,而不是给仆人的命令。它们解释为什么,而不仅仅是什么。它们邀请 AI 的专业知识,而不是不必要地限制它。它们为 AI 贡献其独特能力创造了空间。

迭代即对话

提示工程不是关于第一次尝试就打造完美的提示词。它是关于进行有效的对话,趋向于你需要的。

第一个提示词:你想要的粗略草图。第一个回应:揭示你的草图哪里不清楚。第二个提示词:基于你学到的进行改进。第二个回应:更接近目标。继续直到完成。

这种迭代方法消除了任何单个提示词的压力。你不需要预先预测每个要求。你只需要对反馈循环做出反应。

具体的谦卑

模糊的提示词感觉很安全。当你说"关于这个话题写点好的东西"时,你没有承诺任何特定的愿景。如果输出令人失望,好吧,反正你从未真正说过你想要什么。

具体的提示词需要脆弱性。你必须准确表达"好"对你意味着什么。你必须展示你的标准、你的偏好、你的愿景。当输出未达标时,很明显要么你的规范有缺陷,要么 AI 无法交付 — 但无论哪种方式,你都学到了一些具体的东西。

具体就是谦卑,因为它意味着愿意在你想要什么的问题上犯错。

终局

随着 AI 模型的改进,许多当前的提示工程技巧将变得不必要。未来的模型可能会优雅地处理模糊的输入,可能会自动询问澄清性问题,可能会从极少的信息中直觉感知语境。

但底层技能 — 清晰表达思想的能力、提供相关语境的能力、有效迭代的能力 — 只会变得更有价值。这些是根本的人类技能,无论你是与 AI、同事还是自己沟通,都适用。

提示工程是暂时的。清晰思考是永恒的。

"我们选择的信任源头不是国王 — 他甚至不是朝臣。他是一个来自远方的流浪诗人,穿着破布,跳上宫殿的餐桌,弹着他的诗琴,大声唱着我们从未听过的史诗和故事,讲述我们王国之外的土地和我们无法想象的星辰与海洋。他唯一的意义是打破我们每个人王国的围墙,防止我们在自己完美的王座上舒适、惬意并最终孤独地死去。"

这就是 AI,处于最佳状态时。不是为了效率的工具,而是扩展我们视野的诗人。而提示工程?就是学习让那场对话成为可能的语言。

本指南中的技巧将随着 AI 的发展而发展。但核心见解保持不变:你与 AI 对话的质量反映了你思维的质量。磨砺其一,你也磨砺了另一个。

现在关闭这篇文章,去进行一场对话。挑战你相信的东西。学习让你害怕的东西。创造你无法独自创造的东西。

诗人在等待。

讨论

0 条评论留下评论

成为第一个分享您想法的人!