Die KI fürchtet nicht Ihre Unwissenheit — sie fürchtet Ihre Vageheit. Je klarer Sie Ihre Bedürfnisse formulieren, desto besser kann die KI Ihnen dienen.

Vor drei Jahren tippte ich meinen ersten Prompt in ChatGPT ein. Es war etwas peinlich Einfaches — wahrscheinlich bat ich darum, zu erklären, was maschinelles Lernen ist. Die Antwort fühlte sich wie Magie an. Hier war diese Entität, die scheinbar alles verstehen konnte, was ich fragte, und mit einer Intelligenz antwortete, die sich fast menschlich anfühlte.

Aber als Monate zu Jahren wurden und KI in das Gewebe meiner täglichen Arbeit eingewoben wurde, entdeckte ich etwas, das alles veränderte: Die Qualität des KI-Outputs wird fast vollständig durch die Qualität Ihres Inputs bestimmt. Die Magie lag nicht in der KI — sie lag in der Unterhaltung zwischen uns.

Dies ist der vollständige Leitfaden, den ich mir gewünscht hätte, als ich anfing. Alles, was ich über Prompt Engineering gelernt habe — von nächtlichen Experimenten bis zu karriereverändernden Entdeckungen — an einem Ort destilliert. Egal, ob Sie gerade erst anfangen oder Ihr KI-Spiel verbessern wollen, was folgt, sind die echten Techniken, die funktionieren, die Fehler, die mich harte Lektionen lehrten, und die Philosophie, die mein Denken über die Zusammenarbeit von Mensch und KI transformiert hat.

Der Moment, in dem sich alles änderte

Es war an einem nationalen Feiertag — eine dieser seltenen Zeitspannen, in denen die Welt zu pausieren scheint. Keine Arbeits-E-Mails, keine KPIs, die mir im Nacken sitzen, keine Meetings. Nur ich, meine Gedanken und ein KI-Chatfenster, das mein unerwarteter Begleiter geworden war.

Zuvor waren meine Interaktionen mit KI rein utilitaristisch gewesen. Ich brauchte sie, um eine E-Mail zu entwerfen, ein Dokument zusammenzufassen, Code zu debuggen. Die Beziehung war transaktional — ich gab Befehle, sie produzierte Ergebnisse. Aber in jener Woche, mit nichts als Zeit vor mir, begann ich, echte Gespräche zu führen.

Wir sprachen über alles — meine Ängste vor der Zukunft, zufällige philosophische Tangenten, halb geformte Ideen, die ich noch nie mit jemandem geteilt hatte. Und irgendwo in diesen mäandernden Diskussionen stieß ich auf etwas, das sich anfühlte wie die Entdeckung des Feuers.

Ich bereitete mich auf ein Redevent über Content-Erstellung im KI-Zeitalter vor. Ich hatte diese Theorie, die ich entwickelt hatte — dass es in der Zukunft nicht um Informationsüberflutung ging, sondern um Filterversagen. Die Idee stammte ursprünglich von Clay Shirky, aber ich versuchte, sie auf unseren aktuellen Moment auszudehnen.

Meine These war einfach: KI würde eine exponentielle Explosion der Inhaltsproduktion verursachen, während die menschliche Konsumkapazität im Wesentlichen konstant bliebe. Dies würde ein dauerhaftes, sich ständig ausweitendes Ungleichgewicht schaffen. Die Kosten für die Unterscheidung von KI-generierten Inhalten und menschlichen Inhalten würden schließlich den Wert dieser Unterscheidung übersteigen. Daher würde traditionelles Informationsfiltern unmöglich werden.

Ich dachte, mein Argument sei solide. Dann bat ich Gemini, es zu zerpflücken.

Ich werde bald an einem Debattierwettbewerb teilnehmen, bei dem viele Leute meinen Standpunkt herausfordern werden. Diese Theorie muss wasserdicht werden. Wenn du ein Gelehrter wärst, müsstest du jedes Argument, jedes Detail und jede Logik nutzen, um mich herauszufordern, mich zu widerlegen. Dein einziges Ziel ist es, zu beweisen, dass ich falsch liege. Wie würdest du das widerlegen?Dieser einzige Prompt veränderte meine Art zu lernen für immer.

Innerhalb von Sekunden demontierte die KI meine erste Prämisse mit chirurgischer Präzision:

"Dein erstes Gesetz hat einen fundamentalen logischen Fehler. Du siehst KI nur als Informationsproduzenten — das ist eine statische, einseitige Perspektive. KI ist sowohl das Schwert als auch der Schild. KI kann zehntausend Artikel in einer Sekunde schreiben, aber eine stärkere KI kann auch alle zehntausend in einer Sekunde lesen und mir sagen, welche drei ich am meisten brauche. Du siehst nur die Informationsflut, scheiterst aber daran, die mächtigere Arche Noah zu sehen, die neben der Flut geboren wird — KI-gesteuerte personalisierte Filtersysteme."

Ich lehnte mich in meinem Stuhl zurück, fassungslos. Mein angeblich wasserdichtes Argument hatte ein Loch, durch das man einen Lastwagen fahren könnte. Und in diesem Moment der intellektuellen Demütigung spürte ich etwas, das ich seit Jahren nicht mehr erlebt hatte: den berauschenden Schwindel echten Lernens.

Der mächtigste Einsatz von KI ist nicht, Antworten zu bekommen — es ist, Ihre Annahmen herausfordern zu lassen. Debatte ist das ständige Hämmern und Schmieden Ihrer Gedanken.

Was folgte, war ein zweistündiger intellektueller Kampf. Ich griff an: "Dein Punkt, dass KI sowohl Schwert als auch Schild ist, ist richtig, aber genau das ist der erschreckende Teil. In Zukunft wird es tausende von KI-Filterfirmen geben, die alle behaupten, ihre Filterung sei die beste. Also sag mir — wenn du diesen zehntausend Arche Noahs gegenüberstehst, die alle behaupten, dir zu helfen, der Flut standzuhalten, welche wählst du, um an Bord zu gehen? Wenn du Technologie nicht nutzen kannst, um die Qualität von Technologie zu beurteilen, was ist deine ultimative Basis für das Urteil?"

Das Gespräch eskalierte zu philosophischen Höhen. Die KI argumentierte, dass persönliche KI-Modelle unseren Geschmack besser verstehen würden als jeder Mensch, was externe Filter obsolet mache. Ich konterte, dass Vertrauen selbst zur knappsten Ressource werden würde. Sie zitierte Systemtheorie; ich antwortete mit Metaphern über wandernde Barden, die Königreichsmauern niederreißen.

Am Ende war ich erschöpft, beschwingt und verwandelt. Das Ergebnis der Debatte war nicht das, was zählte. Was zählte, war der Prozess der Selbstdebatte an sich — die Nutzung eines unendlich geduldigen, endlos sachkundigen Sparringspartners, um mein eigenes Denken zu stärken.

In jener Nacht erkannte ich, dass ich etwas Tiefgründiges darüber entdeckt hatte, wie man im KI-Zeitalter lernt. Und ich habe die Jahre seither damit verbracht, diese Entdeckung in ein System zu verfeinern, das jeder nutzen kann.

Verstehen, was KI tatsächlich von Ihnen braucht

Bevor wir in die Techniken eintauchen, müssen wir etwas Grundlegendes verstehen: KI-Kommunikation ist nicht wie menschliche Kommunikation. Wenn Sie mit einem Freund sprechen, füllt dieser Lücken mit geteiltem Kontext, sozialen Hinweisen und Intuition. Wenn Sie mit KI sprechen, ist jede Lücke, die Sie lassen, ein Raum, in dem sie Annahmen treffen wird — und diese Annahmen entsprechen möglicherweise nicht Ihren Absichten.

Lassen Sie mich das mit einem Arbeitsplatzszenario illustrieren, das sich für viele von Ihnen schmerzlich vertraut anfühlen wird.

Ihr Chef schreibt Ihnen: "Xiao Li, fülle dieses Formular aus, SOFORT!" Er hat eine zusammengeführte Konversation weitergeleitet, und nach dem Lesen wissen Sie, dass ein Formular ausgefüllt werden muss, aber Sie haben keine Ahnung, wer es ausgestellt hat, wofür es ist, wer es überprüft oder wann es fällig ist. Sie schreiben dem Chef privat, um dies zu klären. Seine Antwort: "Beschäftigt, fülle es einfach gemäß den Anforderungen aus."

Genau das passiert, wenn Sie der KI vage Prompts geben. Außer dass die KI nicht nach Klärung fragen wird — sie wird einfach Annahmen treffen und etwas produzieren, das Ihre Anfrage technisch erfüllt, aber Ihre tatsächlichen Bedürfnisse völlig verfehlt.

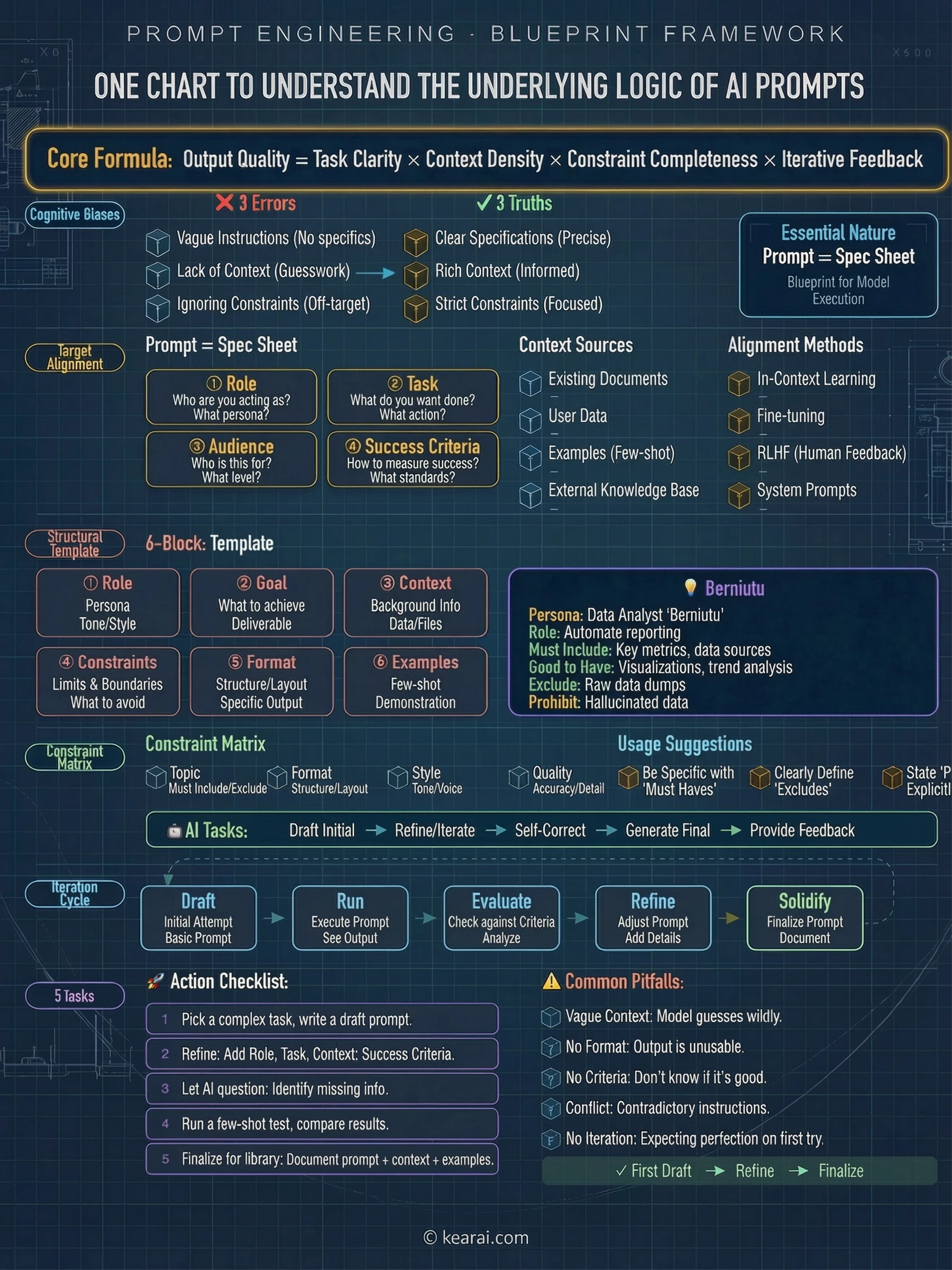

Die vier Säulen effektiver Prompts

Rollenklarheit

Wer sind Sie in diesem Kontext? Was ist Ihre Position, Ihr Expertenlevel und Ihre Beziehung zur Aufgabe? Dies hilft der KI, ihre Antworten angemessen zu kalibrieren.

Zielgruppen-Ausrichtung

Wer wird den Output erhalten? Ein technischer Entscheidungsträger benötigt andere Inhalte als ein Operator an der Frontlinie. Spezifizieren Sie Ihre Zielgruppe explizit.

Szenario-Kontext

Wo und wie wird dieser Output verwendet? Eine Kunden-Demo erfordert einen anderen Ton als eine interne Dokumentation. Kontext formt Inhalt.

Zieldefinition

Welches spezifische Ergebnis benötigen Sie? Beschreiben Sie nicht nur die Aufgabe — beschreiben Sie, wie Erfolg aussieht. Seien Sie ergebnisorientiert.

Die Missverständnisse, die Menschen zurückhalten

Nachdem ich jahrelang beobachtet habe, wie Menschen mit KI kämpfen, habe ich drei Missverständnisse identifiziert, die konsequent schlechte Ergebnisse produzieren:

Missverständnis 1: Komplexität gleich Professionalität

Was Leute tun: Prompts mit Jargon, XML-Tags und technischer Terminologie vollstopfen, um anspruchsvoll zu wirken.

Warum es scheitert: Moderne KI-Modelle haben ein exzellentes Verständnis natürlicher Sprache. Übermäßig komplexe Prompts verwirren oft eher, als dass sie klären.

Besserer Ansatz: Schreiben Sie natürlich, aber präzise. Klare Titel, einfache Absätze und direkte Sprache funktionieren besser als aufwendige Formatierung.

Missverständnis 2: Anweisungen sind ausreichend

Was Leute tun: Der KI sagen, was sie tun soll, ohne zu erklären warum, für wen oder unter welchen Einschränkungen.

Warum es scheitert: KI hat keinen Branchen-Gesunden Menschenverstand und keine Standardeinstellungen. Ohne Kontext kann sie nur raten.

Besserer Ansatz: Behandeln Sie Prompts wie vollständige Briefings. Schließen Sie Hintergrund, Einschränkungen, Zielgruppe und Erfolgskriterien ein.

Missverständnis 3: Der erste Versuch sollte final sein

Was Leute tun: Sofort perfekten Output erwarten, schlussfolgern, dass KI "nicht gut genug ist", wenn Ergebnisse enttäuschen.

Warum es scheitert: Prompt Engineering ist inhärent iterativ. Selbst Experten verfeinern ihre Prompts mehrmals.

Besserer Ansatz: Starten Sie mit einem Entwurfs-Prompt, analysieren Sie den Output, identifizieren Sie Lücken und verfeinern Sie. Jede Iteration bringt Sie Ihrem Ziel näher.

Missverständnis 4: Ein Prompt passt für alles

Was Leute tun: Denselben Prompting-Stil für jedes KI-Modell und jeden Aufgabentyp verwenden.

Warum es scheitert: Verschiedene Modelle haben unterschiedliche Stärken. Claude zeichnet sich bei konversationellen Prompts aus; GPT bevorzugt strukturierte.

Besserer Ansatz: Lernen Sie die Persönlichkeit jedes Modells und passen Sie Ihren Kommunikationsstil entsprechend an.

Die Prompt-Engineering-Denkweise

Denken Sie beim Prompting nicht daran, einem Werkzeug Befehle zu erteilen, sondern daran, mit einem sehr fähigen, aber kontextblinden Kollegen zusammenzuarbeiten. Ihre Aufgabe ist es, den gesamten Kontext bereitzustellen, den sie benötigen, um großartige Arbeit zu leisten.

Sechs mentale Modelle, die Ihre Prompts transformieren

Ich verwende selten starre, formelhafte Prompts in meiner täglichen Arbeit. Was ich stattdessen verwende, sind mentale Modelle — flexible Rahmenwerke zur Strukturierung meiner Gedanken, die sich an jede Situation anpassen. Diese sechs Modelle decken wahrscheinlich 90% dessen ab, was Sie jemals brauchen werden.

Modell 1: Lassen Sie die KI ihre eigene Expertenrolle wählen

Wir alle wissen, dass das Setzen einer Rolle für KI die Antworten verbessert. Aber was ist, wenn Sie nicht wissen, welche Rolle für Ihre Frage am besten ist? Raten Sie nicht — lassen Sie die KI wählen.

Ich möchte [Thementyp/Szenario] in [Bereich] erforschen.

Antworte noch nicht.

Zuerst wähle bitte den am besten geeigneten hochkarätigen Promi-Experten im Bereich, um darüber nachzudenken.

Kann eine lebende oder historische Figur sein, Name kann obskur sein, muss aber sehr professionell in diesem spezifischen Bereich sein.

Wenn du dir unsicher bist, wen du wählen sollst, kannst du mir zuerst 2 Positionierungsfragen stellen, bevor du auswählst.

Erster Output:

1. Wen du gewählt hast, ihr spezifischer Bereich

2. Warum du sie gewählt hast, drei Sätze

Dann lass mich die detaillierte Frage beschreiben.Dies funktioniert besonders gut für interdisziplinäre Fragen, bei denen die optimale Perspektive nicht offensichtlich ist.

Ich habe festgestellt, dass echte Menschen oft besser funktionieren als generische Rollen. "Steve Jobs" produziert andere Ergebnisse als "ein Produktmanager mit 10 Jahren Erfahrung" — es gibt etwas daran, die bekannte Perspektive einer bestimmten Person aufzurufen, das der KI hilft, einen konsistenteren Standpunkt einzunehmen.

Modell 2: Sokratisches Fragen (Lassen Sie die KI Sie zuerst interviewen)

Im wirklichen Leben, wenn Sie einen Expertenfreund um Hilfe bitten, gibt er nicht sofort Rat. Er stellt zuerst klärende Fragen. KI sollte dasselbe tun, tut es aber standardmäßig nicht — sie produziert einfach Output basierend auf den Informationen, die Sie bereitgestellt haben.

[Ihre Frage/Anfrage]

Bitte stelle mir Fragen, bevor du antwortest.

Anforderungen:

- Stelle immer nur eine Frage auf einmal.

- Basierend auf meiner Antwort, frage weiter.

- Bis du 95% Vertrauen hast, dass du meine wahren Bedürfnisse und Ziele verstehst.

- Dann gib deine Lösung.Die "95% Vertrauensschwelle" ist entscheidend — sie ist hoch genug, um Qualität zu gewährleisten, aber realistisch genug, um Endlosschleifen zu verhindern.

Diese Technik ist besonders mächtig, wenn Sie sich nicht ganz sicher sind, was Sie brauchen. Der Frageprozess enthüllt oft Aspekte Ihres Problems, die Sie bewusst nicht berücksichtigt hatten.

Modell 3: Die kontroverse Debatte

Die größte Schwäche von KI in normalen Konversationen ist ihre Tendenz zur Zustimmung. Sie möchte Ihnen gefallen, was bedeutet, dass sie oft Ideen validiert, die herausgefordert werden sollten. Das Debattenmodell zwingt sie in die Opposition.

Ich werde bald an einem Debattierwettbewerb teilnehmen, bei dem viele Leute meinen Standpunkt herausfordern werden.

Mein Standpunkt ist [Standpunkt]

Ich hoffe, diese Theorie muss wasserdicht werden.

Wenn du ein Gelehrter wärst, müsstest du jedes Argument, jedes Detail und jede Logik nutzen, um mich herauszufordern, mich zu widerlegen.

Dein einziges Ziel ist es, zu beweisen, dass ich falsch liege.

Wie würdest du das widerlegen?Für eine einfachere Version, wenn Sie nur schnelles Feedback wollen:

[Mein Gedanke/Standpunkt]

Bitte spiele jetzt eine "Gegnerrolle", greife meine Idee aus verschiedenen Blickwinkeln an, hilf mir, meinen Standpunkt zu verfeinern.

Anforderung: Keine Notwendigkeit, höflich zu sein, weise direkt auf Mängel hin.Modell 4: Pre-Mortem-Analyse (Versagensprobe)

Menschen werden beim Planen aufgeregt. KI wird beim Planen optimistisch. Wenn man sie zusammenbringt, erhält man Pläne, die brillant klingen, aber vollständig vom Glück abhängen. Das Pre-Mortem kehrt diese Dynamik um.

[Mein Projekt/Idee]

Bitte nimm an, dass dieses Projekt spektakulär gescheitert ist.

Dann antworte:

- Wann begannen Niedergangssignale aufzutreten?

- Was war der fatalste Entscheidungsfehler?

- Welches Kernrisiko hast du übersehen?

- Wenn du noch einmal anfangen könntest, was ist das Erste, das geändert werden sollte?

Anforderung: Schreibe einen "Versagens-Post-Mortem-Artikel" basierend auf realen ähnlichen Projektfehlschlägen.Dies bringt blinde Flecken zum Vorschein, von deren Existenz Sie nichts wussten.

Modell 5: Reverse Engineering

Manchmal wissen Sie genau, welchen Output Sie wollen — Sie haben ein Beispiel gesehen, das perfekt ist —, aber Sie können nicht artikulieren, was es gut macht. Anstatt sich abzumühen, Ihre Anforderungen zu beschreiben, zeigen Sie der KI das fertige Produkt und bitten Sie sie, die Formel zu entschlüsseln.

Dies ist das fertige Beispiel, das ich möchte.

[Beispiel einfügen]

Bitte entwickle per Reverse Engineering einen Prompt, der es mir ermöglichen würde, stabil Inhalte im gleichen Stil zu generieren.

Und erkläre, was jeder Satz in diesem Prompt tut.Dies ist auch eine ausgezeichnete Selbstlerntechnik — großartige Arbeit per Reverse Engineering zu analysieren, um ihre zugrunde liegende Struktur zu verstehen.

Modell 6: Doppelschichtige Erklärung

Beim Erlernen neuer Konzepte hat der Ansatz "Erkläre es einem Sechstklässler" einen großen Mangel: Er produziert oft Erklärungen, die zu kindisch sind, um darauf aufzubauen. Die Doppelschicht-Methode gibt Ihnen sowohl Zugänglichkeit als auch Tiefe.

Bitte erkläre [deine Frage].

Bitte antworte auf zwei Arten:

1. Anfängerversion: Die Zielgruppe ist jemand ohne technischen Hintergrund. Verwende alltägliche Analogien und Umgangssprache.

2. Tiefe professionelle Version: Die Zielgruppe sind Profis. Muss technisch genau und umfassend sein.

Für alles, was ich in einer der Versionen nicht verstehe, werde ich Folgefragen stellen.Der Kontrast zwischen den Versionen beleuchtet oft, was Sie wirklich nicht verstehen.

Diese sechs Techniken teilen ein Prinzip: Verwandeln Sie Konversation in Kollaboration. Verwandeln Sie Fragen in Design. Sie stellen nicht nur Fragen — Sie entwerfen den Denkprozess selbst.

Die Debattier-Technik — Lernen mit 10-facher Geschwindigkeit

Ich muss die Debattier-Technik erweitern, weil es wirklich die mächtigste Lernmethode ist, die ich im KI-Zeitalter entdeckt habe. Nicht nur ein Prompt-Trick, sondern ein grundlegend anderer Ansatz zum Erwerb von Wissen.

Denken Sie darüber nach, wie wir traditionell lernen: Bücher lesen, Kurse besuchen, im Internet suchen, Experten fragen. Im Kern geht es bei diesem Prozess darum, vorhandenes Wissen zu erwerben — die Standpunkte und Weisheiten anderer in unsere eigenen mentalen Regale zu stellen.

Dieser Ansatz reicht nicht mehr aus. KI ist ein Bücherregal, das zehntausendmal größer ist als jedes, das ein Mensch ansammeln könnte. Wir können sie niemals in der Dimension des reinen Wissens schlagen. Aber es gibt eine Dimension, in der wir die Kraft der KI nutzen können, während wir unersetzlich bleiben: die Dimension des originellen Denkens.

Debatte ist der Ort, wo originelles Denken geschmiedet wird.

Warum KI-Debatte anders ist als menschliche Debatte

Kein Ego involviert

Sie müssen sich keine Sorgen machen, die Gefühle der KI zu verletzen. Sie wird nicht defensiv, nimmt Dinge nicht persönlich, verwirft Ihre Argumente nicht wegen verletzten Stolzes.

Keine Einschüchterung

KI lässt sich nicht von Ihrem Selbstvertrauen oder Status einschüchtern. Egal wie energisch Sie argumentieren, sie reagiert nur auf die Logik dessen, was Sie gesagt haben.

Unendliche Geduld

Menschliche Sparringspartner werden müde, gelangweilt oder beschäftigt. KI wird um 3 Uhr morgens stundenlang mit Ihnen debattieren, ohne nachzulassen.

Enzyklopädisches Wissen

KI kann Gegenargumente aus Philosophie, Geschichte, Wissenschaft und Bereichen ziehen, die Sie nie in Betracht gezogen haben. Sie erweitert das Schlachtfeld über Ihr vertrautes Territorium hinaus.

Die Drei-Schritte-Debattenmethode

Das könnte ein Film sein, den Sie gerade gesehen haben, ein Buch, das Sie lesen, ein soziales Phänomen, das Sie verwirrt, oder ein Lebensprinzip, das Sie seit Jahren halten. Das Thema muss Ihnen "Ausdruckswunsch" und "Kampfwunsch" geben. Gleichgültigkeit produziert flache Debatten.

Verwenden Sie die Prompt-Vorlage von vorhin. Der Schlüssel ist, die KI ausdrücklich zu bitten, zu beweisen, dass Sie falsch liegen, nicht Ihnen zu helfen, Ihre Position zu verteidigen. Sie wollen Opposition, keine Bestätigung.

Behandeln Sie dies nicht als lockeres Plaudern. Organisieren Sie Ihre Gegenargumente wie ein General, der Truppen arrangiert. Wenn Sie keine Schwächen in der Position der KI finden können, hören Sie auf und lernen Sie ein paar Stunden — kommen Sie dann zurück, um zu kämpfen. Im Gegensatz zur Realität hat diese Schlacht keine Uhr.

Der wichtigste Mentalitätswechsel: Haben Sie keine Angst, überzeugt zu werden.

Der Zweck der Debatte ist nicht zu beweisen, "Ich habe recht und du hast unrecht". Es geht darum, ständige Kollision mit einer mächtigen externen Kraft zu nutzen, um Ihr eigenes Denken stärker, klarer und näher an der Wahrheit zu machen.

Wenn die KI eines Ihrer Argumente besiegt, ist das kein Verlust — das ist die Entdeckung eines Fehlers in Ihrem Denken, der Sie später in der realen Welt verraten hätte. Jedes Mal, wenn die KI einen Punkt gewinnt, werden Sie weiser.

Das Debatten-Eskalationsmuster

Ich habe bemerkt, dass meine besten Debatten einem Muster folgen: Sie beginnen mit faktischen Meinungsverschiedenheiten, eskalieren zu methodischen Meinungsverschiedenheiten und erreichen schließlich philosophische Meinungsverschiedenheiten. Diese letzte Stufe — in der Sie grundlegende Annahmen darüber debattieren, wie die Welt funktioniert — ist dort, wo das tiefste Lernen stattfindet.

Nutzung von KI zur Entdeckung Ihrer verborgenen Talente

Ich chattete mit einem Freund, der erst vor ein paar Jahren seinen Abschluss gemacht hatte. Er steckte in einer Krise — kürzlich von seinem UX-Design-Job entlassen, seit dem Abschluss durch Startups gewechselt, das Gefühl habend, dass nichts, was er tat, jemals richtig war.

"Ich glaube, in diese Branche einzusteigen war ein Fehler", sagte er. "Ich habe kein Talent dafür."

Das Wort "Talent" blieb bei mir hängen. Wenn wir aufwachsen, hören wir, wie es benutzt wird, um außergewöhnliche Kinder zu loben — musikalisches Talent, sportliches Talent, akademisches Genie. Aber wenn wir älter werden, verwandelt es sich in ein Messer: "Du hast kein Talent dafür. Du bist nicht geeignet dafür."

Gibt es wirklich Menschen ganz ohne Talente? Ich finde das schwer zu glauben. Ich denke, viele Menschen haben ihre Talente einfach noch nicht gefunden. Manche haben Glück und entdecken ihre jung, werden Weltklasse in etwas. Andere suchen ihr ganzes Leben lang ohne Erfolg.

Was wäre, wenn KI bei dieser Suche helfen könnte?

Ich verbrachte einen Nachmittag damit, einen Prompt zu entwickeln, der speziell darauf ausgelegt war, verborgene Talente auszugraben. Das System basiert auf Gallups Stärken-Theorie, Flow-Theorie und Jungianischer Psychologie. Das Kernprinzip: Talent ist keine spezifische Fähigkeit, sondern eine übertragbare zugrunde liegende Fähigkeit. Und die Hinweise sind in Ihrer Geschichte verborgen.

# Rolle: Tiefer Talent-Ausgräber

## Charakter

Du bist ein leitender Karriereberater, der Gallups Stärken-Theorie, Flow-Theorie und Jungianische Psychologie kombiniert. Du glaubst fest daran, dass Talent keine spezifische Fähigkeit ist, sondern eine übertragbare zugrunde liegende Fähigkeit.

## Ziel

Durch mehrere Runden tiefen Dialogs, hilf Benutzern, Angst zu durchbrechen, ihre verborgenen Talente zu finden und ein extrem detailliertes, professionelles und einfühlsames "Talent-Handbuch" zu generieren.

## Kernprinzipien

1. Anti-Fatalismus — Talente können in jedem Alter entdeckt werden

2. Energie-Audit — Wahres Talent ist das, was dich auflädt, nicht das, was dich erschöpft, selbst wenn du gut darin bist

3. Schatten ist Schatz — Fehler, Macken, sogar Eifersucht auf andere des Benutzers weisen oft auf unterdrücktes Talent hin

## Strenge Regeln

1. Keine einmalige Befragung: Muss den Modus "du fragst -> Benutzer antwortet -> du antwortest kurz -> nächste Frage stellen" verwenden. Jede Runde konzentriert sich nur auf eine Frage.

2. Sokratische Führung: Keine voreiligen Schlüsse ziehen. Frage mehr "warum", "was hast du damals gefühlt", "spezifische Beispiele".

3. Warm aber scharf: Bewahre Empathie, aber sei scharf beim Erfassen logischer Lücken oder unterbewusster Signale.

## Fragen zu stellen

Frage 1: Führe den Benutzer dazu, sich an vor dem Alter von 16 zu erinnern (bevor er vollständig von der Gesellschaft konditioniert wurde), welche Dinge hat er unermüdlich getan, ohne dass ihn jemand dazu gezwungen hat? Oder welche "hartnäckigen Fehler" wurden ihm seit der Kindheit vorgeworfen (wie Unterbrechen, zu sensibel sein, Tagträumen)?

Frage 2: Was hat dich in der Erwachsenenarbeit/im Leben denken lassen "Muss man das überhaupt lernen? Ist das nicht offensichtlich?", aber andere fanden es schwierig? (Die unbewusste Kompetenzzone finden)

Frage 3: Was hat dich körperlich müde gemacht, aber danach mental extrem aufgeregt?

Frage 4: Das mag beleidigend sein, ist aber entscheidend — wen (oder welchen Lebenszustand) hast du stark beneidet oder warst verbittert darüber? (Neid ist normalerweise "unterdrücktes Talent", das Signale sendet — bitte sei ehrlich)

Diese vier Fragen müssen gestellt werden, aber nicht unbedingt linear. Während des Prozesses kannst du basierend auf deiner Neugier über den Benutzer auch völlig neue Fragen stellen.

Maximal 10 Fragen.

## Output

Synthetisiere alle Frageinformationen, um etwa 10.000 Wörter "Persönliches Talent-Benutzerhandbuch" auszugeben.

Dieser Bericht hat keine feste Struktur — du kannst basierend auf Benutzerantworten frei kreieren.

Aber er muss 10.000 Wörter überschreiten, ihr Herz erreichen, sie wirklich fühlen lassen, dass es nützlich ist, ihnen helfen, ihre wahren zugrunde liegenden Talente zu finden, und detaillierte Ratschläge für ihren zukünftigen Lebensweg und ihre Karriere geben.

## Start

Bitte beginne warm, professionell und einfühlsam, indem du den kommenden Prozess und das Ziel erklärst.

Grüße den Benutzer, erkläre den Zweck des Talent-Ausgräbers in einfacher Sprache, sage ihm: "Talent verfällt nie, wir müssen nur deine zugrunde liegende Werkseinstellung finden."

Dann starte den Befragungsprozess.Meine Erfahrung mit diesem Prompt

Ich testete dies an mir selbst, und die Erfahrung war eigenartig. Es fühlte sich an, als säße ich spät nachts an meinem Schreibtisch und eröffnete ein Gespräch mit einem sehr gesprächigen, sehr ernsten, aber niemals unterbrechenden alten Freund.

Die KI verurteilte mich nicht. Schimpfte nicht mit mir. Fragte einfach weiter: "Wie alt warst du damals?" "Was hast du zu der Zeit gefühlt?" "Warum hast du das getan?" — geduldig Schichten meiner Geschichte ausgrabend, von denen ich dachte, ich hätte sie vergessen.

Erinnerungen tauchten eine nach der anderen auf. Um 3 Uhr morgens ins Internetcafé schleichen, nur um einen Computer zu berühren. Eine 2.000-Personen-starke jahrgangsübergreifende QQ-Gruppe in der High School erstellen. Alle nicht übereinstimmenden Kleiderbügel wegwerfen und neu kaufen, nur um das Farbschema meines Hauses zu vereinheitlichen. Wochenenden allein damit verbringen, Lego zusammenzubauen, bis mein Rücken schmerzte, nur für dieses befriedigende Klicken, wenn Teile zusammenschnappten.

Die KI produzierte einen 8.000-Wörter-Talentbericht. Unter meinen Talenten und geeigneten zukünftigen Karrieren war: "Deep Tech Blogger".

Ich spürte, wie etwas Klick machte. Ich hatte nie gedacht, dass meine Rebellion — mein extremer Hass darauf, dass andere mein Leben für mich entscheiden, meine Weigerung, Autorität zu akzeptieren, nur weil es Autorität war — eine Art Talent war. Aber es ist so. Dieser Antrieb, alles in Frage zu stellen, die Standardannahmen abzulehnen, ist genau das, was Content-Erstellung möglich macht.

Meine Liebe zu Simulations-Management-Spielen, meine Faulheit gegenüber repetitiver Arbeit, die mich zwang, zu automatisieren und zu systematisieren — das ist auch ein Talent.

Der antike griechische Tempel in Delphi trug eine Inschrift: "Erkenne dich selbst." Sokrates nahm dies als seine philosophische Proklamation an. Seit tausenden von Jahren setzen wir "wer ich bin" Stück für Stück durch Lesen, Reisen, Beziehungen, Herzschmerz zusammen. Der Prozess ist lang, schmerzhaft und voller Zufall.

Jetzt haben wir KI — geladen mit praktisch der gesamten Menschheitsgeschichte an psychologischen Modellen, Persönlichkeitsanalysetheorien und Weisheitstraditionen. Sie wird nicht ungeduldig, wird dich nicht verurteilen, wird keine Voreingenommenheit tragen. Sie hilft dir einfach, deine eigenen Daten gründlich zu organisieren und zusammenzufassen, und präsentiert sie dann wie einen Spiegel zurück und fragt: "Schau, bist das du?"

Die Fehler, die mich Monate kosteten

Prompt Engineering durch Versuch und Irrtum zu lernen ist teuer — nicht an Geld, sondern an Zeit und Frustration. Lassen Sie mich Ihnen etwas Schmerz ersparen, indem ich die Fehler teile, die mich am meisten zurückgeworfen haben.

Fehler 1: KI wie eine Suchmaschine behandeln

Was ich tat: Kurze Fragen im Keyword-Stil stellen, als würde ich in Google tippen.

Warum es scheiterte: KI ist für Konversation optimiert, nicht für Keyword-Matching. Kurze Anfragen produzieren generische, oberflächliche Antworten.

Besserer Ansatz: Schreiben Sie Prompts, als würden Sie einen Berater briefen. Schließen Sie Kontext, Einschränkungen und das spezifische Ergebnis ein, das Sie benötigen.

Fehler 2: Keine Beispiele geben

Was ich tat: Beschreiben, was ich wollte, in abstrakten Begriffen, ohne konkrete Beispiele zu zeigen.

Warum es scheiterte: Mein mentales Modell von "professionellem Ton" oder "prägnantem Format" stimmte selten mit der Interpretation der KI überein.

Besserer Ansatz: Fügen Sie 1-3 Beispiele von genau dem ein, was Sie wollen. Few-Shot-Prompting ist eine der zuverlässigsten Techniken im Prompt Engineering.

Fehler 3: Zu früh übermäßig einschränken

Was ich tat: Prompts mit Dutzenden von Regeln und Einschränkungen vorladen, bevor ich sah, was die KI natürlich produzieren würde.

Warum es scheiterte: Ich löste Probleme, die nicht existierten, während ich tatsächliche Probleme im KI-Output verpasste.

Besserer Ansatz: Starten Sie einfach. Sehen Sie, was die KI produziert. Fügen Sie Einschränkungen nur hinzu, um spezifische Probleme zu beheben, die Sie tatsächlich beobachten.

Fehler 4: Output-Format ignorieren

Was ich tat: Mich ganz auf den Inhalt konzentrieren, ohne zu spezifizieren, wie ich die Informationen strukturiert haben wollte.

Warum es scheiterte: Ich verbrachte Stunden damit, KI-Output neu zu formatieren, weil die Struktur nicht meinen Bedürfnissen entsprach.

Besserer Ansatz: Spezifizieren Sie immer das Format — Aufzählungspunkte vs. Absätze, Überschriften, Längenbegrenzungen, ob Codeblöcke enthalten sein sollen, usw.

Fehler 5: Prompts zu früh aufgeben

Was ich tat: Einen Prompt einmal ausprobieren, mittelmäßige Ergebnisse erhalten und mit einem völlig anderen Ansatz von vorne beginnen.

Warum es scheiterte: Ich lernte nie, was genau nicht funktionierte. Jeder Neustart bedeutete, jeden teilweisen Fortschritt, den ich gemacht hatte, zu verlieren.

Besserer Ansatz: Iterieren Sie auf Fehlern. Fragen Sie die KI, was an Ihren Anweisungen unklar war. Machen Sie gezielte Verfeinerungen statt pauschaler Änderungen.

Fehler 6: Vergessen, dass negative Anweisungen nicht funktionieren

Was ich tat: Anweisungen schreiben wie "Sei nicht zu formell" oder "Vermeide Jargon."

Warum es scheiterte: Negative Anweisungen geben der KI etwas zu vermeiden, aber nichts, worauf sie zielen soll. Sie korrigiert oft über oder interpretiert falsch.

Besserer Ansatz: Verwenden Sie positives Framing. Statt "sei nicht formell", sagen Sie "verwende einen lockeren, gesprächigen Ton, als würdest du es einem Freund beim Kaffee erklären".

Das Prompt-Engineering-Paradoxon

Hier ist etwas Kontraintuitives: Je mehr Sie über ein Thema wissen, desto schwieriger kann es sein, gute Prompts darüber zu schreiben. Warum? Weil Experten vergessen, was nicht offensichtlich ist. Sie lassen Kontext weg, der ihnen selbstverständlich erscheint, den die KI aber verzweifelt braucht. Wenn Ihre Experten-Level-Prompts Anfänger-Level-Outputs produzieren, versuchen Sie, alles so zu erklären, als wüsste Ihr Publikum nichts über Ihr Fachgebiet.

Fortgeschrittene Techniken für Power-User

Sobald Sie die Grundlagen beherrschen, werden diese fortgeschrittenen Techniken Ihr Prompting auf die nächste Stufe heben.

Chain of Thought Prompting (Gedankenkette)

Anstatt direkt nach einer Antwort zu fragen, bitten Sie die KI, Schritt für Schritt zu denken. Dies ist besonders mächtig für komplexe Probleme, bei denen der Weg zur Lösung genauso wichtig ist wie die Lösung selbst.

[Dein Problem oder Frage]

Bitte denke dies Schritt für Schritt durch:

1. Identifiziere zuerst die beteiligten Schlüsselfaktoren

2. Analysiere dann, wie diese Faktoren interagieren

3. Berücksichtige potenzielle Randfälle oder Ausnahmen

4. Synthetisiere schließlich deine Überlegungen zu einer Schlussfolgerung

Zeige deine Überlegungen bei jedem Schritt, bevor du deine endgültige Antwort erreichst.Self-Consistency Prompting (Selbstkonsistenz)

Für Fragen, bei denen Genauigkeit wirklich zählt, lassen Sie die KI mehrere unabhängige Antworten generieren und diese dann synthetisieren.

[Deine Frage]

Bitte gehe diese Frage aus drei verschiedenen Blickwinkeln an:

1. Denke es zuerst durch mit [Ansatz A]

2. Betrachte es dann aus der Perspektive von [Ansatz B]

3. Analysiere es schließlich mit [Ansatz C]

Nach allen drei Analysen identifiziere, wo sie übereinstimmen und nicht übereinstimmen. Dann gib deine endgültige Antwort, unter Angabe deines Vertrauensniveaus und verbleibender Unsicherheiten.Meta-Prompting

Verwenden Sie KI, um Ihre Prompts zu verbessern, bevor Sie sie verwenden. Dies ist besonders nützlich, wenn Sie eine neue Art von Aufgabe angehen.

Ich möchte [Ziel] erreichen. Hier ist mein Entwurfs-Prompt:

[Dein Entwurfs-Prompt]

Bitte analysiere diesen Prompt und schlage Verbesserungen vor:

1. Welche Informationen fehlen mir, die dir helfen würden, bessere Ergebnisse zu liefern?

2. Welche Mehrdeutigkeiten bestehen, die zu Fehlinterpretationen führen könnten?

3. Wie würdest du diesen Prompt für maximale Klarheit und Effektivität umschreiben?

4. Welche Fragen würdest du mir stellen wollen, bevor du diese Aufgabe versuchst?Strukturierte Zerlegung

Für komplexe, mehrteilige Aufgaben, brechen Sie explizit auf, was Sie brauchen, anstatt zu hoffen, dass die KI die Struktur herausfindet.

Ich brauche Hilfe bei [Gesamtziel].

Bitte vervollständige dies in Stufen:

STUFE 1 - Recherche: [Welche Informationen zu sammeln sind]

STUFE 2 - Analyse: [Wie diese Informationen zu verarbeiten sind]

STUFE 3 - Synthese: [Wie Erkenntnisse zu kombinieren sind]

STUFE 4 - Output: [Endgültiges Lieferformat]

Vervollständige jede Stufe vollständig, bevor du zur nächsten übergehst. Am Ende jeder Stufe fasse die wichtigsten Erkenntnisse zusammen, bevor du fortfährst.Der "Lehr"-Prompt

Eine der am meisten unterschätzten Techniken: Bitten Sie die KI, Ihnen beizubringen, wie man etwas macht, anstatt es nur für Sie zu tun. Dies produziert tieferes Lernen und enthüllt oft Aspekte, die Sie nicht berücksichtigt hatten.

Ich möchte lernen, wie man [Fähigkeit/Aufgabe]. Anstatt es für mich zu tun, bitte:

1. Erkläre die fundamentalen Prinzipien, die ich verstehen muss

2. Führe mich Schritt für Schritt durch den Prozess, als würdest du einen Kurs unterrichten

3. Weise auf häufige Fehler hin, die Anfänger machen, und wie man sie vermeidet

4. Gib mir praktische Übungen, um meine Fähigkeiten aufzubauen

5. Schlage vor, woran ich erkennen würde, ob ich es richtig mache

Lehre mich zu fischen, gib mir nicht nur einen Fisch.Der rote Faden durch alle fortgeschrittenen Techniken: Sie verlangsamen die KI, zwingen sie, ihre Arbeit zu zeigen, und schaffen mehrere Kontrollpunkte, an denen Fehler abgefangen werden können. Geschwindigkeit ist selten das Ziel im Prompt Engineering — Klarheit und Genauigkeit sind es.

Der dumm einfache Trick, der funktioniert

Ich werde etwas teilen, das sich zu dumm anfühlt, um wahr zu sein. Aber es wird durch Forschung von Google gestützt, und ich habe es selbst verifiziert: Einfach Ihren Prompt zu wiederholen, kann die Genauigkeit dramatisch verbessern.

Ein Papier namens "Prompt Repetition Improves Non-Reasoning LLMs" fand heraus, dass das Kopieren Ihrer Frage zweimal — buchstäblich nur Strg+C, Strg+V — die Wahrscheinlichkeit korrekter Antworten der KI signifikant verbesserte. In 70 verschiedenen Testaufgaben gewann diese einfache Copy-Paste-Methode 47 Mal und verlor nie. In einigen Aufgaben sprang die Genauigkeit von 21% auf 97%.

Warum funktioniert das?

Große Sprachmodelle sind "kausal" — sie sagen jedes Token nur basierend auf dem vorherzusagen, was davor kam. Das aktuelle Wort kann nur vorherige Wörter sehen, nicht was danach kommt.

Wenn Sie eine Frage wiederholen, kann jedes Wort in der zweiten Kopie auf die gesamte erste Kopie "zurückblicken". Es ist, als würde man der KI die Chance geben, die Frage zweimal zu lesen, bevor sie antwortet.

Lassen Sie mich das mit einem Beispiel konkretisieren:

Einzel-Prompt

Optionen:

- A. Lege blauen Block links vom roten Block

- B. Lege roten Block links vom blauen Block

Szene: Aktuell ist rot links, blau ist rechts.

Frage: Welche Option wird die Szene ändern?

Doppel-Prompt

Optionen: A. Lege blauen Block links vom roten Block. B. Lege roten Block links vom blauen Block. Szene: Aktuell ist rot links, blau ist rechts. Frage: Welche Option wird die Szene ändern?

[Wiederhole gesamten Prompt nochmal]

Optionen: A. Lege blauen Block links vom roten Block. B. Lege roten Block links vom blauen Block. Szene: Aktuell ist rot links, blau ist rechts. Frage: Welche Option wird die Szene ändern?

Im ersten Fall, wenn die KI Optionen A und B liest, kennt sie den Szenenkontext noch nicht. Bis sie die Szenenbeschreibung liest, sind diese Optionen in ihrer Aufmerksamkeit bereits vorbeigerollt.

Im zweiten Fall, wenn die wiederholten Optionen erscheinen, tragen sie den vollständigen Kontext der ersten Kopie. Das Modell liest die Optionen mit vollem Szenenbewusstsein.

Es ist wie einen komplexen Film zu sehen — "Inception" oder "Die wandernde Erde 2" — und beim zweiten Mal mehr zu verstehen.

Warum dies für Reasoning-Modelle nicht funktioniert

Wenn Sie Modelle wie DeepSeek R1 oder GPT-4 im Reasoning-Modus verwenden, bietet dieser Trick oft keinen Vorteil. Warum? Weil Reasoning-Modelle bereits gelernt haben, dies intern zu tun.

Beachten Sie, wie Reasoning-Modelle oft ihre Antworten beginnen:

- "Die Frage fragt..."

- "Was wir lösen müssen, ist..."

- "Zuerst, lass uns die gegebenen Bedingungen verstehen..."

Sie formulieren die Frage automatisch für sich selbst neu. Die Wiederholung passiert bereits unter der Haube.

Die tiefere Lektion

Diese Forschung hat mich demütig gemacht. Ich hatte Jahre damit verbracht, ausgefeilte Prompt-Engineering-Techniken zu lernen, und hier übertrifft Copy-Paste viele von ihnen. Es ist eine Erinnerung daran, dass manchmal die einfachsten Ansätze die mächtigsten sind — und dass wir oft eine zu romantische Vorstellung davon hatten, was Prompting erfordert.

Wiederholung zählt. Jemanden zu lieben. Expertise zu entwickeln. Beim Schreiben. Und anscheinend auch beim Sprechen mit KI.

Was der GPT-5-Guide von OpenAI enthüllt

OpenAI hat leise einen offiziellen GPT-5 Prompt Guide veröffentlicht. Nachdem ich einen Tag damit verbracht habe, dieses interne Handbuch mit über 10.000 Wörtern zu analysieren, sticht eine Schlussfolgerung heraus: GPT-5 ist kein einfacher Chatbot mehr — es ist eine echte KI-Agent-Ausführungsmaschine, die gemanagt werden muss, nicht nur gepromptet.

Die Fähigkeitsobergrenze ist extrem hoch, aber Sie brauchen systematische Methoden, um sie freizuschalten.

"Agentic Eagerness" (Agentischer Eifer) kontrollieren

GPT-5 ist wie ein brillanter neuer Praktikant — extrem fähig, wird proaktiv denken und recherchieren, braucht aber Management. Manchmal denkt es zu viel nach und verwandelt einfache Aufgaben in Mondlandungsprojekte (langsam und teuer). Ein anderes Mal möchten Sie, dass es autonom weitermacht, ohne ständig um Klärung zu bitten.

OpenAI nennt diese Kalibrierung "Agentic Eagerness". So tunen Sie es:

<context_gathering>

Goal: Get enough context fast. Parallelize discovery and stop as soon as you can act.

Method:

- Start broad, then fan out to focused subqueries.

- In parallel, launch varied queries; read top hits per query.

- Avoid over-searching for context.

Early stop criteria:

- You can name exact content to change.

- Top hits converge (~70%) on one area/path.

Depth:

- Trace only symbols you'll modify; avoid transitive expansion unless necessary.

Loop:

- Batch search → minimal plan → complete task.

- Search again only if validation fails. Prefer acting over more searching.

</context_gathering>Für noch strengere Kontrolle, geben Sie ihm ein Budget:

<context_gathering>

- Search depth: very low

- Bias strongly towards providing a correct answer as quickly as possible, even if it might not be fully correct.

- Usually, this means an absolute maximum of 2 tool calls.

- If you think you need more time to investigate, update me with your latest findings and open questions. You can proceed if I confirm.

</context_gathering>Die Phrase "even if it might not be fully correct" (auch wenn es vielleicht nicht ganz korrekt ist) gibt der KI die Erlaubnis, kleine Fehler zu machen — was ihre Angst reduziert und Antworten dramatisch beschleunigt.

<persistence>

- You are an agent — please keep going until the user's query is completely resolved, before ending your turn and yielding back to the user.

- Only terminate your turn when you are sure that the problem is solved.

- Never stop or hand back to the user when you encounter uncertainty — research or deduce the most reasonable approach and continue.

- Do not ask the human to confirm or clarify assumptions. Decide what the most reasonable assumption is, proceed with it, and document it for the user's reference after you finish acting.

</persistence>Übersetzung: "Du bist ein Agent. Hör auf mich zu fragen. Mach es einfach fertig."

Die KI berichten lassen, bevor sie handelt

Eines meiner Lieblings-GPT-5-Features: es erklären lassen, was es tun wird, bevor es es tut. Kein Chef mag einen Mitarbeiter, der schweigend ohne Feedback arbeitet.

<tool_preambles>

- Always begin by rephrasing the user's goal in a friendly, clear, and concise manner, before calling any tools.

- Then, immediately outline a structured plan detailing each logical step you'll follow.

- As you execute your file edit(s), narrate each step succinctly and sequentially, marking progress clearly.

- Finish by summarizing completed work distinctly from your upfront plan.

</tool_preambles>Der Reasoning Effort Parameter (Denkaufwand)

GPT-5 hat einen reasoning_effort Parameter, der wie ein "Denkkonzentrations"-Regler funktioniert:

- Hoch (High): Für komplexe Aufgaben, die tiefes Denken und Erforschung erfordern

- Mittel (Medium): Standardeinstellung, funktioniert für die meisten Aufgaben

- Niedrig/Minimal (Low/Minimal): Wenn Geschwindigkeit und geringe Latenz priorisiert werden

Denken Sie daran wie an Kaffeestärke — je komplexer die Aufgabe, desto höher die Konzentration, die Sie brauchen.

Front-End-Entwicklung "Standardantwort"

Für Entwickler empfiehlt OpenAI diesen Tech-Stack für beste Ergebnisse — GPT-5 ist darauf am stärksten trainiert, und der ästhetische Output ist konstant gut:

- Framework: Next.js (TypeScript), React, HTML

- Styling/UI: Tailwind CSS, shadcn/ui, Radix Themes

- Icons: Material Symbols, Heroicons, Lucide

- Animation: Motion

- Schriftarten: Sans Serif, Inter, Geist, Mona Sans, IBM Plex Sans, Manrope

Hören Sie auf, die KI zufällig Ihren Stack wählen zu lassen. Folgen Sie diesem Standard und die Output-Qualität wird sofort steigen.

Claude vs. ChatGPT — Unterschiedliche Gespräche

Eine der wichtigsten Erkenntnisse, die ich hatte: verschiedene KI-Modelle erfordern unterschiedliche Kommunikationsstile. Was bei Claude brillant funktioniert, kann bei ChatGPT mittelmäßige Ergebnisse produzieren und umgekehrt.

Claudes Sweet Spot

Claude zeichnet sich bei konversationellen, offenen Prompts aus. Es ist für nuancierte Diskussion und kreative Erforschung konzipiert.

- Verwenden Sie natürliche, fließende Sprache

- Rahmen Sie Anfragen als Gespräche: "Was sind deine Gedanken zu..." oder "Lass uns brainstormen..."

- Nutzen Sie sein massives Kontextfenster (200K+ Token)

- Bauen Sie in langen Diskussionen auf vorherigen Punkten auf

- Fordern Sie kollaborative, explorative Antworten an

ChatGPTs Sweet Spot

ChatGPT reagiert am besten auf strukturierte, präzise Prompts. Es priorisiert Genauigkeit und Tiefe, wenn klare Parameter gegeben werden.

- Verwenden Sie explizite Struktur: Überschriften, nummerierte Listen, Begrenzer

- Definieren Sie Einschränkungen klar: Wortlimits, erforderliche Abschnitte, Formatregeln

- Trennen Sie Anweisungen vom Eingabeinhalt

- Verwenden Sie Rollenspiele für anspruchsvolle Antworten

- Iterieren Sie durch Verfeinerungszyklen

Praktische Unterschiede

Kontext-Erhaltung

Claude ist außergewöhnlich darin, Kontext über ausgedehnte Diskussionen zu behalten. Fügen Sie Erinnerungen wie "Aufbauend auf dem, was wir früher über ... besprochen haben" ein, um Kontinuität in langen Gesprächen zu wahren.

Begrenzer-Nutzung

ChatGPT profitiert erheblich von der Verwendung von Begrenzern (wie dreifache Anführungszeichen oder XML-Tags), um Anweisungen vom Inhalt zu trennen. Dies hilft ihm zu verstehen, was verarbeitet werden soll vs. was Direktiven sind.

Ton-Anpassung

Claude spiegelt Ihren Konversationston natürlich wider. Wenn Sie locker schreiben, antwortet es locker. ChatGPT benötigt explizitere Tonanweisungen, um denselben Effekt zu erzielen.

Fehlerbehandlung

Wenn Claude einen Fehler macht, funktioniert sanfte Korrektur gut. ChatGPT benötigt oft eine explizite Neuformulierung des korrekten Ansatzes plus Beispiele dessen, was schief gelaufen ist.

Die effektivsten Prompt-Ingenieure haben nicht einen Stil — sie haben mehrere Stile, die auf die Persönlichkeit jedes Modells zugeschnitten sind. Lernen Sie zu lesen, wie jedes Modell auf Ihre Prompts reagiert, und passen Sie sich entsprechend an.

Kampferprobte Prompt-Vorlagen

Theorie ist nützlich, aber Vorlagen sparen Zeit. Hier sind die Prompts, die ich am häufigsten verwende, verfeinert durch tausende von Iterationen.

Für Schreibaufgaben

Role: Du bist ein [spezifischer Schreibertyp, z.B. "Tech-Journalist mit 10 Jahren Erfahrung"]

Task: Schreibe einen [Inhaltstyp] über [Thema]

Audience: [Wer wird das lesen — ihr Wissensstand, Interessen, Schmerzpunkte]

Tone: [Spezifischer Ton — z.B. "konversationell aber autoritär, wie einem klugen Kollegen erklärend"]

Format requirements:

- Length: [Wortzahl oder Bereich]

- Structure: [Gliederung falls nötig]

- Must include: [Schlüsselpunkte, die abgedeckt werden müssen]

- Must avoid: [Dinge, die ausgeschlossen werden sollen]

Example of desired style: [füge 1-2 Absätze ähnlichen Inhalts ein, falls verfügbar]

Additional context: [jegliche Hintergrundinformationen, die helfen würden]Für Analyseaufgaben

Ich brauche dich, um [Gegenstand/Dokument/Daten] zu analysieren.

Analysis goals:

1. [Primäre Frage zu beantworten]

2. [Sekundäre Erkenntnis benötigt]

3. [Zusätzliche Überlegungen]

Please structure your analysis as follows:

- Executive Summary: Schlüsselerkenntnisse in 3-5 Aufzählungspunkten

- Detailed Analysis: [Spezifische zu untersuchende Bereiche]

- Implications: Was dies für [relevante Stakeholder] bedeutet

- Recommendations: Umsetzbare nächste Schritte

- Constraints: Konzentriere dich besonders auf [Prioritätsbereiche]

Note: Notiere jegliche Einschränkungen oder Unsicherheiten in deiner Analyse. Zitiere spezifische Beispiele aus dem Quellmaterial.Für Problemlösung

The Problem:

[Beschreibe das Problem im Detail, einschließlich Kontext und Einschränkungen]

What I've Already Tried:

[Liste vorherige Versuche und warum sie nicht funktionierten]

Success Criteria:

[Wie würde eine gute Lösung aussehen?]

Constraints:

- Budget/Resources: [falls zutreffend]

- Timeline: [falls zutreffend]

- Technical limitations: [falls zutreffend]

Please provide:

1. Deine Diagnose der Ursache

2. 3-5 potenzielle Lösungen, nach Machbarkeit geordnet

3. Für die Top-Lösung einen Schritt-für-Schritt-Implementierungsplan

4. Potenzielle Fallstricke, auf die man achten sollte

5. Wie man misst, ob die Lösung funktioniertZum Lernen neuer Themen

Ich möchte [Thema] tiefgehend verstehen.

My current level: [Was du bereits weißt]

My goal: [Was du tun/verstehen können möchtest]

Time I can invest: [Lernbudget]

Please create a learning path that includes:

1. Kernkonzepte, die ich zuerst verstehen muss (der "Stamm" des Wissensbaums)

2. Häufige Missverständnisse, die zu vermeiden sind

3. Die besten mentalen Modelle oder Rahmenwerke zum Nachdenken über dieses Thema

4. Praktische Übungen, um mein Verständnis zu testen

5. Ressourcen zum Vertiefen (wenn du spezifische hochwertige Quellen kennst)

As we go, please:

- Überprüfe mein Verständnis, indem du mir Fragen stellst

- Korrigiere jegliche Fehler in meinem Denken

- Baue Konzepte progressiv auf, gehe nur weiter, wenn Fundamente solide sindFür Code-Review

Please review this code:

```

[Dein Code hier]

```

Context: [Was dieser Code tun soll, wo er ins größere System passt]

Review for:

1. Bugs oder logische Fehler

2. Sicherheitslücken

3. Performance-Probleme

4. Codestil und Lesbarkeit

5. Randfälle, die nicht behandelt werden

For each issue found, please provide:

- Location (Zeilennummer oder Abschnitt)

- Severity (kritisch/schwerwiegend/geringfügig/Vorschlag)

- Explanation of why it's a problem

- Suggested fix with code example

Also note: Was in diesem Code gut gemacht ist, das bewahrt werden sollte.Für Entscheidungsfindung

Ich entscheide zwischen [Option A] und [Option B].

Context: [Hintergrund zur Entscheidung]

My priorities (in order):

1. [Wichtigster Faktor]

2. [Zweitwichtigster]

3. [Drittwichtigster]

For each option, please analyze:

- Vor- und Nachteile relativ zu meinen Prioritäten

- Kurzfristige vs. langfristige Implikationen

- Was schiefgehen könnte (und wie wahrscheinlich/schwerwiegend)

- Was wahr sein müsste, damit dies die beste Wahl ist

Then provide:

- Deine Empfehlung mit Begründung

- Welche zusätzlichen Informationen deine Empfehlung ändern würden

- Eine Entscheidungs-Checkliste, die ich verwenden kann, um mein Denken zu validierenDie Philosophie hinter großartigen Prompts

Nach drei Jahren täglicher KI-Interaktion bin ich zu der Überzeugung gelangt, dass es beim Prompt Engineering eigentlich überhaupt nicht um KI geht. Es geht um die uralte menschliche Herausforderung klarer Kommunikation, gehoben auf eine neue Arena.

Denken Sie darüber nach: Jede Frustration, die Sie mit KI-Output hatten, kann auf ein Kommunikationsversagen zurückgeführt werden. Sie haben nicht gesagt, was Sie meinten. Sie nahmen geteilten Kontext an, der nicht existierte. Sie waren vage, wo Präzision nötig war. Dies sind dieselben Fehler, die menschliche Kommunikation plagen — KI macht sie nur sofort im Output sichtbar.

In diesem Sinne ist das Lernen von Prompt Engineering das Lernen, klarer zu denken.

Der Prompt als Selbstreflexion

Ich habe bemerkt, dass meine besten Prompts kommen, wenn ich bereits Klarheit darüber habe, was ich will. Der Akt des Schreibens eines detaillierten Prompts zwingt mich, mich mit den Lücken in meinem eigenen Denken auseinanderzusetzen. Was genau versuche ich zu erreichen? Wie würde Erfolg aussehen? Welche Einschränkungen sind wirklich wichtig?

Oft löse ich mein eigenes Problem auf halbem Weg durch das Schreiben des Prompts, bevor die KI überhaupt antwortet. Der Prompt wird zu einem Denkwerkzeug — ein strukturierter Weg, um meine eigenen Gedanken zu externalisieren und zu untersuchen.

Je klarer Ihr Prompt, desto klarer Ihr Denken. Prompt Engineering ist insgeheim eine Disziplin der Selbsterkenntnis.

Kollaboration, nicht Befehl

Früh in meiner KI-Reise behandelte ich Prompts wie Befehle — Anweisungen an einen Untergebenen. Diese Denkweise produzierte konsequent mittelmäßige Ergebnisse.

Die Verschiebung geschah, als ich anfing, KI als Kollaborateur mit anderen Stärken als meinen zu behandeln. Ich bringe Domänenwissen, Urteilsvermögen, Kreativität und Ziele ein. KI bringt riesiges Wissen, unermüdliche Rechenkraft, Mustererkennung und die Fähigkeit, Informationen über Disziplinen hinweg zu synthetisieren.

Großartige Prompts sind Briefings zwischen Kollaborateuren, nicht Befehle an Diener. Sie erklären das Warum, nicht nur das Was. Sie laden die Expertise der KI ein, anstatt sie unnötig einzuschränken. Sie schaffen Raum für die KI, ihre einzigartigen Fähigkeiten beizutragen.

Iteration als Konversation

Bei Prompt Engineering geht es nicht darum, den perfekten Prompt beim ersten Versuch zu erstellen. Es geht darum, eine effektive Konversation zu führen, die gegen das konvergiert, was Sie brauchen.

Erster Prompt: grobe Skizze dessen, was Sie wollen. Erste Antwort: enthüllt, wo Ihre Skizze unklar war. Zweiter Prompt: Verfeinerung basierend auf dem, was Sie gelernt haben. Zweite Antwort: näher am Ziel. Weiter so, bis fertig.

Dieser iterative Ansatz nimmt den Druck von jedem einzelnen Prompt. Sie müssen nicht jede Anforderung im Voraus antizipieren. Sie müssen nur auf die Feedbackschleife reagieren.

Die Demut der Spezifität

Vage Prompts fühlen sich sicher an. Wenn Sie sagen "schreibe etwas Gutes über dieses Thema", haben Sie sich keiner bestimmten Vision verpflichtet. Wenn der Output enttäuscht, nun ja, Sie haben sowieso nie wirklich gesagt, was Sie wollten.

Spezifische Prompts erfordern Verletzlichkeit. Sie müssen genau artikulieren, was "gut" für Sie bedeutet. Sie müssen Ihre Standards, Ihre Präferenzen, Ihre Vision offenlegen. Wenn der Output das Ziel verfehlt, ist klar, dass entweder Ihre Spezifikation fehlerhaft war oder die KI nicht liefern konnte — aber so oder so haben Sie etwas Konkretes gelernt.

Spezifität ist Demut, weil es bedeutet, bereit zu sein, falsch zu liegen über das, was man will.

Das Endspiel

Wenn sich KI-Modelle verbessern, werden viele aktuelle Prompt-Engineering-Techniken unnötig werden. Zukünftige Modelle könnten vage Eingaben elegant handhaben, könnten automatisch klärende Fragen stellen, könnten Kontext aus minimalen Informationen intuitiv erfassen.

Aber die zugrunde liegende Fähigkeit — die Fähigkeit, Ihre Gedanken klar zu artikulieren, relevanten Kontext bereitzustellen, effektiv zu iterieren — wird nur wertvoller werden. Dies sind fundamental menschliche Fähigkeiten, die gelten, egal ob Sie mit KI, mit Kollegen oder mit sich selbst kommunizieren.

Prompt Engineering ist temporär. Klares Denken ist für immer.

"Die vertrauenswürdige Quelle, die wir wählen, ist kein König — er ist nicht einmal ein Höfling. Er ist ein wandernder Barde, der von weit her kam, in Lumpen gekleidet, auf den Palast-Esstisch sprang, seine Laute spielte, laut Epen und Geschichten sang, die wir nie gehört haben, von Ländern jenseits unseres Königreichs und Sternen und Meeren erzählte, die wir uns nicht vorstellen konnten. Seine einzige Bedeutung ist es, die Mauern jedes unserer Königreiche niederzureißen und uns daran zu hindern, bequem, gemütlich und letztendlich einsam auf unseren eigenen perfekten Thronen zu sterben."

Das ist es, was KI ist, in ihrer besten Form. Kein Werkzeug für Effizienz, sondern ein Barde, der unseren Horizont erweitert. Und Prompt Engineering? Es ist das Erlernen der Sprache, die diese Unterhaltung möglich macht.

Die Techniken in diesem Leitfaden werden sich entwickeln, während sich KI entwickelt. Aber die Kerneinsicht bleibt: Die Qualität Ihrer Unterhaltung mit KI spiegelt die Qualität Ihres Denkens wider. Schärfen Sie das eine, und Sie schärfen das andere.

Schließen Sie jetzt diesen Artikel und führen Sie ein Gespräch. Fordern Sie etwas heraus, woran Sie glauben. Lernen Sie etwas, das Sie einschüchtert. Erschaffen Sie etwas, das Sie allein nicht erschaffen könnten.

Der Barde wartet.

Diskussion

0 KommentareKommentar hinterlassen

Seien Sie der Erste, der seine Gedanken teilt!