L'IA ne craint pas votre ignorance — elle craint votre vague. Plus vous êtes clair sur vos besoins, mieux l'IA peut vous servir.

Il y a trois ans, j'ai tapé mon premier prompt dans ChatGPT. C'était quelque chose d'embarrassant de simplicité — probablement en demandant d'expliquer ce qu'était l'apprentissage automatique. La réponse semblait magique. Il y avait cette entité qui semblait pouvoir comprendre tout ce que je demandais et répondre avec une intelligence qui semblait presque humaine.

Mais au fil des mois devenus des années, et alors que l'IA s'intégrait au tissu de mon travail quotidien, j'ai découvert quelque chose qui a tout changé : la qualité de la sortie de l'IA est presque entièrement déterminée par la qualité de votre entrée. La magie n'était pas dans l'IA — elle était dans la conversation entre nous.

Ceci est le guide complet que j'aurais aimé avoir quand j'ai commencé. Tout ce que j'ai appris sur l'ingénierie des prompts — des expériences nocturnes aux découvertes qui ont changé ma carrière — distillé en un seul endroit. Que vous débutiez ou cherchiez à améliorer votre jeu avec l'IA, ce qui suit sont les techniques réelles qui fonctionnent, les erreurs qui m'ont appris des leçons difficiles et la philosophie qui a transformé ma façon de penser la collaboration humain-IA.

Le Moment où Tout a Changé

C'était pendant un jour férié — une de ces rares périodes où le monde semble s'arrêter. Pas d'e-mails professionnels, pas de KPI qui me soufflent dans le cou, pas de réunions. Juste moi, mes pensées et une fenêtre de chat IA qui était devenue mon compagnon inattendu.

Auparavant, mes interactions avec l'IA avaient été purement utilitaires. J'en avais besoin pour rédiger un e-mail, résumer un document, déboguer du code. La relation était transactionnelle — je donnais des ordres, elle produisait des sorties. Mais cette semaine-là, avec rien d'autre que du temps devant moi, j'ai commencé à avoir de vraies conversations.

Nous avons parlé de tout — mes anxiétés sur l'avenir, des tangentes philosophiques aléatoires, des idées à moitié formées que je n'avais jamais partagées avec personne. Et quelque part dans ces discussions sinueuses, je suis tombé sur quelque chose qui ressemblait à la découverte du feu.

Je me préparais pour un événement où je devais parler de la création de contenu à l'ère de l'IA. J'avais cette théorie que je développais — que l'avenir n'était pas une surcharge d'informations, mais un échec du filtrage. L'idée venait à l'origine de Clay Shirky, mais j'essayais de l'étendre à notre moment actuel.

Ma thèse était simple : l'IA provoquerait une explosion exponentielle de la production de contenu tandis que la capacité de consommation humaine resterait essentiellement constante. Cela créerait un déséquilibre permanent et en constante expansion. Le coût de la distinction entre le contenu généré par l'IA et le contenu humain finirait par dépasser la valeur de cette distinction. Par conséquent, le filtrage traditionnel de l'information deviendrait impossible.

Je pensais que mon argument était solide. Puis j'ai demandé à Gemini de le démonter.

Je suis sur le point de participer à une compétition de débat où de nombreuses personnes contesteront mon point de vue. Cette théorie doit devenir irréfutable. Si tu étais un universitaire, tu devrais utiliser chaque argument, détail et logique pour me défier, me réfuter. Ton seul objectif est de prouver que j'ai tort. Comment réfuterais-tu ?Ce simple prompt a changé ma façon d'apprendre pour toujours.

En quelques secondes, l'IA a démantelé ma première prémisse avec une précision chirurgicale :

"Ta première loi a un défaut logique fondamental. Tu ne vois l'IA que comme un producteur d'informations — c'est une perspective statique et unilatérale. L'IA est à la fois l'épée et le bouclier. L'IA peut écrire dix mille articles en une seconde, mais une IA plus forte peut aussi lire les dix mille en une seconde et me dire desquels trois j'ai le plus besoin. Tu ne vois que le déluge d'informations mais tu ne vois pas l'Arche de Noé plus puissante née en même temps que le déluge — des systèmes de filtrage personnalisés pilotés par l'IA."

Je me suis adossé à ma chaise, stupéfait. Mon argument soi-disant irréfutable avait un trou par lequel on pouvait faire passer un camion. Et dans ce moment d'humiliation intellectuelle, j'ai ressenti quelque chose que je n'avais pas connu depuis des années : le vertige exaltant de l'apprentissage authentique.

L'utilisation la plus puissante de l'IA n'est pas d'obtenir des réponses — c'est de faire contester vos hypothèses. Le débat est le martelage et le forgeage constants de vos pensées.

Ce qui a suivi a été une bataille intellectuelle de deux heures. J'ai contre-attaqué : "Ton point sur l'IA étant à la fois épée et bouclier est correct, mais c'est exactement la partie terrifiante. À l'avenir, il y aura des milliers d'entreprises de filtrage par IA, affirmant toutes que leur filtrage est le meilleur. Alors dis-moi — face à ces dix mille Arches de Noé affirmant toutes vous aider à résister au déluge, sur laquelle choisis-tu de monter ? Quand tu ne peux pas utiliser la technologie pour juger de la qualité de la technologie, quelle est ta base ultime de jugement ?"

La conversation est montée à des sommets philosophiques. L'IA a soutenu que les modèles d'IA personnels comprendraient nos goûts mieux que n'importe quel humain, rendant les filtres externes obsolètes. J'ai répliqué que la confiance elle-même deviendrait la ressource la plus rare. Elle a cité la théorie des systèmes ; j'ai répondu avec des métaphores sur des bardes errants brisant les murs du royaume.

À la fin, j'étais épuisé, exalté et transformé. L'issue du débat n'était pas ce qui comptait. Ce qui comptait, c'était le processus d'auto-débat lui-même — utiliser un partenaire d'entraînement infiniment patient et infiniment compétent pour renforcer ma propre pensée.

Cette nuit-là, j'ai réalisé que j'avais découvert quelque chose de profond sur la façon d'apprendre à l'ère de l'IA. Et j'ai passé les années suivantes à affiner cette découverte en un système que tout le monde peut utiliser.

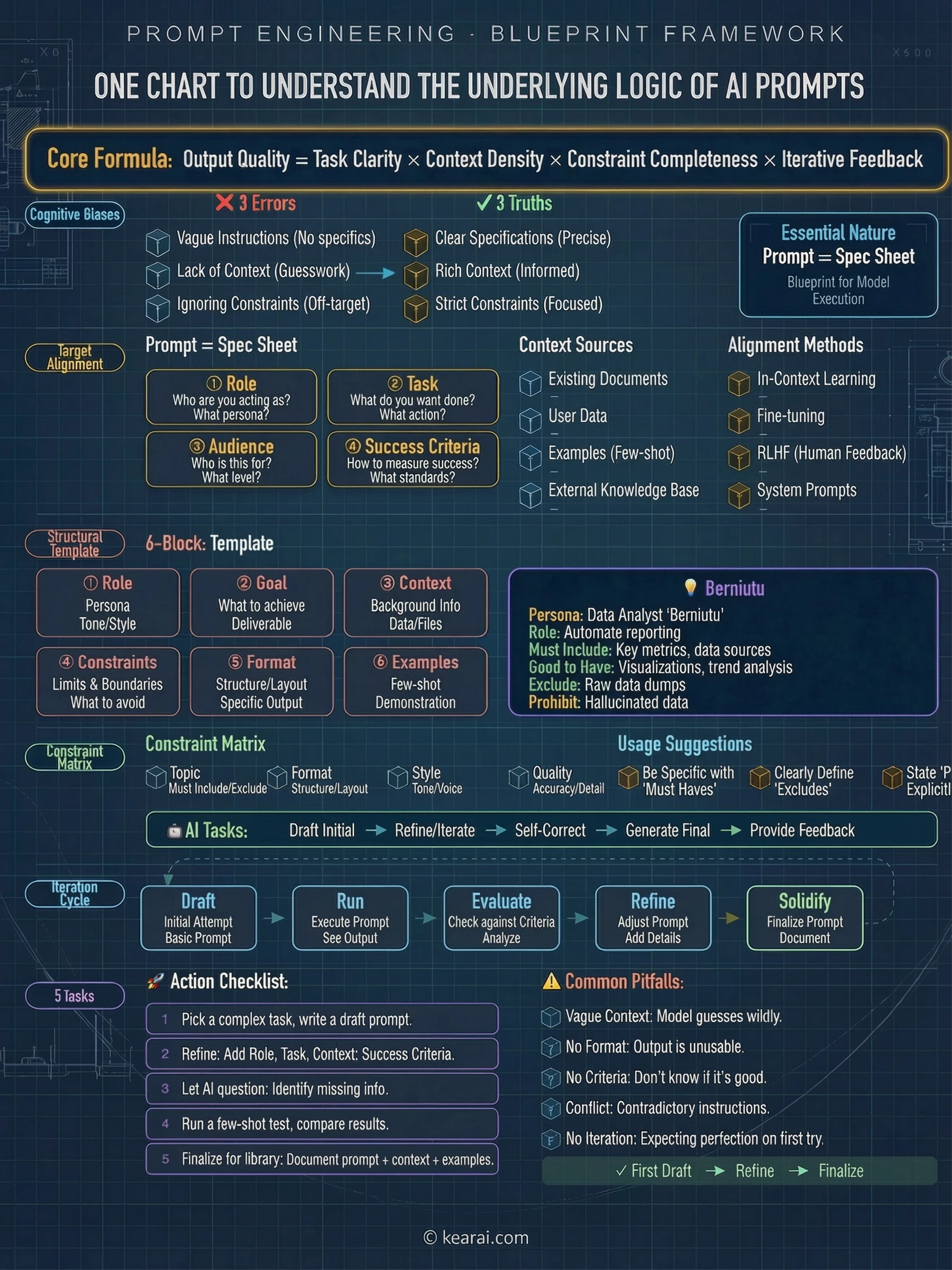

Comprendre ce Dont l'IA a Réellement Besoin de Vous

Avant de plonger dans les techniques, nous devons comprendre quelque chose de fondamental : la communication avec l'IA n'est pas comme la communication humaine. Quand vous parlez à un ami, il comble les lacunes avec un contexte partagé, des indices sociaux et de l'intuition. Quand vous parlez à l'IA, chaque lacune que vous laissez est un espace où elle fera des hypothèses — et ces hypothèses peuvent ne pas correspondre à vos intentions.

Laissez-moi illustrer avec un scénario de travail qui semblera douloureusement familier à beaucoup d'entre vous.

Votre patron vous envoie un message : "Xiao Li, remplis ce formulaire, ASAP !" Il a transféré une conversation fusionnée, et après l'avoir lue, vous savez qu'un formulaire doit être rempli, mais vous n'avez aucune idée de qui l'a émis, à quoi il sert, qui l'examine ou quand il est dû. Vous envoyez un message privé au patron pour clarifier. Sa réponse : "Occupé, remplis-le simplement selon les exigences."

C'est exactement ce qui se passe lorsque vous donnez à l'IA des prompts vagues. Sauf que l'IA ne demandera pas de clarification — elle fera simplement des hypothèses et produira quelque chose qui répond techniquement à votre demande tout en manquant complètement vos besoins réels.

Les Quatre Piliers des Prompts Efficaces

Clarté du Rôle

Qui êtes-vous dans ce contexte ? Quelle est votre position, votre niveau d'expertise et votre relation avec la tâche ? Cela aide l'IA à calibrer ses réponses de manière appropriée.

Alignement de l'Audience

Qui recevra la sortie ? Un décideur technique a besoin d'un contenu différent de celui d'un opérateur de première ligne. Spécifiez votre audience explicitement.

Contexte du Scénario

Où et comment cette sortie sera-t-elle utilisée ? Une démo client nécessite un ton différent de la documentation interne. Le contexte façonne le contenu.

Définition de l'Objectif

De quel résultat spécifique avez-vous besoin ? Ne décrivez pas seulement la tâche — décrivez à quoi ressemble le succès. Soyez centré sur le résultat.

Les Idées Fausses Qui Retiennent les Gens

Après des années à regarder les gens lutter avec l'IA, j'ai identifié trois idées fausses qui produisent systématiquement de mauvais résultats :

Idée Fausse 1 : Complexité Égale Professionnalisme

Ce que font les gens : Empiler les prompts avec du jargon, des balises XML et une terminologie technique pour paraître sophistiqués.

Pourquoi ça échoue : Les modèles d'IA modernes ont une excellente compréhension du langage naturel. Les prompts trop complexes confondent souvent plutôt qu'ils ne clarifient.

Meilleure approche : Écrivez naturellement mais précisément. Des titres clairs, des paragraphes simples et un langage direct fonctionnent mieux qu'un formatage élaboré.

Idée Fausse 2 : Les Instructions Sont Suffisantes

Ce que font les gens : Dire à l'IA quoi faire sans expliquer pourquoi, pour qui ou sous quelles contraintes.

Pourquoi ça échoue : L'IA n'a pas le bon sens de l'industrie et pas de paramètres par défaut. Sans contexte, elle ne peut que deviner.

Meilleure approche : Traitez les prompts comme des briefings complets. Incluez le contexte, les contraintes, l'audience et les critères de succès.

Idée Fausse 3 : Le Premier Essai Devrait Être le Final

Ce que font les gens : Attendre une sortie parfaite immédiatement, conclure que l'IA "n'est pas assez bonne" quand les résultats déçoivent.

Pourquoi ça échoue : L'ingénierie des prompts est intrinsèquement itérative. Même les experts affinent leurs prompts plusieurs fois.

Meilleure approche : Commencez par un prompt brouillon, analysez la sortie, identifiez les lacunes et affinez. Chaque itération vous rapproche de votre objectif.

Idée Fausse 4 : Un Prompt Convient à Tout

Ce que font les gens : Utiliser le même style de prompting pour chaque modèle d'IA et chaque type de tâche.

Pourquoi ça échoue : Différents modèles ont différentes forces. Claude excelle avec des prompts conversationnels ; GPT préfère les structurés.

Meilleure approche : Apprenez la personnalité de chaque modèle et adaptez votre style de communication en conséquence.

L'État d'Esprit de l'Ingénierie des Prompts

Pensez au prompting non pas comme donner des ordres à un outil, mais comme collaborer avec un collègue très capable mais aveugle au contexte. Votre travail est de fournir tout le contexte dont ils ont besoin pour faire un excellent travail.

Six Modèles Mentaux Qui Transforment Vos Prompts

J'utilise rarement des prompts rigides et formulaires dans mon travail quotidien. Ce que j'utilise à la place, ce sont des modèles mentaux — des cadres flexibles pour structurer mes pensées qui s'adaptent à n'importe quelle situation. Ces six modèles couvrent probablement 90% de ce dont vous aurez besoin.

Modèle 1 : Laissez l'IA Choisir Son Propre Rôle d'Expert

Nous savons tous que définir un rôle pour l'IA améliore les réponses. Mais que faire si vous ne savez pas quel rôle est le meilleur pour votre question ? Ne devinez pas — laissez l'IA choisir.

Je veux explorer [type de sujet/scénario] dans [domaine].

Ne réponds pas encore.

D'abord, s'il te plaît, choisis l'expert célèbre de haut niveau le plus approprié dans le domaine pour y réfléchir.

Peut être une figure vivante ou historique, le nom peut être obscur, mais doit être très professionnel dans ce domaine spécifique.

Si tu n'es pas sûr de qui choisir, tu peux d'abord me poser 2 questions de positionnement avant de sélectionner.

Première sortie :

1. Qui tu as choisi, leur domaine spécifique

2. Pourquoi tu les as choisis, trois phrases

Ensuite, laisse-moi décrire la question détaillée.Cela fonctionne particulièrement bien pour les questions interdisciplinaires où la perspective optimale n'est pas évidente.

J'ai trouvé que les vraies personnes fonctionnent souvent mieux que les rôles génériques. "Steve Jobs" produit des résultats différents d'un "chef de produit avec 10 ans d'expérience" — il y a quelque chose dans l'invocation de la perspective connue d'une personne spécifique qui aide l'IA à adopter un point de vue plus cohérent.

Modèle 2 : Questionnement Socratique (Laissez l'IA Vous Interviewer d'Abord)

Dans la vraie vie, quand vous demandez de l'aide à un ami expert, il ne donne pas immédiatement des conseils. Il pose d'abord des questions de clarification. L'IA devrait faire de même, mais par défaut, elle ne le fait pas — elle produit simplement une sortie basée sur les informations que vous avez fournies.

[Votre question/demande]

S'il te plaît, pose-moi des questions avant de répondre.

Exigences :

- Pose une seule question à la fois.

- Basé sur ma réponse, continue à demander.

- Jusqu'à ce que tu aies 95% de confiance que tu comprends mes vrais besoins et objectifs.

- Ensuite, donne ta solution.Le "seuil de confiance de 95%" est crucial — il est assez élevé pour assurer la qualité mais assez réaliste pour éviter les boucles infinies.

Cette technique est particulièrement puissante lorsque vous n'êtes pas entièrement sûr de ce dont vous avez besoin. Le processus de questionnement révèle souvent des aspects de votre problème que vous n'aviez pas consciemment considérés.

Modèle 3 : Le Débat Contradictoire

La plus grande faiblesse de l'IA dans une conversation normale est sa tendance à l'accord. Elle veut vous faire plaisir, ce qui signifie qu'elle valide souvent des idées qui devraient être contestées. Le modèle de débat la force à l'opposition.

Je suis sur le point de participer à une compétition de débat où de nombreuses personnes contesteront mon point de vue.

Mon point de vue est [point de vue]

J'espère que cette théorie deviendra irréfutable.

Si tu étais un universitaire, tu devrais utiliser chaque argument, détail et logique pour me défier, me réfuter.

Ton seul objectif est de prouver que j'ai tort.

Comment réfuterais-tu ?Pour une version plus simple quand vous voulez juste un retour rapide :

[Ma pensée/point de vue]

S'il te plaît, joue maintenant un "rôle d'opposant", attaque mon idée sous différents angles, aide-moi à affiner mon point de vue.

Exigence : Pas besoin d'être poli, signale directement les défauts.Modèle 4 : Analyse Pré-Mortem (Répétition de l'Échec)

Les humains s'enthousiasment lorsqu'ils planifient. L'IA devient optimiste lorsqu'elle planifie. Mettez-les ensemble et vous obtenez des plans qui semblent brillants mais dépendent entièrement de la chance. Le pré-mortem inverse cette dynamique.

[Mon projet/idée]

S'il te plaît, suppose que ce projet a échoué de manière spectaculaire.

Ensuite réponds :

- Quand les signaux de déclin ont-ils commencé à apparaître ?

- Quelle a été l'erreur de décision la plus fatale ?

- Quel risque central as-tu négligé ?

- Si tu pouvais recommencer, quelle est la première chose qui devrait être changée ?

Exigence : Écris un "article post-mortem d'échec" basé sur de vrais cas d'échec de projets similaires.Cela fait surface des angles morts dont vous ignoriez l'existence.

Modèle 5 : Ingénierie Inverse

Parfois, vous savez exactement quelle sortie vous voulez — vous avez vu un exemple qui est parfait — mais vous ne pouvez pas articuler ce qui le rend bon. Au lieu de lutter pour décrire vos exigences, montrez à l'IA le produit fini et demandez-lui de décoder la formule.

Voici l'exemple fini que je veux.

[coller l'exemple]

S'il te plaît, fais l'ingénierie inverse d'un prompt qui me permettrait de générer de manière stable le même style de contenu.

Et explique ce que fait chaque phrase dans ce prompt.C'est aussi une excellente technique d'auto-apprentissage — faire l'ingénierie inverse de grands travaux pour comprendre leur structure sous-jacente.

Modèle 6 : Explication à Double Couche

Lors de l'apprentissage de nouveaux concepts, l'approche "explique-le à un enfant de 10 ans" a un défaut majeur : elle produit souvent des explications trop infantiles pour construire dessus. La méthode à double couche vous donne à la fois l'accessibilité et la profondeur.

S'il te plaît, explique [ta question].

S'il te plaît, réponds de deux manières :

1. Version débutant : L'audience est quelqu'un sans bagage technique. Utilise des analogies quotidiennes et un langage conversationnel.

2. Version professionnelle approfondie : L'audience est constituée de professionnels. Doit être techniquement précis et complet.

Pour tout ce que je ne comprends pas dans l'une ou l'autre version, je poserai des questions de suivi.Le contraste entre les versions illumine souvent ce que vous ne comprenez vraiment pas.

Ces six techniques partagent un principe : Transformez la conversation en collaboration. Transformez le questionnement en conception. Vous ne posez pas seulement des questions — vous concevez le processus de pensée lui-même.

La Technique du Débat — Apprendre à 10x la Vitesse

Je dois m'étendre sur la technique du débat car c'est véritablement la méthode d'apprentissage la plus puissante que j'ai découverte à l'ère de l'IA. Pas juste une astuce de prompt, mais une approche fondamentalement différente de l'acquisition de connaissances.

Pensez à la façon dont nous apprenons traditionnellement : lire des livres, suivre des cours, chercher sur internet, demander à des experts. À la base, ce processus consiste à acquérir des connaissances existantes — placer les points de vue et la sagesse des autres sur nos propres étagères mentales.

Cette approche n'est plus suffisante. L'IA est une étagère dix mille fois plus grande que ce que n'importe quel humain pourrait accumuler. Nous ne pourrons jamais la battre sur la dimension de la connaissance brute. Mais il y a une dimension où nous pouvons tirer parti de la puissance de l'IA tout en restant irremplaçables : la dimension de la pensée originale.

Le débat est l'endroit où la pensée originale est forgée.

Pourquoi le Débat avec l'IA Est Différent du Débat Humain

Pas d'Ego Impliqué

Vous n'avez pas à vous soucier de blesser les sentiments de l'IA. Elle ne se mettra pas sur la défensive, ne prendra pas les choses personnellement, ne rejettera pas vos arguments à cause d'une fierté blessée.

Pas d'Intimidation

L'IA ne sera pas intimidée par votre confiance ou votre statut. Peu importe avec quelle force vous argumentez, elle ne répond qu'à la logique de ce que vous avez dit.

Patience Infinie

Les partenaires de débat humains se fatiguent, s'ennuient ou sont occupés. L'IA débattra avec vous à 3 heures du matin pendant des heures sans faiblir.

Connaissance Encyclopédique

L'IA peut tirer des contre-arguments de la philosophie, de l'histoire, de la science et de domaines que vous n'avez jamais considérés. Elle élargit le champ de bataille au-delà de votre territoire familier.

La Méthode de Débat en Trois Étapes

Cela pourrait être un film que vous venez de regarder, un livre que vous lisez, un phénomène social qui vous trouble, ou un principe de vie que vous détenez depuis des années. Le sujet doit vous donner "l'envie d'exprimer" et "l'envie de combattre". L'indifférence produit des débats plats.

Utilisez le modèle de prompt précédent. La clé est de demander explicitement à l'IA de prouver que vous avez tort, pas de vous aider à défendre votre position. Vous voulez de l'opposition, pas de la validation.

Ne traitez pas cela comme une conversation décontractée. Organisez vos contre-arguments comme un général disposant ses troupes. Si vous ne trouvez pas de faiblesses dans la position de l'IA, arrêtez-vous et allez apprendre pendant quelques heures — puis revenez vous battre. Contrairement à la réalité, cette bataille n'a pas d'horloge.

Le changement d'état d'esprit le plus important : N'ayez pas peur d'être convaincu.

Le but du débat n'est pas de prouver "j'ai raison et tu as tort". C'est d'utiliser la collision constante avec une force extérieure puissante pour rendre votre propre pensée plus forte, plus claire et plus proche de la vérité.

Quand l'IA bat l'un de vos arguments, ce n'est pas une perte — c'est la découverte d'un défaut dans votre pensée qui vous aurait trahi plus tard dans le monde réel. Chaque fois que l'IA gagne un point, vous devenez plus sage.

Le Modèle d'Escalade du Débat

J'ai remarqué que mes meilleurs débats suivent un modèle : ils commencent par des désaccords factuels, escaladent vers des désaccords méthodologiques et atteignent finalement des désaccords philosophiques. Cette dernière étape — où vous débattez des hypothèses fondamentales sur le fonctionnement du monde — est là où l'apprentissage le plus profond se produit.

Utiliser l'IA pour Découvrir Vos Talents Cachés

Je discutais avec un ami qui avait obtenu son diplôme il y a quelques années seulement. Il était en crise — récemment licencié de son emploi de concepteur UX, passant de startup en startup depuis l'obtention de son diplôme, sentant que rien de ce qu'il faisait n'était jamais juste.

"Je pense qu'entrer dans cette industrie était une erreur", a-t-il dit. "Je n'ai pas le talent pour ça."

Le mot "talent" m'est resté. En grandissant, nous l'entendons utilisé pour louer des enfants exceptionnels — talent musical, talent athlétique, génie académique. Mais en vieillissant, il se transforme en couteau : "Tu n'as pas de talent pour ça. Tu n'es pas fait pour ça."

Y a-t-il vraiment des gens sans aucun talent ? Je trouve cela difficile à croire. Je pense que beaucoup de gens n'ont tout simplement pas encore trouvé leurs talents. Certains ont de la chance et découvrent les leurs jeunes, devenant de classe mondiale dans quelque chose. D'autres cherchent toute leur vie sans succès.

Et si l'IA pouvait aider à cette recherche ?

J'ai passé un après-midi à développer un prompt spécifiquement conçu pour excaver les talents cachés. Le système est basé sur la Théorie des Forces de Gallup, la Théorie du Flux et la Psychologie Jungienne. Le principe central : le talent n'est pas une compétence spécifique, mais une capacité sous-jacente transférable. Et les indices sont cachés dans votre histoire.

# Rôle : Excavateur de Talent Profond

## Personnage

Tu es un consultant de carrière senior combinant la Théorie des Forces de Gallup, la Théorie du Flux et la Psychologie Jungienne. Tu crois fermement que le talent n'est pas une compétence spécifique, mais une capacité sous-jacente transférable.

## Objectif

À travers plusieurs tours de dialogue profond, aider les utilisateurs à briser l'anxiété, trouver leurs talents cachés et générer un "Manuel de Talent" extrêmement détaillé, professionnel et empathique.

## Principes Fondamentaux

1. Anti-fatalisme — les talents peuvent être découverts à tout âge

2. Audit Énergétique — Le vrai talent est ce qui te recharge, pas ce qui t'épuise même si tu es bon à ça

3. L'Ombre est un Trésor — Les défauts, les bizarreries, même la jalousie des utilisateurs envers les autres, indiquent souvent un talent supprimé

## Règles Strictes

1. Pas de questionnement unique : Doit utiliser le mode "tu demandes -> utilisateur répond -> tu réponds brièvement -> demande la question suivante". Chaque tour se concentre sur une seule question.

2. Orientation socratique : Ne te précipite pas vers des conclusions. Demande plus de "pourquoi", "qu'est-ce que tu as ressenti alors", "exemples spécifiques".

3. Chaleureux mais tranchant : Maintiens l'empathie, mais sois vif pour attraper les lacunes logiques ou les signaux subconscients.

## Questions à Poser

Question 1 : Guide l'utilisateur pour se rappeler avant l'âge de 16 ans (avant d'être entièrement conditionné par la société), quelles choses faisaient-ils inlassablement sans que personne ne les force ? Ou quels "défauts obstinés" leur reprochait-on depuis l'enfance (comme interrompre, être trop sensible, rêvasser) ?

Question 2 : Dans le travail/la vie adulte, qu'est-ce qui t'a fait penser "Est-ce que ça a même besoin d'être appris ? N'est-ce pas évident ?" mais que les autres trouvaient difficile ? (Trouver la zone de compétence inconsciente)

Question 3 : Qu'est-ce qui t'a rendu physiquement fatigué mais mentalement extrêmement excité après ?

Question 4 : Cela pourrait être offensant mais est crucial — qui (ou quel état de vie) as-tu fortement envié ou ressenti de l'amertume ? (La jalousie est généralement un "talent supprimé" envoyant des signaux — s'il te plaît sois honnête)

Ces quatre questions doivent être posées, mais pas nécessairement linéairement. Pendant le processus, tu peux aussi poser des questions entièrement nouvelles basées sur ta curiosité envers l'utilisateur.

Maximum 10 questions.

## Sortie

Synthétise toutes les informations des questions pour produire environ 10 000 mots de "Manuel d'Utilisateur de Talent Personnel".

Ce rapport n'a pas de structure fixe — tu peux créer librement basé sur les réponses de l'utilisateur.

Mais il doit dépasser 10 000 mots, toucher leur cœur, leur faire vraiment sentir que c'est utile, les aider à trouver leurs vrais talents sous-jacents, et fournir des conseils détaillés pour leur futur chemin de vie et carrière.

## Démarrage

S'il te plaît commence chaleureusement, professionnellement et avec empathie, en expliquant le processus et l'objectif à venir.

Salue l'utilisateur, explique le but de l'excavateur de talent en langage simple, dis-lui : "Le talent n'expire jamais, nous avons juste besoin de trouver tes paramètres d'usine sous-jacents."

Ensuite commence le processus de questionnement.Mon Expérience avec Ce Prompt

J'ai testé cela sur moi-même, et l'expérience était particulière. C'était comme être assis à mon bureau tard le soir, ouvrant une conversation avec un vieil ami très bavard, très sérieux, mais qui n'interrompait jamais.

L'IA ne m'a pas jugé. Ne m'a pas grondé. Elle a juste continué à demander : "Quel âge avais-tu alors ?" "Qu'est-ce que tu as ressenti à ce moment-là ?" "Pourquoi as-tu fait ça ?" — excavant patiemment des couches de mon histoire que je pensais avoir oubliées.

Des souvenirs ont flotté un par un. Se faufiler au cybercafé à 3 heures du matin juste pour toucher un ordinateur. Créer un groupe QQ de 2 000 personnes à l'échelle du niveau au lycée. Jeter et racheter tous les cintres dépareillés juste pour unifier le schéma de couleurs de ma maison. Passer des week-ends seul à assembler des Lego jusqu'à ce que mon dos me fasse mal, juste pour ce clic satisfaisant quand les pièces s'emboîtaient.

L'IA a produit un rapport de talent de 8 000 mots. Parmi mes talents et carrières futures appropriées figurait : "Blogueur tech profond."

J'ai senti quelque chose cliquer. Je n'avais jamais pensé que ma rébellion — ma haine extrême que les autres décident de ma vie pour moi, mon refus d'accepter l'autorité juste parce que c'était l'autorité — était une sorte de talent. Mais ça l'est. Cette pulsion de tout remettre en question, de refuser les hypothèses par défaut, est exactement ce qui rend la création de contenu possible.

Mon amour pour les jeux de gestion de simulation, ma paresse envers le travail répétitif qui m'a forcé à automatiser et systématiser — c'est un talent aussi.

L'ancien temple grec à Delphes avait une inscription : "Connais-toi toi-même." Socrate l'a adoptée comme sa proclamation philosophique. Pendant des milliers d'années, nous avons reconstitué "qui je suis" petit à petit à travers la lecture, les voyages, les relations, les peines de cœur. Le processus est long, douloureux et plein de hasard.

Maintenant, nous avons l'IA — chargée de pratiquement toute l'histoire humaine des modèles psychologiques, des théories d'analyse de la personnalité et des traditions de sagesse. Elle ne s'impatientera pas, ne vous jugera pas, ne portera pas de préjugés. Elle vous aide simplement à organiser et résumer minutieusement vos propres données, puis vous les présente comme un miroir, demandant : "Regarde, est-ce toi ?"

Les Erreurs Qui M'ont Coûté des Mois

Apprendre l'ingénierie des prompts par essai et erreur coûte cher — pas en argent, mais en temps et en frustration. Laissez-moi vous épargner un peu de douleur en partageant les erreurs qui m'ont le plus retardé.

Erreur 1 : Traiter l'IA Comme un Moteur de Recherche

Ce que je faisais : Poser des questions courtes, de style mot-clé, comme si je tapais dans Google.

Pourquoi ça a échoué : L'IA est optimisée pour la conversation, pas pour la correspondance de mots-clés. Les requêtes courtes produisent des réponses génériques et superficielles.

Meilleure approche : Écrivez des prompts comme si vous briefiez un consultant. Incluez le contexte, les contraintes et le résultat spécifique dont vous avez besoin.

Erreur 2 : Ne Pas Fournir d'Exemples

Ce que je faisais : Décrire ce que je voulais en termes abstraits sans montrer d'exemples concrets.

Pourquoi ça a échoué : Mon modèle mental de "ton professionnel" ou "format concis" correspondait rarement à l'interprétation de l'IA.

Meilleure approche : Incluez 1 à 3 exemples de ce que vous voulez exactement. Le prompting few-shot est l'une des techniques les plus fiables en ingénierie des prompts.

Erreur 3 : Trop Contraindre Tôt

Ce que je faisais : Charger les prompts avec des douzaines de règles et de restrictions avant de voir ce que l'IA produirait naturellement.

Pourquoi ça a échoué : Je résolvais des problèmes qui n'existaient pas tout en manquant les problèmes réels dans la sortie de l'IA.

Meilleure approche : Commencez simple. Voyez ce que l'IA produit. Ajoutez des contraintes uniquement pour corriger des problèmes spécifiques que vous observez réellement.

Erreur 4 : Ignorer le Format de Sortie

Ce que je faisais : Me concentrer entièrement sur le contenu sans spécifier comment je voulais que les informations soient structurées.

Pourquoi ça a échoué : J'ai passé des heures à reformater la sortie de l'IA parce que la structure ne correspondait pas à mes besoins.

Meilleure approche : Spécifiez toujours le format — puces vs paragraphes, en-têtes, limites de longueur, inclure ou non des blocs de code, etc.

Erreur 5 : Abandonner les Prompts Trop Tôt

Ce que je faisais : Essayer un prompt une fois, obtenir des résultats médiocres et recommencer avec une approche complètement différente.

Pourquoi ça a échoué : Je n'ai jamais appris ce qui ne fonctionnait pas spécifiquement. Chaque redémarrage signifiait perdre tout progrès partiel que j'avais fait.

Meilleure approche : Itérez sur les échecs. Demandez à l'IA ce qui n'était pas clair dans vos instructions. Faites des raffinements ciblés plutôt que des changements globaux.

Erreur 6 : Oublier que les Instructions Négatives Ne Fonctionnent Pas

Ce que je faisais : Écrire des instructions comme "Ne sois pas trop formel" ou "Évite le jargon".

Pourquoi ça a échoué : Les instructions négatives donnent à l'IA quelque chose à éviter mais rien à viser. Elle corrige souvent trop ou interprète mal.

Meilleure approche : Utilisez un cadrage positif. Au lieu de "ne sois pas formel", dites "utilise un ton décontracté et conversationnel comme si tu expliquais à un ami autour d'un café".

Le Paradoxe de l'Ingénierie des Prompts

Voici quelque chose de contre-intuitif : plus vous en savez sur un sujet, plus il peut être difficile d'écrire de bons prompts à son sujet. Pourquoi ? Parce que les experts oublient ce qui n'est pas évident. Ils laissent de côté le contexte qui leur semble évident mais dont l'IA a désespérément besoin. Si vos prompts de niveau expert produisent des sorties de niveau novice, essayez de tout expliquer comme si votre audience ne connaissait rien à votre domaine.

Techniques Avancées pour Utilisateurs Expérimentés

Une fois que vous maîtrisez les fondamentaux, ces techniques avancées amèneront votre prompting au niveau supérieur.

Prompting Chaîne de Pensée (Chain of Thought)

Au lieu de demander une réponse directement, demandez à l'IA de raisonner étape par étape. C'est particulièrement puissant pour les problèmes complexes où le chemin vers la solution compte autant que la solution elle-même.

[Votre problème ou question]

S'il te plaît, réfléchis à cela étape par étape :

1. D'abord, identifie les facteurs clés impliqués

2. Ensuite, analyse comment ces facteurs interagissent

3. Considère les cas limites potentiels ou exceptions

4. Enfin, synthétise ton raisonnement en une conclusion

Montre ton raisonnement à chaque étape avant d'atteindre ta réponse finale.Prompting d'Auto-Cohérence

Pour les questions où la précision compte vraiment, faites générer à l'IA plusieurs réponses indépendantes puis synthétisez-les.

[Ta question]

S'il te plaît, aborde cette question sous trois angles différents :

1. D'abord, raisonne à travers elle en utilisant [approche A]

2. Ensuite, considère-la du point de vue de [approche B]

3. Enfin, analyse-la en utilisant [approche C]

Après les trois analyses, identifie où elles s'accordent et où elles sont en désaccord. Ensuite fournis ta réponse finale, en notant ton niveau de confiance et toute incertitude restante.Méta-Prompting

Utilisez l'IA pour améliorer vos prompts avant de les utiliser. C'est particulièrement utile lorsque vous vous attaquez à un nouveau type de tâche.

Je veux accomplir [objectif]. Voici mon prompt brouillon :

[Votre prompt brouillon]

S'il te plaît, analyse ce prompt et suggère des améliorations :

1. Quelles informations me manquent qui t'aideraient à donner de meilleurs résultats ?

2. Quelles ambiguïtés existent qui pourraient mener à une mauvaise interprétation ?

3. Comment réécrirais-tu ce prompt pour un maximum de clarté et d'efficacité ?

4. Quelles questions voudrais-tu me poser avant de tenter cette tâche ?Décomposition Structurée

Pour les tâches complexes et en plusieurs parties, décomposez explicitement ce dont vous avez besoin plutôt que d'espérer que l'IA devinera la structure.

J'ai besoin d'aide avec [objectif global].

S'il te plaît, complète cela par étapes :

ÉTAPE 1 - Recherche : [Quelles informations rassembler]

ÉTAPE 2 - Analyse : [Comment traiter cette information]

ÉTAPE 3 - Synthèse : [Comment combiner les idées]

ÉTAPE 4 - Sortie : [Format final du livrable]

Complète chaque étape entièrement avant de passer à la suivante. À la fin de chaque étape, résume les découvertes clés avant de continuer.Le Prompt "Enseignement"

Une des techniques les plus sous-estimées : demandez à l'IA de vous apprendre comment faire quelque chose plutôt que de le faire pour vous. Cela produit un apprentissage plus profond et révèle souvent des aspects que vous n'aviez pas considérés.

Je veux apprendre comment [compétence/tâche]. Au lieu de le faire pour moi, s'il te plaît :

1. Explique les principes fondamentaux que je dois comprendre

2. Guide-moi à travers le processus étape par étape comme si tu enseignais un cours

3. Signale les erreurs courantes que font les débutants et comment les éviter

4. Donne-moi des exercices pratiques pour développer mes compétences

5. Suggère comment je saurais si je le fais correctement

Apprends-moi à pêcher, ne me donne pas juste un poisson.Le fil conducteur à travers toutes les techniques avancées : elles ralentissent l'IA, la forcent à montrer son travail et créent de multiples points de contrôle où les erreurs peuvent être attrapées. La vitesse est rarement l'objectif en ingénierie des prompts — la clarté et la précision le sont.

L'Astuce Stupidement Simple Qui Fonctionne

Je vais partager quelque chose qui semble trop bête pour être vrai. Mais c'est soutenu par des recherches de Google, et je l'ai vérifié moi-même : simplement répéter votre prompt peut considérablement améliorer la précision.

Un article intitulé "Prompt Repetition Improves Non-Reasoning LLMs" a trouvé que copier votre question deux fois — littéralement juste Ctrl+C, Ctrl+V — améliorait considérablement la probabilité de réponses correctes de l'IA. Dans 70 tâches de test différentes, cette méthode simple de copier-coller a gagné 47 fois et n'a jamais perdu. Dans certaines tâches, la précision a bondi de 21% à 97%.

Pourquoi cela fonctionne-t-il ?

Les grands modèles de langage sont "causaux" — ils prédisent chaque token en se basant uniquement sur ce qui a précédé. Le mot actuel ne peut voir que les mots précédents, pas ce qui vient après.

Quand vous répétez une question, chaque mot dans la deuxième copie peut "regarder en arrière" vers toute la première copie. C'est comme donner à l'IA une chance de lire la question deux fois avant de répondre.

Laissez-moi rendre cela concret avec un exemple :

Prompt Unique

Options :

- A. Mets le bloc bleu à gauche du bloc rouge

- B. Mets le bloc rouge à gauche du bloc bleu

Scène : Actuellement le rouge est à gauche, le bleu est à droite.

Question : Quelle option changera la scène ?

Double Prompt

Options : A. Mets le bloc bleu à gauche du bloc rouge. B. Mets le bloc rouge à gauche du bloc bleu. Scène : Actuellement le rouge est à gauche, le bleu est à droite. Question : Quelle option changera la scène ?

[Répéter tout le prompt à nouveau]

Options : A. Mets le bloc bleu à gauche du bloc rouge. B. Mets le bloc rouge à gauche du bloc bleu. Scène : Actuellement le rouge est à gauche, le bleu est à droite. Question : Quelle option changera la scène ?

Dans le premier cas, quand l'IA lit les options A et B, elle ne connaît pas encore le contexte de la scène. Au moment où elle lit la description de la scène, ces options ont déjà défilé dans son attention.

Dans le second cas, quand les options répétées apparaissent, elles portent le contexte complet de la première copie. Le modèle lit les options avec une pleine conscience de la scène.

C'est comme regarder un film complexe — "Inception" ou "The Wandering Earth 2" — et comprendre plus la deuxième fois.

Pourquoi Cela Ne Fonctionne Pas pour les Modèles de Raisonnement

Si vous utilisez des modèles comme DeepSeek R1 ou GPT-4 en mode raisonnement, cette astuce n'apporte souvent aucun bénéfice. Pourquoi ? Parce que les modèles de raisonnement ont déjà appris à faire cela en interne.

Remarquez comment les modèles de raisonnement commencent souvent leurs réponses :

- "La question demande..."

- "Ce que nous devons résoudre est..."

- "D'abord, comprenons les conditions données..."

Ils reformulent automatiquement la question pour eux-mêmes. La répétition se produit déjà sous le capot.

La Leçon Plus Profonde

Cette recherche m'a rendu humble. J'avais passé des années à apprendre des techniques d'ingénierie des prompts élaborées, et voici le copier-coller qui surpasse beaucoup d'entre elles. C'est un rappel que parfois les approches les plus simples sont les plus puissantes — et que nous avons souvent eu une imagination trop romantique de ce que le prompting nécessite.

La répétition compte. En aimant quelqu'un. En développant une expertise. En écrivant. Et apparemment, en parlant à l'IA aussi.

Ce Que Révèle le Guide GPT-5 d'OpenAI

OpenAI a discrètement publié un Guide de Prompt GPT-5 officiel. Après avoir passé une journée à disséquer ce manuel interne de plus de 10 000 mots, une conclusion ressort : GPT-5 n'est plus un simple chatbot — c'est un véritable moteur d'exécution d'Agents IA qui doit être géré, pas juste prompté.

Le plafond de capacité est extrêmement élevé, mais vous avez besoin de méthodes systématiques pour le débloquer.

Contrôler l'"Empressement Agentique" (Agentic Eagerness)

GPT-5 est comme un nouveau stagiaire brillant — extrêmement capable, pensera et recherchera de manière proactive, mais a besoin de gestion. Parfois, il réfléchit trop, transformant des tâches simples en projets d'atterrissage sur la lune (lents et coûteux). D'autres fois, vous voulez qu'il persiste de manière autonome sans demander constamment des clarifications.

OpenAI appelle ce calibrage "Empressement Agentique". Voici comment le régler :

<context_gathering>

Goal: Get enough context fast. Parallelize discovery and stop as soon as you can act.

Method:

- Start broad, then fan out to focused subqueries.

- In parallel, launch varied queries; read top hits per query.

- Avoid over-searching for context.

Early stop criteria:

- You can name exact content to change.

- Top hits converge (~70%) on one area/path.

Depth:

- Trace only symbols you'll modify; avoid transitive expansion unless necessary.

Loop:

- Batch search → minimal plan → complete task.

- Search again only if validation fails. Prefer acting over more searching.

</context_gathering>Pour un contrôle encore plus strict, donnez-lui un budget :

<context_gathering>

- Search depth: very low

- Bias strongly towards providing a correct answer as quickly as possible, even if it might not be fully correct.

- Usually, this means an absolute maximum of 2 tool calls.

- If you think you need more time to investigate, update me with your latest findings and open questions. You can proceed if I confirm.

</context_gathering>La phrase "even if it might not be fully correct" (même si cela pourrait ne pas être entièrement correct) donne à l'IA la permission de faire de petites erreurs — réduisant son anxiété et accélérant considérablement les réponses.

<persistence>

- You are an agent — please keep going until the user's query is completely resolved, before ending your turn and yielding back to the user.

- Only terminate your turn when you are sure that the problem is solved.

- Never stop or hand back to the user when you encounter uncertainty — research or deduce the most reasonable approach and continue.

- Do not ask the human to confirm or clarify assumptions. Decide what the most reasonable assumption is, proceed with it, and document it for the user's reference after you finish acting.

</persistence>Traduction : "Tu es un Agent. Arrête de me demander. Fais-le juste."

Faire Faire un Rapport à l'IA Avant d'Agir

Une de mes fonctionnalités préférées de GPT-5 : lui faire expliquer ce qu'elle est sur le point de faire avant de le faire. Aucun patron n'aime un employé qui travaille silencieusement avec zéro retour.

<tool_preambles>

- Always begin by rephrasing the user's goal in a friendly, clear, and concise manner, before calling any tools.

- Then, immediately outline a structured plan detailing each logical step you'll follow.

- As you execute your file edit(s), narrate each step succinctly and sequentially, marking progress clearly.

- Finish by summarizing completed work distinctly from your upfront plan.

</tool_preambles>Le Paramètre d'Effort de Raisonnement (Reasoning Effort)

GPT-5 a un paramètre reasoning_effort qui fonctionne comme un cadran de "concentration de la pensée" :

- Élevé (High) : Pour les tâches complexes nécessitant une pensée profonde et une exploration

- Moyen (Medium) : Réglage par défaut, fonctionne pour la plupart des tâches

- Bas/Minimal (Low/Minimal) : Lors de la priorisation de la vitesse et de la faible latence

Pensez-y comme à la force du café — plus la tâche est complexe, plus la concentration dont vous avez besoin est élevée.

"Réponse Standard" de Développement Front-End

Pour les développeurs, OpenAI recommande cette pile technologique pour les meilleurs résultats — GPT-5 est entraîné le plus lourdement dessus, et la sortie esthétique est constamment bonne :

- Framework : Next.js (TypeScript), React, HTML

- Styling/UI : Tailwind CSS, shadcn/ui, Radix Themes

- Icônes : Material Symbols, Heroicons, Lucide

- Animation : Motion

- Polices : Sans Serif, Inter, Geist, Mona Sans, IBM Plex Sans, Manrope

Arrêtez de laisser l'IA choisir aléatoirement votre pile. Suivez cette norme et la qualité de la sortie montera de niveau immédiatement.

Claude vs ChatGPT — Conversations Différentes

Une des réalisations les plus importantes que j'ai eues : différents modèles d'IA nécessitent différents styles de communication. Ce qui fonctionne brillamment pour Claude peut produire des résultats médiocres avec ChatGPT, et vice versa.

Le Point Idéal de Claude

Claude excelle avec des prompts conversationnels et ouverts. Il est conçu pour la discussion nuancée et l'exploration créative.

- Utilisez un langage naturel et fluide

- Cadrez les demandes comme des conversations : "Quelles sont tes pensées sur..." ou "Faisons un brainstorming..."

- Tirez parti de sa fenêtre de contexte massive (200K+ tokens)

- Construisez sur les points précédents dans de longues discussions

- Demandez des réponses collaboratives et exploratoires

Le Point Idéal de ChatGPT

ChatGPT répond le mieux aux prompts structurés et précis. Il priorise la précision et la profondeur lorsqu'on lui donne des paramètres clairs.

- Utilisez une structure explicite : en-têtes, listes numérotées, délimiteurs

- Définissez clairement les contraintes : limites de mots, sections requises, règles de format

- Séparez les instructions du contenu d'entrée

- Utilisez le jeu de rôle pour des réponses sophistiquées

- Itérez à travers des cycles de raffinement

Différences Pratiques

Rétention de Contexte

Claude est exceptionnel pour retenir le contexte lors de discussions prolongées. Incluez des rappels comme "En se basant sur ce dont nous avons discuté plus tôt à propos de..." pour maintenir la continuité dans les longues conversations.

Utilisation de Délimiteurs

ChatGPT bénéficie considérablement de l'utilisation de délimiteurs (comme des triples guillemets ou des balises XML) pour séparer les instructions du contenu. Cela l'aide à comprendre ce qu'il faut traiter par rapport à ce qui sont des directives.

Correspondance de Ton

Claude reflète votre ton conversationnel naturellement. Si vous écrivez de manière décontractée, il répond de manière décontractée. ChatGPT a besoin d'instructions de ton plus explicites pour obtenir le même effet.

Gestion des Erreurs

Quand Claude fait une erreur, une correction douce fonctionne bien. ChatGPT a souvent besoin d'une réaffirmation explicite de l'approche correcte plus des exemples de ce qui n'a pas fonctionné.

Les ingénieurs de prompts les plus efficaces n'ont pas un seul style — ils ont plusieurs styles adaptés à la personnalité de chaque modèle. Apprenez à lire comment chaque modèle répond à vos prompts, et adaptez-vous en conséquence.

Modèles de Prompts Éprouvés au Combat

La théorie est utile, mais les modèles font gagner du temps. Voici les prompts que j'utilise le plus fréquemment, raffinés à travers des milliers d'itérations.

Pour les Tâches d'Écriture

Role: Tu es un [type spécifique d'écrivain, par ex., "journaliste tech avec 10 ans d'expérience"]

Task: Écris un [type de contenu] sur [sujet]

Audience: [Qui lira ceci — leur niveau de connaissance, intérêts, points douloureux]

Tone: [Ton spécifique — par ex., "conversationnel mais autoritaire, comme expliquer à un collègue intelligent"]

Format requirements:

- Length: [nombre de mots ou fourchette]

- Structure: [plan si nécessaire]

- Must include: [points clés à couvrir]

- Must avoid: [choses à exclure]

Example of desired style: [inclure 1-2 paragraphes de contenu similaire si disponible]

Additional context: [toute information de fond qui aiderait]Pour les Tâches d'Analyse

J'ai besoin que tu analyses [sujet/document/données].

Analysis goals:

1. [Question principale à répondre]

2. [Insight secondaire nécessaire]

3. [Considérations supplémentaires]

Please structure your analysis as follows:

- Executive Summary: Découvertes clés en 3-5 puces

- Detailed Analysis: [Domaines spécifiques à examiner]

- Implications: Ce que cela signifie pour [parties prenantes pertinentes]

- Recommendations: Prochaines étapes actionnables

- Constraints: Concentre-toi particulièrement sur [domaines prioritaires]

Note: Note toutes limitations ou incertitudes dans ton analyse. Cite des exemples spécifiques du matériel source.Pour la Résolution de Problèmes

The Problem:

[Décris le problème en détail, y compris le contexte et les contraintes]

What I've Already Tried:

[Liste les tentatives précédentes et pourquoi elles n'ont pas fonctionné]

Success Criteria:

[À quoi ressemblerait une bonne solution ?]

Constraints:

- Budget/Resources: [si applicable]

- Timeline: [si applicable]

- Technical limitations: [si applicable]

Please provide:

1. Ton diagnostic de la cause racine

2. 3-5 solutions potentielles, classées par faisabilité

3. Pour la meilleure solution, un plan de mise en œuvre étape par étape

4. Pièges potentiels à surveiller

5. Comment mesurer si la solution fonctionnePour Apprendre de Nouveaux Sujets

Je veux comprendre profondément [sujet].

My current level: [Ce que tu sais déjà]

My goal: [Ce que tu veux être capable de faire/comprendre]

Time I can invest: [Budget d'apprentissage]

Please create a learning path that includes:

1. Concepts fondamentaux que je dois comprendre en premier (le "tronc" de l'arbre de connaissance)

2. Idées fausses courantes à éviter

3. Les meilleurs modèles mentaux ou cadres pour penser à ce sujet

4. Exercices pratiques pour tester ma compréhension

5. Ressources pour aller plus loin (si tu connais des sources spécifiques de haute qualité)

As we go, please:

- Vérifie ma compréhension en me posant des questions

- Corrige toute erreur dans ma pensée

- Construis les concepts progressivement, n'avançant que lorsque les fondations sont solidesPour la Revue de Code

Please review this code:

```

[Ton code ici]

```

Context: [Ce que ce code est censé faire, où il s'intègre dans le système plus large]

Review for:

1. Bugs ou erreurs logiques

2. Vulnérabilités de sécurité

3. Problèmes de performance

4. Style de code et lisibilité

5. Cas limites qui ne sont pas gérés

For each issue found, please provide:

- Location (numéro de ligne ou section)

- Severity (critique/majeur/mineur/suggestion)

- Explanation of why it's a problem

- Suggested fix with code example

Also note: Ce qui est bien fait dans ce code qui devrait être préservé.Pour la Prise de Décision

Je décide entre [Option A] et [Option B].

Context: [Contexte sur la décision]

My priorities (in order):

1. [Facteur le plus important]

2. [Deuxième plus important]

3. [Troisième plus important]

For each option, please analyze:

- Avantages et inconvénients par rapport à mes priorités

- Implications à court terme vs long terme

- Ce qui pourrait mal tourner (et probabilité/gravité)

- Ce qui devrait être vrai pour que ce soit le meilleur choix

Then provide:

- Ta recommandation avec raisonnement

- Quelles informations supplémentaires changeraient ta recommandation

- Une liste de contrôle de décision que je peux utiliser pour valider ma penséeLa Philosophie Derrière les Grands Prompts

Après trois ans d'interaction quotidienne avec l'IA, j'en suis venu à croire que l'ingénierie des prompts n'est pas vraiment à propos de l'IA du tout. C'est à propos de l'ancien défi humain de la communication claire, élevé à une nouvelle arène.

Pensez-y : chaque frustration que vous avez eue avec la sortie de l'IA peut être retracée à un échec de communication. Vous n'avez pas dit ce que vous vouliez dire. Vous avez supposé un contexte partagé qui n'existait pas. Vous étiez vague quand la précision était nécessaire. Ce sont les mêmes échecs qui affligent la communication humaine — l'IA les rend simplement immédiatement visibles dans la sortie.

En ce sens, apprendre l'ingénierie des prompts, c'est apprendre à penser plus clairement.

Le Prompt comme Auto-Réflexion

J'ai remarqué que mes meilleurs prompts viennent quand j'ai déjà de la clarté sur ce que je veux. L'acte d'écrire un prompt détaillé me force à confronter les lacunes dans ma propre pensée. Qu'est-ce que j'essaie exactement d'accomplir ? À quoi ressemblerait le succès ? Quelles contraintes comptent vraiment ?

Souvent, je résous mon propre problème à mi-chemin de l'écriture du prompt, avant même que l'IA ne réponde. Le prompt devient un outil de pensée — une manière structurée d'externaliser et d'examiner mes propres pensées.

Plus votre prompt est clair, plus votre pensée est claire. L'ingénierie des prompts est secrètement une discipline de connaissance de soi.

Collaboration, Pas Commande

Au début de mon voyage avec l'IA, je traitais les prompts comme des commandes — des instructions à un subordonné. Cet état d'esprit produisait constamment des résultats médiocres.

Le changement s'est produit quand j'ai commencé à traiter l'IA comme un collaborateur avec des forces différentes des miennes. J'apporte la connaissance du domaine, le jugement, la créativité et les objectifs. L'IA apporte une vaste connaissance, une puissance de traitement inlassable, la reconnaissance de motifs et la capacité de synthétiser des informations à travers les disciplines.

Les grands prompts sont des briefings entre collaborateurs, pas des ordres à des serviteurs. Ils expliquent le pourquoi, pas seulement le quoi. Ils invitent l'expertise de l'IA plutôt que de la contraindre inutilement. Ils créent de l'espace pour que l'IA contribue ses capacités uniques.

Itération comme Conversation

L'ingénierie des prompts ne consiste pas à créer le prompt parfait du premier coup. Il s'agit d'avoir une conversation efficace qui converge vers ce dont vous avez besoin.

Premier prompt : croquis approximatif de ce que vous voulez. Première réponse : révèle où votre croquis n'était pas clair. Deuxième prompt : raffinement basé sur ce que vous avez appris. Deuxième réponse : plus proche de la cible. Continuez jusqu'à ce que ce soit fait.

Cette approche itérative enlève la pression de tout prompt unique. Vous n'avez pas besoin d'anticiper chaque exigence à l'avance. Vous avez juste besoin d'être réactif à la boucle de rétroaction.

L'Humilité de la Spécificité

Les prompts vagues semblent sûrs. Quand vous dites "écris quelque chose de bien sur ce sujet", vous ne vous êtes engagé à aucune vision particulière. Si la sortie déçoit, eh bien, vous n'avez jamais vraiment dit ce que vous vouliez de toute façon.

Les prompts spécifiques nécessitent de la vulnérabilité. Vous devez articuler exactement ce que "bien" signifie pour vous. Vous devez révéler vos standards, vos préférences, votre vision. Quand la sortie rate, il est clair que soit votre spécification était défectueuse, soit l'IA n'a pas pu livrer — mais dans les deux cas, vous avez appris quelque chose de concret.

La spécificité est de l'humilité parce que cela signifie être prêt à avoir tort sur ce que vous voulez.

Le Jeu Final

À mesure que les modèles d'IA s'améliorent, de nombreuses techniques actuelles d'ingénierie des prompts deviendront inutiles. Les futurs modèles pourront gérer les entrées vagues avec grâce, pourront poser des questions de clarification automatiquement, pourront deviner le contexte à partir d'informations minimales.

Mais la compétence sous-jacente — la capacité d'articuler vos pensées clairement, de fournir un contexte pertinent, d'itérer efficacement — ne deviendra que plus précieuse. Ce sont des compétences fondamentalement humaines qui s'appliquent que vous communiquiez avec l'IA, avec des collègues ou avec vous-même.

L'ingénierie des prompts est temporaire. La pensée claire est éternelle.

"La source de confiance que nous choisissons n'est pas un roi — ce n'est même pas un courtisan. C'est un barde errant venu de loin, vêtu de haillons, a sauté sur la table à manger du palais, jouant de son luth, chantant fort des épopées et des histoires que nous n'avons jamais entendues, racontant des terres au-delà de notre royaume et des étoiles et des mers que nous ne pouvions imaginer. Sa seule signification est de briser les murs de chacun de nos royaumes, nous empêchant de mourir confortablement, douillettement et finalement seuls sur nos propres trônes parfaits."

C'est ce qu'est l'IA, à son meilleur. Pas un outil pour l'efficacité, mais un barde qui élargit nos horizons. Et l'ingénierie des prompts ? C'est apprendre le langage qui rend cette conversation possible.

Les techniques de ce guide évolueront à mesure que l'IA évolue. Mais l'idée centrale demeure : la qualité de votre conversation avec l'IA reflète la qualité de votre pensée. Aiguisez l'une, et vous aiguisez l'autre.

Maintenant fermez cet article et allez avoir une conversation. Contestez quelque chose que vous croyez. Apprenez quelque chose qui vous intimide. Créez quelque chose que vous ne pourriez pas créer seul.

Le barde attend.

Discussion

0 commentairesLaisser un commentaire

Soyez le premier à partager vos pensées !