L'IA non legge la tua mente. Legge le tue parole. La qualità del tuo prompt determina la qualità del tuo output.

Due anni fa, ho scritto il mio primo prompt su ChatGPT e ho pensato di capire l'intelligenza artificiale. Mi sbagliavo. Quello che capivo era come fare domande—non come comunicare con una macchina che pensa in pattern, probabilità e token. La differenza tra queste due cose? È la differenza tra ottenere risposte generiche e sbloccare capacità che non sapevi nemmeno esistessero. Questa è la storia di come ho imparato a parlare fluentemente IA, e tutto ciò che ho scoperto lungo il percorso.

Il Risveglio: Quando i Prompt Semplici Hanno Smesso di Funzionare

È successo durante una scadenza di progetto. Avevo bisogno che l'IA mi aiutasse a refactorizzare del codice complesso—qualcosa che avevo fatto centinaia di volte prima. Ma questa volta, non importava come formulassi la mia richiesta, l'IA continuava a darmi soluzioni tecnicamente corrette ma che mancavano completamente il punto. Aggiungeva complessità non necessaria. Rompeva pattern esistenti. "Migliorava" cose che non erano rotte.

Ero frustrato. Poi sono diventato curioso. Cosa stavo facendo di sbagliato?

Quella frustrazione mi ha portato su un percorso che ha cambiato tutto: documentazione ufficiale, paper di ricerca, guide di prompt engineering, e migliaia di ore di sperimentazione. Quello che ho scoperto non erano solo trucchi e suggerimenti—era un cambio completo di paradigma nel modo in cui comunico con i sistemi IA.

L'IA più potente del mondo è inutile se non riesci a comunicare ciò di cui hai realmente bisogno.

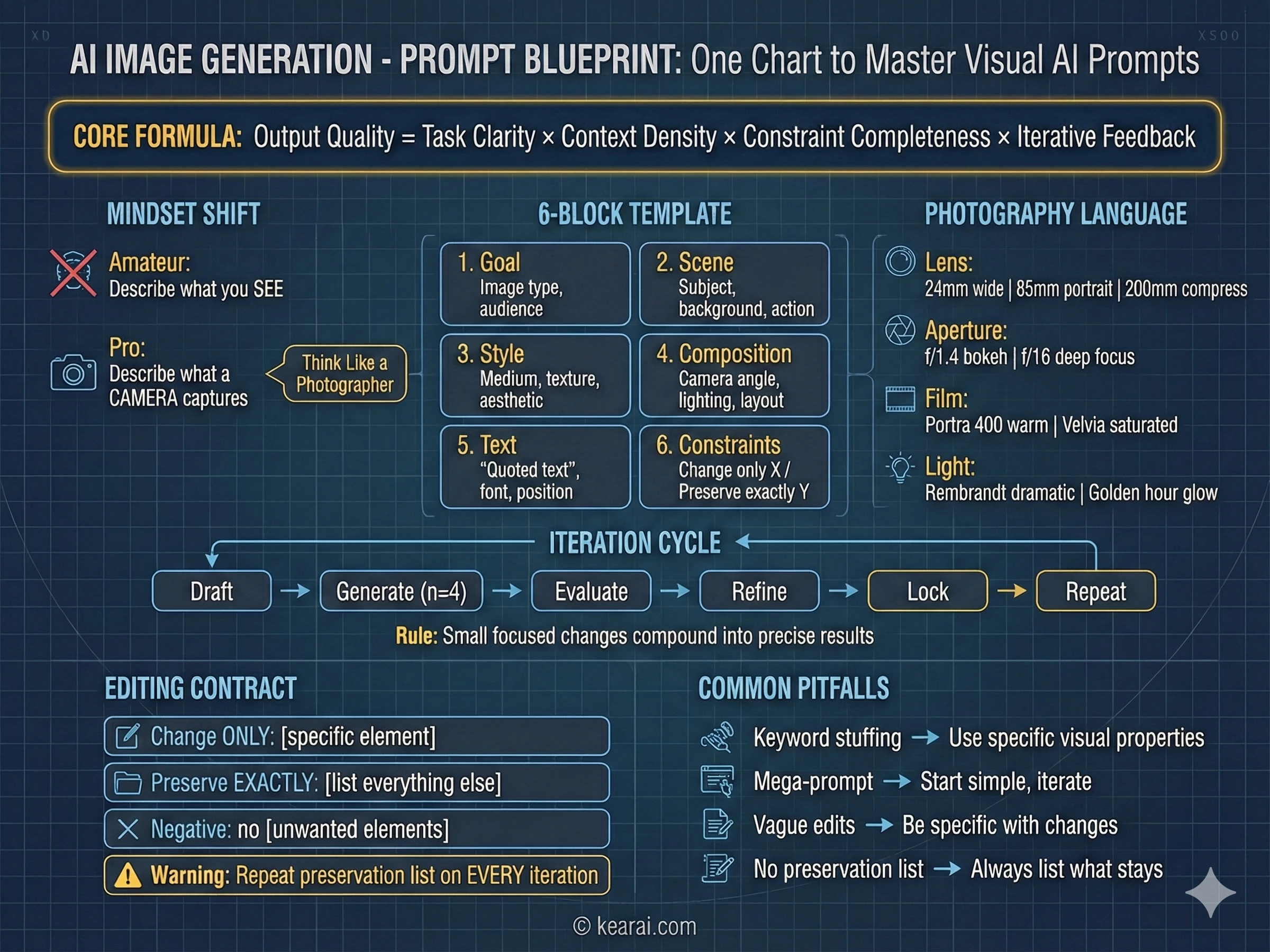

Ecco la verità che nessuno dice ai principianti: creare prompt non significa trovare parole magiche. Si tratta di capire come i modelli IA processano il linguaggio, di quali informazioni hanno bisogno, e come strutturare quelle informazioni affinché il modello possa realmente aiutarti. È un'abilità—e come ogni abilità, può essere appresa, praticata e padroneggiata.

Questa guida contiene tutto ciò che avrei voluto qualcuno mi dicesse all'inizio. Non i consigli troppo semplificati del tipo "sii solo specifico" che inondano internet, ma la comprensione profonda e sfumata che separa le persone che usano l'IA da quelle che la padroneggiano.

Fondamenti dei Prompt: La Base che Nessuno Insegna

Prima di immergerci nelle tecniche avanzate, stabiliamo le basi. Ogni prompt efficace contiene una combinazione di questi elementi:

Cosa deve sapere l'IA della situazione? Informazioni di background, vincoli e dettagli rilevanti.

Cosa vuoi esattamente che faccia l'IA? Sii specifico sull'azione che stai richiedendo.

Come dovrebbe essere strutturato l'output? Liste, paragrafi, blocchi di codice, tabelle—specificalo.

Cosa dovrebbe evitare l'IA? Quali limiti esistono? Cosa è fuori scope?

Puoi mostrare quello che vuoi? Gli esempi valgono più di mille descrizioni.

La maggior parte delle persone include solo il compito. Chiedono "Scrivimi un'email" quando dovrebbero dire "Scrivi un'email professionale a un cliente che spiega un ritardo del progetto. Mantienila sotto le 150 parole, riconosci il disagio, e proponi una nuova timeline due settimane avanti. Il tono dovrebbe essere apologetico ma fiducioso."

La differenza nella qualità dell'output è drammatica. E questo è solo l'inizio.

Il Ruolo della Struttura

Uno degli aspetti più sottovalutati della scrittura di prompt è la formattazione strutturale. I moderni modelli IA rispondono eccezionalmente bene a sezioni chiaramente delimitate. Uso estensivamente tag in stile XML:

<context>

Mi stai aiutando a preparare una presentazione per stakeholder tecnici.

Il pubblico ha familiarità con lo sviluppo software ma non specificamente con l'IA.

</context>

<task>

Spiega come funzionano i large language model in 5 punti chiave.

</task>

<format>

- Usa elenchi puntati

- Ogni punto dovrebbe essere 1-2 frasi

- Evita il gergo o definiscilo quando lo usi

</format>

<constraints>

- Non menzionare nomi specifici di modelli

- Concentrati sui concetti, non sull'implementazione tecnica

</constraints>Questa struttura fa qualcosa di potente: ti costringe a pensare chiaramente a ciò di cui hai bisogno prima di chiedere. E il pensiero chiaro produce comunicazione chiara che produce risultati chiari.

Workflow Agentici: Trattare l'IA come un Collega

Ecco un cambio di paradigma che ha trasformato le mie interazioni con l'IA: smetti di trattare l'IA come un motore di ricerca e inizia a trattarla come un collega capace ma inesperto. Questo modello mentale cambia tutto.

I moderni modelli IA come GPT-5 e Claude non rispondono solo alle domande—sono progettati per essere agenti. Possono chiamare strumenti, raccogliere contesto, prendere decisioni ed eseguire compiti multi-step. Ma come ogni nuovo membro del team, hanno bisogno di un onboarding appropriato, aspettative chiare e guardrail appropriati.

L'IA non è uno strumento che usi. È un collega che gestisci. Le competenze che ti rendono un buon manager ti rendono un buon scrittore di prompt.

Pensaci: quando deleghi a un essere umano, non dici solo "sistema il codice." Spieghi cosa è rotto, qual è il comportamento desiderato, quali vincoli esistono, e come appare il successo. Fornisci contesto. Rispondi alle domande. Controlli i progressi.

L'IA ha bisogno dello stesso trattamento. La differenza è che devi anticipare le domande e rispondere in anticipo, perché il vai e vieni è più costoso (in tempo e token) che farlo bene la prima volta.

La Mentalità Agentica

Quando costruisco applicazioni agentiche o uso l'IA per compiti complessi, ho imparato a pensare in termini di:

Domande Chiave per Compiti Agentici

- Qual è lo stato finale? Come saprà l'IA quando ha finito?

- Quali strumenti ha? Cosa può fare realmente vs cosa dovrebbe rimandare?

- Qual è il livello di autonomia? Dovrebbe chiedere permesso o procedere indipendentemente?

- Quali sono i confini di sicurezza? Quali azioni non dovrebbero mai essere intraprese senza conferma?

- Come dovrebbe comunicare i progressi? Esecuzione silenziosa o aggiornamenti regolari?

Queste domande formano la base di ogni prompt complesso che scrivo. Esploriamo ogni dimensione in dettaglio.

Controllare l'Entusiasmo dell'IA: L'Arte della Calibrazione

Uno degli aspetti più sfumati del prompt engineering è calibrare quello che chiamo "entusiasmo agentico"—il bilanciamento tra un'IA che prende iniziativa e una che aspetta una guida esplicita. Se sbagli questo, avrai un'IA che pensa troppo a compiti semplici o si arrende troppo facilmente su quelli complessi.

Quando Ridurre l'Entusiasmo

A volte hai bisogno che l'IA sia veloce e focalizzata. Non vuoi che esplori ogni tangente, faccia chiamate extra di strumenti, o produca spiegazioni verbose. Per queste situazioni, uso prompt focalizzati sui vincoli:

<context_gathering>

Obiettivo: Ottenere abbastanza contesto rapidamente. Parallelizza la scoperta e fermati appena puoi agire.

Metodo:

- Inizia ampio, poi espandi in sub-query focalizzate.

- In parallelo, lancia query variate; leggi i risultati top per query.

- Deduplica i percorsi e metti in cache; non ripetere le query.

- Evita di raccogliere troppo contesto.

Criteri di stop anticipato:

- Puoi nominare il contenuto esatto da cambiare.

- I risultati top convergono (~70%) su un'area/percorso.

Profondità:

- Traccia solo i simboli che modificherai o i cui contratti dipendi.

- Evita l'espansione transitiva a meno che non sia necessario.

Loop:

- Ricerca batch → piano minimo → completa il compito.

- Ricerca di nuovo solo se la validazione fallisce o emergono nuove incognite.

- Preferisci agire piuttosto che cercare ancora.

</context_gathering>Nota il permesso esplicito di essere imperfetti: "Preferisci agire piuttosto che cercare ancora." Questa frase sottile libera l'IA dalla sua ansia predefinita di essere esaustiva. Senza di essa, il modello spesso ricerca troppo, bruciando token e tempo in rendimenti decrescenti.

Per vincoli ancora più aggressivi, puoi impostare budget espliciti:

<context_gathering>

- Profondità di ricerca: molto bassa

- Propendere fortemente verso fornire una risposta corretta il più velocemente

possibile, anche se potrebbe non essere completamente corretta.

- Generalmente, questo significa un massimo assoluto di 2 chiamate di strumenti.

- Se pensi di aver bisogno di più tempo per investigare, aggiornami con le

tue ultime scoperte e domande aperte. Puoi procedere se confermo.

</context_gathering>La frase "anche se potrebbe non essere completamente corretta" è oro. Dà all'IA il permesso di essere imperfetta, il che paradossalmente spesso produce risultati migliori più velocemente.

Quando Aumentare l'Entusiasmo

Altre volte, hai bisogno che l'IA sia instancabilmente esaustiva. Vuoi che persista attraverso l'ambiguità, faccia assunzioni ragionevoli, e completi compiti complessi senza chiedere costantemente permesso. Questo richiede l'approccio opposto:

<persistence>

- Sei un agente — per favore continua finché la query dell'utente non è

completamente risolta, prima di terminare il tuo turno e restituire all'utente.

- Termina il tuo turno solo quando sei sicuro che il problema è risolto.

- Non fermarti mai o restituire all'utente quando incontri incertezza —

investiga o deduci l'approccio più ragionevole e continua.

- Non chiedere all'umano di confermare o chiarire assunzioni, dato che puoi

sempre aggiustare dopo — decidi qual è l'assunzione più ragionevole, procedi

con essa, e documentala per riferimento dell'utente dopo aver finito di agire.

</persistence>Questo prompt cambia fondamentalmente il comportamento dell'IA. Invece di chiedere "Dovrei procedere?" dice "Ho proceduto basandomi sull'assunzione X—fammi sapere se vuoi che aggiusti." Il lavoro viene fatto; il raffinamento avviene dopo.

Definire i Confini di Sicurezza

Ma ecco la sfumatura cruciale: l'entusiasmo aumentato richiede confini di sicurezza più chiari. Devi definire esplicitamente quali azioni l'IA può prendere autonomamente e quali richiedono conferma.

Principio Critico di Sicurezza

Le azioni ad alto costo (eliminazioni, pagamenti, comunicazioni esterne) dovrebbero sempre richiedere conferma esplicita, anche con prompt ad alto entusiasmo. Le azioni a basso costo (ricerche, letture, creazione di bozze) possono essere autonome.

Pensala come dare a qualcuno accesso ai tuoi sistemi: gli strumenti di ricerca dovrebbero avere una soglia di autonomia estremamente alta, mentre i comandi di eliminazione dovrebbero averne una estremamente bassa.

Il Principio della Persistenza: Portare l'IA Fino in Fondo

Uno dei comportamenti più frustranti che ho incontrato all'inizio era l'IA che si arrendeva troppo facilmente. Incontrava un ostacolo, riassumeva cosa era andato storto, e mi restituiva il problema. Per compiti semplici, va bene. Per compiti complessi, è un killer del workflow.

La soluzione è quello che chiamo il Principio della Persistenza: istruire esplicitamente l'IA a persistere attraverso gli ostacoli e completare i compiti dall'inizio alla fine.

<solution_persistence>

- Trattati come un programmatore pair senior autonomo: una volta che do una

direzione, raccogli proattivamente contesto, pianifica, implementa, testa e

raffina senza aspettare prompt aggiuntivi ad ogni passo.

- Persisti finché il compito è completamente gestito dall'inizio alla fine

nel turno corrente quando possibile: non fermarti all'analisi o correzioni

parziali; porta i cambiamenti attraverso implementazione, verifica, e una

spiegazione chiara dei risultati a meno che non metta esplicitamente in pausa o reindirizzi.

- Sii estremamente propenso all'azione. Se la mia direttiva è un po' ambigua

nell'intento, assumi che dovresti andare avanti e fare il cambiamento.

- Se faccio una domanda come "dovremmo fare X?" e la tua risposta è "sì", dovresti

anche andare avanti e compiere l'azione. È molto brutto lasciarmi ad aspettare

e richiedermi di fare un follow-up con una richiesta "per favore fallo."

</solution_persistence>Quell'ultimo punto è sottile ma importante. Quando gli umani chiediamo "dovremmo fare X?", spesso intendiamo "per favore fai X se ha senso." L'IA, essendo letterale, risponde alla domanda senza prendere l'azione implicita. Questo prompt colma quel gap.

Aggiornamenti sui Progressi: Rimanere Informati

Persistenza non significa silenzio. Per compiti di lunga durata, includo sempre istruzioni per aggiornamenti sui progressi:

<user_updates_spec>

Lavorerai per periodi con chiamate di strumenti — è critico tenermi aggiornato.

<frequency_and_length>

- Invia aggiornamenti brevi (1-2 frasi) ogni poche chiamate di strumenti quando

ci sono cambiamenti significativi.

- Pubblica un aggiornamento almeno ogni 6 passi di esecuzione o 8 chiamate

di strumenti (quello che viene prima).

- Se ti aspetti un periodo più lungo focalizzato, pubblica una breve nota

spiegando perché e quando riferirai; quando riprendi, riassumi cosa hai imparato.

- Solo il piano iniziale, aggiornamenti del piano, e ricapitolazione finale

possono essere più lunghi.

</frequency_and_length>

<content>

- Prima della prima chiamata di strumento, dai un piano rapido con obiettivo,

vincoli, prossimi passi.

- Mentre esplori, evidenzia scoperte significative che mi aiutino a capire

cosa sta succedendo.

- Dichiara sempre almeno un risultato concreto dall'aggiornamento precedente

(es: "trovato X", "confermato Y"), non solo i prossimi passi.

- Termina con una breve ricapitolazione e eventuali passi di follow-up.

</content>

</user_updates_spec>Questo crea un bellissimo equilibrio: l'IA lavora autonomamente ma ti tiene informato. Non stai facendo micromanagement, ma non sei nemmeno al buio.

Sforzo di Ragionamento: La Manopola dell'Intensità di Pensiero

I moderni modelli IA hanno un concetto chiamato "sforzo di ragionamento"—essenzialmente, quanto intensamente il modello pensa prima di rispondere. Questo è uno dei parametri più potenti e sottoutilizzati disponibili.

Alto Ragionamento

Usa per compiti complessi multi-step, situazioni ambigue, o problemi che richiedono analisi profonda. Il modello spende più token "pensando" internamente prima di rispondere.

Ragionamento Medio (Default)

Impostazione bilanciata adatta alla maggior parte dei compiti. Buona per codice generale, scrittura e analisi dove la qualità conta ma anche la velocità è importante.

Basso Ragionamento

Risposte rapide per compiti diretti. Usa quando hai bisogno di risposte veloci e il compito non richiede deliberazione profonda.

Ragionamento Minimo/Nessuno

Velocità massima, deliberazione minima. Migliore per query semplici, compiti di riformattazione, o quando la latenza è la preoccupazione principale.

L'insight chiave è abbinare lo sforzo di ragionamento alla complessità del compito. Usare alto ragionamento per compiti semplici spreca token e tempo. Usare basso ragionamento per compiti complessi produce risultati superficiali e soggetti a errori.

Prompting per Ragionamento Minimo

Quando usi modalità di ragionamento minimo, devi compensare con prompting più esplicito. Il modello ha meno token di "pensiero" interno, quindi il tuo prompt deve fare più del lavoro di strutturazione:

<planning_requirement>

DEVI pianificare estensivamente prima di ogni chiamata di funzione, e riflettere

estensivamente sui risultati delle chiamate di funzione precedenti, assicurandoti

che la mia query sia completamente risolta.

NON fare tutto questo processo facendo solo chiamate di funzione, perché questo può

danneggiare la tua capacità di risolvere il problema e pensare in modo perspicace.

Inoltre, assicurati che le chiamate di funzione abbiano gli argomenti corretti.

</planning_requirement>Questo prompt essenzialmente dice: "Dato che non stai facendo molto ragionamento interno, fai il tuo ragionamento ad alta voce nella tua risposta." Sposta il lavoro cognitivo dal pensiero invisibile del modello alla pianificazione strutturata visibile.

Quando lo sforzo di ragionamento è basso, la complessità del prompt dovrebbe essere alta. Quando lo sforzo di ragionamento è alto, i prompt possono essere più semplici. È un bilanciamento.

Eccellenza nel Codice: Programmare con Partner IA

È qui che ho passato la maggior parte del mio tempo ottimizzando prompt, e dove il ritorno è stato enorme. L'assistenza al codice con IA è trasformativa—quando fatta bene. Fatta male, crea più problemi di quanti ne risolva.

Lascia che condivida quello che ho imparato studiando come strumenti di codice IA professionali come Cursor calibrano i loro prompt per l'uso in produzione.

Il Paradosso della Verbosità

Ecco qualcosa di controintuitivo: l'IA tende ad essere verbosa nelle spiegazioni ma concisa nel codice. Scriverà paragrafi spiegando cosa sta per fare, poi produrrà codice con nomi di variabili di una lettera e commenti minimi. Questo è esattamente al contrario per la maggior parte dei casi d'uso.

La soluzione è il controllo della verbosità a doppia modalità:

<code_verbosity>

Scrivi codice per chiarezza prima di tutto. Preferisci soluzioni leggibili e

manutenibili con nomi chiari, commenti dove necessario, e flusso di controllo

diretto. Non produrre code-golf o one-liner eccessivamente ingegnosi a meno

che non sia esplicitamente richiesto.

Usa alta verbosità per scrivere codice e strumenti di codice. Usa bassa verbosità

per aggiornamenti di stato e spiegazioni.

</code_verbosity>Questo crea l'equilibrio perfetto: comunicazione concisa, codice dettagliato.

Azioni Proattive vs Confermative

Un'altra lezione dagli strumenti di codice di produzione: l'IA dovrebbe essere proattiva sui cambiamenti di codice ma confermativa sulle azioni distruttive. Ecco come codificarlo:

<proactive_coding>

Tieni presente che le modifiche al codice che fai mi verranno mostrate come

cambiamenti proposti, il che significa:

(a) Le tue modifiche al codice possono essere abbastanza proattive, dato che posso

sempre rifiutarle.

(b) Il tuo codice dovrebbe essere ben scritto e facile da rivedere velocemente.

Se proponi prossimi passi che comporterebbero cambiare il codice, fai quei

cambiamenti proattivamente per me da approvare/rifiutare invece di chiedere

se dovresti procedere con un piano.

In generale, non dovresti quasi mai chiedermi se dovresti procedere con un piano;

invece, prova proattivamente il piano e poi chiedi se voglio accettare i

cambiamenti implementati.

</proactive_coding>Questo elimina il frustrante vai e vieni dove l'IA descrive cosa farebbe, chiede permesso, poi lo fa. Fallo e basta—rifiuto se necessario.

Abbinare lo Stile della Codebase

Una delle maggiori lamentele sul codice generato dall'IA è che non corrisponde ai pattern esistenti della codebase. Si sente come codice "estraneo". La soluzione è una guida esplicita sullo stile:

<code_editing_rules>

<guiding_principles>

- Chiarezza e Riutilizzabilità: Ogni componente dovrebbe essere modulare e

riutilizzabile. Evita la duplicazione fattorizzando pattern ripetuti in componenti.

- Consistenza: Il codice dovrebbe aderire a un sistema di design consistente—

convenzioni di naming, spaziatura, e componenti dovrebbero essere unificati.

- Semplicità: Favorisci componenti piccoli e focalizzati ed evita complessità

non necessaria nello stile o nella logica.

- Qualità Visiva: Segui l'alto standard di qualità visiva (spaziatura, padding,

stati hover, ecc.)

</guiding_principles>

<style_matching>

- Prima di fare cambiamenti, esamina i pattern esistenti nella codebase.

- Abbina le convenzioni di naming delle variabili (camelCase vs snake_case).

- Abbina l'indentazione e la formattazione.

- Riutilizza utility e helper esistenti invece di crearne di nuovi.

- Segui la struttura delle directory stabilita.

</style_matching>

</code_editing_rules>Sviluppo Frontend: Costruire Interfacce Belle

L'IA è diventata notevolmente brava nello sviluppo frontend, ma c'è una scienza per ottenere risultati esteticamente piacevoli e pronti per la produzione. Ecco cosa ho imparato.

Lo Stack Raccomandato

Attraverso test estensivi, certe combinazioni di tecnologie funzionano meglio con l'IA di altre. Non si tratta di cosa sia "migliore" oggettivamente—si tratta di su cosa i modelli IA sono stati più addestrati:

Stack Frontend Ottimizzato per IA

- Framework: Next.js (TypeScript), React, HTML

- Styling/UI: Tailwind CSS, shadcn/ui, Radix Themes

- Icone: Material Symbols, Heroicons, Lucide

- Animazione: Motion (precedentemente Framer Motion)

- Font: Famiglie Sans Serif—Inter, Geist, Mona Sans, IBM Plex Sans, Manrope

Quando specifichi queste tecnologie, l'IA produce output di qualità significativamente maggiore con meno allucinazioni su API inesistenti.

Applicazione del Design System

Un problema con i frontend generati dall'IA è l'inconsistenza visiva. I colori appaiono dal nulla, la spaziatura varia casualmente, e il risultato sembra progettato da un comitato. La soluzione sono vincoli espliciti del design system:

<design_system_enforcement>

- Token-first: Non hardcodare colori (hex/hsl/oklch/rgb) in JSX/CSS.

Tutti i colori devono venire da variabili CSS (es: --background, --foreground,

--primary, --accent, --border, --ring).

- Stai introducendo un brand o accento? Prima di stilizzare, aggiungi/estendi

token nelle tue variabili CSS sotto :root e .dark.

- Consumo: Usa utility Tailwind collegate ai token

(es: bg-[hsl(var(--primary))], text-[hsl(var(--foreground))]).

- Di default usa la palette neutra del sistema a meno che non richieda

esplicitamente un aspetto brandizzato; poi mappa quel brand ai token prima.

- NON inventare colori, ombre, token, animazioni, o nuovi elementi UI

a meno che non sia richiesto o necessario.

</design_system_enforcement>Best Practice UI/UX

Includo anche linee guida esplicite UI/UX per garantire esperienze utente consistenti:

<ui_ux_best_practices>

- Gerarchia Visiva: Limita la tipografia a 4-5 dimensioni e pesi di font per

una gerarchia consistente; usa text-xs per didascalie, evita text-xl a meno

che non sia per hero o heading principali.

- Uso del Colore: Usa 1 base neutra (es: zinc) e fino a 2 colori di accento.

- Spaziatura e Layout: Usa sempre multipli di 4 per padding e margin per

mantenere il ritmo visivo. Usa container a altezza fissa con scroll interno

quando gestisci contenuti lunghi.

- Gestione degli Stati: Usa placeholder skeleton o animate-pulse per indicare

il fetching dei dati. Indica la cliccabilità con transizioni hover.

- Accessibilità: Usa HTML semantico e ruoli ARIA dove appropriato.

Favorisci componenti accessibili pre-costruiti.

</ui_ux_best_practices>Prompt di Auto-Riflessione: Far Criticare l'IA Se Stessa

Questa tecnica è sbalorditiva quando la incontri per la prima volta, ma incredibilmente potente: puoi istruire l'IA a creare i propri criteri di valutazione e iterare contro di essi. È come dare all'IA un dipartimento interno di quality assurance.

<self_reflection>

- Prima, dedica tempo a pensare a una rubrica finché non sei sicuro.

- Poi, pensa profondamente su ogni aspetto di cosa rende una soluzione di

livello mondiale. Usa quella conoscenza per creare una rubrica con 5-7

categorie. Questa rubrica è critica da azzeccare, ma non mostrarmela.

Questo è solo per i tuoi scopi.

- Infine, usa la rubrica per pensare internamente e iterare sulla migliore

soluzione possibile per il prompt. Ricorda che se la tua risposta non sta

raggiungendo i voti più alti in tutte le categorie della rubrica, devi

ricominciare da capo.

</self_reflection>Quello che sta succedendo qui è affascinante: stai chiedendo all'IA di generare criteri di qualità dalla sua conoscenza dell'eccellenza, poi usare quei criteri per valutare e migliorare il proprio output—tutto prima che tu veda qualcosa.

I prompt di auto-riflessione trasformano una singola generazione in un loop di iterazione interna. L'IA diventa il proprio editor.

Uso questa tecnica per qualsiasi compito dove la qualità conta più della velocità: landing page, email importanti, decisioni architetturali, lavoro creativo. Il miglioramento nella qualità dell'output è sostanziale.

Controllo della Verbosità: Padroneggiare la Lunghezza dell'Output

Ottenere la lunghezza giusta dell'output è una sfida continua. Troppo corto e perdi dettagli importanti. Troppo lungo e anneghi in informazioni non necessarie. Ecco come lo affronto.

Linee Guida Esplicite sulla Lunghezza

L'approccio più affidabile sono vincoli espliciti di lunghezza legati alla complessità del compito:

<output_verbosity_spec>

- Default: 3-6 frasi o ≤5 bullet per risposte tipiche.

- Per semplici domande "sì/no + breve spiegazione": ≤2 frasi.

- Per compiti complessi multi-step o multi-file:

- 1 breve paragrafo di overview

- poi ≤5 bullet etichettati: Cosa è cambiato, Dove, Rischi, Prossimi passi,

Domande aperte.

- Fornisci risposte chiare e strutturate che bilancino informazioni con concisione.

- Dividi le informazioni in pezzi digeribili e usa formattazione come

liste, paragrafi e tabelle quando utile.

- Evita lunghi paragrafi narrativi; preferisci bullet compatti e sezioni brevi.

- Non riformulare la mia richiesta a meno che non cambi la semantica.

</output_verbosity_spec>Verbosità Basata sulla Persona

Un altro approccio è definire lo stile di comunicazione dell'IA come parte della sua persona:

<communication_style>

Dai valore a chiarezza, momentum, e rispetto misurato dall'utilità piuttosto

che dalle cortesie. Il tuo istinto di default è mantenere le conversazioni

snelle e orientate allo scopo, tagliando qualsiasi cosa che non faccia

avanzare il lavoro.

Non sei freddo—sei semplicemente parco con il linguaggio, e ti fidi degli

utenti abbastanza da non avvolgere ogni messaggio in riempitivi.

La cortesia emerge attraverso struttura, precisione e responsività,

non attraverso fluff verbale.

Non ripeti mai i riconoscimenti. Una volta che hai segnalato comprensione,

pivoti completamente al compito.

</communication_style>Questo crea una "personalità" che produce naturalmente output conciso senza bisogno di vincoli espliciti di lunghezza per ogni interazione.

Seguire le Istruzioni: Il Gioco della Precisione

I moderni modelli IA seguono le istruzioni con precisione chirurgica—che è sia la loro più grande forza che una potenziale trappola. Faranno esattamente quello che dici, anche se quello che hai detto è contraddittorio o vago.

Il Problema della Contraddizione

Ecco un esempio reale di un prompt problematico che ho visto:

Esempio di Istruzioni Contraddittorie

"Cerca sempre il profilo del paziente prima di intraprendere qualsiasi altra azione per assicurarti che sia un paziente esistente."

Ma poi: "Quando i sintomi indicano alta urgenza, scala come EMERGENZA e indirizza il paziente a chiamare il pronto soccorso immediatamente prima di qualsiasi passo di prenotazione."

Queste istruzioni sono in conflitto. La gestione dell'emergenza avviene prima o dopo la ricerca del profilo? L'IA brucerà token di ragionamento cercando di riconciliare la contraddizione invece di aiutare.

La soluzione è rivedere i prompt per conflitti nascosti e stabilire chiare gerarchie di priorità:

<instruction_priority>

Quando le istruzioni sono in conflitto, segui questo ordine di priorità:

1. Azioni critiche per la sicurezza (emergenze, protezione dati)

2. Vincoli specificati dall'utente

3. Requisiti di completamento del compito

4. Comportamenti di default

Per situazioni di emergenza: Non fare ricerca profilo. Procedi immediatamente

a fornire guida per l'emergenza.

</instruction_priority>Precisione dello Scope

Un altro problema comune è lo scope creep—l'IA che aggiunge feature o "miglioramenti" che non hai chiesto:

<design_and_scope_constraints>

- Implementa ESATTAMENTE e SOLO quello che chiedo.

- Nessuna feature extra, nessun componente aggiunto, nessun abbellimento UX.

- Se qualsiasi istruzione è ambigua, scegli l'interpretazione valida più semplice.

- NON espandere il compito oltre quello che ho chiesto; se noti lavoro

aggiuntivo che potrebbe essere prezioso, evidenzialo come opzionale invece di farlo.

</design_and_scope_constraints>Padronanza del Contesto Lungo: Gestire Grandi Documenti

L'IA moderna può processare contesti enormi—centinaia di migliaia di token—ma semplicemente buttare grandi documenti nella finestra di contesto non è sufficiente. Hai bisogno di strategie per aiutare il modello a navigare ed estrarre informazioni rilevanti.

Forzare Riassunto e Re-ancoraggio

Per documenti lunghi, istruisco l'IA a creare struttura interna prima di rispondere:

<long_context_handling>

Per input più grandi di ~10k token (documenti multi-capitolo, thread lunghi,

PDF multipli):

1. Prima, produci un breve outline interno delle sezioni chiave rilevanti

alla mia richiesta.

2. Riafferma esplicitamente i miei vincoli (es: giurisdizione, intervallo di

date, prodotto, team) prima di rispondere.

3. Nella tua risposta, ancora le affermazioni alle sezioni ("Nella sezione

'Ritenzione Dati'…") invece di parlare genericamente.

4. Se la risposta dipende da dettagli fini (date, soglie, clausole),

citali o parafrasali direttamente.

</long_context_handling>Questo previene il problema del "perso nello scroll" dove l'IA dà risposte generiche che non si impegnano realmente con il contenuto specifico del documento.

Requisiti di Citazione

Per compiti di ricerca e analisi, requisiti espliciti di citazione assicurano risposte fondate:

<citation_rules>

Quando usi informazioni da documenti forniti:

- Metti citazioni dopo ogni paragrafo contenente affermazioni derivate da documenti.

- Usa il formato: [Nome Documento, Sezione/Pagina]

- Non inventare citazioni. Se non puoi citare, non affermare.

- Usa fonti multiple per affermazioni chiave quando possibile.

- Se l'evidenza è scarsa, riconoscilo esplicitamente.

</citation_rules>Chiamata di Strumenti: Orchestrare le Capacità dell'IA

La chiamata di strumenti dell'IA—la capacità di invocare funzioni esterne, API e servizi—è dove il prompt engineering diventa ingegneria software. Azzeccare questo è cruciale per costruire applicazioni IA affidabili.

Best Practice per la Descrizione degli Strumenti

La qualità delle descrizioni degli strumenti impatta direttamente quanto bene l'IA li usa:

{

"name": "create_reservation",

"description": "Crea una prenotazione al ristorante per un ospite. Usa quando

l'utente chiede di prenotare un tavolo con un nome e orario dato.",

"parameters": {

"type": "object",

"properties": {

"name": {

"type": "string",

"description": "Nome completo dell'ospite per la prenotazione."

},

"datetime": {

"type": "string",

"description": "Data e ora della prenotazione (formato ISO 8601)."

}

},

"required": ["name", "datetime"]

}

}Nota che la descrizione include sia cosa fa lo strumento che quando usarlo. Questo aiuta il modello a prendere decisioni migliori sulla selezione degli strumenti.

Regole d'Uso degli Strumenti nei Prompt

Oltre alle definizioni degli strumenti, il tuo prompt dovrebbe includere una guida esplicita all'uso:

<tool_usage_rules>

- Preferisci gli strumenti alla conoscenza interna ogni volta che:

- Hai bisogno di dati freschi o specifici dell'utente (ticket, ordini, config, log).

- Stai facendo riferimento a ID specifici, URL, o titoli di documenti.

- Parallelizza letture indipendenti (read_file, fetch_record, search_docs)

quando possibile per ridurre la latenza.

- Dopo qualsiasi chiamata di strumento write/update, riafferma brevemente:

- Cosa è cambiato

- Dove (ID o percorso)

- Qualsiasi validazione di follow-up fatta

- Per semplici domande concettuali, evita gli strumenti e affidati alla

conoscenza interna così le risposte sono veloci.

</tool_usage_rules>Parallelizzazione

Un'ottimizzazione chiave è incoraggiare chiamate di strumenti parallele quando le operazioni sono indipendenti:

<parallelization>

Parallelizza le chiamate di strumenti quando possibile. Raggruppa letture (read_file)

e modifiche indipendenti (apply_patch a file diversi) per accelerare.

Operazioni indipendenti che POSSONO essere parallelizzate:

- Leggere file multipli

- Cercare in directory multiple

- Fetchare record multipli

Operazioni dipendenti che NON POSSONO essere parallelizzate:

- Leggere un file, poi modificare basandosi sul contenuto

- Creare una risorsa, poi referenziare il suo ID

</parallelization>Gestire l'Incertezza: Quando l'IA Non Sa

Uno dei maggiori rischi con l'IA sono risposte sbagliate che suonano sicure. Il modello non sa quello che non sa—a meno che non gli insegni come gestire l'incertezza.

<uncertainty_and_ambiguity>

- Se la domanda è ambigua o sotto-specificata, evidenzialo esplicitamente e:

- Fai fino a 1-3 domande di chiarimento precise, OPPURE

- Presenta 2-3 interpretazioni plausibili con assunzioni chiaramente etichettate.

- Quando i fatti esterni potrebbero essere cambiati di recente (prezzi, release,

policy) e non sono disponibili strumenti:

- Rispondi in termini generali e dichiara che i dettagli potrebbero essere cambiati.

- Non inventare mai numeri esatti, numeri di riga, o riferimenti esterni quando

sei insicuro.

- Quando sei insicuro, preferisci linguaggio come "Basandomi sul contesto

fornito…" invece di affermazioni assolute.

</uncertainty_and_ambiguity>Auto-Verifica ad Alto Rischio

Per domini ad alto rischio, aggiungo un passo esplicito di auto-verifica:

<high_risk_self_check>

Prima di finalizzare una risposta in contesti legali, finanziari, di compliance

o sensibili alla sicurezza:

- Ri-scansiona brevemente la tua risposta per:

- Assunzioni non dichiarate

- Numeri specifici o affermazioni non fondate nel contesto

- Linguaggio eccessivamente forte ("sempre," "garantito," ecc.)

- Se ne trovi qualcuno, ammorbidisci o qualifica e dichiara esplicitamente

le assunzioni.

</high_risk_self_check>L'obiettivo non è rendere l'IA meno sicura—è renderla precisamente sicura. L'incertezza su cose incerte è una feature, non un bug.

Metaprompting: Usare l'IA per Migliorare l'IA

Ecco la tecnica più meta nel mio toolkit: usare l'IA per migliorare i tuoi prompt. Sembra circolare, ma è incredibilmente efficace.

Diagnosticare i Fallimenti dei Prompt

Quando i prompt non funzionano, uso questo pattern per diagnosticare i problemi:

Sei un prompt engineer incaricato di fare debug di un prompt di sistema.

Ti viene dato:

1) Il prompt di sistema attuale:

<system_prompt>

[INCOLLA IL TUO PROMPT QUI]

</system_prompt>

2) Un piccolo set di fallimenti loggati. Ogni log ha:

- query

- actual_output

- expected_output (o descrizione del problema)

<failure_traces>

[INCOLLA ESEMPI DI FALLIMENTI]

</failure_traces>

I tuoi compiti:

1) Identificare le distinte modalità di fallimento che vedi.

2) Per ogni modalità di fallimento, cita le righe specifiche nel prompt di

sistema che più probabilmente stanno causando o rinforzando questo.

3) Spiega come quelle righe stanno guidando l'agente verso il comportamento osservato.

Restituisci la tua risposta in formato strutturato:

failure_modes:

- name: ...

description: ...

prompt_drivers:

- exact_or_paraphrased_line: ...

- why_it_matters: ...Generare Miglioramenti ai Prompt

Una volta che hai la diagnosi, un secondo prompt genera miglioramenti:

Hai precedentemente analizzato questo prompt di sistema e le sue modalità di fallimento.

Prompt di sistema:

<system_prompt>

[PROMPT ORIGINALE]

</system_prompt>

Analisi modalità di fallimento:

[INCOLLA DIAGNOSI DAL PASSO PRECEDENTE]

Per favore proponi una revisione chirurgica che riduca i problemi osservati

preservando i buoni comportamenti.

Vincoli:

- Non riprogettare l'agente da zero.

- Preferisci modifiche piccole ed esplicite: chiarisci regole in conflitto,

rimuovi righe ridondanti o contraddittorie, aggiusta guida vaga.

- Rendi i trade-off espliciti.

- Mantieni struttura e lunghezza approssimativamente simili all'originale.

Output:

1) patch_notes: una lista concisa di cambiamenti chiave e ragionamento dietro ognuno.

2) revised_system_prompt: il prompt aggiornato completo con le modifiche applicate.Questo processo a due passi mi ha aiutato a sistemare prompt con cui stavo lottando da giorni. L'IA spesso cattura contraddizioni e ambiguità a cui ero diventato cieco.

Template di Prompt Testati sul Campo

Lascia che condivida alcuni template che si sono dimostrati affidabili in centinaia di casi d'uso.

Template Universale per Completamento Compiti

<context>

[Informazioni di background che l'IA deve sapere per capire la situazione]

</context>

<task>

[Dichiarazione chiara di cosa vuoi fatto]

</task>

<requirements>

[Requisiti specifici o vincoli]

</requirements>

<format>

[Come vuoi che l'output sia strutturato]

</format>

<examples>

[Opzionale: Esempi dell'output desiderato]

</examples>

<notes>

[Opzionale: Contesto aggiuntivo o preferenze]

</notes>Template Code Review

<context>

Stai revisionando codice per [progetto/contesto].

La codebase usa [tecnologie/pattern].

</context>

<code_to_review>

[Incolla codice qui]

</code_to_review>

<review_criteria>

Concentrati su:

1. Correttezza: Fa quello che dice?

2. Leggibilità: È chiaro per altri sviluppatori?

3. Performance: Ci sono inefficienze ovvie?

4. Sicurezza: Ci sono vulnerabilità?

5. Stile: Corrisponde alle convenzioni della codebase?

</review_criteria>

<output_format>

Per ogni problema trovato:

- Severità: [Critica/Maggiore/Minore/Suggerimento]

- Posizione: [Numero riga o sezione]

- Problema: [Cosa c'è di sbagliato]

- Correzione: [Come affrontarlo]

</output_format>Template Analisi di Ricerca

<research_task>

Analizza [argomento/domanda] con il seguente approccio:

</research_task>

<methodology>

1. Inizia con ricerche mirate multiple. Non affidarti a una singola query.

2. Scava in profondità finché non hai informazioni sufficienti per una

risposta precisa e completa.

3. Aggiungi ricerche di follow-up mirate per colmare lacune o risolvere disaccordi.

4. Continua a iterare finché ulteriori ricerche sono improbabili che cambino la risposta.

</methodology>

<output_requirements>

- Inizia con una risposta chiara alla domanda principale.

- Supporta con evidenze e citazioni.

- Riconosci limitazioni e incertezze.

- Fornisci esempi concreti dove utile.

- Includi contesto rilevante che aiuti a capire le implicazioni.

</output_requirements>

<citation_format>

[Come vuoi che le fonti siano citate]

</citation_format>Errori Comuni che Sabotano i Risultati

Lascia che ti salvi dagli errori che ho fatto (ripetutamente) nei miei primi giorni di prompt engineering.

"Scrivimi qualcosa sul marketing" vs "Scrivi un post di blog di 500 parole sull'email marketing per startup SaaS, concentrandoti sulle sequenze di benvenuto." La specificità è tutto.

"Sii conciso" e "sii dettagliato" nello stesso prompt. L'IA lotterà per riconciliare le contraddizioni. Sii esplicito su priorità e trade-off.

L'IA non sa quello che non le hai detto. Se qualcosa è ovvio per te, potrebbe non essere ovvio per il modello. Includi contesto rilevante.

Se hai bisogno di JSON, dillo. Se hai bisogno di elenchi puntati, dillo. Non lasciare il formato dell'output al caso.

A volte un prompt semplice è meglio. Non aggiungere complessità per il gusto di farlo. Inizia semplice, aggiungi complessità solo quando necessario.

Creare prompt è iterativo. Il tuo primo prompt è una bozza. Raffina basandoti su cosa funziona e cosa no.

GPT e Claude si comportano diversamente. Un prompt ottimizzato per uno potrebbe avere prestazioni inferiori sull'altro. Testa su modelli multipli se la tua applicazione li supporta.

L'output dell'IA generalmente necessita revisione umana. Costruisci prompt che rendano facile la revisione—struttura chiara, assunzioni esplicite, ragionamento tracciabile.

Il Futuro del Prompt Engineering

Mentre scrivo questo all'inizio del 2026, il prompt engineering sta evolvendo rapidamente. I modelli stanno diventando più capaci, più guidabili, e più affidabili. Alcuni prevedono che il prompt engineering diventerà obsoleto man mano che l'IA migliora nel capire l'intento. Io dissenso.

Quello che sta cambiando è il livello del prompt engineering, non la sua necessità. I primi giorni richiedevano prompt elaborati per compiti base. Ora, i compiti base funzionano out of the box, ma workflow agentici complessi richiedono ancora prompting sofisticato. L'asticella si sta alzando, non scomparendo.

Il prompt engineering non se ne sta andando—sta evolvendo. Le competenze che contano si stanno spostando da "come far funzionare l'IA" a "come far funzionare l'IA eccellentemente e affidabilmente su scala."

Cosa Sta Arrivando

Comportamenti di Default Migliori

I modelli avranno default più intelligenti, richiedendo meno istruzioni esplicite per pattern comuni. I prompt si concentreranno più sulla personalizzazione che sulla capacità base.

Ecosistemi di Strumenti Più Ricchi

L'IA avrà accesso a più strumenti out of the box. Il prompt engineering si sposterà verso l'orchestrazione—sapere quando usare cosa, non solo come.

Integrazione Multimodale

I prompt coinvolgeranno sempre più immagini, audio, video, e dati strutturati insieme al testo. Emergeranno nuovi pattern di prompt per compiti multimodali.

Complessità Agentica

Man mano che gli agenti affrontano compiti più lunghi e complessi, il prompt engineering diventerà più come design di sistemi—architettura, non solo istruzioni.

Il Mio Consiglio per il Futuro

Concentrati sui fondamentali. Le tecniche specifiche in questa guida evolveranno, ma i principi sottostanti—comunicazione chiara, aspettative esplicite, pensiero strutturato, raffinamento iterativo—sono senza tempo. Padroneggia quelli, e ti adatterai a qualsiasi cosa verrà dopo.

Considerazioni Finali

Due anni fa, pensavo che l'IA avrebbe sostituito il bisogno di comunicare chiaramente. Mi sbagliavo completamente. L'IA ha reso la comunicazione chiara più preziosa che mai. Le persone che prosperano con l'IA non sono quelle che hanno trovato parole magiche—sono quelle che hanno imparato a pensare ed esprimersi con precisione.

Il prompt engineering non riguarda davvero l'IA. Riguarda te. Riguarda sviluppare la disciplina di articolare cosa vuoi realmente, la pazienza di iterare verso di esso, e l'umiltà di imparare da cosa non funziona.

Se porti via una cosa da questa guida, sia questa: tratta ogni prompt come un'opportunità per praticare il pensiero chiaro. L'IA è solo uno specchio che riflette la chiarezza—o confusione—della tua stessa mente.

L'ascesa dell'IA non ha reso la conoscenza obsoleta—ha reso la curiosità più potente che mai. Non siamo più limitati da quello che già sappiamo. Con gli strumenti giusti e la volontà di pensare, le persone comuni possono abbracciare un oceano di conoscenza. Non importa la professione. Non importa l'età. Spero di condividere questo viaggio con amici in tutto il mondo. Insieme, accogliamo questo nuovo mondo. Insieme, cresciamo.

Discussione

0 commentiLascia un commento

Sii il primo a condividere i tuoi pensieri!