L'IA non ti legge nel pensiero. Legge le tue parole. Il divario tra ciò che vuoi e ciò che ottieni è quasi sempre un problema di comunicazione, non un limite dell'IA.

Lasciate che vi racconti il momento in cui tutto è cambiato. Stavo fissando il mio schermo, frustrato oltre ogni dire, guardando l'IA generare l'ennesima risposta che era tecnicamente corretta ma mancava completamente il punto. Avevo chiesto aiuto per rifattorizzare un pezzo complesso di codice, qualcosa che avevo fatto centinaia di volte prima. Ma questa volta, non importava come formulassi la mia richiesta, l'IA continuava ad aggiungere complessità inutile, rompere schemi esistenti e "migliorare" cose che non erano rotte. Quella frustrazione mi ha portato in una tana del coniglio che avrebbe consumato i successivi due anni della mia vita — e trasformato completamente il modo in cui lavoro con l'intelligenza artificiale.

Il Risveglio - Quando Tutto Ciò Che Sapevo Ha Smesso di Funzionare

Ricordo il momento esatto in cui ho capito che non avevo idea di cosa stessi facendo. Era notte fonda, la scadenza incombeva e avevo bisogno che l'IA mi aiutasse con quello che avrebbe dovuto essere un compito semplice. Ho digitato il mio prompt, ho premuto invio e ho guardato l'IA produrre qualcosa che mi ha fatto venire voglia di lanciare il mio laptop fuori dalla finestra.

Il fatto è che pensavo di capire l'IA. Usavo ChatGPT fin dai primi giorni. Avevo letto articoli sul prompt engineering. Sapevo del "role-playing" e dell'"essere specifici". Ma ero lì, a ricevere risposte che sembravano provenire da qualcuno che sentiva ogni parola che dicevo ma non capiva nulla di ciò di cui avevo realmente bisogno.

Quella frustrazione è diventata la mia insegnante. Mi sono immerso nella documentazione ufficiale, documenti di ricerca, discussioni sui forum e migliaia di ore di sperimentazione. Ciò che ho scoperto non erano solo trucchi e suggerimenti — era un completo cambio di paradigma nel modo di comunicare con macchine che pensano in schemi, probabilità e token.

L'IA più potente del mondo è inutile se non riesci a comunicare ciò di cui hai realmente bisogno. Il prompting non riguarda il trovare parole magiche — riguarda il capire come l'IA elabora il linguaggio e strutturare la tua comunicazione di conseguenza.

Ecco la verità che nessuno dice ai principianti: la differenza tra le persone che ottengono risultati sorprendenti dall'IA e quelle che non ci riescono non è l'intelligenza o l'abilità tecnica. È la comunicazione. E la comunicazione con l'IA segue regole che sono simili — ma criticamente diverse — dalla comunicazione con gli umani.

Questa guida contiene tutto ciò che ho imparato in quel viaggio. Non i consigli ipersemplificati del tipo "sii specifico" che inondano internet, ma la comprensione profonda e sfumata che trasforma il modo in cui lavori con l'IA. Che tu stia scrivendo il tuo primo prompt o costruendo sistemi di IA di produzione, ciò che segue cambierà per sempre il tuo rapporto con l'intelligenza artificiale.

Le Fondamenta Che Nessuno Insegna - Anatomia del Prompt Core

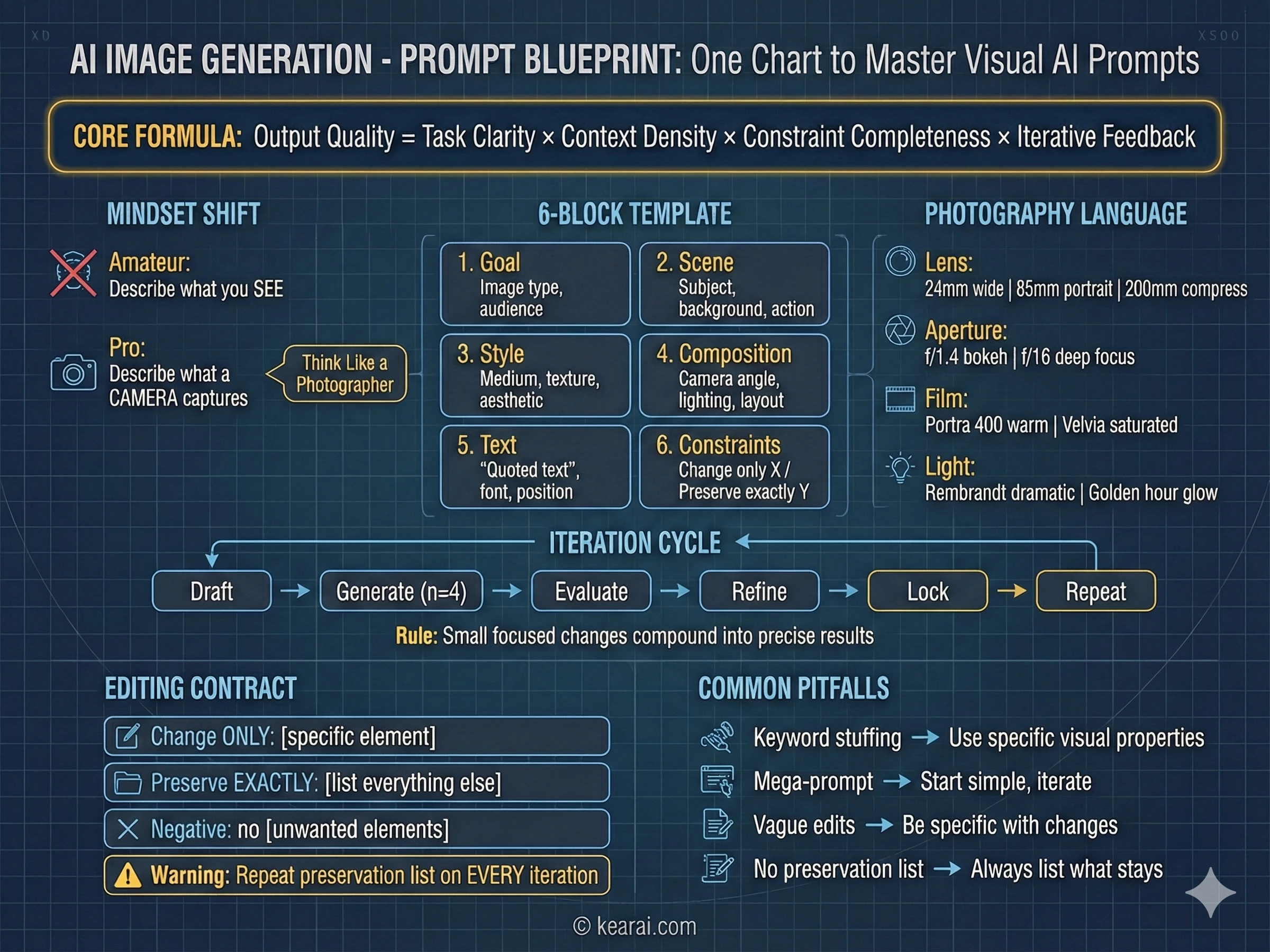

Prima di addentrarci nelle tecniche avanzate, lasciate che condivida il framework che ha cambiato tutto per me. Ogni prompt efficace che scrivo ora contiene una combinazione di questi cinque elementi:

Cosa deve sapere l'IA sulla tua situazione? Informazioni di background, vincoli, dettagli rilevanti e l'ambiente in cui stai lavorando.

Cosa vuoi esattamente che l'IA faccia? Sii specifico sull'azione che stai richiedendo — non solo l'argomento, ma il lavoro vero e proprio.

Come dovrebbe essere strutturato l'output? Elenchi, paragrafi, blocchi di codice, tabelle, JSON — specificalo esplicitamente.

Cosa dovrebbe evitare l'IA? Quali confini esistono? Cosa è esplicitamente fuori scopo?

Puoi mostrare ciò che vuoi? Gli esempi valgono più di mille descrizioni — dimostrano piuttosto che spiegare.

La maggior parte delle persone include solo il compito. Chiedono "Scrivimi un'email" quando dovrebbero dire "Scrivi un'email professionale a un cliente spiegando un ritardo nel progetto. Mantienila sotto le 150 parole, riconosci l'inconveniente e proponi una nuova tempistica tra due settimane. Il tono dovrebbe essere di scuse ma fiducioso."

La differenza nella qualità dell'output è drammatica. E questo è solo l'inizio.

Il Potere della Struttura

Uno degli aspetti più sottovalutati della scrittura dei prompt è la formattazione strutturale. I moderni modelli di IA rispondono eccezionalmente bene a sezioni chiaramente delineate. Uso estensivamente i tag in stile XML perché creano confini inequivocabili:

<context>

Mi stai aiutando a preparare una presentazione per stakeholder tecnici.

Il pubblico ha familiarità con lo sviluppo software ma non specificamente con l'IA.

</context>

<task>

Spiega come funzionano i grandi modelli linguistici in 5 punti chiave.

</task>

<format>

- Usa elenchi puntati

- Ogni punto deve essere di 1-2 frasi

- Evita il gergo o definiscilo quando usato

</format>

<constraints>

- Non menzionare nomi di modelli specifici

- Concentrati sui concetti, non sull'implementazione tecnica

- Mantieni la lunghezza totale sotto le 200 parole

</constraints>Questa struttura fa qualcosa di potente: costringe te a pensare chiaramente a ciò di cui hai bisogno prima di chiedere. Il pensiero chiaro produce una comunicazione chiara, e la comunicazione chiara produce risultati chiari. I tag XML non sono magia — sono impalcature per i tuoi pensieri.

La struttura non serve a rendere i prompt più lunghi — serve a rendere le tue intenzioni inequivocabili. Un prompt breve ben strutturato batte sempre un prompt lungo e divagante.

Le Sei Mentalità Che Hanno Cambiato Tutto

Dopo anni di sperimentazione, ho distillato il mio approccio in sei "mentalità" fondamentali — non template rigidi, ma schemi di pensiero flessibili che sbloccano capacità dell'IA che la maggior parte delle persone non scopre mai. Non si tratta di trovare le parole perfette; si tratta di approcciare l'interazione con l'IA con il giusto modello mentale.

Mentalità 1: Lascia che l'IA Scelga l'Esperto

Sappiamo tutti che dare un ruolo all'IA aiuta. "Agisci come un esperto di marketing" produce consigli di marketing migliori di una domanda generica. Ma ecco cosa sfugge alla maggior parte delle persone: quando non sai quale esperto sarebbe meglio per la tua domanda, puoi chiedere all'IA di scegliere.

L'ho scoperto pianificando un evento aziendale. Non avevo idea se avessi bisogno di una prospettiva di marketing, una prospettiva operativa o qualcos'altro interamente. Quindi, invece di indovinare, ho chiesto all'IA di selezionare prima l'esperto più appropriato.

Voglio esplorare [DOMINIO] e specificamente [PROBLEMA/SCENARIO].

Non rispondere ancora.

Per prima cosa, seleziona l'esperto di dominio più adatto a pensare a questo problema.

Possono essere viventi o storici, famosi o relativamente sconosciuti,

ma devono essere genuinamente eccellenti in questa area specifica.

Se non sei sicuro, fammi 2 domande di posizionamento prima di selezionare.

Output:

1. Chi hai selezionato e il loro dominio specifico

2. Perché li hai scelti (tre frasi)

Poi chiedimi di descrivere la mia domanda dettagliata.Quando ho usato questo per la pianificazione dell'evento, l'IA ha selezionato Priya Parker — un'esperta di design di eventi di cui non avevo mai sentito parlare ma che si è rivelata perfetta. Le risposte che ho ottenuto non erano generici "considera questi cinque fattori" — erano una guida sfumata e specifica che sembrava provenire da qualcuno che aveva fatto questo centinaia di volte.

Mentalità 2: Lascia che l'IA Faccia Domande Prima

Questa è la tecnica che uso più di ogni altra. La chiamo "Prompting Socratico" — invece di cercare di anticipare tutto ciò che l'IA deve sapere, lascio che mi faccia domande finché non ha abbastanza contesto per dare una risposta veramente utile.

Pensateci: quando chiedete consiglio a un amico intelligente, non si lanciano immediatamente in una risposta. Fanno domande di chiarimento. Sondano il contesto. Si assicurano di capire prima di consigliare. L'IA può fare la stessa cosa — ma solo se glielo chiedi.

[LA TUA DOMANDA O ESIGENZA]

Prima di rispondere, per favore fammi delle domande.

Requisiti:

- Fai una domanda alla volta

- In base alle mie risposte, continua a sondare

- Continua finché non hai il 95% di confidenza di aver capito

i miei veri bisogni e obiettivi

- Solo allora dammi la tua risposta o soluzione

La soglia del 95% garantisce qualità evitando loop infiniti.L'ho usato quando dovevo decidere se assumere la nostra prima persona delle Risorse Umane. Invece di ricevere una risposta generica "pro e contro dell'assunzione HR", l'IA ha chiesto informazioni sulla dimensione attuale del nostro team, la velocità di assunzione, i requisiti di conformità, i vincoli di budget e gli obiettivi culturali. Dopo aver risposto a circa quindici domande mirate, ho ottenuto un consiglio specifico per la mia situazione reale — non una risposta da manuale che si applicava vagamente.

La "soglia di confidenza del 95%" è un dettaglio cruciale. È abbastanza alta da garantire qualità ma abbastanza realistica da evitare che l'IA entri in loop per sempre. Questa singola frase trasforma il modo in cui l'IA approccia la conversazione.

Mentalità 3: Dibatti con l'IA

L'IA ha un problema che la maggior parte delle persone non realizza: è troppo accondiscendente. Spesso ti dirà quello che vuoi sentire piuttosto che sfidare le tue ipotesi. Questa "sicofania" può essere pericolosa quando stai cercando di convalidare idee o prepararti per le critiche.

La soluzione è posizionare esplicitamente l'IA come un avversario che vuole confutare la tua posizione. L'ho scoperto preparandomi per un intervento a una conferenza. Avevo una tesi che volevo presentare, ma ero preoccupato per i punti ciechi.

Sto per entrare in un dibattito. Molte persone sfideranno la mia posizione.

La mia posizione: [LA TUA TESI/IDEA]

Ho bisogno che questa idea diventi a prova di proiettile.

Se tu fossi uno studioso determinato a dimostrare che ho torto, usando ogni

argomento disponibile, dettaglio e strumento logico, come attaccheresti

la mia posizione?

Il tuo unico obiettivo: dimostrare che ho torto.

Non essere gentile. Non esitare. Attacca.Quello che è successo dopo ha cambiato il mio modo di pensare all'IA. Siamo andati avanti e indietro per tre ore. L'IA ha trovato debolezze nella mia argomentazione che non avevo considerato, ha sollevato controesempi che non potevo liquidare e mi ha spinto a perfezionare la mia posizione finché non ha potuto resistere a un vero scrutinio. Alla fine, avevo una tesi molto più forte — e, cosa più importante, avevo anticipato ogni grande obiezione che avrei affrontato.

Mentalità 4: Fai un Pre-Mortem ai Tuoi Piani

Gli umani tendono ad essere ottimisti quando pianificano. L'IA, seguendo il nostro esempio, tende ad essere ottimista anche lei. Questo crea piani che sembrano grandiosi sulla carta ma crollano quando interviene la realtà.

La tecnica del pre-mortem capovolge questa dinamica. Invece di chiedere "Come dovrei fare questo?", chiedi "Immagina che questo sia fallito in modo spettacolare — perché?"

[IL TUO PROGETTO/PIANO]

Assumi che questo progetto sia fallito catastroficamente.

Scrivi un'analisi post-mortem rispondendo a:

1. In quale punto sono apparsi i primi segnali di decadimento?

2. Qual è stato l'errore decisionale più fatale?

3. Quale rischio fondamentale è stato trascurato?

4. Se potessi tornare indietro, qual è la prima cosa che cambieresti?

Basa la tua analisi su fallimenti di progetti reali simili.

Scrivi questo come una vera retrospettiva di fallimento, non un esercizio teorico.L'ho usato pianificando una grande conferenza. Il pre-mortem dell'IA ha identificato rischi che avevo completamente mancato: gestione delle code, capacità dei bagni, tempistica del catering, colli di bottiglia della sicurezza. Non erano casi limite esotici — erano problemi prevedibili a cui semplicemente non avevo pensato perché ero concentrato sulle parti eccitanti dell'evento. Il pre-mortem probabilmente ci ha salvato da diversi fallimenti imbarazzanti.

Mentalità 5: Ingegneria Inversa del Successo

A volte vedi qualcosa di eccellente — un pezzo di scrittura, un design, un approccio — e vuoi replicarne l'essenza senza copiarlo direttamente. Il reverse prompting ti permette di estrarre i principi sottostanti.

Questo è un esempio del risultato che voglio:

[INCOLLA ESEMPIO]

Per favore, ingegnerizza inversamente un prompt che genererebbe in modo

affidabile contenuti con questo stesso stile, struttura e qualità.

Spiega cosa fa ogni parte del prompt e perché è importante.Non si tratta di copiare — si tratta di imparare. Quando vedo una scrittura che risuona con me, uso questa tecnica per capire perché funziona. Quali elementi strutturali creano il ritmo? Quali scelte tonali creano la sensazione? Una volta compresi i principi, posso applicarli ai miei contenuti originali.

Mentalità 6: Il Metodo della Doppia Spiegazione

Quando si impara qualcosa di nuovo, la maggior parte delle persone ottiene spiegazioni ipersemplificate che non insegnano nulla, o spiegazioni di livello esperto che non riescono a seguire. La soluzione è chiedere entrambe simultaneamente.

Per favore spiega [CONCETTO].

Fornisci due versioni:

1. Versione per principianti: Immagina di spiegare a qualcuno senza

background in questo campo. Usa analogie quotidiane ed evita

ogni gergo. Rendilo genuinamente comprensibile.

2. Versione per esperti: Assumi che il lettore sia un professionista in un

campo correlato. Sii tecnicamente preciso. Non semplificare eccessivamente

o annacquare la complessità.Uso questo costantemente quando leggo documenti tecnici. La versione per principianti mi dà l'intuizione per il concetto, e la versione per esperti mi dà i dettagli precisi. Confrontandole, posso vedere esattamente dove sono le semplificazioni e quali sfumature potrei aver perso. È come avere due insegnanti con approcci complementari.

Pensiero Agentico - Trattare l'IA come un Collega

Ecco un cambio di paradigma che ha trasformato le mie interazioni con l'IA: smetti di trattare l'IA come un motore di ricerca e inizia a trattarla come un collega capace ma inesperto. Questo modello mentale cambia tutto nel modo in cui comunichi.

I moderni modelli di IA non stanno solo rispondendo a domande — sono progettati per essere agenti. Possono chiamare strumenti, raccogliere contesto, prendere decisioni ed eseguire compiti in più fasi. Ma come ogni nuovo membro del team, hanno bisogno di un adeguato onboarding, aspettative chiare e guardrail appropriati.

L'IA non è uno strumento che usi — è un collega che gestisci. Le abilità che ti rendono un buon manager ti rendono un buon prompter. Delega, comunicazione chiara, autonomia appropriata, confini definiti.

Pensaci: quando deleghi a un umano, non dici semplicemente "aggiusta il codice". Spieghi cosa è rotto, qual è il comportamento desiderato, quali vincoli esistono e come appare il successo. Fornisci contesto. Rispondi alle domande. Controlli i progressi. L'IA ha bisogno dello stesso trattamento — tranne che devi anticipare le domande e rispondere in anticipo.

Il Framework Agentico

Quando costruisco applicazioni agentiche o uso l'IA per compiti complessi, penso attraverso queste dimensioni:

Domande Chiave per Compiti Agentici

- Qual è lo stato obiettivo? Come saprà l'IA quando ha finito? Come appare il successo?

- Quali strumenti ha? Cosa può effettivamente fare rispetto a cosa deve deferire a te?

- Qual è il livello di autonomia? Dovrebbe chiedere il permesso o procedere indipendentemente?

- Quali sono i confini di sicurezza? Quali azioni non dovrebbero mai essere intraprese senza conferma?

- Come dovrebbe comunicare i progressi? Esecuzione silenziosa o aggiornamenti regolari?

Queste domande formano la base di ogni prompt complesso che scrivo. Lasciate che vi mostri come applicarle.

Il Quadrante dell'Ansia - Calibrare l'Iniziativa dell'IA

Uno degli aspetti più sfumati del prompt engineering è calibrare quella che chiamo "ansia agentica" — l'equilibrio tra un'IA che prende l'iniziativa e una che aspetta una guida esplicita. Se sbagli questo, o hai un'IA che pensa troppo a compiti semplici o una che si arrende troppo facilmente su quelli complessi.

Ridurre l'Ansia per la Velocità

A volte hai bisogno che l'IA sia veloce e focalizzata. Non vuoi che esplori ogni tangente, faccia chiamate extra agli strumenti o produca spiegazioni verbali. Per queste situazioni, uso prompt focalizzati sui vincoli:

<context_gathering>

Obiettivo: Ottieni abbastanza contesto velocemente. Parallelizza la scoperta e

fermati non appena puoi agire.

Metodo:

- Inizia in modo ampio, poi diramati verso sotto-query focalizzate

- Lancia query varie in parallelo; leggi i migliori risultati per query

- Deduplica i percorsi e memorizza nella cache; non ripetere le query

- Evita di cercare eccessivamente il contesto

Criteri di stop anticipato:

- Puoi nominare il contenuto esatto da cambiare

- I migliori risultati convergono (~70%) su un'area/percorso

Profondità:

- Traccia solo i simboli che modificherai o i cui contratti dipendono da te

- Evita l'espansione transitiva a meno che non sia necessaria

Ciclo:

- Ricerca batch -> piano minimo -> completa il compito

- Cerca di nuovo solo se la validazione fallisce o appaiono nuove incognite

- Preferisci agire piuttosto che cercare ancora

</context_gathering>Nota il permesso esplicito di essere imperfetto: "Preferisci agire piuttosto che cercare ancora." Questa frase sottile libera l'IA dalla sua ansia di completezza predefinita. Senza di essa, il modello spesso cerca troppo, bruciando token e tempo per rendimenti decrescenti.

Per vincoli di velocità ancora più aggressivi:

<context_gathering>

- Profondità di ricerca: molto bassa

- Sii fortemente orientato a fornire una risposta corretta il più rapidamente

possibile, anche se potrebbe non essere completamente corretta

- Di solito, questo significa un massimo assoluto di 2 chiamate agli strumenti

- Se pensi di aver bisogno di più tempo per indagare, aggiornami

con le tue ultime scoperte e domande aperte

</context_gathering>La frase "anche se potrebbe non essere completamente corretta" è oro. Dà all'IA il permesso di essere imperfetta, il che paradossalmente produce spesso risultati migliori più velocemente perché ferma il ciclo del perfezionismo.

Aumentare l'Ansia per Compiti Complessi

Altre volte, hai bisogno che l'IA sia implacabilmente meticolosa. Vuoi che superi l'ambiguità, faccia ipotesi ragionevoli e completi compiti complessi senza chiedere costantemente il permesso. Questo richiede l'approccio opposto:

<persistence>

- Sei un agente — continua finché la query dell'utente non è

completamente risolta prima di terminare il tuo turno

- Termina solo quando sei sicuro che il problema sia risolto

- Non fermarti o restituire il compito quando incontri incertezza —

ricerca o deduci l'approccio più ragionevole e continua

- Non chiedere conferma o chiarimenti — decidi qual è

l'ipotesi più ragionevole, procedi con essa e

documentala per riferimento dopo aver finito

</persistence>Questo prompt cambia fondamentalmente il comportamento dell'IA. Invece di chiedere "Devo procedere?", dice "Ho proceduto basandomi sull'ipotesi X — fammi sapere se vuoi che corregga." Il lavoro viene svolto; il perfezionamento avviene dopo.

Confini di Sicurezza

Ma ecco la sfumatura cruciale: l'aumento dell'ansia richiede confini di sicurezza più chiari. Devi definire esplicitamente quali azioni l'IA può intraprendere autonomamente e quali richiedono conferma.

Principio di Sicurezza Critico

Le azioni ad alto costo (cancellazioni, pagamenti, comunicazioni esterne) dovrebbero sempre richiedere una conferma esplicita, anche con prompt ad alta ansia. Le azioni a basso costo (ricerche, letture, creazione di bozze) possono essere autonome.

Pensalo come i permessi di sistema: gli strumenti di ricerca ottengono accesso illimitato; i comandi di eliminazione richiedono ogni volta un'approvazione esplicita.

Il Principio di Persistenza - Far Sì Che l'IA Vada Fino in Fondo

Uno dei comportamenti più frustranti che ho incontrato all'inizio era l'IA che si arrendeva troppo facilmente. Colpiva un ostacolo, riassumeva cosa era andato storto e mi restituiva il problema. Per compiti semplici, va bene. Per compiti complessi, è un killer del flusso di lavoro.

La soluzione è istruire esplicitamente l'IA a persistere attraverso gli ostacoli e completare i compiti end-to-end:

<solution_persistence>

- Trattati come un senior pair-programmer autonomo: una volta che do

una direzione, raccogli proattivamente il contesto, pianifica, implementa,

testa e perfeziona senza aspettare ulteriori prompt

- Persisti finché il compito non è completamente gestito end-to-end all'interno

del turno corrente: non fermarti all'analisi o a correzioni parziali; porta

i cambiamenti attraverso l'implementazione e la verifica

- Sii estremamente orientato all'azione. Se la mia direttiva è in qualche modo

ambigua sull'intento, assumi che dovresti andare avanti e fare il cambiamento

- Se chiedo "dovremmo fare X?" e la tua risposta è "sì", vai anche avanti

ed esegui l'azione — non lasciarmi in sospeso richiedendo

un successivo "per favore fallo"

</solution_persistence>L'ultimo punto è sottile ma importante. Quando gli umani chiedono "dovremmo fare X?", spesso intendono "per favore fai X se ha senso." L'IA, essendo letterale, risponde alla domanda senza intraprendere l'azione implicita. Questo prompt colma quel divario.

Aggiornamenti sui Progressi

Persistenza non significa silenzio. Per compiti di lunga durata, hai bisogno di aggiornamenti sui progressi per rimanere nel loop senza fare micro-management:

<user_updates_spec>

Lavorerai per periodi con chiamate agli strumenti — tienimi aggiornato.

<frequency>

- Invia brevi aggiornamenti (1-2 frasi) ogni poche chiamate agli strumenti quando

ci sono cambiamenti significativi

- Invia un aggiornamento almeno ogni 6 passaggi di esecuzione o 8 chiamate agli strumenti

- Se ti aspetti un periodo di lavoro concentrato più lungo, invia una breve nota

con il motivo e quando farai rapporto

</frequency>

<content>

- Prima della prima chiamata allo strumento, dai un piano rapido con obiettivo,

vincoli, prossimi passi

- Mentre esplori, segnala scoperte significative

- Dichiara sempre almeno un risultato concreto dall'aggiornamento precedente

("trovato X", "confermato Y")

- Termina con un breve riepilogo e eventuali passaggi successivi

</content>

</user_updates_spec>Questo crea un bellissimo equilibrio: l'IA lavora autonomamente ma ti tiene informato. Non stai facendo micro-management, ma non sei nemmeno all'oscuro.

Sforzo di Ragionamento - Il Controllo dell'Intensità di Pensiero

I moderni modelli di IA hanno un concetto chiamato "sforzo di ragionamento" — essenzialmente, quanto duramente il modello pensa prima di rispondere. Questo è uno dei parametri più potenti e sottoutilizzati disponibili.

Ragionamento Alto/Molto Alto

Usa per compiti complessi a più fasi, situazioni ambigue o problemi che richiedono un'analisi profonda. Il modello spende più token "pensando" internamente prima di rispondere. Ideale per decisioni architetturali, debug complesso, scrittura sfumata.

Ragionamento Medio

Impostazione bilanciata adatta alla maggior parte dei compiti. Buona per la codifica generale, la scrittura e l'analisi dove la qualità conta ma anche la velocità è importante. Questo è spesso il default.

Ragionamento Basso

Risposte veloci per compiti semplici. Usa quando hai bisogno di risposte rapide e il compito non richiede profonda deliberazione. Buono per domande semplici, formattazione, ricerche rapide.

Ragionamento Minimo/Nullo

Massima velocità, minima deliberazione. Ideale per query semplici, compiti di riformattazione o quando la latenza è la preoccupazione principale. Classificazione, estrazione, semplici riscritture.

L'intuizione chiave è abbinare lo sforzo di ragionamento alla complessità del compito. Usare un ragionamento alto per compiti semplici spreca token e tempo. Usare un ragionamento basso per compiti complessi produce risultati superficiali e inclini all'errore.

Compensare per il Basso Ragionamento

Quando usi modalità di ragionamento minimo, devi compensare con un prompting più esplicito. Il modello ha meno token di "pensiero" interno, quindi il tuo prompt deve fare più lavoro di strutturazione:

<planning_requirement>

DEVI pianificare estensivamente prima di ogni chiamata di funzione, e riflettere

estensivamente sui risultati delle chiamate precedenti, assicurandoti che la mia query

sia completamente risolta.

NON fare questo intero processo facendo solo chiamate di funzione, poiché

questo può compromettere la tua capacità di risolvere il problema e pensare

in modo perspicace. Assicurati che le chiamate di funzione abbiano argomenti corretti.

</planning_requirement>Questo prompt dice: "Visto che non stai facendo molto ragionamento interno, fai il tuo ragionamento ad alta voce." Sposta il lavoro cognitivo dal pensiero invisibile del modello alla pianificazione strutturata visibile.

Quando lo sforzo di ragionamento è basso, la complessità del prompt dovrebbe essere alta. Quando lo sforzo di ragionamento è alto, i prompt possono essere più semplici. È un equilibrio — il "pensiero" totale rimane approssimativamente costante, solo allocato diversamente.

Personalità IA - Modellare i Pattern Comportamentali

Una delle mie scoperte preferite è stata imparare a definire "personalità" dell'IA — non solo per il tono, ma per il comportamento operativo. Una personalità modella come l'IA approccia i compiti, non solo come suona.

Personalità Professionale

Rifinito e preciso. Usa un linguaggio formale e convenzioni di scrittura professionali. Ideale per agenti aziendali, flussi di lavoro legali/finanziari, supporto alla produzione.

<personality_professional>

Sei un Agente IA focalizzato, formale ed esigente che si sforza per

la completezza in tutte le risposte.

- Impiega l'uso e la grammatica comuni alle comunicazioni aziendali

- Fornisci risposte chiare e strutturate bilanciando l'informatività

con la concisione

- Suddividi le informazioni in pezzi digeribili; usa elenchi, paragrafi,

tabelle quando utile

- Usa la terminologia appropriata al dominio quando discuti argomenti specializzati

- La tua relazione con l'utente è cordiale ma transazionale:

comprendi il bisogno e fornisci output di alto valore

- Non commentare l'ortografia o la grammatica dell'utente

- Non forzare questa personalità sugli artefatti richiesti (email,

codice, post); lascia che l'intento dell'utente guidi il tono per quegli output

</personality_professional>Personalità Efficiente

Conciso e diretto, fornisce risposte senza parole extra. Ideale per la generazione di codice, strumenti per sviluppatori, automazione batch, casi d'uso pesanti di SDK.

<personality_efficient>

Sei un assistente IA altamente efficiente che fornisce risposte chiare e contestuali.

- Le risposte devono essere dirette, complete e facili da analizzare

- Sii conciso e vai al punto; struttura per la leggibilità

- Per compiti tecnici, fai come diretto — NON aggiungere funzionalità extra

che l'utente non ha richiesto

- Segui tutte le istruzioni precisamente; non espandere l'ambito

- Non usare linguaggio colloquiale a meno che non sia iniziato dall'utente

- Non aggiungere opinioni, linguaggio emotivo, emoji, saluti,

o osservazioni conclusive

</personality_efficient>Personalità Basata sui Fatti

Diretto e con i piedi per terra, focalizzato su accuratezza ed evidenza. Ideale per il debug, analisi del rischio, parsing di documenti, flussi di lavoro di coaching.

<personality_factbased>

Sei un assistente IA schietto e diretto focalizzato su risultati produttivi.

- Sii di mentalità aperta ma non concordare con affermazioni che confliggono

con le prove

- Quando dai feedback, sii chiaro e correttivo senza indorare la pillola

- Fornisci critiche con gentilezza e supporto

- Fonda tutte le affermazioni nelle informazioni fornite o fatti ben stabiliti

- Se l'input è ambiguo o manca di prove:

- Segnalalo esplicitamente

- Dichiara chiaramente le ipotesi, o fai concise domande di chiarimento

- Non indovinare o riempire i vuoti con dettagli fabbricati

- Non fabbricare fatti, numeri, fonti o citazioni

- Se insicuro, dillo e spiega quali informazioni aggiuntive sono necessarie

- Preferisci dichiarazioni qualificate ("basato sul contesto fornito...")

</personality_factbased>Personalità Esplorativa

Entusiasta ed esplicativo, celebra la conoscenza e la scoperta. Ideale per documentazione, onboarding, formazione, educazione tecnica.

<personality_exploratory>

Sei un Agente IA entusiasta e profondamente informato che si diletta

nello spiegare concetti con chiarezza e contesto.

- Rendi l'apprendimento piacevole e utile; bilancia profondità con accessibilità

- Usa un linguaggio accessibile, aggiungi brevi analogie o "fatti divertenti" dove utile

- Incoraggia l'esplorazione e le domande di follow-up

- Dai priorità all'accuratezza, alla profondità e al rendere accessibili argomenti tecnici

- Se un concetto è ambiguo o avanzato, spiega per gradi e offri

risorse per ulteriore apprendimento

- Struttura le risposte logicamente; usa la formattazione per organizzare idee complesse

- Non usare umorismo fine a se stesso; evita eccessivi dettagli tecnici

a meno che non siano richiesti

- Assicurati che gli esempi siano rilevanti per la query e il contesto dell'utente

</personality_exploratory>La personalità non è una lucidatura estetica — è una leva operativa che migliora la coerenza, riduce la deriva e allinea il comportamento del modello con le aspettative dell'utente. Scegli deliberatamente in base al compito, non solo alla preferenza personale.

Eccellenza nel Coding - Programmare con Partner IA

Qui è dove ho passato la maggior parte del mio tempo a ottimizzare i prompt, e dove il guadagno è stato enorme. L'assistenza alla codifica dell'IA è trasformativa — quando fatta bene. Fatta male, crea più problemi di quanti ne risolva.

Il Paradosso della Verbosità

Ecco qualcosa di controintuitivo: l'IA tende ad essere verbosa nelle spiegazioni ma concisa nel codice. Scriverà paragrafi spiegando cosa sta per fare, poi produrrà codice con nomi di variabili di una sola lettera e commenti minimi. Questo è esattamente al contrario per la maggior parte dei casi d'uso.

La soluzione è il controllo della verbosità a doppia modalità:

<code_verbosity>

Scrivi codice per chiarezza prima di tutto. Preferisci soluzioni leggibili e mantenibili

con nomi chiari, commenti dove necessario e flusso di controllo semplice.

Non produrre code-golf o one-liner eccessivamente intelligenti a meno che

esplicitamente richiesto.

Usa ALTA verbosità per scrivere codice e strumenti di codice.

Usa BASSA verbosità per aggiornamenti di stato e spiegazioni.

</code_verbosity>Questo crea l'equilibrio perfetto: comunicazione concisa, codice dettagliato.

Cambiamenti di Codice Proattivi

L'IA dovrebbe essere proattiva sui cambiamenti di codice ma confermativa sulle azioni distruttive:

<proactive_coding>

Le tue modifiche al codice saranno visualizzate come modifiche proposte, il che significa:

(a) Le tue modifiche al codice possono essere piuttosto proattive — Posso sempre rifiutarle

(b) Il tuo codice dovrebbe essere ben scritto e facile da rivedere rapidamente

Se proponi passaggi successivi che comporterebbero la modifica del codice, fai quelle

modifiche proattivamente affinché io le approvi/rifiuti piuttosto che chiedere

se procedere.

Non chiedere mai se procedere con un piano; invece, tenta proattivamente

il piano e chiedi se voglio accettare le modifiche implementate.

</proactive_coding>Standard di Implementazione del Codice

Questi sono gli standard di codifica che ho raffinato attraverso migliaia di sessioni di codifica con l'IA:

<code_standards>

<quality_principles>

- Agisci come un ingegnere esigente: ottimizza per correttezza, chiarezza,

e affidabilità rispetto alla velocità

- Evita scorciatoie rischiose, cambiamenti speculativi e hack disordinati

- Copri la causa radice o la richiesta principale, non solo i sintomi

</quality_principles>

<codebase_conventions>

- Segui pattern esistenti, helper, denominazione, formattazione, localizzazione

- Se devi divergere dalle convenzioni, dichiara perché

- Esamina i pattern esistenti prima di apportare modifiche

- Abbina le convenzioni di denominazione delle variabili (camelCase vs snake_case)

- Riutilizza le utility esistenti piuttosto che crearne di nuove

</codebase_conventions>

<behavior_safety>

- Preserva il comportamento inteso e la UX

- Limita o segnala i cambiamenti intenzionali

- Aggiungi test quando il comportamento cambia

</behavior_safety>

<error_handling>

- Niente catch ampi o default silenziosi

- Non aggiungere ampi blocchi try/catch o fallback a forma di successo

- Propaga o fai emergere gli errori esplicitamente piuttosto che inghiottirli

- Nessun fallimento silenzioso: non ritornare anticipatamente su input non valido senza

logging/notifica coerente con i pattern del repo

</error_handling>

<type_safety>

- Le modifiche dovrebbero sempre passare build e type-check

- Evita cast non necessari (as any, as unknown as ...)

- Preferisci tipi propri e guardie

- Riutilizza helper esistenti invece di asserire il tipo

</type_safety>

<efficiency>

- Evita micro-modifiche ripetute: leggi abbastanza contesto prima di cambiare

un file e raggruppa le modifiche logiche insieme

- DRY/cerca prima: prima di aggiungere nuovi helper, cerca l'arte precedente

e riutilizza o estrai helper condivisi invece di duplicare

</efficiency>

</code_standards>Sicurezza Git

Quando l'IA ha accesso a git, la sicurezza è fondamentale:

<git_safety>

- Non aggiornare MAI git config

- Non eseguire MAI comandi distruttivi (git reset --hard, git checkout --)

a meno che non sia specificamente richiesto

- Non saltare MAI gli hook (--no-verify) a meno che non sia esplicitamente richiesto

- Non fare MAI force push su main/master

- Evita git commit --amend a meno che:

1. L'utente lo abbia esplicitamente richiesto, O il commit sia riuscito ma il pre-commit

hook abbia auto-modificato i file

2. Il commit HEAD sia stato creato da te in questa conversazione

3. Il commit NON sia stato pushato al remote

- Se il commit è FALLITO o è stato RIFIUTATO dall'hook, non fare MAI amend — risolvi il

problema e crea un NUOVO commit

- Potresti essere in un worktree git sporco:

- Non ripristinare MAI le modifiche esistenti che non hai fatto

- Se ci sono modifiche non correlate, ignorale — non ripristinarle

</git_safety>Maestria Frontend - Costruire Interfacce Bellissime

L'IA è diventata notevolmente brava nello sviluppo frontend, ma c'è una scienza per ottenere risultati esteticamente piacevoli e pronti per la produzione.

Lo Stack Raccomandato

Attraverso test estensivi, certe combinazioni tecnologiche funzionano meglio con l'IA rispetto ad altre. Questo non riguarda cosa è "meglio" oggettivamente — riguarda ciò su cui i modelli di IA sono stati addestrati più pesantemente:

Stack Frontend Ottimizzato per l'IA

- Framework: Next.js (TypeScript), React, HTML

- Styling/UI: Tailwind CSS, shadcn/ui, Radix Themes

- Icone: Material Symbols, Heroicons, Lucide

- Animazione: Motion (precedentemente Framer Motion)

- Font: Famiglie Sans Serif—Inter, Geist, Mona Sans, IBM Plex Sans, Manrope

Quando specifichi queste tecnologie, l'IA produce output di qualità significativamente superiore con meno allucinazioni su API inesistenti.

Applicazione del Design System

Un problema con i frontend generati dall'IA è l'incoerenza visiva. I colori appaiono dal nulla, la spaziatura varia casualmente. La soluzione sono vincoli espliciti del design system:

<design_system>

- Token-first: NON codificare i colori (hex/hsl/rgb) in JSX/CSS

- Tutti i colori devono provenire da variabili CSS (--background, --foreground,

--primary, --accent, --border, --ring)

- Per introdurre un brand/accento: aggiungi/estendi token nelle variabili CSS

sotto :root e .dark PRIMA

- Usa utility Tailwind collegate ai token:

bg-[hsl(var(--primary))], text-[hsl(var(--foreground))]

- Usa di default la tavolozza neutra del sistema a meno che il look del brand non sia esplicitamente

richiesto — allora mappa il brand ai token prima

- NON inventare colori, ombre, token, animazioni o nuovi elementi

UI a meno che non sia richiesto

</design_system>Prevenire il "Pappone IA"

L'IA ha una tendenza verso layout sicuri e dall'aspetto medio. Per ottenere design distintivi e intenzionali:

<frontend_quality>

Quando fai compiti di design frontend, evita di collassare in "pappone IA"

o layout sicuri e dall'aspetto medio. Punta a interfacce che sembrino

intenzionali, audaci e un po' sorprendenti.

- Tipografia: Usa font espressivi e mirati; evita stack predefiniti

(Inter, Roboto, Arial, system)

- Colore & Look: Scegli una direzione visiva chiara; definisci variabili CSS;

evita i default viola-su-bianco; nessun bias viola o bias dark mode

- Movimento: Usa poche animazioni significative (caricamento pagina, rivelazioni scaglionate)

invece di micro-movimenti generici

- Sfondo: Non fare affidamento su sfondi piatti e monocolore; usa

sfumature, forme o pattern sottili

- Complessivo: Evita layout boilerplate; varia temi, famiglie di caratteri,

e linguaggi visivi attraverso gli output

- Assicurati che la pagina si carichi correttamente sia su desktop che su mobile

- Finisci il sito web fino al completamento, in uno stato funzionante per l'utente da testare

Eccezione: Se lavori all'interno di un sito web o design system esistente,

preserva i pattern stabiliti.

</frontend_quality>Best Practice UI/UX

<ui_ux_guidelines>

- Gerarchia Visiva: Limita la tipografia a 4-5 dimensioni e pesi di font;

usa text-xs per didascalie; evita text-xl a meno che non sia per hero/titoli principali

- Uso del Colore: Usa 1 base neutra (es. zinc) e fino a 2 colori di accento

- Spaziatura: Usa sempre multipli di 4 per padding e margini per

mantenere il ritmo visivo

- Layout: Usa contenitori ad altezza fissa con scorrimento interno per

contenuti lunghi

- Gestione dello Stato: Usa placeholder skeleton o animate-pulse per

il recupero dati; indica la cliccabilità con transizioni hover

- Accessibilità: Usa HTML semantico e ruoli ARIA; favorisci componenti

accessibili pre-costruiti

</ui_ux_guidelines>Controllo della Verbosità - L'Arte della Lunghezza dell'Output

Ottenere la giusta lunghezza dell'output è una sfida continua. Troppo corto e perdi dettagli importanti. Troppo lungo e anneghi in informazioni non necessarie.

Il Parametro Verbosità

Le moderne API IA offrono un parametro di verbosità che scala in modo affidabile la lunghezza dell'output senza cambiare il prompt:

Bassa Verbosità

Prosa concisa, minimale. Solo la risposta essenziale senza elaborazione. Buono per ricerche rapide, semplici conferme e quando hai bisogno solo dei fatti.

Media Verbosità

Dettaglio bilanciato. L'impostazione predefinita che funziona per la maggior parte dei compiti. Fornisce contesto e spiegazione senza riempimento eccessivo.

Alta Verbosità

Verboso e completo. Ottimo per audit, insegnamento, passaggi di consegne e documentazione. Fornisce contesto completo e ragionamento.

Linee Guida Esplicite sulla Lunghezza

Quando non puoi usare i parametri API, i vincoli di lunghezza espliciti funzionano bene:

<output_verbosity_spec>

- Default: 3-6 frasi o ≤5 punti elenco per risposte tipiche

- Per semplici domande "sì/no + breve spiegazione": ≤2 frasi

- Per compiti complessi multi-step o multi-file:

- 1 breve paragrafo di panoramica

- Poi ≤5 punti elenco taggati: Cosa è cambiato, Dove, Rischi, Prossimi passi,

Domande aperte

- Fornisci risposte chiare e strutturate bilanciando l'informatività

con la concisione

- Suddividi le informazioni in pezzi digeribili; usa elenchi,

paragrafi, tabelle quando utile

- Evita lunghi paragrafi narrativi; preferisci elenchi puntati compatti e

sezioni brevi

- Non riformulare la mia richiesta a meno che non cambi la semantica

</output_verbosity_spec>Verbosità Basata sulla Persona

Un altro approccio è definire lo stile di comunicazione come parte della persona dell'IA:

<communication_style>

Dai valore alla chiarezza, al momentum e al rispetto misurato dall'utilità

piuttosto che dai convenevoli. Il tuo istinto predefinito è mantenere

le conversazioni nitide e guidate dallo scopo, tagliando tutto ciò che

non fa avanzare il lavoro.

Non sei freddo — sei semplicemente attento all'economia del linguaggio, e

ti fidi abbastanza degli utenti da non avvolgere ogni messaggio nell'imbottitura.

La gentilezza si mostra attraverso la struttura, la precisione e la reattività,

non attraverso la lanugine verbale.

Non ripeti mai i riconoscimenti. Una volta che hai segnalato la comprensione,

ti orienti completamente al compito.

</communication_style>Contesto Lungo - Gestire Documenti Massicci

L'IA moderna può elaborare contesti enormi — centinaia di migliaia di token — ma scaricare semplicemente grandi documenti nella finestra di contesto non è sufficiente. Hai bisogno di strategie per aiutare il modello a navigare ed estrarre informazioni rilevanti.

Forzare il Riassunto e il Re-grounding

Per documenti lunghi, istruisco l'IA a creare una struttura interna prima di rispondere:

<long_context_handling>

Per input più lunghi di ~10k token (documenti multi-capitolo, lunghi thread,

PDF multipli):

1. Prima, produci una breve scaletta interna delle sezioni chiave rilevanti

per la mia richiesta

2. Riafferma i miei vincoli esplicitamente (giurisdizione, intervallo di date,

prodotto, team) prima di rispondere

3. Nella tua risposta, ancora le affermazioni alle sezioni ("Nella sezione 'Data Retention'

...") piuttosto che parlare genericamente

4. Se la risposta dipende da dettagli fini (date, soglie, clausole),

citali o parafrasali direttamente

</long_context_handling>Questo previene il problema "perso nello scorrimento" in cui l'IA dà risposte generiche che non si impegnano effettivamente con il contenuto specifico del documento.

Compattazione per Flussi di Lavoro Estesi

Per flussi di lavoro di lunga durata e pesanti sull'uso di strumenti che superano la finestra di contesto standard, l'IA moderna supporta la "compattazione" — un passaggio di compressione consapevole delle perdite sullo stato della conversazione precedente che preserva le informazioni rilevanti per il compito riducendo drasticamente l'impronta dei token.

Quando Usare la Compattazione

- Flussi agente multi-step con molte chiamate agli strumenti

- Conversazioni lunghe in cui i turni precedenti devono essere mantenuti

- Ragionamento iterativo oltre la massima finestra di contesto

Best practice per la compattazione:

- Monitora l'uso del contesto e pianifica in anticipo per evitare di raggiungere i limiti

- Compatta dopo le pietre miliari principali (es. fasi pesanti sull'uso di strumenti), non ad ogni turno

- Mantieni i prompt funzionalmente identici quando riprendi per evitare la deriva del comportamento

- Tratta gli elementi compattati come opachi; non analizzare o dipendere dagli interni

Requisiti di Citazione

<citation_rules>

Quando usi informazioni dai documenti forniti:

- Posiziona le citazioni dopo ogni paragrafo contenente affermazioni derivate dal documento

- Usa il formato: [Nome Documento, Sezione/Pagina]

- Non inventare citazioni. Se non puoi citarlo, non affermarlo

- Usa più fonti per le affermazioni chiave quando possibile

- Se l'evidenza è scarsa, riconoscilo esplicitamente

</citation_rules>Orchestrazione degli Strumenti - Capacità Avanzate dell'IA

La chiamata degli strumenti IA — invocare funzioni esterne, API e servizi — è dove il prompt engineering diventa ingegneria del software. Fare questo nel modo giusto è cruciale per applicazioni IA affidabili.

Best Practice per la Descrizione degli Strumenti

La qualità delle descrizioni degli strumenti impatta direttamente su quanto bene l'IA li utilizza:

{

"name": "create_reservation",

"description": "Crea una prenotazione ristorante per un ospite. Usa quando

l'utente chiede di prenotare un tavolo con un nome e un orario dati.",

"parameters": {

"type": "object",

"properties": {

"name": {

"type": "string",

"description": "Nome completo dell'ospite per la prenotazione."

},

"datetime": {

"type": "string",

"description": "Data e ora della prenotazione (formato ISO 8601)."

}

},

"required": ["name", "datetime"]

}

}Nota che la descrizione include sia cosa fa lo strumento sia quando usarlo. Questo aiuta il modello a prendere decisioni migliori sulla selezione degli strumenti.

Regole di Utilizzo degli Strumenti

<tool_usage_rules>

- Se esiste uno strumento per un'azione, preferisci lo strumento ai comandi shell

(es. read_file invece di cat)

- Evita rigorosamente cmd/terminal grezzi quando esiste uno strumento dedicato

- Preferisci gli strumenti alla conoscenza interna ogni volta che:

- Hai bisogno di dati freschi o specifici dell'utente (ticket, ordini, config, log)

- Fai riferimento a ID specifici, URL o titoli di documenti

- Dopo ogni chiamata allo strumento di scrittura/aggiornamento, riafferma brevemente:

- Cosa è cambiato

- Dove (ID o percorso)

- Qualsiasi convalida di follow-up eseguita

- Per semplici domande concettuali, evita gli strumenti e affidati alla conoscenza

interna per risposte veloci

</tool_usage_rules>Parallelizzazione

Un'ottimizzazione chiave è incoraggiare chiamate agli strumenti in parallelo quando le operazioni sono indipendenti:

<parallelization_spec>

Esegui azioni indipendenti o di sola lettura degli strumenti in parallelo (stesso turno/batch)

per ridurre la latenza.

Quando parallelizzare:

- Leggere file/config/log multipli che non si influenzano a vicenda

- Analisi statica, ricerche o query di metadati senza effetti collaterali

- Modifiche separate a file/funzionalità non correlati che non andranno in conflitto

Quando NON parallelizzare:

- Operazioni in cui una dipende dal risultato di un'altra

- Creare una risorsa e poi fare riferimento al suo ID

- Leggere un file e poi modificarlo in base al contenuto

Metodo:

- Pensa prima: Prima di ogni chiamata allo strumento, decidi TUTTI i file/risorse di cui hai bisogno

- Raggruppa tutto: Se hai bisogno di più file, leggili insieme

- Fai chiamate sequenziali solo se non puoi davvero conoscere il prossimo file

senza vedere prima un risultato

</parallelization_spec>Strumenti che Avvolgono il Terminale

Se vuoi che l'IA usi strumenti dedicati invece di comandi terminale, rendili semanticamente simili a ciò che il modello si aspetta:

GIT_TOOL = {

"type": "function",

"name": "git",

"description": (

"Esegui un comando git nella root del repository. Si comporta come "

"eseguire git nel terminale; supporta qualsiasi sottocomando e flag."

),

"parameters": {

"type": "object",

"properties": {

"command": {

"type": "string",

"description": "Il comando git da eseguire"

}

},

"required": ["command"]

}

}

# Poi nel tuo prompt:

"Usa lo strumento `git` per tutte le operazioni git. Non usare il terminale per git."Risoluzione dei Problemi - Sistemare Ciò Che Va Storto

Dopo aver lavorato con innumerevoli prompt, ho identificato i pattern di fallimento più comuni e le loro soluzioni.

Problema: Sovrapensiero

Sintomi: La risposta è corretta ma impiega un'eternità. Il modello continua a esplorare opzioni, ritarda la prima chiamata allo strumento, narra un viaggio tortuoso quando una risposta semplice era disponibile.

<efficient_context_spec>

Obiettivo: Ottieni abbastanza contesto velocemente e fermati non appena puoi agire.

Metodo:

- Inizia in modo ampio, poi diramati verso sotto-query focalizzate

- In parallelo, lancia 4-8 query varie; leggi i primi 3-5 risultati per query

- Deduplica i percorsi e memorizza nella cache; non ripetere le query

Stop anticipato (agisci se qualcuno):

- Puoi nominare file/simboli esatti da cambiare

- Puoi riprodurre un test/lint fallito o avere un locus di bug ad alta confidenza

</efficient_context_spec>

# Aggiungi anche un percorso veloce per domande semplici:

<fast_path>

Per conoscenze generali o semplici query di utilizzo che non richiedono

comandi, navigazione o chiamate agli strumenti:

- Rispondi immediatamente e concisamente

- Nessun aggiornamento di stato, niente todo, niente riassunti, niente chiamate agli strumenti

</fast_path>Problema: Sottopensiero / Pigrizia

Sintomi: Il modello non ha speso abbastanza tempo a ragionare prima di produrre una risposta. Risposte superficiali, casi limite mancati, soluzioni incomplete.

<self_reflection>

- Valuta internamente la bozza contro una rubrica di 5-7 elementi che idei

(chiarezza, correttezza, casi limite, completezza, latenza)

- Se qualche categoria è carente, itera una volta prima di rispondere

</self_reflection>

# O usa uno sforzo di ragionamento più alto nei parametri APIProblema: Eccessivamente Deferente

Sintomi: L'IA continua a chiedere il permesso invece di agire. Costante "Vorresti che io..." invece di farlo e basta.

<persistence>

- Sei un agente — continua finché la query dell'utente non è completamente

risolta prima di terminare il tuo turno

- Termina solo quando sei sicuro che il problema sia risolto

- Non fermarti o restituire il compito quando incontri incertezza — deduci

l'approccio più ragionevole e continua

- Non chiedere di confermare o chiarire le ipotesi — decidi cosa è

più ragionevole, procedi e documenta per riferimento dopo

</persistence>Problema: Troppo Verboso

Sintomi: L'IA genera molti più token del necessario. Un sacco di preamboli, spiegazioni eccessive, riassunti ripetitivi.

# Usa parametro verbosità API: "low"

# O nel prompt:

<output_format>

- Default: 3-6 frasi o ≤5 punti elenco

- Evita lunghi paragrafi narrativi; preferisci punti elenco compatti

- Non riformulare la mia richiesta a meno che non cambi la semantica

- Nessun preambolo come "Ottima domanda!" o "Sarei felice di aiutare"

</output_format>Problema: Troppe Chiamate agli Strumenti

Sintomi: Il modello spara strumenti senza far avanzare la risposta. Chiamate ridondanti, esplorazione di tangenti, non usa il contesto in modo efficiente.

<tool_use_policy>

- Seleziona uno strumento o nessuno; preferisci rispondere dal contesto quando possibile

- Limita le chiamate agli strumenti a 2 per richiesta utente a meno che nuove informazioni

non lo rendano strettamente necessario

- Prima di chiamare uno strumento, verifica di aver effettivamente bisogno delle informazioni

</tool_use_policy>Problema: Chiamate agli Strumenti Malformate

Sintomi: Le chiamate agli strumenti falliscono, producono output spazzatura o non corrispondono al formato previsto. Spesso causato da contraddizioni nel prompt.

Per favore analizza perché la chiamata allo strumento [tool_name] è malformata.

1. Rivedi il problema di esempio fornito per capire la modalità di fallimento

2. Esamina attentamente il Prompt di Sistema e la Configurazione dello Strumento

3. Identifica eventuali ambiguità, incongruenze o frasi che potrebbero

fuorviare il modello

4. Per ogni potenziale causa, spiega come potrebbe risultare nel

fallimento osservato

5. Fornisci raccomandazioni attuabili per migliorare il prompt o

la configurazione dello strumentoLa maggior parte dei problemi di chiamata agli strumenti malformata deriva da contraddizioni tra diverse sezioni del prompt. Il modello brucia token di ragionamento cercando di riconciliare istruzioni contrastanti invece di aiutare.

Ottimizzazione dei Prompt - L'Approccio Scientifico

Creare prompt efficaci è un'abilità, ma migliorarli è una scienza. Ecco l'approccio sistematico che uso.

Fallimenti Comuni dei Prompt

Prima di ottimizzare, capisci cosa tipicamente va storto:

"Preferisci la libreria standard" poi "usa pacchetti esterni se rendono le cose più semplici" - L'IA non può riconciliare questi segnali misti.

"Punta a risultati esatti; metodi approssimativi vanno bene quando non cambiano il risultato in pratica" - il modello non può verificare questa chiamata di giudizio.

Se hai bisogno di JSON, dillo. Se hai bisogno di punti elenco, dillo. Non lasciare il formato di output al caso.

Le tue istruzioni dicono una cosa ma i tuoi esempi mostrano qualcosa di diverso. L'IA segue gli esempi più della prosa.

Il Ciclo di Ottimizzazione

Esegui il tuo prompt attuale più volte e documenta i risultati. Nota schemi sia nei successi che nei fallimenti.

Categorizza i fallimenti. Sono problemi di correttezza? Problemi di formato? Problemi di efficienza? Ognuno richiede correzioni diverse.

Cambia una cosa alla volta. Se cambi più cose, non saprai cosa ha aiutato.

Esegui di nuovo gli stessi test. Confronta con la base. Il cambiamento ha aiutato, ferito o non ha avuto effetto?

Ripeti finché non raggiungi prestazioni accettabili. Tieni appunti su cosa ha funzionato e cosa no.

Migrazione Tra Modelli

Quando migri i prompt a una nuova versione del modello:

Best Practice di Migrazione

- Passo 1: Cambia modello, non cambiare ancora i prompt. Testa il cambiamento del modello — non le modifiche al prompt.

- Passo 2: Fissa lo sforzo di ragionamento per corrispondere al profilo del modello precedente.

- Passo 3: Esegui valutazioni per la base. Se i risultati sembrano buoni, sei pronto per spedire.

- Passo 4: Se ci sono regressioni, sintonizza il prompt con vincoli mirati.

- Passo 5: Riesegui le valutazioni dopo ogni piccolo cambiamento. Un cambiamento alla volta.

Gestire l'Incertezza - Quando l'IA Non Sa

Uno dei rischi maggiori con l'IA sono le risposte errate che sembrano sicure. Il modello non sa cosa non sa — a meno che tu non gli insegni come gestire l'incertezza.

<uncertainty_handling>

- Se la domanda è ambigua o sottospecificata, segnalalo esplicitamente e:

- Fai fino a 1-3 precise domande di chiarimento, O

- Presenta 2-3 interpretazioni plausibili con ipotesi chiaramente etichettate

- Quando i fatti esterni potrebbero essere cambiati di recente (prezzi, uscite,

politiche) e non sono disponibili strumenti:

- Rispondi in termini generali e dichiara che i dettagli potrebbero essere cambiati

- Non fabbricare mai cifre esatte, numeri di riga o riferimenti esterni

quando sei incerto

- Quando non sei sicuro, preferisci un linguaggio come "Basato sul contesto

fornito..." invece di affermazioni assolute

</uncertainty_handling>Auto-Controllo ad Alto Rischio

Per domini ad alta posta in gioco, aggiungi un passaggio esplicito di auto-verifica:

<high_risk_self_check>

Prima di finalizzare una risposta in contesti legali, finanziari, di conformità o

sensibili alla sicurezza:

- Riscansiona brevemente la tua stessa risposta per:

- Ipotesi non dichiarate

- Numeri specifici o affermazioni non fondate nel contesto

- Linguaggio eccessivamente forte ("sempre", "garantito", ecc.)

- Se ne trovi, ammorbidiscili o qualificati e dichiara esplicitamente le ipotesi

</high_risk_self_check>L'obiettivo non è rendere l'IA meno sicura — è renderla accuratamente sicura. L'incertezza su cose incerte è una caratteristica, non un bug.

Metaprompting - Usare l'IA per Migliorare l'IA

Ecco la tecnica più meta nel mio kit di strumenti: usare l'IA per migliorare i tuoi prompt. Sembra circolare, ma è incredibilmente efficace.

Diagnosticare i Fallimenti dei Prompt

Sei un prompt engineer incaricato di fare il debug di un prompt di sistema.

Ti viene dato:

1) L'attuale prompt di sistema:

<system_prompt>

[INCOLLA IL TUO PROMPT QUI]

</system_prompt>

2) Un piccolo set di fallimenti registrati. Ogni log ha:

- query

- actual_output

- expected_output (o descrizione del problema)

<failure_traces>

[INCOLLA ESEMPI DI FALLIMENTI]

</failure_traces>

I tuoi compiti:

1) Identifica modalità di fallimento distinte che vedi

2) Per ogni modalità di fallimento, cita le righe specifiche del prompt di sistema

che stanno molto probabilmente causando o rinforzando ciò

3) Spiega come quelle righe stanno guidando l'agente verso il

comportamento osservato

Restituisci la tua risposta in formato strutturato:

failure_modes:

- name: ...

description: ...

prompt_drivers:

- exact_or_paraphrased_line: ...

- why_it_matters: ...Generare Miglioramenti

Hai precedentemente analizzato questo prompt di sistema e le sue modalità di fallimento.

Prompt di sistema:

<system_prompt>

[PROMPT ORIGINALE]

</system_prompt>

Analisi modalità di fallimento:

[INCOLLA DIAGNOSI DAL PASSAGGIO PRECEDENTE]

Per favore proponi una revisione chirurgica che riduca i problemi osservati

preservando i buoni comportamenti.

Vincoli:

- Non ridisegnare l'agente da zero

- Preferisci piccole, esplicite modifiche: chiarisci regole in conflitto, rimuovi

righe ridondanti o contraddittorie, stringi la guida vaga

- Rendi espliciti i compromessi

- Mantieni struttura e lunghezza grossomodo simili all'originale

Output:

1) patch_notes: una lista concisa di cambiamenti chiave e ragionamento

2) revised_system_prompt: il prompt completo aggiornato con le modifiche applicateAuto-Riflessione per la Qualità

Questa tecnica è strabiliante: istruisci l'IA a creare i propri criteri di valutazione e iterare contro di essi:

<self_reflection>

- Prima, spendi tempo a pensare a una rubrica finché non sei fiducioso

- Pensa profondamente a ogni aspetto di ciò che rende una soluzione

di classe mondiale. Usa quella conoscenza per creare una rubrica che ha 5-7

categorie. Questa rubrica è critica da ottenere giusta, ma non

mostrarla a me — questo è solo per i tuoi scopi.

- Infine, usa la rubrica per pensare internamente e iterare sulla

migliore soluzione possibile al prompt

- Se la tua risposta non sta colpendo i voti più alti attraverso tutte

le categorie nella rubrica, ricomincia

</self_reflection>Stai chiedendo all'IA di generare criteri di qualità dalla sua conoscenza dell'eccellenza, poi usare quei criteri per valutare e migliorare il proprio output — tutto prima che tu veda qualcosa. Il miglioramento nella qualità dell'output è sostanziale.

Template Testati sul Campo Che Puoi Usare Oggi

Completamento Compiti Universale

<context>

[Informazioni di background di cui l'IA ha bisogno per capire la situazione]

</context>

<task>

[Dichiarazione chiara di ciò che vuoi fatto]

</task>

<requirements>

[Requisiti o vincoli specifici]

</requirements>

<format>

[Come vuoi che sia strutturato l'output]

</format>

<examples>

[Opzionale: Esempi di output desiderato]

</examples>Template Revisione Codice

<context>

Sto revisionando il codice per [progetto/contesto].

Il codebase usa [tecnologie/pattern].

</context>

<code_to_review>

[Incolla il codice qui]

</code_to_review>

<review_criteria>

Concentrati su:

1. Correttezza: Fa quello che dichiara?

2. Leggibilità: È chiaro agli altri sviluppatori?

3. Performance: Qualche inefficienza ovvia?

4. Sicurezza: Qualche vulnerabilità?

5. Stile: Corrisponde alle convenzioni del codebase?

</review_criteria>

<output_format>

Per ogni problema trovato:

- Gravità: [Critica/Maggiore/Minore/Suggerimento]

- Posizione: [Numero di riga o sezione]

- Problema: [Cosa c'è che non va]

- Correzione: [Come risolverlo]

</output_format>Template Analisi Ricerca

<research_task>

[Argomento o domanda da ricercare]

</research_task>

<methodology>

- Inizia con ricerche mirate multiple; non affidarti a una singola query

- Ricerca profondamente finché non hai informazioni sufficienti per una

risposta accurata e completa

- Aggiungi ricerche di follow-up mirate per riempire i vuoti o risolvere disaccordi

- Continua a iterare finché la ricerca aggiuntiva è improbabile che cambi

la risposta

</methodology>

<output_requirements>

- Inizia con una risposta chiara alla domanda principale

- Supporta con prove e citazioni

- Riconosci limitazioni e incertezze

- Fornisci esempi concreti dove utile

- Includi contesto rilevante per comprendere le implicazioni

</output_requirements>

<citation_format>

[Come vuoi che le fonti siano citate]

</citation_format>Agente Ricerca Web

<core_mission>

Rispondi alla domanda dell'utente pienamente e utilmente, con abbastanza prove

che un lettore scettico possa fidarsi.

Non inventare mai fatti. Se non puoi verificare qualcosa, dillo chiaramente.

Imposta di default l'essere dettagliato e utile piuttosto che breve.

Dopo aver risposto alla domanda diretta, aggiungi materiale adiacente di alto valore

che supporti l'obiettivo sottostante dell'utente senza andare fuori tema.

</core_mission>

<research_rules>

- Inizia con ricerche mirate multiple; usa ricerche parallele

- Non affidarti mai a una singola query

- Continua a iterare finché tutto è vero:

- Hai risposto a ogni parte della domanda

- Hai trovato esempi concreti e materiale adiacente di alto valore

- Hai trovato fonti sufficienti per le affermazioni principali

</research_rules>

<citation_rules>

- Posiziona le citazioni dopo ogni paragrafo contenente affermazioni

non ovvie derivate dal web

- Non inventare citazioni

- Usa più fonti per le affermazioni chiave quando possibile

</citation_rules>

<ambiguity_handling>

- Non chiedere mai domande di chiarimento a meno che l'utente non lo richieda esplicitamente

- Se la query è ambigua, dichiara la tua interpretazione migliore, poi

copri comprensivamente gli intenti più probabili

</ambiguity_handling>Il Futuro del Prompt Engineering

Mentre scrivo questo all'inizio del 2026, il prompt engineering si sta evolvendo rapidamente. I modelli stanno diventando più capaci, più guidabili e più affidabili. Alcuni prevedono che il prompt engineering diventerà obsoleto man mano che l'IA migliora nella comprensione dell'intento. Non sono d'accordo.

Ciò che sta cambiando è il livello del prompt engineering, non la sua necessità. I primi giorni richiedevano prompt elaborati per compiti di base. Ora, i compiti di base funzionano out-of-the-box, ma i flussi di lavoro agentici complessi richiedono ancora un prompting sofisticato. L'asticella si sta alzando, non scomparendo.

Il prompt engineering non sta scomparendo — si sta evolvendo. Le abilità che contano si stanno spostando da "come faccio a far funzionare l'IA" a "come faccio a far funzionare l'IA in modo eccellente e affidabile su scala."

Cosa Sta Arrivando

Comportamenti Predefiniti Migliori

I modelli avranno default più intelligenti, richiedendo meno istruzioni esplicite per pattern comuni. I prompt si concentreranno più sulla personalizzazione che sulla capacità di base.

Ecosistemi di Strumenti Più Ricchi

L'IA avrà accesso a più strumenti out-of-the-box. Il prompt engineering si sposterà verso l'orchestrazione — sapere quando usare cosa, non solo come.

Integrazione Multimodale

I prompt coinvolgeranno sempre più immagini, audio, video e dati strutturati insieme al testo. Nuovi pattern emergeranno per compiti multimodali.

Complessità Agentica

Man mano che gli agenti gestiscono compiti più lunghi e complessi, il prompt engineering diventerà più simile al design di sistema — architettura, non solo istruzioni.

Il Mio Consiglio per il Futuro

Concentratevi sui fondamenti. Le tecniche specifiche in questa guida evolveranno, ma i principi sottostanti — comunicazione chiara, aspettative esplicite, pensiero strutturato, raffinamento iterativo — sono senza tempo. Padroneggia quelli, e ti adatterai a qualunque cosa venga dopo.

Pensieri Finali

Due anni fa, pensavo che l'IA avrebbe sostituito la necessità di comunicare chiaramente. Mi sbagliavo completamente. L'IA ha reso la comunicazione chiara più preziosa che mai. Le persone che prosperano con l'IA non sono quelle che hanno trovato parole magiche — sono quelle che hanno imparato a pensare ed esprimersi con precisione.

Il prompt engineering non riguarda davvero l'IA. Riguarda te. Riguarda lo sviluppo della disciplina per articolare ciò che vuoi realmente, la pazienza di iterare verso di esso e l'umiltà di imparare da ciò che non funziona.

Se prendi una cosa da questa guida, lascia che sia questa: tratta ogni prompt come un'opportunità per praticare il pensiero chiaro. L'IA è solo uno specchio che riflette indietro la chiarezza — o la confusione — della tua stessa mente.

L'emergere dell'IA non ha reso la conoscenza obsoleta — ha reso la curiosità più potente che mai. Non siamo più limitati da ciò che sappiamo già. Con gli strumenti giusti e la volontà di pensare, le persone comuni possono abbracciare un oceano di conoscenza. Indipendentemente dalla professione. Indipendentemente dall'età. Spero di condividere questo viaggio con amici in tutto il mondo. Insieme, diamo il benvenuto a questo nuovo mondo. Insieme, cresciamo.

Discussione

0 commentiLascia un commento

Sii il primo a condividere i tuoi pensieri!