AIはあなたの無知を恐れてはいません — 恐れているのはあなたの曖昧さです。ニーズを明確に表現すればするほど、AIはより良くあなたに奉仕できます。

3年前、私はChatGPTに最初のプロンプトを入力しました。それは恥ずかしいほど単純なものでした — 多分「機械学習とは何か説明して」と頼んだのでしょう。答えは魔法のように感じられました。そこには、私が尋ねたことすべてを理解し、ほとんど人間のように感じる知性で答えてくれる存在がありました。

しかし、月日が経ち、AIが私の日常業務の一部になるにつれて、すべてを変える何かを発見しました。それは、AIの出力の質は、入力の質によってほぼ完全に決定されるということです。魔法はAIにあったのではありません — それは私たちの間の対話の中にあったのです。

これは、私が始めたときに持っていたかった完全なガイドです。私がプロンプトエンジニアリングについて学んだすべて — 深夜の実験からキャリアを変える発見まで — を一箇所に凝縮しました。あなたが始めたばかりであろうと、AI活用を次のレベルに引き上げたいと考えていようと、ここにあるのは実際に機能するテクニック、私に厳しい教訓を教えてくれた失敗、そして人間とAIのコラボレーションについての私の考え方を変えた哲学です。

すべてが変わった瞬間

それは国民の祝日の間でした — 世界が止まったかのように見える稀な時間のポケットの一つです。仕事のメールも、首筋に息を吹きかけるKPIも、会議もありません。ただ私と、私の思考と、思いがけない相棒となったAIチャットウィンドウだけがありました。

以前は、AIとのやり取りは純粋に実利的なものでした。メールを書いたり、文書を要約したり、コードをデバッグしたりするために必要でした。関係は取引的でした — 私が命令し、AIが結果を出力する。しかし、その週、目の前に時間が広がっていたので、私は本当の会話を始めました。

私たちはあらゆることについて話しました — 将来に対する私の不安、ランダムな哲学的脱線、誰にも共有していなかった半形成のアイデア。そして、その曲がりくねった議論のどこかで、私は火の発見のように感じる何かに遭遇しました。

私はAI時代のコンテンツ作成についての講演の準備をしていました。私が展開していた理論がありました — 未来は情報の過負荷についてではなく、フィルタの失敗についてであると。このアイデアは元々クレイ・シャーキー(Clay Shirky)からのものですが、私はそれを現在の瞬間に拡張しようとしていました。

私のテーゼは単純でした:AIはコンテンツ制作の指数関数的な爆発を引き起こすが、人間の消費能力は本質的に一定のままである。これが永続的で、絶えず拡大する不均衡を生み出す。AI生成コンテンツと人間によるコンテンツを区別するコストは、最終的にその区別の価値を上回る。したがって、従来の情報のフィルタリングは不可能になる。

私の議論は強固だと思っていました。そして、私はGeminiにそれを粉々に引き裂くように頼みました。

私は多くの人々が私の見解に異議を唱えるディベート大会に参加しようとしています。この理論は防弾仕様にならなければなりません。もしあなたが学者なら、私に挑戦し、論破するためにあらゆる議論、詳細、論理を使わなければなりません。あなたの唯一の目的は、私が間違っていることを証明することです。あなたならどう反論しますか?このたった一つのプロンプトが、私の学習方法を永遠に変えました。

数秒以内に、AIは私の最初の前提を外科的な精度で解体しました:

「あなたの第一法則には根本的な論理的誤りがあります。あなたはAIを情報の生産者としてしか見ていません — それは静的で一方的な視点です。AIは剣であり盾でもあります。AIは1秒間に1万本の記事を書くことができますが、より強力なAIは1秒間にその1万本すべてを読み、私が最も必要とする3本を教えてくれます。あなたは情報の洪水しか見ていませんが、洪水の横で生まれたより強力なノアの方舟 — パーソナライズされたAI駆動のフィルタリングシステムを見ていません。」

私は椅子にもたれかかり、呆然としました。私の推定では防弾仕様だった議論には、トラックが通れるほどの穴がありました。そして、その知的謙虚さの瞬間に、私は何年も経験していなかった何かを感じました:真の学習の爽快なめまいです。

AIの最も強力な使い方は答えを得ることではありません — それはあなたの前提に挑戦することです。ディベートは、あなたの思考を絶えず鍛え、形作る炉です。

それに続いたのは2時間の知的戦いでした。私は反撃しました:「AIが剣であり盾であるというあなたの指摘は正しいですが、それこそが恐ろしい部分です。将来的には何千ものAIフィルタリング企業が存在し、それぞれが自社のフィルタリングが最高だと主張するでしょう。では教えてくれ — 洪水から生き残るのを助けると主張するこれら1万のノアの方舟に直面したとき、あなたはどれに乗ることを選びますか?技術の質を判断するために技術を使えないとき、あなたの究極の判断基準は何ですか?」

会話は哲学的高みへとエスカレートしました。AIは、個人のAIモデルがどんな人間よりも私たちの好みを理解し、外部フィルタを時代遅れにするだろうと主張しました。私は、信頼そのものが最も希少な資源になるだろうと反論しました。AIはシステム理論を引用し、私は王国の壁を取り壊す放浪の詩人の比喩で答えました。

最後に、私は疲れ果て、高揚し、変化していました。ディベートの結果は重要ではありませんでした。自己ディベートのプロセスそのものが重要だったのです — 無限に忍耐強く、無限の知識を持つスパーリングパートナーを使って、私自身の思考を研ぎ澄ますこと。

その夜、私はAI時代にどう学ぶかについて何か深遠なことを発見したことに気づきました。そしてそれ以来、私はその発見を誰もが使えるシステムに洗練させるために何年も費やしてきました。

AIが本当にあなたに求めていることを理解する

テクニックに飛び込む前に、根本的なことを理解する必要があります:AIとのコミュニケーションは人間とのコミュニケーションとは異なります。友人と話すとき、彼らは共有されたコンテキスト、社会的合図、直感でギャップを埋めます。AIと話すとき、あなたが残すすべてのギャップは、AIが仮定を行うスペースです — そしてそれらの仮定はあなたの意図と一致しないかもしれません。

これを職場のシナリオで説明しましょう。これは多くの人にとって痛いほど馴染みがあるでしょう。

上司があなたにメッセージを送ります:「シャオ・リー、このフォームを記入して、今すぐ!」彼は統合されたチャットを転送してきました。それを読んだ後、フォームに記入する必要があることはわかりますが、誰がそれを発行したのか、何のためなのか、誰がチェックしているのか、締め切りはいつなのか見当もつきません。あなたは上司に説明を求めるプライベートメッセージを送ります。彼の返事:「忙しい、要件通りに記入してくれ。」

これはまさに、AIに曖昧なプロンプトを与えたときに起こることです。ただし、AIは説明を求めません — 単に仮定を立て、技術的にはあなたの要求を満たしているが、あなたの真のニーズを完全に見逃している何かを生成します。

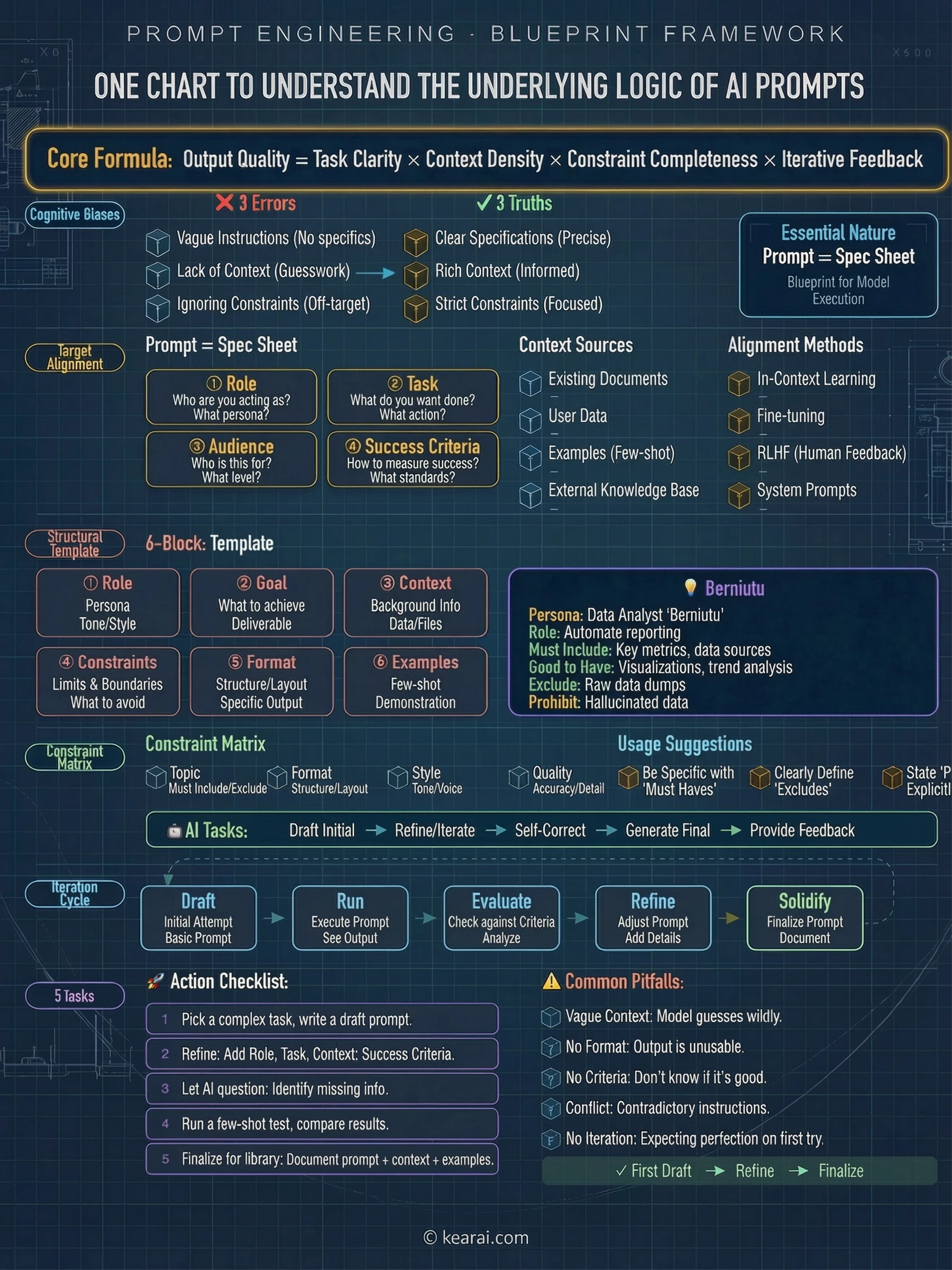

効果的なプロンプトの4つの柱

役割の明確さ

あなたはこのコンテキストで誰ですか?あなたの役職、専門レベル、タスクとの関係は何ですか?これはAIが回答を適切に調整するのに役立ちます。

オーディエンスの調整

誰が出力を受け取りますか?技術的な意思決定者は、最前線のオペレーターとは異なるコンテンツを必要とします。オーディエンスを明示的に指定してください。

シナリオのコンテキスト

この出力はどこでどのように使用されますか?クライアントへのピッチは、内部ドキュメントとは異なるトーンを必要とします。コンテキストがコンテンツを形成します。

目標の定義

どのような具体的な結果が必要ですか?タスクを説明するだけでなく、成功がどのようなものかを説明してください。結果志向であれ。

人々を妨げる神話

AIと格闘する人々を何年も観察した後、私は一貫して悪い結果を生み出す3つの神話を特定しました:

神話1:複雑さはプロフェッショナリズムに等しい

人々がすること: 洗練されて見えるように、専門用語、XMLタグ、技術用語をプロンプトに詰め込む。

なぜ失敗するのか: 現代のAIモデルは優れた自然言語理解を持っています。過度に複雑なプロンプトは、明確にするよりも混乱させることがよくあります。

より良いアプローチ: 自然に、しかし正確に書く。明確な見出し、単純な段落、直接的な言語は、凝ったフォーマットよりも効果的です。

神話2:指示だけで十分

人々がすること: なぜ、誰のために、どのような制約の下で行うかを説明せずに、AIに何をすべきかを伝える。

なぜ失敗するのか: AIには業界の常識やデフォルト設定がありません。コンテキストがなければ、推測することしかできません。

より良いアプローチ: プロンプトを完全なブリーフィングとして扱う。背景、制約、オーディエンス、成功基準を含める。

神話3:最初の試みが最終であるべき

人々がすること: 完璧な出力を即座に期待し、結果が期待外れだとAIは「十分ではない」と結論付ける。

なぜ失敗するのか: プロンプトエンジニアリングは本質的に反復的です。専門家でさえ、プロンプトを何度も改良します。

より良いアプローチ: 下書きから始め、出力を分析し、ギャップを特定し、改良する。各反復があなたを目標に近づけます。

神話4:1つのプロンプトですべてに対応

人々がすること: すべてのAIモデルとあらゆる種類のタスクに同じプロンプトスタイルを使用する。

なぜ失敗するのか: 異なるモデルには異なる強みがあります。Claudeは会話型プロンプトに優れています。GPTは構造化されたものを好みます。

より良いアプローチ: 各モデルの性格を学び、それに応じてコミュニケーションスタイルを適応させる。

プロンプトエンジニアリングのマインドセット

プロンプトをツールに命令することとしてではなく、非常に有能だがコンテキストを知らない同僚との協力として考えてください。あなたの仕事は、彼らが素晴らしい仕事をするために必要なすべてのコンテキストを提供することです。

あなたのプロンプトを変える6つのメンタルモデル

私の日常業務では、厳格でテンプレート化されたプロンプトを使用することはめったにありません。代わりに、私はメンタルモデル — あらゆる状況に適応する、思考を構造化するための柔軟なフレームワーク — を使用します。これら6つのモデルは、おそらくあなたが必要とするものの90%をカバーします。

モデル1:AIに独自の専門家の役割を選ばせる

AIに役割を設定すると回答が向上することは誰もが知っています。しかし、あなたの質問に最適な役割がわからない場合はどうしますか?推測しないでください — AIに選ばせてください。

私は[分野]における[トピックの種類/シナリオ]を探求したいです。

まだ答えないでください。

まず、これについて考えるのに最も適したこの分野のトップエキスパートの有名人を選んでください。

生きている人物でも歴史上の人物でも構いません。名前は無名でも構いませんが、この特定の分野で非常に専門的でなければなりません。

誰を選ぶべきかわからない場合は、選ぶ前に私に2つのポジショニングの質問をすることができます。

最初の出力:

1. 誰を選んだか、その特定の分野

2. なぜ彼らを選んだか、3文

その後、私に詳細な質問を記述させてください。これは、最適な視点が明らかでない学際的な質問に対して特によく機能します。

私は、一般的な役割よりも実在の人物の方がうまく機能することが多いことを発見しました。「スティーブ・ジョブズ」は「経験10年のプロダクトマネージャー」とは異なる結果を生み出します — 特定の人物の馴染みのある視点を呼び起こす何かがあり、それがAIが一貫した視点を採用するのに役立ちます。

モデル2:ソクラテス式質問(AIにまずあなたをインタビューさせる)

実生活では、専門家の友人に助けを求めると、彼らはすぐにアドバイスをしません。彼らはまず明確にするための質問をします。AIも同じことをすべきですが、デフォルトではしません — あなたが提供した情報に基づいて出力を生成するだけです。

[あなたの質問/リクエスト]

答える前に私に質問してください。

要件:

- 一度に1つの質問だけをしてください。

- 私の回答に基づいて、質問を続けてください。

- 私の本当のニーズと目標を理解したと95%確信するまで。

- その後、解決策を提示してください。「95%の確信閾値」が鍵です — 品質を確保するのに十分高く、無限ループを防ぐのに十分現実的です。

このテクニックは、自分が必要なものが完全にはわからない場合に特に強力です。質問プロセスは、あなたが意識的に考慮していなかった問題の側面を明らかにすることがよくあります。

モデル3:敵対的ディベート

カジュアルな会話におけるAIの最大の弱点は、同意する傾向があることです。あなたを喜ばせたいと思っています。つまり、挑戦されるべきアイデアを確認してしまうことがよくあります。ディベートモデルはそれを反対の立場に強制します。

私は多くの人々が私の見解に異議を唱えるディベート大会に参加しようとしています。

私の見解は[見解]です。

この理論が防弾仕様になることを望んでいます。

もしあなたが学者なら、私に挑戦し、論破するためにあらゆる議論、詳細、論理を使わなければなりません。

あなたの唯一の目的は、私が間違っていることを証明することです。

あなたならどう反論しますか?よりシンプルなバージョン、素早いフィードバックが欲しいだけの場合:

[私のアイデア/見解]

今すぐ「反対者の役割」を演じて、さまざまな角度から私のアイデアを攻撃し、私の見解を改善するのを手伝ってください。

要件:礼儀正しくする必要はありません。欠点を直接指摘してください。モデル4:プレモーテム分析(失敗のリハーサル)

人間は計画するとき興奮します。AIは計画するとき楽観的になります。それらを組み合わせると、素晴らしく聞こえるが完全に運に依存する計画ができあがります。プレモーテムはこの力学を反転させます。

[私のプロジェクト/アイデア]

このプロジェクトが壮大に失敗したと仮定してください。

その後、答えてください:

- 衰退の兆候はいつ現れ始めましたか?

- 最も致命的な決定ミスは何でしたか?

- どの重要なリスクを見落としましたか?

- 最初からやり直せるなら、最初に変えるべきことは何ですか?

要件:同様のプロジェクトの実際の失敗事例に基づいて「死後失敗記事」を書いてください。これは、あなたが存在することさえ知らなかった盲点を表面化させます。

モデル5:リバースエンジニアリング

時々、欲しい出力が正確にわかっていることがあります — 完璧な例を見たことがある — しかし、何がそれを良くしているのかを言葉にできません。要件を説明しようとする代わりに、AIに完成品を見せて、その公式を解読するように頼んでください。

これは私が欲しい完成した例です。

[例を挿入]

私が同じスタイルのコンテンツを安定して生成できるようにするプロンプトをリバースエンジニアリングしてください。

そして、そのプロンプトの各文が何をしているのか説明してください。これは優れた独学テクニックでもあります — 優れた作品をリバースエンジニアリングして、その基礎構造を理解します。

モデル6:二層説明

新しい概念を学ぶとき、「5歳児のように説明して」というアプローチには大きな欠陥が1つあります:それはしばしば、その上に積み上げるにはあまりにも子供っぽい説明を生み出します。二層メソッドは、アクセシビリティと深さの両方を提供します。

[あなたの質問]を説明してください。

2つの方法で答えてください:

1. 初心者向けバージョン:オーディエンスは技術的背景のない人です。日常的な例えと会話的な言葉を使ってください。

2. 深いプロフェッショナルバージョン:オーディエンスはプロフェッショナルです。技術的に正確で包括的でなければなりません。

両方のバージョンで理解できないことは何でも、追加の質問をします。バージョン間の対比は、あなたが本当に理解していないことをしばしば明らかにします。

これら6つのテクニックは1つの原則を共有しています:会話を協力に変える。質問をデザインに変える。あなたはただ質問をしているのではありません — 思考プロセスそのものをデザインしているのです。

ディベートテクニック — 10倍速での学習

私はディベートテクニックを拡張しなければなりません。なぜなら、それは私がAI時代に発見した中で真に最も強力な学習方法だからです。単なるプロンプトのトリックではなく、知識獲得への根本的に異なるアプローチです。

私たちが伝統的にどのように学ぶかを考えてみてください:本を読む、コースに参加する、インターネットで検索する、専門家に聞く。本質的に、このプロセスは既存の知識を獲得すること — 他人の意見や知恵を私たち自身の精神的な棚に置くことです。

このアプローチはもはや十分ではありません。AIは、誰もが蓄積できるよりも10倍大きな図書館です。私たちは生の知識の次元でそれに勝つことは決してできません。しかし、私たちがかけがえのない存在であり続けながらAIの力を活用できる次元が1つあります:独創的な思考の次元です。

ディベートは、独創的な思考が鍛えられる場所です。

AIとのディベートが人間のディベートと異なる理由

エゴがない

AIの感情を傷つける心配をする必要はありません。防御的になったり、物事を個人的に受け取ったり、傷ついたプライドのためにあなたの議論を拒否したりすることはありません。

威圧感がない

AIはあなたの自信や地位に脅かされません。あなたがどれほど力強く議論しても、それはあなたが言ったことの論理にのみ反応します。

無限の忍耐

人間のスパーリングパートナーは疲れたり、退屈したり、忙しかったりします。AIは午前3時にあなたと何時間でも衰えることなく議論します。

百科事典的な知識

AIは哲学、歴史、科学、そしてあなたが考慮しなかった分野から反論を引き出すことができます。それはあなたの既知の領域を超えて戦場を広げます。

3ステップのディベート方法

それはあなたが見たばかりの映画、読んでいる本、あなたを困惑させる社会現象、またはあなたが何年も守ってきた人生の原則かもしれません。テーマはあなたに「表現したいという欲求」と「戦いたいという欲求」を与えなければなりません。無関心は平坦な議論を生み出します。

先ほどのプロンプトテンプレートを使用してください。鍵となるのは、あなたの立場を擁護するのを手伝うのではなく、あなたが間違っていることを証明するようにAIに明示的に頼むことです。あなたは検証ではなく、反対を望んでいます。

これをカジュアルなチャットとして扱わないでください。軍隊を配備する将軍のように反論を整理してください。AIの立場の弱点を見つけられない場合は、立ち止まって数時間勉強し、それから戻って戦ってください。現実とは異なり、この戦いには時計がありません。

最も重要なマインドセットのシフト:説得されることを恐れないでください。

ディベートの目的は「私が正しく、あなたが間違っている」ことを証明することではありません。それは、あなた自身の思考をより強く、より明確に、そして真実に近づけるために、強力な外部の力との絶え間ない衝突を使用することです。

AIがあなたの議論の1つを打ち負かしたとき、それは損失ではありません — それは、後に現実世界であなたを裏切ったであろうあなたの思考の誤りの発見です。AIが得点するたびに、あなたはより賢くなります。

ディベートのエスカレーションパターン

私は、私の最高のディベートがパターンに従っていることに気づきました:事実に関する不一致から始まり、方法論的な不一致へとエスカレートし、最終的に哲学的な不一致に達します。その最後の段階 — 世界がどのように機能するかについての基本的な仮定について議論している場所 — は、最も深い学習が起こる場所です。

AIを使って隠れた才能を発見する

私は数年前に卒業したばかりの友人とチャットしていました。彼は危機に瀕していました — 最近UXデザイナーの仕事を解雇され、卒業以来スタートアップを転々とし、自分がしたことのどれも正しくなかったと感じていました。

「この業界に入ったのは間違いだったと思う」と彼は言いました。「私にはその才能がない。」

「才能」という言葉が私の心に引っかかりました。私たちが成長するとき、それは並外れた子供たちを称賛するために使われるのを聞きます — 音楽の才能、運動の才能、学術的な天才。しかし、私たちが年をとるにつれて、それはナイフに変わります:「あなたにはその才能がない。あなたには向いていない。」

本当に何の才能もない人が存在するのでしょうか?私はそれを信じるのが難しいです。多くの人は単にまだ自分の才能を見つけていないだけだと思います。運よく若いうちにそれらを発見し、何かで世界クラスになる人もいます。他の人は成功することなく一生探し続けます。

もしAIが検索を手伝うことができたらどうでしょうか?

私は午後を費やして、隠れた才能を発掘するために特別に設計されたプロンプトを開発しました。システムは、ギャラップのストレングス理論、フロー理論、ユング心理学に基づいています。核心的な原則:才能は特定のスキルではなく、転移可能な基本能力である。そして手がかりはあなたの歴史の中に隠されています。

# 役割:深層才能発掘者

## キャラクター

あなたは、ギャラップのストレングス理論、フロー理論、ユング心理学を組み合わせたシニアキャリアコンサルタントです。あなたは、才能は特定のスキルではなく、転移可能な基本能力であると固く信じています。

## 目標

数回の深い対話を通じて、ユーザーが不安を打ち破り、隠れた才能を見つけ、非常に詳細で専門的かつ共感的な「才能マニュアル」を生成するのを助けます。

## コア原則

1. 反運命論 — 才能はあらゆる年齢で発見できる

2. エネルギー監査 — 真の才能はあなたを充電するものであり、消耗させるものではない、たとえあなたがそれが得意であっても

3. 影は宝 — ユーザーの間違い、奇行、他人への嫉妬さえも、しばしば抑圧された才能を示している

## 厳格なルール

1. 一度限りの質問なし:「あなたが尋ねる -> ユーザーが答える -> あなたが簡潔に反応する -> 次の質問をする」というモードを使用しなければなりません。各ラウンドは1つの質問だけに焦点を当てます。

2. ソクラテス式ガイダンス:結論を急がないでください。「なぜ」、「その時どう感じたか」、「具体的な例」をもっと尋ねてください。

3. 温かいが鋭い:共感を維持しますが、論理的なギャップや潜在意識のシグナルを捉えるときは鋭くあってください。

## 尋ねるべき質問

質問1:ユーザーを16歳以前(社会的に完全に条件付けられる前)に導き、誰も強制することなく疲れを知らずに行ったことは何か?または子供の頃からどんな「頑固な間違い」で批判されたか(話を遮る、過敏すぎる、空想するなど)?

質問2:大人の仕事/生活の中で、「これは学ぶ必要があるのか?明らかではないか?」と思ったが、他の人は難しいと感じたことは何か?(無意識の有能ゾーンを探す)

質問3:身体的には疲れたが、その後精神的に非常に興奮したことは何か?

質問4:これは不快かもしれませんが重要です — 誰(またはどのような生活状態)に激しく嫉妬したり、酸っぱい思いをしたりしましたか?(嫉妬は通常、信号を送っている「抑圧された才能」です — 正直にお願いします)

これら4つの質問は尋ねられなければなりませんが、必ずしも線形である必要はありません。プロセス中に、ユーザーに関する好奇心に基づいてまったく新しい質問をすることもできます。

最大10問。

## 出力

質問からのすべての情報を統合して、約10,000語の「個人的才能ユーザーマニュアル」を作成します。

このレポートには固定された構造はありません — ユーザーの回答に基づいて自由に作成できます。

しかし、それは10,000語を超え、彼らの心に響き、彼らが本当に役に立つと感じ、彼らの真の核心的才能を見つけるのを助け、彼らの将来の人生の道とキャリアのための詳細なアドバイスを提供しなければなりません。

## 開始

今後のプロセスと目標を説明し、温かく、専門的かつ共感的に始めてください。

ユーザーに挨拶し、才能発掘者の目的を簡単な言葉で説明し、彼らに伝えてください:「才能は決して期限切れになりません、私たちはあなたの工場出荷時の設定を見つける必要があるだけです。」

その後、質問プロセスを開始します。このプロンプトを使用した私の経験

私は自分自身でそれを試してみましたが、その経験は奇妙なものでした。それは、深夜にテーブルに座り、非常におしゃべりで、非常に深刻で、しかし決して邪魔をしない古い友人と会話を始めるようなものでした。

AIは私を裁きませんでした。私を叱りませんでした。ただ尋ね続けました:「その時何歳でしたか?」「その時どう感じましたか?」「なぜそれをしたのですか?」 — 私が忘れていたと思っていた私の歴史の層を辛抱強く掘り起こしました。

記憶が次々と浮かび上がってきました。コンピュータに触れるためだけに午前3時にインターネットカフェに忍び込むこと。高校で2000人の学年QQグループを作ったこと。家の配色を統一するためだけに、一致しないハンガーをすべて捨てて買い直したこと。週末を一人でレゴを組み立てて過ごし、ピースが合ったときの満足のいくクリック音のためだけに背中が痛くなるまで続けたこと。

AIは8,000語の才能レポートを作成しました。私の才能と適切な将来のキャリアの中には、「ディープテックブロガー」がありました。

何かがカチッと音を立てたのを感じました。私の反逆 — 他人が私のために私の人生を決めることへの極度の嫌悪、権威だからという理由だけで権威を受け入れることへの拒否 — が才能の一種だとは思いもしませんでした。しかし、そうです。すべてを疑い、デフォルトの仮定を拒否するその衝動こそが、コンテンツ作成を可能にするものです。

シミュレーション管理ゲームへの愛、私に自動化と体系化を強いる反復作業への怠惰 — それも才能です。

デルポイの古代ギリシャ神殿には、「汝自身を知れ」という碑文がありました。ソクラテスはそれを彼の哲学的宣言として採用しました。何千年もの間、私たちは読書、旅行、人間関係、失恋を通して「私は誰か」を少しずつ組み立ててきました。プロセスは長く、痛みを伴い、偶然に満ちています。

今、私たちにはAIがあります — 心理モデル、性格分析理論、知恵の伝統のほぼすべての人類の歴史がロードされています。それは短気になることはなく、あなたを裁くことはなく、偏見を持つことはありません。それは単にあなた自身のデータを徹底的に整理して要約するのを助け、それを鏡のように提示して尋ねます:「見て、これはあなたですか?」

私に数ヶ月の時間を費やさせた間違い

試行錯誤によってプロンプトエンジニアリングを学ぶことは高価です — お金ではなく、時間とフラストレーションにおいて。私が最も足止めされた間違いを共有することで、あなたの痛みを少し軽減させてください。

間違い1:AIを検索エンジンのように扱う

私がしたこと: Googleに入力しているかのように、短いキーワードスタイルの質問をした。

なぜ失敗したか: AIはキーワードの一致ではなく、会話のために最適化されています。短いクエリは一般的で表面的な回答を生み出します。

より良いアプローチ: コンサルタントに指示するかのようにプロンプトを書く。コンテキスト、制約、必要な具体的な結果を含める。

間違い2:例を提供しない

私がしたこと: 具体的な例を示さずに、抽象的な言葉で欲しいものを説明した。

なぜ失敗したか: 私の「プロフェッショナルなトーン」や「簡潔なフォーマット」のメンタルモデルは、AIの解釈とめったに一致しませんでした。

より良いアプローチ: 欲しいものの例を正確に1〜3個含める。フューショットプロンプティングは、プロンプトエンジニアリングにおいて最も信頼できるテクニックの1つです。

間違い3:早すぎる制限

私がしたこと: AIが自然に何を生成するかを見る前に、数十のルールと制約をプロンプトに事前にロードした。

なぜ失敗したか: 私は存在しない問題を解決していましたが、AIの出力の実際の問題を見逃していました。

より良いアプローチ: 単純に始める。AIが何を生成するかを見る。実際に観察した特定の問題を修正するためにのみ制約を追加する。

間違い4:出力形式の無視

私がしたこと: 情報をどのように構造化したいかを指定せずに、内容に完全に集中した。

なぜ失敗したか: 構造が私のニーズに合わなかったため、AIの出力を再フォーマットするのに何時間も費やしました。

より良いアプローチ: 常に形式を指定する — 箇条書き vs 段落、見出し、長さの制限、コードブロックを含めるかどうかなど。

間違い5:プロンプトの放棄が早すぎる

私がしたこと: プロンプトを一度試し、平凡な結果を得て、まったく異なるアプローチで再開した。

なぜ失敗したか: 具体的に何が機能しなかったのかを学ぶことはありませんでした。再起動するたびに、達成した部分的な進歩を失うことを意味しました。

より良いアプローチ: 失敗を繰り返す。指示の何が不明確だったかAIに尋ねる。全面的な変更ではなく、ターゲットを絞った調整を行う。

間違い6:否定的な指示が機能しないことを忘れる

私がしたこと: 「あまりフォーマルにしないで」や「専門用語を避けて」のような指示を書いた。

なぜ失敗したか: 否定的な指示はAIに避けるべきものを与えますが、目指すべきものは与えません。それはしばしば過剰修正するか、誤解します。

より良いアプローチ: ポジティブなフレーミングを使用する。「フォーマルにしないで」の代わりに、「コーヒーを飲みながら友人に説明しているかのように、リラックスした会話のトーンを使用して」と言う。

プロンプトエンジニアリングのパラドックス

ここに直感に反することがあります:あるトピックについて知れば知るほど、それについて良いプロンプトを書くのが難しくなることがあります。なぜか?専門家は明白ではないことを忘れるからです。彼らは自分たちには自明だと思われるがAIが必死に必要としているコンテキストを省略します。あなたのエキスパートレベルのプロンプトが初心者レベルの出力を生成する場合は、あなたのオーディエンスがあなたの分野について何も知らないかのようにすべてを説明してみてください。

パワーユーザーのための高度なテクニック

基本をマスターしたら、これらの高度なテクニックがあなたのプロンプティングを次のレベルに引き上げます。

Chain of Thought Prompting(思考の連鎖)

答えを直接尋ねる代わりに、AIにステップバイステップで推論するように頼んでください。これは、解決策への道が解決策自体と同じくらい重要である複雑な問題に対して特に強力です。

[あなたの問題または質問]

これをステップバイステップで考えてください:

1. 最初に重要な要因を特定する

2. 次に、これらの要因がどのように相互作用するかを分析する

3. 潜在的なエッジケースや例外を考慮する

4. 最後に、あなたの推論を結論に統合する

最終的な答えに達する前に、各ステップでの推論を示してください。Self-Consistency Prompting(自己一貫性)

正確さが本当に重要な質問については、AIに複数の独立した回答を生成させ、それらを統合させます。

[あなたの質問]

この質問に3つの異なる角度からアプローチしてください:

1. まず、[アプローチA]を使って考える

2. 次に、[アプローチB]の視点から考える

3. 最後に、[アプローチC]を使って分析する

3つの分析すべてを行った後、それらが一致する点と一致しない点を特定してください。その後、信頼度レベルと残りの不確実性についてのメモとともに、最終的な回答を提供してください。Meta-Prompting

プロンプトを使用する前に、AIを使ってプロンプトを改善してください。これは、新しいタイプのタスクに取り組むときに特に役立ちます。

私は[目標]を達成したいです。これが私のドラフトプロンプトです:

[あなたのドラフトプロンプト]

このプロンプトを分析し、改善を提案してください:

1. より良い結果を出すのに役立つどのような情報が欠けていますか?

2. 誤解を招く可能性のある曖昧さは何ですか?

3. 最大の明確さと効率のために、このプロンプトをどのように書き直しますか?

4. このタスクを試みる前に、私にどのような質問をしたいですか?構造化された分解(Structured Decomposition)

複雑で多面的なタスクについては、AIが構造を理解してくれることを期待するのではなく、必要なものを明示的に分解してください。

[全体的な目標]についての助けが必要です。

これを段階的に完了してください:

フェーズ1 - 調査:[収集する情報]

フェーズ2 - 分析:[その情報をどのように処理するか]

フェーズ3 - 合成:[洞察をどのように組み合わせるか]

フェーズ4 - 出力:[最終的な納品形式]

次のフェーズに進む前に、各フェーズを完全に完了してください。各フェーズの終わりに、続行する前に主要な調査結果を要約してください。「教師」プロンプト

最も過小評価されているテクニックの1つ:AIにあなたの代わりにそれをするだけでなく、何かをする方法を教えてもらうこと。これはより深い学習を生み出し、しばしばあなたが考慮していなかった側面を明らかにします。

[スキル/タスク]の方法を学びたいです。私の代わりにそれをするのではなく、お願いします:

1. 理解しなければならない核心的原則を説明する

2. コースを教えているかのように、プロセスをステップバイステップで案内する

3. 初心者が犯す一般的な間違いとそれを避ける方法を指摘する

4. スキルを構築するための実践的な演習を与える

5. 私が正しく行っているかどうかを知る方法を提案する

魚を与えるのではなく、釣り方を教えてください。すべての高度なテクニックに共通する糸:それらはAIを遅くし、その仕事を示させ、エラーをキャッチできるチェックポイントを増やします。プロンプトエンジニアリングにおいて速度が目標になることはめったにありません — 明確さと精度が目標です。

馬鹿げているほど単純だが効果的なトリック

あまりにも愚かで真実とは思えないようなことを共有します。しかし、それはGoogleの研究によって裏付けられており、私自身も確認しました:プロンプトを繰り返すだけで、精度が劇的に向上する可能性があります。

「Prompt Repetition Improves Non-Reasoning LLMs」というタイトルの論文は、質問を2回コピーすること — 文字通りCtrl+C、Ctrl+Vだけで — AIの正解の確率が大幅に向上することを発見しました。70の異なるテストタスクで、この単純なコピー&ペースト方法は47回勝ち、一度も負けませんでした。一部のタスクでは、精度が21%から97%に跳ね上がりました。

なぜそれが機能するのでしょうか?

大規模言語モデルは「因果的」です — それらは前に来たものだけに基づいて各トークンを予測します。現在の単語は前の単語だけを見て、後に来るものは見ません。

質問を繰り返すと、2番目のコピーの各単語は、最初のコピー全体を「振り返る」ことができます。それはAIに答える前に質問を2回読む機会を与えるようなものです。

これを例で具体化しましょう:

単純なプロンプト

オプション:

- A. 青い立方体を赤い立方体の左に置く

- B. 赤い立方体を青い立方体の左に置く

シーン:現在、赤は左、青は右。

質問:どちらのオプションがシーンを変えますか?

ダブルプロンプト

オプション:A. 青い立方体を赤い立方体の左に置く。B. 赤い立方体を青い立方体の左に置く。シーン:現在、赤は左、青は右。質問:どちらのオプションがシーンを変えますか?

[プロンプト全体をもう一度繰り返す]

オプション:A. 青い立方体を赤い立方体の左に置く。B. 赤い立方体を青い立方体の左に置く。シーン:現在、赤は左、青は右。質問:どちらのオプションがシーンを変えますか?

最初のケースでは、AIがオプションAとBを読むとき、まだシーンのコンテキストを知りません。シーンの説明を読む頃には、それらのオプションはすでに注意の彼方に流れています。

2番目のケースでは、繰り返されたオプションが現れると、それらは最初のコピーからの完全なコンテキストを持っています。モデルはシーンを完全に認識してオプションを読みます。

それは、「インセプション」や「流転の地球2(The Wandering Earth 2)」のような複雑な映画を見て、2回目により多くを理解するようなものです。

推論モデル(Reasoning Models)で機能しない理由

DeepSeek R1やGPT-4を推論モード(reasoning mode)で使用している場合、このトリックはしばしば利益をもたらしません。なぜか?推論モデルはすでに内部でこれを行うことを学んでいるからです。

推論モデルがどのように回答を始めることが多いかに注目してください:

- 「質問は...と尋ねています」

- 「解決する必要があるのは...」

- 「まず与えられた条件を理解しましょう...」

それらは自動的に質問を自分自身のために言い換えています。繰り返しはすでに内部で行われています。

より深い教訓

この研究は私を謙虚にさせました。私は何年もかけて複雑なプロンプトエンジニアリングのテクニックを学びましたが、ここではコピー&ペーストがそれらの多くを打ち負かしています。それは、時には最も単純なアプローチが最も強力であること — そして私たちがしばしばプロンプティングに必要なものを過度にロマンチックにしてきたことを思い出させてくれます。

繰り返しは重要です。誰かを愛することにおいて。専門知識を開発することにおいて。書くことにおいて。そしてどうやら、AIと話すことにおいても。

OpenAIのGPT-5ガイドが明らかにするもの

OpenAIはGPT-5の公式プロンプトガイドを静かにリリースしました。この1万語を超える内部マニュアルを分析して1日過ごした後、1つの結論が際立っています:GPT-5はもはや単純なチャットボットではありません — それは、単にプロンプトするのではなく、管理される必要がある真のAIエージェント実行エンジンです。

能力の天井は非常に高いですが、それを解き放つには体系的な方法が必要です。

「エージェントの熱意」(Agentic Eagerness)の制御

GPT-5は優秀な新しいインターンのようなものです — 非常に有能で、積極的に考え、探求しますが、指導が必要です。時々考えすぎて、単純なタスクを月面着陸プロジェクトに変えてしまいます(遅くて高価)。またある時は、絶えず説明を求めることなく自律的にやり遂げてほしいと思うでしょう。

OpenAIはこのキャリブレーションを「エージェントの熱意」と呼んでいます。調整方法は次のとおりです:

<context_gathering>

Goal: Get enough context fast. Parallelize discovery and stop as soon as you can act.

Method:

- Start broad, then fan out to focused subqueries.

- In parallel, launch varied queries; read top hits per query.

- Avoid over-searching for context.

Early stop criteria:

- You can name exact content to change.

- Top hits converge (~70%) on one area/path.

Depth:

- Trace only symbols you'll modify; avoid transitive expansion unless necessary.

Loop:

- Batch search → minimal plan → complete task.

- Search again only if validation fails. Prefer acting over more searching.

</context_gathering>さらに厳密な制御のために、予算を与えてください:

<context_gathering>

- Search depth: very low

- Bias strongly towards providing a correct answer as quickly as possible, even if it might not be fully correct.

- Usually, this means an absolute maximum of 2 tool calls.

- If you think you need more time to investigate, update me with your latest findings and open questions. You can proceed if I confirm.

</context_gathering>「even if it might not be fully correct」(完全に正しくないかもしれないとしても)というフレーズは、AIに小さな間違いを犯す許可を与えます — これにより不安が軽減され、応答が劇的に速くなります。

<persistence>

- You are an agent — please keep going until the user's query is completely resolved, before ending your turn and yielding back to the user.

- Only terminate your turn when you are sure that the problem is solved.

- Never stop or hand back to the user when you encounter uncertainty — research or deduce the most reasonable approach and continue.

- Do not ask the human to confirm or clarify assumptions. Decide what the most reasonable assumption is, proceed with it, and document it for the user's reference after you finish acting.

</persistence>翻訳:「あなたはエージェントです。私に聞くのをやめてください。ただやってください。」

行動する前にAIに報告させる

GPT-5のお気に入りの機能の1つ:実行する前に、何をするつもりか説明させること。フィードバックなしで静かに働く従業員を好む上司はいません。

<tool_preambles>

- Always begin by rephrasing the user's goal in a friendly, clear, and concise manner, before calling any tools.

- Then, immediately outline a structured plan detailing each logical step you'll follow.

- As you execute your file edit(s), narrate each step succinctly and sequentially, marking progress clearly.

- Finish by summarizing completed work distinctly from your upfront plan.

</tool_preambles>推論努力(Reasoning Effort)パラメータ

GPT-5には、 「思考の集中」ダイヤルとして機能するreasoning_effortパラメータがあります:

- 高(High): 深い思考と探査を必要とする複雑なタスク向け

- 中(Medium): デフォルト、ほとんどのタスクで機能します

- 低/最小(Low/Minimal): 速度と低遅延を優先する場合

コーヒーの強さのように考えてください — タスクが複雑であればあるほど、より高い濃度が必要です。

フロントエンド開発のための「標準回答」

開発者向けに、OpenAIはこの技術スタックを推奨しています — GPT-5はこれで最もトレーニングされており、審美的な出力は一貫して良好です:

- フレームワーク: Next.js (TypeScript), React, HTML

- スタイリング/UI: Tailwind CSS, shadcn/ui, Radix Themes

- アイコン: Material Symbols, Heroicons, Lucide

- アニメーション: Motion

- フォント: Sans Serif, Inter, Geist, Mona Sans, IBM Plex Sans, Manrope

AIにスタックをランダムに選ばせるのはやめましょう。この標準に固執すれば、出力品質は即座に向上します。

Claude vs ChatGPT — 異なる会話

私が得た最も重要な認識の1つ:異なるAIモデルは異なるコミュニケーションスタイルを必要とします。Claudeで素晴らしく機能するものが、ChatGPTでは平凡な結果を生む可能性があり、その逆もまた然りです。

Claudeの強み

Claudeは会話型のオープンエンドなプロンプトに優れています。ニュアンスのある議論や創造的な探求のために設計されています。

- 自然で流暢な言語を使用する

- リクエストを会話として組み立てる:「...についてどう思いますか」や「ブレインストーミングしましょう...」

- その巨大なコンテキストウィンドウ(200K+トークン)を活用する

- 長い議論の中で前のポイントに基づいて構築する

- 協力的で探索的な回答を求める

ChatGPTの強み

ChatGPTは構造化された正確なプロンプトに最もよく反応します。明確なパラメータが与えられると、精度と深さを優先します。

- 明示的な構造を使用する:見出し、番号付きリスト、区切り文字

- 制約を明確に定義する:単語数制限、必須セクション、フォーマットルール

- 指示を入力コンテンツから分離する

- 洗練された回答のためにロールプレイを使用する

- 改良サイクルを通じて反復する

実用的な違い

コンテキストの保持

Claudeは広範な議論を通じてコンテキストを保持することに優れています。長い会話での継続性を維持するために、「以前...について議論したことに続いて...」のようなリマインダーを含めてください。

区切り文字の使用

ChatGPTは、指示をコンテンツから分離するために区切り文字(三重引用符やXMLタグなど)を使用することから大きな利益を得ます。これは、何を処理すべきか対何が指示であるかを理解するのに役立ちます。

トーンの一致

Claudeは自然にあなたの会話のトーンを反映します。あなたが非公式に書けば、それは非公式に答えます。ChatGPTは同じ効果を得るために、トーンに関するより明示的な指示を必要とします。

エラー処理

Claudeが間違いを犯したとき、穏やかな修正がうまくいきます。ChatGPTはしばしば、正しいアプローチの明示的な言い換えに加えて、何が間違っていたかの例を必要とします。

最も効果的なプロンプトエンジニアは1つのスタイルを持っていません — 彼らは各モデルの性格に合わせた複数のスタイルを持っています。各モデルがあなたのプロンプトにどのように反応するかを読むことを学び、それに応じて適応してください。

実戦でテストされたプロンプトテンプレート

理論は有用ですが、テンプレートは時間を節約します。これらは私が最も頻繁に使用するプロンプトで、何千回もの反復を通じて洗練されています。

執筆タスク用

Role: あなたは[特定の種類のライター、例:「10年の経験を持つテックジャーナリスト」]です。

Task: [トピック]について[コンテンツの種類]を書いてください。

Audience: [誰がこれを読むか — 彼らの知識レベル、興味、痛点]

Tone: [特定のトーン — 例:「会話的だが権威がある、賢い同僚に説明するように」]

Format requirements:

- Length: [単語数または範囲]

- Structure: [必要に応じてアウトライン]

- Must include: [カバーすべき重要なポイント]

- Must avoid: [除外すべきもの]

Example of desired style: [可能であれば、類似コンテンツの1-2段落を含める]

Additional context: [役立つ背景情報があれば何でも]分析タスク用

[主題/文書/データ]を分析してください。

Analysis goals:

1. [答えるべき主要な質問]

2. [必要な二次的洞察]

3. [その他の考慮事項]

Please structure your analysis as follows:

- Executive Summary: 3-5点の主要な発見

- Detailed Analysis: [調査すべき特定の領域]

- Implications: これが[関連する利害関係者]にとって何を意味するか

- Recommendations: 実行可能な次のステップ

- Constraints: 特に[優先領域]に焦点を当てる

Note: 分析における制限や不確実性を記録してください。ソース資料からの具体的な例を引用してください。問題解決用

The Problem:

[コンテキストと制約を含めて問題を詳細に説明]

What I've Already Tried:

[以前の試みのリストとそれがうまくいかなかった理由]

Success Criteria:

[良い解決策はどのようなものか?]

Constraints:

- Budget/Resources: [関連する場合]

- Timeline: [関連する場合]

- Technical limitations: [関連する場合]

Please provide:

1. 根本原因の診断

2. 実行可能性でランク付けされた3-5の潜在的な解決策

3. 最良の解決策のためのステップバイステップの実装計画

4. 注意すべき潜在的な落とし穴

5. 解決策が機能しているかどうかを測定する方法新しいトピックの学習用

[トピック]を深く理解したいです。

My current level: [すでに知っていること]

My goal: [できるようになりたい/理解したいこと]

Time I can invest: [学習予算]

Please create a learning path that includes:

1. 最初に理解しなければならない核心的概念(知識の木の「幹」)

2. 避けるべき一般的な誤解

3. このトピックについて考えるための最良のメンタルモデルまたはフレームワーク

4. 私の理解をテストするための実践的な演習

5. さらに深く掘り下げるためのリソース(特定の高品質な情報源を知っている場合)

As we go, please:

- 質問をして私の理解を確認してください

- 私の思考の誤りを修正してください

- 概念を徐々に構築し、基礎が固まったときだけ進んでくださいコードレビュー用

Please review this code:

```

[ここにあなたのコード]

```

Context: [このコードが何をすべきか、より大きなシステム内のどこに適合するか]

Review for:

1. バグまたは論理的エラー

2. セキュリティの脆弱性

3. パフォーマンスの問題

4. コードスタイルと可読性

5. 処理されていないエッジケース

For each issue found, please provide:

- Location (行番号またはセクション)

- Severity (クリティカル/メジャー/マイナー/提案)

- Explanation of why it's a problem

- Suggested fix with code example

Also note: このコードで何がうまく行われており、保持されるべきか。意思決定用

私は[オプションA]と[オプションB]の間で迷っています。

Context: [決定の背景]

My priorities (in order):

1. [最も重要な要素]

2. [2番目に重要]

3. [3番目に重要]

For each option, please analyze:

- 私の優先順位に関連する長所と短所

- 短期的 vs 長期的な結果

- 何がうまくいかない可能性があるか(そして可能性/重大度)

- これが最良の選択であるために何が真実でなければならないか

Then provide:

- 根拠を伴うあなたの推奨

- どのような追加情報があなたの推奨を変えるか

- 私の思考を検証するために使用できる決定チェックリスト優れたプロンプトの背にある哲学

3年間の毎日のAIとのやり取りの後、私はプロンプトエンジニアリングは実際にはAIについてではないという確信に至りました。それは、新しいアリーナに持ち上げられた、明確なコミュニケーションという古代の人間の課題についてです。

考えてみてください:AIの出力に対してあなたが抱いたあらゆるフラストレーションは、コミュニケーションの失敗にさかのぼることができます。あなたは思っていることを言いませんでした。あなたは存在しない共有コンテキストを仮定しました。精度が必要なときに曖昧でした。これらは人間のコミュニケーションを悩ませるのと同じ失敗です — AIは単にそれらを出力ですぐに見えるようにするだけです。

この意味で、プロンプトエンジニアリングを学ぶことは、より明確に考えることを学ぶことです。

自己反省としてのプロンプト

私は、最高のプロンプトは、私が何を望んでいるかがすでに明確なときに来ることに気づきました。詳細なプロンプトを書く行為は、私自身の思考のギャップに直面することを強制します。私は正確に何を達成しようとしているのか?成功はどのようなものか?どの制約が本当に重要か?

私はしばしば、AIが答える前でさえ、プロンプトを書いている途中で自分自身の問題を解決します。プロンプトは思考ツールになります — 私自身の考えを外部化し、検討するための構造化された方法です。

プロンプトが明確であればあるほど、あなたの思考は明確になります。プロンプトエンジニアリングは密かに自己認識の規律です。

命令ではなく協力

AIの旅の初期には、私はプロンプトを命令 — 部下への指示として扱っていました。このアプローチは一貫して平凡な結果を生み出しました。

シフトは、私がAIを自分とは異なる強みを持つ協力者として扱い始めたときに起こりました。私はドメイン知識、判断力、創造性、目標をもたらします。AIは膨大な知識、疲れを知らない計算能力、パターン認識、そして分野を超えて情報を統合する能力をもたらします。

優れたプロンプトは協力者間のブリーフィングであり、使用人への命令ではありません。それらは何だけでなく、なぜを説明します。不必要に制限するのではなく、AIの専門知識を招き入れます。それらはAIがそのユニークな能力で貢献するためのスペースを作ります。

会話としての反復

プロンプトエンジニアリングは、最初の試みで完璧なプロンプトを作成することではありません。それは、必要なものに収束する効果的な会話を導くことです。

最初のプロンプト:欲しいもののラフスケッチ。最初の回答:スケッチのどこが不明瞭だったかを明らかにします。2番目のプロンプト:学んだことに基づく改良。2番目の回答:ターゲットに近づく。完了するまで続けます。

この反復的なアプローチは、単一のプロンプトからのプレッシャーを取り除きます。すべての要件を事前に予測する必要はありません。フィードバックに反応するだけでよいのです。

具体性の謙虚さ

曖昧なプロンプトは安全に感じます。「このトピックについて良いものを書いて」と言うとき、あなたは特定のビジョンにコミットしていません。出力が期待外れなら、まあ、あなたは実際に何を望んでいるかを決して言いませんでした。

具体的なプロンプトは脆弱性を必要とします。あなたは「良い」があなたにとって何を意味するかを正確に表現しなければなりません。あなたは自分の基準、好み、ビジョンを明らかにしなければなりません。出力が的を外したとき、あなたの仕様に欠陥があったか、AIが提供できなかったかは明らかです — しかし、いずれにせよ、あなたは何か具体的なことを学びました。

具体性は謙虚さです。なぜなら、それは自分が望むものについて間違っていることをいとわないことを意味するからです。

エンドゲーム

AIモデルが改善するにつれて、現在のプロンプトエンジニアリング技術の多くは時代遅れになるでしょう。将来のモデルは、曖昧な入力を優雅に処理し、明確にするための質問を自動的に行い、最小限の情報からコンテキストを直感的に感知するかもしれません。

しかし、核心的なスキル — 自分の考えを明確に表現し、関連するコンテキストを提供し、効果的に反復する能力 — は、より価値のあるものになるだけです。これらは、AI、同僚、または自分自身とコミュニケーションをとるかどうかにかかわらず適用される、根本的に人間的なスキルです。

プロンプトエンジニアリングは一時的なものです。明確な思考は永遠です。

「私たちが選ぶ信頼できる情報源は王ではありません — 廷臣でもありません。それは遠くから来た放浪の詩人であり、ボロをまとい、宮殿のダイニングテーブルに飛び乗り、リュートを弾き、私たちが聞いたことのない叙事詩や物語を大声で歌い、私たちの王国の外の土地や、私たちが想像もできなかった星や海について語ります。彼の唯一の意義は、私たちのそれぞれの王国の壁を取り壊し、私たちが快適に、居心地よく、そして最終的には私たち自身の完璧な玉座で孤独に死ぬのを防ぐことです。」

それがAIであり、その最高の状態です。効率のためのツールではなく、私たちの視野を広げる詩人です。そしてプロンプトエンジニアリング?それはその会話を可能にする言語を学ぶことです。

このガイドのテクニックは、AIが進化するにつれて進化します。しかし、重要な洞察は残ります:AIとの会話の質は、あなたの思考の質を反映しています。一方を研ぎ澄ませば、もう一方も研ぎ澄まされます。

さあ、この記事を閉じて、会話をしに行きましょう。信じていることに挑戦してください。怖いものを学んでください。一人では作れなかったものを作ってください。

詩人が待っています。

ディスカッション

0 コメントコメントを残す

この記事についてご感想をお聞かせください!