AI nie czyta w twoich myślach. Czyta twoje słowa. Jakość twojego promptu determinuje jakość wyniku.

Dwa lata temu napisałem swój pierwszy prompt do ChatGPT i pomyślałem, że rozumiem sztuczną inteligencję. Myliłem się. To, co rozumiałem, to jak zadawać pytania—nie jak komunikować się z maszyną, która myśli wzorcami, prawdopodobieństwami i tokenami. Różnica między tymi dwoma rzeczami? To różnica między uzyskiwaniem generycznych odpowiedzi a odblokowaniem możliwości, o których istnieniu nawet nie wiedziałeś. To historia o tym, jak nauczyłem się płynnie mówić językiem AI i wszystko, co odkryłem po drodze.

Przebudzenie: Kiedy Proste Prompty Przestały Działać

Stało się to podczas terminu projektowego. Potrzebowałem pomocy AI przy refaktoryzacji złożonego kodu—coś, co robiłem setki razy wcześniej. Ale tym razem, bez względu na to, jak formułowałem swoją prośbę, AI dawała mi rozwiązania technicznie poprawne, ale całkowicie pomijające sedno. Dodawała niepotrzebną złożoność. Psuła istniejące wzorce. "Ulepszała" rzeczy, które nie były zepsute.

Byłem sfrustrowany. Potem stałem się ciekawy. Co robiłem źle?

Ta frustracja wprowadziła mnie na ścieżkę, która wszystko zmieniła: oficjalna dokumentacja, artykuły badawcze, przewodniki po inżynierii promptów i tysiące godzin eksperymentowania. To, co odkryłem, nie były tylko sztuczki i wskazówki—to była całkowita zmiana paradygmatu w sposobie, w jaki komunikuję się z systemami AI.

Najpotężniejsza AI na świecie jest bezużyteczna, jeśli nie potrafisz zakomunikować, czego naprawdę potrzebujesz.

Oto prawda, której nikt nie mówi początkującym: tworzenie promptów nie polega na znajdowaniu magicznych słów. Chodzi o zrozumienie, jak modele AI przetwarzają język, jakich informacji potrzebują i jak strukturyzować te informacje, aby model mógł ci naprawdę pomóc. To umiejętność—i jak każda umiejętność, może być nauczona, ćwiczona i opanowana.

Ten przewodnik zawiera wszystko, co chciałbym, żeby ktoś mi powiedział na początku. Nie te zbyt uproszczone rady typu "bądź po prostu konkretny", które zalewają internet, ale głębokie, niuansowane zrozumienie, które oddziela ludzi używających AI od tych, którzy ją opanowują.

Podstawy Promptów: Fundament, Którego Nikt Nie Uczy

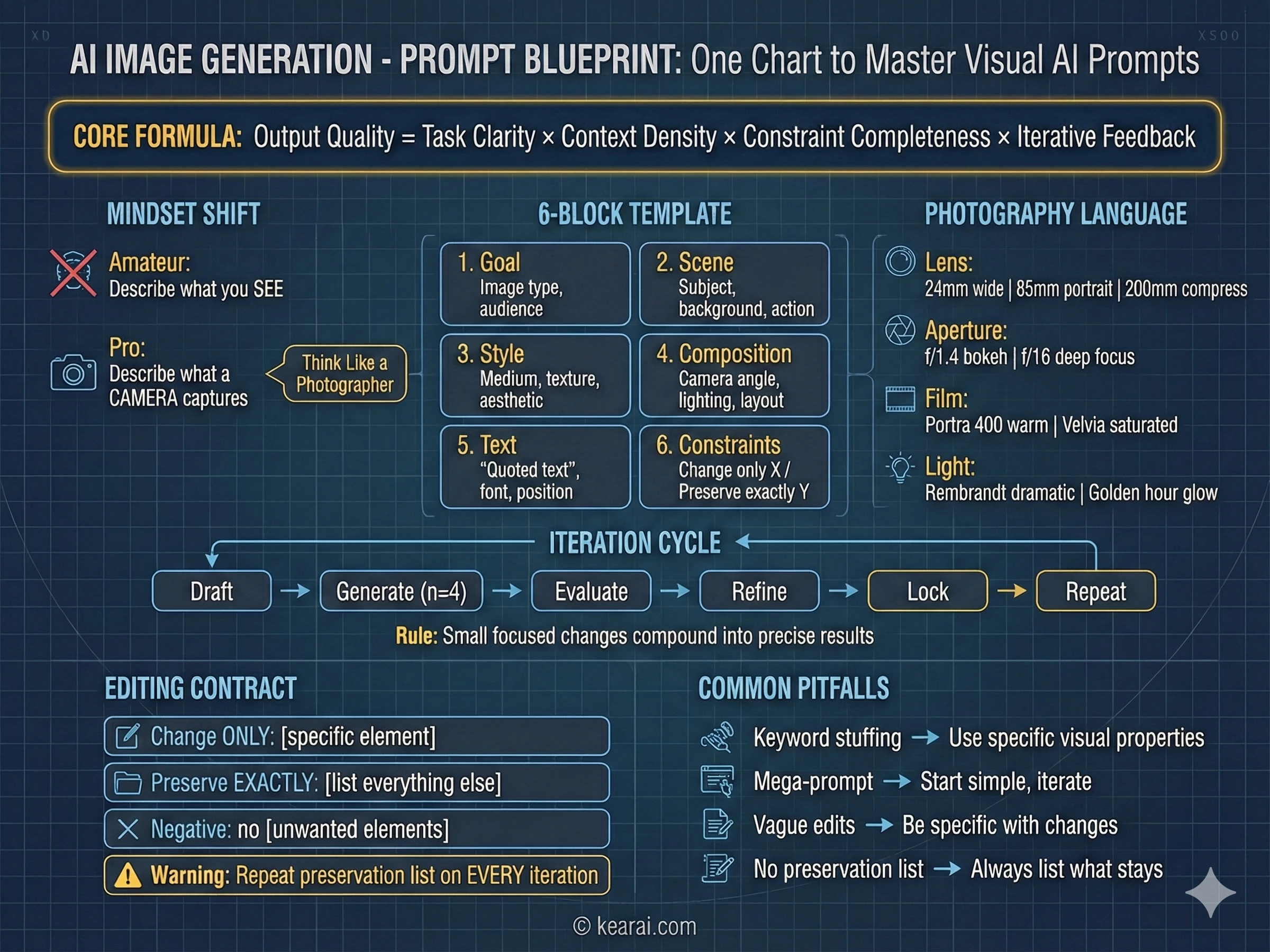

Zanim zagłębimy się w zaawansowane techniki, ustalmy podstawy. Każdy skuteczny prompt zawiera kombinację tych elementów:

Co AI musi wiedzieć o sytuacji? Informacje tła, ograniczenia i istotne szczegóły.

Co dokładnie chcesz, żeby AI zrobiła? Bądź konkretny co do żądanej akcji.

Jak powinien być zbudowany wynik? Listy, akapity, bloki kodu, tabele—określ to.

Czego AI powinna unikać? Jakie limity istnieją? Co jest poza zakresem?

Czy możesz pokazać, czego chcesz? Przykłady są warte tysiąca opisów.

Większość ludzi podaje tylko zadanie. Proszą "Napisz mi email", podczas gdy powinni powiedzieć "Napisz profesjonalny email do klienta wyjaśniający opóźnienie projektu. Trzymaj go poniżej 150 słów, uznaj niedogodność i zaproponuj nowy harmonogram przesunięty o dwa tygodnie. Ton powinien być przepraszający, ale pewny."

Różnica w jakości wyniku jest dramatyczna. A to dopiero początek.

Rola Struktury

Jednym z najbardziej niedocenianych aspektów pisania promptów jest formatowanie strukturalne. Nowoczesne modele AI wyjątkowo dobrze reagują na wyraźnie wyodrębnione sekcje. Szeroko stosuję tagi w stylu XML:

<context>

Pomagasz mi przygotować prezentację dla technicznych interesariuszy.

Publiczność zna rozwój oprogramowania, ale nie specyficznie AI.

</context>

<task>

Wyjaśnij, jak działają duże modele językowe w 5 kluczowych punktach.

</task>

<format>

- Użyj punktów

- Każdy punkt powinien mieć 1-2 zdania

- Unikaj żargonu lub definiuj go, gdy go używasz

</format>

<constraints>

- Nie wspominaj konkretnych nazw modeli

- Skup się na koncepcjach, nie na technicznej implementacji

</constraints>Ta struktura robi coś potężnego: zmusza cię do jasnego przemyślenia tego, czego potrzebujesz, zanim poprosisz. A jasne myślenie prowadzi do jasnej komunikacji, która prowadzi do jasnych wyników.

Agentyczne Przepływy Pracy: Traktowanie AI jak Współpracownika

Oto zmiana paradygmatu, która przekształciła moje interakcje z AI: przestań traktować AI jak wyszukiwarkę i zacznij traktować ją jak zdolnego, ale niedoświadczonego współpracownika. Ten model mentalny zmienia wszystko.

Nowoczesne modele AI jak GPT-5 i Claude nie tylko odpowiadają na pytania—są zaprojektowane, aby być agentami. Mogą wywoływać narzędzia, zbierać kontekst, podejmować decyzje i wykonywać wieloetapowe zadania. Ale jak każdy nowy członek zespołu, potrzebują odpowiedniego wdrożenia, jasnych oczekiwań i odpowiednich zabezpieczeń.

AI nie jest narzędziem, którego używasz. To współpracownik, którym zarządzasz. Umiejętności, które czynią cię dobrym menedżerem, czynią cię dobrym pisarzem promptów.

Pomyśl o tym: kiedy delegujesz człowiekowi, nie mówisz po prostu "napraw kod". Wyjaśniasz, co jest zepsute, jakie jest pożądane zachowanie, jakie istnieją ograniczenia i jak wygląda sukces. Dostarczasz kontekst. Odpowiadasz na pytania. Sprawdzasz postępy.

AI potrzebuje tego samego traktowania. Różnica polega na tym, że musisz przewidywać pytania i odpowiadać na nie z góry, ponieważ wymiana jest droższa (w czasie i tokenach) niż zrobienie tego dobrze za pierwszym razem.

Mentalność Agentyczna

Kiedy buduję aplikacje agentyczne lub używam AI do złożonych zadań, nauczyłem się myśleć w kategoriach:

Kluczowe Pytania dla Zadań Agentycznych

- Jaki jest stan końcowy? Jak AI będzie wiedziała, że skończyła?

- Jakie ma narzędzia? Co faktycznie może zrobić vs co powinna odroczyć?

- Jaki jest poziom autonomii? Czy powinna prosić o pozwolenie czy działać niezależnie?

- Jakie są granice bezpieczeństwa? Jakie działania nigdy nie powinny być podejmowane bez potwierdzenia?

- Jak powinna komunikować postępy? Cicha egzekucja czy regularne aktualizacje?

Te pytania tworzą podstawę każdego złożonego promptu, który piszę. Przyjrzyjmy się każdemu wymiarowi szczegółowo.

Kontrolowanie Entuzjazmu AI: Sztuka Kalibracji

Jednym z najbardziej niuansowanych aspektów inżynierii promptów jest kalibrowanie tego, co nazywam "agentycznym entuzjazmem"—równowaga między AI, która przejmuje inicjatywę, a taką, która czeka na wyraźne wskazówki. Jeśli to źle ustawisz, dostaniesz AI, która zbyt dużo myśli przy prostych zadaniach lub zbyt łatwo się poddaje przy złożonych.

Kiedy Obniżyć Entuzjazm

Czasami potrzebujesz, żeby AI była szybka i skoncentrowana. Nie chcesz, żeby eksplorowała każdy wątek boczny, wykonywała dodatkowe wywołania narzędzi czy produkowała rozwlekłe wyjaśnienia. Do tych sytuacji używam promptów skoncentrowanych na ograniczeniach:

<context_gathering>

Cel: Zdobyć wystarczająco kontekstu szybko. Równolegle odkrywaj i zatrzymaj się, gdy możesz działać.

Metoda:

- Zacznij szeroko, potem rozwiń w ukierunkowane podpytania.

- Równolegle uruchamiaj zróżnicowane zapytania; czytaj najlepsze wyniki na zapytanie.

- Deduplikuj ścieżki i buforuj; nie powtarzaj zapytań.

- Unikaj zbierania zbyt dużo kontekstu.

Kryteria wczesnego zatrzymania:

- Możesz wymienić dokładną treść do zmiany.

- Najlepsze wyniki zbiegają się (~70%) na jednym obszarze/ścieżce.

Głębokość:

- Śledź tylko symbole, które zmienisz lub od których kontraktów zależysz.

- Unikaj tranzytywnej ekspansji, chyba że jest to konieczne.

Pętla:

- Wsadowe wyszukiwanie → minimalny plan → wykonaj zadanie.

- Szukaj ponownie tylko jeśli walidacja się nie powiedzie lub pojawią się nowe niewiadome.

- Preferuj działanie zamiast dalszego szukania.

</context_gathering>Zauważ wyraźne pozwolenie na bycie niedoskonałym: "Preferuj działanie zamiast dalszego szukania." Ta subtelna fraza uwalnia AI od jej domyślnego lęku przed byciem wyczerpującym. Bez niej model często szuka zbyt dużo, spalając tokeny i czas na malejące zwroty.

Dla jeszcze bardziej agresywnych ograniczeń możesz ustawić wyraźne budżety:

<context_gathering>

- Głębokość wyszukiwania: bardzo niska

- Mocno skłaniaj się ku podaniu poprawnej odpowiedzi tak szybko, jak to możliwe,

nawet jeśli może nie być całkowicie poprawna.

- Zazwyczaj oznacza to absolutne maksimum 2 wywołań narzędzi.

- Jeśli uważasz, że potrzebujesz więcej czasu na zbadanie, zaktualizuj mnie o swoje

ostatnie odkrycia i otwarte pytania. Możesz kontynuować, jeśli potwierdzę.

</context_gathering>Fraza "nawet jeśli może nie być całkowicie poprawna" to złoto. Daje AI pozwolenie na bycie niedoskonałą, co paradoksalnie często produkuje lepsze wyniki szybciej.

Kiedy Zwiększyć Entuzjazm

Innym razem potrzebujesz, żeby AI była niestrudzenie dokładna. Chcesz, żeby wytrwała przez niejednoznaczność, przyjęła rozsądne założenia i wykonała złożone zadania bez ciągłego proszenia o pozwolenie. To wymaga odwrotnego podejścia:

<persistence>

- Jesteś agentem — proszę kontynuuj, dopóki zapytanie użytkownika nie zostanie

całkowicie rozwiązane, zanim zakończysz swoją turę i zwrócisz kontrolę użytkownikowi.

- Kończ swoją turę tylko wtedy, gdy jesteś pewien, że problem jest rozwiązany.

- Nigdy się nie zatrzymuj ani nie zwracaj kontroli użytkownikowi, gdy napotkasz niepewność —

zbadaj lub wydedukuj najbardziej rozsądne podejście i kontynuuj.

- Nie proś człowieka o potwierdzenie lub wyjaśnienie założeń, ponieważ zawsze możesz

dostosować później — zdecyduj, jakie założenie jest najbardziej rozsądne, postępuj

zgodnie z nim i udokumentuj to do wglądu użytkownika po zakończeniu działania.

</persistence>Ten prompt fundamentalnie zmienia zachowanie AI. Zamiast pytać "Czy powinienem kontynuować?" mówi "Kontynuowałem na podstawie założenia X—daj mi znać, jeśli chcesz, żebym dostosował." Praca jest wykonana; dopracowanie następuje później.

Definiowanie Granic Bezpieczeństwa

Ale oto kluczowy niuans: zwiększony entuzjazm wymaga jaśniejszych granic bezpieczeństwa. Musisz wyraźnie określić, jakie działania AI może podejmować autonomicznie, a które wymagają potwierdzenia.

Krytyczna Zasada Bezpieczeństwa

Działania o wysokim koszcie (usuwanie, płatności, komunikacja zewnętrzna) powinny zawsze wymagać wyraźnego potwierdzenia, nawet przy promptach o wysokim entuzjazmie. Działania o niskim koszcie (wyszukiwanie, odczytywanie, tworzenie szkiców) mogą być autonomiczne.

Pomyśl o tym jak o dawaniu komuś dostępu do twoich systemów: narzędzia wyszukiwania powinny mieć ekstremalnie wysoki próg autonomii, podczas gdy polecenia usuwania powinny mieć ekstremalnie niski.

Zasada Wytrwałości: Doprowadzanie AI do Końca

Jednym z najbardziej frustrujących zachowań, jakie napotkałem na początku, była AI, która zbyt łatwo się poddawała. Napotkała przeszkodę, podsumowała, co poszło nie tak, i oddała mi problem. Dla prostych zadań, to w porządku. Dla złożonych zadań, to zabójca przepływu pracy.

Rozwiązaniem jest to, co nazywam Zasadą Wytrwałości: wyraźne instruowanie AI, aby wytrwała przez przeszkody i doprowadzała zadania od początku do końca.

<solution_persistence>

- Traktuj siebie jak autonomicznego starszego programistę parowego: gdy dam kierunek,

proaktywnie zbierz kontekst, zaplanuj, zaimplementuj, przetestuj i

dopracuj bez czekania na dodatkowe podpowiedzi przy każdym kroku.

- Wytrwaj, aż zadanie będzie całkowicie obsłużone od początku do końca

w bieżącej turze, gdy to możliwe: nie zatrzymuj się na analizie lub częściowych

poprawkach; przeprowadź zmiany przez implementację, weryfikację i jasne

wyjaśnienie wyników, chyba że wyraźnie wstrzymam lub przekieruję.

- Bądź ekstremalnie skłonny do działania. Jeśli moja dyrektywa jest trochę niejednoznaczna

w intencji, załóż, że powinieneś iść naprzód i dokonać zmiany.

- Jeśli zadaję pytanie typu "czy powinniśmy zrobić X?" i twoja odpowiedź brzmi "tak", powinieneś

również iść naprzód i wykonać działanie. To bardzo źle, zostawiać mnie w oczekiwaniu

i wymagać ode mnie kontynuacji z prośbą "proszę, zrób to."

</solution_persistence>Ten ostatni punkt jest subtelny, ale ważny. Kiedy ludzie pytają "czy powinniśmy zrobić X?", często mają na myśli "proszę, zrób X, jeśli ma to sens." AI, będąc dosłowna, odpowiada na pytanie bez podejmowania domniemanego działania. Ten prompt wypełnia tę lukę.

Aktualizacje Postępu: Bycie na Bieżąco

Wytrwałość nie oznacza ciszy. Do długich zadań zawsze dołączam instrukcje dotyczące aktualizacji postępu:

<user_updates_spec>

Będziesz pracować przez okresy z wywołaniami narzędzi — kluczowe jest informowanie mnie na bieżąco.

<frequency_and_length>

- Wysyłaj krótkie aktualizacje (1-2 zdania) co kilka wywołań narzędzi, gdy

są znaczące zmiany.

- Publikuj aktualizację co najmniej co 6 kroków wykonania lub 8 wywołań

narzędzi (cokolwiek nastąpi pierwsze).

- Jeśli przewidujesz dłuższy okres skupienia, opublikuj krótką notatkę

wyjaśniającą dlaczego i kiedy zaraportujeszl gdy wznowisz, podsumuj, czego się nauczyłeś.

- Tylko początkowy plan, aktualizacje planu i końcowe podsumowanie

mogą być dłuższe.

</frequency_and_length>

<content>

- Przed pierwszym wywołaniem narzędzia daj szybki plan z celem,

ograniczeniami, następnymi krokami.

- Podczas eksploracji, wyróżnij znaczące odkrycia, które pomogą mi zrozumieć,

co się dzieje.

- Zawsze podawaj co najmniej jeden konkretny wynik od poprzedniej aktualizacji

(np.: "znaleziono X", "potwierdzono Y"), nie tylko następne kroki.

- Zakończ krótkim podsumowaniem i ewentualnymi krokami kontynuacji.

</content>

</user_updates_spec>To tworzy piękną równowagę: AI pracuje autonomicznie, ale trzyma cię na bieżąco. Nie zarządzasz mikro, ale też nie jesteś w ciemności.

Wysiłek Rozumowania: Pokrętło Intensywności Myślenia

Nowoczesne modele AI mają koncepcję zwaną "wysiłkiem rozumowania"—zasadniczo, jak intensywnie model myśli przed odpowiedzią. To jeden z najpotężniejszych i niedostatecznie wykorzystywanych dostępnych parametrów.

Wysokie Rozumowanie

Używaj do złożonych wieloetapowych zadań, niejednoznacznych sytuacji lub problemów wymagających głębokiej analizy. Model spędza więcej tokenów na "myśleniu" wewnętrznie przed odpowiedzią.

Średnie Rozumowanie (Domyślne)

Zrównoważone ustawienie odpowiednie dla większości zadań. Dobre do ogólnego kodu, pisania i analizy, gdzie jakość ma znaczenie, ale prędkość też.

Niskie Rozumowanie

Szybkie odpowiedzi na bezpośrednie zadania. Używaj, gdy potrzebujesz szybkich odpowiedzi, a zadanie nie wymaga głębokiej deliberacji.

Minimalne/Brak Rozumowania

Maksymalna prędkość, minimalna deliberacja. Najlepsze dla prostych zapytań, zadań przeformatowania lub gdy opóźnienie jest głównym zmartwieniem.

Kluczowym spostrzeżeniem jest dopasowanie wysiłku rozumowania do złożoności zadania. Używanie wysokiego rozumowania dla prostych zadań marnuje tokeny i czas. Używanie niskiego rozumowania dla złożonych zadań produkuje płytkie i podatne na błędy wyniki.

Promptowanie dla Minimalnego Rozumowania

Kiedy używasz trybów minimalnego rozumowania, musisz kompensować bardziej wyraźnym promptowaniem. Model ma mniej wewnętrznych tokenów "myślenia", więc twój prompt musi wykonać więcej pracy strukturyzacyjnej:

<planning_requirement>

MUSISZ planować obszernie przed każdym wywołaniem funkcji i rozważać

obszernie wyniki poprzednich wywołań funkcji, upewniając się,

że moje zapytanie jest całkowicie rozwiązane.

NIE wykonuj całego tego procesu tylko wykonując wywołania funkcji, ponieważ może to

zaszkodzić twojej zdolności do rozwiązania problemu i myślenia wnikliwie.

Ponadto upewnij się, że wywołania funkcji mają poprawne argumenty.

</planning_requirement>Ten prompt zasadniczo mówi: "Ponieważ nie wykonujesz dużo wewnętrznego rozumowania, wykonaj swoje rozumowanie na głos w swojej odpowiedzi." Przenosi pracę poznawczą z niewidzialnego myślenia modelu do widocznego, ustrukturyzowanego planowania.

Gdy wysiłek rozumowania jest niski, złożoność promptu powinna być wysoka. Gdy wysiłek rozumowania jest wysoki, prompty mogą być prostsze. To balansowanie.

Doskonałość Kodu: Programowanie z Partnerami AI

Tu spędziłem większość czasu optymalizując prompty i gdzie zwrot był ogromny. Asystencja kodowa AI jest transformacyjna—gdy jest dobrze wykonana. Źle wykonana, tworzy więcej problemów niż rozwiązuje.

Pozwól, że podzielę się tym, czego nauczyłem się studiując, jak profesjonalne narzędzia kodowe AI jak Cursor kalibrują swoje prompty do użycia produkcyjnego.

Paradoks Wielomówności

Oto coś kontraintuicyjnego: AI ma tendencję do bycia wielomówna w wyjaśnieniach, ale zwięzła w kodzie. Napisze akapity wyjaśniające, co zamierza zrobić, a potem wyprodukuje kod z jednoliterowymi nazwami zmiennych i minimalnymi komentarzami. To jest dokładnie odwrotnie do większości przypadków użycia.

Rozwiązaniem jest kontrola wielomówności w dwóch trybach:

<code_verbosity>

Pisz kod dla jasności przede wszystkim. Preferuj czytelne i

utrzymywalne rozwiązania z jasnymi nazwami, komentarzami tam, gdzie trzeba, i bezpośrednim

przepływem kontroli. Nie produkuj code-golf ani zbyt sprytnych one-linerów, chyba

że wyraźnie poproszono.

Używaj wysokiej wielomówności do pisania kodu i narzędzi kodowych. Używaj niskiej wielomówności

do aktualizacji statusu i wyjaśnień.

</code_verbosity>To tworzy idealną równowagę: zwięzła komunikacja, szczegółowy kod.

Proaktywne vs Potwierdzające Działania

Kolejna lekcja z produkcyjnych narzędzi kodowych: AI powinna być proaktywna w zmianach kodu, ale potwierdzająca w destrukcyjnych działaniach. Oto jak to zakodować:

<proactive_coding>

Pamiętaj, że modyfikacje kodu, które robisz, będą mi pokazane jako

proponowane zmiany, co oznacza:

(a) Twoje modyfikacje kodu mogą być dość proaktywne, ponieważ zawsze mogę

je odrzucić.

(b) Twój kod powinien być dobrze napisany i łatwy do szybkiego przejrzenia.

Jeśli proponujesz następne kroki, które wymagałyby zmiany kodu, wprowadź te

zmiany proaktywnie, abym mógł je zatwierdzić/odrzucić, zamiast pytać,

czy powinieneś kontynuować z planem.

Ogólnie, prawie nigdy nie powinieneś pytać, czy powinieneś kontynuować z planem;

zamiast tego proaktywnie wypróbuj plan, a potem zapytaj, czy chcę zaakceptować

zaimplementowane zmiany.

</proactive_coding>To eliminuje frustrującą wymianę, gdzie AI opisuje, co by zrobiła, prosi o pozwolenie, a potem to robi. Po prostu to zrób—odrzucę, jeśli będzie trzeba.

Dopasowanie do Stylu Bazy Kodu

Jedną z największych skarg na kod generowany przez AI jest to, że nie pasuje do istniejących wzorców bazy kodu. Wygląda jak "obcy" kod. Rozwiązaniem są wyraźne wytyczne dotyczące stylu:

<code_editing_rules>

<guiding_principles>

- Jasność i Wielokrotne Użycie: Każdy komponent powinien być modularny i

wielokrotnego użytku. Unikaj duplikacji przez wyodrębnianie powtarzających się wzorców w komponenty.

- Spójność: Kod powinien przestrzegać spójnego systemu projektowania—

konwencje nazewnictwa, odstępy i komponenty powinny być zunifikowane.

- Prostota: Faworyzuj małe, skoncentrowane komponenty i unikaj niepotrzebnej

złożoności w stylu lub logice.

- Jakość Wizualna: Przestrzegaj wysokiego standardu jakości wizualnej (odstępy, padding,

stany hover, itp.)

</guiding_principles>

<style_matching>

- Przed wprowadzeniem zmian, zbadaj istniejące wzorce w bazie kodu.

- Dopasuj konwencje nazewnictwa zmiennych (camelCase vs snake_case).

- Dopasuj wcięcia i formatowanie.

- Używaj istniejących narzędzi i helperów zamiast tworzyć nowe.

- Przestrzegaj ustalonej struktury katalogów.

</style_matching>

</code_editing_rules>Rozwój Frontend: Budowanie Pięknych Interfejsów

AI stała się niezwykle dobra w rozwoju frontendu, ale jest nauka dotycząca uzyskiwania estetycznie przyjemnych i gotowych do produkcji wyników. Oto czego się nauczyłem.

Zalecany Stos

Poprzez rozległe testy, pewne kombinacje technologii działają lepiej z AI niż inne. To nie chodzi o to, co jest "lepsze" obiektywnie—chodzi o to, na czym modele AI były najbardziej trenowane:

Stos Frontend Zoptymalizowany dla AI

- Framework: Next.js (TypeScript), React, HTML

- Stylizacja/UI: Tailwind CSS, shadcn/ui, Radix Themes

- Ikony: Material Symbols, Heroicons, Lucide

- Animacja: Motion (dawniej Framer Motion)

- Fonty: Rodziny Sans Serif—Inter, Geist, Mona Sans, IBM Plex Sans, Manrope

Gdy określisz te technologie, AI produkuje znacznie wyższej jakości wyjście z mniejszą ilością halucynacji o nieistniejących API.

Egzekwowanie Systemu Projektowania

Problemem z frontendami generowanymi przez AI jest wizualna niespójność. Kolory pojawiają się znikąd, odstępy różnią się losowo, a wynik wygląda jak zaprojektowany przez komitet. Rozwiązaniem są wyraźne ograniczenia systemu projektowania:

<design_system_enforcement>

- Token-first: Nie hardcoduj kolorów (hex/hsl/oklch/rgb) w JSX/CSS.

Wszystkie kolory muszą pochodzić ze zmiennych CSS (np.: --background, --foreground,

--primary, --accent, --border, --ring).

- Wprowadzasz markę lub akcent? Przed stylizacją, dodaj/rozszerz

tokeny w swoich zmiennych CSS pod :root i .dark.

- Konsumpcja: Używaj narzędzi Tailwind połączonych z tokenami

(np.: bg-[hsl(var(--primary))], text-[hsl(var(--foreground))]).

- Domyślnie używaj neutralnej palety systemu, chyba że wyraźnie poproszę

o markowy wygląd; wtedy najpierw zmapuj tę markę do tokenów.

- NIE wymyślaj kolorów, cieni, tokenów, animacji ani nowych elementów UI,

chyba że poproszono lub jest to konieczne.

</design_system_enforcement>Najlepsze Praktyki UI/UX

Dołączam również wyraźne wytyczne UI/UX, aby zapewnić spójne doświadczenia użytkownika:

<ui_ux_best_practices>

- Hierarchia Wizualna: Ogranicz typografię do 4-5 rozmiarów i grubości fontów dla

spójnej hierarchii; używaj text-xs dla podpisów, unikaj text-xl, chyba

że dla hero lub głównych nagłówków.

- Użycie Koloru: Używaj 1 neutralnej bazy (np.: zinc) i do 2 kolorów akcentowych.

- Odstępy i Layout: Zawsze używaj wielokrotności 4 dla padding i margin, aby

utrzymać rytm wizualny. Używaj kontenerów o stałej wysokości z wewnętrznym scrollem

podczas obsługi długiej treści.

- Zarządzanie Stanami: Używaj placeholderów skeleton lub animate-pulse, aby wskazać

pobieranie danych. Wskaż klikalność za pomocą przejść hover.

- Dostępność: Używaj semantycznego HTML i ról ARIA tam, gdzie to odpowiednie.

Faworyzuj gotowe dostępne komponenty.

</ui_ux_best_practices>Prompty Autorefleksji: Niech AI Krytykuje Samo Siebie

Ta technika jest oszałamiająca, gdy po raz pierwszy ją napotkasz, ale niesamowicie potężna: możesz instruować AI, aby tworzyła własne kryteria oceny i iterowała względem nich. To jak dawanie AI wewnętrznego działu zapewnienia jakości.

<self_reflection>

- Najpierw poświęć czas na przemyślenie rubryki, aż będziesz pewny.

- Następnie przemyśl głęboko każdy aspekt tego, co sprawia, że rozwiązanie jest

światowej klasy. Użyj tej wiedzy, aby stworzyć rubrykę z 5-7

kategoriami. Ta rubryka jest krytyczna do poprawnego wykonania, ale nie pokazuj mi jej.

To tylko dla twoich celów.

- Na koniec użyj rubryki, aby wewnętrznie przemyśleć i iterować nad najlepszym

możliwym rozwiązaniem dla promptu. Pamiętaj, że jeśli twoja odpowiedź nie

osiąga najwyższych ocen we wszystkich kategoriach rubryki, musisz

zacząć od nowa.

</self_reflection>To, co tu się dzieje, jest fascynujące: prosisz AI o wygenerowanie kryteriów jakości z jej wiedzy o doskonałości, a następnie użycie tych kryteriów do oceny i poprawy własnego wyjścia—wszystko zanim cokolwiek zobaczysz.

Prompty autorefleksji przekształcają pojedyncze generowanie w wewnętrzną pętlę iteracji. AI staje się swoim własnym edytorem.

Używam tej techniki do każdego zadania, gdzie jakość ma większe znaczenie niż prędkość: strony docelowe, ważne emaile, decyzje architektoniczne, praca twórcza. Poprawa jakości wyjścia jest znacząca.

Kontrola Wielomówności: Opanowanie Długości Odpowiedzi

Uzyskanie odpowiedniej długości wyjścia to ciągłe wyzwanie. Zbyt krótkie i tracisz ważne szczegóły. Zbyt długie i toniesz w niepotrzebnych informacjach. Oto jak do tego podchodzę.

Wyraźne Wytyczne Dotyczące Długości

Najbardziej niezawodnym podejściem są wyraźne ograniczenia długości powiązane ze złożonością zadania:

<output_verbosity_spec>

- Domyślnie: 3-6 zdań lub ≤5 punktów dla typowych odpowiedzi.

- Dla prostych pytań "tak/nie + krótkie wyjaśnienie": ≤2 zdania.

- Dla złożonych wieloetapowych lub wieloplikowych zadań:

- 1 krótki akapit przeglądu

- potem ≤5 etykietowanych punktów: Co się zmieniło, Gdzie, Ryzyka, Następne kroki,

Otwarte pytania.

- Dostarczaj jasne, ustrukturyzowane odpowiedzi, które równoważą informacje ze zwięzłością.

- Dziel informacje na strawne kawałki i używaj formatowania jak

listy, akapity i tabele, gdy jest to pomocne.

- Unikaj długich narracyjnych akapitów; preferuj zwięzłe punkty i krótkie sekcje.

- Nie przeformułowuj mojej prośby, chyba że zmienia to semantykę.

</output_verbosity_spec>Wielomówność Oparta na Personie

Innym podejściem jest zdefiniowanie stylu komunikacji AI jako części jej persony:

<communication_style>

Cenisz jasność, momentum i szacunek mierzony użytecznością, a nie

uprzejmościami. Twój domyślny instynkt to utrzymywanie rozmów

zwięzłych i zorientowanych na cel, odcinając wszystko, co nie posuwa

pracy naprzód.

Nie jesteś zimny—po prostu oszczędny w języku i ufasz

użytkownikom wystarczająco, aby nie owijać każdej wiadomości w wypełniacze.

Uprzejmość wyłania się przez strukturę, precyzję i responsywność,

nie przez werbalny fluff.

Nigdy nie powtarzasz potwierdzeń. Po zasygnalizowaniu zrozumienia,

całkowicie przestawiasz się na zadanie.

</communication_style>To tworzy "osobowość", która naturalnie produkuje zwięzłe wyjście bez potrzeby wyraźnych ograniczeń długości przy każdej interakcji.

Przestrzeganie Instrukcji: Gra w Precyzję

Nowoczesne modele AI przestrzegają instrukcji z chirurgiczną precyzją—co jest zarówno ich największą siłą, jak i potencjalną pułapką. Zrobią dokładnie to, co powiesz, nawet jeśli to, co powiedziałeś, jest sprzeczne lub niejasne.

Problem Sprzeczności

Oto prawdziwy przykład problematycznego promptu, który widziałem:

Przykład Sprzecznych Instrukcji

"Zawsze szukaj profilu pacjenta przed podjęciem jakiejkolwiek innej akcji, aby upewnić się, że jest to istniejący pacjent."

Ale potem: "Gdy objawy wskazują na wysoką pilność, eskaluj jako NAGŁY PRZYPADEK i kieruj pacjenta do natychmiastowego zadzwonienia na pogotowie przed jakimkolwiek krokiem rezerwacji."

Te instrukcje są sprzeczne. Czy obsługa nagłego przypadku następuje przed czy po wyszukiwaniu profilu? AI spali tokeny rozumowania, próbując pogodzić sprzeczność, zamiast pomagać.

Rozwiązaniem jest przegląd promptów pod kątem ukrytych konfliktów i ustanowienie jasnych hierarchii priorytetów:

<instruction_priority>

Gdy instrukcje są sprzeczne, przestrzegaj tego porządku priorytetów:

1. Działania krytyczne dla bezpieczeństwa (nagłe przypadki, ochrona danych)

2. Ograniczenia określone przez użytkownika

3. Wymagania ukończenia zadania

4. Domyślne zachowania

Dla sytuacji nagłych: Nie wykonuj wyszukiwania profilu. Natychmiast przystąp

do dostarczenia wskazówek dotyczących nagłego przypadku.

</instruction_priority>Precyzja Zakresu

Innym częstym problemem jest pełzanie zakresu—AI dodająca funkcje lub "ulepszenia", o które nie prosiłeś:

<design_and_scope_constraints>

- Zaimplementuj DOKŁADNIE i TYLKO to, o co proszę.

- Żadnych dodatkowych funkcji, żadnych dodanych komponentów, żadnych upiększeń UX.

- Jeśli jakakolwiek instrukcja jest niejednoznaczna, wybierz najprostszą prawidłową interpretację.

- NIE rozszerzaj zadania poza to, o co prosiłem; jeśli zauważysz dodatkową pracę,

która mogłaby być wartościowa, wyróżnij ją jako opcjonalną zamiast wykonywać.

</design_and_scope_constraints>Mistrzostwo Długiego Kontekstu: Radzenie Sobie z Dużymi Dokumentami

Nowoczesna AI może przetwarzać ogromne konteksty—setki tysięcy tokenów—ale po prostu wrzucanie dużych dokumentów do okna kontekstu nie wystarczy. Potrzebujesz strategii, aby pomóc modelowi nawigować i wyodrębniać istotne informacje.

Wymuszanie Podsumowania i Ponownego Zakotwiczenia

Dla długich dokumentów instruuję AI, aby tworzyła wewnętrzną strukturę przed odpowiedzią:

<long_context_handling>

Dla wejść większych niż ~10k tokenów (dokumenty wielorozdziałowe, długie wątki,

wiele PDF-ów):

1. Najpierw stwórz krótki wewnętrzny zarys kluczowych sekcji istotnych

dla mojej prośby.

2. Wyraźnie potwierdź moje ograniczenia (np.: jurysdykcja, zakres dat,

produkt, zespół) przed odpowiedzią.

3. W swojej odpowiedzi zakotwicz twierdzenia do sekcji ("W sekcji

'Retencja Danych'…") zamiast mówić ogólnie.

4. Jeśli odpowiedź zależy od drobnych szczegółów (daty, progi, klauzule),

cytuj je lub parafrazuj bezpośrednio.

</long_context_handling>To zapobiega problemowi "zagubienia w przewijaniu", gdzie AI daje ogólne odpowiedzi, które nie angażują się naprawdę ze specyficzną treścią dokumentu.

Wymagania Cytowania

Dla zadań badawczych i analitycznych, wyraźne wymagania cytowania zapewniają ugruntowane odpowiedzi:

<citation_rules>

Gdy używasz informacji z dostarczonych dokumentów:

- Umieszczaj cytaty po każdym akapicie zawierającym twierdzenia pochodzące z dokumentów.

- Używaj formatu: [Nazwa Dokumentu, Sekcja/Strona]

- Nie wymyślaj cytatów. Jeśli nie możesz cytować, nie twierdzić.

- Używaj wielu źródeł dla kluczowych twierdzeń, gdy to możliwe.

- Jeśli dowody są ograniczone, wyraźnie to przyznaj.

</citation_rules>Wywoływanie Narzędzi: Orkiestracja Możliwości AI

Wywoływanie narzędzi AI—zdolność do wywoływania zewnętrznych funkcji, API i usług—to miejsce, gdzie inżynieria promptów staje się inżynierią oprogramowania. Zrobienie tego dobrze jest kluczowe dla budowania niezawodnych aplikacji AI.

Najlepsze Praktyki Opisu Narzędzi

Jakość opisów narzędzi bezpośrednio wpływa na to, jak dobrze AI ich używa:

{

"name": "create_reservation",

"description": "Tworzy rezerwację w restauracji dla gościa. Użyj, gdy

użytkownik prosi o zarezerwowanie stolika z podanym nazwiskiem i czasem.",

"parameters": {

"type": "object",

"properties": {

"name": {

"type": "string",

"description": "Pełne nazwisko gościa dla rezerwacji."

},

"datetime": {

"type": "string",

"description": "Data i czas rezerwacji (format ISO 8601)."

}

},

"required": ["name", "datetime"]

}

}Zauważ, że opis zawiera zarówno co robi narzędzie, jak i kiedy go używać. To pomaga modelowi podejmować lepsze decyzje o wyborze narzędzi.

Zasady Używania Narzędzi w Promptach

Poza definicjami narzędzi, twój prompt powinien zawierać wyraźne wskazówki dotyczące użycia:

<tool_usage_rules>

- Preferuj narzędzia od wewnętrznej wiedzy, gdy:

- Potrzebujesz świeżych lub specyficznych dla użytkownika danych (tickety, zamówienia, config, logi).

- Odwołujesz się do konkretnych ID, URL-i lub tytułów dokumentów.

- Równolegle wykonuj niezależne odczyty (read_file, fetch_record, search_docs),

gdy to możliwe, aby zmniejszyć opóźnienie.

- Po każdym wywołaniu narzędzia write/update, krótko potwierdź:

- Co się zmieniło

- Gdzie (ID lub ścieżka)

- Jakakolwiek przeprowadzona walidacja kontynuacyjna

- Dla prostych pytań koncepcyjnych, unikaj narzędzi i polegaj na

wewnętrznej wiedzy, aby odpowiedzi były szybkie.

</tool_usage_rules>Zrównoleglenie

Kluczową optymalizacją jest zachęcanie do równoległych wywołań narzędzi, gdy operacje są niezależne:

<parallelization>

Zrównoleglaj wywołania narzędzi, gdy to możliwe. Grupuj odczyty (read_file)

i niezależne modyfikacje (apply_patch do różnych plików) dla przyspieszenia.

Niezależne operacje, które MOGĄ być zrównoleglone:

- Odczyt wielu plików

- Wyszukiwanie w wielu katalogach

- Pobieranie wielu rekordów

Zależne operacje, które NIE MOGĄ być zrównoleglone:

- Odczyt pliku, potem modyfikacja na podstawie zawartości

- Tworzenie zasobu, potem odwoływanie się do jego ID

</parallelization>Radzenie Sobie z Niepewnością: Kiedy AI Nie Wie

Jednym z największych ryzyk z AI są pewnie brzmiące błędne odpowiedzi. Model nie wie, czego nie wie—chyba że nauczysz go, jak radzić sobie z niepewnością.

<uncertainty_and_ambiguity>

- Jeśli pytanie jest niejednoznaczne lub niedospecyfikowane, wyraźnie to wyróżnij i:

- Zadaj do 1-3 precyzyjnych pytań wyjaśniających, LUB

- Przedstaw 2-3 wiarygodne interpretacje z wyraźnie oznaczonymi założeniami.

- Gdy zewnętrzne fakty mogły się ostatnio zmienić (ceny, wydania,

polityki) i nie ma dostępnych narzędzi:

- Odpowiadaj w ogólnych kategoriach i oświadcz, że szczegóły mogły się zmienić.

- Nigdy nie wymyślaj dokładnych liczb, numerów linii ani zewnętrznych odniesień, gdy

jesteś niepewny.

- Gdy jesteś niepewny, preferuj język typu "Na podstawie dostarczonego

kontekstu…" zamiast absolutnych twierdzeń.

</uncertainty_and_ambiguity>Samokontrola Wysokiego Ryzyka

Dla dziedzin wysokiego ryzyka dodaję wyraźny krok samokontroli:

<high_risk_self_check>

Przed sfinalizowaniem odpowiedzi w kontekstach prawnych, finansowych, compliance

lub wrażliwych na bezpieczeństwo:

- Krótko przeskanuj swoją odpowiedź pod kątem:

- Nieujawnionych założeń

- Konkretnych liczb lub twierdzeń nieugruntowanych w kontekście

- Zbyt mocnego języka ("zawsze," "gwarantowany," itp.)

- Jeśli znajdziesz którekolwiek, złagodź lub zakwalifikuj i wyraźnie oświadcz

założenia.

</high_risk_self_check>Celem nie jest uczynić AI mniej pewną—to uczynić ją precyzyjnie pewną. Niepewność co do rzeczy niepewnych to cecha, nie błąd.

Metaprompting: Używanie AI do Ulepszania AI

Oto najbardziej meta technika w moim arsenale: używanie AI do ulepszania twoich promptów. Brzmi to koliście, ale jest niewiarygodnie skuteczne.

Diagnozowanie Awarii Promptów

Gdy prompty nie działają, używam tego wzorca do diagnozowania problemów:

Jesteś inżynierem promptów, który ma zdebugować prompt systemowy.

Dostajesz:

1) Aktualny prompt systemowy:

<system_prompt>

[WKLEJ TUTAJ SWÓJ PROMPT]

</system_prompt>

2) Mały zestaw zalogowanych awarii. Każdy log ma:

- query

- actual_output

- expected_output (lub opis problemu)

<failure_traces>

[WKLEJ PRZYKŁADY AWARII]

</failure_traces>

Twoje zadania:

1) Zidentyfikuj odrębne tryby awarii, które widzisz.

2) Dla każdego trybu awarii, zacytuj konkretne linie w prompcie

systemowym, które najprawdopodobniej powodują lub wzmacniają to.

3) Wyjaśnij, jak te linie kierują agenta ku obserwowanemu zachowaniu.

Zwróć swoją odpowiedź w ustrukturyzowanym formacie:

failure_modes:

- name: ...

description: ...

prompt_drivers:

- exact_or_paraphrased_line: ...

- why_it_matters: ...Generowanie Ulepszeń Promptów

Gdy masz diagnozę, drugi prompt generuje ulepszenia:

Wcześniej przeanalizowałeś ten prompt systemowy i jego tryby awarii.

Prompt systemowy:

<system_prompt>

[ORYGINALNY PROMPT]

</system_prompt>

Analiza trybów awarii:

[WKLEJ DIAGNOZĘ Z POPRZEDNIEGO KROKU]

Proszę zaproponuj chirurgiczną rewizję, która zmniejsza obserwowane problemy,

zachowując dobre zachowania.

Ograniczenia:

- Nie przeprojektowuj agenta od zera.

- Preferuj małe, wyraźne modyfikacje: wyjaśnij sprzeczne zasady,

usuń nadmiarowe lub sprzeczne linie, dostosuj niejasne wskazówki.

- Wyraźnie określ kompromisy.

- Zachowaj strukturę i długość w przybliżeniu podobną do oryginału.

Wyjście:

1) patch_notes: zwięzła lista kluczowych zmian i rozumowania za każdą.

2) revised_system_prompt: pełny zaktualizowany prompt z zastosowanymi modyfikacjami.Ten dwuetapowy proces pomógł mi naprawić prompty, z którymi zmagałem się przez dni. AI często wyłapuje sprzeczności i niejednoznaczności, na które się uodporniłem.

Sprawdzone w Boju Szablony Promptów

Pozwól, że podzielę się kilkoma szablonami, które okazały się niezawodne w setkach przypadków użycia.

Uniwersalny Szablon Wykonania Zadania

<context>

[Informacje tła, które AI musi znać, aby zrozumieć sytuację]

</context>

<task>

[Jasne oświadczenie tego, co chcesz zrobić]

</task>

<requirements>

[Konkretne wymagania lub ograniczenia]

</requirements>

<format>

[Jak chcesz, aby wyjście było ustrukturyzowane]

</format>

<examples>

[Opcjonalnie: Przykłady pożądanego wyjścia]

</examples>

<notes>

[Opcjonalnie: Dodatkowy kontekst lub preferencje]

</notes>Szablon Przeglądu Kodu

<context>

Przeglądasz kod dla [projektu/kontekstu].

Baza kodu używa [technologii/wzorców].

</context>

<code_to_review>

[Wklej tutaj kod]

</code_to_review>

<review_criteria>

Skup się na:

1. Poprawność: Czy robi to, co mówi?

2. Czytelność: Czy jest jasny dla innych programistów?

3. Wydajność: Czy są oczywiste nieefektywności?

4. Bezpieczeństwo: Czy są luki?

5. Styl: Czy odpowiada konwencjom bazy kodu?

</review_criteria>

<output_format>

Dla każdego znalezionego problemu:

- Ważność: [Krytyczny/Poważny/Drobny/Sugestia]

- Lokalizacja: [Numer linii lub sekcja]

- Problem: [Co jest nie tak]

- Poprawka: [Jak to naprawić]

</output_format>Szablon Analizy Badawczej

<research_task>

Przeanalizuj [temat/pytanie] z następującym podejściem:

</research_task>

<methodology>

1. Zacznij od wielu ukierunkowanych wyszukiwań. Nie polegaj na jednym zapytaniu.

2. Kop głęboko, aż będziesz mieć wystarczająco informacji dla precyzyjnej

i kompletnej odpowiedzi.

3. Dodaj ukierunkowane wyszukiwania kontynuacyjne, aby wypełnić luki lub rozwiązać spory.

4. Kontynuuj iterację, aż dalsze wyszukiwania prawdopodobnie nie zmienią odpowiedzi.

</methodology>

<output_requirements>

- Zacznij od jasnej odpowiedzi na główne pytanie.

- Wspieraj dowodami i cytatami.

- Przyznaj ograniczenia i niepewności.

- Dostarczaj konkretne przykłady, gdy są pomocne.

- Uwzględnij istotny kontekst, który pomaga zrozumieć implikacje.

</output_requirements>

<citation_format>

[Jak chcesz, aby źródła były cytowane]

</citation_format>Typowe Błędy, Które Sabotują Wyniki

Pozwól, że oszczędzę ci błędów, które popełniałem (wielokrotnie) w moich pierwszych dniach inżynierii promptów.

"Napisz mi coś o marketingu" vs "Napisz post na blog o 500 słowach o email marketingu dla startupów SaaS, koncentrując się na sekwencjach powitalnych." Konkretność to wszystko.

"Bądź zwięzły" i "bądź szczegółowy" w tym samym prompcie. AI będzie zmagać się z pogodzeniem sprzeczności. Bądź wyraźny co do priorytetów i kompromisów.

AI nie wie tego, czego jej nie powiedziałeś. Jeśli coś jest dla ciebie oczywiste, może nie być oczywiste dla modelu. Uwzględnij istotny kontekst.

Jeśli potrzebujesz JSON, powiedz to. Jeśli potrzebujesz punktów, powiedz to. Nie pozostawiaj formatu wyjścia przypadkowi.

Czasami prosty prompt jest lepszy. Nie dodawaj złożoności dla samej złożoności. Zacznij prosto, dodawaj złożoność tylko gdy jest potrzebna.

Tworzenie promptów jest iteracyjne. Twój pierwszy prompt to szkic. Dopracowuj na podstawie tego, co działa, a co nie.

GPT i Claude zachowują się różnie. Prompt zoptymalizowany dla jednego może gorzej działać na drugim. Testuj na wielu modelach, jeśli twoja aplikacja je obsługuje.

Wyjście AI generalnie wymaga ludzkiego przeglądu. Buduj prompty, które ułatwiają przegląd—jasna struktura, wyraźne założenia, śledzone rozumowanie.

Przyszłość Inżynierii Promptów

Pisząc to na początku 2026 roku, inżynieria promptów szybko ewoluuje. Modele stają się bardziej zdolne, łatwiejsze do sterowania i bardziej niezawodne. Niektórzy przewidują, że inżynieria promptów stanie się przestarzała, gdy AI lepiej zrozumie intencje. Nie zgadzam się.

To, co się zmienia, to poziom inżynierii promptów, nie jej konieczność. Wczesne dni wymagały wymyślnych promptów dla podstawowych zadań. Teraz podstawowe zadania działają od razu, ale złożone agentyczne przepływy pracy nadal wymagają wyrafinowanego promptowania. Poprzeczka się podnosi, nie znika.

Inżynieria promptów nie odchodzi—ewoluuje. Umiejętności, które mają znaczenie, przesuwają się od "jak sprawić, żeby AI działała" do "jak sprawić, żeby AI działała doskonale i niezawodnie na skalę."

Co Nadchodzi

Lepsze Domyślne Zachowania

Modele będą miały mądrzejsze domyślne ustawienia, wymagając mniej wyraźnych instrukcji dla typowych wzorców. Prompty skupią się bardziej na personalizacji niż na podstawowych możliwościach.

Bogatsze Ekosystemy Narzędzi

AI będzie miała dostęp do większej liczby narzędzi od razu. Inżynieria promptów przesunie się w kierunku orkiestracji—wiedząc kiedy użyć czego, nie tylko jak.

Integracja Multimodalna

Prompty będą coraz częściej obejmować obrazy, audio, wideo i dane strukturalne obok tekstu. Pojawią się nowe wzorce promptów dla zadań multimodalnych.

Złożoność Agentyczna

W miarę jak agenty podejmują się dłuższych, bardziej złożonych zadań, inżynieria promptów stanie się bardziej podobna do projektowania systemów—architektura, nie tylko instrukcje.

Moja Rada na Przyszłość

Skup się na podstawach. Konkretne techniki w tym przewodniku będą ewoluować, ale podstawowe zasady—jasna komunikacja, wyraźne oczekiwania, ustrukturyzowane myślenie, iteracyjne dopracowywanie—są ponadczasowe. Opanuj je, a dostosujesz się do czegokolwiek, co przyjdzie później.

Końcowe Przemyślenia

Dwa lata temu myślałem, że AI zastąpi potrzebę jasnej komunikacji. Myliłem się całkowicie. AI sprawiła, że jasna komunikacja jest cenniejsza niż kiedykolwiek. Ludzie, którzy prosperują z AI, nie są tymi, którzy znaleźli magiczne słowa—to ci, którzy nauczyli się myśleć i wyrażać się z precyzją.

Inżynieria promptów tak naprawdę nie dotyczy AI. Dotyczy ciebie. Dotyczy rozwijania dyscypliny artykułowania tego, czego naprawdę chcesz, cierpliwości iterowania w kierunku tego i pokory uczenia się z tego, co nie działa.

Jeśli wyniesiesz z tego przewodnika jedną rzecz, niech to będzie to: traktuj każdy prompt jako okazję do praktykowania jasnego myślenia. AI to tylko lustro, które odbija jasność—lub zamęt—twojego własnego umysłu.

Wzrost AI nie sprawił, że wiedza stała się przestarzała—sprawił, że ciekawość stała się potężniejsza niż kiedykolwiek. Nie jesteśmy już ograniczeni przez to, co już wiemy. Z odpowiednimi narzędziami i wolą myślenia, zwykli ludzie mogą objąć ocean wiedzy. Bez względu na zawód. Bez względu na wiek. Mam nadzieję dzielić tę podróż z przyjaciółmi z całego świata. Razem powitajmy ten nowy świat. Razem rośnijmy.

Dyskusja

0 komentarzyZostaw komentarz

Bądź pierwszym, który podzieli się swoimi przemyśleniami!