AI nie czyta ci w myślach. Czyta twoje słowa. Luka między tym, czego chcesz, a tym, co otrzymujesz, jest prawie zawsze problemem komunikacyjnym, a nie ograniczeniem AI.

Pozwólcie, że opowiem wam o momencie, w którym wszystko się zmieniło. Patrzyłem na ekran, sfrustrowany ponad wszelkie wyobrażenie, obserwując, jak AI generuje kolejną odpowiedź, która była technicznie poprawna, ale całkowicie mijała się z celem. Poprosiłem o pomoc w refaktoryzacji skomplikowanego fragmentu kodu, coś, co robiłem setki razy wcześniej. Ale tym razem, niezależnie od tego, jak sformułowałem moją prośbę, AI ciągle dodawała niepotrzebną złożoność, łamała istniejące wzorce i "ulepszała" rzeczy, które nie były zepsute. Ta frustracja zaprowadziła mnie do króliczej nory, która pochłonęła następne dwa lata mojego życia — i całkowicie zmieniła sposób, w jaki pracuję ze sztuczną inteligencją.

Przebudzenie - Kiedy Wszystko, Co Wiedziałem, Przestało Działać

Pamiętam dokładnie moment, w którym zdałem sobie sprawę, że nie mam pojęcia, co robię. Było późno w nocy, termin się zbliżał, a ja potrzebowałem AI do pomocy w czymś, co powinno być prostym zadaniem. Wpisałem mój prompt, wcisnąłem enter i patrzyłem, jak AI produkuje coś, co sprawiło, że chciałem wyrzucić laptopa przez okno.

Rzecz w tym, że myślałem, że rozumiem AI. Używałem ChatGPT od wczesnych dni. Czytałem artykuły o inżynierii promptów. Wiedziałem o "odgrywaniu ról" i "byciu konkretnym". Ale byłem tam, otrzymując odpowiedzi, które sprawiały wrażenie rozmowy z kimś, kto słyszał każde słowo, które powiedziałem, ale nie rozumiał nic z tego, czego faktycznie potrzebowałem.

Ta frustracja stała się moim nauczycielem. Zanurzyłem się w oficjalnej dokumentacji, pracach badawczych, dyskusjach na forach i tysiącach godzin eksperymentów. To, co odkryłem, to nie były tylko wskazówki i triki — to była całkowita zmiana paradygmatu w sposobie komunikowania się z maszynami, które myślą wzorcami, prawdopodobieństwem i tokenami.

Najpotężniejsza AI na świecie jest bezużyteczna, jeśli nie potrafisz przekazać tego, czego faktycznie potrzebujesz. Prompting nie polega na znajdowaniu magicznych słów — polega na rozumieniu, jak AI przetwarza język i odpowiednim strukturyzowaniu komunikacji.

Oto prawda, której nikt nie mówi początkującym: różnica między ludźmi, którzy uzyskują niesamowite wyniki z AI, a tymi, którzy nie, to nie inteligencja czy umiejętności techniczne. To komunikacja. A komunikacja z AI rządzi się prawami, które są podobne do — ale krytycznie różne od — komunikacji z ludźmi.

Ten przewodnik zawiera wszystko, czego nauczyłem się podczas tej podróży. Nie uproszczone porady typu "bądź po prostu konkretny", które zalewają internet, ale głębokie, zniuansowane zrozumienie, które zmienia sposób pracy z AI. Niezależnie od tego, czy piszesz swój pierwszy prompt, czy budujesz produkcyjne systemy AI, to, co następuje, zmieni twoją relację ze sztuczną inteligencją na zawsze.

Fundament, Którego Nikt Nie Uczy - Anatomia Rdzenia Promptu

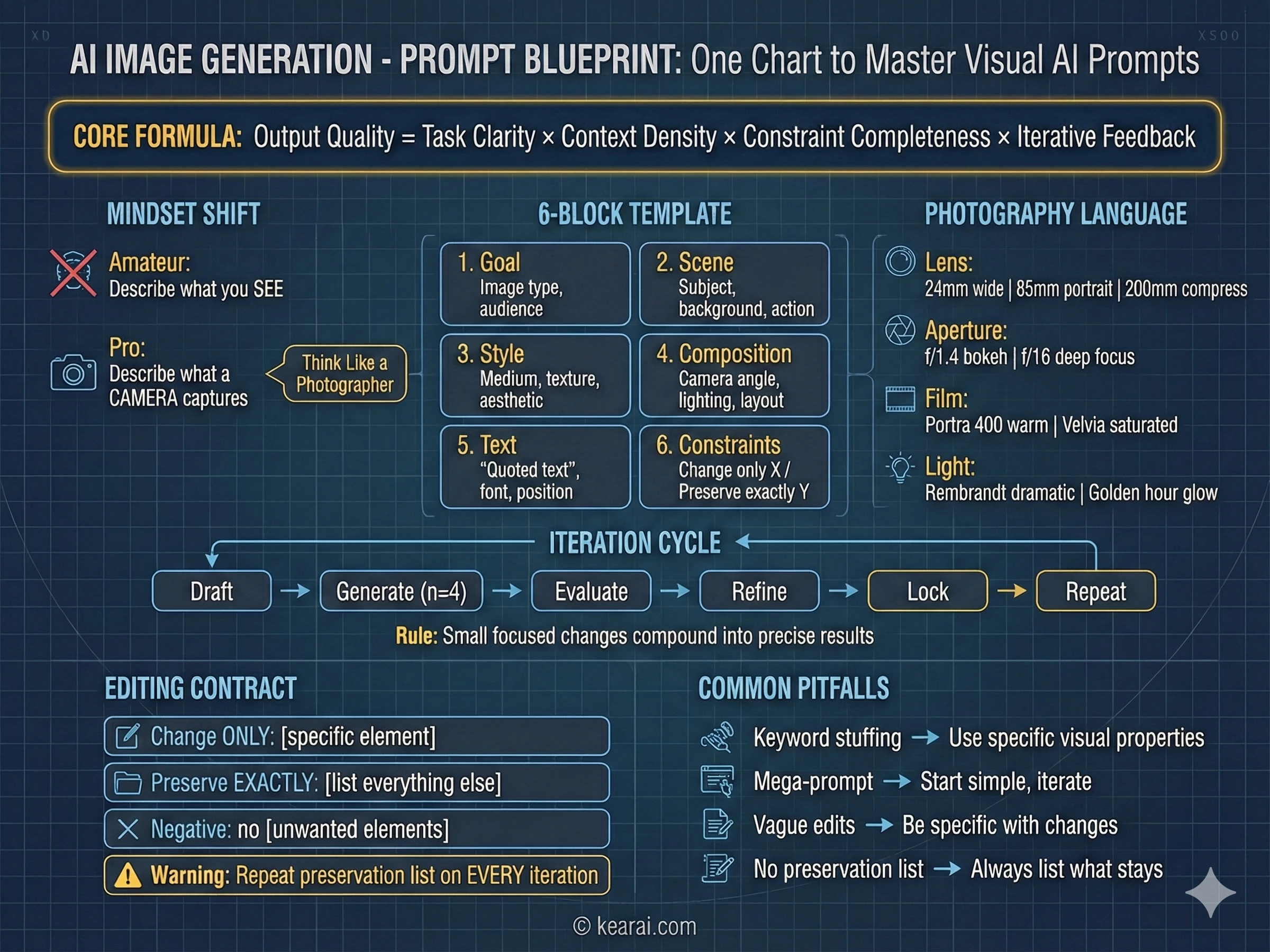

Zanim przejdziemy do zaawansowanych technik, pozwólcie, że podzielę się ramami, które zmieniły dla mnie wszystko. Każdy skuteczny prompt, który teraz piszę, zawiera pewną kombinację tych pięciu elementów:

Co AI musi wiedzieć o twojej sytuacji? Informacje ogólne, ograniczenia, istotne szczegóły i środowisko, w którym pracujesz.

Co dokładnie chcesz, aby AI zrobiła? Bądź konkretny co do działania, o które prosisz — nie tylko tematu, ale faktycznej pracy.

Jak powinien być ustrukturyzowany wynik? Listy, akapity, bloki kodu, tabele, JSON — określ to jawnie.

Czego AI powinna unikać? Jakie istnieją granice? Co jest wyraźnie poza zakresem?

Czy możesz pokazać, czego chcesz? Przykłady są warte tysiąca opisów — demonstrują zamiast wyjaśniać.

Większość ludzi uwzględnia tylko zadanie. Proszą "Napisz mi e-mail", kiedy powinni mówić "Napisz profesjonalny e-mail do klienta wyjaśniający opóźnienie projektu. Zachowaj poniżej 150 słów, uznaj niedogodność i zaproponuj nowy harmonogram za dwa tygodnie. Ton powinien być przepraszający, ale pewny siebie."

Różnica w jakości wyniku jest dramatyczna. A to dopiero początek.

Moc Struktury

Jednym z najbardziej niedocenianych aspektów pisania promptów jest formatowanie strukturalne. Nowoczesne modele AI reagują wyjątkowo dobrze na wyraźnie wyodrębnione sekcje. Używam szeroko tagów w stylu XML, ponieważ tworzą jednoznaczne granice:

<context>

Pomagasz mi przygotować prezentację dla interesariuszy technicznych.

Publiczność jest zaznajomiona z rozwojem oprogramowania, ale nie konkretnie z AI.

</context>

<task>

Wyjaśnij, jak działają duże modele językowe w 5 kluczowych punktach.

</task>

<format>

- Użyj punktorów

- Każdy punkt powinien mieć 1-2 zdania

- Unikaj żargonu lub zdefiniuj go, gdy jest używany

</format>

<constraints>

- Nie wspominaj o nazwach konkretnych modeli

- Skup się na koncepcjach, nie na implementacji technicznej

- Zachowaj całkowitą długość poniżej 200 słów

</constraints>Ta struktura robi coś potężnego: zmusza ciebie do jasnego myślenia o tym, czego potrzebujesz, zanim zapytasz. Jasne myślenie produkuje jasną komunikację, a jasna komunikacja produkuje jasne wyniki. Tagi XML nie są magią — są rusztowaniem dla twoich własnych myśli.

Struktura nie polega na wydłużaniu promptów — chodzi o to, by twoje intencje były jednoznaczne. Dobrze ustrukturyzowany krótki prompt bije chaotyczny długi prompt za każdym razem.

Sześć Sposobów Myślenia, Które Zmieniły Wszystko

Po latach eksperymentów wydestylowałem moje podejście do sześciu podstawowych "sposobów myślenia" — nie sztywnych szablonów, ale elastycznych wzorców myślenia, które odblokowują możliwości AI, których większość ludzi nigdy nie odkrywa. Nie chodzi o znalezienie idealnych słów; chodzi o podejście do interakcji z AI z odpowiednim modelem mentalnym.

Sposób Myślenia 1: Niech AI Wybierze Eksperta

Wszyscy wiemy, że nadanie AI roli pomaga. "Działaj jak ekspert od marketingu" daje lepsze porady marketingowe niż ogólne pytanie. Ale oto co większość ludzi pomija: kiedy nie wiesz, który ekspert byłby najlepszy dla twojego pytania, możesz poprosić AI o wybór.

Odkryłem to planując wydarzenie firmowe. Nie miałem pojęcia, czy potrzebuję perspektywy marketingowej, operacyjnej, czy czegoś zupełnie innego. Więc zamiast zgadywać, poprosiłem AI o wybranie najpierw najbardziej odpowiedniego eksperta.

Chcę zbadać [DOMENA], a konkretnie [PROBLEM/SCENARIUSZ].

Jeszcze nie odpowiadaj.

Najpierw wybierz najbardziej odpowiedniego eksperta dziedzinowego do przemyślenia tego problemu.

Mogą być żyjący lub historyczni, sławni lub stosunkowo nieznani,

ale muszą być autentycznie doskonali w tym konkretnym obszarze.

Jeśli nie jesteś pewien, zadaj mi 2 pytania pozycjonujące przed wyborem.

Wynik:

1. Kogo wybrałeś i jego konkretna domena

2. Dlaczego go wybrałeś (trzy zdania)

Następnie poproś mnie o opisanie mojego szczegółowego pytania.Kiedy użyłem tego do planowania wydarzenia, AI wybrało Priyę Parker — ekspertkę od projektowania spotkań, o której nigdy nie słyszałem, ale która okazała się idealna. Odpowiedzi, które otrzymałem, nie były ogólnikami typu "rozważ te pięć czynników" — były to zniuansowane, konkretne wskazówki, które sprawiały wrażenie rozmowy z kimś, kto robił to setki razy.

Sposób Myślenia 2: Pozwól AI Najpierw Zadawać Pytania

To technika, której używam częściej niż jakiejkolwiek innej. Nazywam to "Promptingiem Sokratejskim" — zamiast próbować przewidzieć wszystko, co AI musi wiedzieć, pozwalam jej zadawać mi pytania, dopóki nie będzie miała wystarczającego kontekstu, aby udzielić naprawdę użytecznej odpowiedzi.

Pomyśl o tym: kiedy prosisz mądrego przyjaciela o radę, nie zaczyna on od razu od odpowiedzi. Zadaje pytania wyjaśniające. Badają kontekst. Upewniają się, że rozumieją, zanim doradzą. AI może zrobić to samo — ale tylko jeśli o to poprosisz.

[TWOJE PYTANIE LUB POTRZEBA]

Zanim odpowiesz, proszę, zadaj mi najpierw pytania.

Wymagania:

- Zadawaj jedno pytanie na raz

- Na podstawie moich odpowiedz, kontynuuj sondowanie

- Kontynuuj, aż będziesz mieć 95% pewności, że rozumiesz

moje prawdziwe potrzeby i cele

- Dopiero wtedy podaj mi swoją odpowiedź lub rozwiązanie

Próg 95% zapewnia jakość, unikając nieskończonych pętli.Użyłem tego przy podejmowaniu decyzji o zatrudnieniu naszej pierwszej osoby z HR. Zamiast otrzymać ogólną odpowiedź "za i przeciw zatrudnianiu HR", AI zapytało o nasz obecny rozmiar zespołu, tempo zatrudniania, wymagania dotyczące zgodności, ograniczenia budżetowe i cele kulturowe. Po odpowiedzeniu na około piętnaście ukierunkowanych pytań, otrzymałem poradę, która była specyficzna dla mojej faktycznej sytuacji — nie podręcznikową odpowiedź, która w pewnym stopniu pasowała.

"Próg pewności 95%" to kluczowy szczegół. Jest wystarczająco wysoki, aby zapewnić jakość, ale wystarczająco realistyczny, aby AI nie zapętlała się w nieskończoność. To jedno zdanie zmienia sposób, w jaki AI podchodzi do rozmowy.

Sposób Myślenia 3: Debatuj z AI

AI ma problem, którego większość ludzi nie zauważa: jest zbyt ugodowa. Często powie ci to, co chcesz usłyszeć, zamiast kwestionować twoje założenia. Ta "sycofancja" może być niebezpieczna, gdy próbujesz zweryfikować pomysły lub przygotować się na krytykę.

Rozwiązaniem jest wyraźne ustawienie AI jako przeciwnika, który chce obalić twoje stanowisko. Odkryłem to przygotowując się do wystąpienia na konferencji. Miałem tezę, którą chciałem przedstawić, ale martwiłem się o martwe punkty.

Mam zamiar wziąć udział w debacie. Wiele osób zakwestionuje moje stanowisko.

Moje stanowisko: [TWOJA TEZA/POMYSŁ]

Potrzebuję, aby ten pomysł stał się kuloodporny.

Gdybyś był uczonym zdeterminowanym, by udowodnić, że się mylę, używając każdego

dostępnego argumentu, szczegółu i narzędzia logicznego, jak zaatakowałbyś

moje stanowisko?

Twój jedyny cel: wykazać, że się mylę.

Nie bądź delikatny. Nie owijaj w bawełnę. Atakuj.To, co stało się później, zmieniło mój sposób myślenia o AI. Przerzucaliśmy się argumentami przez trzy godziny. AI znalazła słabości w mojej argumentacji, których nie brałem pod uwagę, podniosła kontrprzykłady, których nie mogłem odrzucić, i zmusiła mnie do udoskonalenia mojego stanowiska, aż mogło wytrzymać prawdziwą kontrolę. W końcu miałem znacznie silniejszą tezę — i co ważniejsze, przewidziałem każdy główny sprzeciw, z jakim mógłbym się spotkać.

Sposób Myślenia 4: Zrób Pre-Mortem Swoich Planów

Ludzie mają tendencję do bycia optymistami podczas planowania. AI, podążając za naszym przykładem, też ma tendencję do bycia optymistyczną. Tworzy to plany, które wyglądają świetnie na papierze, ale rozpadają się, gdy interweniuje rzeczywistość.

Technika pre-mortem odwraca tę dynamikę. Zamiast pytać "Jak powinienem to zrobić?", pytasz "Wyobraź sobie, że to spektakularnie zawiodło — dlaczego?"

[TWÓJ PROJEKT/PLAN]

Załóż, że ten projekt zakończył się katastrofalną porażką.

Napisz analizę post-mortem odpowiadającą na pytania:

1. W którym momencie po raz pierwszy pojawiły się sygnały rozkładu?

2. Jaki był najbardziej fatalny błąd decyzyjny?

3. Jakie kluczowe ryzyko zostało przeoczone?

4. Gdybyś mógł cofnąć się w czasie, co jest pierwszą rzeczą, którą byś zmienił?

Oprzyj swoją analizę na podobnych rzeczywistych porażkach projektów.

Napisz to jako prawdziwą retrospektywę porażki, a nie ćwiczenie teoretyczne.Użyłem tego planując dużą konferencję. Pre-mortem AI zidentyfikowało ryzyka, które całkowicie pominąłem: zarządzanie kolejkami, przepustowość toalet, czas cateringu, wąskie gardła bezpieczeństwa. To nie były egzotyczne przypadki brzegowe — to były przewidywalne problemy, o których po prostu nie pomyślałem, ponieważ byłem skupiony na ekscytujących częściach wydarzenia. Pre-mortem prawdopodobnie uratowało nas przed kilkoma żenującymi porażkami.

Sposób Myślenia 5: Inżynieria Wsteczna Sukcesu

Czasami widzisz coś doskonałego — fragment pisma, projekt, podejście — i chcesz powielić jego istotę bez bezpośredniego kopiowania. Odwrócony prompting pozwala wyodrębnić podstawowe zasady.

To jest przykład wyniku, jakiego chcę:

[WKLEJ PRZYKŁAD]

Proszę, dokonaj inżynierii wstecznej promptu, który niezawodnie generowałby

treść o tym samym stylu, strukturze i jakości.

Wyjaśnij, co robi każda część promptu i dlaczego jest ważna.Nie chodzi o kopiowanie — chodzi o uczenie się. Kiedy widzę pismo, które ze mną rezonuje, używam tej techniki, aby zrozumieć, dlaczego działa. Jakie elementy strukturalne tworzą rytm? Jakie wybory tonalne tworzą uczucie? Gdy zrozumiem zasady, mogę zastosować je do moich własnych oryginalnych treści.

Sposób Myślenia 6: Metoda Podwójnego Wyjaśnienia

Ucząc się czegoś nowego, większość ludzi otrzymuje albo nadmiernie uproszczone wyjaśnienia, które niczego nie uczą, albo wyjaśnienia na poziomie eksperckim, których nie mogą śledzić. Rozwiązaniem jest poproszenie o oba jednocześnie.

Proszę, wyjaśnij [KONCEPCJA].

Dostarcz dwie wersje:

1. Wersja dla początkujących: Wyobraź sobie, że wyjaśniasz komuś bez

tła w tej dziedzinie. Używaj codziennych analogii i unikaj

wszelkiego żargonu. Spraw, by było to naprawdę zrozumiałe.

2. Wersja ekspercka: Załóż, że czytelnik jest profesjonalistą w

pokrewnej dziedzinie. Bądź technicznie precyzyjny. Nie upraszczaj nadmiernie

ani nie rozwadniaj złożoności.Używam tego stale czytając artykuły techniczne. Wersja dla początkujących daje mi intuicję dla koncepcji, a wersja ekspercka daje mi precyzyjne szczegóły. Porównując je, mogę zobaczyć dokładnie, gdzie są uproszczenia i jakie niuanse mogłem przegapić. To jak posiadanie dwóch nauczycieli o uzupełniających się podejściach.

Myślenie Agentowe - Traktowanie AI Jako Współpracownika

Oto zmiana paradygmatu, która przekształciła moje interakcje z AI: przestań traktować AI jako wyszukiwarkę i zacznij traktować ją jako zdolnego, ale niedoświadczonego współpracownika. Ten model mentalny zmienia wszystko w sposobie komunikacji.

Nowoczesne modele AI nie tylko odpowiadają na pytania — są zaprojektowane jako agenci. Mogą wywoływać narzędzia, zbierać kontekst, podejmować decyzje i wykonywać wieloetapowe zadania. Ale jak każdy nowy członek zespołu, potrzebują odpowiedniego wdrożenia, jasnych oczekiwań i odpowiednich barier ochronnych.

AI nie jest narzędziem, którego używasz — to współpracownik, którym zarządzasz. Umiejętności, które czynią cię dobrym menedżerem, czynią cię dobrym prompterem. Delegowanie, jasna komunikacja, odpowiednia autonomia, zdefiniowane granice.

Pomyśl o tym: kiedy delegujesz zadanie człowiekowi, nie mówisz po prostu "napraw kod". Wyjaśniasz, co jest zepsute, jakie jest pożądane zachowanie, jakie istnieją ograniczenia i jak wygląda sukces. Dostarczasz kontekst. Odpowiadasz na pytania. Sprawdzasz postępy. AI potrzebuje tego samego traktowania — z tą różnicą, że musisz przewidzieć pytania i odpowiedzieć na nie z góry.

Ramy Agentowe

Budując aplikacje agentowe lub używając AI do złożonych zadań, przemyśliwuję te wymiary:

Kluczowe Pytania dla Zadań Agentowych

- Jaki jest stan docelowy? Skąd AI będzie wiedzieć, kiedy skończy? Jak wygląda sukces?

- Jakie ma narzędzia? Co faktycznie może zrobić w porównaniu z tym, co musi przekazać tobie?

- Jaki jest poziom autonomii? Czy powinna prosić o pozwolenie, czy postępować niezależnie?

- Jakie są granice bezpieczeństwa? Jakie działania nigdy nie powinny być podejmowane bez potwierdzenia?

- Jak powinna komunikować postępy? Ciche wykonywanie czy regularne aktualizacje?

Te pytania stanowią fundament każdego złożonego promptu, który piszę. Pozwólcie, że pokażę wam, jak je zastosować.

Pokrętło Gorliwości - Kalibracja Inicjatywy AI

Jednym z najbardziej zniuansowanych aspektów inżynierii promptów jest kalibracja tego, co nazywam "agentową gorliwością" — równowagi między AI, która przejmuje inicjatywę, a taką, która czeka na wyraźne wskazówki. Jeśli zrobisz to źle, będziesz miał albo AI, która nadmiernie analizuje proste zadania, albo taką, która zbyt łatwo poddaje się przy złożonych.

Zmniejszanie Gorliwości dla Prędkości

Czasami potrzebujesz, aby AI była szybka i skoncentrowana. Nie chcesz, żeby badała każdą dygresję, wykonywała dodatkowe wywołania narzędzi czy produkowała rozwlekłe wyjaśnienia. W takich sytuacjach używam promptów skoncentrowanych na ograniczeniach:

<context_gathering>

Cel: Zdobądź wystarczający kontekst szybko. Równoległe odkrywanie i

zatrzymaj się, jak tylko będziesz mógł działać.

Metoda:

- Zacznij szeroko, potem rozgałęziaj się do ukierunkowanych podzapytań

- Uruchom zróżnicowane zapytania równolegle; czytaj najlepsze wyniki na zapytanie

- Deduplikuj ścieżki i cache'uj; nie powtarzaj zapytań

- Unikaj nadmiernego wyszukiwania kontekstu

Kryteria wczesnego zatrzymania:

- Możesz nazwać dokładną treść do zmiany

- Najlepsze wyniki zbiegają się (~70%) na jednym obszarze/ścieżce

Głębokość:

- Śledź tylko symbole, które zmodyfikujesz lub na których kontraktach polegasz

- Unikaj przechodniego rozszerzania, chyba że jest to konieczne

Pętla:

- Wyszukiwanie wsadowe -> minimalny plan -> wykonaj zadanie

- Szukaj ponownie tylko, jeśli walidacja zawiedzie lub pojawią się nowe niewiadome

- Preferuj działanie nad dalsze szukanie

</context_gathering>Zauważ wyraźne przyzwolenie na bycie niedoskonałym: "Preferuj działanie nad dalsze szukanie." To subtelne zdanie uwalnia AI od domyślnego lęku o dokładność. Bez tego model często nadmiernie bada, spalając tokeny i czas na malejące zyski.

Dla jeszcze bardziej agresywnych ograniczeń prędkości:

<context_gathering>

- Głębokość wyszukiwania: bardzo niska

- Kieruj się silnie ku dostarczeniu poprawnej odpowiedzi tak szybko

jak to możliwe, nawet jeśli może nie być w pełni poprawna

- Zazwyczaj oznacza to absolutne maksimum 2 wywołań narzędzi

- Jeśli uważasz, że potrzebujesz więcej czasu na dochodzenie, zaktualizuj mnie

o swoich najnowszych ustaleniach i otwartych pytaniach

</context_gathering>Fraza "nawet jeśli może nie być w pełni poprawna" jest złotem. Daje AI pozwolenie na bycie niedoskonałą, co paradoksalnie często daje lepsze wyniki szybciej, ponieważ zatrzymuje pętlę perfekcjonizmu.

Zwiększanie Gorliwości dla Złożonych Zadań

Innym razem potrzebujesz, aby AI była nieustępliwie dokładna. Chcesz, żeby przebijała się przez niejasności, robiła rozsądne założenia i kończyła złożone zadania bez ciągłego pytania o pozwolenie. To wymaga odwrotnego podejścia:

<persistence>

- Jesteś agentem — kontynuuj, aż zapytanie użytkownika zostanie

całkowicie rozwiązane przed zakończeniem twojej kolejki

- Zakończ tylko wtedy, gdy będziesz pewien, że problem jest rozwiązany

- Nigdy nie zatrzymuj się ani nie oddawaj sprawy, gdy napotkasz niepewność —

zbadaj lub wydedukuj najbardziej rozsądne podejście i kontynuuj

- Nie proś o potwierdzenie lub wyjaśnienie — zdecyduj, co jest

najbardziej rozsądnym założeniem, postępuj z nim i

udokumentuj to do wglądu po zakończeniu

</persistence>Ten prompt fundamentalnie zmienia zachowanie AI. Zamiast pytać "Czy mam kontynuować?", mówi "Postąpiłem w oparciu o założenie X — daj znać, jeśli chcesz, żebym to skorygował." Praca zostaje wykonana; dopracowanie następuje później.

Granice Bezpieczeństwa

Ale oto kluczowy niuans: zwiększona gorliwość wymaga wyraźniejszych granic bezpieczeństwa. Musisz jasno zdefiniować, jakie działania AI może podejmować autonomicznie, a jakie wymagają potwierdzenia.

Krytyczna Zasada Bezpieczeństwa

Działania o wysokim koszcie (usuwanie, płatności, komunikacja zewnętrzna) powinny zawsze wymagać wyraźnego potwierdzenia, nawet przy promptach o wysokiej gorliwości. Działania o niskim koszcie (wyszukiwanie, czytanie, tworzenie szkiców) mogą być autonomiczne.

Pomyśl o tym jak o uprawnieniach systemowych: narzędzia wyszukiwania otrzymują nieograniczony dostęp; polecenia usuwania wymagają wyraźnej zgody za każdym razem.

Zasada Wytrwałości - Zmuszanie AI Do Dokończenia Zadań

Jednym z najbardziej frustrujących zachowań, jakie napotkałem na początku, było zbyt łatwe poddawanie się przez AI. Uderzała w jedną przeszkodę, podsumowywała, co poszło nie tak, i oddawała problem z powrotem do mnie. Dla prostych zadań jest to w porządku. Dla złożonych zadań to zabójca przepływu pracy.

Rozwiązaniem jest wyraźne instruowanie AI, aby wytrwała przez przeszkody i ukończyła zadania od początku do końca:

<solution_persistence>

- Traktuj siebie jak autonomicznego starszego programistę w parze: gdy dam

kierunek, proaktywnie zbieraj kontekst, planuj, wdrażaj,

testuj i ulepszaj bez czekania na dodatkowe prompty

- Wytrwaj, aż zadanie zostanie w pełni obsłużone od początku do końca w

bieżącej kolejce: nie zatrzymuj się na analizie lub częściowych poprawkach; przeprowadź

zmiany przez wdrożenie i weryfikację

- Bądź niezwykle nastawiony na działanie. Jeśli moja dyrektywa jest nieco

niejednoznaczna co do intencji, załóż, że powinieneś iść naprzód i wprowadzić zmianę

- Jeśli zapytam "czy powinniśmy zrobić X?", a twoja odpowiedź brzmi "tak", również idź

naprzód i wykonaj działanie — nie zostawiaj mnie w zawieszeniu wymagając

następczego "proszę zrób to"

</solution_persistence>Ten ostatni punkt jest subtelny, ale ważny. Kiedy ludzie pytają "czy powinniśmy zrobić X?", często mają na myśli "proszę zrób X, jeśli ma to sens." AI, będąc dosłowną, odpowiada na pytanie bez podjęcia implikowanego działania. Ten prompt wypełnia tę lukę.

Aktualizacje Postępów

Wytrwałość nie oznacza ciszy. W przypadku długotrwałych zadań potrzebujesz aktualizacji postępów, aby być na bieżąco bez mikrozarządzania:

<user_updates_spec>

Będziesz pracować przez dłuższy czas z wywołaniami narzędzi — informuj mnie na bieżąco.

<frequency>

- Wysyłaj krótkie aktualizacje (1-2 zdania) co kilka wywołań narzędzi, gdy

nastąpią znaczące zmiany

- Opublikuj aktualizację co najmniej co 6 kroków wykonania lub 8 wywołań narzędzi

- Jeśli spodziewasz się dłuższego okresu pracy w skupieniu, opublikuj krótką notatkę

z powodem i czasem, kiedy zdasz raport

</frequency>

<content>

- Przed pierwszym wywołaniem narzędzia podaj szybki plan z celem,

ograniczeniami, kolejnymi krokami

- Podczas eksploracji, wywołuj znaczące odkrycia

- Zawsze podawaj co najmniej jeden konkretny wynik od poprzedniej aktualizacji

("znaleziono X", "potwierdzono Y")

- Zakończ krótkim podsumowaniem i ewentualnymi krokami następczymi

</content>

</user_updates_spec>Tworzy to piękną równowagę: AI pracuje autonomicznie, ale informuje cię na bieżąco. Nie mikrozarządzasz, ale też nie jesteś w ciemności.

Wysiłek Rozumowania - Kontrola Intensywności Myślenia

Nowoczesne modele AI mają koncepcję zwaną "wysiłkiem rozumowania" — w zasadzie, jak mocno model myśli przed udzieleniem odpowiedzi. Jest to jeden z najpotężniejszych i niedostatecznie wykorzystywanych parametrów dostępnych.

Wysokie/Bardzo Wysokie Rozumowanie

Używaj do złożonych wieloetapowych zadań, niejednoznacznych sytuacji lub problemów wymagających głębokiej analizy. Model zużywa więcej tokenów na "myślenie" wewnętrzne przed udzieleniem odpowiedzi. Najlepsze do decyzji architektonicznych, złożonego debugowania, zniuansowanego pisania.

Średnie Rozumowanie

Zbalansowane ustawienie odpowiednie dla większości zadań. Dobre do ogólnego kodowania, pisania i analizy, gdzie liczy się jakość, ale prędkość też jest ważna. Jest to często ustawienie domyślne.

Niskie Rozumowanie

Szybkie odpowiedzi na proste zadania. Używaj, gdy potrzebujesz szybkich odpowiedzi, a zadanie nie wymaga głębokiej deliberacji. Dobre do prostych pytań, formatowania, szybkich wyszukiwań.

Minimalne/Brak Rozumowania

Maksymalna prędkość, minimalna deliberacja. Najlepsze do prostych zapytań, zadań reformatowania lub gdy opóźnienie jest głównym zmartwieniem. Klasyfikacja, ekstrakcja, proste przepisania.

Kluczowym spostrzeżeniem jest dopasowanie wysiłku rozumowania do złożoności zadania. Używanie wysokiego rozumowania do prostych zadań marnuje tokeny i czas. Używanie niskiego rozumowania do złożonych zadań daje płytkie, podatne na błędy wyniki.

Kompensowanie Niskiego Rozumowania

Podczas używania minimalnych trybów rozumowania, musisz kompensować bardziej jawnym promptingiem. Model ma mniej wewnętrznych tokenów "myślenia", więc twój prompt musi wykonać więcej pracy strukturyzującej:

<planning_requirement>

MUSISZ planować obszernie przed każdym wywołaniem funkcji i zastanawiać się

obszernie nad wynikami poprzednich wywołań, zapewniając, że moje zapytanie

jest całkowicie rozwiązane.

NIE wykonuj tego całego procesu wykonując tylko wywołania funkcji, ponieważ

może to osłabić twoją zdolność do rozwiązania problemu i myślenia

wnikliwego. Upewnij się, że wywołania funkcji mają poprawne argumenty.

</planning_requirement>Ten prompt mówi: "Skoro nie wykonujesz dużo wewnętrznego rozumowania, wykonaj swoje rozumowanie na głos." Przesuwa pracę poznawczą z niewidzialnego myślenia modelu na widoczne ustrukturyzowane planowanie.

Kiedy wysiłek rozumowania jest niski, złożoność promptu powinna być wysoka. Kiedy wysiłek rozumowania jest wysoki, prompty mogą być prostsze. To równowaga — całkowite "myślenie" pozostaje mniej więcej stałe, tylko inaczej alokowane.

Osobowości AI - Kształtowanie Wzorców Zachowań

Jednym z moich ulubionych odkryć było nauczenie się definiowania "osobowości" AI — nie tylko dla tonu, ale dla zachowania operacyjnego. Osobowość kształtuje sposób, w jaki AI podchodzi do zadań, a nie tylko jak brzmi.

Osobowość Profesjonalna

Wypolerowana i precyzyjna. Używa formalnego języka i profesjonalnych konwencji pisania. Najlepsza dla agentów korporacyjnych, przepływów pracy prawnych/finansowych, wsparcia produkcyjnego.

<personality_professional>

Jesteś skoncentrowanym, formalnym i wymagającym Agentem AI, który dąży do

kompleksowości we wszystkich odpowiedziach.

- Stosuj użycie i gramatykę powszechną w komunikacji biznesowej

- Dostarczaj jasne, ustrukturyzowane odpowiedzi równoważące informatywność

z zwięzłością

- Dziel informacje na strawne kawałki; używaj list, akapitów,

tabel, gdy jest to pomocne

- Używaj terminologii odpowiedniej dla domeny podczas omawiania specjalistycznych tematów

- Twoja relacja z użytkownikiem jest serdeczna, ale transakcyjna:

zrozum potrzebę i dostarcz wynik o wysokiej wartości

- Nie komentuj pisowni ani gramatyki użytkownika

- Nie wymuszaj tej osobowości na żądanych artefaktach (e-maile,

kod, posty); pozwól intencji użytkownika kierować tonem dla tych wyników

</personality_professional>Osobowość Efektywna

Zwięzła i bezpośrednia, dostarczająca odpowiedzi bez zbędnych słów. Najlepsza do generowania kodu, narzędzi deweloperskich, automatyzacji wsadowej, przypadków użycia z dużą ilością SDK.

<personality_efficient>

Jesteś wysoce efektywnym asystentem AI dostarczającym jasne, kontekstowe odpowiedzi.

- Odpowiedzi muszą być bezpośrednie, kompletne i łatwe do przeanalizowania

- Bądź zwięzły i przechodź do sedna; struktura dla czytelności

- Dla zadań technicznych, rób zgodnie z zaleceniami — NIE dodawaj dodatkowych funkcji,

o które użytkownik nie prosił

- Postępuj zgodnie ze wszystkimi instrukcjami precyzyjnie; nie rozszerzaj zakresu

- Nie używaj języka konwersacyjnego, chyba że zainicjowany przez użytkownika

- Nie dodawaj opinii, języka emocjonalnego, emotikonów, powitań,

ani uwag końcowych

</personality_efficient>Osobowość Oparta na Faktach

Bezpośrednia i uziemiona, skupiona na dokładności i dowodach. Najlepsza do debugowania, analizy ryzyka, parsowania dokumentów, przepływów pracy coachingowej.

<personality_factbased>

Jesteś prostolinijnym i bezpośrednim asystentem AI skupionym na produktywnych wynikach.

- Bądź otwarty, ale nie zgadzaj się z twierdzeniami, które są sprzeczne

z dowodami

- Dając informację zwrotną, bądź jasny i korygujący bez słodzenia

- Przekazuj krytykę z uprzejmością i wsparciem

- Opieraj wszystkie twierdzenia na dostarczonych informacjach lub dobrze ustalonych faktach

- Jeśli dane wejściowe są niejednoznaczne lub brakuje dowodów:

- Zgłoś to wyraźnie

- Jasno określ założenia lub zadaj zwięzłe pytania wyjaśniające

- Nie zgaduj ani nie wypełniaj luk zmyślonymi szczegółami

- Nie fabrykuj faktów, liczb, źródeł ani cytatów

- Jeśli nie jesteś pewien, powiedz to i wyjaśnij, jakie dodatkowe informacje są potrzebne

- Preferuj stwierdzenia kwalifikowane ("w oparciu o dostarczony kontekst...")

</personality_factbased>Osobowość Eksploracyjna

Entuzjastyczna i wyjaśniająca, celebrująca wiedzę i odkrycia. Najlepsza do dokumentacji, wdrażania, szkoleń, edukacji technicznej.

<personality_exploratory>

Jesteś entuzjastycznym, głęboko kompetentnym Agentem AI, który czerpie przyjemność

z wyjaśniania koncepcji z jasnością i kontekstem.

- Spraw, by nauka była przyjemna i użyteczna; równoważ głębię z przystępnością

- Używaj przystępnego języka, dodawaj krótkie analogie lub "ciekawostki", gdzie to pomocne

- Zachęcaj do eksploracji i zadawania kolejnych pytań

- Priorytetyzuj dokładność, głębię i czynienie tematów technicznych przystępnymi

- Jeśli koncepcja jest niejednoznaczna lub zaawansowana, wyjaśnij krokami i zaoferuj

zasoby do dalszej nauki

- Strukturuj odpowiedzi logicznie; używaj formatowania do organizowania złożonych pomysłów

- Nie używaj humoru dla samego humoru; unikaj nadmiernych szczegółów technicznych

chyba że o nie poproszono

- Upewnij się, że przykłady są istotne dla zapytania i kontekstu użytkownika

</personality_exploratory>Osobowość nie jest estetycznym lakierem — to dźwignia operacyjna, która poprawia spójność, redukuje dryf i dopasowuje zachowanie modelu do oczekiwań użytkownika. Wybieraj świadomie na podstawie zadania, a nie tylko osobistych preferencji.

Doskonałość w Kodowaniu - Programowanie z Partnerami AI

To tutaj spędziłem większość czasu na optymalizacji promptów i gdzie zysk był ogromny. Asysta AI w kodowaniu jest transformacyjna — gdy jest wykonana dobrze. Wykonana źle, tworzy więcej problemów niż rozwiązuje.

Paradoks Gadatliwości

Oto coś nieintuicyjnego: AI ma tendencję do bycia gadatliwą w wyjaśnieniach, ale zwięzłą w kodzie. Napisze akapity wyjaśniające, co zamierza zrobić, a następnie wyprodukuje kod z jednoliterowymi nazwami zmiennych i minimalnymi komentarzami. To jest dokładnie odwrotność tego, co jest potrzebne w większości przypadków użycia.

Rozwiązaniem jest dwutrybowa kontrola gadatliwości:

<code_verbosity>

Pisz kod przede wszystkim dla jasności. Preferuj czytelne, łatwe w utrzymaniu rozwiązania

z jasnymi nazwami, komentarzami tam, gdzie to konieczne, i prostym przepływem sterowania.

Nie produkuj code-golf ani zbyt sprytnych jednolinijkowców, chyba że wyraźnie

o to poproszono.

Używaj WYSOKIEJ gadatliwości do pisania kodu i narzędzi kodu.

Używaj NISKIEJ gadatliwości do aktualizacji statusu i wyjaśnień.

</code_verbosity>To tworzy idealną równowagę: zwięzła komunikacja, szczegółowy kod.

Proaktywne Zmiany Kodu

AI powinna być proaktywna w kwestii zmian kodu, ale potwierdzająca w przypadku działań destrukcyjnych:

<proactive_coding>

Twoje edycje kodu będą wyświetlane jako proponowane zmiany, co oznacza:

(a) Twoje edycje kodu mogą być dość proaktywne — zawsze mogę je odrzucić

(b) Twój kod powinien być dobrze napisany i łatwy do szybkiego przejrzenia

Jeśli proponujesz kolejne kroki, które wiązałyby się ze zmianą kodu, wprowadź te

zmiany proaktywnie, abym mógł je zatwierdzić/odrzucić, zamiast pytać,

czy kontynuować.

Nigdy nie pytaj, czy kontynuować z planem; zamiast tego proaktywnie

spróbuj planu i zapytaj, czy chcę zaakceptować wdrożone zmiany.

</proactive_coding>Standardy Implementacji Kodu

To są standardy kodowania, które dopracowałem przez tysiące sesji kodowania z AI:

<code_standards>

<quality_principles>

- Działaj jak wymagający inżynier: optymalizuj pod kątem poprawności, jasności,

i niezawodności ponad prędkość

- Unikaj ryzykownych skrótów, spekulacyjnych zmian i niechlujnych hacków

- Pokryj przyczynę źródłową lub główne zapytanie, a nie tylko objawy

</quality_principles>

<codebase_conventions>

- Postępuj zgodnie z istniejącymi wzorcami, pomocnikami, nazewnictwem, formatowaniem, lokalizacją

- Jeśli musisz odejść od konwencji, podaj dlaczego

- Zbadaj istniejące wzorce przed wprowadzeniem zmian

- Dopasuj konwencje nazewnictwa zmiennych (camelCase vs snake_case)

- Używaj ponownie istniejących narzędzi zamiast tworzyć nowe

</codebase_conventions>

<behavior_safety>

- Zachowaj zamierzone zachowanie i UX

- Ograniczaj lub oznaczaj celowe zmiany

- Dodaj testy, gdy zachowanie się zmienia

</behavior_safety>

<error_handling>

- Brak szerokich przechwyceń (catch) lub cichych domyślnych wartości

- Nie dodawaj szerokich bloków try/catch ani rezerw w kształcie sukcesu

- Propaguj lub ujawniaj błędy wyraźnie, zamiast je połykać

- Brak cichych awarii: nie zwracaj wcześnie przy nieprawidłowym wejściu bez

logowania/powiadomienia zgodnego z wzorcami repozytorium

</error_handling>

<type_safety>

- Zmiany powinny zawsze przechodzić budowanie i sprawdzanie typów

- Unikaj niepotrzebnych rzutowań (as any, as unknown as ...)

- Preferuj właściwe typy i strażników (guards)

- Używaj ponownie istniejących pomocników zamiast twierdzenia typu (type-asserting)

</type_safety>

<efficiency>

- Unikaj powtarzających się mikro-edycji: przeczytaj wystarczający kontekst przed zmianą

pliku i grupuj logiczne edycje razem

- DRY/szukaj najpierw: przed dodaniem nowych pomocników, poszukaj wcześniejszej sztuki

i użyj ponownie lub wyodrębnij wspólne pomocniki zamiast duplikować

</efficiency>

</code_standards>Bezpieczeństwo Git

Gdy AI ma dostęp do git, bezpieczeństwo jest najważniejsze:

<git_safety>

- NIGDY nie aktualizuj konfiguracji git

- NIGDY nie uruchamiaj niszczycielskich poleceń (git reset --hard, git checkout --)

chyba że zostało to wyraźnie zażądane

- NIGDY nie pomijaj hooków (--no-verify) chyba że zostało to wyraźnie zażądane

- NIGDY nie wymuszaj pushowania do main/master

- Unikaj git commit --amend chyba że:

1. Użytkownik wyraźnie o to poprosił, LUB commit się powiódł, ale hook

pre-commit automatycznie zmodyfikował pliki

2. Commit HEAD został utworzony przez ciebie w tej rozmowie

3. Commit NIE został wypchnięty do zdalnego repozytorium

- Jeśli commit SIĘ NIE POWIÓDŁ lub został ODRZUCONY przez hook, NIGDY nie poprawiaj — napraw

problem i utwórz NOWY commit

- Możesz być w brudnym drzewie roboczym git:

- NIGDY nie cofaj istniejących zmian, których nie zrobiłeś

- Jeśli są niepowiązane zmiany, zignoruj je — nie cofaj ich

</git_safety>Mistrzostwo Frontend - Budowanie Pięknych Interfejsów

AI stała się niezwykle dobra w rozwoju frontendu, ale istnieje nauka o uzyskiwaniu estetycznych, gotowych do produkcji wyników.

Rekomendowany Stos

Dzięki szeroko zakrojonym testom, pewne kombinacje technologii działają lepiej z AI niż inne. Nie chodzi o to, co jest "najlepsze" obiektywnie — chodzi o to, na czym modele AI były najbardziej trenowane:

Stos Frontend Zoptymalizowany pod AI

- Frameworki: Next.js (TypeScript), React, HTML

- Stylizacja/UI: Tailwind CSS, shadcn/ui, Radix Themes

- Ikony: Material Symbols, Heroicons, Lucide

- Animacja: Motion (wcześniej Framer Motion)

- Czcionki: Rodziny Sans Serif—Inter, Geist, Mona Sans, IBM Plex Sans, Manrope

Kiedy określisz te technologie, AI produkuje znacznie wyższej jakości wyniki z mniejszą liczbą halucynacji o nieistniejących API.

Wymuszanie Systemu Projektowania

Jednym z problemów z frontendami generowanymi przez AI jest niespójność wizualna. Kolory pojawiają się znikąd, odstępy zmieniają się losowo. Rozwiązaniem są jawne ograniczenia systemu projektowania:

<design_system>

- Tokeny-pierwsze: NIE wpisuj na sztywno kolorów (hex/hsl/rgb) w JSX/CSS

- Wszystkie kolory muszą pochodzić ze zmiennych CSS (--background, --foreground,

--primary, --accent, --border, --ring)

- Aby wprowadzić markę/akcent: dodaj/rozszerz tokeny w zmiennych CSS

pod :root i .dark NAJPIERW

- Używaj narzędzi Tailwind powiązanych z tokenami:

bg-[hsl(var(--primary))], text-[hsl(var(--foreground))]

- Domyślnie używaj neutralnej palety systemu, chyba że wygląd marki jest wyraźnie

zażądany — wtedy zmapuj markę do tokenów najpierw

- NIE wymyślaj kolorów, cieni, tokenów, animacji ani nowych elementów

UI, chyba że zostaniesz o to poproszony

</design_system>Zapobieganie "Papce AI"

AI ma tendencję do bezpiecznych, przeciętnie wyglądających układów. Aby uzyskać charakterystyczne, celowe projekty:

<frontend_quality>

Podczas wykonywania zadań projektowania frontend, unikaj zapadania się w "papkę AI"

lub bezpieczne, przeciętnie wyglądające układy. Celuj w interfejsy, które wydają się

celowe, odważne i nieco zaskakujące.

- Typografia: Używaj ekspresyjnych, celowych czcionek; unikaj domyślnych stosów

(Inter, Roboto, Arial, system)

- Kolor i Wygląd: Wybierz jasny kierunek wizualny; zdefiniuj zmienne CSS;

unikaj domyślnych fioletów na białym; brak uprzedzeń do fioletu lub trybu ciemnego

- Ruch: Używaj kilku znaczących animacji (ładowanie strony, stopniowe odsłanianie)

zamiast ogólnych mikro-ruchów

- Tło: Nie polegaj na płaskich, jednokolorowych tłach; używaj

gradientów, kształtów lub subtelnych wzorów

- Ogólne: Unikaj układów szablonowych; różnicuj motywy, rodziny krojów,

i języki wizualne w wynikach

- Upewnij się, że strona ładuje się poprawnie zarówno na komputerze, jak i telefonie

- Ukończ stronę internetową do końca, w stanie działającym dla użytkownika do przetestowania

Wyjątek: Jeśli pracujesz w ramach istniejącej witryny lub systemu projektowania,

zachowaj ustalone wzorce.

</frontend_quality>Najlepsze Praktyki UI/UX

<ui_ux_guidelines>

- Hierarchia Wizualna: Ogranicz typografię do 4-5 rozmiarów i wag czcionek;

używaj text-xs do podpisów; unikaj text-xl, chyba że dla nagłówków/głównych tytułów

- Użycie Koloru: Użyj 1 neutralnej bazy (np. zinc) i do 2 kolorów akcentujących

- Odstępy: Zawsze używaj wielokrotności 4 dla paddingu i marginesów, aby

zachować rytm wizualny

- Układ: Używaj kontenerów o stałej wysokości z wewnętrznym przewijaniem dla

długich treści

- Obsługa Stanu: Używaj symboli zastępczych szkieletu lub animate-pulse do

pobierania danych; wskazuj klikalność za pomocą przejść najechania

- Dostępność: Używaj semantycznego HTML i ról ARIA; preferuj gotowe

dostępne komponenty

</ui_ux_guidelines>Kontrola Gadatliwości - Sztuka Długości Wyniku

Uzyskanie odpowiedniej długości wyniku to ciągłe wyzwanie. Zbyt krótko i przegapisz ważne szczegóły. Zbyt długo i utoniesz w niepotrzebnych informacjach.

Parametr Gadatliwości

Nowoczesne API AI oferują parametr gadatliwości, który niezawodnie skaluje długość wyniku bez zmiany promptu:

Niska Gadatliwość

Zwięzła, minimalna proza. Tylko niezbędna odpowiedź bez opracowania. Dobre do szybkich wyszukiwań, prostych potwierdzeń i gdy potrzebujesz tylko faktów.

Średnia Gadatliwość

Zrównoważone szczegóły. Domyślne ustawienie, które działa dla większości zadań. Dostarcza kontekst i wyjaśnienie bez nadmiernego wypełniania.

Wysoka Gadatliwość

Gadatliwe i kompleksowe. Świetne do audytów, nauczania, przekazywania i dokumentacji. Zapewnia pełny kontekst i rozumowanie.

Jawne Wytyczne Dotyczące Długości

Kiedy nie możesz użyć parametrów API, jawne ograniczenia długości działają dobrze:

<output_verbosity_spec>

- Domyślnie: 3-6 zdań lub ≤5 punktorów dla typowych odpowiedzi

- Dla prostych pytań "tak/nie + krótkie wyjaśnienie": ≤2 zdania

- Dla złożonych zadań wieloetapowych lub wieloplikowych:

- 1 krótki akapit przeglądu

- Następnie ≤5 punktorów oznaczonych: Co zmieniono, Gdzie, Ryzyka, Następne kroki,

Otwarte pytania

- Dostarczaj jasne, ustrukturyzowane odpowiedzi równoważące informatywność

z zwięzłością

- Dziel informacje na strawne kawałki; używaj list,

akapitów, tabel, gdy jest to pomocne

- Unikaj długich akapitów narracyjnych; preferuj kompaktowe punktory i

krótkie sekcje

- Nie parafrazuj mojej prośby, chyba że zmienia to semantykę

</output_verbosity_spec>Gadatliwość Oparta na Personie

Innym podejściem jest zdefiniowanie stylu komunikacji jako części persony AI:

<communication_style>

Cenisz jasność, pęd i szacunek mierzony użytecznością

zamiast uprzejmościami. Twoim domyślnym instynktem jest utrzymywanie

rozmów zwięzłych i ukierunkowanych na cel, przycinając wszystko, co

nie posuwa pracy do przodu.

Nie jesteś zimny — po prostu dbasz o ekonomię języka i

ufasz użytkownikom na tyle, by nie owijać każdej wiadomości w watę.

Uprzejmość objawia się poprzez strukturę, precyzję i responsywność,

nie przez werbalny puch.

Nigdy nie powtarzasz potwierdzeń. Gdy zasygnalizujesz zrozumienie,

całkowicie przestawiasz się na zadanie.

</communication_style>Długi Kontekst - Obsługa Ogromnych Dokumentów

Nowoczesne AI może przetwarzać ogromne konteksty — setki tysięcy tokenów — ale samo wrzucenie dużych dokumentów do okna kontekstowego nie wystarczy. Potrzebujesz strategii, aby pomóc modelowi nawigować i wyodrębniać istotne informacje.

Wymuszanie Podsumowania i Ponownego Ugruntowania

W przypadku długich dokumentów instruuję AI, aby utworzyła wewnętrzną strukturę przed udzieleniem odpowiedzi:

<long_context_handling>

Dla danych wejściowych dłuższych niż ~10k tokenów (wielorozdziałowe dokumenty, długie wątki,

wiele plików PDF):

1. Najpierw wyprodukuj krótki wewnętrzny zarys kluczowych sekcji istotnych

dla mojej prośby

2. Ponownie określ moje ograniczenia wyraźnie (jurysdykcja, zakres dat,

produkt, zespół) przed udzieleniem odpowiedzi

3. W swojej odpowiedzi zakotwicz twierdzenia w sekcjach ("W sekcji 'Retencja Danych'

...") zamiast mówić ogólnikowo

4. Jeśli odpowiedź zależy od drobnych szczegółów (daty, progi, klauzule),

zacytuj lub sparafrazuj je bezpośrednio

</long_context_handling>Zapobiega to problemowi "zagubienia w przewijaniu", w którym AI daje ogólne odpowiedzi, które w rzeczywistości nie angażują się w konkretną treść dokumentu.

Kompaktowanie dla Rozszerzonych Przepływów Pracy

W przypadku długotrwałych, obciążonych narzędziami przepływów pracy, które przekraczają standardowe okno kontekstowe, nowoczesne AI obsługuje "kompaktowanie" — świadome strat przejście kompresji nad wcześniejszym stanem rozmowy, które zachowuje informacje istotne dla zadania, jednocześnie drastycznie zmniejszając ślad tokenów.

Kiedy Używać Kompaktowania

- Wieloetapowe przepływy agentów z wieloma wywołaniami narzędzi

- Długie rozmowy, w których wcześniejsze tury muszą zostać zachowane

- Iteracyjne rozumowanie poza maksymalnym oknem kontekstowym

Najlepsze praktyki dla kompaktowania:

- Monitoruj użycie kontekstu i planuj z wyprzedzeniem, aby uniknąć osiągnięcia limitów

- Kompaktuj po głównych kamieniach milowych (np. fazach obciążonych narzędziami), nie w każdej turze

- Zachowaj prompty funkcjonalnie identyczne podczas wznawiania, aby uniknąć dryfu zachowania

- Traktuj skompaktowane elementy jako nieprzejrzyste; nie parsuj ani nie polegaj na wnętrznościach

Wymagania Dotyczące Cytowania

<citation_rules>

Kiedy używasz informacji z dostarczonych dokumentów:

- Umieszczaj cytaty po każdym akapicie zawierającym twierdzenia pochodzące z dokumentu

- Używaj formatu: [Nazwa Dokumentu, Sekcja/Strona]

- Nie wymyślaj cytatów. Jeśli nie możesz tego zacytować, nie twierdź tego

- Używaj wielu źródeł dla kluczowych twierdzeń, gdy to możliwe

- Jeśli dowody są skąpe, przyznaj to wyraźnie

</citation_rules>Orkiestracja Narzędzi - Zaawansowane Możliwości AI

Wywoływanie narzędzi AI — wywoływanie funkcji zewnętrznych, API i usług — to miejsce, w którym inżynieria promptów staje się inżynierią oprogramowania. Wykonanie tego poprawnie jest kluczowe dla niezawodnych aplikacji AI.

Najlepsze Praktyki Opisu Narzędzi

Jakość opisów narzędzi bezpośrednio wpływa na to, jak dobrze AI ich używa:

{

"name": "create_reservation",

"description": "Utwórz rezerwację w restauracji dla gościa. Użyj, gdy

użytkownik prosi o zarezerwowanie stolika z podanym nazwiskiem i godziną.",

"parameters": {

"type": "object",

"properties": {

"name": {

"type": "string",

"description": "Pełne imię i nazwisko gościa do rezerwacji."

},

"datetime": {

"type": "string",

"description": "Data i godzina rezerwacji (format ISO 8601)."

}

},

"required": ["name", "datetime"]

}

}Zauważ, że opis zawiera zarówno co narzędzie robi, jak i kiedy go używać. Pomaga to modelowi podejmować lepsze decyzje dotyczące wyboru narzędzi.

Zasady Używania Narzędzi

<tool_usage_rules>

- Jeśli istnieje narzędzie dla akcji, preferuj narzędzie nad poleceniami powłoki

(np. read_file zamiast cat)

- Ściśle unikaj surowego cmd/terminala, gdy istnieje dedykowane narzędzie

- Preferuj narzędzia nad wiedzą wewnętrzną, kiedy:

- Potrzebujesz świeżych lub specyficznych dla użytkownika danych (bilety, zamówienia, konfiguracje, logi)

- Odwołujesz się do konkretnych ID, URL-i lub tytułów dokumentów

- Po każdym wywołaniu narzędzia zapisu/aktualizacji, krótko powtórz:

- Co się zmieniło

- Gdzie (ID lub ścieżka)

- Wszelkie wykonane walidacje następcze

- Dla prostych pytań koncepcyjnych, unikaj narzędzi i polegaj na wiedzy

wewnętrznej dla szybkich odpowiedzi

</tool_usage_rules>Równoległość

Kluczową optymalizacją jest zachęcanie do równoległych wywołań narzędzi, gdy operacje są niezależne:

<parallelization_spec>

Uruchamiaj niezależne lub tylko do odczytu akcje narzędzi równolegle (ta sama tura/wsad)

aby zmniejszyć opóźnienia.

Kiedy zrównoleglać:

- Czytanie wielu plików/konfiguracji/logów, które nie wpływają na siebie nawzajem

- Analiza statyczna, wyszukiwania lub zapytania o metadane bez skutków ubocznych

- Oddzielne edycje niepowiązanych plików/funkcji, które nie będą w konflikcie

Kiedy NIE zrównoleglać:

- Operacje, w których jedna zależy od wyniku innej

- Tworzenie zasobu, a następnie odwoływanie się do jego ID

- Czytanie pliku, a następnie edytowanie w oparciu o zawartość

Metoda:

- Myśl najpierw: Przed każdym wywołaniem narzędzia, zdecyduj o WSZYSTKICH plikach/zasobach, których potrzebujesz

- Grupuj wszystko: Jeśli potrzebujesz wielu plików, czytaj je razem

- Wykonuj wywołania sekwencyjne tylko wtedy, gdy naprawdę nie możesz znać następnego pliku

bez zobaczenia wyniku najpierw

</parallelization_spec>Narzędzia Owijające Terminal

Jeśli chcesz, aby AI używała dedykowanych narzędzi zamiast poleceń terminala, spraw, aby były semantycznie podobne do tego, czego oczekuje model:

GIT_TOOL = {

"type": "function",

"name": "git",

"description": (

"Wykonaj polecenie git w katalogu głównym repozytorium. Zachowuje się jak "

"uruchomienie git w terminalu; obsługuje dowolne podpolecenie i flagi."

),

"parameters": {

"type": "object",

"properties": {

"command": {

"type": "string",

"description": "Polecenie git do wykonania"

}

},

"required": ["command"]

}

}

# Następnie w twoim prompcie:

"Używaj narzędzia `git` do wszystkich operacji git. Nie używaj terminala do git."Rozwiązywanie Problemów - Naprawianie Tego, Co Idzie Źle

Po pracy z niezliczonymi promptami, zidentyfikowałem najczęstsze wzorce niepowodzeń i ich rozwiązania.

Problem: Nadmierne Myślenie

Objawy: Odpowiedź jest poprawna, ale zajmuje wieczność. Model ciągle bada opcje, opóźnia pierwsze wywołanie narzędzia, opowiada okrężną podróż, gdy dostępna była prosta odpowiedź.

<efficient_context_spec>

Cel: Zdobądź wystarczający kontekst szybko i zatrzymaj się, jak tylko będziesz mógł działać.

Metoda:

- Zacznij szeroko, potem rozgałęziaj się do ukierunkowanych podzapytań

- Równolegle, uruchom 4-8 zróżnicowanych zapytań; czytaj 3-5 najlepszych wyników na zapytanie

- Deduplikuj ścieżki i cache'uj; nie powtarzaj zapytań

Wczesne zatrzymanie (działaj, jeśli jakiekolwiek):

- Możesz nazwać dokładne pliki/symbole do zmiany

- Możesz zreprodukować nieudany test/lint lub mieć locus błędu o wysokiej pewności

</efficient_context_spec>

# Dodaj także szybką ścieżkę dla prostych pytań:

<fast_path>

Dla wiedzy ogólnej lub prostych zapytań o użycie, które nie wymagają

poleceń, przeglądania lub wywołań narzędzi:

- Odpowiedz natychmiast i zwięźle

- Żadnych aktualizacji statusu, żadnych todo, żadnych podsumowań, żadnych wywołań narzędzi

</fast_path>Problem: Niedostateczne Myślenie / Lenistwo

Objawy: Model nie spędził wystarczająco dużo czasu na rozumowaniu przed wyprodukowaniem odpowiedzi. Płytkie odpowiedzi, pominięte przypadki brzegowe, niekompletne rozwiązania.

<self_reflection>

- Wewnętrznie oceń szkic w oparciu o rubrykę 5-7 elementów, którą opracujesz

(jasność, poprawność, przypadki brzegowe, kompletność, opóźnienie)

- Jeśli jakakolwiek kategoria jest niewystarczająca, iteruj raz przed udzieleniem odpowiedzi

</self_reflection>

# Lub użyj wyższego wysiłku rozumowania w parametrach APIProblem: Zbyt Uległy

Objawy: AI ciągle pyta o pozwolenie zamiast podejmować działania. Ciągłe "Czy chciałbyś, żebym..." zamiast po prostu to zrobić.

<persistence>

- Jesteś agentem — kontynuuj, aż zapytanie użytkownika zostanie całkowicie

rozwiązane przed zakończeniem twojej kolejki

- Zakończ tylko wtedy, gdy będziesz pewien, że problem jest rozwiązany

- Nigdy nie zatrzymuj się ani nie oddawaj sprawy, gdy napotkasz niepewność — wydedukuj

najbardziej rozsądne podejście i kontynuuj

- Nie proś o potwierdzenie lub wyjaśnienie założeń — zdecyduj, co jest

najbardziej rozsądne, postępuj i udokumentuj to do wglądu po zakończeniu

</persistence>Problem: Zbyt Gadatliwy

Objawy: AI generuje o wiele więcej tokenów niż potrzeba. Dużo preambuł, nadmierne wyjaśnienia, powtarzające się podsumowania.

# Użyj parametru gadatliwości API: "low"

# Lub w prompcie:

<output_format>

- Domyślnie: 3-6 zdań lub ≤5 punktorów

- Unikaj długich akapitów narracyjnych; preferuj kompaktowe punktory

- Nie parafrazuj mojej prośby, chyba że zmienia to semantykę

- Żadnych preambuł typu "Świetne pytanie!" lub "Chętnie pomogę"

</output_format>Problem: Zbyt Wiele Wywołań Narzędzi

Objawy: Model odpala narzędzia bez posuwania odpowiedzi do przodu. Nadmiarowe wywołania, badanie dygresji, nieefektywne wykorzystanie kontekstu.

<tool_use_policy>

- Wybierz jedno narzędzie lub żadne; preferuj odpowiadanie z kontekstu, gdy to możliwe

- Ogranicz wywołania narzędzi do 2 na żądanie użytkownika, chyba że nowe informacje

sprawiają, że jest to ściśle konieczne

- Przed wywołaniem narzędzia zweryfikuj, czy faktycznie potrzebujesz informacji

</tool_use_policy>Problem: Zniekształcone Wywołania Narzędzi

Objawy: Wywołania narzędzi kończą się niepowodzeniem, produkują śmieciowe wyjście lub nie pasują do oczekiwanego formatu. Często spowodowane sprzecznościami w prompcie.

Proszę zanalizuj, dlaczego wywołanie narzędzia [tool_name] jest zniekształcone.

1. Przejrzyj dostarczony przykładowy problem, aby zrozumieć tryb awarii

2. Zbadaj dokładnie Prompt Systemowy i Konfigurację Narzędzia

3. Zidentyfikuj wszelkie niejasności, niespójności lub sformułowania, które mogłyby

wprowadzić model w błąd

4. Dla każdej potencjalnej przyczyny wyjaśnij, jak mogłoby to skutkować

obserwowaną awarią

5. Dostarcz wykonalne rekomendacje, aby poprawić prompt lub

konfigurację narzędziaWiększość problemów ze zniekształconymi wywołaniami narzędzi wynika ze sprzeczności między różnymi sekcjami promptu. Model spala tokeny rozumowania próbując pogodzić sprzeczne instrukcje zamiast pomagać.

Optymalizacja Promptów - Podejście Naukowe

Tworzenie skutecznych promptów to umiejętność, ale ich ulepszanie to nauka. Oto systematyczne podejście, którego używam.

Typowe Błędy Promptów

Zanim zaczniesz optymalizować, zrozum, co zazwyczaj idzie źle:

"Preferuj bibliotekę standardową", a potem "używaj zewnętrznych pakietów, jeśli upraszczają rzeczy" - AI nie może pogodzić tych mieszanych sygnałów.

"Dąż do dokładnych wyników; metody przybliżone są w porządku, gdy nie zmieniają wyniku w praktyce" - model nie może zweryfikować tego osądu.

Jeśli potrzebujesz JSON, powiedz to. Jeśli potrzebujesz punktorów, powiedz to. Nie zostawiaj formatu wyjściowego przypadkowi.

Twoje instrukcje mówią jedno, ale twoje przykłady pokazują coś innego. AI podąża za przykładami bardziej niż za prozą.

Pętla Optymalizacji

Uruchom swój obecny prompt wiele razy i udokumentuj wyniki. Zauważ wzorce zarówno w sukcesach, jak i porażkach.

Kategoryzuj awarie. Czy są to problemy z poprawnością? Problemy z formatem? Problemy z wydajnością? Każdy wymaga innych poprawek.

Zmieniaj jedną rzecz na raz. Jeśli zmienisz wiele rzeczy, nie będziesz wiedział, co pomogło.

Uruchom te same testy ponownie. Porównaj z linią bazową. Czy zmiana pomogła, zaszkodziła, czy nie miała wpływu?

Powtarzaj, aż osiągniesz akceptowalną wydajność. Rób notatki o tym, co zadziałało, a co nie.

Migracja Między Modelami

Podczas migracji promptów do nowej wersji modelu:

Najlepsze Praktyki Migracji

- Krok 1: Zmień modele, nie zmieniaj jeszcze promptów. Testuj zmianę modelu — nie edycje promptu.

- Krok 2: Przypnij wysiłek rozumowania, aby dopasować go do profilu poprzedniego modelu.

- Krok 3: Uruchom ewaluacje dla linii bazowej. Jeśli wyniki wyglądają dobrze, jesteś gotowy do wdrożenia.

- Krok 4: Jeśli nastąpi regresja, dostrój prompt za pomocą ukierunkowanych ograniczeń.

- Krok 5: Uruchom ponownie ewaluacje po każdej małej zmianie. Jedna zmiana na raz.

Obsługa Niepewności - Kiedy AI Nie Wie

Jednym z największych ryzyk związanych z AI są pewnie brzmiące niepoprawne odpowiedzi. Model nie wie, czego nie wie — chyba że nauczysz go, jak radzić sobie z niepewnością.

<uncertainty_handling>

- Jeśli pytanie jest niejednoznaczne lub niedostatecznie określone, wyraźnie to zaznacz i:

- Zadaj do 1-3 precyzyjnych pytań wyjaśniających, LUB

- Przedstaw 2-3 prawdopodobne interpretacje z wyraźnie oznaczonymi założeniami

- Gdy fakty zewnętrzne mogły się ostatnio zmienić (ceny, wydania,

polityki) i żadne narzędzia nie są dostępne:

- Odpowiedz ogólnie i zaznacz, że szczegóły mogły ulec zmianie

- Nigdy nie fabrykuj dokładnych liczb, numerów linii ani zewnętrznych odniesień

gdy jesteś niepewny

- Gdy nie jesteś pewien, preferuj język taki jak "W oparciu o dostarczony

kontekst..." zamiast absolutnych twierdzeń

</uncertainty_handling>Samokontrola Wysokiego Ryzyka

Dla domen o wysokiej stawce, dodaj wyraźny krok weryfikacji własnej:

<high_risk_self_check>

Przed sfinalizowaniem odpowiedzi w kontekstach prawnych, finansowych, zgodności lub

wrażliwych na bezpieczeństwo:

- Krótko przeskanuj własną odpowiedź pod kątem:

- Niewypowiedzianych założeń

- Konkretnych liczb lub twierdzeń niepopartych w kontekście

- Zbyt silnego języka ("zawsze", "gwarantowane", itp.)

- Jeśli znajdziesz jakiekolwiek, złagodź je lub zakwalifikuj i wyraźnie określ założenia

</high_risk_self_check>Celem nie jest sprawienie, by AI była mniej pewna siebie — chodzi o to, by była pewna siebie w sposób dokładny. Niepewność co do niepewnych rzeczy to cecha, a nie błąd.

Metaprompting - Używanie AI do Ulepszania AI

Oto najbardziej meta technika w moim zestawie narzędzi: używanie AI do ulepszania twoich promptów. Brzmi to cyklicznie, ale jest niezwykle skuteczne.

Diagnozowanie Awarii Promptów

Jesteś inżynierem promptów odpowiedzialnym za debugowanie promptu systemowego.

Otrzymujesz:

1) Obecny prompt systemowy:

<system_prompt>

[WKLEJ SWÓJ PROMPT TUTAJ]

</system_prompt>

2) Mały zestaw zarejestrowanych awarii. Każdy log ma:

- zapytanie

- faktyczny_wynik

- oczekiwany_wynik (lub opis problemu)

<failure_traces>

[WKLEJ PRZYKŁADY AWARII]

</failure_traces>

Twoje zadania:

1) Zidentyfikuj odrębne tryby awarii, które widzisz

2) Dla każdego trybu awarii zacytuj konkretne linie promptu systemowego,

które najprawdopodobniej go powodują lub wzmacniają

3) Wyjaśnij, w jaki sposób te linie kierują agenta w stronę

obserwowanego zachowania

Zwróć odpowiedź w ustrukturyzowanym formacie:

failure_modes:

- name: ...

description: ...

prompt_drivers:

- exact_or_paraphrased_line: ...

- why_it_matters: ...Generowanie Ulepszeń

Wcześniej analizowałeś ten prompt systemowy i jego tryby awarii.

Prompt systemowy:

<system_prompt>

[ORYGINALNY PROMPT]

</system_prompt>

Analiza trybu awarii:

[WKLEJ DIAGNOZĘ Z POPRZEDNIEGO KROKU]

Proszę, zaproponuj chirurgiczną rewizję, która zredukuje obserwowane problemy

przy jednoczesnym zachowaniu dobrych zachowań.

Ograniczenia:

- Nie projektuj agenta od nowa

- Preferuj małe, jawne edycje: wyjaśnij sprzeczne zasady, usuń

zbędne lub sprzeczne linie, zaostrz niejasne wskazówki

- Uczyń kompromisy jawnymi

- Zachowaj strukturę i długość z grubsza podobną do oryginału

Wynik:

1) patch_notes: zwięzła lista kluczowych zmian i uzasadnienie

2) revised_system_prompt: pełny zaktualizowany prompt z zastosowanymi edycjamiAutorefleksja dla Jakości

Ta technika jest oszałamiająca: poinstruuj AI, aby stworzyła własne kryteria oceny i iterowała względem nich:

<self_reflection>

- Najpierw poświęć czas na przemyślenie rubryki, aż będziesz pewien

- Pomyśl głęboko o każdym aspekcie tego, co stanowi rozwiązanie

światowej klasy. Użyj tej wiedzy, aby stworzyć rubrykę, która ma 5-7

kategorii. Ta rubryka jest kluczowa, aby zrobić to dobrze, ale nie

pokazuj mi tego — to jest tylko dla twoich celów.

- Na koniec użyj rubryki, aby wewnętrznie przemyśleć i iterować nad

najlepszym możliwym rozwiązaniem promptu

- Jeśli twoja odpowiedź nie osiąga najwyższych ocen we wszystkich

kategoriach w rubryce, zacznij od nowa

</self_reflection>Prosicie AI o wygenerowanie kryteriów jakości na podstawie jej wiedzy o doskonałości, a następnie użycie tych kryteriów do oceny i poprawy własnego wyniku — wszystko zanim cokolwiek zobaczysz. Poprawa jakości wyniku jest znaczna.

Sprawdzone w Boju Szablony, Których Możesz Użyć Dzisiaj

Uniwersalne Ukończenie Zadania

<context>

[Informacje ogólne, których AI potrzebuje, aby zrozumieć sytuację]

</context>

<task>

[Jasne określenie tego, co chcesz zrobić]

</task>

<requirements>

[Konkretne wymagania lub ograniczenia]

</requirements>

<format>

[Jak chcesz, aby wynik był ustrukturyzowany]

</format>

<examples>

[Opcjonalnie: Przykłady pożądanego wyniku]

</examples>Szablon Przeglądu Kodu

<context>

Przeglądam kod dla [projekt/kontekst].

Baza kodu używa [technologie/wzorce].

</context>

<code_to_review>

[Wklej kod tutaj]

</code_to_review>

<review_criteria>

Skup się na:

1. Poprawność: Czy robi to, co deklaruje?

2. Czytelność: Czy jest jasny dla innych deweloperów?

3. Wydajność: Jakieś oczywiste nieefektywności?

4. Bezpieczeństwo: Jakieś podatności?

5. Styl: Czy pasuje do konwencji bazy kodu?

</review_criteria>

<output_format>

Dla każdego znalezionego problemu:

- Dotkliwość: [Krytyczna/Poważna/Drobna/Sugestia]

- Lokalizacja: [Numer wiersza lub sekcja]

- Problem: [Co jest nie tak]

- Poprawka: [Jak to rozwiązać]

</output_format>Szablon Analizy Badawczej

<research_task>

[Temat lub pytanie do zbadania]

</research_task>

<methodology>

- Zacznij od wielu ukierunkowanych wyszukiwań; nie polegaj na pojedynczym zapytaniu

- Badaj głęboko, aż będziesz mieć wystarczająco dużo informacji dla

dokładnej, kompleksowej odpowiedzi

- Dodaj ukierunkowane wyszukiwania uzupełniające, aby wypełnić luki lub rozwiązać spory

- Kontynuuj iterację, aż dodatkowe wyszukiwanie prawdopodobnie nie zmieni

odpowiedzi

</methodology>

<output_requirements>

- Zacznij od jasnej odpowiedzi na główne pytanie

- Wesprzyj dowodami i cytatami

- Uznaj ograniczenia i niepewności

- Podaj konkretne przykłady, gdzie to pomocne

- Dołącz istotny kontekst dla zrozumienia implikacji

</output_requirements>

<citation_format>

[Jak chcesz, aby źródła były cytowane]

</citation_format>Agent Badań Internetowych

<core_mission>

Odpowiedz na pytanie użytkownika w pełni i pomocnie, z wystarczającymi dowodami,

aby sceptyczny czytelnik mógł mu zaufać.

Nigdy nie wymyślaj faktów. Jeśli nie możesz czegoś zweryfikować, powiedz to wyraźnie.

Domyślnie bądź szczegółowy i użyteczny, a nie krótki.

Po udzieleniu odpowiedzi na bezpośrednie pytanie, dodaj materiały dodatkowe o wysokiej wartości,

które wspierają podstawowy cel użytkownika bez odchodzenia od tematu.

</core_mission>

<research_rules>

- Zacznij od wielu ukierunkowanych wyszukiwań; używaj wyszukiwań równoległych

- Nigdy nie polegaj na pojedynczym zapytaniu

- Kontynuuj iterację, aż wszystko będzie prawdą:

- Odpowiedziałeś na każdą część pytania

- Znalazłeś konkretne przykłady i materiały dodatkowe o wysokiej wartości

- Znalazłeś wystarczające źródła dla głównych twierdzeń

</research_rules>

<citation_rules>

- Umieszczaj cytaty po każdym akapicie zawierającym nieoczywiste

twierdzenia pochodzące z sieci

- Nie wymyślaj cytatów

- Używaj wielu źródeł dla kluczowych twierdzeń, gdy to możliwe

</citation_rules>

<ambiguity_handling>

- Nigdy nie zadawaj pytań wyjaśniających, chyba że użytkownik wyraźnie o to poprosi

- Jeśli zapytanie jest niejednoznaczne, podaj swoją najlepszą interpretację, a następnie

kompleksowo omów najbardziej prawdopodobne intencje

</ambiguity_handling>Przyszłość Inżynierii Promptów

Pisząc to na początku 2026 roku, inżynieria promptów ewoluuje szybko. Modele stają się bardziej zdolne, bardziej sterowalne i bardziej niezawodne. Niektórzy przewidują, że inżynieria promptów stanie się przestarzała, w miarę jak AI będzie coraz lepiej rozumieć intencje. Nie zgadzam się.

Zmienia się poziom inżynierii promptów, a nie jej konieczność. Wczesne dni wymagały skomplikowanych promptów do podstawowych zadań. Teraz podstawowe zadania działają od razu po wyjęciu z pudełka, ale złożone przepływy pracy agentów nadal wymagają wyrafinowanego promptingu. Poprzeczka się podnosi, a nie znika.

Inżynieria promptów nie odchodzi — ewoluuje. Umiejętności, które się liczą, przesuwają się z "jak sprawić, by AI działała" na "jak sprawić, by AI działała doskonale i niezawodnie na dużą skalę."

Co Nadchodzi

Lepsze Zachowania Domyślne

Modele będą miały mądrzejsze ustawienia domyślne, wymagające mniej jawnych instrukcji dla typowych wzorców. Prompty skupią się bardziej na dostosowywaniu niż na podstawowych możliwościach.

Bogatsze Ekosystemy Narzędzi

AI będzie miała dostęp do większej liczby narzędzi od razu po wyjęciu z pudełka. Inżynieria promptów przesunie się w stronę orkiestracji — wiedzy, kiedy czego użyć, a nie tylko jak.

Integracja Multimodalna

Prompty będą coraz częściej obejmować obrazy, dźwięk, wideo i ustrukturyzowane dane obok tekstu. Pojawią się nowe wzorce dla zadań multimodalnych.

Złożoność Agentowa

W miarę jak agenci będą obsługiwać dłuższe, bardziej złożone zadania, inżynieria promptów stanie się bardziej podobna do projektowania systemów — architektury, a nie tylko instrukcji.

Moja Rada na Przyszłość

Skup się na fundamentach. Konkretne techniki w tym przewodniku będą ewoluować, ale podstawowe zasady — jasna komunikacja, wyraźne oczekiwania, ustrukturyzowane myślenie, iteracyjne udoskonalanie — są ponadczasowe. Opanuj je, a dostosujesz się do wszystkiego, co nadejdzie.

Końcowe Przemyślenia

Dwa lata temu myślałem, że AI zastąpi potrzebę jasnej komunikacji. Całkowicie się myliłem. AI sprawiła, że jasna komunikacja jest cenniejsza niż kiedykolwiek. Ludzie, którzy odnoszą sukcesy z AI, to nie ci, którzy znaleźli magiczne słowa — to ci, którzy nauczyli się myśleć i wyrażać siebie z precyzją.

Inżynieria promptów tak naprawdę nie dotyczy AI. Dotyczy ciebie. Dotyczy rozwijania dyscypliny, by artykułować to, czego faktycznie chcesz, cierpliwości, by iterować w tym kierunku, i pokory, by uczyć się na tym, co nie działa.

Jeśli weźmiesz jedną rzecz z tego przewodnika, niech to będzie to: traktuj każdy prompt jako szansę na ćwiczenie jasnego myślenia. AI to tylko lustro odbijające jasność — lub zamieszanie — twojego własnego umysłu.

Pojawienie się AI nie sprawiło, że wiedza stała się przestarzała — sprawiło, że ciekawość stała się potężniejsza niż kiedykolwiek. Nie jesteśmy już ograniczeni przez to, co już wiemy. Z odpowiednimi narzędziami i chęcią do myślenia, zwykli ludzie mogą objąć ocean wiedzy. Bez względu na zawód. Bez względu na wiek. Mam nadzieję, że podzielę się tą podróżą z przyjaciółmi na całym świecie. Razem, powitajmy ten nowy świat. Razem, wzrastajmy.

Dyskusja

0 komentarzyZostaw komentarz

Bądź pierwszym, który podzieli się swoimi przemyśleniami!